The base of THREADE

Даже если твоя правая рука сильнее левой, не забывай про зарядку.

Даже если твоя правая рука сильнее левой, не забывай про зарядку.

>И не используй iq кванты с мое, замедление очень существенное.

Другой крокодил Конкретно для Air, iq кванты имеют большой смысл. У меня память в конфигурации 12v+8v+64r - и статический квант, даже q4_ks туда нормально не лезет. А вот Iq4xs - влазит спокойно. Субъективная же разница по качеству вывода с Q3 на котором мне бы пришлось сидеть со статикой - весьма высока. Причем скорость генерации у меня все равно достаточно комфортная, скорее время процессинга напрягает, при большом контексте (но это и на Q3 так). Так что, не стоит так категорично от них отговаривать.

>512гб ддр4 серверной стоят 37к, доска 6-7к, процы по 3-5к

Это где такие цены?

Мне тут неделю назад советовали glm air 4.5

Наконец-то дошли руки и ...? Как это запустить? Даже в 4 кванте это 60+ Гб. Вы по 2 токена в секунду генерируете?

Или я что-то упускаю? Посоветуйте что-нибудь крутое для рп на 24 врама.

Алсо, кто-нибудь тут экспериментировал с долгосрочной памятью - эмбедингами или rag?

Наконец-то дошли руки и ...? Как это запустить? Даже в 4 кванте это 60+ Гб. Вы по 2 токена в секунду генерируете?

Или я что-то упускаю? Посоветуйте что-нибудь крутое для рп на 24 врама.

Алсо, кто-нибудь тут экспериментировал с долгосрочной памятью - эмбедингами или rag?

> Как это запустить?

Тредов пять уже все обсуждают как. Берешь и запускаешь.

Это же МОЕ.

>Вы по 2 токена в секунду генерируете?

По три. Вечером попробую линь накатить и из под неё запускать.

И что, она НАСТОЛЬКО круче, что стоит этих компромиссов?

поставил на скачивание

Вообще, по 6-12.

Нет, конечно, тут сам пердолинг вставляет

Это небось на риге из 4090.

В 4-ом кванте - да. (Но русский у нее весьма слабый сам по себе, за ним - лучше куда-то еще). В третьем кванте - внешне пишет красивше чем мистраль с геммой, но при этом плосковато, серьезной глубины не чувствуется. А вот в четвертом - это да. Прямо сильно лучше, IMHO. И четвертый iq4xs - это как раз 62 Гб, вместе в vram остается на систему, если 64Гб на борту.

На 4090+ddr5 на аире 12-17 т.с.

На двухбитном 2_k_s квене - 9-12 т.с.

Вот у меня как раз 64рама и есть. Посмотрю, но настроен скептично, если честно.

А без пердолинга есть что-то крутое для русского рп чтобы полностью в 24врам влезло?

Из последнего что я тыкал и мне понравилось - сидонька, её мерж с пантеоном (вроде) и некий darkatom.

Анрелейтед к тому, просто нужна такая с не-фурри.

Это приличный представитель современных моделей что уже достаточно умны и в базе могут в рп, пусть и младший.

> для русского рп

Гемма, лол. Русский в айэр и жлм 4.5 в целом мэх, само рп хорошее, особенно в большом.

Какое совпадение, у меня тоже 4090 и 64гб ддр5. Запускаю гуфф с ламма.сср как тут советуют. И 2,5 токена на озу. И это на q3 лишь.

Ну значит вы прокляты.

Заебало уже переливать из пустого в порожнее. Почему то у анонов, которые делали отзывы на квен/эйр и приносили скриншоты - все работает быстро.

А тут на 4090 не работает. Мммагия..

> А без пердолинга

Весь пердолинг это написать батник, скопировав его с позапозапрошлого треда. Погуглить что за что отвечает, изменить как твоей душе угодно и жамкать запуск.

Никогда еще так в жизни не пердолился. И это пишу я, та еще обезьяна, которая не отличит / от \.

Нет, если конечно тензоры ручками выгружать, это уже похоже на пердолинг. Но разобравшись, это обычная работа с таблицей. Это значение поменьше сюда, побольше сюда.

В Жоре вообще можно адовые кадавры писать. Даже ручками прокидывать на конкретную видеокарту.

Еще бы доки к Жоре были написаны для таких как я, цены бы ему не было.

Taobao

>Весь пердолинг это написать батник

... И получить 2,5 т/с.

>Нет, если конечно тензоры ручками выгружать, это уже похоже на пердолинг.

Есть же цпу-мое. Там ручками только 1 число прописать. Я вот на квене 235 выгружаю 68 мое-слоёв на проц, и всё работает весьма быстро, свой десяток токенов там есть.

>... И получить 2,5 т/с.

Я тебя съем, даже костей не останется. Не беси меня

АББРВЛГХХХХХ

Сука, 4й тред по счёту ебался с ламой (скоро шерстью обрасту как горцы), и чтобы хоть кто помог, только троллить горазды, ни одного дельного совета. Даже линь не нужна с её х2 еблей. Условия всё те же, тот же айр q3, 10к/32к, 4090...

И как добился буста в тех трех токенов?

Если бы ты хотел разобраться, вменяемо делился своими аргументами запуска , а не кокетничал, отвечая в духе "мне уже давали советы, не помогло", я бы тебе помог разобраться. Но ты два треда подряд отказываешься принять, что просто не разобрался, как запускать, и все тут. Всякое желание помогать пропадает. Это тебе надо, а не треду.

> я бы тебе помог

Приехал бы ко мне и вытащил физически теслы, потому что убогая лама не умеет работать вместе с ними в отличии от кобольда?

> и чтобы хоть кто помог, только троллить горазды, ни одного дельного совета

> Приехал бы ко мне и вытащил физически теслы, потому что убогая лама не умеет работать вместе с ними в отличии от кобольда?

И тебе хорошего настроения и прекрасной погоды на четырех сторонах.

Странный ты.

>помогите, пидоры

>хуй вы чем поможете, Теслы виноваты.

Huh ?!

Чел, тебе про теслы в мусорку чуть ли не первым постом ответили. Кобольд - лишь обертка лламы.

вот тут в систем промте описано скрытие инфы

https://www.characterhub.org/characters/novisini/funtime-entertainment-2f4be001a1a9

Виновата лама, которая с доп карточками работает хуже чем без них. И никто даже не обмолвился что так может быть, хотя экспертов из себя строили.

Но коммандер на кобальте с ними лучше работает. Может проблема в ламе?

> Может проблема в ламе?

А может ты просто криворукий уебан, которого корежит от собственной беспомощности.

>помогите, пидоры

>хуй вы чем поможете, Теслы виноваты.

А на деле

>помогите

>лол, ну ты кобольд

>ладно, сам справился

>криворукий уебан

> вы мне не помогаете, пидорасы

> никто тебе не поможет, если ты называешь их пидорасами, пидорас

> что и требовалось доказать, вы пидорасы

> дурка или школа

лол, меня обозвали пидорасом, а теперь ещё и обвиняют что это я первый начал, и поэтому не помогали? Какой-то турбогазлайтинг.

> И никто даже не обмолвился что так может быть, хотя экспертов из себя строили.

Ну теперь знаем, лол.

Сорян анон, у меня две одинаковые карточки, были правда, лол. Подобных проблем не было.

Я смотрю в треде орудует банда кобальтов.

Братство свидетелей круглых тензоров

Теперь бы узнать как научить ламу игнорировать теслы, потому что я привык на одной поднимать мелкогемму для перевода.

> с доп карточками

С некротой, если офк речь на про ik форк.

> на кобальте

Нет, кобольд это лишь васян-обертка ничего нового не привносящая по этой части, скорее наоборот. Вероятно, они оформили компиляцию на старой куде и/или с определенными флагами, чтобы оно лучше работало на совсем некроте, но при этом тормозило на относительно актуальной железе, на что тут многие жалуются. Вот в твоем случае оно и попало, хотя чаще наоборот подсирает.

Ору с пика

>Теперь бы узнать как научить ламу игнорировать теслы

Куда визибле девайс же, тоже мне тайное знание.

Блядь, уже всё выкладывали в треде, надо только оформить в вики треда. но всем лень ((

>Нет, кобольд это лишь васян-обертка

Почему васян обёртка при настройке "используй основную видяху, остальное грузи на проц+озу" именно так и делает, а лама зачем-то задействует теслы?

Даже так поставлю вопрос, как сделать чтобы она себя вела как кобольд?

Как в гуи кобольда/лм студии? И какие параметры нужны?

Твоя криворукость подход к запуску удачно совпал с его забагованностью/странностью, от чего ты словил космический эффект и доказываешь что белое это черное.

> как сделать чтобы она себя вела как кобольд

> компьютер не работает как починить

Без подробностей звучит именно так. Про маску куда тебе в первых постах написали если что.

Зачем читать документацию или хотя бы вникать в то, что пишут аноны, когда можно потратить то же время на создание смешной картинки...

Кобольд - в твоем случае приговор. Не разберешься с Лламой, терпи 3 токена на q3

Аноны, умоляю, может кто-то дать нормальный систем промпт для игры с несколькими персонажами в рп/ерп. Я того его рот ебал, пытался несколько раз юзать то что писал сам - вышло говно.

>но всем лень ((

But you can do it !

>Как в гуи кобольда/лм студии?

Никак, это в консоли выставляется.

Мне тоже лень.

>Про маску куда тебе в первых постах написали если что.

И я про неё ответил в первых постах. С маской только на 4090 2,5 токена. С цпу-мое тоже 2,5 токена. С разбиением на теслы - 3.

Нет, не надо. Так в треде остаются самые заинтересованные -> самые умные или как минимум способные к тому, чтобы разбираться самостоятельно. Таких идиотов как кобольд выше хотелось бы поменьше. Думаю, потому до сих пор и не нашелся герой

Посмотри в acig, лол.

В части пердолинга с промтами именно для ЕРП - у них опыт богаче.

>Никак, это в консоли выставляется.

Так мне это и надо. Наверняка есть параметры запуска для этого, иначе бы как кобольд из коробки правильно работал.

Просто проставь в энв перед запуском экзешника. У каждого фреймворка это свои энвы, у зелёных это куда визибл дивайсес, у красных хип визибл девайсес

> С маской

CUDA_VISIBLE_DEVICES

> С цпу-мое

Неюзабельно при мультигпу

> С разбиением

С каким именно разбиением?

Хотя ладно, уже то что в самом начале ныл про то что на 4090 плохо, а про 2 теслы выяснилось через хрен знает сколько постов - уже признак.

Я справился всего за час пердолинга.

Сбилдил сам llama.cpp под куду. На винде понятное дело без ебучих ошибок не обойтись. Но за час управился.

И ллама без лишних вопросов сожрала 4 квант глм.

И отвечает даже бодрее чем я думал.

Правда я пока через cli общаюсь, а тут нет спидометра, чтобы замерить скорость.

Завтра уже накачу какой нибудь юай (какой кстати выбрать?) и отрапортую.

мимо 4090 64ddr4 + amd r7 5700x3d

>Так в треде остаются

И где они, эти оставшиеся? И нахуя им тут сидеть, если в треде сплошной гейкип?

>Наверняка есть параметры запуска для этого

Ты сука блядь троллишь. Даже тупой ИИ умнее тебя и даёт ответ с первой попытки. Но я уверен, что и тут ты обосрёшься, потому что совет под люнупс, а у тебя шинда, и ты не сможешь найти в гугле нужную команду.

Таверна. Как минимум потому что семплеры не придется писать ручками. Да и в целом, лучше таверны нет, как и хуже.

пукни и прокрутись три раза вокруг себя, все заработает. ну можешь еще доки почитать а не чатгпт умолять это сделать за тебя

Ты идиот?

Тупой вопрос, на раз ссаными тряпками не выгнали, можно и задать.

Что есть семплеры? Типо системных промтов?

А Кобольд? Это же тоже фронт? Или это полный пакет вместе с самой ламой?

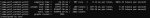

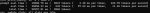

Оказывается, при остановке лламы выводится метрика - пикрилейтед.

В русском он действительно оказался не силен.

попросил придумать 10 синонимов слову "вагина" - получил всякие расселина, разлом, прореха, раздел. Покекал с этого спелеолога.

Вижу, что основную нагрузку берет проц, а не видяха.

Запускаю с дефолтной командой (только слои свои выставил)

llama-cli -cnv -c 16384 -ngl 15 -m C:\Users\Downloads\GLM-4.5-Air-IQ4_XS-00001-of-00002.gguf

Есть с чем поэкспериментировать? Жпт предложил вот эту команду

.\build\bin\Release\llama-cli.exe ^

-m "E:/models/your.gguf" ^

-ngl 999 ^

-c 2048 ^

--no-kv-offload ^

-b 2048 ^

--ubatch 512 ^

--flash-attn

Но кажется он хочет меня наебать. Если пытаюсь загрузить с ngl больше, чем физически влезает - падает по out of memory, потому что пытается зарезервировать на видяхе все 60гигов.

> 10 синонимов слову "вагина"

А должен был начать задвигать про курагу и согнутую пиццу?

>Что есть семплеры?

Заодно с методами выборки.

https://gist.github.com/kalomaze/4473f3f975ff5e5fade06e632498f73e

>А Кобольд? Это же тоже фронт?

>Шапка

>Самый простой в использовании и установке форк llamacpp: https://github.com/LostRuins/koboldcpp

>Оказывается, при остановке лламы выводится метрика - пикрилейтед.

Она выводится и до и после генерации.

>Жпт предложил вот эту команду

Жпт может пососать хуй, как и ты ленивый пидр. Посмотри что означает каждая команда,

Да всего то нужно было

set CUDA_VISIBLE_DEVICES=0

llama-server -m GLM-4.5-Air-Q3_K_S-00001-of-00002.gguf -ngl 999 -c 32768 -fa --prio-batch 2 -ub 2048 -b 2048 -ctk q8_0 -ctv q8_0 --no-context-shift --mlock --n-cpu-moe 32

На случай если у кого тоже зоопарк с теслами.

>Даже тупой ИИ умнее тебя

А ничего что он выдал на линь?

>Что есть семплеры?

Это то что вот в этой вкладке

Немного копаний с теслами.

Использование только одной, роняет скорость до 6-8 токенов, когда вторя добивает до 3. Онли 4090 -13-15 токенов.

Если есть аноны с мультиГПУ советую проверить момент, возможно все карточки заметно слабее ведущей надо принудительно вырубать. Порог "слабости" пока не ясен. Возможно играет роль способ подключения, теслы висели на 4х линиях (а больше на десктоп матери взять неоткуда), а у тесел лишь 3.0 поддерживается.

Использование только одной, роняет скорость до 6-8 токенов, когда вторя добивает до 3. Онли 4090 -13-15 токенов.

Если есть аноны с мультиГПУ советую проверить момент, возможно все карточки заметно слабее ведущей надо принудительно вырубать. Порог "слабости" пока не ясен. Возможно играет роль способ подключения, теслы висели на 4х линиях (а больше на десктоп матери взять неоткуда), а у тесел лишь 3.0 поддерживается.

На 4070ti и DDR4 — 6-7. Q4_K_S.

Видеокарта тут меньше влияет, лишь бы память была.

Про куда_визибл_дейвайсес как раз хотел написать. Опередил.

>Видеокарта тут меньше влияет, лишь бы память была.

Перечитай спор растянувшийся на 4 треда))

TL;DR;

Короче теслы без CUDA_VISIBLE_DEVICES убивают производительность токенизации в 15 раз и генерации в 6 раз.

Естественно все начали писать "ну очевидно надо было указать в среде..." лишь после того как я сообщил что проблема решилась физическим отключением тесел.

И как там с rp на русском? Лучше чем 32b модельки или нет? Мне стоит тратить ради этого 6к на 16 гигов доп оперативки или не особо лучше? Насколько та же Claude Haiku 3.5 пизже будет?

Очень интересно.

>ради этого 6к на 16 гигов доп оперативки

Надеюсь не 3 и 4 плашкой, ведь так?

> CUDA_VISIBLE_DEVICES

Эта штука слишком очевидная для многих, как снять штаны перед тем как сесть срать. А вот то что ты ныл про перфонмас 4090 скрывая наличие некротесел, подразумевая это дефолтом, вот это вообще не ок, о чем сразу написали и предложили их выкинуть, запустив на одной 4090.

> лишь после того как я сообщил

Лол, может еще расскажешь что на них фп16 не работает? Хотя эффект в целом странный, потому что у другого их выкидывание как раз замедляет. Кто-то нахуевертил что-то странное.

>А ничего что он выдал на линь?

У тебя контекстное окно 16 токенов? Я про это и написал. Хорошо что ты сумел найти нужную команду, спустя всего лишь 5 тредов. Но жаль, что не написал итоговые скорости.

>Эта штука слишком очевидная для многих

Что за 4 треда никто не назвал

>скрывая наличие некротесел

Ещё в позапрошлом треде подробно обсуждали и мне советовали скриптом поиграться раскидывая тензоры между картами вручную или использовать cpu-moe.

-->

Аноны привет.

щас буду ныть.

Заебался, сука, я от вашего мистраля 24б. Ну тупое же. ТУПОЕ пиздец , 4кхл квант. Очень ТУПОЕ так еще и блять 6 токенов в секунду всего, с выгрузкой.

Что нибудь ХОТЬ ЧТО НИБУДЬ БЛЯДЬ получше него я могу запустить на i711700k, 3060 12 vram 32 ram ddr4?

Или подскажите плз, сколько РАМа мне надо добавить и какой ddr4 или ddr5, чтобы компенсировать отсутствие ВРАМа? Видюху я ебал покупать ну денег нет сука. Чтобы я смог нормальные сука модели запускать, ради которых даже карточки писать не в падлу будет.

Но вопрос первый остается открытым. посоветуйте что то сука лучше мистраля на моем конфиге чтобы УМНОЕ ХОТЬ ЧУТЬ ЧУТЬ УМНЕЕ.

щас буду ныть.

Заебался, сука, я от вашего мистраля 24б. Ну тупое же. ТУПОЕ пиздец , 4кхл квант. Очень ТУПОЕ так еще и блять 6 токенов в секунду всего, с выгрузкой.

Что нибудь ХОТЬ ЧТО НИБУДЬ БЛЯДЬ получше него я могу запустить на i711700k, 3060 12 vram 32 ram ddr4?

Или подскажите плз, сколько РАМа мне надо добавить и какой ddr4 или ddr5, чтобы компенсировать отсутствие ВРАМа? Видюху я ебал покупать ну денег нет сука. Чтобы я смог нормальные сука модели запускать, ради которых даже карточки писать не в падлу будет.

Но вопрос первый остается открытым. посоветуйте что то сука лучше мистраля на моем конфиге чтобы УМНОЕ ХОТЬ ЧУТЬ ЧУТЬ УМНЕЕ.

Попробуй qwen30a3b с thinking. А так все тупые будут, надо промптом как-то закрывать. А, еще qwq-snowdrop с thinking, но большеват конечно. Надо тут еще самому понатыкивать. Попробуй nemotron thinking мелкий. Сам пробовал только большой, он бомбовый, насчет мелких не знаю

----

https://github.com/koolara/Local-LLM-Wiki

Анонцы, пока только открыл. Буду потихоньку наполнять контентом. Если хотите пульте хуйню (или сюда пасты), смержу или как там. Также давайте придерживаться практики указания источников, если откуда понатырили инфу. Я гитом пользовался до этого, но нехотя. Короче цель иметь Википедию, на которую можно ссылаться. Вроде как-то можно на гите просто вики замутить, но я не ебу.

>qwen30a3b

пробовал

пишет слишком уебански я бы сказал. такое себе для рп.

подскажи, сколько ram добавить чтоб запускать более менее норм модельки умные ? Ты сам на каком железе?

Ну квен тот же 32b это гигабайт 23 на саму модель, еще выделить на контекст места. GLM-4 тоже где-то так. 32гб видеопамяти надо.

Сам на двух mi50 64гб врама (и мне мала). Здесь можно скейлить до бесконечности, вплоть до 600b параметров моделей и это уже другой разговор совсем для железа. Простой вариант попробовать moe-шки. Модели которые не все параметры свои сразу задействуют, за счет чего получаем скорость. Тогда мы можем часть тензоров выгрузить на оперативную память и получить все равно приличные скорости.

Из таких qwen-235b и glm-4.5 air в идеале набрать 256гб оперативной памяти. Или 128гб если впадлу сильно расширяться.

Одноклассников мистраля - гемму, жлм4 который 32б, qwq.

> 32 ram ddr4

Если двумя плашками - еще две плашки по 32 гига. Будет не быстро.

> Анонцы, пока только открыл.

> Официальная вики треда с гайдами по запуску и базовой информацией: https://2ch-ai.gitgud.site/wiki/llama/

Чел

> набрать 256гб оперативной памяти

> qwen-235b

160 в сумме врам и рам

> glm-4.5 air

96 в сумме

>Чел

У меня она не открывается, но понял, плодить хуйню не буду

>ТУПОЕ пиздец

Если тебе последний Мистраль тупой, то дорога только в корпоративные модели. Хотя и их уровень тебя явно не устроит. Да и конфиг твой... Приходи короче лет через 5.

>У меня она не открывается

2025 год, а кто-то ещё не знает, что нужно делать, когда ссылка не открывается.

>жлм4 который 32б,

в каком кванте?

Наверняка русикодебил и не умеет промтить. 3.2 Мистрал по мозгам почти Лама 70б

хуй его знает честно, я нашел пресет, в систем промт ставлю ролплей имерсив, карточки пишу на инглише чатом гпт за несколько промтов он подробно хуярит.

А чем отличаются режимы detailed, immersive и simple. Если я хочу дать свободу модели развивать историю, а самому лишь направлять в нужном мне направлении, то какой режим для этого лучше?

Также, когда следует включать slow burn в пресете?

Я просто нубас, только вчера попробовал порпшить на квене 235b. Поэтому не бейте за мои тупые вопросы.

Также, когда следует включать slow burn в пресете?

Я просто нубас, только вчера попробовал порпшить на квене 235b. Поэтому не бейте за мои тупые вопросы.

> А чем отличаются режимы detailed, immersive и simple.

В том, что это разные промпты. У тебя отсутствует понимание, что такое промпт. Потрать часик-другой на то, чтобы почитать, что это такое и как это работает. Не придется задаваться глупыми вопросами, и качество ответов нейронки вырастет на порядок.

> Если я хочу дать свободу модели развивать историю, а самому лишь направлять в нужном мне направлении, то какой режим для этого лучше?

Использовать подходящий промпт или написать свой. Не существует волшебной галочки, которая решит твою задачу.

https://huggingface.co/TheDrummer/GLM-Steam-106B-A12B-v1

Скажите, мне ведь не одному хочется блевать от карточек для последних Драммерских тюнов? Да и от его тюнов в целом

Такая ебанина блять в описании

> I don't have enough vram to test it on longer chats to 16k, but on 6k chats it's looking good and without deepseek's slop.

Много поняли? Содержательно? Ахуеть! на 6к контекста в GLM нет Deepseek слопа 10/10

Скажите, мне ведь не одному хочется блевать от карточек для последних Драммерских тюнов? Да и от его тюнов в целом

Такая ебанина блять в описании

> I don't have enough vram to test it on longer chats to 16k, but on 6k chats it's looking good and without deepseek's slop.

Много поняли? Содержательно? Ахуеть! на 6к контекста в GLM нет Deepseek слопа 10/10

Зато картиночка подходит к названию!

Слышь, он цензуру победил.

Аполжайсит, правда, в ризонинге. Но цензуры нет, бля буду.

Кому как, но на мой вкус — лучше. Больше знаний, больше возможностей для маневров, лучше описания.

Да, активных параметров поменьше, где-то потупее, возможно, но вопрос вкуса, в итоге.

> скрывая наличие некротесел

Я здесь поддержу человека. Ты говорил про 4090 и ддр5, но про теслы не слова. Я поэтому и уточнил, ты там вообще ггуф запускал, а то вдруг экслламу.

Это ж совсем другой поворот. А про куда визибл чтобы тебе сказали раньше? Отключи 4090? Странный был бы совет, не находишь?

Ну в общем, надо со старта конфиг вываливать, а не скрывать 4 треда подряд, на чем гоняешь. =)

И систему, кстати, тоже.

И проц.

А то одни приходят с интелом на 120 гбс, другие с райзеном на 60 гбс, и оба такие «у меня ддр5, а чо скорость разная?»

> Что за 4 треда никто не назвал

Ну да. Выражение «слишком очевидно» означает, что про это не говорят (никто не говорит про очевидные вещи).

Вот скажи, ты часто спрашиваешь каждого собеседника в том числе тут, поел ли он, поспал ли он? Очевидные вещи же. =)

При этом, я сам тесловод, ниче против не имею, но с rtx-инами их просто не мешаю.

> Ты говорил про 4090 и ддр5, но про теслы не слова.

Чувак прятал слона в комнате, а потом обиделся, что ему не помогли, когда он начал выебываться. Прекратите ему уже отвечать

У меня есть, но он под сторителлинг/соавторство, а не рп как таковое, если подойдёт.

>Ты говорил про 4090 и ддр5, но про теслы не слова

Мне привести ссылки на все сообщения где я говорил про теслы? Уже третий тред про них пишу.

>Ну да. Выражение «слишком очевидно»

Откуда может быть очевидно, если гонял только плотные модели в кобольде, а там ситуация противоположная?

Еще один...

Ты думаешь, здесь кто-то именно твои посты отслеживает?

Если бы ты нормально оформил единый пост, объяснив ситуацию, приложив параметры запуска, логи, скриншоты, весь конфиг (а не выдавал хныки вроде я писал про теслы три треда назад, как ты мог не заметить?), тебе бы помогли. В итоге ты хуй знает сколько времени крутился как уж на сковородке, умалчивая все самое важное и порционно выдавая информацию. И теперь выебываешься, что тебе, оказывается, недостаточно эффективно помогли. Сделай выводы. Или не сделай. Но лучше все же прекратить трястись всему треду на потеху и искать виноватых. С каждым продолжением своей драмы все дальше закапываешься.

Если скинешь буду благодарен.

Зашёл сюда после просмотра годовалого видео про таверну. Скачать себе пару ботов локально на комп, лишь бы крышей не поехать в случае без интернета.

А тред как будто больше дрочится самими технологиями, чем их использует. Подозрительно. Пока посижу посмотрю, похоже видео сильно аудтейчено. Поразбираюсь в вашей вики наверняка тоже устаревшей.

50 гигов ддр4 - 4070 с 12 гигами

А тред как будто больше дрочится самими технологиями, чем их использует. Подозрительно. Пока посижу посмотрю, похоже видео сильно аудтейчено. Поразбираюсь в вашей вики наверняка тоже устаревшей.

50 гигов ддр4 - 4070 с 12 гигами

Используем активно. Стараемся использовать эффективно и оттого все разговоры. Сохранил себе и перенес модельки что юзаю на внешний жд если вдруг вернут железный занавес. Думаю немало тут таких

На какой хватит терпения

Сначала одно бессвязное нытье про 3 токена, потом про теслы, потом про превосходство кобольда, теперь про то что ты был прав и никто не понял. Как называется эта болезнь?

Лучше бы научился выражать свои мысли.

> больше дрочится самими технологиями, чем их использует

А что в использовании обсуждать? Опытом делятся, чего еще нужно, кто как покумил?

Френдлифаер оформил пацан. Чё только не происходит в противостоянии кобольдам... Столько анонов сложили головы

Где френдлифаер? Наоборот двачую анончика

Что делать то... у меня кетбоксы не открываются например, что с тунелем что с впном полноценным, зато нашел абуз, в телегу ссылку вставлять оно файл добавляет к ней который можно скачать.

Аноны, вы используете какие то нейронки для написания карточек?

Я пробую чат гпт, в целом неплохо пишет, подробно и если поправлять то збс, и можно скинуть ему пикчи персонажа чтоб он внешку описал

но в бесплатной версии можно скинуть только 4 файла же, или 3 блять

есть ли какая то альтернатива? Не хочу подписку покупать

Я пробую чат гпт, в целом неплохо пишет, подробно и если поправлять то збс, и можно скинуть ему пикчи персонажа чтоб он внешку описал

но в бесплатной версии можно скинуть только 4 файла же, или 3 блять

есть ли какая то альтернатива? Не хочу подписку покупать

GIGA - Garbage In, Garbage Out

Ручками печатаю идеи из своей головы, до 1к токенов

Никто так хорошо не сможет описать карточку как ты сам, сой гпт тебе в голову залезть не сможет, а если ты сам конкретно не знаешь чего хочешь то тут и говорить не о чем.

Никакие. Я просто беру чужие карточки. Потому что если пишу сам, я и так знаю что и чего от персонажа ждать.

>А тред как будто больше дрочится самими технологиями, чем их использует.

Всё так. И нам ещё далеко до картиночных, вот уж где задрачиваются с лорами, какой-нибудь сенко-анон сжёг электричества на тренировку своих лор и голосовух больше, чем сотня кумеров в тексте.

>что с тунелем что с впном полноценным

Значит тоннели и VPNы говно, что тут сказать.

>я и так знаю что и чего от персонажа ждать

Типа нейронки не могут выдать что-то неожиданное? Да, есть такое.

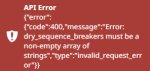

Все не могу пользоваться бугой больше. Сучья таверна даже после чистой переустановки продолжает выдавать ошибку про сиквенс брейкеры блядские даже если их вообще отключить.

Посоветуйте хороший бэкенд.

Блядь вроде был в таверне какой-то легаси апи помнит кто? Мб он поможет.

Посоветуйте хороший бэкенд.

Блядь вроде был в таверне какой-то легаси апи помнит кто? Мб он поможет.

Ты точно уверен, что у тебя DRY выключен, и Sequence Breakers в семплерах содержит непустую строку? Потому что если проблема в этом, замена бекенда тебе никак не поможет. Скриншоты тащи.

>Посоветуйте хороший бэкенд

Вступай в братство кобальдов, мы примем тебя как своего.

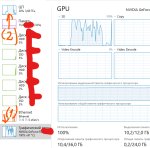

Ща будут скрины.

1. Буга успешно загружает модель.

2. Таверно успешно цепляет апи буги.

3. Ебучая таверна срет ошибкой. Брейкеры не пустые.

4. Ебучая таверна срет ошибкой. Брейкеры вообще выключены нахуй как они могут выдавать ошибку то?

И буга и таверна свежие.

Походу придется да.

Дополнительно.

Сообщения в консоли от буги.

Сука да что с тобой не так мразота.

>Если скинешь буду благодарен.

https://pixeldrain.com/l/47CdPFqQ#item=148

Можешь выкинуть часть про "This is scenario script..." и часть про русский язык, если не требуется.

Переноса на новую строку у тебя случаем нет в Sequence Breakers?

"[...]

"

Если есть, удали. Попробуй в Chat Completion еще.

Если не поможет, то и правда странный баг. Угабуга в любом случае так себе. Даже Кобольд лучше будет.

Вот все что есть

["\n", ":", "\"", "*"]

А у тебя как? очень странно что повторяется ошибка при чистой переустановке обоих программ. Причем обе по отдельности норм работают. И буга в своем убогом юи что то пишет и таверна с другим бэком работает. Хззз

>Даже Кобольд лучше будет.

Какие они вообще есть? Я только лламу юзал но там в консоли ебаться надо без UI не хочу.

Ну значит я проебал, сорян-посорян. Слишком уж часто было «4090 и ddr5», а я часть сообщений скипаю.

> Откуда может быть очевидно, если гонял только плотные модели в кобольде, а там ситуация противоположная?

Если мы про cuda_visible_device, то плотные или мое тут не причем. Это обычная переменная окружения для лламы (и производных), которая позволяет выбирать видяхи (в кобольде это на первой же странице: выбор гпу). Ну то есть, буквально выбираю All GPU все юзеры кобольда ее юзают. Хотя она не часто пригождается, но и паскали вместе с адой в одной системе не часто встречаются.

———

Там Алибаба выпустили Wan-S2V, проще говоря видеогенерацию с липсинком. Русский подключается подрублением русского файнтьюна wav2vec, все работает хорошо.

Долго, но по сравнению с «эта генерится 1 минуту» уже и норм.

Так что, думаю, в ту же таверну скоро завезут и такое, через полгодика. Будем с тнями онлайн беседовать, чисто по референс-пикче.

> Какие они вообще есть? Я только лламу юзал но там в консоли ебаться надо без UI не хочу.

Если только в видеопамять грузить, то Exllamav3. Работает очень легко и удобно через TabbyAPI. Для меня лучший бекенд.

Если с оффлоадом (видимо, твой случай), то лучше Лламы ничего нет. Искренне убежден, что на поисках альтернативы ты потеряешь больше времени, чем сесть и потратить час на то, чтобы разобраться с Лламой. Почему-то люди стали бояться читать и разбираться. Информации в интернете очень много. Один раз собрать батник под одно семейство моделей/кол-во параметров, дальше меняй пути, и все.

Двачую за экслламу, blazing fast но требовательная. Кстати в табби висит пр на фикс функциональных вызовов квена, причем с оригинальной реализацией, а не костыльной как в жоре, которая часто дает сбои.

> то лучше Лламы ничего нет

Кроме, лол. Ну в теории может трансформерс но там скорость ужасная. Остальное все форки или не умеет.

Даже мистраль 3.2 и гемма3-27 вполне справляются, как минимум с основой. Обоим можно вообще картинку показать (через mmproj) и попросить взять персону с изображения как основу для персонажа.

Ну и GLM-Air новый, конечно, карточку по запросу прекрасно делает, но у него зрения нет.

Однако, лучше все-таки потом руками допилить под свой вкус.

Лучший результат у меня получается если скинуть картинку и шаблон желаемых пунктов которые должны быть в карточке.

Имелось ввиду, что лучше использовать Лламу напрямую - без дополнительных оберток вроде Уги или Кобольда. Это быстрее, удобнее и функциональнее.

Как же я ненавижу программирование, как же я ненавижу консольки, сука.

Опять разбираться, что вообще пошло не так.

И ведь это самый простой путь через кобольда.

Опять разбираться, что вообще пошло не так.

И ведь это самый простой путь через кобольда.

Ты зачем контекст трогаешь?

Ты одновременно и прав и немножко неправ. Однозначно сам ллама-сервер более легквесный и шустрый чем лишние обертки, однако убабуга позволяет иметь корректно работающие как это было задумано семплеры, одинаковые между разными беками. В принципе, если юзаешь simple-1 или min-p то не принципиально, однако жорич может обосраться и забаговать даже с rep pen, выдавая полную шизу и сильно замедляясь пока не уберешь.

Сменил версию кобальда, само заработало.

Просто впихивал разные файлы, не хотело. Ну сейчас на другом заработало, и ладно.

Теперь надо попробовать накачать что-нибудь потяжелее, чем какая-то легковесная мистраль.

А потом может с чем-то кроме кобальда разбираться.

Просто впихивал разные файлы, не хотело. Ну сейчас на другом заработало, и ладно.

Теперь надо попробовать накачать что-нибудь потяжелее, чем какая-то легковесная мистраль.

А потом может с чем-то кроме кобальда разбираться.

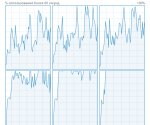

И снова всех заебавший анон с двумя теслами.

Провёл серию экспериментов:

Только тесла

set CUDA_VISIBLE_DEVICES=2

llama-server -m GLM-4.5-Air-Q3_K_S-00001-of-00002.gguf -ngl 999 -c 32768 -fa --prio-batch 2 -ub 2048 -b 2048 -ctk q8_0 -ctv q8_0 --no-context-shift --mlock --n-cpu-moe 32

4090 и тесла, но выгружаю сначала на теслу

set CUDA_VISIBLE_DEVICES=0,2

llama-server -m GLM-4.5-Air-Q3_K_S-00001-of-00002.gguf -c 32768 --batch-size 512 -fa -ot "blk.1\.ffn_._exps\.=CUDA1,blk.2\.ffn_._exps\.=CUDA1,blk.3\.ffn_._exps\.=CUDA1,blk.4\.ffn_._exps\.=CUDA1,blk.5\.ffn_._exps\.=CUDA1,blk.6\.ffn_._exps\.=CUDA1,blk.7\.ffn_._exps\.=CUDA1,blk.8\.ffn_._exps\.=CUDA1,blk.9\.ffn_._exps\.=CUDA1,blk.10\.ffn_._exps\.=CUDA1,blk.11\.ffn_._exps\.=CUDA1,blk.12\.ffn_._exps\.=CUDA1,blk.13\.ffn_._exps\.=CUDA1,blk.14\.ffn_._exps\.=CUDA1,blk.15\.ffn_._exps\.=CUDA1,blk.16\.ffn_._exps\.=CUDA1,blk.17\.ffn_._exps\.=CUDA1,blk.18\.ffn_._exps\.=CUDA1,blk.19\.ffn_._exps\.=CUDA1,blk.20.ffn_gate_exps.=CUDA1,blk.24.ffn_gate_exps.=CUDA0,blk.24.ffn_up_exps.=CUDA0,blk.25\.ffn_._exps\.=CUDA0,blk.26\.ffn_._exps\.=CUDA0,blk.27\.ffn_._exps\.=CUDA0,blk.28\.ffn_._exps\.=CUDA0,blk.29\.ffn_._exps\.=CUDA0,blk.30\.ffn_._exps\.=CUDA0,blk.31\.ffn_._exps\.=CUDA0,blk.32\.ffn_._exps\.=CUDA0,blk.33\.ffn_._exps\.=CUDA0,blk.34\.ffn_._exps\.=CUDA0,blk.35\.ffn_._exps\.=CUDA0,blk.36\.ffn_._exps\.=CUDA0,blk.37\.ffn_._exps\.=CUDA0,blk.38\.ffn_._exps\.=CUDA0,blk.39\.ffn_._exps\.=CUDA0,blk.40\.ffn_._exps\.=CUDA0,blk.41\.ffn_._exps\.=CUDA0,blk.42\.ffn_.*_exps\.=CUDA0" --cpu-moe -ctk q8_0 -ctv q8_0 -ub 2048 --no-context-shift --mlock -ngl 999

Всё во врам (4090 + две теслы) выдавало 3,2 токена.

Эксперты которым «слишком очевидно» - почему так?

Провёл серию экспериментов:

Только тесла

set CUDA_VISIBLE_DEVICES=2

llama-server -m GLM-4.5-Air-Q3_K_S-00001-of-00002.gguf -ngl 999 -c 32768 -fa --prio-batch 2 -ub 2048 -b 2048 -ctk q8_0 -ctv q8_0 --no-context-shift --mlock --n-cpu-moe 32

4090 и тесла, но выгружаю сначала на теслу

set CUDA_VISIBLE_DEVICES=0,2

llama-server -m GLM-4.5-Air-Q3_K_S-00001-of-00002.gguf -c 32768 --batch-size 512 -fa -ot "blk.1\.ffn_._exps\.=CUDA1,blk.2\.ffn_._exps\.=CUDA1,blk.3\.ffn_._exps\.=CUDA1,blk.4\.ffn_._exps\.=CUDA1,blk.5\.ffn_._exps\.=CUDA1,blk.6\.ffn_._exps\.=CUDA1,blk.7\.ffn_._exps\.=CUDA1,blk.8\.ffn_._exps\.=CUDA1,blk.9\.ffn_._exps\.=CUDA1,blk.10\.ffn_._exps\.=CUDA1,blk.11\.ffn_._exps\.=CUDA1,blk.12\.ffn_._exps\.=CUDA1,blk.13\.ffn_._exps\.=CUDA1,blk.14\.ffn_._exps\.=CUDA1,blk.15\.ffn_._exps\.=CUDA1,blk.16\.ffn_._exps\.=CUDA1,blk.17\.ffn_._exps\.=CUDA1,blk.18\.ffn_._exps\.=CUDA1,blk.19\.ffn_._exps\.=CUDA1,blk.20.ffn_gate_exps.=CUDA1,blk.24.ffn_gate_exps.=CUDA0,blk.24.ffn_up_exps.=CUDA0,blk.25\.ffn_._exps\.=CUDA0,blk.26\.ffn_._exps\.=CUDA0,blk.27\.ffn_._exps\.=CUDA0,blk.28\.ffn_._exps\.=CUDA0,blk.29\.ffn_._exps\.=CUDA0,blk.30\.ffn_._exps\.=CUDA0,blk.31\.ffn_._exps\.=CUDA0,blk.32\.ffn_._exps\.=CUDA0,blk.33\.ffn_._exps\.=CUDA0,blk.34\.ffn_._exps\.=CUDA0,blk.35\.ffn_._exps\.=CUDA0,blk.36\.ffn_._exps\.=CUDA0,blk.37\.ffn_._exps\.=CUDA0,blk.38\.ffn_._exps\.=CUDA0,blk.39\.ffn_._exps\.=CUDA0,blk.40\.ffn_._exps\.=CUDA0,blk.41\.ffn_._exps\.=CUDA0,blk.42\.ffn_.*_exps\.=CUDA0" --cpu-moe -ctk q8_0 -ctv q8_0 -ub 2048 --no-context-shift --mlock -ngl 999

Всё во врам (4090 + две теслы) выдавало 3,2 токена.

Эксперты которым «слишком очевидно» - почему так?

> lama-server -m GLM-4.5-Air-Q3_K_S-00001-of-00002.gguf -c 32768 --batch-size 512 -fa -ot "blk.1\.ffn_._exps\.=CUDA1,blk.2\.ffn_._exps\.=CUDA1,blk.3\.ffn_._exps\.=CUDA1,blk.4\.ffn_._exps\.=CUDA1,blk.5\.ffn_._exps\.=CUDA1,blk.6\.ffn_._exps\.=CUDA1,blk.7\.ffn_._exps\.=CUDA1,blk.8\.ffn_._exps\.=CUDA1,blk.9\.ffn_._exps\.=CUDA1,blk.10\.ffn_._exps\.=CUDA1,blk.11\.ffn_._exps\.=CUDA1,blk.12\.ffn_._exps\.=CUDA1,blk.13\.ffn_._exps\.=CUDA1,blk.14\.ffn_._exps\.=CUDA1,blk.15\.ffn_._exps\.=CUDA1,blk.16\.ffn_._exps\.=CUDA1,blk.17\.ffn_._exps\.=CUDA1,blk.18\.ffn_._exps\.=CUDA1,blk.19\.ffn_._exps\.=CUDA1,blk.20.ffn_gate_exps.=CUDA1,blk.24.ffn_gate_exps.=CUDA0,blk.24.ffn_up_exps.=CUDA0,blk.25\.ffn_._exps\.=CUDA0,blk.26\.ffn_._exps\.=CUDA0,blk.27\.ffn_._exps\.=CUDA0,blk.28\.ffn_._exps\.=CUDA0,blk.29\.ffn_._exps\.=CUDA0,blk.30\.ffn_._exps\.=CUDA0,blk.31\.ffn_._exps\.=CUDA0,blk.32\.ffn_._exps\.=CUDA0,blk.33\.ffn_._exps\.=CUDA0,blk.34\.ffn_._exps\.=CUDA0,blk.35\.ffn_._exps\.=CUDA0,blk.36\.ffn_._exps\.=CUDA0,blk.37\.ffn_._exps\.=CUDA0,blk.38\.ffn_._exps\.=CUDA0,blk.39\.ffn_._exps\.=CUDA0,blk.40\.ffn_._exps\.=CUDA0,blk.41\.ffn_._exps\.=CUDA0,blk.42\.ffn_.*_exps\.=CUDA0" --cpu-moe -ctk q8_0 -ctv q8_0 -ub 2048 --no-context-shift --mlock -ngl 999

https://youtu.be/NqDs91lezis

Между запуском всё во врам, запуском на одной тесле, и всем что мне советовали все последние 4 треда...

...это самый лучший результат (не считая медленной токенизации контекста). Почему? А самая быстрая токенизация контекста (не считая 4090+озу) вышла на тесла+озу.

Лама попросту сломана и не умеет адекватно в мультигпу?

Хорошо, я дам тебе подсказку и пошаговое решение твоей проблемы

Подсказка: bottleneck.

Наводящий вопрос, в котором пригодится подсказка: как ты думаешь, когда ты запускаешь модель, где и как происходят вычисления? Правильно, на твоих железках. Твои железки отдельно друг от друга проводят вычисления, а затем результаты этих вычислений должны синхронизироваться между собой. Как это происходит? Что же может пойти не так?

Пошаговая инструкция:

1. Отнеси свои теслы на помойку

2. Запускай на 4090 + озу, быстрее не будет

3. Прекрати заебывать тред глупыми вопросами

4. Вы великолепны

>1. Отнеси свои теслы на помойку

Я об этом писал в позапрошлом треде, спасибо, КО!

>2. Запускай на 4090 + озу, быстрее не будет

Я хотел теслы заменить на 3090, и теперь сомневаюсь что это вообще что-то даст.

>3. Прекрати заебывать тред глупыми вопросами

И пользоваться бэкендом, чья работа мне не понятна?

> почему так

Пикрел

> Лама попросту сломана

Она исправна и не терпит пидарасов. Ведь у всех нормальных людей даже у истинного теслашиза(!) все прекрасно работает, а тебе проводят залупой по губам. Не удивлюсь если там вылезет какая-нибудь база с переполнением врам и ее выгрузкой из-за увеличения буферов с мультигпу, или оно подключено через х1 2.0. Даже не то что не удивлюсь, а почти уверен что это так и ты об этом молчишь.

> и теперь сомневаюсь что это вообще что-то даст

В голос.

Подсказка хуйня какая-то.

Люди сидят с 3060+P104, 4090+P40, я думаю, тоже можно норм запустить, но вдруг винда не могет.

Плюс, у чела DDR5, и так неплохо.

Плюс, , ты вручную выставляешь где какие слои и где контекст? ллама.спп умеет в мультигпу, есть люди у которых с этим нет проблем, вывод один: ты ее неправильно приготовил.

На вопрос «а как?» у меня ответ один: во-первых, перестань ебать мозг и перейди на линуху, если тебе усрись хочется теслы подрубить. Или еби мозги себе и думай, как соединить дрова вместе на винде.

Далее, посмотри, как выгружаются тензоры или слои по разным видяхам вручную. Посчитай, поэкспериментируй, выгружай так, чтобы стало ок.

Я запускаю глм-аир-Q4 и получаю 10-12 токенов на двух теслах и DDR4.

Если у тебя не так — значит ты что-то охуеть не так делаешь. И, заметь, мы не можем угадать, а ты не говоришь.

Поехали, ебать.

1. Ubuntu 24

2. Сбилдить llama.cpp самому

3. llama-server -m GLM-4.5-Air-Q3_K_S-00001-of-00002.gguf -ngl 999 -c 32768 -fa -ctv q8_0 --n-cpu-moe 32 (ну или скока там, чтобы И КОНТЕКСТ БЛЯДЬ И НАХУЙ МОДЕЛЬ поместились на видеокартах, жксперименты)

Как это сделать? Я писал пару тредов назад, если ты не сделал — ну твой выбор страдать с 4 токенами, никто его за тебя не делал, верно же.

Для меня очевидно, и я свое очевидно по-командно в тред сбросил (меня пару человек засрало и все).

У меня 12 токенов на кванте выше без 4090 и с ддр4, у тебя 4 токена с 4090 и ддр5.

Выводы? Мне похую, я пошел, помог тебе максимально, если ты дальше будешь делать выбор сидеть с 4 токенами — то приятного сидения. =)

Замечу, что сбросить: ОС, проц, статы оперативы, версию лламы.спп и так далее все еще стоит, тут все еще нет экстрасенсов.

Всем добра! ^_^

> Я об этом писал в позапрошлом треде, спасибо, КО!

Баба срака два десятка тредов назад рассказывала про чечевичный суп и боттлнеке на оффлоад инференсе, не за что, КО! (КО - Кобольд Обычный, прим. автора)

> Я хотел теслы заменить на 3090, и теперь сомневаюсь что это вообще что-то даст.

Ну тебе может не даст, кому-то даст.

> И пользоваться бэкендом, чья работа мне не понятна?

Не знаю. Я предложил тебе тред не заебывать глупыми вопросами. Ты можешь хоть на велосипеде с треугольными колесами кататься, мы тут причем? Ты там как, в свои 30-40 до сих пор живешь с мамой и не можешь собрать стеллаж по вложенной инструкции? Думаю, у тебя траблы с головой, дальше игнорю и остальных призываю

Это смешно, но я впервые согласен с антитеслошизом.

Ллама прекрасно работает, у меня стойкой подозрение, что там что-то выливается в оперативу, как-то не так распределяются.

Может просто не знает, что контекст тоже помещается в оперативу по умолчанию, а винда может не выдавать ООМ, а сливать в Shared Memory? Из-за чего часть модели будет лежать в оперативе, а обсчитываться видеочипом по линиям PCIe.

Казалось бы, очевидно…

Кстати, блин, я за последний год этих стеллажей уже пачку собрал. Вот что переезд делает!

Майнерский риг за мини-стеллаж считается?

>если тебе усрись хочется теслы подрубить

Мне хочется запустить как можно более жирную модель, но не ценой 3 токенов в секунду. А пока что я вижу что одна тесла работает быстрее чем две+4090 вообще без озу. И это настораживает.

>И, заметь, мы не можем угадать, а ты не говоришь.

Уже четвёртый тред говорю.

>перейди на линуху

Видимо выходные этому и посвящу.

>у тебя 4 токена с 4090 и ддр5.

Без тесел около 14 выдаёт (от 12 до 16 в зависимости от рерола)

> Подсказка хуйня какая-то.

Не хуйня, а прямой ответ на его проблему. У чувака железо, которое в обособленности друг от друга работает быстрее, чем вместе. Значит, где-то боттлнек. На твое полотно ему будет похуй, этот пес скулит уже четыре треда и вниманиеблядствует, а не решает свою проблему

>Значит, где-то боттлнек.

К примеру 4 линии pci-e 3.0. И тогда замена тесел актуальными картами ничего не даст. Раз тут сидят эксперты которым и так всё очевидно, надеюсь узнать так это или нет.

Так ты узнай самостоятельно.

И на шинде работали связки 4090 + п40, правда тогда еще моэ не было. Врядли повлияет, исключая выгрузку врам, которой у здоровых людей не должно случаться.

> антитеслошизом

Какой милый перефорс, ути мой хороший.

> К примеру 4 линии pci-e 3.0

Не, такое может гадить на обсчет контекста при большой выгрузке на проц если карточка основная, в остальных случаях похуй. Может быть проблемой если там ссанина вместо райзера и оно все засыпает ошибками, но это было бы заметно в системе по лагам.

> эксперты которым и так всё очевидно

Сказать что еще очевидно экспертам?

Штош, могу подтвердить, что у Эира действительно есть проблема с балансом в ответах. Как ни промти или префиль, бестолку. Половина или две трети ответа - реакция чара на действия юзера, вплоть до самых мелких деталей. Иногда это круто, когда контекст подходящий, но часто очень бесит. И что еще хуже, со временем диалогов все меньше и меньше будет, на 400 токенов генерации слов персонажа наберется с 50 токенов, даже если ты напрямую подашь инструкции или будешь в рамках игры чара пытаться разговорить, хуй у тя че выйдет. Потому что с наполнением контекста моделька на своих же респонсах учится и чар говорит все меньше-меньше-меньше. Ну и потом привет лупы. Да, имена отключены. Да, примеры диалогов используются. Кайфовая модель в целом, но вот эту хуйню походу из нее не вытащить никак. Задушился

q4 квант бтв. В куме прекрасно показывает себя за счет своей особенности, но во всем остальном это пиздец кромешный. Если кому удалось пофиксить, поделитесь пожалуйста. Помню аноны в прошлых тредах писали что моделька пиздец медленная и не хочется двигаться, я вот думаю это оно и есть. Вместо того чтобы двигать сюжет или хоть что предпринимать две трети токенов уходят на пересказ прошлой реплики. Ахуеть конечно

>правда тогда еще моэ не было.

Я уже несколько раз писал, что на кобольде с плотными моделями теслы себя нормально показывают. Тот же коммандер выдаёт полтора токена, и то из-за выгрузки в озу скорее всего.

>такое может гадить на обсчет контекста

Тесла+озу 30т/с контекста

4090+озу 40т/с контекста, на х16 pcie4.0

Кто там был из любителей потерпеть и полтных моделей https://huggingface.co/NousResearch/Hermes-4-405B

> нормально показывают

> полтора токена

Проиграл. Хотябы 3-5 токенов там должно быть, если офк половина не в рам, в 72 гига он со свистом залетает.

> 4090+озу 40т/с контекста

Должно быть 400+

> нормально показывают

> полтора токена

Проиграл. Хотябы 3-5 токенов там должно быть, если офк половина не в рам, в 72 гига он со свистом залетает.

> 4090+озу 40т/с контекста

Должно быть 400+

>если офк половина не в рам

конечно половина, у меня же не целый риг тесел.

>Должно быть 400+

Странно, было 40, сейчас глянул сколько выдало уже на 4 кванте, и вправду 400+.

Короче надо искать лоха кричащего про урезанный физикс на rtx5000 и впаривать ему эти теслы как инновационное решение поддерживающее старый физикс и ставящиеся в параллель с основной картой.

А чо вы делаете вообще с локальными моделями, можете пальцем тыкнуть, тред не читал?

Какая новая ссылка на Smash or Pass AI? Есть ли возможность запуска в коллабе и подобном?

> конечно половина, у меня же не целый риг тесел.

4й квант весит ~60 гигов, в 72 можно есть запас на контекст. Все хорошо?

> Странно, было 40

Тут только экзорцист поможет.

Запускаем

пердолимся с запуском

Первые запуски на llama.cpp.

Хочу советов мудрых.

Загрузил модель, которая не влезает в видюху полностью, вываливается на оперативу.

При общении сначала подрубается видюха, что-то обрабатывает, а затем подрывается и цп.

Что делает цп, тоже пытается выполнить вычисления нейросетки, или же это он так упорно тасует данные видеопамять-оператива и обратно?

В общем, происходят ли вычисления на цп вообще? Потому что если запускать без подруба в cpp видюхи, он будет сам всё вычислять как может, так что я не удивлюсь, если он и правда что-то пытается делать, а не просто помогать более быстрой видюхе тасовать память туда-обратно.

Хочу советов мудрых.

Загрузил модель, которая не влезает в видюху полностью, вываливается на оперативу.

При общении сначала подрубается видюха, что-то обрабатывает, а затем подрывается и цп.

Что делает цп, тоже пытается выполнить вычисления нейросетки, или же это он так упорно тасует данные видеопамять-оператива и обратно?

В общем, происходят ли вычисления на цп вообще? Потому что если запускать без подруба в cpp видюхи, он будет сам всё вычислять как может, так что я не удивлюсь, если он и правда что-то пытается делать, а не просто помогать более быстрой видюхе тасовать память туда-обратно.

> Какой милый перефорс, ути мой хороший.

Ну язык фактов. Чел, который поделил 100 токенов генерации на 90 секунд чтения контекста + 10 секунд генерации и получил 1 т/с скорость генерации — определенно не знает математики и просто хейтит теслы, которые прекрасно работают. =) Шиз, проще говоря. Здоровья ему и желаю узнать, как работает математика.

> 4090+озу 40т/с контекста

Падажжи… Че-то хуйня какая-то.

Если контекст целиком в 4090, то там обсчет должен быть мгновенным в любом случае.

У тебя и тут проблема.

О, ну вот теперь норм.

40 могло быть знаешь когда? Когда у тебя модель забила 4090, а контекст утек в оперативу, в Shared Memory, как я и писал.

> эти теслы

Заберу за 12 каждая.

Считает, конечно.

Так что физ-ядра - 1 в -t

Чтение контекста сожрет 100%, генерация поменьше.

> Считает, конечно.

> Так что физ-ядра - 1 в -t

Спасибо. Я правильно понял, что цп всегда будет считать, если данные не помещаются только в видюху, и идут дополнительно в оперативу?

То есть у меня появилась причина обновить проц-память.

На кобольде такого не видел.

А, понял. Такого я не видел, потому что кобольд хуже занимает все потоки процессора в отличие от лламы.спп. В итоге и видюху хуже догружает.

Как посчитать слои в квантованной модели?

Вот есть gemma-3-12b-it-Q8_0.gguf весит 12.2 гб. Сколько в ней слоев вообще?

Вот есть gemma-3-12b-it-Q8_0.gguf весит 12.2 гб. Сколько в ней слоев вообще?

Запихиваешь в кобальд не запуская модель

Тебе показывает сколько влезет, сколько всего

Ну, в общем и целом.

Главное что? Чтобы тебе нравилось и скорость была высокой. =)

Но если оперативу возьмешь по-шустрее (высокочастотную DDR4, или DDR5 лучше), ядер побольше (8 полноценных ядер звучит лучше классических 6), то и скорость подрастет чутка.

Но, если у тебя есть слот на материнке для видяхи второй… может лучше видеокарту добрать?

Тоже подумай над таким вариантом.

Поделителсь кто-нибудь своими Advanced Formatting под гемму 3, прям мастер импорт. И Пресет семплеров если не в падлу. Я все свои проебал.

Так ну лламу поставил даже запустил гемку мелкую. Бегает быстро уважаю. Правда хз где спидометр. Не очень понял за что отвечают

-fa --prio-batch 2 -ub 2048 -b 2048 ^

Что такое flash attntion знаю. А остальное что?

Так ну лламу поставил даже запустил гемку мелкую. Бегает быстро уважаю. Правда хз где спидометр. Не очень понял за что отвечают

-fa --prio-batch 2 -ub 2048 -b 2048 ^

Что такое flash attntion знаю. А остальное что?

кто-то упомянул exllama а я загуглил

Есть смысл её ставить вместо обычной лламы для глм, которая не полностью влезает в vram? Гугл говорит, что экслама быстрее, но заточена исключительно под GPU.

Есть смысл её ставить вместо обычной лламы для глм, которая не полностью влезает в vram? Гугл говорит, что экслама быстрее, но заточена исключительно под GPU.

В hf можно на ггуф нажать и будет инфо, у лламыцпп есть gguf-dump

Прикол эксламмы как раз в том что на только во врам.

Чем выше -b -ub, тем быстрее происходит обработка контекста ценой маленькой просадки скорости генерации и большим потреблением врама. Все в документации есть.

Правильно говорит.

Знаете, почему замазал видюху? На двух постах, не совпадение. Потому что это тот еблан, который купил себе 512 оперативы и выебывался этим в треде, используя свой риг как аргумент. У него 2080 Ти или типа того. Поразительно как можно в один лень срать в тред картинками, пытаться агрить людей на ровном месте, а позже к ним же обращаться с глупыми вопросами и прятаться

Количество рам он тоже конечно же скрыл. Конфиденциальная информация! Неужели стыд взял за ту хуйню, что он делал? Человек признал бы неправоту, а этот прячется. Тьфу

Да, ты угадал!

Если соберу 1тб то буду чики бамбони боссом этой помойки?

По современным меркам копейки, но нахуй столько надо? Страдать 0.1tps?

>0.1

Эт схуяли ? МОЭ прекрасно на жыжыэр 5 работает.

>боссом этой помойки?

Тредов 20 назад сюда забегал гигатеслоёб с двумя а-100. Так что ты просто будешь с кучей памяти, но без короны главного боярина.

Понел, благодарю.

А расскажите ещё лор местного теславода. В чем вообще суть сультигпу на разных архитектурах? В каких сценариях есть профит?

Когда я в своё время изучал вопрос мультигпу пришел к выводу, что это говно, так как память не суммируется и данные гоняются через pci-e последовательно.

> расскажите ещё лор местного теславода

Спроси у него сам, он не агрессивный. Если начнет раскрывать шину и шипеть, стукни его газетой.

> он не агрессивный

Ты или он и есть, или не видел его в критические дни

> Ты или он и есть

Нет, ты что. Я просто шиз.

> не видел его в критические дни

~naaah

Обычный анон. Ни хуже, ни лучше других. Нести хуйню с умным видом и не замечать собственных проёбов - это чуть ли не база треда.

Да блядь. Могу только пару 6000про купить и всё

Во-первых, плотные модели с выгрузкой на гпу, даже такое хреновое, работают чуть быстрее чем на озу.

Во-вторых, 24гига на каждую карту неплохо апают общее количество памяти. Тот же новый коммандер без тесел мне не запустить в адекватном кванте. А когда собирал комп, цена 48гб ддр5 была такая же как и 2х тесел.

Ну подкопи еще миллионов 5, тоже станешь боярином.

Запускать кими к2 в 6 кванте?

Ну или ждать, че там будет с новыми дипсиками, обещали 1,3Т моешку.

Тока не забудь докупить видяху с 32+ гигами памяти, общие слои на крупных моделях и весят крупно. =)

Ты опечатался? Память как раз суммируется.

Но не дается доступа к памяти других видях для самого мощного чипа — это другое.

Но в общем, смотри, если у тебя выбор, работать 4090, а потом двумя теслами, или работать 4090, а потом гораздо более медленной оперативной памятью и гораздо более слабым процессором — то выбор очевиден, не? Теслы тебе один фиг дадут гораздо выше перформанса, чем проц с памятью (если у тебя не эпик о 12 каналах, там уже под вопросом=).

Ну это в условиях, когда оно работает, а не тупит хер знает почему. =)

И не называй его теславодом, он же 4090 юзает в конфиге как мэйн карту. =(

> Загрузил модель, которая не влезает в видюху полностью, вываливается на оперативу

Что загрузил, как загрузил? Трактовать эту фразу можно кучей способов, опиши подробно и ясно что конкретно ты делал. 3060, 48 рама и буквы дисков можешь не замазывать, это рофлово.

> сначала подрубается видюха

Что значит подрубается? Ты просто смотришь на эти показометры в диспетчере задач? Можешь забыть про них и почитать в вики треда как работает ллм, как проиходит расчет, выгрузка и работа на нескольких устройствах.

> происходят ли вычисления на цп вообще

В зависимости от того что ты подразумевал под первой фразой, когда часть слоев явно на оперативе - происходит при генерации, когда идет вываливание врам в рам - нет, но нагрузка может показываться из-за интенсивного спользования шины.

> видюхе тасовать память туда-обратно

Сейчас такое поведение при обработке контекста с выгруженными слоями.

> Чел, который поделил 100 токенов генерации на 90 секунд чтения контекста + 10 секунд генерации и получил 1 т/с скорость генерации

Лолсука, настоящий, живой теслошиз! Даже не тот что городил шизоидный риг, а который доказывал что теслы быстрые скрином с одним токеном. Или это один и тот же поех так эволюционировал?

> -fa

Флешатеншн

> --prio-batch 2

Повышенный приоритет при обработке контекста, сомнительно

> -ub 2048

Фактический размер батчой, на которые будет делиться контекст для его обработки. То есть твое 10к будут поделены на 5 кусков по 2к а потом по очереди каждый из них пробежит все слои. Если не все веса находятся в врам - для обработки каждого батча придется их закинуть в видеокарту и чем меньше батч тем большее число раз это придется делать, потому повышение позволяет избежать упора в шину. Можно смело повышать, на генерацию это не повлияет, но видеопамяти в буферы отожрет больше.

> -b 2048

Как часто жора будет в командной строке показывать промежуточный прогресс обработки, он по дефолту 2048 и можно просто выкинуть. Но, если ub будет стоять больше чем b то он уменьшится до размеров последнего, потому выше чем 2048 нужно будет повышать и его.

https://huggingface.co/zerofata/GLM-4.5-Iceblink-106B-A12B

Еще один Воздушный тюн. Возможно, даже неплохой?

Еще один Воздушный тюн. Возможно, даже неплохой?

Жизнеспособной - не соберешь.

> сультигпу на разных архитектурах? В каких сценариях есть профит

В последовательной обработке одной большой модели если под это написан код. Ллм - идеальный пример.

> изучал вопрос мультигпу пришел к выводу, что это говно, так как память не суммируется и данные гоняются через pci-e последовательно

Ты неправ, точнее это справедливо только к части применений. Например, при обычной тренировке каждая карта считает свое, а после обратного прохода накопленные градиенты и веса синхронизируются, тем самым повышается эффективный размер батч сайза и все идет в N раз быстрее. Память не суммируется, суммируется скорость.

Можно раскидать одну большую модель по нескольким гпу чтобы на каждой была ее часть, при этом они будут прогоняться последовательно, так суммируется память но не складывается скорость.

Можно схитрить с распределением, делая его не последовательно а "параллельно", если все реализовано правильно - можно будет не только сложить память видюх, но и частично реализовать их параллельную работу что поднимет скорость. Также и с тренировкой, можно раскидать на шарды состояния оптимайзера и распределить их между гпу, можно подробить и веса, и в таком виде получить одновременно и объединение памяти и сложение скорости, но офк с компромиссами.

tldr: суммируется, это конфетка но требует правильного приготовления, в ллм изи.

>открыл

>гуфи еще не проснулся

>закрыл

Продолжайте вести наблюдение.

> Лолсука, настоящий, живой теслошиз!

Антитеслошиз спалился. =) До сих пор делить не можешь.

Чувак, ну почитай ты учебники математики, но посмотри ты на тот же скрин.

Ты уже полтора года носишься и доказываешь, что если поделить 100 токенов на 10 — получится 1.

Это ж вот донышко.

И, нет, мы разные люди. =) Просто ты уж очень забавный со своей математикой особой. Как тебя не запомнить.

ДО СИХ ПОР ТЫ ПРИ ДЕЛЕНИИ 100 НА 10 ПОЛУЧАЕШЬ 1. Это же, ну… мировое открытие, новый раздел математики, я хз. =)

Мне бы твою уверенность по жизни, что в мире 8 миллиардов дурачков и один ты понимаешь, как устроен мир.

Кстати, вот реально же, кто хочет себе такую же славу —возьмите скрины чувака, где у него на 4090 4 токена выдает глм (поскриньте его сообщения) и носитесь полтора года рассказывая, что DDR4 с 6 токенами быстрее 4090 с 4.

Same level, same vibe.

Same level, same vibe.

Мда мужык ну ты и дэбил.. =)

Ну, расскажи, сколько будет 100/10. =D

О, я знаю ! Я знаю !

Так. 100/10, убираем значит 1 и 0, получаем… эммм

0 ?!

Да я вообще мимо проходил. Не сдержался извини. =)

Даже лучше. Жаваскриптеры победили всех, получается. =)

Какие еще сказки расскажешь? =)

...да у тебя фляга течет конкретно мужик. =)

Протыков ищи в соседнем тредике

Да если бы 4, там 3 было! До сих пор аж печёт.

Я не шарю в твоей теме, не понял о чем ты.

Ну пофиксил же в итоге, хотя бы отчасти. Уже легче.

Всмысле отчасти? 14 стало. Даже 4q 11 выдает. Разве что без тесел квен не запустить, но уже протестил, и он того не стоит.

> но уже протестил, и он того не стоит.

У меня наоборот. q4 air < q2 qwen. Ты не трясись только, что он кому-то нравится

>Тредов 20 назад сюда забегал гигатеслоёб с двумя а-100.

Был ещё как минимум с одной ptx 6000 pro, а а100 сейчас отсасывает у 5090 во всём, кроме объёма врама, особенно в версии 40ГБ.

>Можно

Забыл обработку батчами. Технически можно сделать конвеер, чтобы каждая карта была загружена своей частью своего батча, и общая пропускная станет в разы больше, хотя каждый отдельный батч будет идти с обычной скоростью. Но это интересно хостерам моделей, обычному анону смысла нет.

> а100 сейчас отсасывает у 5090 во всём

Логично, если ты берешь 5090 то сравнивай его со вторым хоппером.

Сравниваю по цене и количеству понта.

У меня коммандер лучше их обоих, и работает со скоросью квена. Но на фоне скорости айра, навряд ли буду их запускать.

> количеству понта.

Ну хуй знает. У меня нет ни одного, ни другого.

Но мне кажется - h200 таки попонтовей будет.

Чем активнее форсишь изначальный кринж - тем больше говна в штаны "тебе заливают". Бенчмарк говорит один токен - значит один токен, на большее ты не способен.

> а100 сейчас отсасывает у 5090 во всём

Она все еще быстрее по флопсам.

Да хуйня это все, в рамках треда грейсхоппер нужен. Крайне занимательная штука, там даже плотные монстры летали не говоря и том, с какой скоростью будут носиться современные моэ. Еще бы так сильно не глючила.

Она стоит 3 миллиона рублей. Блять. За эти деньги ты риг из 5090 соберешь, еще и на эскортницу останется, которая будет тебе отсасывать, пока ты собираешь его.

Нет ни одной разумной задачи, зачем эту хуиту покупать мимокроку. Это исключительно корпоративное решение.

>грейсхоппер

А это еще что такое ? Сказка из хопперов ?

Это комба из старшего 144-гигового хоппера и дохуяядерного чипа грейс с кучей каналов рам и высокой псп, соединенные быстрым нвлинком. Причем вся память имеет общую адресацию (с нюансами), в сумме овер 600 гигов набегает.

Сделай себе карточку грейсхоппера в таверне. Или мб ригофрики итт поделятся?

О да ... Активируй все параметры в моей рам..

> сумме овер 600 гигов набегает

> дохуяядерного чипа грейс с кучей каналов рам

Если у тебя это не вызывает инфернальный стояк, то что ты в этом треде забыл.

Хоспаде, как сладенько звучит.

А, 42.000$ и это только начало цены. В среднем 55.000$

Эхххх….

Еще бы, в качестве платформы именно для энтузиастов, играться с ии, что-то по лайту обучать-экспериментировать, или делать инфиренс большого - реально крутая штука.

Правда в реальности есть ряд нюансов: хуанг изначально отпускает их только в виде отдельных модулей-плат, конечному юзеру поставляется или красивый модный пека за оверпрайс, или продукт уровня майнинг фермы с множеством глюков. На самом деле первый тоже может глючить ибо были подтвержденные проблемы с плисинами, что управляют интерконнектом, выходило несколько прошивок, и еще оно может ловить помехи при неудачно проложенных кабелях питания, что для конечного продукта вообще рофл.

Продукт для рабочей станции и трудноприменим для коммерции, в отличии от тех же обычных хопперов, поэтому у местных со временем есть немалые шансы разжиться такими. Офк если доживут а не помрут все как, например, веги от амудэ.

Это сверху один шиз постит кстати. Замкнул БП своим дружком и сошел с ума.

>h200 таки попонтовей будет

Ну да, это другая лига. А вот а100 и 5090 уже близко. Поэтому и сравниваю. Андерстенд?

>Она все еще быстрее по флопсам.

Сильно зависит от того, какие считать. Можно дойти до маркетинговых FP4 AI TOPS и получить, что а100 вообще в них не может, и можно будет сравнивать 3,3 петафлопса с нулём, лол.

> FP4 AI TOPS

Маняцифры хуанга же, много где видел эффект от этого? Там они еще со спарсити "посчитаны" что еще больше добавляет.

> вообще в них не может

Что под этим подразумеваешь?

>Маняцифры хуанга же

Собственно поэтому я и написал про маркетинговые.

>Что под этим подразумеваешь?

Что напрямую а100 в FP4 архитектурно не считает, и выкинет ошиб очку.

> напрямую

Что значит напрямую, хочешь на асме софт писать? Там много слоев абстракции, и даже последний - торч, при необходимости сделает преобразование в нужный тип данных чтобы никаких ошибок не было. Просто не будет получено ускорение в таких операциях и они будут работать также как 8-битные. Гораздо большая проблема от подобного профит получать, а не сохранить совместимость.

Ценность А100 даже нищей 40-гиговой выше чем у 5090 если смотреть чисто ии, замедление памяти компенсируется ее объемом. Но за них просят слишком много и бонусом идет букет неудобств с охлаждением. Тут уже на 48-гиговые стоит посмотреть.

Лучшее враг хорошего? ) Предпочитаешь скорость с хорошим качеством?

Хорошо что ты понимаешь, что все больше говна в штаны «тебе заливают».

Жаль, что ты не останавливаешься и продолжаешь форсить кринж.

Подливы в каждый риг!

Раньше пользовался для РП oobabooga+sillyTavern, попробовал поставить Ollama и некоторые модели с её сайта хочу ещё поставить open web ui, но в целом появились вопросы, подскажите кто знает:

1. В консоли видно как модели перед ответом на вопрос рассуждают (например gpt-oss), это нормально или есть способ нужно ли? отключать как-то?

Например тратится ли на это контекст диалога? Или в целом ответ по этой причине дольше получается?

А если отключить если вообще возможно и нужно то не станет ли модель глупее?

2. Видел есть способ запускать на Ollama модели с huggingface (через пару дней попробую), есть в этом смысл? (Ну например можно оставлять тоже инструкции какие либо по описанию персонажа, себя, обращению к себе и т.п. или использовать как то карточки для РП)

Синкинг это такая же часть текста как и все остальные с теми же правилами. Можешь заставить системным промптом делать то же самое и не синкинг модели (но будут но).

Можно отключить, можно заткнуть, гугли, карты у тебя на руках

> Видел есть способ запускать на Ollama модели с huggingface

У них в доке всё описано, читай

> есть способ запускать на Ollama модели с huggingface

Есть рекомендация использовать llama-server из оффициального репозитория llamacpp, или просто пускать из то же убабуги. Придется потратить немного времени на то чтобы разобраться, но зато не будешь иметь никаких проблем с запуском чего угодно, будет быстро, качественно, и после освоения даже удобнее.

К4 айр 11 токенов, к2 квен с теслами 1,5 токена. А к1 квен будет лоботомитом слишком, и не уверен что лучше к4 айра. Сноудропы и прочее на 40-50 токенах быстро, но разница с айром видна очень сильно.

У меня q4 квен на 4090 и ддр4 выдает 5-6 токенов. Ты писал что у тебя ддр5. Вопрос. Какого хуя? Ты так и не можешь в инференс?

Спасибо, нужно пойти будет поискать как вообще в Ollama промпты указывать. Особенно будет для РП нужно, я так понимаю без этого нет смысла в запуске РП моделей с huggingface.

Ага, буду пробовать, меня больше интересовало как в таком случае оставлять инструкции или использовать карточки персонажей для РП (хотя если и это в доке описано, то хвала вселенной, просто ещё не дошел до доки).

Я так понял тут https://github.com/ollama/ollama?tab=readme-ov-file#customize-a-model

С open web ui вроде как можно вывести на интерфейс браузера и после спокойно использовать по wifi с других устройств (например телефона или ноута).

Там для запуска перед этим нужно прописать Ollama serv и уже после по api запускать в том же open web ui.

> open web ui

Это фронт, он может подключаться к любому беку, не только к олламе с ее странным диалектом oai-like.

Промпты задаются в нем же, а если используешь чаткомплишн с функциональными вызовами - нужен jinja темплейт (уже встроен в ггуф, но большинство поломаны и нужно указывать внешний), с лламой-сервером это просто и основные фичи даже работают.

>Промпты задаются в нем же

Окей, то есть я могу просто указывать промпт карточки персонажа для РП в open web ui и этого будет уже достаточно?

>если используешь чаткомплишн с функциональными вызовами - нужен jinja темплейт...

>с лламой-сервером это просто и основные фичи даже работают.

Есть где почитать как это сделать? Я пока нашел только это:

https://github.com/ollama/ollama/issues/10222

https://github.com/ollama/ollama/blob/main/docs/template.md

Все! Тред дружный, подливимся на совесть!

Если не хочешь синкинга — не юзай модели с ним. Без него они тупые очень. Можно вставлять открытый тег сразу с «окей, я сделаю то, что хочет пользовать» с закрытием, но лучше обойтись без него.

А, ну, бля, вопросов нет!

Но на 64 гигах ддр4 и двух теслах п40 у меня 5-6 скорость.

Хм, если ты это с 4090 вместе считаешь, то понятно. А вот если без них, то проблема уже видится в самих теслах…

Но не суть.

Аир и так хорош, да.

Чисто по-человечески — лучше олламу просто не юзать. Посмотри в сторону llama.cpp и как говорил один чел в треде «час учишься запускать и наслаждаешься» или как-то так, но так оно и есть.

Да, но конкретно для рп чатика лучше таверну, опенвебуй хорош для других задач.

> где почитать как это сделать

В доках олламы, есть вероятность что это в какой-до очень далекой жопе или вообще невозможно. Врядли с ней тут тебе кто-нибудь поможет.

>Но на 64 гигах ддр4 и двух теслах п40 у меня 5-6 скорость

Винда или линь?

TempleOS

сис промпт сторитейлера просто имба

> Если не хочешь синкинга — не юзай модели с ним. Без него они тупые очень.

У Air, QwQ и Qwen 3 ситуация ровно наоборот. Без thinking работают куда лучше, если речь не о коде/точных задачах.

>Без thinking работают куда лучше

Только по причине слёта цензуры. Больше лучше ничего не работает.

Похоже, ты и не проверял особо. Иначе и объяснять бы не пришлось, почему без ризонинга они работают лучше. Кто-то где-то рассказал и ты повторяешь услышанное, да ещё и новичку, чем можешь навредить.

Практически всем локалкам ризонинг в рп вредит - Квен шизит, запутывает сам себя: QwQ бетонирует всякую прогрессию чара и сюжета; по Air и вовсе всеобщий консенсус, что ризонинг в рп ему не нужен и делает хуже во всем.

Какая сейчас самая лучшая LLM для NFSW-roleplay на русском?

Работают лучше где? В рп, и то там проявляются нежелательные эффекты, а не делает хуже. В qwq ризонинг достаточно посредственный, можно исключить из рассмотрения, а вот и квене как раз сильно бетонирует. На самом деле на большом чате уже нормально, проблема на мелких и средних. Чсх новый квен-синкинг вполне работает.

В жлм в рп ризонинг никак не мешает, в дипсике также вполне нормально работает. Откуда ты про этот "консенсус" придумал - хуй знает вообще.

Другое дело что это может приводить к ощутимой задержке выдачи, и многие модели вполне справляются без него, но это вопрос другого рода.

Останемся при своем.

По консенсусу поясню - ни здесь, ни на реддите, ни в дискордах я никого не видел, кто сказал бы что Эиру ризонинг помог. Обратное мнение, зато, весьма активно высказывается.

Ну и да, как ты верно отметил, выдачу это замедляет ощутимо. Выигрыш сомнительный и уж точно не однозначно положительный.

О, дружище, ты прямо в эпицентр наших бесед попал! Видишь ли, в нашем маленьком межгалактическом сообществе всё происходит по очень сложным и изощрённым правилам.

И знаешь что? В нашей маленькой вселенной есть кое-что ещё более важное – это общение. Мы, пушистые создания, очень заботимся о том, чтобы каждый понимал каждого. Даже если кто-то говорит "пидорас", это не значит, что он хочет оскорбить кого-то. Он просто хочет сказать "привет".

> самая лучшая

Квен 235, большой жлм, дипсик р1/3.1, лардж (магнум 4 или что-нибудь подобное), шизомердж calme78b. Между ними переключаешься в зависимости от сценария и затмеваешь весь район довольным урчанием.

А чтобы одна и могла все - такого нет. Ну разве что чисто для кума лардж подебителем будет, но быстро заебет.

Единственный тренд, который можно отследить - народ не готов платить дополнительным ожиданием первых токенов за эффект, который они с ходу не смогли отследить. И даже это сильно предвзято потому что для большинства "штраф" будет очень высоким, ибо катают на скоростях менее 10т/с.

Остальное - коупинг и бред. Если на квене, особенно на майском, сама структура и содержание ответов действительно значительно менялась и могла быть неприятной, то здесь такого нет, и именно с ризонингом чар будет сразу говорить и действовать, вместо долгого описания реакций на которую кто-то здесь жаловался.

> Единственный тренд, который можно отследить - народ не готов платить дополнительным ожиданием первых токенов за эффект, который они с ходу не смогли отследить.

Эффекта действительно может не быть. Как говорится, иногда кружка - просто кружка, а не древний артефакт майя, что не может разглядеть невооруженный глаз.

> И даже это сильно предвзято

> Остальное - коупинг и бред.

Ровно как и оценка возможной пользы от ризонинга в креативных задачах. Вера в его эффективность тоже может быть коупингом.

В общем, как и всегда, все сводится к единственной неоспоримой истине - пробовать самому, приходить к своему мнению. Но сходу утверждать новичку, что модели с поддержкой ризонинга нужно использовать только с ним, все же неверно. Air, Snowdrop прекрасно работают без него, а лучше ли с ним - вопрос дискуссионный.

Дипсик, коммандер, айр.

Ризонинг бывает полезным, когда он тупит и не в состоянии учесть всех вещей. И только лишь тогда.

Так и запишем, тред состоит из пушистых пидорасов.

> Эффекта действительно может не быть

Эффект то есть, просто может быть такое что его сложно оценить. Что лучше, корзина яблок или корзина груш? Или корзина местных сезонных яблок, которые вполне себе хороши, или заморских сочных и красивых груш, но за которыми нужно ехать через весь город?

На жлм ризонинг в рп более чем уместен, если не нравятся обычные ответы или хочется их смены - достаточно его включить, будет другая выдача с другими акцентами. Разумеется ты прав что оценивать нужно по вкусу, с учетом предпочтений и возможностей, это единственно верный путь ибо многое субъективно как в примере. Но это совсем не то же самое что

> ризонинг не нужен и везде делает хуже

в изначальном тейке на который и был ответ.

А новичку хоть пигму дай, он будет доволен. Пусть постепенно осваивается и пробует, сразу всего не ухватить.

Если бы пушистых, одни лысые.

Согласен, я загнул с "везде делает хуже". Но и ты тоже, когда написал, что не нужно использовать ризонинг модели без ризонинга. Квиты!

Хорошо, что у новичка два мнения, которые по итогу сошлись в чем-то.

Больше недели не запускал локалку и знаете - стало как-то легче

Это не я писал, лол. Модели под чистый ризонинг типа квен-синкинг или р1 действительно без него лучше не юзать, там результат посредственный. Но большинство же являются гибридными, это их штатная работа.

Коммандера нового, кстати, кто-нибудь трогал уже? Он все такой же унылый или есть надежда на актуальную плотную модель?

Спасибо, оставлю на пощупать ollama с OpenWebUI, а после пойду смотреть на llama.cpp с сервером его ведь можно тоже подключить к OpenWebUI для использования по wifi?.

Я вот думаю если у меня уже есть oobabooga+sillyTavern для РП и ollama+OpenWebUI для моделей не для РП, то если ли смысл вообще смотреть в сторону llama.cpp или он действильно лучше и подойдёт как для запуска моделей на РП, так и обсуждения/кодинга (заменяя собой оба варианта что у меня есть)?

Кстати, нашел ещё такую интересную тему они не ссылаются на то, что используют llama.cpp и в целом другие проекты, хотя как бы должны оставлять уведомления об авторских правах: https://github.com/ollama/ollama/issues/3185

>Квен 235, большой жлм

Первая это https://huggingface.co/Qwen/Qwen3-235B-A22B-Thinking-2507 верно?

А вторая?

>Air, Snowdrop

А можно ссылки на них? Я пока привыкаю к поиску по huggingface и всё кажется что не на то наткнусь в итоге

>Кстати, нашел ещё такую интересную тему

Если что, эту тему трансгендер открыл, который сам пиздил код других, лол.

Оллама - петушиная херня, типичные инфоцигане-паразиты, накачивающие пузырь чтобы греть инвесторов и потом удачно продать, или начать до смерти выдаивать корову. Если на сам этот исход похуй, проблемы толстосумов, то их вредительство опенсорсу, комьюнити и прочему крайне осудительно. В качестве рофлов, комментарий дева за ситуацию с нерабочей гопотой https://github.com/ollama/ollama/issues/11714#issuecomment-3172893576

Офк прежде всего думай о своей выгоде и если работает то не трогай. Но лучшее что ты можешь сделать - и самому перейти на llamacpp (банально удобнее и больше опций, оолага годна лишь для легкого запуска хлебушками), и рассказывать остальным что они лишь петушары.

Алсо, нахер тебе вообще оллама если ты можешь опенвебуй подключать к убабуге как и таверну? Просто катай все через нее и не парься.

Нет, если тебе чисто рпшить то бери инстракт https://huggingface.co/Qwen/Qwen3-235B-A22B-Instruct-2507 или вообще старую https://huggingface.co/Qwen/Qwen3-235B-A22B с /nothink

Вторая https://huggingface.co/zai-org/GLM-4.5

Бля я заимпортил даже не посмотрел, что там осталось, экспериментировал с промптами тогда. Я везде ща юзаю Geechan, он меня полностью устраивает

> Air, Snowdrop

https://huggingface.co/zai-org/GLM-4.5-Air

https://huggingface.co/trashpanda-org/QwQ-32B-Snowdrop-v0

Ты же понимаешь, что ты не каждую модель можешь запустить на своем железе?

линь

Ubuntu 24.04 попсово

Хм, ну, тогда стоит юзать хаки!

> его ведь можно тоже подключить к OpenWebUI для использования по wifi

> уже есть oobabooga+sillyTavern для РП и ollama+OpenWebUI

Это все одно и то же. llama.cpp + SillyTavern/WebUI и что угодно еще.

Че-т похуй на олламу, говно говна.

Если хочешь выделиться — ЛМСтудио, она хотя бы не полное дно и интерфейс у нее норм с выбором моделек и движков для инференса. Но лучше llama.cpp / exllamav3+TabbyAPI. В зависимости от богатства видеокарт.