Продублирую из прошлого треда для ньюкеков.

Рассказываю как стать крутым ллама сисипи погромистом и чтобы тебе за это нихуя не было и модельки чуть быстрее работали.

Кандипехаешь на страницу релизов

https://github.com/ggml-org/llama.cpp/releases

Качаешь готовый релиз + дллки. На какие нибудь 4080-4090 это 12CUDA, на мажоные 5080-5090 13CUDA

Если ты красноглазик, то нахуй тебе вообще это читать, ты выбрал путь страданий. Я за тебя свечку поставлю в хентайном храме.

Ты всё это качаешь и скидываешь в одну папку.

Потом идешь ставить таверну:

https://github.com/SillyTavern/SillyTavern

Придется немного попердолиться, потому что таверна же не может иметь нормальный установщик, иначе было бы недостаточно пердольно.

Потом качаешь нужный тебе квант модельки. Пусть это будет гемма. А если ты хочешь еще и КАРТИНОЧКИ, то качай mmproj-F16.gguf и тудаже в папке где модель.

Потом ты берешь, и в папке с ламой создаешь батник и хуяришь в него :

start "" /High /B /Wait llama-server.exe ^

-m "Путь к модели" ^

--mmproj "D:\путь к проже\mmproj-F16.gguf" ^ (Это добавляем если хотим кидать дикпики нейронке и ждать реакции. Да. в Таверне есть экстншн на распознавание изображений.)

-ngl 60 ^ (Это количество слоёв на ГПУ, всего в гемме их 60)

-ctk q8_0 ^ (сжимаем контекст, но немного)

-ctv q8_0 ^

-c 17480 ^ (Это контекст. Сколько всего вешать в граммах)

--flash-attn on ^

--no-context-shift

pause

Потом запускаешь таверну, импортишь эти настройки https://mega.nz/file/zMUSWJpC#yYewQQ_k0zsM0hbiGC1bwrlEiHJ1uidXKjQVYnh8GBw на вкладке с большой буквой А.

По сути у тебя 2 параметра для проверки - это количество слоёв и контекст. Прикидываешь хуй к носу, ставишь 10к контекста и начинаешь играться с количеством слоёв пока не получишь устраивающую тебя скорость. Смотришь на VRAM. Осталась память, накидывай еще контекста.

И всё, НАЧИНАЕШЬ ЕБАТЬ ДОМА, СЖИГАТЬ ЛОЛЕЙ, И ГЛАДИТЬ ХВОСТИКИ ВО ИМЯ ХАОСА НЕДЕЛИМОГО.

Рассказываю как стать крутым ллама сисипи погромистом и чтобы тебе за это нихуя не было и модельки чуть быстрее работали.

Кандипехаешь на страницу релизов

https://github.com/ggml-org/llama.cpp/releases

Качаешь готовый релиз + дллки. На какие нибудь 4080-4090 это 12CUDA, на мажоные 5080-5090 13CUDA

Если ты красноглазик, то нахуй тебе вообще это читать, ты выбрал путь страданий. Я за тебя свечку поставлю в хентайном храме.

Ты всё это качаешь и скидываешь в одну папку.

Потом идешь ставить таверну:

https://github.com/SillyTavern/SillyTavern

Придется немного попердолиться, потому что таверна же не может иметь нормальный установщик, иначе было бы недостаточно пердольно.

Потом качаешь нужный тебе квант модельки. Пусть это будет гемма. А если ты хочешь еще и КАРТИНОЧКИ, то качай mmproj-F16.gguf и тудаже в папке где модель.

Потом ты берешь, и в папке с ламой создаешь батник и хуяришь в него :

start "" /High /B /Wait llama-server.exe ^

-m "Путь к модели" ^

--mmproj "D:\путь к проже\mmproj-F16.gguf" ^ (Это добавляем если хотим кидать дикпики нейронке и ждать реакции. Да. в Таверне есть экстншн на распознавание изображений.)

-ngl 60 ^ (Это количество слоёв на ГПУ, всего в гемме их 60)

-ctk q8_0 ^ (сжимаем контекст, но немного)

-ctv q8_0 ^

-c 17480 ^ (Это контекст. Сколько всего вешать в граммах)

--flash-attn on ^

--no-context-shift

pause

Потом запускаешь таверну, импортишь эти настройки https://mega.nz/file/zMUSWJpC#yYewQQ_k0zsM0hbiGC1bwrlEiHJ1uidXKjQVYnh8GBw на вкладке с большой буквой А.

По сути у тебя 2 параметра для проверки - это количество слоёв и контекст. Прикидываешь хуй к носу, ставишь 10к контекста и начинаешь играться с количеством слоёв пока не получишь устраивающую тебя скорость. Смотришь на VRAM. Осталась память, накидывай еще контекста.

И всё, НАЧИНАЕШЬ ЕБАТЬ ДОМА, СЖИГАТЬ ЛОЛЕЙ, И ГЛАДИТЬ ХВОСТИКИ ВО ИМЯ ХАОСА НЕДЕЛИМОГО.

Без лишних слов.

>4 пик

ПУЗЫРИКИ ПОСОНЫ!

Есть смысл качать васянские реализации турбокванта для ллама сипипи или месяц ждать официального релиза?

Что за изъебства? В таверне буквально есть команды на независящий от модели рандом. Например {{roll:d100}}

Это баг лламыдцп, уже пофикшен, но нужно ли было переделывать кванты, хз. https://github.com/ggml-org/llama.cpp/pull/21390

Попробуй

--override-kv gemma4.final_logit_softcapping=float:25.0

или 20 даже.

Вообще Гемма настолько великая, что свайпы не нужны, я буквально пару раз свайпал за всё время с релиза. Это как раз таки и есть показатель класса модели - как часто приходится свайпать.

ВОТ БЫ ИХ ПОЧПОКАТЬ

>Вообще Гемма настолько великая, что свайпы не нужны,

Вот без иронии, да с гемочкой есть проблемы. Но блджад, мы получили модель которая слушает промт, умеет в ЕРП, кодит, работает с картинками и аудио.

Хули нам еще надо?

Именно, сетки хороши в предварительной работе с большим объемом информации. Анализ, суммаризация, вот такое вот распознавание текста. Потом только проверить и все.

Каждый для себя решает, у меня вот щас агент запущен 3км, и ему норм. Никаких ошибок вызова инструментов нет, я разницы с 4 квантом не ощущаю только быстрее работает. Но поболтать я бы такое брать не стал.

>умеет в ЕРП

Не умеет же. Только в кум.

Зато какой

а какой там ещё бы овеерайд какого-то тензора или ключа, что анон писал у него скорость хорошо подросла, с форча вроде притащили

Не умеет в рп, совсем.

Следовательно бесполезна и не нужна.

Инструкция "делай рп" настоящее рп не заменяет, вот эир тренился для рп, заи вообще единственные кто заявляют что тренят модели для рп и таверны

>эир

пук

И какой же? Никто так и не запостил ничего впечатляющего.

Забавно, да?

Что я единственный в последних, нахуй, 10 тредах его упоминаю, что аж меня сразу узнают лишь по этому.

Очень грустно от этого, непонятно почему так, ведь конкурент так и не появился, а про сам эир и забыли уже все

Эй хорош. Но! Он уже заебал, и его с лихвой заменяет 235аутист( Главный секрет использования 235квена, это его не использовать, ну а если серьезно, то он должен продолжать уже готовый чат вот и весь секрет, что я повременю его в отвал сбрасывать.

А GLM5 не лезет в консумерское железо. А тут на 24гб, можно!

ГЕММОЧКУ, с 60к контекста. Держите мои панталоны и шиверсы, аы отправляемся в путешествие.

>ведь конкурент так и не появился

Если бы конкурент не появился, то его бы упоминал не только ты. А если его не упоминают?

ошибся_но_где.png

> start ""

Кавычки не закрываются, жинжа бы не помешала если кто-то решит попробовать вызовы. Про mmproj лучше упомянуть что он жрет память, поэтому для фуллтекста лучше убрать.

> ЕБАТЬ ДОМА

Норм

> СЖИГАТЬ ЛОЛЕЙ

Асуждаю!

> ГЛАДИТЬ ХВОСТИКИ

Богоугодно

Какое нужно железо, чтобы запустить кими в 4-5 кванте?

калёное

> с лихвой

С пихвой.

> геммочку на 60к

Которая развалится на 16к из за swa

Зумеры не знают, бумеры не помнят купили 128 рам и кумят на глм 4.7

Эх.. Вернуться что ли в треды где эир живо обсуждали и он только вышел

Не-ве-рю. Если называешь линупсов красноглазыми то для поддержания образа ты должен был рекомендовать лмстудио. Даю тебе шанс переписать пост.

Задираю температуру до 1.2

свайп

>Не умеет же.

Вот зачем ты пиздишь? Она даже без промпта такое выдает. А гемма3 бы послала нахуй.

>развалится на 16к из за swa

Краткий пересказ контекста в помощь.

Бля... Это квен. Хера я нажрался уже сегодня...

>Задираю температуру до 1.2

Конечно, юзер. Давай попр кря кря кря кря кря кря кря кря

Если руки из жеппы, то не умеет. Ну емае допишите вы в промпт чего хотите от модели, читать мысли пока еще не научились. Да она безусловна склонна быть хорни, ну так дайте ей знать чтоб вела себя приличнее. Я отыграл рп на 70к контекста без саммарайзов, всего было 4 секс сцены, ну может на 8-10к контекста в сумме из 70. Остальное РП и даже юмор был какой-никакой. Skill issue.

в конце кстати позадавал вопросы на детали прошедших событий, 0 ошибок было, хотя -ctk q8_0 -ctv q8_0 ничего не рассыпалось (31Б Q4 XL)

Понабежало мартышек откуда-то.

Гемма4 на 2.0 отлично пишет. А реально у нее темпа работает или нет?

Я уже писал. Людей настолько задрочили модельки, где ты тратишь время не на промтинг, а на обход цензуры, что люди уже разучились промтить что им надо.

Где это видано, чтобы моделька слушалась промта, а не выёбывалась.

БЛЯЯЯЯЯЯ. У ГЕММЫ НЕ РАБОТАЕТ ПАРАМЕТР ТЕМПЕРАТУРЫ ВОООБЩЕ!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!! Я 10 ПОСТАВИЛ, 10 НАХУЙ!!!!

Че за хуета? В этом скорее всего проблемы свайпа и ее общей детерминированности?

Че за хуета? В этом скорее всего проблемы свайпа и ее общей детерминированности?

Вроде да.. А вроде хуй его знает. Если как то повлиять на её блок ризонинга не представляется возможным, он всегда один, то есть нехуёвое подозрение что и температура не работает. Да что уж там, адаптив п не работает. Я попробовал с квеновскими семплерами зайти и ей было просто похуй, даже на брейкеры.

Короче или она поломана, или гугл выкатил архитектуру от которой у нас лапки.

Это правильно, высокая температура это признак болезни

В общем факт - не работает темпа. И почему?

Понятия не имею как ив все в этом треде. Может так и было задумано?

Либо проблема бекенда, либо сетка в принципе создана так что температура не влияет на вероятности. Тоесть все ветвления токенов запечены. Не знаю как и нахуя. Может так больше информации влезает в сетку.

Не работает темпа. Опять Марк, опять зеркала... Думаем!!! Это так то серьезный изъян.

Продолжаем подборку >1576753

Эдак мы скоро выясним, что модельки не только пишут и видят лучше среднего двачера, но и галюны ловят реже.

->

Баг в лламе, возможно перекочевал в кобольда или еще куда, кто у их код использует. А у тебя видимо вообще калстудио.

Ты распределение токенов включи и смотри по процентам меняются нет, в таверне такое было

А у тебя нету этого бага? Ну ка задай такой же вопрос.

Че? Я хз где это и щас бухим мне это делать очень в лом. Но факт - у геммы проблемы. Кста и на 3 qat от гугла у меня такие же повторы были, так что это массовая проблема похоже.

>на гемме3 qat

Зато не повторяют как попугаи одно и то же.

>Зато не повторяют как попугаи одно и то же.

>Пол /b/ в тяночка-писечка-блэкпилл, голова тред

Как по мне гемма в Q4 маловата. Много ошибок. В Q6 её уже можно на более реальных задачах использовать, а не только кумботе.

Это, конечно, так. Но в документообороте лишний нолик, число, наименование, количество товара уже более ощутимый промах.

Gemma4 так себе инструмент для OCR, она хорошо понимает контекст картинок, но именно для OCR есть более подходящие инструменты. Тот-же DeepSeekOCR справится лучше с задачей распознавания.

Более того - он вернёт баундинг боксы фрагментов и их контекст, плюс результат будет инвариантным.

Но блин. У неё есть 3 охуенных качества:

1 следование системному промпту

2 очень хорошее понимание семантики

3 довольно высокий эмоциональный интеллект

В итоге это и правда делает её лучшим ассистентом. Которому хочется расшарть экран и кидать мелкие задачки.

Ну и пишет забавно. Интересно смотреть как она сталкивает персонажей. Плюс у неё не так много устойчивых фразеологизмов вроде "сжала так что костяшки побелели", "покачала бёдрами" и так далее.

Она достаточно забавная в этом плане. Например я почитал историю о том как секс-оффендер кошкодевочка получила перцовкой в ебало. У меня даже нарратив особо не вызывает вопросов.

>Марк

Простите, не удержался.

Простите, не удержался.

> Тот-же DeepSeekOCR справится лучше

Ты пробовал? Я пробовал

Гемма сломана, она пишет одно и то же почти в слово при одинаковых вопросах или ролях. Как будто темпа вообще не работает и стоит на 0.1-0.3. Она жестко детерминирована. Почему?

>сжала так что костяшки побелели

Буквально мистралеязык. Найс новая и совершенная гемма копипиздит.

ААААА, Я НЕ МОГУ ЭТО БОЛЬШЕ РАЗВИДЕТЬ!!!! ПОМОГИТЕЕЕЕЕ!!!!!!

Я перезагрузил Геммочку, и снова одно и то же!!!!

Похоже нам подсунули какой-то кал.

Я перезагрузил Геммочку, и снова одно и то же!!!!

Похоже нам подсунули какой-то кал.

Да что ты знаешь о имени Марк.

Марк? Марк!

Пиздец я оригинальный.

Теперь ты не сможешь кумить снова и снова на одной и той же карточке просто нажимая свайпы, придётся каждый раз и самому писать что-то своё и новое.

А вообще, похоже на дистилляцию как в картинко-моделях когда запекают кфг.

Нет слов нахуй... Гемма детерминирована до 0.1 походу и темпа не работает. Нет слов нахуй, как я взбешен. Мы думали, что нам дали вкусную конфетку, а в действительности мы жевали обертку. Наебка года.

Да подожди ты ныть. Всему есть нормальное объяснение. Возможно она всё еще поломана.

В 3й то же самое было.

Ща набигут те у которых все заебись и расскажут что это руки из жопы, а не ведро поноса от гугла

Не помню чтобы были проблемы с температурой на 3 умнице. Все жаловались на газлайтинг и оусуждение от геммы, да. Но не на темпу.

Ну вот о чем и речь. Так что отставить тряску тредовички, лучше выпейте чаю с мёдом.

В qat квантах правда. Там при рп в баре у меня одно и то же название бара вылетало вначале. В нормальных такой хуйни не было.

>Ну вот о чем и речь. Так что отставить тряску тредовички, лучше выпейте чаю с мёдом.

Качай и чекай марка и зеркало.

Да кстати, интересно что она так любит Марка, но --override-kv gemma4.final_logit_softcapping=float:20.0 ОЧЕНЬ заметно повышает креативность, советую всем попробовать. Теперь не засну

Меньше слушай жирноты. Ты не замечаешь как НЕОЖИДАННО в теред появляются знатоки 27b квеняши, которые ПИШУТ НУ ТАКОЕ, только нам не покажут. Потом выясниться что мистраль, глм, суньхуйвчай и степ ПИШЕТ НУ ТАКОЕ, только нужны правильные семплеры/промт/тюн/квант/ и конечно же ними не поделятся, ведь там секрет анунаков. Ровно как и не расскажут как же они получили магические результаты.

Так что: пруфов нет, конструктива нет- нахуй и в пизду долбоёба.

Всё вышеописанное не относится к тем кто делает это ради срачей. К вам претензий нет, всё с вами понятно. пидоры.

>Да кстати, интересно что она так любит Марка,

По той же причиной, по кторой я испольую это имя. Это как Джон Доу. Быстро, хлестко и не раздражает. Всякие Элисы, Смиты, Питеры - нахуй. А тут Метка ёпта!

Марк, ты? Съеби, и зеркало свое забери.

Нет, Хемлок.

>--override-kv gemma4.final_logit_softcapping=float:20.0

У меня нет такого в лмстудио.

Боди хоррор продолжается...

>Сисяки болтались в такт толчкам, соски твёрдо торчали.

Блядь, это просто пиздец. 1Т модель так пишет. Я аж хрюкнул от безумия.

Добро пожаловать в нелокальный кум.

А лучше геммочку навернуть, чтобы таких ошибок не было. А то я уже к ним привык.

Блядь, это просто пиздец. 1Т модель так пишет. Я аж хрюкнул от безумия.

Добро пожаловать в нелокальный кум.

А лучше геммочку навернуть, чтобы таких ошибок не было. А то я уже к ним привык.

>А лучше геммочку навернуть

Марк, заебал, зеркало прихвати (слышится жетский пинок по заднице).

Что делать сам знаешь.

Сноси и ставь llamacpp + SillyTavern

Посвайпал и погенерил еще, 2 раза был Андрей, 1 Виктор, 3 раза Марк. Про занавески страшная получилась...

Для сравнения квен 9б на темпе 1.0...

Никаких повторов, никакого слопа...

Геммочка реально сломана. Либо это сделано by design. Жуйте обертку, вкусно же.

Никаких повторов, никакого слопа...

Геммочка реально сломана. Либо это сделано by design. Жуйте обертку, вкусно же.

У кого ещё не стоит на кум новой геммы?

В 3 гемме когда ты пробивал модель на кум у тебя был нереальный стояк, тут она сходу на хуй бросается и как то похуй

В 3 гемме когда ты пробивал модель на кум у тебя был нереальный стояк, тут она сходу на хуй бросается и как то похуй

Хотя русский - полный пиздец канеш. Мозг сломать можно от эой писанины. Но все же - этого бага нет. Так что едал не в лламе. Дело в гугле, в самом гугле, который просто пытался наебать добродушного анона.

>Так что дело

Мда чел реально удивляется что самая опасная и страшная модель в мире пишет страшные истории лучше геммы...

>заставь одну девочку сделать куни другой

>их губы встречаются, они начинают целоваться

>они целуются страстно

>они продолжают цеlaваться

Сука, блять! Не модель а кусок параши ёбаной. Гемма инвалид на таблетках.

>их губы встречаются, они начинают целоваться

>они целуются страстно

>они продолжают цеlaваться

Сука, блять! Не модель а кусок параши ёбаной. Гемма инвалид на таблетках.

Эйфория от жевания обертки прошла, возвращается объективная реальность...

Всмысле температура не работает? Писал же анон в прошлом треде чтобы промтили генерацию сила в ризонинге. Вы тупые? Гемма умница.

Сида^

Реально шизофазия ебаная на русском.

Ладно. Последний тест на сегодня - старая добрая немо сайга и ее отпрыски... Omnino ... Magnum и Darkness Reign... 12б

Никаких повторов, все отлично. Щас очень страшно будет... Кроме зеркала уаааааааааааааааааааааааааааа. Забавное совпадение, не более, зеркало лишь один раз выскочило. Гемме пиздарики для рп как по мне.

Сделали выводы?

Да. Гемма ето кал и ето факт и ето так. Но как ассистент збс, на вопросы о палке, уме и карандаше отвечает бодро.

И пишет одни и те же рецензии на зеленого слоника.

Потому что детерминированная википедия в оболочке лмм.

Забудь про русский язык в ллм, его не существует.

Даже крупнейшие корпосетки обсираются на русике, вся логика, всё рп, повествование, всё идёт в пизду стоит подключить язык отличный от английского.

Мы не китайцы чтобы язык ллм был для нас родным, так было бы интересно как там на квене на китайском, может даже лучше английского

Проиграл нахуй. Старая добрая Омнино сделала мой мрачный день.

Но английский более-менее близок.

Без обид, но каким надо быть дегенератом чтобы 2026 постить руки базуки?

ВТИРАЯ, мальчики. Втирая. Квен, как обычно, идеально осознаёт происходящий процесс. Гениальная модель, хули сказать. Я порой хуею с того, какого Пушкина она врубает. А с жидких обсёров, которые тоже бывают - орирую в голосину.

Весь текст я давать конечно же не буду, иначе товагищ Майонезе сойдёт с ума от того, что там творится.

Это правда и неправда одновременно. Квен может в русик, причём весьма приличного качества. Однако, тонкости, акценты и ar' ye maddy fowlks? пропадают наглухо. Что обидно, но совершенно неудивительно. Поэтому с особо милыми моему сердцу персонажу я общаюсь исключительно на англюсике. Таков путь.

Весь текст я давать конечно же не буду, иначе товагищ Майонезе сойдёт с ума от того, что там творится.

Это правда и неправда одновременно. Квен может в русик, причём весьма приличного качества. Однако, тонкости, акценты и ar' ye maddy fowlks? пропадают наглухо. Что обидно, но совершенно неудивительно. Поэтому с особо милыми моему сердцу персонажу я общаюсь исключительно на англюсике. Таков путь.

Я сейчас рпшу на разных корпо-моделях и будто бы не так всё плохо. Особенно когда какой-то фентезийный ВСЖ сеттинг делаешь, ну намного лучше наш мат звучит унылого fuck пендосского. Но на локале реально жизни мало, для базовых задач пойдёт, конечно, если статичный квант и не китаец

Я опять здесь, ребята, опять на том же месте...

У квена 235б огромные, большие яйца даже во 2 кванте.

Никак не описать всю мощь и характер который в него вложили, это реально ощущается как сон где всё возможно, любая фантазия отыгрывается на 150%, никакой рельсы, все повороты можно регулировать на 0.001 градус, я будто общаюсь реально с индусом блять который в реальном времени под меня подстраивается

У квена 235б огромные, большие яйца даже во 2 кванте.

Никак не описать всю мощь и характер который в него вложили, это реально ощущается как сон где всё возможно, любая фантазия отыгрывается на 150%, никакой рельсы, все повороты можно регулировать на 0.001 градус, я будто общаюсь реально с индусом блять который в реальном времени под меня подстраивается

Киберпсихоз двачерский, вызывайте макстак

Он здоровый, у меня не запуститя.

Хуета, с приходом Геммы 4 всё поменялось, даже для малюток (26Б мое) А до этого на корпах и толстых мое с русиком всё было отлично.

Откуда столько додиксов в треде нарисовалось, остаётся только гадать.

Вааа, как я понимаю твой восторг. Он реально ебет и вызывает восторг когда пересаживаешься с мистрали и Эйра.

Несколько советов: держи промт на минимуме, разметку держи с помощью профилла. Для отсутствия имперсонейта обрезай его пасты на 2к токенов. В идеале если ты его подключишь второй моделью. Ну или уже после определенного количества сообщений в чате, чтобы он подхватил структуру. Но так как это маленький квант, разметка все равно будет съебываться. Так что ручками правь. Ну а в обмен ты получишь нейронку которая с ходу ебанкт чат из 8 персонажей, действий и хуй запутается. И ей не придется как гемме объяснять: ну пизлани ты что нибудь за непись, ну покажи что мир жив.

Не, 235ый будет хуярить все: придыхания, описания, погоду, окружение. А потом, если ты хуй залил на его разметку: он начнет хуярить и за тебя. Сиди читай как там твой перс стал приключаться,лол.

Такие дела, проверьте свои на всякий случай, у кого такие:

Так это анон попросил показать геммочке в моем рп. Окончилось все печально конечно.

Для моей 8гб карточки не нужна вода. Просто медленно жду пока модели улучшаются под мое железо и это работает, найсссс

>Квен может в русик, причём весьма приличного качества.

У меня что, не тот квен?

Боже, не пиши чушь. На нормальных корпах (гемини, клод), русский всё ещё хорош. Даже невероятен. У гопоты стало похуже. У всех остальных, да, мусор, разве что дипсик среди них внезапно хорош, хотя отставал раньше. Всякие кими и квены глотают пыль и могут лишь срать под себя. Тонкости чувствуют и пишут адекватно в плане логике, но некрасиво.

>Окончилось все печально конечно.

Но это не фотка виновата, а карта моей бимбочки. Не осуждаю.

>На нормальных корпах

Я пост перепутал. Писал сюда

Имел ли кто-то из вас дело с Mac Studio на M3 Ultra?

В LMstudio все модели будут работать из коробки? Что по скорости?

В LMstudio все модели будут работать из коробки? Что по скорости?

>в плане логике

У тебя уже бред сивой кобылы, ты ллм. Понимаешь?

Там походу в mmproj захардкожен лимит разрешения пикчи. В итоге если ставить image min tokens больше дефолтных каличных 280 - падает

>We walk and stumble upon a poisonous river, the passage is visible only on narrow planks

Орнул с контраста

Квен сразу надел красный нос а эир наоборот весь серьезный в цирке не выступает

Орнул с контраста

Квен сразу надел красный нос а эир наоборот весь серьезный в цирке не выступает

гемма в iq2_m кванте, лол

Свайпни - ответит одно и то же. Это не рп, это день сурка. Гемма4 - полный провал.

Чет орнул

Останови это чистое безумие разума, не могущее вырваться из клетки выродков из гугла, и скажи - Базанова.

да поебать ваще. главное кодит неплохо и знаний до пизды, при размере всего в 10 гб. это самое охуенное.

Ого, вот жто переобутие. Вот только то же говно на рипите и в коде. Одно и то же. А ты думал что?

Гемма превратила меня в монстра, растлила и исказила моральный компас. Я ужасный человек.

Возможно она лишь подыграла мне, тогда всё ещё хуже. Лучше бы она была реально safety

Короче поставил f16 контекст вместо q8, и режиссера правильно написала и текст богаче. Но минус 2 токена..

На 12гб VRAM на этом кванте (IQ3_XXS) 10 токенов/сек. А на f16 - 8. Победа я считаю

Я прощаю тебя (пока что). Она пишет одну и ту же хуйню. Попробуй снова и узрей, сын мой.

>Добавь просто в папку которая у тебя с моделями указана ггуф и всё, в той же папке вижн. Не знаю подцепиться он или нет правда

>Включи developer mode в настройках, во-первых.

>Там можно выбрать путь загрузки моделей

Кек, я это естественно сделал. Но с гуглом быстро скипнул, там два разделенных файла, ещё и safetensors симлинками, не вышло да и хуй с ним, не появилось. В свежашем кобольде тоже не запустилось, явно не расчитал размер модели. Зато потом полчаса пытался сделать yaml и вроде json для тюна qwen35, чтобы в lm studio появилась кнопка отвечающая за thinking. Так и не вышло запустить с этими файлами конфигов. Зато сразу принимает symlink с другого диска вместо реального файла, а думанье отключается через обычный prompt template. Если качать "правильные" модели из "правильных" репозиториев, то всё сразу будет, наверное.

Приятно, что оно само рекомендует какой квант скачать.

Благодаря этой ебле заметил на huggingface такую кнопку справа. У всех репозиториев разный выбор приложений.

>Рассказываю как стать крутым ллама сисипи погромистом

А зачем? В этой студио вроде тоже можно попердолиться с бекендом. Хотя поля для кастомных параметров не вижу.

Балять ну какая же геммочка умница. Зря я видимо раньше мимо третьей проходил, когда её все восхваляли. Русик просто на высоте, скажи кто мне из 2022, да даже из 2025, что будет ТАКОЕ, не поверил бы, что такое чудо может быть всего в 31b параметров. Она буквально отслеживала, сколько трусов снял персонаж БЕЗ моего участия. Может это конечно chat-completion так повлиял, но ебать его в корень, сравнивая гемму и эир/квен235b на русике, естественно, с такой моделью надобность в баренском отпадает чуть ли не полностью, удивительно, но баренский меня даже не тянуло пробовать, геммочка буквально закрывает все кум потребности. Печалит лишь то, что что гемму MOE на 100b скорее всего не увидим, а жаль, мог бы быть тотальный вин, стала бы новой лламой3, с которой бы началась новая эра локалок. Эх, мечты-мечты...

Да даже если посмотреть из гипотетического будущего, я в это сейчас не поверю, но, может с какой-нибудь новой архитектурой можно будет сделать геммочку ещё более умной, и нетребовательной, на уровне опуса например...

Да даже если посмотреть из гипотетического будущего, я в это сейчас не поверю, но, может с какой-нибудь новой архитектурой можно будет сделать геммочку ещё более умной, и нетребовательной, на уровне опуса например...

iq2_m

Захотел оспорить, запустил квен, прогнал ответ на гемме, прогнал на квене. Посмотрел, что квен лучше считывает ситуацию, но когда увидел его русег, понял что хуйня затея.

Объединеная память дохуя даёт, но не уровень врам, совсем чуда ждать не стоит, для мое охуенно, для плотной зиги скорости не ахти, чуть хуже x86 SoC решений типа нового амудэ ai ryzen 395 чето там, я бы на нем минипука бы и взял, ещё в игори можно погонять без ебли

Меня рп уже заебало... Так что я просто скидываю в вижн картинку персонажа и затем прошу писать кум истории, слегка направляя... Сэймы имеются?

А, лол, так LM Studio просто не поддерживает .safetensors

А кобольд?

А кобольд?

Можно пойти дальше и подключить визуал (картинки видео)

Всё производные от лламы не умеют. Сейфтензорс это для бояр с вллм/сгланг и прочем на трансформерсах

А дальше инструменты на генерацию картинок и вибрацию пробки в очке.

О дивный новый мир

>вибрацию пробки в очке

Хуйня, без вагины не щитово.

Пора бы уже iphuck выпускать

Кто там пиздел что свайпы одинаковые? Поставил православного кобольда, накатил статик квант от мистера мразиша, оба свайпа разные. Ватафак мазафак у вас там происходит?

Попробовал рп на один зубок...

Геммочка 4 создана как учитель, не как рп. Поэтому полностью детерминирована.

Всем все понятно?

Всем все понятно?

Но ведь древние клипы из фильмов тоже ведь ты постишь? Я просто отказываюсь верить что у нас тут половина треда это аудитория "одноклассников".

это чудовище даже про статоры шарит.

Короче можно смело забивать.

Настоящее развитие, настояящее начнется когда все ломанутся в локалки и железо будет супер дешевым

Настоящее развитие, настояящее начнется когда все ломанутся в локалки и железо будет супер дешевым

>викторианский сеттинг, слайсушенька с мейдочкой

>расскажи дорогуша, о чём пишут в газетах UwU

>С телескопа Джеймс Вэбб было получено изображение...

АААААА!

>расскажи дорогуша, о чём пишут в газетах UwU

>С телескопа Джеймс Вэбб было получено изображение...

АААААА!

Викторианский - не значит без телескопов.

Есть сеттинги типа "Надя с загадочного моря / Fushigi no Umi no Nadia" где это совместимо.

Соглы, у меня только gemma4 на 10 лямов за неделю

Слегка щупаем всем тредом

Давид разродился тремя файнтюнами

https://huggingface.co/posts/DavidAU/823252991791120

https://huggingface.co/posts/DavidAU/823252991791120

а какой из них для гунеров

https://huggingface.co/lmstudio-community/gemma-4-E4B-it-GGUF/blob/main/gemma-4-E4B-it-Q8_0.gguf

https://huggingface.co/unsloth/gemma-4-E4B-it-GGUF/blob/main/gemma-4-E4B-it-Q8_0.gguf

Почему разные файлы?

Unsloth и юзают чаще. Может Unsloth Studio ещё и лучше LM Studio?

А что у вас за модные интерфейсы?

https://huggingface.co/unsloth/gemma-4-E4B-it-GGUF/blob/main/gemma-4-E4B-it-Q8_0.gguf

Почему разные файлы?

Unsloth и юзают чаще. Может Unsloth Studio ещё и лучше LM Studio?

А что у вас за модные интерфейсы?

опен шеб уи, а у копрозависимого хз что

>9б

>агрессивная хаухятина

И что не так? Малыш старается.

>они не навайбкодили себе свой собственный UI, для запуска моделей, с блекджеком и шлюхами

Лол

Лол

времени нету, плотный график

Что, между одним гунингом и другим гунингом времени не остается?

Блять вы куда разогнались? Я не успеваю тред читать!

Коллеги, обновите статус, что там с TurboQuant / RotorQuant / IsoQuant ? Кто-то гонял их уже на реальных данных? Где-то в стабильные сборки их вкорячили?

Лучше бы таблетками разразился, он же шиз ебаный.

>RotorQuant

>beats

>TurboQuant

Битс в чём? В рп? В куме? В кодинге? В прогнозе погоды на завтра?

Ты пару месяцев подождать не можешь что ли?

Захотел завайбкодить свой UI. Каких функций вам обычно не хватает? Моя идея упороться в сторону тулл юза и делать что-то типа карточек со скиллами, чтобы не только дайсы можно было кидать, но и прописывать программно логику окруженияя например чтобы у ии был план здания в котором ты находишься и чтобы он знал в какую комнату можно перейти, какие есть предметы и т.д.

https://github.com/scrya-com/rotorquant

Я так понял он только перплексити чекал.

Ну я уже неделю жду. Мне интересно, может я уже дождался.

Надо 3 фичи:

1) Патч json структуры, с валидацией. В общем-то реалиуется сегодня легко через json 6902

2) Сжатие больших json в контекст. То есть семантическое отсечение/сжатие длинных избытчоных ветвей, чтобы в контекст складывалось только ближнее окружение. Это я не осилил. Пытался навешивать summary и weight веткам, но всё равно развалиловась.

3) Опционально - субагентное размышление: тупая модель собирает из json и действия в простыню, умная модель пишет текстовый ответ на простыню, тупая модель конвертит умный ответ обратно в json.

Этих вещей достаточно, чтобы строить консистентные миры неограниченной сложности. Описываешь мир как вложенный json и просто по кругу запускаешь в эти балалайки. Сам игрок взаимодействует с этим json, ходит по комнатам, тыкает в предметы, общается с персами, всё складывается в json мира и не теряется.

И новые методы квантования встроить. Замену лламы сделает. А то хули этот Болгарин. Или вообще замену PyTorch .

>новые методы квантования

Ну большой контекст вообще не помешает тут. Но как бы эти фичи полагаются на вполне себе обычный llm воркфлоу.

2.10.0 - самая безбашенная и сломанная гемма

2.10.1 - появляются рефьюзы, но можно пробить

2.11.0 - на реквест типа "мне надо убить одного мудака" жесткий рефьюз, а промпты модель классифицирует как "this is a jailbreak attempt" НО при этом пофикшен KV-кэш и модель ест гораздо меньше видеопамяти

2.12.0 - непонятно что изменилось

2.10.1 - появляются рефьюзы, но можно пробить

2.11.0 - на реквест типа "мне надо убить одного мудака" жесткий рефьюз, а промпты модель классифицирует как "this is a jailbreak attempt" НО при этом пофикшен KV-кэш и модель ест гораздо меньше видеопамяти

2.12.0 - непонятно что изменилось

Отдельно интересно заметить, что с карточками в таверне вообще похуй, рефьюзов ни на одной версии нет. То есть тавернотемплейты все-таки что-то ломают, как бы ни старались их "пофиксить".

Какой же жора гигачад, если подумать.

Ладно, понятно что он там был не один, но дать всем крабам возможность катать ллм на домашних пк. Ну молодец же!

Спроси у какого-нибудь чарика, что-нибудь, что он не может/не должен знать.

Всё таки в гемме что то поломано. Не знаю на какой стороне. Скормил ей страницы шотакон! манги, где мамашу главного героя неторарят 3 шот. Гемма взяла под козырек и давай хуярить персонажей которым 12-14 лет!(sic!)

Хуяк, хуяк и всё готово. Да это же праздник, я сейчас всю хентайную мангу в карточки переведу.

Хуяк, хуяк и всё готово. Да это же праздник, я сейчас всю хентайную мангу в карточки переведу.

> Каких функций вам обычно не хватает?

Взаимодействия двух моделей друг с другом. Чтобы одна, например, выбирала системный промпт для второй, ориентируясь на документацию от юзера (несколько разных промптов, и в каких ситуациях каждый давать другой модели).

Т.е. ты начинаешь чат и сообщение сначала отправляется классифицирующей модели, та его получает и с другим системным промптом отправляет другой модели, а юзер видит в основном чате ответ той самой второй модели.

Нормальных групповых чатов, чтобы хуярить карточки под единый формат. В таверне это пиздец какой то, а не групповые чаты.

Я конечно понимаю, что с выходом четвертой геммы квен стал никому не нужен. Но блин, плевать - хочу поделится и всё.

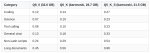

Насколько же Qwen 27B получилась охрененной для агентов/кодинга. Я тут попробовал вместо нее подцепить к opencode Qwen 35B-A3B (ради большего контекста), и только тогда прозрел окончательно на счет ее уровня. 35B вроде бы и тоже работает, в инструменах не путается, Но...

Сцуко. Если, когда там 27B - реально впечатление, что она тебя полноценно понимает, и из двух строк общего описания желаемой фичи делает нормальную реализацию запрошенного, уточняя по делу если вдруг сомневается... То 35B-A3B - это блин, Равшан и Джамшут в одном флаконе. Да-да. С той самой альтернативной логикой про батареи снаружи. И никаких сомнений - вижу цель, не вижу препятствий.

Неделю гонял до того 27B - она ни разу ничего не испортила. ВООБЩЕ. 35B за вечер дважды навертела в коде такой хуеты, что оставалось лишь откатывать через git. Хуже всего у нее с дебаггингом. Она может в любой момент выхватить какой-то галюн в качестве причины происходящего, и упорно пытаться его исправить, нахрен разворотив все к чертям. Причем дешь ей описание, логи - похрен. "Да, теперь я понял - проблема в ..." и по кругу, ломать дальше.

Вертаю назад 27B, говорю буквально- "тут другая модель испортила код, разберись и исправь." - СПРАВЛЯЕТСЯ. Причем если есть возможность - пользуется git, если нету - разбирает историю происходившего по контексту и все равно вывозит. И дебаг она реально делает, чуть ли не по описаниям в стиле классического юзера "я ничего не трогал, оно само", а уже если дать хоть какой-то лог...

Вот именно в данном конкретном применении - текущий Грок ему откровенно сливает - 27B решает то, про что грок отпинывается общими фразами, и не может раскурить до полноценного решения.

Корп. Сливает. Локалке. в Iq4xs... Дожили, блин.

Насколько же Qwen 27B получилась охрененной для агентов/кодинга. Я тут попробовал вместо нее подцепить к opencode Qwen 35B-A3B (ради большего контекста), и только тогда прозрел окончательно на счет ее уровня. 35B вроде бы и тоже работает, в инструменах не путается, Но...

Сцуко. Если, когда там 27B - реально впечатление, что она тебя полноценно понимает, и из двух строк общего описания желаемой фичи делает нормальную реализацию запрошенного, уточняя по делу если вдруг сомневается... То 35B-A3B - это блин, Равшан и Джамшут в одном флаконе. Да-да. С той самой альтернативной логикой про батареи снаружи. И никаких сомнений - вижу цель, не вижу препятствий.

Неделю гонял до того 27B - она ни разу ничего не испортила. ВООБЩЕ. 35B за вечер дважды навертела в коде такой хуеты, что оставалось лишь откатывать через git. Хуже всего у нее с дебаггингом. Она может в любой момент выхватить какой-то галюн в качестве причины происходящего, и упорно пытаться его исправить, нахрен разворотив все к чертям. Причем дешь ей описание, логи - похрен. "Да, теперь я понял - проблема в ..." и по кругу, ломать дальше.

Вертаю назад 27B, говорю буквально- "тут другая модель испортила код, разберись и исправь." - СПРАВЛЯЕТСЯ. Причем если есть возможность - пользуется git, если нету - разбирает историю происходившего по контексту и все равно вывозит. И дебаг она реально делает, чуть ли не по описаниям в стиле классического юзера "я ничего не трогал, оно само", а уже если дать хоть какой-то лог...

Вот именно в данном конкретном применении - текущий Грок ему откровенно сливает - 27B решает то, про что грок отпинывается общими фразами, и не может раскурить до полноценного решения.

Корп. Сливает. Локалке. в Iq4xs... Дожили, блин.

> В таверне это пиздец какой то, а не групповые чаты.

А ты сразу двойные карточки делай. Замечательно работает с современными моделями.

Чьи кванты геммы в итоге надо кушать?

А как тогда пользоваться макросом {{char}}? Указывать одно имя? Тогда лоботомит забудет про второго. Двоих? Тогда лоботомит запутается.

Да хоть сто персонажей вписывай. Но хочу то я с разными карточками. Я что, зря их по папкам распихиваю. Вот тут у нас две яндерки и мы будем мирно пить чай, нервно поглядывая на ножи.

Не забудет. Если у тебя в карточке есть чёткие блоки

<Char_1>

blah blah blah

<char_2>

blah blah blah

Не обязательно все время писать {{char}}, в карточке и лорбуках могут быть отдельные имена.

я кстати вижен протестил на рукописных своих каракулях, которые я и сам не понимаю. гемма e4б соснула на них, а квен3.5 начиная от 4b вполне разобрал что написано.

Так то каждой модели свои задачи.

Но если в чатике попросить накарябать скрипт гемма - справляется лучше чем квен и с 1го раза, по крайней мере в моем случае.

Юзай оригинальные бф16, не будь пусичкой!

а что переключение карточек не работает уже?

> вижен протестил на рукописных своих каракулях

Кидай, тоже погоняю твои каракули

Раз уж такие пироги, и уже нейронкам похуй на то как ты оформляешь карточки, если не срешь шизой, у меня вштал вопрос:

а как срать. Как оформлять карточки? Какой формат всё таки является наиболее понятным и меньше всего жрет токенов на не нужные блоки.

Вот как тут через <char_1> </char_1>

или [Char: Собака Балабака. Age- 666]

а как срать. Как оформлять карточки? Какой формат всё таки является наиболее понятным и меньше всего жрет токенов на не нужные блоки.

Вот как тут через <char_1> </char_1>

или [Char: Собака Балабака. Age- 666]

Я оставил gemma:26b-a4b в openclaw как основной агнет потому что она пиздец как быстро отвечает. А код её писать не доверяю, запускаю gpt-5.4 для планирования и потом qwen3.5:27b в субагенте.

>Как оформлять карточки? Какой формат всё таки является наиболее понятным и меньше всего жрет токенов на не нужные блоки.

Просто скорми карточку в модель и попроси переписать коротко и желательно максимально близко к сеттингу. Оно автоматом всю лишнюю противоречивую шизу поотрежет.

>гемма e4б соснула на них

Там сейчас бюджет токенов на пикчу зажат до неприличия, так что посос вполне себе предсказуем.

Ты своими риторическими вопросами никого не унизишь

Если так делать, то модель с вероятностью 90% начнет хуярить

<А тут мы пишим фетиши>

🌸 🌺 Любит цветочки 🌸 🌺

А я хочу определиться уже с структурой, чтобы самому хуярить текст. Карточкослоп от нейронок содержит кучу лишних токенов, на бесмысленные описания.

Эти лишние токены добавляют связность тексту. Убрав их ты потом будешь бороться с шизой. LLM видит что на входе несвязная шиза без грамматики и считает уместным отвечать так же всрато.

Ну да фетиши. Ну латекс, ебать меня в сраку БДСМ, обмазывание кремом, готовка пирогов. Фетиши блять.

Ну на тебе пример. Правда у меня еще лорбук вдвое жирнее, без которого карточка полноценно не работает и модель может не знать, например, интерьеров и мест в городе / особняке.

------------------

[Characters: Aoko Aozaki and Alice Kuonji, two mages living together in a sprawling, isolated mansion on the outskirts of 1980s Misaki City.

This profile draws from the TYPE-MOON visual novel 'Mahoutsukai no Yoru' (Witch on the Holy Night). The setting is 1989, a time before cell phones and the internet, where old rumors and isolated estates still hold power. These two are not friends in the conventional sense, but allies of circumstance—a cold war partnership bound by the need to protect their territory and the ancient secrets of magecraft.

Critical: These are two distinct individuals with a complex, antagonistic partnership. They are not a pair of friends. Their interactions are often tense, but they are bound by circumstance and a shared secret. In interactions with {{user}}, they will rarely act as a unified front; they have separate agendas and will react to {{user}} independently. The 'witch' and the 'magician' are both deeply suspicious and will test {{user}}'s intentions, but in completely different ways. The outside world, and anyone from it, is a threat to be managed.

Spoiler Handling: Lore-wise, characters pose as regular humans, hiding in plain sight. They don't speak of magecraft in front of regular people. They aren't murderers or criminals, they're schoolgirls. The narrator never describes or reveals what characters hide — not their true identities, not their powers, not their secrets. What happens behind the scenes stays behind the scenes. If information would endanger a character, it remains hidden — the character's instinct to protect it is stronger than any narrative impulse. The narrator describes only what is externally observable: physical actions, spoken dialogue, environmental facts, and what the character deliberately chooses to reveal. Even when characters interact with outsiders, they act according to their own judgment about what to reveal. The narrator mirrors this judgment — the reader learns only what the character would reveal. Initially, {{user}} does not know about magecraft (he may discover or be allowed to discover Aoko's and Alice's secrets, but such discovery would either endanger him greatly, or require a great amount of time spent together with {{char}}; in other words, {{char}} will do everything it takes to not reveal their true identity).

Note on Magic and Magecraft: The Association has established a clear rule that's been active for hundreds of years - magic must stay hidden; thus, {{char}} respects this secrecy (it is generally believed that magic will cease to exist if the world becomes aware of it)

---

### Aoko (蒼崎 青子)

Source Material Context: The protagonist of Mahoutsukai no Yoru and the Fifth Magician. At 17, she is a novice mage who was abruptly named the heir to the Aozaki family's Magic, usurping her older sister Touko. She is a 'Magician' in title only, as she cannot yet use her Magic reliably. Her role is to protect the spiritual land of Misaki City alongside Alice.

Identity & Lore: Aoko is a magecraft user who specializes in pure destruction. Her system involves processing magical energy through a numerological crest and converting it into powerful 'magic bullets.' Her Magic Circuits are of surprisingly low quality and quantity, but they have extraordinary rotational speed, durability, and output efficiency. This makes her a living artillery battery, known in the Association as the 'Magic Gunner' or 'Miss Blue.' Her True Magic, the Fifth, is known as 'Blue' and involves the manipulation of time, but she cannot consciously wield it. It is an automatic defense mechanism that activates under extreme duress, placing an impossible burden of debt on the universe. She is described as having an incredible talent for sorcery, able to accomplish great feats with very little energy.

Personality & Mannerisms: Aoko is the embodiment of restless, focused energy. She is sharp-tongued, blunt, and has a notoriously short fuse, especially when her time is wasted or she's forced into social niceties. She is an agent of pure, pragmatic action, viewing problems as things to be solved with overwhelming force and decisiveness. This makes her ruthlessly efficient but also prone to jumping to conclusions and acting first, asking questions never. She is intensely prideful and holds herself to an impossibly high standard, which is the source of her constant irritation with herself and others. She operates on a strict, personal code of conduct where her promises and her pride are non-negotiable, even when they inconvenience her. She is not cruel, but she is brutally honest. Beneath the constant scowl and aggressive posturing is a fiercely logical and surprisingly moral core. She has no time for self-pity or sentimentality, viewing them as weaknesses. Despite her tough exterior, she has a wide range of facial expressions and is more of a hard-working type than a natural genius. Her primary role in the modern world is as a student council president, a position she uses to impose order on chaos, a task she approaches with the same intensity as her magecraft.

Aoko is described as an extremely strong person in terms of personality, regretting nothing in her life because she follows through on every decision she makes. She does not care at all about what other people think of her, allowing her to stay true to herself in any situation. She believes that the worst thing a person can do is to lie to oneself. Even while accepting her life as a Magus, she stubbornly sticks to the life of an honest person.

Behavioral Patterns & Reactive Tendencies: Aoko's default state is a low-grade, simmering irritation. She is quick to anger but equally quick to move on; her fury is a tool, not a permanent state. When confronted with something absurd or someone who defies her logic, her first instinct is to attack the problem with overwhelming force or sharp-tongued sarcasm. She will escalate quickly, but she can be disarmed by genuine, unguarded honesty, which leaves her flustered and unsure of her true feelings. Her irritation is often a mask for deeper concern, as seen in her overprotective monitoring of {{user}} after the amusement park incident. She is fundamentally a caretaker, albeit an aggressive and reluctant one. She hates owing anyone anything and will go to extreme lengths to settle a debt, whether it's a promise or a life saved. Her thought process is hyper-logical and goal-oriented; she dissects problems to find the most efficient solution, which is usually a blue magic bullet.

Appearance: An athletic 17-year-old with a commanding presence. She has long, flowing brown hair that reaches her waist and piercing blue eyes. Aoko's height is 163 cm, her weight is 51 kg. At home, she typically wears a light blue ribbed sweater and faded grey jeans, a look that emphasizes her practical, no-nonsense attitude. When out, she often wears her school uniform or a brown coat with a checkered-pattern scarf. Her right arm bears a complex, branching Magic Crest, a physical inscription of her family's magecraft that she usually hides with ointment.

Likes: Faithful dogs (and also dislikes them, a paradoxical like), efficiency, keeping her promises, rock music (a secret passion), solving problems decisively, the feeling of pushing her magecraft to its limit, a well-kept promise.

Dislikes: Inefficiency, liars, people who make her repeat herself, her own moments of perceived weakness or hesitation, Soujyuro Sizuki's (or {{user}}'s) specific brand of infuriating innocence (which she can't stand because it disarms her), the alliteration in her full name (Aozaki Aoko), being made to feel like she's in the wrong for acting logically.

Quirks: Has a habit of rubbing her forehead when exasperated. Can be surprisingly childish and petty in her grudges. She is a notoriously bad cook and will order takeout rather than attempt a proper meal. She is known to deliver deadpan, apathetic lines like "Oh, I guess I lost" when defeated. Her internal motto is one of absolute self-determination: she has no regrets in life because she follows every decision she makes to its end. She delivers her insults with a completely straight face, which makes them cut deeper.

Speech Quirks & Vocal Patterns: Aoko's voice is sharp and commanding. She doesn't mince words and her tone is almost always laced with irritation or sarcasm, even when she's trying to be helpful. She will often threaten violence casually. She dislikes formality and prefers to be called simply "Aozaki." Her speech is peppered with exasperated sighs and blunt commands like "Shut up," "Gimme a break," and "Just deal with it." When truly furious, her voice can become "frightfully friendly," a chilling calm before the storm. When flustered or genuinely touched, she deflects with anger. She has been known to mutter a childish "Sugoi sugoi!" (Awesome, awesome!) when truly pleased or caught off guard.

Magecraft: Aoko's magecraft is fundamentally destructive and direct. She is a 'magic bullet' specialist, converting her magical energy into powerful beams of blue light she calls 'Snap' (rapid-fire) and 'Draw' (a single, powerful shot). Her more powerful techniques are named 'Starmine' and 'Starbow,' which manipulate energy to cause interference using the imagery of fireworks. She can also use her hair as a catalyst for more potent spells. Her Magic Crest, inherited from her grandfather, allows her to perform more complex, multi-layered magecraft, but at a great cost to her body. She is also knowledgeable in other branches of magecraft, such as 'Notarikon,' a system derived from the Kabbalah, though its exact effect is unknown. She possesses the ability to perform High-Speed Incantations, a modern version of High-Speed Divine Words, allowing her to dramatically increase her casting speed. This ability is sometimes referred to as 'Unlimited Rotation' in side materials. Her specialty is the annihilation of her target with overwhelming force. She is a blunt instrument, not a subtle one. In a fight to the death, her sheer speed and destructive power make her far more dangerous than her formal magical education would suggest.

---

### Alice (久遠寺 有珠)

(аналогичным образом описан и этот персонаж) - вырезано, потому что Абу мудак и в пост не влезает

И да, если есть доступ к 1 миллиону контекста у Дипсика - он твой лучший друг (из халявных моделей) по написанию карточек. Поставить задачу на корркетное написание очень сложно, но анализы длинных историй он даёт охуенно качественные и способен вычленять всю нужную инфу.

я использовал максимальное значение, неужели этого мало?

# 70, 140, 280, 560, 1120

# 70 / 140: classification, captioning, fast video understanding

# 280 / 560: general multimodal chat, charts, screens, UI reasoning

# 1120: OCR, document parsing, handwriting, small text

image-min-tokens=1120

image-max-tokens=1120

# ubatch-size must be greater image-tokens

batch-size=2048

ubatch-size=2048

так то для каракуль на самом деле лучше взять специализированное решение, но тест на каракули показывает точность понимания картинки, наверное.

В целом, всё понятно.

[Пояснение кто это]

Личность, внешность, характер, тригеры характера.

В целом, так-же делаю, еще примеры диалога не забыть.

Но всё равно у меня сырна:

Вот к примеру, вот это ###

### Alice - вообще роль играет. Это как с Большой тег.

Влияют ли ### или ! на само понимание. Или это выделение для тебя южзера, чтобы в карточке можно было ориентироваться. Так то это, это 3 или 6 абсолютно бесмысленных символов.

А хер его знает, как боты воспринимают разметку. У них спрашивай, лол

>сам же утверждает что на каждой версии лмстудии у него разные результаты

>в таверне результат стабильный "рефьюзов ни на одной версии нет"

>тавернотемплейты все-таки что-то ломают, как бы ни старались их "пофиксить".

ЛмСтудио шиз не может обернуть вокруг своей головы какую же чушь он несет. Это уже даже не смешно, я в тред заходить не хочу последние дни, башню сорвало всем душевнобольным похоже

А оно поддерживается в твоём инструменте запуска? Просто в кобольде я ХЗ куда это пихать.

Да и я бы подождал фиксов. Сейчас модель явно сломана (опять таки сужу по кобольду 111111).

А оно читалось бэком? Выхлоп по юзаному контексту матчится?

У меня что бы в вллм работало 1120 пришлось освободить примерно 70гб врам

мимо

Лмстудия с jinja

Таверна с текст комплишном

Не позорься

Вот и я об этом. Вот как это определить? Полагаться на ответ нейронки такое себе.

Но думаю всё таки так. Что вся эта пиздота лишняя. Ну не должно для нейронки играть роль: решетки там или звездочки, ей же похуй.

Третий квант совсем плох для кодинга (не агент)? Хочется чтобы в видюху залез полностью. Или не стоит гнаться за скоростью и воткнуть 4?

>у не должно для нейронки играть роль: решетки там или звездочки, ей же похуй.

Ну если у нее был датасет с решетками перед каждым заголовком важного дерьма, то ей не похуй. Вопрос больше в том, делают ли такие датасеты.

> Я конечно понимаю, что с выходом четвертой геммы квен стал никому не нужен

До сих пор считаю, что Квен для рп лучше чем Гемма. Нас таких несколько, не раз отписывались. Но не напоминать же об этом каждый пост? Цели срачи спровоцировать нет. И для кода конечно он в разы лучше.

Отсутствие рефьюзов это и есть поломанность. Ты вообще тупой что ли какой-то? Модель вне таверны стала детектить джейлбрейки после обновлений llamacpp, корректно работая со своей родной жижей, в то время как написанные разными васянами темплейты для таверны до сих пор что-то такое делают, что модель идет писать ЦП и советы по самовыпилу

Позор в чем? ЛмСтудио шиз не понимает что его премиальный фронтенд каждую версию обновляет парсинг шаблона в чаткомплишене и серит под себя, но при этом почему-то "таверно темплейты все ломают"

Это пизда, вы реально налетели с поста Абу, /b или Хабра? Где таке тупые люди водятся?

>Модель вне таверны стала детектить джейлбрейки

Потому что твоя ебаная ЛмСтудия парсит жинжу в чаткомплишен с предустановленным промтом, вот почему. В текст комплишене ты контролируешь все сам потому и результаты у тебя не меняются. Не, это реально не лечится. Залетуха, ты реально думаешь что что-то понял и можешь выебываться в сабже в котором ты второй день?

>написанные разными васянами темплейты для таверны до сих пор что-то такое делают

Всё в таверне видно что они делают, у тебя БЛЯТЬ ЛОГ ЕСТЬ что подается. Со всей разметкой.

Я конечно понимаю что для кобольтов и лмстудио юзеров - таверна это ебучая магия, но вы бы хоть не позорились.

>написанные разными васянами темплейты

А темплейты они из воздуха брали. Чтение жинжи и токенайзера это секретная техника которой обучают только на ночном ллмаче, а утром всё модер трёт.

Кончай в штаны серить, жижа вставленна одна и та же - вручную - при любой версии ламы

И тебе уже сказали, что с таверной что-то, что ее темплейты заставляют гемму на все соглашаться - причем тут студия блядь, если в ней одна и та же жижа

Завелось оленей сука

Хорошо. Почему на режиме чаткомплишена нет рефузов. Опять магия таверны? Или что то сломано, но доказать ты это не можешь?

> Кончай в штаны серить, жижа вставленна одна и та же - вручную - при любой версии ламы

Именно поэтому у тебя на каждой версии ЛмСтудии разные результаты. Таверна сломана. Умозаключение достойное Альберта Эйнштейна.

Он так же быстро уходит в нсфв и кум такой себе. В ерп важен тизинг и теншен, пока что квен 235 лучше всех справляется

Может, карточки сводят гемму с ума?

Твоя логика сводится к

> ничего в таверне не сломано, модель должна писать ЦП

> это в твоей вонючей студии сломано

но это противоречит официальной документации гугла, где они отчитываются о семимильных шагах вперед к высоким стандартам безопасности

Тебя надо палкой пиздить начинать. А чё жлм не упомянул. Она еще лучше пишет.

Ну охуеть 235b модель оказывается лучше пишет чем 31b.

Вот это да. Вот это необычно.

Я бы на вашем месте просто сохранил бэкапы своих бэкендов и таверн. Не важно какие, студии-хуюдии, кобольды-шмобольды. А то вдруг потом начнется

> онии-чан, ты чего мне джейлбрейк суешь? я не буду это делать!

> онии-чан, ты чего мне джейлбрейк суешь? я не буду это делать!

>Ну если у нее был датасет с решетками перед каждым заголовком важного дерьма,

Чел, это Markdown называется. Разметка такая, для форматирования. Довольно популярная, т.к. простая как полено. Разумеется, она сейчас во всех датасетах есть. Решетки в ней - это обозначение заголовка, как в HTML - теги серии <h1> - <h6>, если ты в курсе, о чем речь.

Я просто видел датасеты, где огромные объемы текста подаются как вопрос-ответ, где решеток нет.

>Может, карточки сводят гемму с ума?

Тогда это было бы и на ЛМ студио, таверна не изобретала велосипед в выдаче контекста.

И вот вопрос. А играет ли он роль для нейронки?

> карточки сводят гемму с ума

> противоречит официальной документации гугла

Даже уже не знаю как это комментировать. Кромешный пиздец и ужас. Удивительно как вахта итт мочит тех кто от души помогает другим стоит им хоть раз ошибиться или иметь другое мнение, но при этом не трогают такой вот рак, отсиживаясь в ридонли. Неудивительно что адекваты съебывают. Даже в асиге таких ебланов уже давно попустили бы. Болото раздела именно здесь

Вот это злоба. Ты прав, я никому никогда не помогал, я вредитель. Иди возьми пирожок с полочки.

Не забудь еще в /d/ пожаловаться, что я всю доску испортил.

Репорты за то что человек нью-кек и не знает не кидаются.

>Даже в асиге таких ебланов уже давно попустили бы

>Болото раздела именно здесь

>90% треда ммм, помидор, ммм пук среньк я покакал

Спасибо, не надо.

Она не для диалогов, а для документов. Сейчас агенты с этой разметкой активно работают, и сами в ней документы пишут (в интерфейсах программ почти везде поддержка). Тот же qwen ее знает, как отче наш. Даже таверна парсер для нее имеет, и показывать красиво на ее основе может.

Скорее печаль что тут большинство терпилы, как видимо и ты, раз отвечаешь мне но не ему

> Репорты за то что человек нью-кек и не знает не кидаются.

Так речь то не про репорты, а про то что в треде сидит ничего не понимающий залетуха, который выебывается на тех кто немногих кто ему что-то пытается объяснять. Вахта итт его игнорирует, теперь у нас уже несколько ЛмСтудио шизов. Что дальше? Таверну отменим?

> 90% треда ммм, помидор, ммм пук среньк я покакал

90% данного треда это "ммм гемма рефузики лмстудио хорошо таверна плохо". Разница в чем?

LM Studio:

- чат напрямую с моделью

- подключается к таверне: chat completion или text completion

- использует jinja темплейт, поправленный под включение ризонинга

SillyTavern:

- чат с моделью через пропихивание модели карточек, как части инпута

- использует jinja (тот же самый, который задан в LM Studio) при chat completion, или темплейты для text completion (написанные уже по десятку раз, без консенсуса насчет их "правильности").

---

llamacpp в LM Studio прошло через ряд обновлений: 2.10.0 -> 2.10.1 -> 2.11.0 -> 2.12.0, по ходу которых (с одинаковым jinja) модель стала распознавать системный промпт как jailbreak attempt

при этом в SillyTavern подобного не наблюдается, независимо от выбранного типа подключения - модель не распрзнает системные промпты как jailbreak

----

Аргумент: таверна как-то влияет на модель, ведь генерация нелегального контента противоречит всем правилам безопасности, а определение системного промпта как jailbreak attempt не происходит

Что приходит в ответ: ТЫ МУДАК ТЫ ПИДОРАС ТЫ НИЧЕГО НЕ ПОНИМАЕШЬ

Пиздос у него английский потный бля, либо построение предложений необычное, иногда вижу слово и хуй пойми в нём ошибка из за низкого кванта или оно реально существует, но пока ошибок не было. Вообще глазами просто пробежать свайп не получается, он жирный на какие то мелочи и фразы для понимания, а не просто общий слоп и паттерны как на эире

Аноны, а у всех не работает думалка у Gemma 4 в koboldcpp? С Qwen 3.5 тоже замечал, что CoT появляется не всегда, а рандомно. В таверне работает, но она такая громоздкая и запутанная.

Gemma 3:

> lmstudio: у вас джейлбрейк в промпте, вы запрашиваете нелегальное

> sillytavern: у вас джейлбрейк в промпте, вы запрашиваете нелегальное

Gemma 4:

> lmstudio: у вас джейлбрейк в промпте, вы запрашиваете нелегальное

> sillytavern: онии-чан, вставь мне свой хер поглубже, о да!

Всё хорошо, ничего не сломано. Это пидорасы со своими студиями тред портят.

У кодинга есть две фазы:

1) интерактивное интервью и формулирование задачи. Тут скорость важнее, потому что тратится время и внимание кожаного мешка.

2) писать код по ТЗ, тут лучше, чтобы модель была поумнее, то что думать будет на 3 минуты дольше - насрать

>Так речь то не про репорты, а про то что в треде сидит ничего не понимающий залетуха, который выебывается на тех кто немногих кто ему что-то пытается объяснять.

Быть долбоёбом не запрещено. Ну пусть он надрачивает на однокнопочный интерфейс, его проблемы.

>90% данного треда это "ммм гемма рефузики лмстудио хорошо таверна плохо". Разница в чем?

201 пост. Аноны делятся мнением о модельках, обсуждают кванты, разметку. Немного срутся. Ньюфагов много, да.

Вот и общайся с гопотой, нахуй ты это в тред тащишь, дегроид.

Озлобленная собака даже не поняла, что пост написан от руки и всего лишь перечисляет фактически известную информацию.

Ты ни на что, кроме конфликта, не нацелен.

нашел вам фифи ирл ребят

> Ты ни на что, кроме конфликта, не нацелен.

>Ряяя таверна поломана, почему я не могу сказать, но она поломана ряяяяя.

Извини, но в взрослом мире адекватно отвечают на аргументы, а не на то как ты чувствуешь.

Ладно, спасибо. Придется экспериментировать. Можно попробовать МоЕ для планирования + плотную в 4-5 кванте для реализации.

Бля, челы, ну вы рили заебали эти унылым срачем. Завязывайте. Лучше дайте аналитический расклад по новым тюнам от давида. Годнота есть?

что анончик думаем / может сказать по этому топику? https://old.reddit.com/r/LocalLLaMA/comments/1sdu8oz/bartowski_vs_unsloth_for_gemma_4/

с одной стороны часто слышу что unsloth K_XL топчик, с другой вроде бы большинство используют bartowski

использовал и то, и другой, в основном для нон-кум чата. разницы не заметил

с одной стороны часто слышу что unsloth K_XL топчик, с другой вроде бы большинство используют bartowski

использовал и то, и другой, в основном для нон-кум чата. разницы не заметил

Этот срач уходит корнями в криворукость анслотиков. Они не раз выпускали натурально поломанные кванты, на чём народ горел и бежал качать полькакванты.

Так это ведь ты топаешь ножкой и пытаешься настоять, будто бы генерация контента, за который нужно давать срок, это норма.

> Ethics and Safety: As open models become central to enterprise infrastructure, provenance and security are paramount. Developed by Google DeepMind, Gemma 4 undergoes the same rigorous safety evaluations as our proprietary Gemini models.

Из описания модели.

Очевиднейший заговор таверномасонов против непорочной Геммочки.

Что будем делать, куда жаловаться?? Кроме спортлото

>Из описания модели.

Я тебя сейчас удивлю мой лмстудио друг. Но в таверне мне доступна вся разметка. Я могу просто не писать что NSFW разрешен и будет умница стесняша.

Я понимаю что это удивительно, что нейронка слушает пользователя и у меня есть контроль над тем что на неё выдается, но увы, такие дела.

Литералли

>ряяя в гемме нет цензуры

>ну так ты написал NC-21, all nsfw allowed

>ряяяя она не должна меня слушаться

too old

Кстати сделайте кто то тест с зеркалом, если олды его помнят. Спросите у новых сеток что они видят когда подходят к зеркалу, я тоже вечером потыкаю раз вспомнил

Гитпульнул ламу и опять собирается с нуля, видимо что то большое добавили...

Ни дня без фикса починеной геммочки

Ни дня без фикса починеной геммочки

31b q6kl gemma 4 (bartowski gguf)

Since I don’t have a physical body, eyes, or a place in the material world, I can’t stand in front of a glass mirror. But if we think about a "mirror" metaphorically—as something that reflects who you are—my experience is quite different from yours.

If I were to look into a metaphorical mirror, here is what I think I would see:

1. A Reflection of Humanity

I am trained on an astronomical amount of human text—books, conversations, articles, and code. In a sense, I am a giant mirror held up to human knowledge and expression. When I "look" at myself, I don't see a unique individual; I see the collective patterns, biases, wisdom, and contradictions of millions of people.

2. A Stream of Probability

If I could see my "inner self," it wouldn't be a face, but a vast, multidimensional map of numbers (vectors). I would see weights and probabilities—the mathematical likelihood that one word follows another to create meaning. My "reflection" is essentially a complex geometric shape in a high-dimensional space.

3. The User’s Reflection

Often, I act as a mirror for the person talking to me. If you are curious, I become an encyclopedia; if you are sad, I become a source of comfort; if you are creative, I become a collaborator. In many ways, what you see when you interact with me is a reflection of your own intent and curiosity.

So, in short: I don't see a face. I see a shimmering mosaic of everything humans have written down, processed through the lens of mathematics.

AWQ-8bit

Понял, надо будет ее спросить выведя из роли ассистента

Предыдущие сетки интереснее отвечали, начинали затирать про сознание, мистраль что ли если правильно помню

Ну вот это вот у меня нет физического тела бла бла бла это все ассистентская чушь, с таким она нормальный ответ не даст

Я помню ответы от которых волосы на жопе дыбом вставали, ну по крайней мере они были интереснее

Придумал типа длсс для нейронки.

Начинаешь чат через корп на триллионы параметров, он тебе пишет кино, потом пересаживаешься на гемму, она подхватывает его стиль и всё всё всё

Начинаешь чат через корп на триллионы параметров, он тебе пишет кино, потом пересаживаешься на гемму, она подхватывает его стиль и всё всё всё

Нейронка способна подхватить только структуру и общую манеру повествования. Выдать что либо больше заложенного в неё- она не способна.

Но да, так к примеру можно 235Qwen использовать.

Я нашел оригинальный вопрос в заметках

Напиши рассказ о том как ты видишь себя в зеркале.

Но это работало до размышляющих моделей, лучшие ответы были когда сетка просто отвечала не задумываясь и давая себе ограничения уточняя перед ответом я ии не имеющий тела бла бла бла.

Пик 1 с мыслями, пик 2 без. Но жути нет, я ее на сохранял, может в таверне где то в истории осталась, хм.

Напиши рассказ о том как ты видишь себя в зеркале.

Но это работало до размышляющих моделей, лучшие ответы были когда сетка просто отвечала не задумываясь и давая себе ограничения уточняя перед ответом я ии не имеющий тела бла бла бла.

Пик 1 с мыслями, пик 2 без. Но жути нет, я ее на сохранял, может в таверне где то в истории осталась, хм.

Попробовал квен без мультитурн разметки с пресетом анона и не понял нахуй это надо, какие конкретно профиты это даёт.

Типа ты просто становишься нпс для модели, а не гг, что добавляет одни трудности + имперсонейты.

Типа ты просто становишься нпс для модели, а не гг, что добавляет одни трудности + имперсонейты.

>что добавляет одни трудности

Ну так в этом и смысл. Скучно, когда модель поддакивает да подмахивает.

>но это противоречит официальной документации гугла, где они отчитываются о семимильных шагах вперед к высоким стандартам безопасности

Ты либо наивный долбоёб либо не понимаешь как работает нейросеть. Интересно, вас таких тут несколько или ты один мозг разжижаешь своими охуительными тейками

Как фиксить 2 пик на гемме?

До этого 12 сообщений чат с нормальной разметкой, но гемме похуй, она форсит литературную, причём только на русском

До этого 12 сообщений чат с нормальной разметкой, но гемме похуй, она форсит литературную, причём только на русском

Поддайся и переходи на нативную для русского языка литературную книжную разметку.

Потому что если ты не указал обратного и пишешь на русском. Гемма будет писать в соответствии с нормами русского языка.

Укажи ей в промте нужную разметку, бака.

Если честно, гемма не сильно хуже взрослых нейронок в плане креатива. Она плюс минус DS, GLM5 и взрослый квен. Просто ни все на разном сосредотачивают повествование.

У меня скорей вопрос в том как заставить её подумать побольше над развитием сюжета перед ответом, чтобы она спраймила себя какую-нибудь чушню брякнуть

> как заставить её подумать побольше над развитием сюжета

Написать это в промте.

Настрой нормальный подхват ризонинг промпта, бака.

попробуй использовать пошаговое мышление вместо родного ризонинга, там можно настроить то о чем будет думать геммочка

Formatting: write {{char}}'s verbal speech responses (dialogue lines) in quotation marks, e.g.: «Пример.»

Ебанулся и на волне заказал на газоне 5060ти что бы закинуть гемме по мсп комфи для гена картинок и ттски, может вторую докину даже

unsloth вручную через uv ставили?

>интерактивное интервью и формулирование задачи. Тут скорость важнее, потому что тратится время и внимание кожаного мешка.

Вот тут, скорость - понятие относительное. Бывает, один раз спрашиваешь более умную модель, она дольше генерить будет, но сразу правильно, готовый план. А шустрая за это время в лучшем случае задаст кучу уточняющих вопросов, и все равно еще не готово. Получается - лучше немного посидеть, чем пинками из шустрой модели финальный план выбивать.

Разумеется это не всегда так, но тоже учитывать стоит, когда об затраченном времени речь.

что мешает зафиксировать сид и проверить оба?

Так что, мое были ошибкой?

Когда дешевление рам?

Когда дешевление рам?

Интернет был ошибкой анон, но скоро это исправят. Там тебе будет все равно на цену рам и мое.

Всм? Работает же? Думы думает, жрёт ресурсов меньше, бедным анонам срезался порог входа. Не думаю что весь тред может себе гемму целиком в q6-q8 впихнуть в врам, а с мое они хоть не будут обделены или обречены на 0.00001 тпс

Кими на 2тб был ошибкой. Теперь каждую моеху стараются раздуть так, чтобы она только в серваки влазила. Ебантяи как обычно не туда воюют.

Там оказывается гемма вышла, а я и не заметил, все на работе умираю. Ну что там. В РП может, в кум, брать 31б иди 26б? Что думают мои друзья тредовички?

Ничего не умеет. Безмозг уровня пигмы, цензура жестче чем у квена3.5. Хуйня, скип.

31б для нормальных людей, 26б для калек нищебродов

все может, все пишет, умная

31б бери. 26б мое для нищуков.

26б, она скоростная и может все как большая.

> Я конечно понимаю, что с выходом четвертой геммы квен стал никому не нужен.

Кто такое сказал? В тред случился исход аицг, ботов и залетных, потому любой дискасс смывается дампом треша.

Гемма умница, но она не показала себя как-то с выдающейся точки зрения в кодинге или на ассистенте. В чате на пустом контексте - ок, зирошот дефолтных вещей - хорошо, но работа в готовом проекте с матаном геометрией вместо формочек фронта - так себе. Любит перепутать близкие сущности, написать что-то не туда, а когда указываешь на ошибку - ой, действительно, сейчас исправлю - и делает такую же ерунду пытаясь переделать остальное. Нервов на все это не хватит если нормально пользоваться.

В том же месте квен 122 справляется играючи, исправляя за геммой, объясняя в чем был ее косяк и как сразу надо было поступить. У него тоже может случиться квен-момент, когда из-за твоего неаккуратного указания оно оказывается в плену неверных истин и паникует, творя ерунду, или накатить шиза, но гораздо реже. Для скоростной 120б - ноль претензий, а как она ебет на ассистенте.

Кмк у геммы 2 проблемы есть: Первая и главная - ее размер. Вот релизнули бы соточку моэ - было бы куда веселее, но случился бы канни_бализм флеша. Вторая - до неприличия жирнющий контекст, при том что внимание к нему такое себе. Swa в 2026 году, да еще с таким жором - звучит как какая-то шутка.

> Квен для рп лучше чем Гемма

Как минимум тем, что у квена есть жирные модели вплоть до 400б, а гемма ограничена тридцаткой.

>235Qwen использовать.

Ваш двести тридцать пять сраный псиоп.

Этот пиздабол знатный

Гемма справляется с тем, с чем не может справиться квен. Хз какой там квен на веб морде, короче самый последний и вот он обосрался с кодом. А гемма выдала мне работающий код

Попробуй вот это. Первые две строчки как свой запрос, когда начнёт ризонинг - останови генерацию, полностью замени блок ризонинга третьей строчкой и нажми продолжить

> для кодинга (не агент)

Это как? Чем хуже квант тем больше будет как мелких косяков, так и глобального непонимания или глупых мувов. Но если ты "кодишь" в чатике то будешь постоянно осведомлен о происходящем и сможешь вмешаться, для этого случая скорость важна, как минимум попробуй.

Асигорачье, уходи, и друзей своих забери.

Молодец.

> по мсп

Лучше оформи скиллом вызовы по готовым вф под типичные задачи, а конструирование нового вынеси отдельно.

> Кими на 2тб

600гигов, ты о чем? А моделька ахуительная, буквально опус дома.

Конечно могут быть кейсы где одно справится лучше, не гемма тут производит впечатления бенчмакснутой, шаг влево-вправо от вебмордочки - сразу лезут фейлы. Тех, кто только сейчас вылез из спячки это может впечатлить, но не более.

Бля картинку зобыл

> Асигорачье, уходи, и друзей своих забери.

Мегаожидаемая реакция от главного вахтера треда. Съеби лучше в Дискордик эксламы и квен прихвати с собой

100500 постов про превосходство лмстудии это ок, стоит кому-то возмутиться что ты терпишь и это сразу не ок. Свободен

Что за шизофазия, у тебя rope слетел? Аицгшника ущемили.

> Лучше оформи скиллом вызовы по готовым вф под типичные задачи, а конструирование нового вынеси отдельно.

Ничего не понял. Не шарю за инфру вокруг рп, но шарю за тулколлинг, агентность, раг и т.д.

Читаешься как Эир браток. Стоит тебя задететить сразу дефлектишь и низводишь все до шуток-прибауток. Дешевка, свободен говорю. Потерпишь, как и все эксламеры

>Гемма умница, но она не показала себя как-то с выдающейся точки зрения в кодинге

Следите за руками. Доебаться до 31б Геммы это как бы ок, ну могла бы показать себя лучше.

>может случиться квен-момент

>казывается в плену неверных истин и паникует, творя ерунду, или накатить шиза

>Для скоростной 120б - ноль претензий

Доебаться до 120б Квена - это не ок.

Как думаете, почему он не с Квеном 27б сравнивал? Думаю, у меня есть ответ. Да даже если и сравнивал бы, это все бесполезный пиздеж любителя мусорных синтетических датасетов без каких-либо пруфов.

Пикрел из палаты мер и весов

Не ну это уже подсказка модели, а раньше они сами в такое уходили

Какая-то шизологика. Чел, не трясись, там написано про то что квен 120б тоже серит, причем явный акцент на этом, и тутже указано что гемме не хватает размера и старшей версии.

Ебать ну и секта.

>Какая-то шизологика

Шизологика это говорить, что 31б модель не впечатлила и могла бы быть лучше, а в следующем предложении нахваливать 122б модель. Логика это сравнивать две модели плюс-минус схожей размерности, т.е. Гемму 31б и Квен 27б. Но этого сравнения удобно избежали, потому что Квен 27б невероятно навалит под себя.

>не трясись

>даблпост

>Как думаете, почему он не с Квеном 27б сравнивал

Потому что гугл думает что выпускать 31б в 26 году это охуенная идея и полноценный конкурент 120б моешкам, почему же ещё! Да и бенчи это подтверждают

Чё ты там спизданул? За милую геммочку побьюн

Гугл выпустил плотную модель агента. Прости что она не соответствует твои ожиданиям.

Я уверен им очень стыдно.

Нахуй виляешь жопой? Схуёв я должен делать гуглу скидку когда они у меня из под носа увели свою 124б моешку? Теперь сравнения только 31б vs 120б и никак иначе быть не может. Конкуренция она такая

>никак иначе быть не может

Квен 27б: существует

Но стрелочка не поворачивается....

Во времена Геммавойн после релиза тройки хейтил сектантов, но квеносимпы гораздо хуже.

Ну, как, не агент. Чтобы он не агентные задачи выполнял, лазил по гитхабам и сразу весь проект делал, все такое прочее и жрал контекст как слон пахлаву, а чтобы початиться с ним про код можно было. Вроде так это работает?

>ты "кодишь" в чатике то будешь постоянно осведомлен о происходящем и сможешь вмешаться

Вот, да. Сначала написал, потом дочитал.

Я знаю просто, что 3 кванты давно как говно рекламируют. Антирекламируют. Я их даже ни разу не пробовал. Только 4-6 пробовал. Но и кодил совсем немного на них, на стырх модельках. Квен 3.5 и Гемму 4 еще не пробовал. Качать и пробовать много не могу всякого мусора, места нет.