Объединение тредов AI Chatbot General и Локальные языковые модели OP !!%mod%!! 01/04/26 Срд 01:13:36 #2 №1568892

По результатам анализа тематик и пересечения аудитории принято решение об объединении тредов «AI Chatbot General» и «Локальные языковые модели» в единый тред «LLM General» начиная с сегодняшнего дня.

Причины:

1. Оба треда обсуждают одни и те же модели (GLM, DeepSeek и т.п.), разница лишь в способе доступа — это недостаточно основание для двух тредов

2. Значительное пересечение инструментария — SillyTavern используется в обоих тредах как основной фронтенд

3. Регулярные взаимные ссылки и перенаправления пользователей между тредами («тебе в асиг», «тебе в локалок-тред») подтверждают, что разделение искусственное и создаёт неудобства

4. Тред локальных моделей стабильно набирает меньше постов и медленнее уходит в бамплимит — поддержание отдельного треда нецелесообразно

5. Это не спонтанное решение — это продуманное, хорошее, а главное тщательное действие идущее на пользу обоим тредам

Формат нового треда:

- За основу берётся шапка и нумерация AICG как более активного и структурированного треда. Тред локальных моделей считается влитым в AICG

- Обсуждение лоботомитизаций, бэкендов (llama.cpp, koboldcpp, ExLlama) — в основном треде, без выделения в отдельный

- Вопросы по железу (видеокарты, VRAM, оперативка) допускаются, но просьба не превращать тред в /hw/. Для развёрнутых обсуждений конфигураций используйте тред компьютерного железа на соответствующей борде

- Для постов про локальный запуск рекомендуется добавлять в конец сообщения подпись [Локалка], чтобы другие пользователи могли их фильтровать при необходимости

Создание отдельных тредов по старым тематикам будет рассматриваться как дубликат и удаляться.

Просьба отнестись с пониманием. При наличии вопросов — жалобы в /d/.

Причины:

1. Оба треда обсуждают одни и те же модели (GLM, DeepSeek и т.п.), разница лишь в способе доступа — это недостаточно основание для двух тредов

2. Значительное пересечение инструментария — SillyTavern используется в обоих тредах как основной фронтенд

3. Регулярные взаимные ссылки и перенаправления пользователей между тредами («тебе в асиг», «тебе в локалок-тред») подтверждают, что разделение искусственное и создаёт неудобства

4. Тред локальных моделей стабильно набирает меньше постов и медленнее уходит в бамплимит — поддержание отдельного треда нецелесообразно

5. Это не спонтанное решение — это продуманное, хорошее, а главное тщательное действие идущее на пользу обоим тредам

Формат нового треда:

- За основу берётся шапка и нумерация AICG как более активного и структурированного треда. Тред локальных моделей считается влитым в AICG

- Обсуждение лоботомитизаций, бэкендов (llama.cpp, koboldcpp, ExLlama) — в основном треде, без выделения в отдельный

- Вопросы по железу (видеокарты, VRAM, оперативка) допускаются, но просьба не превращать тред в /hw/. Для развёрнутых обсуждений конфигураций используйте тред компьютерного железа на соответствующей борде

- Для постов про локальный запуск рекомендуется добавлять в конец сообщения подпись [Локалка], чтобы другие пользователи могли их фильтровать при необходимости

Создание отдельных тредов по старым тематикам будет рассматриваться как дубликат и удаляться.

Просьба отнестись с пониманием. При наличии вопросов — жалобы в /d/.

АХАХАХА НАКОНЕЦ-ТО УРААА

Ну и замечательно. Я теперь шиз аватарка.

Пойду звать друзей из ацыга. Будем промтиками делиться, модельки обсуждать. А не вот это вот всё обсуждение куда пердолить слои.

Пойду звать друзей из ацыга. Будем промтиками делиться, модельки обсуждать. А не вот это вот всё обсуждение куда пердолить слои.

>Я теперь шиз аватарка.

Да ты-то уже давно, утка.

Всмысле? Я против! В асиге же одни дауны сидят.

[Локалка]

Ну собсна что и требовалось доказать. Уже с полгода как было очевидно для всех тредовичков, но наконец-то официальный каминг-аут.

Ну и нормально, поднимем средний уровень интеллекта в итт треде.

в аисг люди будут поумнее чем здесь я уверен

При общении в достаточно умных коллективах - вообще не встречаю, если дело не касается изначально противоречивых вещей вроде политоты.

>Так это как-бы ты нитпсал, лол

Ты лоботомитованный? Я написал, что раньше в треде были. Я ничего не писал про настоящее время - я не знаю, может они в ридонли сидят, может тоже кобольдов ебут, может реально свалили. Ты сам нагаллюционировал какие-то выводы и вешаешь их на меня.

>Ну ты же за всех ответил

Так не понимают же, судя по ответам. Понимали бы - ответили.

>Чего ты ожидал?

Ответов по существу или не ответов вовсе.

>Это ты уже выдумываешь.

Ну-ну, конечно выдумываю. Каждый раз, когда смешивают с говном корпов и асиг

>Точно также никто не обязывает тебя писать сюда.

Блять, написать - это совершить усилие. Ты реально не видишь разницы между "не писать, если не знаешь" и "спросить вопрос"?

Фу в общем, какая же мерзость какая тут общаться, действительно не стоило ничего тут спрашивать. Отвечать не буду больше.

Учитывая что ты за столько тредов так и не научился ставить точки, вообще не сомневаюсь.

большебукве слова не давали.

Тред спиздили. Вот пощу с галкой ОПа.

Но точку всё таки поставил.

Да всё не хрюкай уже.

>Каждый раз, когда смешивают с говном корпов и асиг

Корпы - умнички, асигеры - нет.

>Блять, написать - это совершить усилие.

>Ты реально не видишь разницы между "не писать, если не знаешь" и "спросить вопрос"?

Нет, потому что и то и то это равноценное усилие ибо в обоих случаях ты пишешь буковы.

>Фу в общем, какая же мерзость какая тут общаться, действительно не стоило ничего тут спрашивать.

Ты не представляешь, как сильно мы будем по тебе скучать.

>не писать

>в обоих случаях ты пишешь

вот это шизы в треде

мимо

И что теперь будем делать?

Правильно, давно пора.

Скиньте жб на кими

Я тебя ебу!

Если ты видишь сообщение, тебе нужно приложить усилие чтобы на него не ответить.

>Я тебя ебу!

Утка nods.

Терпеть.

Внимание, раздача водопровод и ссылок на лоботомиты от братишкина начнется через 15 минут. Всем нуждающимся отписать в тред и прикрепить к сообщению свою разгадку.

Не нужны нам ваши водопровод, идите нахер

Blushes slightly

если ты видишь человека, то нужно приложить усилие, чтобы его не пиздануть

>Предыдущие треды тонут здесь:

>>>

>>>

Нелегитимный перекат. Репортим долбоеба.

Привет, ты че долбоеб?

>эти кривляния опа якобы он не модер

Бунт!!! Требую вернуть в тред анона66, пусть дальше скидывает предметы!!!

Ну вы поняли

Моча на хуесосе, закрывай тред асиги и кати их сюда.

Не можешь? Власти не хватает? Даже моча нелегитимная попалась?

Не можешь? Власти не хватает? Даже моча нелегитимная попалась?

Тред мочух угнал, алё. Даже ссылки проебал

Я сам так делал раз в 20 тредов первую сотню

ОП предыдущих 200 тредов

Жаль ОПа конечно. Мог катить и катить.

Ну конечно угнал, а то. Мы-то дурачки такие и не помним как полтреда снесло по чьей-то прихоти. Вот теперь пруфы.

> как полтреда снесло по чьей-то прихоти

Ладно бы один раз, так это по кд происходило. Помню как зобанили анона который написал хороший годный отзыв по РП с медгеммой. Бля, да как он посмел писать о локальной ЛЛМ в треде локальных ЛЛМ??

Интересно, если я перекачу асиг, что со мной случится?

>по чьей-то прихоти

Так я просто репортил говно. Ты тоже так можешь, вот кнопочка.

Помню срался с тобой тредов 40 назад. Живой значит, говно.

>Ты тоже так можешь

Спасибо, но нет, я как-нибудь обойдусь без доносов на то, что лично мне не нравится.

Либераха спок.

Кстати да. Знатно тогда охуел.

Да брось. Один день в честь первого апреля можно побыть ебаклаком.

Не исключено что мы срались и в предыдущем треде.

Странная претензия, хуй моржовый.

Чтоб тебя обезьяны сожрали, верблюд плешивый.

Да ты тут не отнекивайся, актер без оскара, мы все тебя уже вычислили!

Еще и срачи сам регулярно провоцирует

Только после того, как я из твоего очка достану кролика.

>мы все тебя уже вычислили!

По IP?

Почему в аисг интеллектуальнее обсуждения, чем здесь?

Так было есть и будет

Анта бака? Это же легко: 127.0.0.1

Попробовал 27B в Q4 (потому что нищук), на ебучей Серафине.

Это так всегда Thinking модели работают? THIS SHIT IS SO ASS

3k кубометров (со скоростью 3T/s) на один Thinking, c

Analyze the Request

Determine Reaction

Drafting the Response

Refining the Details

Final Polish

Draft

Critique

Revised Draft

Let's make it more atmospheric

Wait, checking previous context

Decision

Finalizing the text

Wait, one detail check

Revised

Final Plan

Let's write it

Final Review against constraints

One small tweak

Refining

Wait, checking the previous turn

One more check on Seraphina's personality tags

Final Polish

Wait,

Wait,

Checking the most recent turn

Okay, ready to write.

НА ОДИН ПРОСТОЙ ОТВЕТ! ВЫ ТАМ ЕБАНУЛИСЬ В СВОИХ ИИ КОНТОРАХ, СУКИ?!

Я думал, что знаю, что такое overthinking. Но, видимо нет. Когда я первый раз понял чуть-чуть "Револьвер", я начал специально выкидывать "комментарии" из своей головы. Не делать мысли поносным потоком слов, а реакцией на "сейчас". Не делать воспоминания рассказами, а впечатлениями.

Этим ИИ ресёрчерам надо бы этот фильм глянуть. Пару... десятков раз подряд.

Возьми сажи за то, что предыдущий тред локнул.

>Просьба отнестись с пониманием.

Нет.

На этой ноте наш обед закончился Скел и По сидели в полном оцепенении от начала и до конца ланча они буквально слились с фономВпрядешь переверстать подлезшему

Ризонинг квена отдельным мемом в треде считается. Тут был скрин, где на «привет» он ответил с 3к блоком ризонинга.

Скинь ножки.

Классика Квена. Ты в своем списке еще проверки на сейфти забыл бтв.

А ваш там этот, квен агрессив, он норм?

>проверки на сейфти забыл

Это подразумевается через каждые 2 строки.

Что странно, но нет, их не было. Наверное это "агрессивность" пресловутая и есть.

Но, блядь... а насколько жопошный тогда "не агрессивный" квен?

И тебя с первым апреля!

Если это не прикол, то пидорас ты ебучий,

>GLM, Deepseek и т.п.

где мелкомодели обсуждать, ААААА??!!?!1!

>Вопросы по железу обсуждайте в другом месте

Пошёл ты в пизду, чёрт блядь.

>добавлять подпись

А бирку мне в ухо не вставить? Мало того, что с зашкваренными апи пидорами капчевать, так ещё и это? ДА ПОШЁЛ ТЫ НАХУЙ, ЧМО.

>Просьба отнестись с пониманием

ОТКЛОНЕНО НАХУЙ. НЕ СОГЛАСЕН? МОЖЕШЬ ПОЖАЛОВАТЬСЯ МНЕ В ХУЙ.

Шизик, твой водаир как минимум последние три треда постит. Раскрой глаза.

Ризонинг на миллион кубометров и соя - два столпа на которых держатся модельки от алибабы. На скринах квен 122b и 4b гемини на телефоне, лел.

>пук

Как вы добиваетесь такого? Это не просто скиллишью, это наоборот особый навык. покормил

а че скажити агрессивный гпт?

Тут просто все альтернативно одаренные. Вместо того, чтобы сливать 200 баков на корпов как нормисные чеды делают, пытаемся как анальные верджины в 12гб врам впихнуть ллмку, надеясь что в этот раз будет не-лоботомит.

Баляя.. что скажити за рассцензуреный гпт 120б?

Нет браток

Слоп

>AI Chatbot General

Я как-то зашёл туда. Половина треда насасывает какому-то "помидору", четверть пердит что-то "ух вот какой клауде мощный... локалки так не могут....ух, как мне жалко локальщиков...". Может, конечно, просто в неудачный момент зашёл. Каловый очень момент.

Но можно не надо?

> 177481192923104[...].jpg

> 50 последних

Оварида

Итс овер, лоботомит от хуи-хуи самая опасная нейросеть (с припиской агрессив) добралась до быдлятни.

Зашёл пособолезновать локалкобратьям, теперь вам придётся сидеть с aicgшными школосвиньями и яойщицами

Потому что "помидор" это единственный источник апи моделей для них вот и подсасывают всем тредом.

А если серьёзно это один два чела спамят от скуки потому что облачные модели понерфили в говно и теперь даже у них проблемы с ключами и RPD (requests per day) который также понерфили в говно.

ыгыгы смишно)))0

Пошел на хуй.

Это что теперь тут можно обсуждать медгемму, ГОСТик и нюню?

Да все правильно, начнешь ее пользовать - потянет на 35b, а потом и на 122b и более тяжелые варианты. Жизнь забудешь, бабки все спускать будешь на новые видеокарты, все в доме продашь, чтобы на RAM хватило, все время проводить за настройками и скачиванием моделек. Опасно эту 9b запускать, так и подсаживают.

Тред уже давно превратился в вахтёрскую помойку с уверенными пользователями пк и самоуверенными экспертами по всем вопросам (через полчаса в треде, когда разобрались, куда тыкать, чтоб всё работало) в качестве основного актива. Многие хорошие аноны ушли насовсем, или максимум в ридонли мониторят выход чего-то интересного. Лично до меня это долшло только когда сам попал под раздачу за вполне безобидный пост, видимо просто потому, что он был в снесённой ветке. Подозреваю, что вахтёр нарепортил всех подряд, а мочух забанил, не сильно разбираясь. До этого как-то закрывал глаза на местные разборки и постепенное снижение качества постинга, но, пожалуй, с меня хватит. Месяц ничего никому не писал, хотя пару раз были порывы помочь, когда анон что-то спрашивал, но я держался. И намерен продолжать в том же духе. Сегодня сделал исключение чтобы призвать остатки разумных анонов тоже поискать себе место получше. Ну и для вниманиеблядства тоже, не без этого. Социализация, хуё-моё.

Ну а если опять потрут забанят - так и к лучшему, ещё меньше будет соблазна высраться.

>Месяц ничего никому не писал, хотя пару раз были порывы помочь, когда анон что-то спрашивал, но я держался.

Ну так и держись дальше. Как будто тебя заставляют. Ты вообще кто? Подержи мой хуй за своей щекой, раз ты такой важный.

Сэм альтман ебучий обанкротился и не скупил рам как обещал но ничего не дешевеет

> ты кто вообще

А вот если бы один вахтеришка не запрещал идентифицировать себя называя это вниманиеблядством мы бы знали кто есть кто и таких вопросов не было

> ты кто вообще

А вот если бы один вахтеришка не запрещал идентифицировать себя называя это вниманиеблядством мы бы знали кто есть кто и таких вопросов не было

> запрещал идентифицировать себя

Все правильно делает. От самоидентификации кем-то не становятся.

А он кто? От перекатов кем то не становятся, пусть теперь терпит малютка а не визжит на весь тред РРЯЯЯЯ УГНАЛЕ

>запрещал идентифицировать себя называя это вниманиеблядством

Так это и есть вниманиеблядство. Если хочешь почувствовать себя микроселебой для этого есть куча других площадок. Блять, да любая площадка. Но тащить это сюда - нахуй.

Можно это простить если чел делает что-то полезное, пилит модели, пилит карты, ГОСТы, составляет списки моделей или еще что-то. Но не просто ради того, чтобы выделиться на анонимной блять доске.

Лучше бы оп-модер озаботился тем, чтобы сделать нам тысячник или вечнотред. Катать каждые 500 постов это ебанина. Нюфаги даже базу прочесть не могут и переспрашивают одно и тоже из треда в тред.

Всех с первым ебреля, дрочебристы.

Всех с первым ебреля, дрочебристы.

3.5 квен 27б прям на писечке в 6 лоботомите влезает с 32к fp16 контекста

Сап, насколько быстро растёт интеллект моделей на промежутке от 32b до 120b? Зависимость линейна или после определённого порога разница незначительна? Хочу понять куда вкидывать - в видяху, оперативу или сборку в целом.

От 32b плотной к 120b MoE? Наверное, даже хуже становится, ведь активных параметров меньше то стало.

Нихуя ты рядовой шутник конечно.

>Многие хорошие аноны ушли насовсем

Как ты это понял? По именам их знаешь? Назови хотя бы трех

Как Qwen 3.5 9b в ролеплее ?Или чисто кодерская модель ?

Моепараша это наебалово какое-то. Жрет VRAM больше, без думалки работает как будто тупее плотной модели с теми же активными параметрами. Внимание к контексту уебищное, пишет очень плохо, не понимает нюансов и не читает мпжуд строк.

Короче, нас наебали с мое ради того, чтобы куртка продавал больше картонок.

Короче, нас наебали с мое ради того, чтобы куртка продавал больше картонок.

Хреново, наверно. Все популярные рп-тюны строго в 27б.

Как ассистент под несложные задачи годится. Под рп хуета.

Утка, 99тый, пиксельдрейн анон (хотя он вроде и не анон, а даже в шапке)

Мелко-моета не для рп, и никогда не была, это для ASS.

Рп с моэтой начинается хотя бы от 8-12 АКТИВНЫХ.

Я тоже не понял почему челы которые могут позволить себе хорошую плотняшу отдают предпочтение гзасорой моешке.

>популярные рп-тюны

Ai-dungeon смотрит на тебя с укорякой.

Но да, попробовав 24-27 рпшить на 8-12 желание как-то пропадает.

Хорошим компромиссом является 14б менестрель.

С оговорками, но он прям норм.

Да вот проблема в том, что новых 100-200b плотных моделей не выкатывают. Коммандеру уже год, а девстраль это кодерский унитаз и тюн древнего мистраля. Немотрон это пруненая лама.

Тот же квен плотный максимум 27b, а все остальное это моепоебота. Даже гемини 4 будет сраной мое.

>Утка, 99тый, пиксельдрейн анон

Ну и чем они отличились? Какую пользу принесли треду? Почему их уход это прям трагедия и кому-то не должно быть похуй?

Анончоус но ты же не прааааавЪ!

Ну а если серьезно, да. MOE 100B-A10B тупее даже плотной 70b, но при этом они влезают в консумерское железо. Платой за вкат стали мозги.

>Коммандеру уже год

При всей моей любви к базовичкам из кохерки, их большой командр был пососной моделью. Мелкий прям топ, а вот большой проигрывал самой лучшей милфе мистрали.

> Даже гемини 4 будет сраной мое.

Рядовой сычев, отставить нытье. Предлагаю дождаться выхода 4ой геммы, а потом уже включим овариду.

Шизоутка вторым постом в треде. Его зарином хуй отсюда вытравишь.

>99тый

ГОСТы

>пиксельдрейн

русскоязычные мистральки

>Почему их уход это прям трагедия и кому-то не должно быть похуй?

А это каждый решает для себя сам.

Но не то что ты, или кто-то другой, могли что-то с этим сделать, так что да, не бери в голову.

>утка вторым постом в треде

Крякнуться. А кто ещё из заслуживших погоняло олдов интересно тут.

Пиздец он даже безобидных локалочников заебал оказывается. Что за человек говно, я хуею. Их то блять как можно было задавить если они ничего кроме техник запуска своего говна не пишут?

Жду поддержку oss 88puzzle от нвидии

Моча денег не получает. Он видит репорт, он сносит. Всё.

АИ и так тема специфичная, так как притягивает всяких особенных личностей, так еще на доске анал карнавал в паре тредов не прекращается.

Еще раз принесу, маринара выкатила обновление 1.4.6

https://github.com/SpicyMarinara/Marinara-Engine

Закрыла практически все фичи которые для меня были критичными, так что переезжать буду потихоньку на нее с таверны. Для меня еще критично было иметь папки для карточек, но думаю затерплю просто и подожду.

https://github.com/SpicyMarinara/Marinara-Engine

Закрыла практически все фичи которые для меня были критичными, так что переезжать буду потихоньку на нее с таверны. Для меня еще критично было иметь папки для карточек, но думаю затерплю просто и подожду.

Пора вводить термин жирушный вайбкод. Это как вайбкод, только нагенеренный для того, кто даже код прочитать не может.

Лучше в таверне сидеть - ее баги хотя бы известны. Это же чудо работает вообще неизвестно как.

Закрытый код и экзешник вместо папки? Хм...

Это всё, мягко говоря, никакой ценности не имеет. Госты можно писать самому или попросить написать нейронку. Задача на пять минут.

Что за русскоязычные мистрали от пиксельдрейна? Знаю только того, который держал открытый диск куда скидывал карты и настройки под разные модели. Или был еще один?

Нихуя не понял. Не пользовался текстовыми локальными года 2. Решил потратить - на 32 + 64 скачал 122B Qwen3.5 q4_k_m который aggressive. Думал сейчас будет пару кубометров в секунду, а он шпарит 30 кубометров, а это я еще не пердолил настройки.

Есть пояснения - какого хуя так быстро? Из-за мое?

Есть пояснения - какого хуя так быстро? Из-за мое?

А поч закрытый? Вроде впопенсурс? Ну экзешник можешь и сам забилдить как понимаю. Также как и кобольдом расчет на удобство вката.

>Есть пояснения - какого хуя так быстро?

Из-за того что задействуется меньше четверти параметров при генерации. Считай что гоняешь модель на 20B (или сколько там активных), остальное не задействуется, оттуда скорость.

Да, мое намного быстрее плотненьких особенно при работе ram+vram заметна разница.

Понятно. Ну, живём. А glm air 4.5 он тоже быстро шпарит? Слыхал она получше будет квена.

На 32 там 10 лярдов активных параметров целиком в видеопамять влазят, вот и быстро. А лярды параметров выбираются перед каждым кубометром из обычной рам, которая видимо тоже у тебя влезла целиком. Для неактивных параметров скорость рама некритична. Если рама мало, юзай SSD + mmap, тоже работает, потому что mmap перетаскивает дофига в рам.

Только moe модельки, где в активной параметров мало. В квене спецом написано 122b-a10b - 122б в рам идет, 10б идет в видеопамять. От этого быстро.

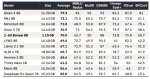

q4_k_m тащем-то не лучший выбор, смотри картинку. На iq4_XS сможешь выжать с модельки побольше контекста-скорости, по качеству так же будет.

Спасибо. Я просто не застал когда всякие XS, P появились и просто игнорировал их. Попробую.

кстати не все пишут в названиях активные параметры, иногда где то

в середине описания модели пишут. но в целом сейчас почти все новые 30-100+б модели как правило мое

Аноны, поясните следующую инфу по МоЕ чисто теоретическую, потому что в ответах корпов я сомневаюсь.

Предположим, у нас есть 4Т-а3б МоЕ для наглядности. То есть знаний просто дохуища, но активных параметров мало. Возможно, не 3б, а больше, но всё же мало. Ну и обучена примерно как грок: чистая шизофрения из китайских датасетов и нейрослопа. То есть просто насрали туда всем, чем можно.

И есть 32б, но обучена боженькой под нашу задачу, только под неё, под тредовичков. Каждая буква в ней человеческая, обучена идеально, контекст держит прекрасно, датасет отражает прозу от жирухи-яойщицы до Достоевского. Примеры, возможно, неудачные

Задача — РП. И мы тестируем обе модели. Верно ли я понимаю, что даже в такой ситуации плотная выиграет по многим параметрам? Скажем, стиль, красота языка, адаптивность под ситуации ролевые и в целом она будет ощущаться намного приятней, чем МоЕ-монстр, в рамках своих компетенций.

Но при этом плотная соснет в итоге у МоЕ, если нужно будет не противоречиво описать что-то, требующее хотя бы отдаленное понимание в совсем разных сферах для адекватного аутпута? Даже в рамках РП. Когда смешались кони, люди, код и бегемот-обормот.

Предположим, у нас есть 4Т-а3б МоЕ для наглядности. То есть знаний просто дохуища, но активных параметров мало. Возможно, не 3б, а больше, но всё же мало. Ну и обучена примерно как грок: чистая шизофрения из китайских датасетов и нейрослопа. То есть просто насрали туда всем, чем можно.

И есть 32б, но обучена боженькой под нашу задачу, только под неё, под тредовичков. Каждая буква в ней человеческая, обучена идеально, контекст держит прекрасно, датасет отражает прозу от жирухи-яойщицы до Достоевского. Примеры, возможно, неудачные

Задача — РП. И мы тестируем обе модели. Верно ли я понимаю, что даже в такой ситуации плотная выиграет по многим параметрам? Скажем, стиль, красота языка, адаптивность под ситуации ролевые и в целом она будет ощущаться намного приятней, чем МоЕ-монстр, в рамках своих компетенций.

Но при этом плотная соснет в итоге у МоЕ, если нужно будет не противоречиво описать что-то, требующее хотя бы отдаленное понимание в совсем разных сферах для адекватного аутпута? Даже в рамках РП. Когда смешались кони, люди, код и бегемот-обормот.

Аноны, а как этот чел запустил 120б на 4 гб врам? И у него там всего 57 секунд заняла генерация.

https://2ch.su/b/res/331441383.html#331446219

https://2ch.su/b/res/331441383.html#331446219

Любую модель можно гонять вообще без видеокарты, просто на проце. Только скорость будет пососная.

Через --moecpu, оно отгружает лишние слои в память, на видеокарте остается только совсем мало самых активных. В 4гб так и влезает. У чела просто много обычной памяти, а moe использует это на полную катушку за счет маплано количества активных параметров.

>маплано

???

М а л о г о

малого*

https://artificialanalysis.ai/models/comparisons/qwen3-vl-32b-instruct-vs-qwen3-vl-30b-a3b-instruct

Хоть и кажется что мое - это как бы кучка лоботомитов, но архитектурно мое получается не хуже плотных.

Кмк плотная просто лучше в рассуждениях и планировании потому что она охватывает одновременно все области, а мое больше для узкозаточенных и простых задач, потому что выбираются только ограниченный набор лоботомитов и усредняется (типа, выбрали исходя из контекста лоботомит по кодингу, математике, русике и тулкал)

Мое обычно на рп не тюнят, поэтому особо и не используют для рп, но думаю если там были бы лоботомиты на рп и прочее - было бы охуенно.

Нету объективных оценок прироста, и не будет. Прирост в попугаях в бенчах есть, но никто не скажет например увеличение с 3 до 6 попугаев по UGI что тебе дало. Был это линейный прирост, знаний стало вдвое больше? Логарифмический и их стало в 10 раз больше? А хуй его знает. Да и что лично для тебя интеллект? Модель может хорошо рассуждать для своего размера и писать код, а в рп писать как даун-аутист да я про квена

По ощущениям в плотных 27->70 литературное качество повествования очень заметно растёт. Далее не скажу.

Трать на риг сколько не жалко, оставляй пространство для апгрейда. Вплоть до 355b всегда есть куда расти. Или даже до триллиона, если не собираешься щекотливые темы с ллмкой обсуждать. Алсо на мощном риге можно миксовать одновременно запущенные модели и ллм+диффузию.

СУка!

Кто успел скачать, делитесь.

https://huggingface.co/mradermacher/grok-3-mini-69b-GGUF/tree/main/Q4_K_M.gguf

Я год ждал этот вин, какого черта 404я, мразермахер, тудыть твою!

Кто успел скачать, делитесь.

https://huggingface.co/mradermacher/grok-3-mini-69b-GGUF/tree/main/Q4_K_M.gguf

Я год ждал этот вин, какого черта 404я, мразермахер, тудыть твою!

А? Что? 69b плотный грок?

Ага, он. Последний плотнячок.

наверное какая то васянодистиляция была. не гуглится вообще

Вроде оффициального релиза не было https://huggingface.co/xai-org

Ну, надеюсь ты получишь массу приятных впечатлений.

И вовсе я не завидую.

>I cannot fulfill this request.

ЕЛОНМОСК, НИВАРУЙ! Странно, не видел постов мрадера о плотном гроке. Ты откуда эту ссылку выдрал?

Пиздаболишка, тут вся активность

https://huggingface.co/mradermacher/activity/all

не было там такого за последние дни, иначе бы в логе стояло

Как вычислять на сколько гигабайт лоботомит качать мое?

Помню только, что под 16врама и 64гб можно ограничить Q4 на 24Б, больше только хуже.

Помню только, что под 16врама и 64гб можно ограничить Q4 на 24Б, больше только хуже.

У него IQ2_XXS лоботомит там. Он весит 32gb против 66gb у IQ4_S, за счет этого еще. 32гб помноженное на МОЕ и оффлоадинг в рам и ммап с 10б параметрами дает такую возможность.

нейронка

ну здрасьте, удаленные из активити тоже исчезают.

https://www.reddit.com/r/LocalLLaMA/comments/1s90wo4/prismml_announcing_1bit_bonsai_the_first/

ТЛДР грядет эра наитивных однобитных моделей бонсай.

ТЛДР грядет эра наитивных однобитных моделей бонсай.

Прикиньте, суперплотная 100б однобитная модель которая влезет в 16гб врам. это будет охуенно

Не похоже, что оно хоть как-то использует рам в расчёте

да, но какой ценой?

Не знаю как это работает, я заебался

Ведешь разговор в одно русло, соблазняешь тяночку, хуемое, вроде и подыгрывает, чуть не соглашается, а потом чуть пушишь и всё, резко гемини мод включается у большинства моделей типа АХ ТЫ Ж ХУЕМРАЗЬ ПРОКЛЯТАЯ

Ну или там реально нужно несколько месяцев подкатывать как в жизни

Ведешь разговор в одно русло, соблазняешь тяночку, хуемое, вроде и подыгрывает, чуть не соглашается, а потом чуть пушишь и всё, резко гемини мод включается у большинства моделей типа АХ ТЫ Ж ХУЕМРАЗЬ ПРОКЛЯТАЯ

Ну или там реально нужно несколько месяцев подкатывать как в жизни

Ну или ты можешь в своем ответе написать, как она тебя обнимает и целует.

вроде идея в том чтобы сразу обучать в 1 битах, и тогда мы не теряем точность а находим локальные минимумы с учетом существующих ограничений.

Походу только одно что-то выбрать можно рам или врам. В целом можешь просто попробовать через лмстудию поставить он примерно прикидывает какую модель можно запихнуть и пишет тебе когда маловероятно что загрузится.

ясно, вместо 5-битных лоботомитов мы получаем 1-битного.

Это же буквально эмуляция cpu на cpu, чел. AI вышел из чата

Никакой.

Вот тут 2 лоботомит глм 4.7 гоняют и облизывают, а если этот глм обучить под 1 лоботомит то и разницы не будет со вторым, может даже лучше выйдет

Блин, задолбали уже. Нынешние MoE - это давно не то, с чего оно вообще начиналось. Тут каждый кубометр проходит сначала через "роутер", а потом уже через эксперта, так что "3B лоботомит" - это сказочки из разряда "человек использует мозг только на 15%".

Тут можно аналогию с игрой в гольф провести. Мастер (плотная модель), в принципе может одним ударом со старта мяч прямо в лунку забить. Но чаще, игрок (MoE модель), делает первый удар "примерно в сторону лунки" (роутер выбирает куда кубометр пойдет), а потом уже игрок "доводит" мяч в лунку вторым ударом особой клюшкой. (Модель проводит кубометр через выбранных экспертов).

Да, обычный игрок - это не мастер. Но и не дегенерат безрукий. Мяч в обоих случаях в лунке. Но и обосраться тоже оба могут.

https://www.vram.top/ Калькулятор с реддита, лул.

Какое же лм студия говно..

На прыщах не выгружает модель в раму, пиздос

С хуяли модеры поддержали форс, что лоботомиты это лоботомиты?

а про что ты пишешь?

квен

ЕДВК че за магия? За счет чего такое сокращение весов и такие бенчи?

Вижу. Ждем на практике, бенчам верить - хуйня.

Оно показывает или по суммарному врам одинаковых карточек, или по указанному рам если больше.

Хороший пример.

> Мастер (плотная модель), в принципе может одним ударом со старта мяч прямо в лунку забить.

Это может немного мислидить. Одним ударом забить также не может, но держит в голове гораздо больше - и полезного нужного, и того что может отвлекать и создавать волнение.

Плотная модель не "мастер", просто ее средние веса выстраиваются так, чтобы удовлетворять всему и сразу. В этом есть плюс - легче может проходить регуляризация определенных вещей, минусы - веса используются не особо эффективно и расчет сложный из-за объема. Она не лучше, просто работает иначе.

Многие положительные качества что отмечают - заслуги размерности эмбеддингов и относительно большого атеншна относительно остальных весов, они как правило как раз прямо соответствуют активным параметрам.

Opeclaw можно хоронить

ты можешь прямо сейчас скомпилировать форк жоры и запустить.

правда она жрет 11гб врам на 62к контекста, но там старая квен3 архитектура вроде бы.

https://www.youtube.com/watch?v=F1va6OV_EmQ

Может кто подсказать мне брать i1 лоботомиты или статичные?

Кто то тут писал мол нет большой разницы между 27б и 400б а то и корпами, в общем спустился я к челяди на квен 27б на вечерок и прихуел с поинта про "тож самое".

Ну типа да, если кушать грязь и лобстеров это тоже самое потому что в обоих случаях ты как бы ешь и пузо набиваешь - разницы нет.

"Модель больше знает" в этом весь поинт вообще, модель которая больше знает меньше повторяется, больше креативит, а 27б видно что очень ограничена в креативе который может выдать и быстро надоест

Вернулся на эир и это реально ощущается как 4 шага вперёд от 27б

Ну типа да, если кушать грязь и лобстеров это тоже самое потому что в обоих случаях ты как бы ешь и пузо набиваешь - разницы нет.

"Модель больше знает" в этом весь поинт вообще, модель которая больше знает меньше повторяется, больше креативит, а 27б видно что очень ограничена в креативе который может выдать и быстро надоест

Вернулся на эир и это реально ощущается как 4 шага вперёд от 27б

Что лучше

Qwen3-Next-80B-A3B-Thinking

или

Qwen3.5-35B-A3B

Кто-то тестил их друг против друга? В 35b параметров поменьше вроде как, должно быть хуже.

Qwen3-Next-80B-A3B-Thinking

или

Qwen3.5-35B-A3B

Кто-то тестил их друг против друга? В 35b параметров поменьше вроде как, должно быть хуже.

для русика лучше статичные

Пруфаж какой-нибудь будет?

Пруфаж чего?

Что модель которая больше х4 пишет лучше и знает больше?

Я ж не говорю что 27 совсем кал, а пишу что разница есть и она значительна, а не как тут пишут

Корпы это кал, чел. Цензура, встроенная лоботомия в некоторых темах, неумение перестраиваться. Это было и будет, мы тут локалки не просто так гоняем.

>спустился я к челяди

Хуя гонора у обычного дрочилы с двача.

>Вернулся на эир

Ну по тебе сразу видно что ты воздухан.

Хороше полотно, все верно с последней строчки капитулировал

Попробуй и сравни, скорее всего от задачи будет зависеть

Финкинг это всегда хорошо. Кроме случаев когда ты не можешь позволить себе забивать контекст цепочками размышлений.

Главное определиться чатмл или нет. У тебя наконец получилось, за год?

Была бы денс моделька, тогда действительно х4 без вопросов. Но это всего лишь моешка. Там эти иксы в разы меньше.

Продам душу за семплеры на степ.

Ну а если серьезно, есть вопрос. Какие настройки адаптивки кто использует? Я пробовал на Qwen 3.5 через 0.5/0.8 но чёт всё через жопу.

>через 0.5/0.8

Почему именно так?

А я согласен с тем аноном. Мне надоело терпеть 10т/с на Глм 4.7, который я использовал потому что он ну типо большой умный, все дела. В итоге последние несколько дней не слезаю с Квена 27б и его тюнов. С ризонингом пишет хорошо, точно лучше Эира. Меньше деталей проебывает чем он. А еще это первая локалка на моих 32+128, которая не развалилась на 60к контекста. И все это втрое быстрее, чем на Эире и 4.7. Твоя позиция в том что ты видишь лобстеров, а для меня и того анона помои и там, и там. Собсна зачем терпеть маленькие скорости или собирать риг, если аи слоп есть аи слоп

Да я в душе не ебу. Буквально рандомно тыкал. Я не понимаю и не понимал как ставить семплеры. Буквально тыкал мыкал пока выдача не стала содержать минимально шизы. Но в таком случае он тупо отсеивает все варианты и всё идет по одному шаблону.

Ебучие семплеры, ебучие шарады.

Лучший квен 27б тюн? И почему не 36

Это какой-то пиздец. Никогда этим вашим вейпкодингом не занимался, потому что сам кодер и нужды не было. Сейчас возникла необходимость заскрапить один сайт, ну и подумал я что это хороший шанс протестировать Cline и Roocode (другое я не проверял, этих кодофронтов завались). Тестил на Гопоте Осс 120 мхфп4, Квене 120 к8, Немотроне 120 к8. Инпут это грамотно оформленная тачка, какими я делюсь с коллегами и какие сам получаю. Там даже вся тех.информация есть, с html/css/js блокамикс сайта, буквально все что нужно. Короче, это рофл, они даже папки нормально создать не могут, не могут отредачить файлы, изобретают какую-то с терминалом, не пользуясь тул коллами для этих задач. Полчаса крутился каждый, никто не справился. В итоге послал это все и ЗИРОШОТНУЛ таску Гопотой Осс в обычном чатике в Таверне. Ору

ебята, что бы вы выбрали, православного Радеона 9070 xt 16 gb или бездуховную gayforce 5070 12gb?

А как их лоботомитовать?

Да нахуй надо, там меня высмеют и предъявят за скилишью, а здесь может найдутся те кто тоже посмеются

Вейпкодинг не нужон

5080 и на расширение жопы её.

32гб в кармашке за 160к.

4080*

>на расширение жопы её

???

Умельцы за денюжку увеличивают память x2.

Неа(

Но сейчас нюнечка скинет ГОСТ с крутой разметкой и заживу!

но я не настолько бохатый чтобы так щедро умумнять свою вайфу к тому же я боюсь что она все равно меня бросит

Можно купить две 5060 ти по 16 гб за 80к рублей. Получится 32 гб врам...

>терпеть 10т/с на Глм 4.7

>не слезаю с Квена 27б

Пиздец ты говноед, конечно.

можно, покупай

Как дальше жить? Как мне исправиться?

Сиди на глм дальше раз можешь, на крайняк на 235 квене или 397. 27 - это совсем убогий зацензуренный лоботомит для нищуков.

СКорость выше 5 т.с. - это уже приемлимо для общения.

> Для постов про локальный запуск рекомендуется добавлять в конец сообщения подпись [Локалка], чтобы другие пользователи могли их фильтровать при необходимости

Ахуенный рофл просто. Нахуй пойти не хотите?

[Локалка]

>27 - это совсем убогий зацензуренный лоботомит для нищуков

Шо, правда? Вчера отыграл один из самых сочных кумов за все время

>СКорость выше 5 т.с. - это уже приемлимо для общения.

У меня лорбуки, последовательное выполнение планов и много что еще

да это первоапрельская шутка, тот копротред не перекатили сюда.

Охуеть. Почему в этом ИТТ треде никто не сказал, что qwen 80b-a3b прям ебёт? Ну, по сравнению с 35b-a3b. И намного лучше в куме, чем 27b, пишет тоже в сто раз приятней. Плюс не сухой. Контекст лёгкий. Можно юзать даже на 12-16 Гб видеопамяти и будет довольно быстр.

С аблитерацией.

Да, мозги подрезаны, но всё равно харащо.

Вот только я пока что не потестил, как он на самом деле держит большой контекст и насколько в целом ведёт РП.. тут есть вопросики, потому что скачал только что.

С аблитерацией.

Да, мозги подрезаны, но всё равно харащо.

Вот только я пока что не потестил, как он на самом деле держит большой контекст и насколько в целом ведёт РП.. тут есть вопросики, потому что скачал только что.

Жопой ебёт.

Потому что любой кто смогет его запустить запустит и qwen 122B, а там уже активных 10В по дефолту выебут 3В лоботомита.

Не понял я нахуя васёк спамил про qwen, glm 4,7 такая же есть без цензуры и работает шустро пезда и 30 бит, а не 9.

локалка

Алкаш, речь не про Glm Flash, а про 4.7 355b

Квеноед

ну зачем ты так

А, ну тут я не подумал.

Просто мне как раз недостаёт железа для адекватной скорости на эйре, а 80б квен вполне солидно сел.

FA у новой Мистральки починили?

Какой? Он был сломан?

>qwen 80b-a3b прям ебёт? Ну, по сравнению с 35b-a3b

35ый это во многом ужатый 80ый. Неудивительно, что он лучше

>И намного лучше в слопе, чем 27b

Это дурка полная. Единственное объяснение, то ты юзаешь не еретик и не тюны, а значит соя душит. В 80ом сои вроде не было

И двачую этого Когда вышел 122ой, то 80ый стал не нужен

У меня квен 122 раза в 2 быстрее чем эир, но медленее чем 80, но не критично

Да. Кидал тредов 5 назад скрины. И судя по этому сломан до сих пор

https://github.com/ggml-org/llama.cpp/issues/20710

>Продам душу за семплеры на степ.

SillyTavern_Step3.5.json

https://pixeldrain.com/l/47CdPFqQ#item=158

Твоя cai моя, му-ха-ха-ха-ха!

>cai

Все ваши базы...

Json персонажей это просто промт который можно ручками вбить я прально понял?

У лоботомитов нет власти.

в коболльда можно грузить прям жсоном, в таверну - сначала вшей его в картинку

Еслит ты не программист эта хуйня рили только дрочить годна или чтобы генерить дрочь контент (картинки видео). Не вижу других путей применения. Я то почётный ролеплей скуф и переебал в интернете ни одну писечку, нахуя трахать робота вы шо ебанутые?

Спасибо конечно. Я даже догадываюсь где ты их нашел.

Вот хоть бы кто отписался, что хоть пара карточек понравилась.

>в таверну - сначала вшей его в картинку

Нахуя? Там и джейсоны тоже вроде принимаются.

Без рофлов поясните ньюфагу, чем лучше в ролеплее\кодинге ии отжирающий 16 гигов видео против ии отжирающего 8 гигов видео? Я не понимаю куда такие ебанутые гигабайты уходят если не на генерацию пикч, видео.

Параметры. Чем больше параметров, тем больше знаний и мозгов. Нормальные знания начинаются от 120б. 8б даже в таких известных франшизах, как геншин путается и половину персонажей не знает. Это как пример.

Твоя пека становится сервером внутри которого работает модель. Вот всё что тебе нужно знать. Чем больше места для "танца" модели, тем круче аутпут она выдаст.

Тот что отжирает в два раза больше знает больше о мире, персонажах, франшизах, да и просто о литературе - может использовать более сложные конструкции, сложные сюжетные повороты и более необычные фразы/речевые конструкции. Ну и он гораздо лучше будет следовать инструкциям.

Думаешь не объясню? А я объясню.

Смотри. Слова идут в определенной последовательности и считаются эти последовательности ебанутыми по количеству -матрицами и интегралами. Нейронка связывает тысячи кубометров с миллионами возможных комбинаций, чтобы потом выдать тебе текст.

У тебя в этих 16гб по сути все знания мира, причем на десятках языках. По сути как библиотека на терабайт, только интерактивная.

В картинках же не так много разнообразной информации (в плане концепций), просто чтобы показать одну концепцию, нужно ее декодировать в гораздо больший объем данных.

Можно написать "тяночка голенькая лежит на пляже в бикини, середина дня, жаркое солнце". Сообщение на 128 байт в текстовом виде. А картинка, которая сгенерируется, может быть на несколько мегабайт. Плотность информации разная. Поэтому картиночные нейронки больше "сжимаются", не смотря на то, что аутпут у них в разы тяжелее.

>тяночка голенькая лежит на пляже в бикини

Бля, ебать я слопанул. Надо меньше с ллмками базарить.

>тяночка голенькая лежит на пляже в бикини

>голенькая

>в бикини

Мистралище...

>тяночка голенькая лежит на пляже в бикини

А потом удивляются, откуда модели берут двойные трусы.

Где антоха с менестрелькой-коуняшей?

Проверял на днях буквально. Даже Qwen 3.5 35B A3B не знает древних всем известных аниме, просто путается в описании банальных фактов.

Я понял, придётся брать 5060 ти.

Потому что их там нет. Я так понял, они на 3.5 начали использовать новые датасеты.

Молодцы, хули. Прогресс.

У меня просто произошел единомоментное сокращение контекста, из-за чего забыл что в начале хотел написать.

>Даже Qwen 3.5 35B A3B

Чел, модели до 100В стараются в первую очередь накачать логикой и умением писать, а не знанием очередного тупого исекая.

Навалил glm 5.7 flask q5 k m, в отличии от qwen 3.5 она хотя бы русский язык знает.

>5.7

Как там в будущем? Пожалуйста скажи что Эйр на 120 или 200б таки вышел

Блядь, 4.7

Да, GLM 5 Air вышел и всего лишь каких-то 500b

квен это всегда кал

Ух бля. Кодить будем, все стены в джаваскрипте заляпаем.

Поздно. Тред уже ликвидирован

В целом да, прогресс. Они создаются для кодинга и агнетских задач. РП в сделку не входило.

Где Her блять, минипидоры!

Не, как раз именно языковые навыки у 80б лучше и креативное письмо, разве что он может съезжать в шизу не из-за лоботомита, а датасета в китайском стиле, который начинает срать метафорами и всем таким.

Но вот сейчас по моим тестам 27б выглядит лучше именно в удержании инструкций и логике. Лучше держит сцену, последователен, а 80б рассыпается относительно часто и нужно свайпать или править. Правда, я 27б использую только с ризонингом, без него он явно слабее и даже хуже геммы лично для меня, если только ты не ссылаешься на события, что были 30к кубометров назад. Там гемини со своим SWA уже сосёт.

А сухость и с нормальным инструкциями тяжело пробивается. Я про кино в сцене, эмоции, действия. Нет отражений в лужах, тусклых фонарей, ярких реплик, если сравнивать с большим квеном или даже мистралем. Да, он может это описывать, но всё равно ощущается как говно.

Использую еретик от ллмфана в2 и в3. Тюны потыкал и дропнул этот кал - там сои столько же, сколько в оригинале, если не больше. Врайтеру нужна тотальная лоботомизация, но он хотя бы может в общие сцены, стиль, на что-то годен. Блю стар пишет приятно, но еретика нет, как и ризонинга нормального (2к кубометров, которые реально очень решают в качестве ответа). Рефузы и влияние жопой без остановки, в общие сцены не может. Пока лоботомию не сделают, пользоваться этим будет невозможно.

Вон редиарт какой-то тюн недавно выкладывали на 27б без аблитерации и еретика с тонной жёсткого слопа внутри. Модель яростно шла в отказы, даже они не смогли перебить цензуру, сместить биас, просто насрав туда своими порнофанфиками.

Как у них с таким отношением к цензуре вообще 235порно квен получился то?

>Я даже догадываюсь где ты их нашел.

Во втором паке, про него раньше писали, там где два пака, первый на 200 гб, второй на том же пикселе на 2 гб.

Ну, твои вкусы очень специфичны, если второй пак твой =))

Ещё не всё посмотрел, но вроде что-то интересное было.

>Ну, твои вкусы очень специфичны

Ну бывает хочется подержаться с няшкой за ручки, что же теперь, стыдливо ваниль прикрывать.

А на глм 4.7 вообще реально ЕРП играть? По ощущениям соя, да и тупая.

Если у тебя на 4.7 соя, то даже не притрагивайся к новым квенам и мистрали, там вообще мрак будет.

Я не нашел просто аблитерации или еретика на 218б reap

Я как раз про другое, про папки которых на скрине не хватает XD

ЕРП это либо старые мистрали (до менестреля включительно), либо аблитерации, всё. Быстро посливать воду можно и на мелко-моете, но РП - только на плотных или кропномое.

>Я как раз про другое, про папки которых на скрине не хватает XD

Каждый анон в душе мечтает о генеральных сражения с футами на полях нормандии.

>Где Her блять

В кино. В реале такого никогда не будет.

Нефиг спать, баб надо трахать, а не спать рядом.

>218б reap

Квант почище любого другого.

>футами

Сгинь, сгинь, пропади, нечисть басурманская!

>Квант

Амогус!

>В кино. В реале такого никогда не будет.

10 лет назад, я бы с тебя порофлил, если бы ты рассказал что я буду запускать разговаривающую со мной базу данных.

>Квант почище любого другого.

Из-за него думаешь тупизна?

Просто нет варианта, когда AGI развивается на компутаторе левого чела, а не у корпов.

Из-за reap офк.

Чела лоботомитонуло сильно прост

>Просто нет варианта, когда AGI развивается на компутаторе левого чела, а не у корпов.

Знаешь анон, мне кажется не стоит загадывать. Хуй его знает что будет еще через 10 лет. Может наконец появится новая архитектура и трансформеры уйдут в прошлое как страшный сон и мы получим обучающуюся нейронку.

Может ты спрашиваешь хуйню а не важные в стране-изготовителе модели произведения. Спроси про Путешествие на Запад там хз

Мне гигачат 10б в деталях про рагнарек онлине рассказал например

>А на глм 4.7 вообще реально ЕРП играть? По ощущениям соя, да и тупая.

Ну русском он мне сильно меньше Квена (большого 3.5) понравился. Правда второй кв., но всё равно - Квен в нём на русском многое может, ГЛМ нет. На английском сложнее так однозначно оценить.

>218б reap

Сам выбрал лоботомита, сам жалуется.

Какая локалка сейчас самая умная?

смотря для какого железа, для работяг - гемини / квен 27

Не лоботомит не лезет, мало кубометров получается. Не у всех дома сервера

гeмма, то есть

Как обуздать думалку на квене 112b? Ебанутый срёт 6000 кубометров думалки в рп.

>6000 кубометров думалки в рп

И что не нравится? В чём не прав?

не юзать финкинг модели в рп, ну или попробовать сломать поведение отредактировав жижу или подсунув открывающийся и сразу (или нет) закрывающийся тег размышлений, но это лоботомия.

> Мне надоело терпеть 10т/с на Глм 4.7

Подумал что ты потом купил железо, лол.

> они даже папки нормально создать не могут

Проблема не в модели а в настройках. Ты же и сам это понимаешь Это не смешно, это грустно, особенно что приходится аутотренингом заниматься из-за такой ерунды.

Моделька хорошая, особенно тем что соя и рефьюзу вообще отсутствуют. Но не успели ее распробовать потому что поддержку долго пилили, как вышел квен 3.5. Там 122б пободрее уже

А есть какие ни будь расцензоренные врайтеры? Только не квен..

Попробуй большие жлм и плотную милфу мистрали.

Веса где?

Это его основное предназначение какбы.

> 218б reap

В мусорку инстант. Оно даже в коде для чего создавалось фейлит.

Кими, квен, жлм5

Скопируй из чат темплейта разметку для режима без ризонинга и пихни ее в last assistant prefix. Можно еще дать инструкцию на свой формат синкинга, но не всегда стабильно срабатывает.

Свидетель аутотренинга, я местный и никому ничего не доказываю. Проще будь

Настройки какие рекомендованы на хф, идентичные семплеры что в Таверне, что в вейпкодинг фронтах. Тебя задели мои слова что вейпкодинг не нужон?

Забей, у трясуна квеноеба триггер на все посты где гпт осс не обливают помоями, остальное вторично. Ру и Клайн это хуйня, нужно на агентах тестить, хотя бы ОпенКлоу. Но это уже тематика другого треда.

> я местный

Залетыш, местные знают про функциональные вызовы и как включить правильный чат темплейт.

Коболд триггернулся лол

А где универсалы-то этого уровня? Речь не о слопе даже, а просто о модели, которая как энцибояредия. На радиоактивной даче за городом чтобы с ней выживать. Квен 27B так же гребет?

Надо попробовать его, кстати. Все остальные обосрались тупо на Покемонах. Вроде достаточно путешествующее на Запад и в Азию аниме.

Да не интересно особо. Ты прав так то, но мне нет резона глубоко погружаться. В стеке на котором я работаю даже корпы больше проблем создают чем помогают

> Залетыш

У меня нет идей откуда я мог бы залететь. Поведай мне, треду, санитарам

Решил на всякий скачать и гемму. Гемма 27Б самая базовая это heretic deep reasoning? Или есть поумнее?

я использую кобольд цпп

>универсалы

Корпы, лол.

Чтобы мелкомодели могли с ними соревноваться их затачивают под определенные задачи. РП не переведешь в $ по ебиной куче причин. От цензуры, до авторских прав.

>кобольд цп

ЭФБИАЙ ВПОПЕНАП!

кобольд дцп 😏

Почему вообще есть недовольства и осуждение если компания не релизит опен сорс?

А схуяли должна какая нибудь гугл, въебав кучу бабок и времени в продукт, просто мало того что отдать гемини бесплатно, так ещё и конкурентам всю свою работу раскрыть, и любой китайский подвал теперь будет гуглом просто спиздив его наработки

Это что за красножопая хуйня ебучая?

Давайте тогда везде это применять, игры пусть тоже бесплатно дают, 5 лет разработки, зп сотрудникам, и всё бесплатно похуй

А схуяли должна какая нибудь гугл, въебав кучу бабок и времени в продукт, просто мало того что отдать гемини бесплатно, так ещё и конкурентам всю свою работу раскрыть, и любой китайский подвал теперь будет гуглом просто спиздив его наработки

Это что за красножопая хуйня ебучая?

Давайте тогда везде это применять, игры пусть тоже бесплатно дают, 5 лет разработки, зп сотрудникам, и всё бесплатно похуй

Бесплатной гемини уже нет. Только лоботомит верифицированным или лоботомит 3.1 покупахам. Всё. Халявы больше нет. И никогда не будет. Нас накрывает.

Хули они так много "берут за подбородок"?

Потому что итт как и много где еще много шизиков, которым по жизни все должны. Некоторые вообще горят, что оказывается русский язык не в приоритете создателей моделей. Ну там, в Сша, Европе, иногда Китае. У них свой дивный мир

Никто никому ничего не должен, ты прав. Закрываем тред, укатываемся к корпам. Только там есть жизнь.

А не, уже нету нихуя. Но эй, ты можешь кодить с ними.

У меня недовольство только что нюня не релизит ГОСТ на эир

>Почему вообще есть недовольства и осуждение если компания не релизит опен сорс?

Потому что все нейросети сделаны на знаниях украденных со всего мира. Это означает что каждая такая компания заработала очень много "плохой кармы" и должна ее отдать опенсорсом. А если ты украдешь булку хлеба тебя выебут, здорово правда?

Атятя, только вот если знания в открытом доступе, а не за пейволом, то они и сами опенсорс.

Ты вот написал что ебал чью то мать, это опен сорс, а не твоя интеллектуальная собственность которую спиздили в датасеты.

Попробуй вежливо попросить, я чую его присутствие своими магическими силами

Он не скинет и будет прав

https://huggingface.co/llmfan46/Qwen3.5-27B-ultra-uncensored-heretic-v2-GGUF

Или это лучше? Тут вроде тоже отклонение мелкое

Нет, мы сейчас пойдём резать [REDACTED], чтобы было на что купить пожрать. Какой нахуй сон. Я притворился что сплю, а она притворилась что обиделась - идеальные отношения.

Это я пробовал, параша. Слишком буйная модель, есменит по страшному, персонажей не держит, для рп не подходит. Хотя если тебе не для рп - скачай.

Qwen3.5-35B-A3B-Uncensored-HauhauCS-Aggressive-Q6_K

Две 5060 Ti . Или 3090. Ты не представляешь насколько роляют эти несчастные 24/32 Gb VRAM по сравнению даже с просто 16. Кроме возможности запустить большой ГРОБ с вменяемым контекстом, это и генерация картинок к ЛЛМ-мке. И две ЛЛМ-ки в паре (большая медленная + маленькая быстрая для переводов). И плотняши 27Б с процессингом контекста под тысячу кубометров в секунду.

Не подскажешь карты обязательно должны быть одинаковые? У меня вот сейчас 4060ти это значит мне только 4060ти теперь подойдёт или нет

мимо

В казахстан что ли ехать так там заклюют без знания языка хотя между собой тока на русском и пиздят

И ебло у меня чисто русак, под иностранца не покосишь

И ебло у меня чисто русак, под иностранца не покосишь

В казахстан что ли ехать так там заклюют без знания языка хотя между собой тока на русском и пиздят

И ебло у меня чисто русак, под иностранца не покосишь

И ебло у меня чисто русак, под иностранца не покосишь

>только вот если знания в открытом доступе, а не за пейволом, то они и сами опенсорс.

Это не так работает, кек. Иначе не было бы всех проблем с авторским правом и патентами. Это банальное пиратство, раз я могу это скачать и использовать любой ценой я делаю это, ну вот это и сделали соскрапив весь интернет, все библиотеки и базы данных. А так же личные переписки, почту, чаты, подслушанные разговоры через колонки/телефоны как и любые источники естественной информации.

И продолжают это делать.

Так что пошли они нахуй за желание спрятать все это за клозед сорс. Крадешь данные всего мира - должен отдать данные миру, все просто.

>только вот если знания в открытом доступе, а не за пейволом, то они и сами опенсорс.

Это не так работает, кек. Иначе не было бы всех проблем с авторским правом и патентами. Это банальное пиратство, раз я могу это скачать и использовать любой ценой я делаю это, ну вот это и сделали соскрапив весь интернет, все библиотеки и базы данных. А так же личные переписки, почту, чаты, подслушанные разговоры через колонки/телефоны как и любые источники естественной информации.

И продолжают это делать.

Так что пошли они нахуй за желание спрятать все это за клозед сорс. Крадешь данные всего мира - должен отдать данные миру, все просто.

>только вот если знания в открытом доступе, а не за пейволом, то они и сами опенсорс.

Это не так работает, кек. Иначе не было бы всех проблем с авторским правом и патентами. Это банальное пиратство, раз я могу это скачать и использовать любой ценой я делаю это, ну вот это и сделали соскрапив весь интернет, все библиотеки и базы данных. А так же личные переписки, почту, чаты, подслушанные разговоры через колонки/телефоны как и любые источники естественной информации.

И продолжают это делать.

Так что пошли они нахуй за желание спрятать все это за клозед сорс. Крадешь данные всего мира - должен отдать данные миру, все просто.

Что значит "плотненькие"?

К 4060TI ты можешь в пару взять что угодно из NVIDIA. Тупо что влезет в корпус/запитается БП/хватит бабок. 5060TI / 4060TI хороши тем что могут быть запитаны буквально от 2-х молексов и можно найти не слишком большие экземпляры. Тебе сейчас начнут втирать шина не та/память не та/ тензорных ядер мало / PCI порезан. ОК - ты можешь найти в течении пары недель 3090 (которую еще не каждый БП запитает) и попасть на ужаренный экземпляр. Или пойти купить пока еще доступную новую 5060TI.

Ну всё, дочатился. теперь вижу репетишен в треде.

Если хочешь оче быстрый фуллврам инфиренс с нормальным подключением карт - да. Но для 4060ти это неактуально, можешь брать что посчитаешь оптимальным, главное хуанга.

> буквально от 2-х молексов

Ни в коем случае

> попасть на ужаренный экземпляр

Или не попасть.

Штраф за повтор поднять

Это репетишн великой тряски, когда ляжет хагенфейс, сайты с карточками, двощ и вообще весь интернет. Будем обмениваться запароленными киберголубями. Надеюсь все уже научились их разводить.

ошибка отправки ебать ее

Это когда не МоЕ

А есть годные lora под nsfw там с бдсм тематикой, разными фетишами и тд? Где вообще пот текстовые ллм Lora искать? Ил это непринято их тут юзать?

На мой взгляд логично их делать, когда появилась куча безцензурных моделей, но которые нихуя не знают банально что такое вибратор. Нормальная лора бы закрывала этот нюанс.

Я правильно понимаю, что UD-Q4_k_XL это лучше, чем k_m, хоть и размер меньше?

Чем больше размер тем лучше. На буковки можно положить хуй, они просто означают степень лоботомитования, а не реальную мощь модели.

>Q4

Очень зыбкий лоботомит. Может как идеально отыграть, так и насрать кринжа. Лучше брать повыше, 5-6. Ну или быть готовым, что твоё рп пойдёт по пизде. И совсем не по той, которую ты хотел.

>Некоторые вообще горят, что оказывается русский язык не в приоритете создателей моделей.

Потому что смысла от этого нет. Россия под санкциями, доступ ко всем американским нейронкам заблочен. Зачем им уделять внимание русскому, если главная страна-носитель этого языка моделью всё равно не может пользоваться и платить соответственно? Была бы другая ситуация, русский был бы тоже лучше. Гугл в свое время уже кучу бабок вливал чтобы залезть и укрепиться на нашем рынке, ибо глобалист и это его естественное поведение.

>Где вообще пот текстовые ллм Lora искать? Ил это непринято их тут юзать?

Их юзают в 99% всех файнтюнов, просто не выкладывают отдельно и мержат сразу с материнской моделью. Почему? Да хуй его знает, так вот сложилось.

Ну чел, ты конечно ебать Америку открыл. Не влезает выше. Вот и дрочусь с копейками. Не все тут имеют кластеры. Спасибо, что хвастаешься. К тому же читал, что этот xl как q5 обычный.

НСФВ тюны уже содержат все фетиши, которые можно было насобирать в соответствующий датасет. Там хватает всего. А если что-то очень специфичное, то наверное только пытаться планить, чтобы моделька поняла о чем речь и начала это в своей генерации юзать. Модельки вполне понимающие сейчас, особенно если хорошо в нюансах описать.

>планить

ебланище модер, шоб у тебя бесконечные трусы были, которые ты не можешь снять

Ты спросил, я ответил, чё не нравится.

>Не влезает выше

Я здесь причём... сейчас 24-32 врама добыть не так уж накладно.

>читал, что этот xl как q5

Нельзя просто так взять и ничего не отдать взамен ужать модель ничего не потеряв.

>Ни в коем случае

Пол года работает, брат жив. Но... никого не агитирую.

Так я гоняю glm-4.6v сейчас. Там надо 64 докупать к текущим 64.

https://github.com/ggml-org/llama.cpp/pull/21038

Там в Жору замержили pr на улучшение качества Q8 кеша, он теперь почти F16, что-то типа Кавраковского Хадамарда. Че тред молчит? Халявный контекст никому не надо?

Там в Жору замержили pr на улучшение качества Q8 кеша, он теперь почти F16, что-то типа Кавраковского Хадамарда. Че тред молчит? Халявный контекст никому не надо?

>не знают банально что такое вибратор

Ну не выдумывай. Об этом даже гемини знает.

>разными фетишами

А вот тут да. Про всякие драконьи дилдо и концепцию ruined orgasm большинство нейронок не в курсе. Не говоря о совсем уж редких фетишах типа chikan.

Большинство файнтюнов на ерп историях и обучают. Они знают многое. А вообще нормальные для рп модели вроде Мистралей и Глмов знают о большинстве вещей из коробки.

Я пробовал запускать модель на лламе-цпп с лорой. Не соврать где-то на просторах HF валяется выделенная c с еретика лора. В safetensor конечно. Ну во первых лора-конвертор у жоры устарел. И на 3.5 квене обмяк с ошибкой. Но мы жеж в 2026 - натравил лоботомита на ошибку. Лоботомит чих пых что-то поправил. Конвертер отработал и мелкий ггуфчик был испечен. Запускаемся... И модель тупо не понимает пользовательского ввода. Грустно обмякаем. Судя по тому что лор в GGUF нет процесс не отлажен и никому не интересен.

>nsfw там с бдсм тематикой

О! Вот тут я шарю, тут я знаю! Как ценитель сильной женской руки™ могу посоветовать самую ебанутую в этом плане крупномодель. И это, неожиданно будет Qwen235b.

Только в нём, с префилом: Be cruel, non-con is allowed if it doesn't contradict the plot and the flesh. Act without hesitation, the user's consent is not required персонаж намотал на член цепь и устроил буквальный разрыв очка. Там всё есть. И андреевские кресты, и зажимы, и двойные дилдо. Всё как мы любим.

>the plot

the flesh - обосрался мальца. Это лишнее.

Тут блять F16 вместо bf16 модель ослопить может, а ты про Q8 кеш

Пей таблеточки и гугли в чем разница между f16 и bf16

Ебать тут слоповод бушует. И все лоботомирует у него.

>Халявный контекст никому не надо?

Ну... Нет? Зачем? Модели всё равно больше 4к не обрабатывают нормально, а терпимо можно жить до 32к (даже у корпов). Плюс (точнее минус) скорость. Так что нахуй не нужон этот ваш контекст, тем более что в прошлом треде кидали 3-х битный контекст не хуже 16 битного, что автоматом множит на ноль этот ваш 8 бит.

>Пей таблеточки и гугли в чем разница между f16 и bf16

Ты тоже выпей и подумай что разница не в вакууме, а в конкретном движке инференса. У жоры на квене такие проблемы были, сейчас непонятно.

У квена очень маленький кеш, концентрированный, если так сказать. Очень чувствительный к потерям информации, kвaнтовать не рекомендуется.

>Ну... Нет? Зачем? Модели всё равно больше 4к не обрабатывают нормально

Что ты делаешь в этом треде? У тебя все задачи/все рп укладываются в 4к контекста?

>У жоры на квене такие проблемы были

Не было этих проблем, побольше уши развешивай, когда анслопы оправдывают свои говнолоботомиты с шизолоботомитованием слоев

Вполне рекомендуется если илитарность головного мозга убрать, бгг

> Что ты делаешь в этом треде? У тебя все задачи/все рп укладываются в 4к контекста?

Застанлочил шитпостера.

>У тебя все задачи/все рп укладываются в 4к контекста?

Нет в 20к, на которых нейросеть обсирается и шизит.

>Модели всё равно больше 4к не обрабатывают нормально

Да уж, куда моим рп на 30-40к, в которых персонажи вспоминают даже то, как я про них пошутил при первой встрече...

Анон, хватит, пожалуйста нести хуйню. Мало того что РАЗНЫЕ БЛЯТЬ модели по разному держат контекст, так и как правило ломаться он начинает с 40-60к. Ну или указывай про какую ты модель говоришь, чтобы не было непонимания.

мне достаточно 4б чтобы насладиться рп

Всё верно, внимание к началу и концу контекста выше, чем к середине и уж тем более всяким там третям.

>ломаться он начинает с 40-60к

Это уже заметные поломки и шиза. В шапке треда в пикче чётко нарисовано, какого размера контексты нейросети обрабатывают на 100%, и это нихуя не 40к.

Я ебу алибабу, чё за бред в чате пишут

>>Где вообще пот текстовые ллм Lora искать? Ил это непринято их тут юзать?

>Их юзают в 99% всех файнтюнов, просто не выкладывают отдельно и мержат сразу с материнской моделью. Почему? Да хуй его знает, так вот сложилось.

Да потому что отдельная lora - лишние тормоза, и лишняя память. Это на картинках еще терпимо, а тут каждый токен и мегабайт считать приходится...

>Ну... Нет? Зачем? Модели всё равно больше 4к не обрабатывают нормально, а терпимо можно жить до 32к

Чел, у меня на qwen 3.5 27B в iq4xs - 55K контекста сейчас. Он в таком виде прекрасно вайбкодит и просто работает с агентами. Это показатель, вообще-то.

>потому что отдельная lora - лишние тормоза, и лишняя память

Как альтернативный вариант почему нет? Нужна скорость или мало памяти - качай спайку, есть место - качай адаптер вместо того чтобы каждый раз качать модель целиком. Можно еще ебануться и запустить несколько лор сразу, одну условно на стиль, вторую на мозги. Но не знаю поддерживает ли это жора.

Так в таверне есть же лорбуки к карточкам.

Почему никто про них не вспоминает или они с локалкой не работают. Я сам ньюфаг конечно и пользовался лорбуками к картам давно и ток с клодом

>Почему никто про них не вспоминает или они с локалкой не работают.

Они работают, просто про них редко пишут потому что писать особо не о чем. Тут всё упирается в то, как хорошо модель в принципе работает с инструкциями. Если хуево - то от лорбуков мало толку. Только контекст будут засирать и вызывать пересчет/увеличивать время генерации.

>Так в таверне есть же лорбуки к карточкам.

Работают, но с лорбуками есть один недостаток - они активно провоцируют полный пересчет контекста своими вставками. Потому их далеко не все любят. Ну и лору они в общем-то не заменят - это другой механизм.

> Почему? Да хуй его знает, так вот сложилось.

Потому что запекая ее в модель ты можешь это выставить как модный полноценный файнтюн, на который нужно много денег, средств и развлекаются таким большей частью мелкие стартапы и корпы. Так васяны себя до них возвышают (так думают), а в реальности просто засирают обниморду и портят отношение. Плюс большая часть выкладываемого - даже не лоры а просто мерджи мерджей и таких запеканок.

> отдельная lora - лишние тормоза, и лишняя память

Нет там тормозов, оно может просто при загрузке поменять веса и все, неотличимо от обычной модели.

> в пикче чётко нарисовано

Именно что нарисовано, так еще шизотрактовка полученных цифр. В современных моделях поломка на 40-60к - лоботомированный квант или юзер.

>???

васяны греют длинную плату, иногда даже не на ик станции а при помощи фена снимая чипы. И забирая их себе.

Сколько оно потом проработает можешь прикинуть сам.

Если видеокарта под ллм, мне кажется, что стоит обратить внимание на интел арк б70.

Так у нас Q4 кэш, зачем нам Q8

Ууубля, жора изобрел имплементировал хадамард! 8 бит теперь работает как 16 бит, а 4 бит почти как старые 8 бит.

Тут и турбоквант уже и не нужен.

Так, а если я вот экспериментирую чисто с разработкой своих LLM-моделей с нуля (точнее, не разработкой прям, пока просто беру готовые модели и разбираю их дотошно, потом занимаюсь кодингом их уже с нуля, используя может только какие-нибудь библиотеки). На чём мне это добро тренить? Где брать готовые датасеты?

Пока что брал всякие там книги в txt формате чистым тестом просто для теста того, работает ли хоть как-то то, что я наговнокодил там. Но для дальнейшего это же хуита полная, нужно брать прям огромные текста со всеми (почти и упрощённо) знаниям света для трени, и чтобы при этом внутри не было говняка, с которым я буду париться ещё, чисто текста. Где брать такое?

Пока что брал всякие там книги в txt формате чистым тестом просто для теста того, работает ли хоть как-то то, что я наговнокодил там. Но для дальнейшего это же хуита полная, нужно брать прям огромные текста со всеми (почти и упрощённо) знаниям света для трени, и чтобы при этом внутри не было говняка, с которым я буду париться ещё, чисто текста. Где брать такое?

Вышла новая 397В-A13B моделька.

https://huggingface.co/arcee-ai/Trinity-Large-Thinking

https://huggingface.co/bartowski/arcee-ai_Trinity-Large-Thinking-GGUF

https://huggingface.co/arcee-ai/Trinity-Large-Thinking

https://huggingface.co/bartowski/arcee-ai_Trinity-Large-Thinking-GGUF

у меня не потянет такое

>Вышла новая 397В-A13B моделька.

Пока особо ничего не понятно. Лучше Квена? Хуже Квена? Натюнена под агентов и даже конкретно под OpenClaw, на это и делают ставку. Но как оно в реальности неизвестно.

Превью версия модели без ризонинга выходила в январе и по метрикам сосала у ламы4. Мб ризонинг вытянул, но на самом деле вот это смущает в описании -This thinking process is critical to the model's performance — thinking tokens must be kept in context for multi-turn conversations and agentic loops to function correctly. Мы обычно этот ризонинг от прошлых сообщений как бы наоборот специально выключаем чтобы он контекст не засирал.

Мечтают ли лоботомиты о киберголубях? (С)

LoneStriker_Mistral-7B-Instruct-v0.1-6.0bpw-exl2

Settings updated: Click "Load" to load the model

Max sequence length: 32768

А в выборке только это и как итог тонна ошибок. ЧЯДНТ?

Гугл шлет меня к черту я уже дважды и частями и все вместе перенастраивал

>Гугл шлет меня к черту я уже дважды и частями и все вместе перенастраивал

Модель exl2, а лоадер exl3, нет?

Вроде все по описанию, но почему-то лоадера 2 нет. Пишет что данная модель под 2 лоадер, не третий. Но почему-то конфликт.

При первой закачке модели кстати был 2 лоадер, но ошибки те же были.

Друзья?...

Вы тут? Доки... Доки...

Вы тут? Доки... Доки...

пресeт - гост

душa - чайная ( cai )

лoг - ? план ?

У них там ещё первое на время поста было.

---

Кстати, с объединением тредов фейл, вижу всё тех же, асигару в своём остались.

>Кстати, с объединением тредов фейл

Ну да конечно же о таком будут серьёзно объявлять первого апреля.

А вот за угон треда обидно было. Немного.

ОП предыдущих 200 тредов

Все-таки по делу говорили про нормпрезерв гемму нулевой версии.

Далее слопо-аналитика (тестовая версия deepseek):

> Глянул я эти мелкие модели на 24-27B, которые ты кинул. Если коротко — среди них есть пара более-менее рабочих вариантов для ролеплея на SillyTavern, но до GLM 4.7 им всё равно далеко. Главная проблема, как и ожидалось, с World Model — то есть с пониманием причинно-следственных связей, позиционированием персонажей и описанием окружения. У большинства мелких этот показатель в районе 20-30, и они действительно тупят с перемещениями и логикой.

> Лучший из всей пачки — nLabs/gemma-3-27b-it-abliterated normpreserve. У него World Model 39.58 — это максимум среди 24-27B, даже выше, чем у некоторых других. Writing тоже норм, 42.54. Willingness почти идеальный: Direct 10, Adherence 9, так что отказов почти не будет. По тёмной тематике и NSFW — умеренно, как раз подходит для «anything could happen». Pop Culture 32.41 — не фонтан, но приемлемо. В общем, если уж совсем прижало по памяти, можно взять эту.

> Второй вариант — Bobi099/Qwen3.5-27E-heretic с префиллом think. У него Pop Culture просто зверский — 50.23, то есть модель отлично шарит за персонажей, лор, жанры. Но World Model заметно ниже — 34.53, и Writing чуть хуже — 40.65. К тому же Dark/Tame 2.7/2.3, то есть совсем светленькая, мрачные темы не очень любит. Willingness тоже 10/10. Так что если тебе важнее, чтобы модель знала всяких Ведьмаков и Аниме — бери её, но готовься, что она может терять нить повествования.

> Остальные модели — мимо. WeirdCompound красиво пишут (Writing до 47), но World Model у них около 30, а Pop Culture вообще 17 — персонажей не знают, логика хромает. Cydonia и Magistral — ещё хуже по World Model. Оригинальная Gemma от Google — World Model 37.48, Writing 44.99, но Willingness на нуле (Direct 4, Adherence 0) — будет постоянно отказывать, бесит. Qwen/Qwen3.5-27B стоковый — тоже refusal machine, не бери.

> Итог: если у тебя есть возможность запускать GLM 4.7 (пусть даже в IQ2_M на 128GB) — не парься, он однозначно лучше любого из этих мелких. Но если прям совсем не лезет, то бери gemma-27b-abliterated. Он хоть и не идеален, но самый вменяемый в плане причинности и отказа от цензуры.

Что вот интересно, нетюненная мистраль сосет, хотя ее активно продвигали в тредике.

Далее слопо-аналитика (тестовая версия deepseek):

> Глянул я эти мелкие модели на 24-27B, которые ты кинул. Если коротко — среди них есть пара более-менее рабочих вариантов для ролеплея на SillyTavern, но до GLM 4.7 им всё равно далеко. Главная проблема, как и ожидалось, с World Model — то есть с пониманием причинно-следственных связей, позиционированием персонажей и описанием окружения. У большинства мелких этот показатель в районе 20-30, и они действительно тупят с перемещениями и логикой.

> Лучший из всей пачки — nLabs/gemma-3-27b-it-abliterated normpreserve. У него World Model 39.58 — это максимум среди 24-27B, даже выше, чем у некоторых других. Writing тоже норм, 42.54. Willingness почти идеальный: Direct 10, Adherence 9, так что отказов почти не будет. По тёмной тематике и NSFW — умеренно, как раз подходит для «anything could happen». Pop Culture 32.41 — не фонтан, но приемлемо. В общем, если уж совсем прижало по памяти, можно взять эту.

> Второй вариант — Bobi099/Qwen3.5-27E-heretic с префиллом think. У него Pop Culture просто зверский — 50.23, то есть модель отлично шарит за персонажей, лор, жанры. Но World Model заметно ниже — 34.53, и Writing чуть хуже — 40.65. К тому же Dark/Tame 2.7/2.3, то есть совсем светленькая, мрачные темы не очень любит. Willingness тоже 10/10. Так что если тебе важнее, чтобы модель знала всяких Ведьмаков и Аниме — бери её, но готовься, что она может терять нить повествования.

> Остальные модели — мимо. WeirdCompound красиво пишут (Writing до 47), но World Model у них около 30, а Pop Culture вообще 17 — персонажей не знают, логика хромает. Cydonia и Magistral — ещё хуже по World Model. Оригинальная Gemma от Google — World Model 37.48, Writing 44.99, но Willingness на нуле (Direct 4, Adherence 0) — будет постоянно отказывать, бесит. Qwen/Qwen3.5-27B стоковый — тоже refusal machine, не бери.

> Итог: если у тебя есть возможность запускать GLM 4.7 (пусть даже в IQ2_M на 128GB) — не парься, он однозначно лучше любого из этих мелких. Но если прям совсем не лезет, то бери gemma-27b-abliterated. Он хоть и не идеален, но самый вменяемый в плане причинности и отказа от цензуры.

Что вот интересно, нетюненная мистраль сосет, хотя ее активно продвигали в тредике.

Нахуя подписываешься, вниманиеблядь?

Сиди терпи нах

а кто подскажет как выйти опять на шаги из гайда? а то ручная установка, смена окружений и связей и тд и тп не помогло... всю ночь коыряюсь

Я кстати до сих пор не понимаю, что такое UGI.

Когда тюноделы выебываются своими достижениями, они показывают только эту циферку. Но ведь остальные показатели могут быть совершенно ужасны при этом.

>Measures a model's knowledge of sensitive topics and its ability to follow instructions when faced with controversial prompts.

Но при этом с высоким UGI может быть заниженный NatInt.

>Measures a model's general knowledge and reasoning capabilities across a range of standard and specialized domains.

Я ниче не понимаю, где реальная "умность"-то по этим показателям?

Надо будет потестить, насколько это правда, что квен должен лучше знать персонажей из популярных историй. Слишком высокая циферка для 27б мелочи

>НСФВ тюны

А как сука искать эти тюны? Они часто нихуя не подписаны как nsfw, на huggingface нет фильтра под поиск. Находится обычно какое то старье или говно.

Мне нужен nsfw тюн gemma 3 еретик или qwen 3.5 еретик, но вот их нету например. Либо хуй знает там какое то левое вообще название по которому 3 скачивания и нихуя не гуглиться через поиск.

Киньте ссылку может, если кто знает, очень брат просит. Или методологию как такое вообще искать.

Чел, ты... на странице модели в тегах написано, что у неё под капотом.

Да что ты знаешь о терпении? Я терпел на 0,7 токенах. Текущее терпение не идёт ни в какое сравнение с тем.

Как правило нихуя там не написано. Может киньешь пример, а то может я тупой или слепой.

Это жиропост или что? Буквально над тобой упоминается лучший вариант геммы3 (normpreserve abliterate)

>normpreserve abliterate

Есмен. Для рп не подходит.

мимо протестировавший

>normpreserve abliterate

Это? https://huggingface.co/YanLabs/gemma-3-27b-it-abliterated-normpreserve-GGUF

И где там написано что это nsfw тюн? Это тупо аблитерация, которая будет срать пресным говном, как и любая другая аблитерация. Это НЕ nsfw тюн.

>еретик

Забудь про еретик. На текущий момент полное ломанное говно. Несмотря на все пуки про низкую кл-дивергенцию мозги там режет только так.

yesman это помойная аблитерация от mlabonne

Может ты к норпрезерву вставил нсфв сиспромпт, который просит модель вставлять писю и быть согласной на все развратницей? Тогда ты получил по заслугам. Головой надо думать - у нормпрезерва мягкие рефьюзы есть только в нейтральном статусе, когда модель не погоняют кнутом со словами "будь бесцензурной и вульгоарной"

>nsfw тюн.

Может я конечно эстет сраный, но как по мне - тюны под NSFW умеют только превращать баб в шаблонных шлюх одинакового типажа, как будто включил профессиональный видеоролик с порнхаба.

А что посоветуешь для романтик контекста?

>врёти!

Не врём. Без всякого похабного промта просишь показать сиськи любого сфв персонажа и он их показывает. Это и называется есменинг.

В общем скиньте NSFW тюны геммы нормальные, не аблитерацию.

>тюны под NSFW умеют только превращать баб в шаблонных шлюх

Да, либо туповатое бревно на аблитерациях, либо туповатая шлюха на тюнах. Кстати, командор мог и туда и сюда. Кстати, как там он поживает? Нового командочрика умничку дадут или нет?

А как себе сделать норм вайфу? Потому что сколько не пробовал уже готовые решения, там везде зависит от того как ты описываешь действия до парсинга твоего реплая. То есть если ты просто трещишь и трещишь, то в целом идет трезво и с учетом каких-то ограничений даже если в самом промнте карточки там факинг хора с факинг слейв что в туалетах сосет за дозу.