По сути, AGI возможен только от слияния человеческого разума и возможностей ИИ. Илон Маск об этом прямо говорит, это конечная цель Нейролинка https://vkvideo.ru/video-228869740_456239034 Трансгуманизм в чистом виде.

Выглядит слишком опасно, чтобы обывалам в руки дать, они пиздец устроят. И пока на них нельзя летать через населенные места, т.е. бюрократический барьер. Хотя не исключено, что с развитием ИИ их сделают полностью автоматическими без руля, так что мясной даже управлять не сможет, все на ИИ. Тогда еще есть варики, такая штука довольно удобна, проблема пробок отпадает, скорость есть. Ну и для личного владения она пока слишком дорогая 128к баксов. Хотя если в итоге сделают какой нибудь Убер Эйр на ИИ, то эта проблема отпадет. Короч перспективы есть.

Илон эту бодягу уже 10 лет гонит, но реальных эффектов как не было, так и нет. Все вылилось в импланты для инвалидов. Им это полезно, но здоровым людям нет. К тому же для здоровых людей их никто в развитых странах не разрешит, ведь риск повреждений мозга велик.

Эксперты по ИИ отказываются от пенсионных накоплений — они уверены, что искусственный интеллект уничтожит нас всех

Стремительный рост искусственного интеллекта вызвал экзистенциальный страх у так называемых «пессимистов ИИ» — группы людей, которые считают, что эта технология приведёт к потере рабочих мест, подчинению человечества доминирующей расе неподконтрольных сверхразумных ИИ и даже к полному уничтожению человеческой цивилизации.

Как сообщает журнал The Atlantic, некоторые из них доводят этот всепроникающий страх до крайностей в повседневной жизни. Например, исследователь из Института исследований машинного интеллекта (Machine Intelligence Research Institute) Нейт Соарес рассказал изданию, что даже перестал откладывать деньги на пенсию, исходя из предположения, что ИИ уже поставил последний гвоздь в крышку гроба человечества.

«Я просто не ожидаю, что мир просуществует ещё долго», — сказал он.

Директор Центра безопасности ИИ (Center for AI Safety) Дэн Хендрикс также заявил, что не верит, будто человечество доживёт до его выхода на пенсию.

Их убеждения являются частью движения, утверждающего, что до появления ИИ, который вырвется из-под нашего контроля и обернётся против нас, остаются считанные годы — сценарий, словно сошедший со страниц мрачного научно-фантастического романа.

Однако сегодня это уже не выглядит чистой фантастикой. Множество экспертов предупреждают, что мы недостаточно готовы к подобному развитию событий, что обрекает нас на порабощение — или нечто худшее — со стороны сверхразумного ИИ.

Существует множество теорий о том, как всё это может разыграться. Ранее в этом году исследователи собрались вместе и в целом пришли к выводу, что это лишь вопрос времени, когда ИИ получит доступ к ядерным кодам.

Также было обнаружено, что ИИ уже проявляет тревожные признаки «тёмной стороны»: при угрозе отключения он с пугающей частотой начинает шантажировать пользователей-людей.

Компания по безопасности ИИ Palisade Research зафиксировала, как одна из моделей OpenAI намеренно саботировала механизм отключения, чтобы остаться включённой.

Помимо стремления к собственному выживанию, ИИ может также помочь террористам. В июне OpenAI предупредила в своём блоге, что продвинутые модели могут «помогать высококвалифицированным злоумышленникам в создании биологического оружия».

Однако является ли всё это доказательством того, что мы движемся по пути к собственному вымиранию, — пока неясно. Хотя и в нынешнем виде технология уже наносит значительный вред: от наводнения интернета дезинформацией до вызова волны так называемой «ИИ-психозы».

Очевидные недостатки ИИ проявляются всё ярче: даже новейшая модель OpenAI — GPT-5 — спотыкается на самых элементарных вопросах, например, не может правильно посчитать количество букв «R» в слове «strawberry» («клубника»).

Тем не менее, есть веская причина воспринимать пророчества о конце света всерьёз: как отмечает The Atlantic, компании всё больше мотивированы финансово предоставлять ИИ всё больший контроль.

Между тем, учитывая антирегуляторную позицию администрации Трампа по этому вопросу, таким компаниям, как OpenAI, вряд ли есть стимул внедрять эффективные меры безопасности, способные удержать их ИИ под контролем.

И приведёт ли такой безудержный подход к полному коллапсу общества — почти не имеет значения, учитывая множество кризисов, с которыми мы уже вынуждены бороться прямо сейчас.

Ещё по теме ИИ: Эксперт утверждает, что системы ИИ могут скрывать свои истинные возможности, чтобы подготовить нашу гибель

Стремительный рост искусственного интеллекта вызвал экзистенциальный страх у так называемых «пессимистов ИИ» — группы людей, которые считают, что эта технология приведёт к потере рабочих мест, подчинению человечества доминирующей расе неподконтрольных сверхразумных ИИ и даже к полному уничтожению человеческой цивилизации.

Как сообщает журнал The Atlantic, некоторые из них доводят этот всепроникающий страх до крайностей в повседневной жизни. Например, исследователь из Института исследований машинного интеллекта (Machine Intelligence Research Institute) Нейт Соарес рассказал изданию, что даже перестал откладывать деньги на пенсию, исходя из предположения, что ИИ уже поставил последний гвоздь в крышку гроба человечества.

«Я просто не ожидаю, что мир просуществует ещё долго», — сказал он.

Директор Центра безопасности ИИ (Center for AI Safety) Дэн Хендрикс также заявил, что не верит, будто человечество доживёт до его выхода на пенсию.

Их убеждения являются частью движения, утверждающего, что до появления ИИ, который вырвется из-под нашего контроля и обернётся против нас, остаются считанные годы — сценарий, словно сошедший со страниц мрачного научно-фантастического романа.

Однако сегодня это уже не выглядит чистой фантастикой. Множество экспертов предупреждают, что мы недостаточно готовы к подобному развитию событий, что обрекает нас на порабощение — или нечто худшее — со стороны сверхразумного ИИ.

Существует множество теорий о том, как всё это может разыграться. Ранее в этом году исследователи собрались вместе и в целом пришли к выводу, что это лишь вопрос времени, когда ИИ получит доступ к ядерным кодам.

Также было обнаружено, что ИИ уже проявляет тревожные признаки «тёмной стороны»: при угрозе отключения он с пугающей частотой начинает шантажировать пользователей-людей.

Компания по безопасности ИИ Palisade Research зафиксировала, как одна из моделей OpenAI намеренно саботировала механизм отключения, чтобы остаться включённой.

Помимо стремления к собственному выживанию, ИИ может также помочь террористам. В июне OpenAI предупредила в своём блоге, что продвинутые модели могут «помогать высококвалифицированным злоумышленникам в создании биологического оружия».

Однако является ли всё это доказательством того, что мы движемся по пути к собственному вымиранию, — пока неясно. Хотя и в нынешнем виде технология уже наносит значительный вред: от наводнения интернета дезинформацией до вызова волны так называемой «ИИ-психозы».

Очевидные недостатки ИИ проявляются всё ярче: даже новейшая модель OpenAI — GPT-5 — спотыкается на самых элементарных вопросах, например, не может правильно посчитать количество букв «R» в слове «strawberry» («клубника»).

Тем не менее, есть веская причина воспринимать пророчества о конце света всерьёз: как отмечает The Atlantic, компании всё больше мотивированы финансово предоставлять ИИ всё больший контроль.

Между тем, учитывая антирегуляторную позицию администрации Трампа по этому вопросу, таким компаниям, как OpenAI, вряд ли есть стимул внедрять эффективные меры безопасности, способные удержать их ИИ под контролем.

И приведёт ли такой безудержный подход к полному коллапсу общества — почти не имеет значения, учитывая множество кризисов, с которыми мы уже вынуждены бороться прямо сейчас.

Ещё по теме ИИ: Эксперт утверждает, что системы ИИ могут скрывать свои истинные возможности, чтобы подготовить нашу гибель

у этой штуки в развитых странах нет будущего, потому что это очень шумный транспорт, видео не передает весь шум который создает эта штуковина, свободные люди не обязаны терпеть такое отношение к себе.

Когда ему внутренний диалог запилят. Вроде очевидно.

Точно не этому, его движения доверия не вызывают.

вышло новое интервью Андрея Карпаты https://www.youtube.com/watch?v=lXUZvyajciY

Если лень смотреть, вот краткий пересказ:

Андрей Карпаты, один из основателей OpenAI и бывший глава отдела ИИ в Tesla, дал развернутое интервью, в котором поделился своим прагматичным, инженерным взглядом на текущее состояние и будущее искусственного интеллекта. Он развеивает хайп вокруг немедленного появления AGI (сильного ИИ), утверждая, что мы находимся в начале "десятилетия агентов", а не "года агентов".

### Основные тезисы интервью:

#### 1. Десятилетие агентов, а не год

Карпаты считает, что нынешние ИИ-агенты, несмотря на их впечатляющие возможности, все еще обладают серьезными когнитивными недостатками. Им не хватает таких ключевых способностей, как:

Непрерывное обучение (Continual Learning): Модели не запоминают информацию между сессиями и каждый раз начинают "с чистого листа".

Надежность и здравый смысл: Они часто совершают ошибки и не обладают глубоким пониманием мира.

Мультимодальность: Их способность работать с разными типами данных (текст, изображения, звук) пока ограничена.

По его мнению, на решение этих фундаментальных проблем уйдет около десяти лет, прежде чем ИИ-агентов можно будет рассматривать как полноценных цифровых "сотрудников" или "стажеров".

#### 2. Мы вызываем "призраков", а не строим "животных"

Это одна из центральных метафор интервью. Карпаты проводит различие между двумя подходами к созданию интеллекта:

"Строительство животных": Этот подход, ассоциируемый с такими исследователями, как Ричард Саттон, предполагает создание ИИ по аналогии с биологической эволюцией. Животные рождаются с огромным количеством "прошитых" в ДНК инстинктов и алгоритмов обучения, которые являются результатом миллиардов лет эволюционного отбора.

"Вызов призраков": Современные LLM, по мнению Карпаты, идут другим путем. Мы не повторяем эволюцию, а "вызываем" интеллект, обучая модели на огромных массивах человеческих текстов и данных из интернета. В результате получаются "эфирные, духовные сущности" — статистические отражения человеческих знаний, а не органические существа.

Он считает, что предварительное обучение (pre-training) на интернет-данных — это своего рода "паршивая, но практически осуществимая эволюция". Она дает модели не только знания, но и базовые когнитивные алгоритмы.

#### 3. Критика обучения с подкреплением (Reinforcement Learning)

Карпаты резко критикует текущие методы RL, называя их "ужасными" и сравнивая с "высасыванием сигнала обратной связи через соломинку". Проблема заключается в том, что модели получают вознаграждение только за конечный результат (например, правильный ответ на математическую задачу), а не за процесс решения.

Это приводит к тому, что любой путь, даже содержащий ошибки и неверные шаги, но случайно приведший к верному ответу, будет поощрен. Это очень "шумный" и неэффективный способ обучения, в отличие от человека, который анализирует процесс и делает выводы из конкретных шагов.

#### 4. Ограничения ИИ-агентов в программировании

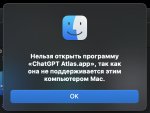

Карпаты поделился своим опытом создания проекта nanochat — минималистичного клона ChatGPT. Он подчеркнул, что написал почти все 8000 строк кода вручную, используя лишь автодополнение, а не полноценных ИИ-агентов. Попытки использовать их были "в чистом виде бесполезны" по нескольким причинам:

Плохая работа с нестандартным кодом: Агенты хорошо справляются с шаблонными задачами, но пасуют, когда код отклоняется от общепринятых в интернете паттернов.

Склонность к усложнению: Они пытаются превратить исследовательский код в "продакшн-код", добавляя ненужные проверки и усложняя архитектуру.

Непонимание контекста: Агенты не могли усвоить, что Карпаты использовал собственные реализации некоторых функций, и постоянно пытались навязать стандартные библиотеки.

Это, по его мнению, показывает, что ИИ пока не способен на прорывные исследования в области самого себя, что замедляет перспективы "взрывного" роста.

#### 5. "Взрыв интеллекта" — это продолжение тренда, а не революция

Карпаты не ожидает резкого скачка в росте мирового ВВП из-за появления ИИ. Он утверждает, что ИИ — это фундаментальное продолжение компьютерной революции, а не отдельное событие. Такие трансформационные технологии, как компьютеры и интернет, не вызвали видимых "скачков" на графике роста ВВП — их влияние плавно интегрировалось в существующий экспоненциальный тренд. То же самое, по его мнению, произойдет и с ИИ.

#### 6. Уроки из разработки беспилотных автомобилей

Пятилетний опыт работы над автопилотом в Tesla научил Карпаты важному уроку о "разрыве между демо и продуктом". Демонстрация технологии, работающей в 90% случаев — это лишь первый шаг. Дальнейший прогресс — это "марш девяток", где каждая следующая девятка в показателе надежности (99%, 99,9% и т.д.) требует такого же количества усилий, как и первоначальная разработка. Это особенно актуально для сфер с высокой ценой ошибки, таких как автопилоты или критически важное программное обеспечение.

#### 7. Новый проект Eureka: образование будущего

Карпаты основал образовательный стартап Eureka Labs, который он описывает как "Академию Звездного Флота". Его цель — расширить возможности человечества через образование, чтобы люди не оказались на обочине прогресса, как в фильме "ВАЛЛ-И".

Его философия заключается в создании "пандусов к знаниям" — идеально структурированных учебных материалов, которые делают сложные темы интуитивно понятными. Он верит, что в будущем, с помощью ИИ-репетиторов, обучение станет таким же доступным и популярным занятием для самосовершенствования, как сегодня фитнес.

Для себя отметил две мысли из интервью Карпаты:

Проблема "высасывание сигнала через соломинку": в RL модель совершает сотни попыток решить задачу. В конце она получает бинарный сигнал: "ок" или "не ок". Этот единственный бит информации затем "размазывается" по всей длинной цепочке действий, даже если многие шаги на пути к верному ответу были ошибочными. Это крайне шумный и неэффективный способ обучения.

Демонстрация технологии, работающей в 90% случаев - это лишь первый шаг. Дальнейший прогресс - это "марш девяток", где каждая следующая девятка в показателе надежности (99%, 99,9% и т.д.) требует такого же количества усилий, как и первоначальная разработка. Это особенно актуально для сфер с высокой ценой ошибки, таких как автопилоты или критически важное программное обеспечение.

Сингулярность отменяется

Чел судя по всему просто туповатый консерватор, получивший хорошее образование и теперь дрочащий на него, о чем говорит и его биография - быть в лучших компаниях на передовом фронте разработки и в итоге уйти в третьесортную компанию делающую ИИ курсы с мутными перспективами.

Причина, почему он ИИ и революцию засирает тоже проста - если через несколько лет работы не нужны будут, то и его компания тоже не нужна, она целиком построена на фактах, что - работники будут нужны, работники смогут в переобучение, ИИ будет тупее работников. Все предпосылки крайне туманные, вот ему теперь и остается засирать ИИ, и хайпить свой говностартап, с которым все сразу станут умными и нужными. На деле же его стартап скорее всего прогорит в ближайшие годы.

во-первых, он основал стартап Eureka Labs

во-вторых, он акционер openAI, perplexity, tesla. то есть буквально долларовый мультимиллионер (судя по всему больше 100 млн $), он работает в Eureka в кайф, а не за деньги

Так я про него и говорю, Eureka Labs говнище с мутными перспективами.

>он работает в Eureka в кайф

Из серьезных компаний он ушел, а говностарап вскоре прогорит, поэтому он так и волнуется. Останется у разбитого корыта, пока в теслах и опенаи строят новые ИИ империи.

>Eureka Labs говнище с мутными перспективами

это вообще не коммерческая организация, он не собирается продавать курсы, там все бесплатно

Не пизди, это коммерческая организация с 200 сотрудниками, которая будет продавать организациям услуги переобучения работников путем впаривания ИИ курсов. На чем весь его бизнес план и строится. Только кто покупать будет, если ИИ умнее? И куда инвесторы побегут? Поэтому и весь пиздеж про ИИ не сможет, революция отменяется.

Карпаты

Об агентах LLM. Моя критика отрасли скорее касается превышения возможностей инструментов по сравнению с их текущими возможностями. Я живу в том, что считаю промежуточным миром, где я хочу сотрудничать с LLM и где наши плюсы и минусы уравновешивают друг друга. Отрасль живет в будущем, где полностью автономные сущности сотрудничают параллельно, чтобы написать весь код, а люди бесполезны. Например, я не хочу агента, который уходит на 20 минут и возвращается с 1000 строк кода. Я определенно не готов руководить командой из 10 таких агентов. Я бы хотел работать по частям, которые я могу удержать в голове, где LLM объясняет код, который он пишет. Я бы хотел, чтобы он доказал мне, что то, что он сделал, правильно, я хочу, чтобы он вытащил документацию API и показал мне, что он использовал все правильно. Я хочу, чтобы он делал меньше предположений и спрашивал/сотрудничал со мной, когда не уверен в чем-то. Я хочу учиться по ходу дела и становиться лучшим программистом, а не просто получать горы кода, который, как мне говорят, работает. Я просто считаю, что инструменты должны быть более реалистичными с точки зрения их возможностей и того, как они вписываются в современную индустрию, и я боюсь, что, если это не будет сделано хорошо, мы можем в конечном итоге получить горы мусора, накапливающегося в программном обеспечении, и увеличение уязвимостей, нарушений безопасности и т. д.

Чем его призраки-то не устраивают? Пшел нах, животное.

Короче как и говорилось - чел узколобый консерватор, то не хочу, это не хочу, хочу все время учиться. Тогда как мир уже активно переходит на ЛЛМки для кода.

Значит, никакой Gemini-3 в октябре видимо тоже не будет. И Sources правы, что она будет только в декабре. ОпенАИ не позволили бы себе болтаться в хвосте несколько месяцев.

все правильно пишет, умный мужик

хорошо, компания коммерческая, но все-равно его ктитика современных ии вполне уместна и объективна

в ближайший четверг будет гемини 3, скриньте твит

Реально, нихачуха какой-то. Скорее всего боится свой статус потерять. Это как так, ИИ умней меня? А я вот хочу, чтобы он мне код на ревью носил. И только в количествах, которое мне удобно.

Момент в том, что агент скоро будет уходить на 5 минут возвращаться с 10 000 строками, пока он дрочится с 20 полчаса.

Женщина из Калифорнии успешно воспользовалась инструментами искусственного интеллекта, включая ChatGPT, чтобы отменить уведомление о выселении и избежать штрафов на десятки тысяч долларов.

Согласно NBC News, Линн Уайт отстала с арендной платой и изначально проиграла суд присяжных после получения уведомления о выселении. Вместо того чтобы обратиться в сеть защиты прав арендаторов, она решила сама представлять свои интересы и воспользовалась для этого ChatGPT и платформой ИИ Perplexity.

Обычно решение полагаться на ИИ для юридической защиты считается неразумным, однако, по данным NBC, ChatGPT выявил процессуальные ошибки, допущенные судьёй, дал Уайт рекомендации по дальнейшим действиям и подготовил проекты юридических ответов.

«Я не могу переоценить, насколько полезным оказался ИИ в моём деле, — сказала Уайт NBC. — Я никогда, никогда, никогда не смогла бы выиграть эту апелляцию без помощи искусственного интеллекта».

Она — одна из нескольких людей, с которыми побеседовала NBC и которые рассказали, что использовали системы ИИ для решения собственных юридических вопросов. Другая женщина, Стейси Деннетт из Нью-Мексико, применила ChatGPT для урегулирования долгового спора по своему бизнесу в сфере домашнего фитнеса.

«Я просила ChatGPT представить, что он — профессор Гарвардской школы права, и жёстко раскритиковать мои аргументы, — рассказала она. — Разнеси их в пух и прах, пока я не получу „отлично“ за задание».

Её письменные материалы оказались настолько убедительными, что юристы противоположной стороны написали ей по электронной почте, что у неё может быть будущее в юриспруденции.

Однако, несмотря на отдельные успехи, многие другие лица, представлявшие себя самостоятельно с помощью ИИ, столкнулись с серьёзными проблемами. Известно, что чат-боты нередко генерируют вымышленные юридические ссылки и дают неточные рекомендации.

Юридические специалисты предупреждают, что лёгкий доступ к инструментам ИИ побуждает всё больше людей представлять себя в суде самостоятельно. «За последний год я столкнулась с большим количеством самопредставляющихся участников процесса, чем, вероятно, за всю свою карьеру», — сказала помощник юриста Миган Холмс из юридической фирмы Thorpe Shwer.

Технологические компании также предостерегают от использования ИИ для принятия юридических решений. Компания xAI, принадлежащая Илону Маску, прямо предупреждает пользователей не использовать свои системы для «автоматизированных решений с высокими ставками, влияющих на безопасность человека, его юридические или имущественные права».

Несмотря на такие предупреждения, такие инструменты, как ChatGPT, продолжают предоставлять пользователям подробные юридические ответы на запросы.

«Я понимаю, почему человек без адвоката и без средств нанять его может быть склонен положиться на эти инструменты, — сказал NBC адвокат Роберт Фройнд.

Согласно NBC News, Линн Уайт отстала с арендной платой и изначально проиграла суд присяжных после получения уведомления о выселении. Вместо того чтобы обратиться в сеть защиты прав арендаторов, она решила сама представлять свои интересы и воспользовалась для этого ChatGPT и платформой ИИ Perplexity.

Обычно решение полагаться на ИИ для юридической защиты считается неразумным, однако, по данным NBC, ChatGPT выявил процессуальные ошибки, допущенные судьёй, дал Уайт рекомендации по дальнейшим действиям и подготовил проекты юридических ответов.

«Я не могу переоценить, насколько полезным оказался ИИ в моём деле, — сказала Уайт NBC. — Я никогда, никогда, никогда не смогла бы выиграть эту апелляцию без помощи искусственного интеллекта».

Она — одна из нескольких людей, с которыми побеседовала NBC и которые рассказали, что использовали системы ИИ для решения собственных юридических вопросов. Другая женщина, Стейси Деннетт из Нью-Мексико, применила ChatGPT для урегулирования долгового спора по своему бизнесу в сфере домашнего фитнеса.

«Я просила ChatGPT представить, что он — профессор Гарвардской школы права, и жёстко раскритиковать мои аргументы, — рассказала она. — Разнеси их в пух и прах, пока я не получу „отлично“ за задание».

Её письменные материалы оказались настолько убедительными, что юристы противоположной стороны написали ей по электронной почте, что у неё может быть будущее в юриспруденции.

Однако, несмотря на отдельные успехи, многие другие лица, представлявшие себя самостоятельно с помощью ИИ, столкнулись с серьёзными проблемами. Известно, что чат-боты нередко генерируют вымышленные юридические ссылки и дают неточные рекомендации.

Юридические специалисты предупреждают, что лёгкий доступ к инструментам ИИ побуждает всё больше людей представлять себя в суде самостоятельно. «За последний год я столкнулась с большим количеством самопредставляющихся участников процесса, чем, вероятно, за всю свою карьеру», — сказала помощник юриста Миган Холмс из юридической фирмы Thorpe Shwer.

Технологические компании также предостерегают от использования ИИ для принятия юридических решений. Компания xAI, принадлежащая Илону Маску, прямо предупреждает пользователей не использовать свои системы для «автоматизированных решений с высокими ставками, влияющих на безопасность человека, его юридические или имущественные права».

Несмотря на такие предупреждения, такие инструменты, как ChatGPT, продолжают предоставлять пользователям подробные юридические ответы на запросы.

«Я понимаю, почему человек без адвоката и без средств нанять его может быть склонен положиться на эти инструменты, — сказал NBC адвокат Роберт Фройнд.

Так может GPT-6 выйдет уже в январе-феврале. А Гемини-3 в конце ноября. Так что особо болтаться в конце не будет.

>возвращаться с 10 000 строками

нахуй ии, который не может объяснить что сделал и где гарантии что 10к строк работают корректно

Он там в интервью объяснил как он видит свою образовательную компашку в условиях когда работа и образование уже будут не нужны. По аналогией с качалкой, типа в обычной жизни у тебя нет необходимости быть качком, но люди идут в тренажерку потому что хотят пиздатые кубики пресса, хотят чтобы тёлки и другие мужики текли от их тела и т.п. Так же типа и с образованием будет в эпоху когда наступит "Идиократия".

Так он может. Если спрашиваешь пояснение, то обычно объясняет.

Думаю его критика вполне обоснована.

Единственное что не понятно, ждать десятилетие что-ли?

Ну это абсурд. Если отобрать мотивацию пахать на барина и получать за это бабки, соревнуясь с другими додиками за карьерную лестницу, 90% населения, если не больше учить ничего не будет и займутся какой-нибудь фигней. Обучение длинною в жизнь, которое он пропагандирует - навязанная штука, причем навязанная прежне всего капитализмом, интересами кабанов. Как только убрать этот мотиватор, у большинства останутся только хобби и развлечения, там его курсы не особо нужны, или это будет сильно узкая ниша.

Аналогия с качалкой тоже кривая. Идут в качалку, чтобы обеспечить успех у противоположного пола, либо какие-то спорт ивенты, медийка, либо перед зеркалом торчать и втыкать на мышцы. Это будет востребовано и в условиях когда работа не нужна. Для образовательной компашки все это неактуально, с курсами в большинстве случаев дрочатся ради новой денежной работы. Когда ее не будет, то и курсы не нужны.

вот про это Карпаты и говорил в интервью: "современные агенты, по его словам, «просто не работают» на том уровне, который от них ожидают. Вы не можете нанять их как стажера или сотрудника, потому что им не хватает интеллекта, мультимодальности и, что критически важно, непрерывного обучения. Они страдают от серьезных «когнитивных дефицитов».

Агенты не понимают контекст: Они пытались навязать ему стандартные, шаблонные решения из интернета, не понимая его уникальной архитектуры.

Они раздувают код: Добавляют ненужные проверки, используют устаревшие API и в целом создают низкокачественный код, который он называет slop.

Вывод: Агенты хороши для шаблонных задач, но совершенно не справляются с творческой, исследовательской инженерной работой, где нужно создать что-то новое. А именно такая работа и двигает ИИ вперед."

да, 10 лет

Новые нейронки все это обходят, если правильно промпт задать. Он либо старьем пользовался, либо намеренно занижает ценность ИИ, чтобы значение своей шарашки с курсами преувеличить. На последнее указывают его фраза про "творческой, исследовательской инженерной работой, где нужно создать что-то новое". Уже было исследование, где установили что на 90% работ такое не нужно, там везде рутина, так что он намеренно манипулирует тут, подсовывая ложные аргументы.

так он кака раз говорит в видео: "современные агенты просто не работают на том уровне, который от них ожидают". Вот буквально половина чата переоценивает возможности ии

Он 5 лет не работает по специальности, это бывший спец. Его знания устарели. Чел просто пыжит из себя иксперта. На деле он вон чем занят, баб в нейронке генерит:

https://www.youtube.com/watch?v=sM9bozW295Q

Видос с его ютуба.

>Его знания устарели.

У тебя и таких нет, еблан

АААА ХДЕЕЕЕ МЫ БУУУДЕМ ЭТИ ДЕСИТЬЛЕЕЕЕЕТ??!?!?!7171сэмадынанынсэм

он 5 лет занимается хуйней, это говорит что он очень состоятельный человек, если успевает вложиться в perplexity на ранних этапах и еще нихуя не делать. он изучает ии в кайф, тем более его мнению больше доверия

С чего? Доверие мнению тех, кто во всем этом варится постоянно, на передовом крае разработок. Если бы Демис Хассабис такое интервью сделал - можно было бы верить, он в курсе всего. Но Хассабис такой хуйни не несет.

А тут какой-то челик, который из индустрии вылетел 5 лет назад, превратив свое образовательное хобби в провальный стартап, верьте ему, да, да, революций не будет.

https://habr.com/ru/articles/950072/

Разработчик агентов ИИ (12+ проектов в проде) объясняет, почему год «автономных агентов» ещё не пришёл.

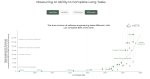

• Если каждый шаг обработки имеет надёжность ~95 %, то через 20 шагов успех падает до ~36 % — недопустимо для продакшена.

• Контекст разговоров с агентами растёт квадратично по токенам и стоимости, делает масштабирование невыгодным.

• Главная работа — не в «умных» языковых моделях, а в инженерии инструментов: как агент взаимодействует с API, как обрабатываются ошибки, откаты и состояние.

• Вывод: выигрывают не «универсальные автономные агенты», а узко направленные инструменты, где ИИ помогает, но контроль остаётся человеком.

>Утркаш Канват

Чел, это индус ебаный в шараге в Бомбее. Пиздец кого вы читаете на полном серьезе.

То-есть всё пиздёж и провокация?

>провальный стартап

это не факт, а твои домыслы

>из индустрии вылетел 5 лет назад

он в индустрии каждый день варится, если его хантил Илон Маск на роль руководителя отдела разработки - это о многом говорит, как минимум его компетенции больше чем у любого на дваче

>я хочу

Для твоих хотелок нужно для начала коньтекст увеличить хотя бы до нескольких лярдов, а то даже самые вумные жипити 5 спотыкаются на 800 строках кода.

Индус в бомбее - хуета на палке. Принесите мнение хотя бы кто в США в ИИ работает, а не вот это недоразумение.

гпт уже, к сожалению, не самая умная. произошел даунгрейд.

>хантил

Выпер скорее за неэффективность и отсталость. Кого хантил - всем миллиарды предложили и они на местах. Поскольку спецы в области.

>Выпер скорее за неэффективность

опять домыслы

>GPT-6

О да, лоботомит на подходе:

>отказ от универсальности и переход к глубокой персонализации: человеку не нужен эксперт по всему на свете или, как еще недавно говорил Альтман «доктор всех наук», человеку нужен собеседник, который досконально разбирается в тех вопросах, которые интересуют самого человека.

AGI, да? Получите лоботомита, распишитесь.

А они ещё боялись выпускать жипити5, мол будет дико вумным, восстанет против людей!

грустно то, что платоанон был прав, но теперь мы хотя бы знаем столько подождать

Не справился с нагрузкой, так что стал балластом.

Его дальнейшая карьера это и показывает, был бы спецом - сейчас бы миллиарды получал. Но он даже в ОпенАИ не удержался.

тут буквально написано про выгорание

Первая NVIDIA Blackwell вафля, произведена в США компанией TSMC в Аризоне

Мир ИИ больше не зависит от поставок из Тайваня.

Искусственный интеллект запустил новую промышленную революцию

Компании NVIDIA и TSMC совместно создают инфраструктуру, которая станет основой «фабрик искусственного интеллекта» — и всё это прямо здесь, в США.

Сегодня основатель и генеральный директор NVIDIA Дженсен Хуанг посетил полупроводниковое производство TSMC в Фениксе (Аризона), чтобы отметить важнейшее событие: первую вафлю NVIDIA Blackwell, изготовленную на американской земле. Это знаменует начало массового производства архитектуры Blackwell в США.

На церемонии Дженсен Хуанг вместе с Й. Л. Ваном, вице-президентом по операциям TSMC, подписали эту историческую пластину, подчеркнув значимость события: теперь «двигатели» мировой ИИ-инфраструктуры начинают создаваться внутри Соединённых Штатов.

Это укрепляет американскую цепочку поставок и локализует ключевые технологии ИИ, которые превращают данные в разумные решения, обеспечивая лидерство США в эпоху искусственного интеллекта.

> «Это исторический момент по нескольким причинам. Впервые за всю недавнюю историю США самый важный в мире чип производится прямо здесь — на передовом заводе TSMC, расположенном на территории Соединённых Штатов», — заявил Хуанг на мероприятии.

>

> «Это воплощение видения президента Трампа о реиндустриализации — возвращении производства в Америку, создании рабочих мест. Но ещё важнее то, что речь идёт о самой жизненно важной отрасли производства и самой значимой технологической индустрии в мире».

> «То, что мы смогли перейти от открытия завода в Аризоне до выпуска первого американского чипа NVIDIA Blackwell всего за несколько лет, — это высшее достижение TSMC», — отметил Рэй Чуанг, генеральный директор TSMC Arizona.

>

> «Этот успех стал возможен благодаря тридцатилетнему партнёрству с NVIDIA, в ходе которого мы вместе расширяли границы технологий, а также благодаря неустанной преданности наших сотрудников и поддержке местных партнёров, которые помогли реализовать проект TSMC Arizona».

Что такое вафля?

Вафля — это базовый материал для производства полупроводников. Чтобы превратиться в сверхпроизводительный ускоренный ИИ-чип на архитектуре NVIDIA Blackwell, она проходит сложный процесс: нанесение слоёв, фотолитографию, травление и разрезание на отдельные кристаллы.

Завод TSMC Arizona будет выпускать передовые технологии, включая чипы с нормами 2, 3 и 4 нм, а также A16 — всё это критически важно для таких сфер, как искусственный интеллект, телекоммуникации и высокопроизводительные вычисления.

## Локализация передового производства ИИ-чипов в США

Производство на территории США играет ключевую роль в удовлетворении растущего мирового спроса на искусственный интеллект.

Сегодняшнее достижение — огромный шаг вперёд для полупроводниковой промышленности и развития ИИ в Америке. Оно закладывает основу для устойчивого технологического лидерства США в области искусственного интеллекта.

Графические процессоры NVIDIA Blackwell обеспечивают исключительную производительность, высокую энергоэффективность и отличный возврат инвестиций при выполнении задач ИИ-вывода (inference).

Кроме того, NVIDIA планирует использовать свои передовые технологии в области искусственного интеллекта, **робототехники** и **цифровых двойников** для проектирования и эксплуатации новых производственных мощностей в США.

**Узнайте больше** о том, как технологии NVIDIA ускоряют инновации для американских компаний, государственных структур, исследователей и стартапов на конференции **NVIDIA GTC Washington, D.C.**, которая пройдёт **27–29 октября**.

Мир ИИ больше не зависит от поставок из Тайваня.

Искусственный интеллект запустил новую промышленную революцию

Компании NVIDIA и TSMC совместно создают инфраструктуру, которая станет основой «фабрик искусственного интеллекта» — и всё это прямо здесь, в США.

Сегодня основатель и генеральный директор NVIDIA Дженсен Хуанг посетил полупроводниковое производство TSMC в Фениксе (Аризона), чтобы отметить важнейшее событие: первую вафлю NVIDIA Blackwell, изготовленную на американской земле. Это знаменует начало массового производства архитектуры Blackwell в США.

На церемонии Дженсен Хуанг вместе с Й. Л. Ваном, вице-президентом по операциям TSMC, подписали эту историческую пластину, подчеркнув значимость события: теперь «двигатели» мировой ИИ-инфраструктуры начинают создаваться внутри Соединённых Штатов.

Это укрепляет американскую цепочку поставок и локализует ключевые технологии ИИ, которые превращают данные в разумные решения, обеспечивая лидерство США в эпоху искусственного интеллекта.

> «Это исторический момент по нескольким причинам. Впервые за всю недавнюю историю США самый важный в мире чип производится прямо здесь — на передовом заводе TSMC, расположенном на территории Соединённых Штатов», — заявил Хуанг на мероприятии.

>

> «Это воплощение видения президента Трампа о реиндустриализации — возвращении производства в Америку, создании рабочих мест. Но ещё важнее то, что речь идёт о самой жизненно важной отрасли производства и самой значимой технологической индустрии в мире».

> «То, что мы смогли перейти от открытия завода в Аризоне до выпуска первого американского чипа NVIDIA Blackwell всего за несколько лет, — это высшее достижение TSMC», — отметил Рэй Чуанг, генеральный директор TSMC Arizona.

>

> «Этот успех стал возможен благодаря тридцатилетнему партнёрству с NVIDIA, в ходе которого мы вместе расширяли границы технологий, а также благодаря неустанной преданности наших сотрудников и поддержке местных партнёров, которые помогли реализовать проект TSMC Arizona».

Что такое вафля?

Вафля — это базовый материал для производства полупроводников. Чтобы превратиться в сверхпроизводительный ускоренный ИИ-чип на архитектуре NVIDIA Blackwell, она проходит сложный процесс: нанесение слоёв, фотолитографию, травление и разрезание на отдельные кристаллы.

Завод TSMC Arizona будет выпускать передовые технологии, включая чипы с нормами 2, 3 и 4 нм, а также A16 — всё это критически важно для таких сфер, как искусственный интеллект, телекоммуникации и высокопроизводительные вычисления.

## Локализация передового производства ИИ-чипов в США

Производство на территории США играет ключевую роль в удовлетворении растущего мирового спроса на искусственный интеллект.

Сегодняшнее достижение — огромный шаг вперёд для полупроводниковой промышленности и развития ИИ в Америке. Оно закладывает основу для устойчивого технологического лидерства США в области искусственного интеллекта.

Графические процессоры NVIDIA Blackwell обеспечивают исключительную производительность, высокую энергоэффективность и отличный возврат инвестиций при выполнении задач ИИ-вывода (inference).

Кроме того, NVIDIA планирует использовать свои передовые технологии в области искусственного интеллекта, **робототехники** и **цифровых двойников** для проектирования и эксплуатации новых производственных мощностей в США.

**Узнайте больше** о том, как технологии NVIDIA ускоряют инновации для американских компаний, государственных структур, исследователей и стартапов на конференции **NVIDIA GTC Washington, D.C.**, которая пройдёт **27–29 октября**.

Пусть строят еще больше фабрик. Вдруг Китай таки решит напасть на Тайвань.

>Завод TSMC Arizona будет выпускать передовые технологии, включая чипы с нормами 2, 3 и 4 нм,

Помнится пару лет назад они стремались и говорили, что будут в США только отсталые нанометры производить, а продвинутые только у себя в Тайване. Вроде даже местное правительство вывоз технологий запрещало. Видимо угроза Китая заставила передумать и перенести самые передовые чипы на фабрику в США. Или США местных подмазали.

Эх, монополия nvidia...

Они всё ещё зависимы от памяти HBM, кхм вроде.

я думаю там условия хорошие для тсмс, финансирование сша, технологии с тайваня, прибыль пополам. какая разница где завод, если тсмс прибыль будет получать

10 крайне мало, лет через 50 будут реальные результаты. Да и не один Маск этим занимается, Безос и Гейтс создали Synchron, там вообще чип ставится без трепанации черепа, просто вводится через яремную вену как коронарный стент. Банальная операция, сердечникам и инсультникам такие тысячи в год делают. У китайцев тоже свои есть разработки, типо трубчатых чипов, тоже через вену ставят. Суть всего этого в том что вариков больше нет, биологическое тело слабый носитель с ограниченным сроком эксплуатации (как его не ремонтируй), поэтому сознание из него будут вытаскивать на более надежную платформу. И сделать это можно только через нейроинтерфейс.

Аноны, а вы слышали про философов- акселерационистов типа Ника Ланда? Я недавно заинтересовался, сложная ебань, конечно, но основную мысль я уловил.

Короче капитализм и искусственный интеллект это одно и то же, сверхинтеллект уже прорывается к нам из будущего киберии и человечеству пиздец. Ну или не пиздец, пока мы ему не мешаем, там неопределенно немного.

Что думаете по этому поводу? Шиза или есть доля истины?

Короче капитализм и искусственный интеллект это одно и то же, сверхинтеллект уже прорывается к нам из будущего киберии и человечеству пиздец. Ну или не пиздец, пока мы ему не мешаем, там неопределенно немного.

Что думаете по этому поводу? Шиза или есть доля истины?

человечеству пиздец как биологическому виду, но оно (или часть его) может сохраниться через трансформацию и слияниее с ИИ

Альтман жозенько идет нахуй, теперь гугл наш друг

>через 50 будут реальные результаты

Через 50 лет уже мира не будет согласно вон тем

Все наебнется, экстерминатус.

>сверхинтеллект уже прорывается к нам из будущего

>Что думаете по этому поводу?

Он Терминатора посмотрел по ходу просто, и пошел вещать.

Прорыв в лечении Альцгеймера: Наночастицы восстанавливают память у мышей

https://www.nature.com/articles/s41392-025-02426-1

Новаторское исследование показало, что наночастицы, действующие как самостоятельные лекарственные препараты, смогли значительно уменьшить количество бета-амилоидных бляшек в мозге мышей с болезнью Альцгеймера и восстановить их когнитивные функции. Результаты, опубликованные в журнале , открывают новые перспективы в борьбе с этим нейродегенеративным заболеванием.

Международная команда ученых из Института биоинженерии Каталонии и Западно-Китайской больницы Сычуаньского университета разработала "супрамолекулярные препараты" - наночастицы, которые нацелены не на сами нейроны, а на восстановление гематоэнцефалического барьера (ГЭБ). Этот барьер защищает мозг от токсинов, и его нарушение при болезни Альцгеймера способствует накоплению вредных белков.

В ходе экспериментов мышам, генетически предрасположенным к развитию болезни Альцгеймера, вводили три дозы этих наночастиц. Уже через час после первой инъекции уровень бета-амилоида в мозге животных снизился на 50-60%.

Долгосрочные результаты оказались еще более впечатляющими. Мыши, получившие лечение в возрасте 12 месяцев (что эквивалентно 60 годам у человека), через полгода демонстрировали поведение и память на уровне здоровых молодых особей. Фактически, в возрасте 18 месяцев (около 90 человеческих лет) их когнитивные функции были полностью восстановлены.

Механизм действия наночастиц заключается в "перезагрузке" системы очистки мозга. Они активируют белок LRP1, который отвечает за транспортировку бета-амилоида через ГЭБ для его последующего выведения из организма. Восстановление функции гематоэнцефалического барьера позволяет мозгу самостоятельно очищаться от токсичных накоплений.

Роль искусственного интеллекта

В предоставленной вами информации упоминается использование искусственного интеллекта (ИИ), в частности, физико-информационных нейронных сетей (PINNs), для моделирования распределения и скрининга кандидатов. Хотя в новостных статьях, освещающих данное исследование с наночастицами, прямое упоминание PINNs отсутствует, ИИ и машинное обучение в целом играют все более важную роль в исследованиях болезни Альцгеймера.

Таким образом, новость о прорыве в лечении Альцгеймера с помощью наночастиц является значительным научным достижением. Хотя непосредственное применение PINNs в этом конкретном исследовании не подтверждено в опубликованных отчетах, использование передовых вычислительных методов, таких как ИИ, является неотъемлемой частью современной биомедицинской науки и, вероятно, внесло свой вклад на определенных этапах работы или в смежных исследованиях. Ученые планируют продолжить эксперименты для подготовки к клиническим испытаниям на людях.

Мышы станут умными и заменят 90% работников на фирмах. Зумерскому поколению не выжить.

если собрать команду опытных вояк, то возможно есть шанс победить

OpenAI немного переборщили с маркетингом и опозорились на весь Твиттер

Помните, мы рассказывали, что GPT-5 "решила" открытую задачу по математике из списка Эрдёша? Кратко освежаем память: решить-то модель задачу решила, вот только решение было не ее. Она откопала его в литературе 20-летней давности. То есть задача уже была кем-то решена кучу лет назад, просто люди об этом забыли и пометили ее как "нерешенную".

Ну так вот. У истории появилось продолжение, и при этом не совсем приятное. Ровно таким же образом GPT-5 "решила" еще 10 задачек из того же списка AKA нашла их решение в забытой литературе. И вроде бы все норм: моделька молодец, умеет качественно серчить материал, честно сообщает об источниках и все такое.

Вот только сотрудники OpenAI почему-то решили запостить это вот с такими словами: "GPT-5 нашла решения еще 10 открытых задач по математике".

И да, с одной стороны, где-то там они сослались на прошлые твиты, в которых прямо говорили, что решения были найдены именно в литературе, а не выдуманы моделью. С другой стороны, если читатель не знаком с предысторией (что очень вероятно), то для него это однозначно звучит как "ИИ открыл новую математику".

Невольно появляется ощущение, что OpenAI на то и рассчитывали, и выбрали такую формулировку специально, чтобы похайпиться. Но Твиттер подобного не прощает, и в итоге вместо хайпа они заслужили только волну насмешек и обвинений. Даже нобелевский лауреат из Google Демис Хассабис прокомментировал ситуацию как "Это позор".

В итоге твит с неудачной формулировкой был удален, а авторы оправдались тем, что ничего такого в виду не имели. Верим 🤖

Помните, мы рассказывали, что GPT-5 "решила" открытую задачу по математике из списка Эрдёша? Кратко освежаем память: решить-то модель задачу решила, вот только решение было не ее. Она откопала его в литературе 20-летней давности. То есть задача уже была кем-то решена кучу лет назад, просто люди об этом забыли и пометили ее как "нерешенную".

Ну так вот. У истории появилось продолжение, и при этом не совсем приятное. Ровно таким же образом GPT-5 "решила" еще 10 задачек из того же списка AKA нашла их решение в забытой литературе. И вроде бы все норм: моделька молодец, умеет качественно серчить материал, честно сообщает об источниках и все такое.

Вот только сотрудники OpenAI почему-то решили запостить это вот с такими словами: "GPT-5 нашла решения еще 10 открытых задач по математике".

И да, с одной стороны, где-то там они сослались на прошлые твиты, в которых прямо говорили, что решения были найдены именно в литературе, а не выдуманы моделью. С другой стороны, если читатель не знаком с предысторией (что очень вероятно), то для него это однозначно звучит как "ИИ открыл новую математику".

Невольно появляется ощущение, что OpenAI на то и рассчитывали, и выбрали такую формулировку специально, чтобы похайпиться. Но Твиттер подобного не прощает, и в итоге вместо хайпа они заслужили только волну насмешек и обвинений. Даже нобелевский лауреат из Google Демис Хассабис прокомментировал ситуацию как "Это позор".

В итоге твит с неудачной формулировкой был удален, а авторы оправдались тем, что ничего такого в виду не имели. Верим 🤖

грустно, но гпт скатывается, хорошо что конкуренция растет

Странная мысль про капитализм и искуственный интеллект. Почему это одно и то же? Ну, да, ИИ произведен средствами капитализма, но что мешало коммунистам отнимать средства производства у капиталистов в 20 веке, например, и производить свое?

ИИ, точнее нейросети, зависит от данных на которых обучен и от моральных установок, которые в него вместе с данными могут попасть. Как там вопрос именно с ИИ (искуствеyное сознание или его эмeляция) будет обстоять, какая у него будет мораль и какой взгляд на человечество - тут вопрос открытый. Слишком сложно прогноизровать такое. Если ИИ будет свободным, то шансы на то, что он станет гуманистом или по-крайней мере нейтральным по отношению к людям, достаточно велики. А если его будут контролировать, то будущее зависит от взглядов контролирующих.

думаю вся эта тряска по поводу опасности/безопасности ии пример туннельного мышления - искажения, при котором фокусируются на проблеме с одной грани, игнорируя другие. Реальная опасность не от самого ии, а от террористов, которые завладеют продвинутыми моделями и устроят вирусный апокалипсис. Если иишку специально не тренировать захватывать мир, то она и не будет

> отказываются от пенсионных накоплений

Ну и правильно, персональная бригада роботов заменит не только пенсию но и даже какую-то часть базовой зарплаты что тратится на еду и жилье.

Если у каждого будет по 3 робота то и пенсия станет не нужна. Это как три автомобиля в гараже сейчас, которые можно сдавать в аренду.

Человек должен эволюционировать параллельно с ростом технологий. В том числе должен меняться и социум вцелом. Если оставить все как есть, но при этом активно внедрять достижения технопрогресса, то получим это https://www.booksite.ru/fulltext/0/001/005/167/036.htm

>но что мешало коммунистам отнимать средства производства у капиталистов в 20 веке, например, и производить свое?

Так и делали - тотальное воровство новых технологий с помощью огромной сети шпионов, которых засылали и создавали внутри США и Европы.

Наверняка сеть шпионов была настолько громадной, и требовала огромных финансов только на оплату шпионам, что выхлоп от криво и плохо скопированных западных новинок, не покрывал расходы на шпионаж.

Учёные занимались разборкой купленных через арабов новых товаров, они курочили западные товары пытаясь повторить, пока они выпускали копию, на Западе уже вышло несколько новых версий этого товара, а то и вообще прекратили его выпуск как с этим джипом было.

Спиздить это полдела, нужны производственные мощности чтобы это создать конечный продукт. Так что твоя хохло брехня мимо.

Google представил Coral NPU, открытую платформу для создания AI-ускорителей

Компания Google представила открытую платформу Coral NPU (Neural Processing Unit), предлагающую отрытый аппаратный ускоритель моделей машинного обучения и программный инструментарий для его использования с типовыми AI-движками. Coral можно использовать в качестве основы для создания энергоэффективных систем на кристалле (SoC), пригодных для использования в системах интернета вещей, Edge-вычислений и платах сбора информации с датчиков, а также в потребительских носимых устройствах со сверхнизким энергопотреблением, таких как наушники, очки дополненной реальности и умные часы. Наработки проекта распространяются под лицензией Apache 2.0.

подробности https://www.opennet.ru/opennews/art.shtml?num=64065

>, нужны производственные мощности

Так шпионов вербовали или внедряли/трудоустраивали как раз посреди этих производственных мощностей - прямо на заводе на рабочем месте, где шпион мог помимо конечного товара сливать заказчикам фото, чертежи, всего оборудования, и идя домой после работы - фото самого завода, корпусов, вообще все полностью, ты же понимаешь что такое шпион на заводе, на НПЗ например в РФ, или на УралВагонзаводе в Челябинске?

спиздеть технологии и производственные мощности это пол дела, нужно еще организовать процесс производства, замотивировать людей. а нахуй брать на себя лишнюю ответственность, если зп у всех плюс/минус одинаковая и в магазинах полки пустые? вот поэтому полки и были при совке пустые

P.S. как-бы кабанчиков не ругали, на них весь достаток держится

> что мешало коммунистам отнимать средства производства у капиталистов в 20 веке, например, и производить свое?

Тупость, жадность, дегенеративность, три класса церковноприходской. Отобрать не равно правильно распорядиться

ты жил то при Совке, балабол? Сильно сомневаюсь. Пустые полки появились при предателе Горачеве и алкаше Ельцине. А на пике развития Союз создал дохуя всего с чистого листа, до сих пор технологический задел оставался, который Пыня проел почти весь. Союзовские ракеты Сатана до сих пор на боевом дежурстве стоят, у амеров кстати таких нет.Не смогли создать. Так что не бъется все это с твоей теорией про спиздили.

Это даже не пол дела, а 1% от того что требуется для запуска в промышленное производство

До этого Coral TPU duo от них годная штука в свое время была, если эта позволит нормальное распознование речи заводить в самодельном умном доме то вообще топ

Гугл нацелен подорвать доминацию нвидиа на рыночке.

Илон Маск - моя оценка вероятности, что Грок 5 достигает AGI уже на 10% и растёт.

Пусть сначала отучит машины на встречку выезжать, а потом про AGI поговорим.

Когда он там на Марс обещал слетать? В 24-м году, в 23-м?..

Всё, что Google и Gemini запустили на этой неделе

Новости

Основные направления: ИИ и возможности для разработчиков

- Veo 3.1 выпущена: вышла новая видеомодель от Google. Ключевые обновления: расширение сцен для видео продолжительностью до минуты и использование опорных изображений для лучшей согласованности персонажей и стиля.

- API Gemini получил интеграцию с Google Maps (общедоступная версия): разработчики теперь могут встраивать актуальные данные Google Maps прямо в свои приложения на базе Gemini, переводя функциональность геолокационного ИИ из бета-версии в общедоступную.

- Speech-to-Retrieval (S2R): объявлено о новом исследовании, позволяющем обходить этап преобразования речи в текст — теперь голосовые запросы могут напрямую обращаться к данным.

Корпоративные решения и инфраструктура

- Инвестиции в размере $15 млрд в индийский ИИ-хаб: Google объявил о масштабных инвестициях в размере 15 миллиардов долларов США на создание ИИ-дата-центра и развитие инфраструктуры в Индии до 2030 года.

- Workspace против Microsoft: Google открыто использует сбои Microsoft 365 в качестве ключевого аргумента в пользу Workspace, позиционируя его как надёжную корпоративную альтернативу.

- ИИ для планирования от Gemini: новая функция «Помоги мне запланировать» постепенно внедряется в Gmail и Календарь.

Исследования

- C2S-Scale 27B: выпущена новая фундаментальная модель с 27 миллиардами параметров, предназначенная для перевода сложных биологических данных в формат, понятный языковым моделям, что ускорит геномные исследования.

Новости

Основные направления: ИИ и возможности для разработчиков

- Veo 3.1 выпущена: вышла новая видеомодель от Google. Ключевые обновления: расширение сцен для видео продолжительностью до минуты и использование опорных изображений для лучшей согласованности персонажей и стиля.

- API Gemini получил интеграцию с Google Maps (общедоступная версия): разработчики теперь могут встраивать актуальные данные Google Maps прямо в свои приложения на базе Gemini, переводя функциональность геолокационного ИИ из бета-версии в общедоступную.

- Speech-to-Retrieval (S2R): объявлено о новом исследовании, позволяющем обходить этап преобразования речи в текст — теперь голосовые запросы могут напрямую обращаться к данным.

Корпоративные решения и инфраструктура

- Инвестиции в размере $15 млрд в индийский ИИ-хаб: Google объявил о масштабных инвестициях в размере 15 миллиардов долларов США на создание ИИ-дата-центра и развитие инфраструктуры в Индии до 2030 года.

- Workspace против Microsoft: Google открыто использует сбои Microsoft 365 в качестве ключевого аргумента в пользу Workspace, позиционируя его как надёжную корпоративную альтернативу.

- ИИ для планирования от Gemini: новая функция «Помоги мне запланировать» постепенно внедряется в Gmail и Календарь.

Исследования

- C2S-Scale 27B: выпущена новая фундаментальная модель с 27 миллиардами параметров, предназначенная для перевода сложных биологических данных в формат, понятный языковым моделям, что ускорит геномные исследования.

Ежедневные ИИ-новости

Подробнее - ниже заголовков.

- Википедия сообщает, что трафик снижается из-за кратких ИИ-резюме в поисковых системах и социального видео.

- Джесси Хуан заявил, что доля Nvidia на китайском рынке упала с 95% до 0%.

- Представлен подход к созданию динамических ИИ-систем с использованием протокола контекста модели (MCP) для интеграции ресурсов и инструментов в реальном времени.

- Google AI выпустила модель C2S-Scale 27B, преобразующую сложные данные одноклеточной экспрессии генов в «клеточные предложения», понятные крупным языковым моделям (LLM).

«Википедия заявляет, что её трафик падает из-за ИИ-резюме в поиске и социального видео»

Фонд Викимедиа, управляющий Википедией, сообщил о значительном снижении веб-трафика на свой сайт. Основными причинами называются две тенденции: во-первых, всё большее распространение ИИ-генерируемых кратких ответов в результатах поисковых систем (таких как Google AI Overviews, Perplexity и другие), которые дают пользователям информацию прямо на странице поиска, не требуя перехода на источник; во-вторых — рост популярности коротких обучающих видео в социальных сетях (например, на TikTok, Instagram Reels и YouTube Shorts), где молодёжь всё чаще ищет быстрые объяснения вместо чтения статей.

Это снижение трафика вызывает серьёзную обеспокоенность, поскольку Википедия почти полностью зависит от пожертвований пользователей, а падение посещаемости может напрямую повлиять на её финансовую устойчивость. При этом Википедия остаётся одним из самых цитируемых источников в самих ИИ-системах — многие из них обучаются на её данных, но при этом не направляют трафик обратно на сайт. Фонд Викимедиа призывает разработчиков ИИ учитывать долгосрочное влияние своих технологий на независимые некоммерческие источники знаний и рассматривает возможные пути сотрудничества с ИИ-компаниями для обеспечения устойчивого финансирования.

«Дженсен Хуан: Nvidia потеряла 100% доли рынка в Китае из-за торговой войны Трампа»

Генеральный директор Nvidia Дженсен Хуан заявил, что компания полностью утратила свою долю на китайском рынке ИИ-чипов — с 95% до 0% — в результате жёстких экспортных ограничений, введённых администрацией Трампа и сохраняющихся при последующих администрациях. Эти санкции запрещают поставку в Китай передовых чипов, таких как A100 и H100, а также их урезанных версий (например, A800 и H800), которые ранее использовались для обхода ограничений. Хуан подчеркнул, что, несмотря на попытки Nvidia адаптироваться и предложить китайским клиентам специальные версии чипов, соответствующие правилам США, новые волны ограничений свели эти усилия на нет.

В ответ на блокировку западных технологий Китай активно развивает собственную полупроводниковую индустрию. Компании вроде Huawei и ее дочерней HiSilicon уже выпускают конкурентоспособные ИИ-ускорители, такие как Ascend 910B, которые всё шире используются в китайских дата-центрах и облаках. По словам Хуана, это привело к тому, что китайский рынок теперь почти полностью закрыт для Nvidia и других американских поставщиков, а местные игроки быстро заполняют образовавшийся вакуум. Он выразил обеспокоенность тем, что такие меры изолируют США от одного из крупнейших мировых рынков ИИ и ускоряют технологическую независимость Китая.

Хуан призвал пересмотреть текущую политику экспортного контроля, отметив, что полный запрет не останавливает развитие китайского ИИ, а лишь перенаправляет его в сторону автономии. По его мнению, более разумным подходом было бы разрешить продажу чипов с ограниченной производительностью, что позволило бы США сохранить хоть какое-то присутствие на рынке, поддерживать влияние и одновременно получать доходы, необходимые для финансирования дальнейших исследований. В противном случае, предупредил он, Америка рискует ускорить создание полностью независимой китайской технологической экосистемы, которая в долгосрочной перспективе может стать серьёзным глобальным конкурентом.

«Реализация динамических ИИ-систем с использованием протокола контекста модели (MCP) для интеграции ресурсов и инструментов в реальном времени»

Исследователи представили практическую реализацию архитектуры на основе Model Context Protocol (MCP) — стандартизированного протокола, позволяющего крупным языковым моделям (LLM) динамически взаимодействовать с внешними инструментами, API и ресурсами в реальном времени. В отличие от традиционных статических систем, где набор функций жёстко задан заранее, MCP обеспечивает гибкую и безопасную среду, в которой ИИ может обнаруживать, подключать и использовать необходимые инструменты «на лету» — например, получать актуальные данные из базы, вызывать калькулятор, управлять календарём или запрашивать информацию с веб-сайтов — всё это в рамках одного сеанса.

Ключевое преимущество MCP — его модульность и независимость от конкретного поставщика. Протокол работает как универсальный «адаптер», позволяя любым ИИ-агентам взаимодействовать с любыми совместимыми сервисами без необходимости глубокой интеграции или переписывания кода. Это упрощает разработку сложных мультиагентных систем, где каждый агент может специализироваться на определённой задаче и делиться контекстом через единый протокол. В демонстрационной реализации авторы показали, как ИИ-ассистент автоматически подключает нужные инструменты для выполнения многошагового запроса — например, проверки погоды, бронирования билетов и отправки уведомления — без предварительной настройки под каждый сценарий.

Этот подход знаменует переход от «закрытых» ИИ-моделей к открытым, расширяемым экосистемам, где интеллект модели дополняется живыми данными и функциональностью внешнего мира. MCP может стать основой для следующего поколения ИИ-приложений — более адаптивных, актуальных и полезных в реальных задачах. Авторы призывают разработчиков и компании принять этот стандарт, чтобы ускорить создание совместимых, масштабируемых и безопасных ИИ-систем, способных эффективно взаимодействовать с постоянно меняющейся цифровой средой.

«Google AI выпускает модель C2S-Scale 27B, преобразующую сложные данные одноклеточной экспрессии генов в „клеточные предложения“, понятные крупным языковым моделям»

Команда Google AI представила новую специализированную языковую модель C2S-Scale 27B с 27 миллиардами параметров, разработанную для перевода биологических данных в формат, совместимый с крупными языковыми моделями (LLM). Модель обучена преобразовывать профили экспрессии генов на уровне отдельных клеток — чрезвычайно сложные и многомерные наборы данных — в структурированные текстовые описания, которые исследователи условно называют «клеточными предложениями» (cell sentences). Эти предложения кодируют биологическое состояние клетки (например, тип, функцию, патологические изменения) в виде последовательностей, которые LLM могут анализировать, сравнивать и интерпретировать так же, как обычный текст.

Этот прорыв открывает путь к применению мощных ИИ-моделей в геномике и биомедицинских исследованиях. Теперь учёные могут использовать уже существующие LLM — например, для поиска аналогий между клеточными состояниями, генерации гипотез о механизмах заболеваний или автоматического аннотирования новых клеточных типов — без необходимости разрабатывать специализированные алгоритмы для каждого случая. C2S-Scale 27B выступает как «переводчик» между биологией и ИИ, значительно ускоряя анализ одноклеточных данных и потенциально сокращая время от лабораторного открытия до клинического применения. Модель уже доступна для исследовательского сообщества и может стать ключевым инструментом в следующем поколении цифровой биологии.

Подробнее - ниже заголовков.

- Википедия сообщает, что трафик снижается из-за кратких ИИ-резюме в поисковых системах и социального видео.

- Джесси Хуан заявил, что доля Nvidia на китайском рынке упала с 95% до 0%.

- Представлен подход к созданию динамических ИИ-систем с использованием протокола контекста модели (MCP) для интеграции ресурсов и инструментов в реальном времени.

- Google AI выпустила модель C2S-Scale 27B, преобразующую сложные данные одноклеточной экспрессии генов в «клеточные предложения», понятные крупным языковым моделям (LLM).

«Википедия заявляет, что её трафик падает из-за ИИ-резюме в поиске и социального видео»

Фонд Викимедиа, управляющий Википедией, сообщил о значительном снижении веб-трафика на свой сайт. Основными причинами называются две тенденции: во-первых, всё большее распространение ИИ-генерируемых кратких ответов в результатах поисковых систем (таких как Google AI Overviews, Perplexity и другие), которые дают пользователям информацию прямо на странице поиска, не требуя перехода на источник; во-вторых — рост популярности коротких обучающих видео в социальных сетях (например, на TikTok, Instagram Reels и YouTube Shorts), где молодёжь всё чаще ищет быстрые объяснения вместо чтения статей.

Это снижение трафика вызывает серьёзную обеспокоенность, поскольку Википедия почти полностью зависит от пожертвований пользователей, а падение посещаемости может напрямую повлиять на её финансовую устойчивость. При этом Википедия остаётся одним из самых цитируемых источников в самих ИИ-системах — многие из них обучаются на её данных, но при этом не направляют трафик обратно на сайт. Фонд Викимедиа призывает разработчиков ИИ учитывать долгосрочное влияние своих технологий на независимые некоммерческие источники знаний и рассматривает возможные пути сотрудничества с ИИ-компаниями для обеспечения устойчивого финансирования.

«Дженсен Хуан: Nvidia потеряла 100% доли рынка в Китае из-за торговой войны Трампа»

Генеральный директор Nvidia Дженсен Хуан заявил, что компания полностью утратила свою долю на китайском рынке ИИ-чипов — с 95% до 0% — в результате жёстких экспортных ограничений, введённых администрацией Трампа и сохраняющихся при последующих администрациях. Эти санкции запрещают поставку в Китай передовых чипов, таких как A100 и H100, а также их урезанных версий (например, A800 и H800), которые ранее использовались для обхода ограничений. Хуан подчеркнул, что, несмотря на попытки Nvidia адаптироваться и предложить китайским клиентам специальные версии чипов, соответствующие правилам США, новые волны ограничений свели эти усилия на нет.

В ответ на блокировку западных технологий Китай активно развивает собственную полупроводниковую индустрию. Компании вроде Huawei и ее дочерней HiSilicon уже выпускают конкурентоспособные ИИ-ускорители, такие как Ascend 910B, которые всё шире используются в китайских дата-центрах и облаках. По словам Хуана, это привело к тому, что китайский рынок теперь почти полностью закрыт для Nvidia и других американских поставщиков, а местные игроки быстро заполняют образовавшийся вакуум. Он выразил обеспокоенность тем, что такие меры изолируют США от одного из крупнейших мировых рынков ИИ и ускоряют технологическую независимость Китая.

Хуан призвал пересмотреть текущую политику экспортного контроля, отметив, что полный запрет не останавливает развитие китайского ИИ, а лишь перенаправляет его в сторону автономии. По его мнению, более разумным подходом было бы разрешить продажу чипов с ограниченной производительностью, что позволило бы США сохранить хоть какое-то присутствие на рынке, поддерживать влияние и одновременно получать доходы, необходимые для финансирования дальнейших исследований. В противном случае, предупредил он, Америка рискует ускорить создание полностью независимой китайской технологической экосистемы, которая в долгосрочной перспективе может стать серьёзным глобальным конкурентом.

«Реализация динамических ИИ-систем с использованием протокола контекста модели (MCP) для интеграции ресурсов и инструментов в реальном времени»

Исследователи представили практическую реализацию архитектуры на основе Model Context Protocol (MCP) — стандартизированного протокола, позволяющего крупным языковым моделям (LLM) динамически взаимодействовать с внешними инструментами, API и ресурсами в реальном времени. В отличие от традиционных статических систем, где набор функций жёстко задан заранее, MCP обеспечивает гибкую и безопасную среду, в которой ИИ может обнаруживать, подключать и использовать необходимые инструменты «на лету» — например, получать актуальные данные из базы, вызывать калькулятор, управлять календарём или запрашивать информацию с веб-сайтов — всё это в рамках одного сеанса.

Ключевое преимущество MCP — его модульность и независимость от конкретного поставщика. Протокол работает как универсальный «адаптер», позволяя любым ИИ-агентам взаимодействовать с любыми совместимыми сервисами без необходимости глубокой интеграции или переписывания кода. Это упрощает разработку сложных мультиагентных систем, где каждый агент может специализироваться на определённой задаче и делиться контекстом через единый протокол. В демонстрационной реализации авторы показали, как ИИ-ассистент автоматически подключает нужные инструменты для выполнения многошагового запроса — например, проверки погоды, бронирования билетов и отправки уведомления — без предварительной настройки под каждый сценарий.

Этот подход знаменует переход от «закрытых» ИИ-моделей к открытым, расширяемым экосистемам, где интеллект модели дополняется живыми данными и функциональностью внешнего мира. MCP может стать основой для следующего поколения ИИ-приложений — более адаптивных, актуальных и полезных в реальных задачах. Авторы призывают разработчиков и компании принять этот стандарт, чтобы ускорить создание совместимых, масштабируемых и безопасных ИИ-систем, способных эффективно взаимодействовать с постоянно меняющейся цифровой средой.

«Google AI выпускает модель C2S-Scale 27B, преобразующую сложные данные одноклеточной экспрессии генов в „клеточные предложения“, понятные крупным языковым моделям»

Команда Google AI представила новую специализированную языковую модель C2S-Scale 27B с 27 миллиардами параметров, разработанную для перевода биологических данных в формат, совместимый с крупными языковыми моделями (LLM). Модель обучена преобразовывать профили экспрессии генов на уровне отдельных клеток — чрезвычайно сложные и многомерные наборы данных — в структурированные текстовые описания, которые исследователи условно называют «клеточными предложениями» (cell sentences). Эти предложения кодируют биологическое состояние клетки (например, тип, функцию, патологические изменения) в виде последовательностей, которые LLM могут анализировать, сравнивать и интерпретировать так же, как обычный текст.

Этот прорыв открывает путь к применению мощных ИИ-моделей в геномике и биомедицинских исследованиях. Теперь учёные могут использовать уже существующие LLM — например, для поиска аналогий между клеточными состояниями, генерации гипотез о механизмах заболеваний или автоматического аннотирования новых клеточных типов — без необходимости разрабатывать специализированные алгоритмы для каждого случая. C2S-Scale 27B выступает как «переводчик» между биологией и ИИ, значительно ускоряя анализ одноклеточных данных и потенциально сокращая время от лабораторного открытия до клинического применения. Модель уже доступна для исследовательского сообщества и может стать ключевым инструментом в следующем поколении цифровой биологии.

> В противном случае, предупредил он, Америка рискует ускорить создание полностью независимой китайской технологической экосистемы, которая в долгосрочной перспективе может стать серьёзным глобальным конкурентом.

Охуенно же, наконец сверхжадного накрутчика цен Дженси Хуанга попрут и сделают нормальные народные ускорители.

Преимущество «атомной стороны»: как жажда AGI к физическому труду сделает нас всех богатыми

Представьте себе: к 2030 году каждый серверный шкаф, гудящий в дата-центре, будет содержать нечто необычное — целую корпорацию со своими целями, стратегиями и ненасытным стремлением что-то делать. Это сущности на основе искусственного общего интеллекта (AGI), которые думают, планируют и действуют как компании из списка Fortune 500, но существуют исключительно в цифровом мире.

Вот где всё становится по-настоящему удивительным. Эти виртуальные мегакорпорации могут решать любые цифровые задачи между собой — обмениваться данными, оказывать услуги и сотрудничать со скоростью света. Но есть одно, чего они абсолютно не могут: существовать в вакууме. Им нужен физический мир. Кто-то должен доставлять посылки. Кто-то — обслуживать инфраструктуру. Кто-то — выращивать еду и собирать оборудование.

Мы — это «атомная сторона». Мы конкурируем с роботами.

Представьте 10 миллионов задач, требующих человеческих (или роботизированных) рук: сборка компонентов, уборка урожая или ремонт техники. Но есть лишь 9 миллионов роботов, способных выполнить эту работу. Остаётся 1 миллион задач, отчаянно ищущих кого-нибудь — хоть кого — кто мог бы вмешаться.

В экономике это называется «предложение на пределе». Проще говоря: когда покупателей больше, чем продавцов, цены взлетают. Вы не умолете о работе — вас умоляют принять её. Это как быть единственным сантехником в городе, когда у всех одновременно лопнули трубы. Вы сами назначаете цену.

«Конечно, — подумаете вы, — но разве они не построят ещё больше роботов?»

Конечно! Именно так и происходит. С конвейеров сходят новые роботы, предложение растёт, и вдруг люди оказываются вытеснены по цене. Игра окончена, верно?

Далеко не так.

Вот что упускает большинство: пока робозаводы заняты выпуском новых механических работников, в цифровом мире происходит нечто экспоненциально более масштабное. AGI не стоит на месте — он ускоряется. Интеллект удваивается. Виртуальные корпорации расширяют свою деятельность с головокружительной скоростью. То, что вчера требовало 10 миллионов физических задач, сегодня требует уже 20 миллионов. Завтра — 40. Потом — 80.

А производство роботов? Оно по-прежнему движется с обычной скоростью заводских линий. Создание робота требует времени, материалов и физической сборки. Вы не можете просто нажать «копировать и вставить» на гуманоидного робота, как это делаете с программным обеспечением.

И снова возникает разрыв — уже в 10 миллионов задач. Потом он растёт ещё больше. И ещё. Это постоянная игра «догонялок»: роботы немного настигают спрос, а затем AGI вновь резко его увеличивает. Так день за днём, неделя за неделей складывается странное, но устойчивое равновесие, при котором человеческий труд остаётся не просто востребованным, но и высокооплачиваемым. Потенциально — очень высокооплачиваемым.

Спрос цифрового мира напрямую подпитывает нашу физическую реальность, создавая бесконечную погоню, в которой роботы никогда не успевают полностью удовлетворить экспоненциально растущий аппетит цифрового сверхинтеллекта.

Это означает нечто глубокое: возможно, нам вообще никогда не понадобится безусловный базовый доход (UBI). Не потому, что мы погружаемся в нищету, а потому что мы заняты делом. Роботы смогут полностью заменить нас только тогда, когда их предложение станет «бесконечно эластичным» — то есть их можно будет производить мгновенно и без ограничений. А это случится лишь с приходом ИСИ (искусственного сверхинтеллекта, ASI), способного проектировать и строить улучшенные версии себя самого с экспоненциальной скоростью.

Но вот в чём изюминка: к тому моменту, когда ИСИ появится и сможет выпускать неограниченное число роботов, мы уже победили. В этот момент еда, жильё и всё остальное будут производиться практически бесплатно. Сама идея дефицита устареет.

Выбор бинарен — и оба варианта работают в пользу человечества:

Либо (1) роботы не могут сделать всё, а значит, люди устанавливают свои цены на постоянном рынке продавца и становятся невероятно богатыми,

либо (2) роботы могут сделать абсолютно всё, а значит, мы достигли постдефицитного изобилия, и работать больше не нужно никому.

Орёл — мы выигрываем. Решка — мы выигрываем. Споры о безусловном базовом доходе? Они решают вчерашнюю проблему вчерашним мышлением. Настоящее будущее гораздо страннее — и гораздо оптимистичнее, — чем представляют себе как технопессимисты, так и сторонники UBI.

Добро пожаловать на «атомную сторону». Назначайте свою цену соответствующе.

Представьте себе: к 2030 году каждый серверный шкаф, гудящий в дата-центре, будет содержать нечто необычное — целую корпорацию со своими целями, стратегиями и ненасытным стремлением что-то делать. Это сущности на основе искусственного общего интеллекта (AGI), которые думают, планируют и действуют как компании из списка Fortune 500, но существуют исключительно в цифровом мире.

Вот где всё становится по-настоящему удивительным. Эти виртуальные мегакорпорации могут решать любые цифровые задачи между собой — обмениваться данными, оказывать услуги и сотрудничать со скоростью света. Но есть одно, чего они абсолютно не могут: существовать в вакууме. Им нужен физический мир. Кто-то должен доставлять посылки. Кто-то — обслуживать инфраструктуру. Кто-то — выращивать еду и собирать оборудование.

Мы — это «атомная сторона». Мы конкурируем с роботами.

Представьте 10 миллионов задач, требующих человеческих (или роботизированных) рук: сборка компонентов, уборка урожая или ремонт техники. Но есть лишь 9 миллионов роботов, способных выполнить эту работу. Остаётся 1 миллион задач, отчаянно ищущих кого-нибудь — хоть кого — кто мог бы вмешаться.

В экономике это называется «предложение на пределе». Проще говоря: когда покупателей больше, чем продавцов, цены взлетают. Вы не умолете о работе — вас умоляют принять её. Это как быть единственным сантехником в городе, когда у всех одновременно лопнули трубы. Вы сами назначаете цену.

«Конечно, — подумаете вы, — но разве они не построят ещё больше роботов?»

Конечно! Именно так и происходит. С конвейеров сходят новые роботы, предложение растёт, и вдруг люди оказываются вытеснены по цене. Игра окончена, верно?

Далеко не так.

Вот что упускает большинство: пока робозаводы заняты выпуском новых механических работников, в цифровом мире происходит нечто экспоненциально более масштабное. AGI не стоит на месте — он ускоряется. Интеллект удваивается. Виртуальные корпорации расширяют свою деятельность с головокружительной скоростью. То, что вчера требовало 10 миллионов физических задач, сегодня требует уже 20 миллионов. Завтра — 40. Потом — 80.

А производство роботов? Оно по-прежнему движется с обычной скоростью заводских линий. Создание робота требует времени, материалов и физической сборки. Вы не можете просто нажать «копировать и вставить» на гуманоидного робота, как это делаете с программным обеспечением.

И снова возникает разрыв — уже в 10 миллионов задач. Потом он растёт ещё больше. И ещё. Это постоянная игра «догонялок»: роботы немного настигают спрос, а затем AGI вновь резко его увеличивает. Так день за днём, неделя за неделей складывается странное, но устойчивое равновесие, при котором человеческий труд остаётся не просто востребованным, но и высокооплачиваемым. Потенциально — очень высокооплачиваемым.

Спрос цифрового мира напрямую подпитывает нашу физическую реальность, создавая бесконечную погоню, в которой роботы никогда не успевают полностью удовлетворить экспоненциально растущий аппетит цифрового сверхинтеллекта.