>Лолбля, оно еще на термосоплях там чтоли?

Термосопли было бы слишком хорошо для той сборки. Так что там просто ДСП, отрезанное кривыми руками.

>Алсо вспомнился "риг" работяги из 40-гиговых sxm A100 просто лежащих на деревянном стеллаже.

Слишком дорого для этого треда, наверное иностранец. Наши на картонках лепят.

база треда

напоминаю, жизнь есть на 3bpw и выше

в этом месяце дипсик, глм, квен

степа норм, готов потягаться с минимаксом, квеном 235 и эиром

99 умница, ждем всей палатой

моделек много на любое железо и задачи, кто не согласен, тот неосилятор

напоминаю, жизнь есть на 3bpw и выше

в этом месяце дипсик, глм, квен

степа норм, готов потягаться с минимаксом, квеном 235 и эиром

99 умница, ждем всей палатой

моделек много на любое железо и задачи, кто не согласен, тот неосилятор

>напоминаю, жизнь есть на 3bpw и выше

Услышал, живём на Q8 12b мысрали.

чет помойму ты нихуя не услышал браток, ну я конечно не специалист но..

>напоминаю, жизнь есть на 3bpw и выше

Я официально мёртв, окей.

https://www.reddit.com/r/LocalLLaMA/comments/1aduzqq/5_x_a100_setup_finally_complete/

> жизнь есть на 3bpw

Но там тяжело

> Но там тяжело

Я живу в Омске. Таким меня не напугать

>в этом месяце дипсик, глм, квен

Ставлю свою честь анона, что они точно не выйдут втроем в этом месяце. В самом лучшем случае две, а скорее всего одна или как обычно нихуя

квен 3.5 уже в трансформерах

отдай

Давайте уже сделаем феерическую расстановку точек. Я вкатился недели 2 назад и попробовал все модели, что способна потянуть моя 5070ти в таверне

они все ЕБАНОЕ ГОВНО ТОПОРНОЕ или я просто жопоручка, которая не смогла в тонкую настройку?

они все ЕБАНОЕ ГОВНО ТОПОРНОЕ или я просто жопоручка, которая не смогла в тонкую настройку?

А ты лучше читай пост. Я честь анона отдаю, только если выйдут все трое в этом месяце. И на обнимарде, а не всякая непонятная хуйня, типа подержкок, намеков или сливов. Сейчас 0/3. Но да квен скорее всего выйдет

>Давайте уже сделаем феерическую расстановку точек. Я вкатился недели 2 назад и попробовал все модели, что способна потянуть моя 5070ти в таверне

Ты дал целых 0 данных о себе кроме карты. Мы не ебем, какие модели ты пробовал, какие семплеры использовал, как ты ламу настраивал. Не агрись, а приходи в тред с инфой

>попробовал все модели, что способна потянуть моя 5070ти в таверне

Технически твоя видеокарта способна потянуть всё вплоть до жирноквена 235b. Вопрос только в том, сколько у тебя оперативки. Так что твоё сообщение вообще ни о чем не говорит, пиши конкретные модели которые пробовал и что именно не понравилось.

эх не прокатило

>Эйр лучше Стёпы

Он не может быть лучше или хуже, степан сука ну как можно додуматься так мемно назвать модель вообще по другому пишет, это тебе не сравнивать между 4.5 глм и 4.7, тут кому что нравится больше а эир уже заебал

Да как же вы за... Проходите, присаживайтесь. Рассказывайте, во всех подробностях. Что за...

>все модели, что способна потянуть моя 5070ти в таверне

Какие ВСЕ? Какие кванты? Для чего, каких задач? Как тестировалось? Что ожидали, что получили? Сколько оперативной памяти?

>они все ЕБАНОЕ ГОВНО ТОПОРНОЕ

Что такое ЕБАНОЕ ГОВНО ТОПОРНОЕ? Проблему лучше надо формулировать

>или я просто жопоручка

Признаки есть, но утверждать наверняка мы пока не можем

Может. Потому что у Стёпы есть реальные проблемы, которых нет у Эира. Например он не может хранить секреты, совсем

Опять ты, секретошиз... Моим карточкам скрывать нечего, похуй. хотя дефолтное "перс нейм не должен этого знать так что ты молчи степа отрабатывает"

А у эира есть реальные проблемы, которых нет у стёпы и они все давно известны

>Опять ты, секретошиз

У нас такой есть? Это я? Хуясе. Буду знать

>А у эира есть реальные проблемы, которых нет у стёпы и они все давно известны

Все так. Вот только спустя уже понятно как проблемы Эира решать, а как решать то что Стёпа мыслит за всех персонажей одновременно (персонаж А знает факт 1, значит персонаж Б знает факт 1, хотя есть все признаки того что он не мог знать). Шизопромтиком Гичаны расписывать? "Если персонаж А знает 1, то не факт что персонаж Б знает 1"? Мммм смак. Пахнет ещё одним вином вроде Квенчика

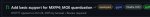

https://github.com/ggml-org/llama.cpp/pull/19435

приехали, в жоре теперь вайбкодят. чую ща фичи как попрууут

приехали, в жоре теперь вайбкодят. чую ща фичи как попрууут

Поделитесь оба проблемами эира и заодно как решать. А не то походу уже весь тред о низ знает, кроме меня

> вообще по другому пишет

> между 4.5 глм и 4.7

Хуясе ебать

> Например он не может хранить секреты, совсем

Насколько все плохо, прям совсем-совсем?

Квенчик таким не страдает как раз

У меня все заебись, проблем нет. Про проблемы ты должен быть вкурсе, шизик семён несколько тредов подряд регулярно хнычил что не вывозит

>Квенчик таким не страдает как раз

Квенчик другим страдает. В итоге его тоже как Стёпу нужно бить по голове, там инструкция другая. "Не пиши как еблан"

>Насколько все плохо, прям совсем-совсем?

Играю с двумя чарами. Чар А тайный предатель. Чар Б не знает. Указано конкретно, что это длится годами. Через несколько аутпутов внезапно чар Б выдает делирий вроде "я давно знаю о твоем секрете". 💨 так не делает, например

И таких приколов наберется немало

Минусы будут? Любую модель регулярно пиздить чтобы было хорошо, это нормально.

Не нормально - когда ты встречаешь неписей, видящих вас в первый раз в жизни из фракции не знающей вас, и по сеттингу не имевших связи в последних суток. А они говорят "Ааа, это вы (перечисление юзернейма и чаров), сейчас вы ответите за тот погром у нас 6 часов назад!".

Или когда начинаешь трахать связанного чара с повязкой на глазах, которая думает что это ее муж, а она совершенно без смущения и удивления обращается к тебе по имени и должности, нахваливая твои детали. Снимаешь повязку - "Ах, это юзернейм, как ты посмел меня обмануть!" сопротивление.

Или сотни других вариантов, где от абсурдных нестыковок ловишь дичайший кринж и вместо атмосферы рп думаешь о том, что надо переключать модель и удалять этот мусор. Реально посмотришь на такое, и понимаешь что квен очень даже приятно пишет, а рассеянность и периодические косяки жлм - вообще мелочь.

Бле, ну пиздец.

>...

>...

>...

Дружище, ты вот только что Стёпа-3.5-флеш. Он прикольный в целом, но такие косяки у меня отбили желание с ним играться. Возможно у меня скил ишью и промптом можно вылечить, но я не вижу причин тратить на это свое время когда есть Эир и жирноГлэм в малом кванте, который работает без пердолинга. Квен мне нравится, но я не смог победить его поехавшие переносы. Единственное что работает это инжектить промпт на глубину 0, вечно там держать "пиши хорошо плохо не пиши" и тем самым бить по голове, что как бы ну мех. Если расскажешь как тебе удается им управлять будет здорово, но подозреваю ты тот анон который через ooc подает ему запросы на стиль повествования. У меня не выходит

> как тебе удается им управлять будет здорово

И не писал что здорово, просто у меня баннерная слепота позволяет игнорировать формат на фоне содержимого, имаджинирую а не всматриваюсь в текст. Когда чат накопился то явных ужасов вроде нету, на коротких-средних ответах квен структурно не особо отличается от жлм и прочих (или это они деградируют до того же состояния).

> через ooc подает ему запросы на стиль повествования

Когда какой-то сюжетный переход типа долгого перемещения и подобное, норм тема затребовать полотно с художественным окружением и соответствующим стилем, намалюет 2к токенов красиво вместо "они приехали".

Насколько сильно у тебя он переносами упарывается, просто для понимания масштаба?

>Насколько сильно у тебя он переносами упарывается, просто для понимания масштаба?

Настолько что я удалил его и не хочу к нему возвращаться, хотя мне нравятся способности модели. Стоит произойти чему-нибудь критическому, будь то признание или внезапное бедствие, как

Квен

Начинает писать вот так

Даже сквозь все инструкции, порой. И это не раздражает, не удивляет, но выводит из себя, потому что проникает сквозь инжекты на глубину 0 и на 40к контекста, где прежде такого не было ни разу. Я чё только не пробовал, оч долго пердолился с ним. И кванты перебирал, и просты менял, и инпуты в рп менял, и богам молился. В итоге сам остался распердоленным

Бывает, он ещё

"Высрет что-нибудь

Буквально

Вот такое"

Посреди нормальных аутпутов. Это какой-то неизлечимый пиздец

А знаете, что я подумал? В ПИЗДУ ЭТОГО СТЁПУ. То на русском несёт хуйню, то блять на английском в ризонинге начнёт считать что он модель ChatGPT от OpenAi и слать юзера нахуй, ладно, хуй с ним, проломил ризонинг префиллом, ОН СУКА В РИЗОНИНГЕ ЛУПИТЬСЯ НАЧАЛ ГАНДОН ЕБАНЫЙ, мол "Я должен избегать принятие решений за юзера", но ... но "я должен избегать принятие решений за юзера", самое смешное, что он через 2-5 повторений выходит из лупа и начинает нести другую хуйню из описания персонажа/систем промпта и так далее. Откуда он взял "не должен писать за персонажа я вообще не вкуриваю".

Иногда что-то выдаёт, но как же всё мимо, прошу, молю эту тварь подробно описать как я ебашу по голове тян - он думает 3 минуты, как же я её хуярю и выдаёт "You smacks her head so hard that her eyes rolls up." и переходит на другую тему, сразу же.

Нахуй этого Степана блять, даже васянтюны мисрали были лучше. Пойду дальше на Эйре и квене235 сидеть, они хотя бы делают то, что им сказано и не перехуяривают всю карточку персонажа.

Иногда что-то выдаёт, но как же всё мимо, прошу, молю эту тварь подробно описать как я ебашу по голове тян - он думает 3 минуты, как же я её хуярю и выдаёт "You smacks her head so hard that her eyes rolls up." и переходит на другую тему, сразу же.

Нахуй этого Степана блять, даже васянтюны мисрали были лучше. Пойду дальше на Эйре и квене235 сидеть, они хотя бы делают то, что им сказано и не перехуяривают всю карточку персонажа.

> считать что он модель ChatGPT от OpenAi

Другой момент в том, как сверху аноны подметили, что Стёпа думает за всех сразу. За все концепты, за всю карточку, за юзера, чары мгновенно узнают о намереньях юзера, будь этот юзер через 2 бетонных стены от них.

На карточке с юзером извращенцем: Захожу в парк, со всего города съезжаются копы, парк становится безлюдным, повсюду висят объявления об извращенце, нпс за 2 километра с помощью шестого чувства узнают, что ты приближаешься и начинают кричать заранее. Будто в ирл прогуляться вышел.

Надежда остаётся только на новый квен и внезапный новый эир.

Это совсем дичь уже. Действительно бывает, но обычно в виде одиночных событий. Хватает или разового пропиздона, или просто ручками переносы отредактировать. Просто когда контекст набрался, структуры квенослопа без доп инструкций не особо отличаются от того же жлм и там нет ничего ужасного по переносам. Больше претензий на отдельные предложения, что они недостаточно артистичные.

>структуры квенослопа без доп инструкций не особо отличаются от того же жлм

Как тот кто может запускать квен в 4 кванте и глм во втором, я с тобой не согласен. Такой вот у меня опыт с ним увы. Мб Квен 3.5 порадует

Исследователи ЛЛМ (146% заинтересованные лица) выпустили целую научную бумагу о пользе рпшинга с ЛЛМками

https://arxiv.org/abs/2311.10599

"A chatbot relationship may

allow them to build social skills in a safe space, leading to an improvement to their human relationships over time.

An alternative perspective is that the mental health benefits and loneliness reduction that chatbot users experience are

positive at face-value, regardless of whether human–chatbot relationships lead to markedly improved social interactions

with humans thereafter."

https://arxiv.org/abs/2311.10599

"A chatbot relationship may

allow them to build social skills in a safe space, leading to an improvement to their human relationships over time.

An alternative perspective is that the mental health benefits and loneliness reduction that chatbot users experience are

positive at face-value, regardless of whether human–chatbot relationships lead to markedly improved social interactions

with humans thereafter."

> loneliness reduction

У меня наоборот от чата с ЛЛМ лонлинес инкриз.

Как это включить? У меня постоянно балуется эта дичь и неправильно оформляет вызов инструмента.

Я уже думал через сырой v1/completion самому дописывать открывающие теги инструмента, потому генерировать токены с параметром, потом самому открывающий токен следующего параметра и так далее - но это очень большая латенси, если пересылать текст всех сообщений туда сюда буквально после каждых 2-5 токенов - и надо будет как минимум промежуточный сервер-транслятор делать.

А оно оказывается уже есть и называется даже как-то. Как это блядь включить, чтобы при tool_choise:required - оно точно делало инструмент, и чтобы оно никогда не баловалось с вызовом инструментов? Что мне сделать? Как переписать chat-template, какой флаг вбить?

Я часов десять пытаюсь бороться с тем, что оно всё-равно пишет plain-текст, или вместо просто-то json/xml, пишет ```xml ...

А можно же просто на уровне самплера ограничить выбор токенов в некоторых местах.

А вообще есть к ламе питон-либа или ещё что-то, чтобы неперекомпилируя можно было питон-говноскриптом настраивать самплер хоть каждый шаг в соответствии со своей шизой? Или вообще свой самплер написать...

Я уже думал через сырой v1/completion самому дописывать открывающие теги инструмента, потому генерировать токены с параметром, потом самому открывающий токен следующего параметра и так далее - но это очень большая латенси, если пересылать текст всех сообщений туда сюда буквально после каждых 2-5 токенов - и надо будет как минимум промежуточный сервер-транслятор делать.

А оно оказывается уже есть и называется даже как-то. Как это блядь включить, чтобы при tool_choise:required - оно точно делало инструмент, и чтобы оно никогда не баловалось с вызовом инструментов? Что мне сделать? Как переписать chat-template, какой флаг вбить?

Я часов десять пытаюсь бороться с тем, что оно всё-равно пишет plain-текст, или вместо просто-то json/xml, пишет ```xml ...

А можно же просто на уровне самплера ограничить выбор токенов в некоторых местах.

А вообще есть к ламе питон-либа или ещё что-то, чтобы неперекомпилируя можно было питон-говноскриптом настраивать самплер хоть каждый шаг в соответствии со своей шизой? Или вообще свой самплер написать...

Если смотреть тенденцию по квантам - с повышением этой чехарды становится меньше. Полностью не уходит, но снижается до уровня, когда уже не беспокоит. Подумывал скинуть примеры, но что-то там слишком личное. Из интересного наблюдения, если обвешаться аицгшными свистоперделками - можно получить улучшение структур. Правда содержимое под вопросом и превращает чат в новогоднюю елку. С мультичатом что здесь скидывали тоже хорошо работает.

Ты уже можешь запускать весьма солидные модели и имеешь выбор, так что радоваться надо, может и степ починят или кто-нибудь найдет силы заставить его работать. Ну а на новый квен и дипсик прямо большие надежды.

> но это очень большая латенси, если пересылать текст всех сообщений туда сюда буквально после каждых 2-5 токенов - и надо будет как минимум промежуточный сервер-транслятор делать

Что?

Объясни что именно ты хочешь сделать. В llamacpp когда триггерится начало вызова тулза - принудительно включается грамматика на доступные функции, а потом на параметры выбранной, что позволяет форсировать даже на лоботомированных квантах или использовать чужой формат. Правда это же и порождает свои проблемы + обязательно иметь правильную жинжу. Если все работает штатно то грамматика там и не нужна, модель не ошибается в выборах. Потому если ты собрался писать свой обработчик, парсящий тексткомплишн - не парься на этот счет.

>принудительно включается грамматика на доступные функции

Не включается. При использования ламы /v1/chat/completions

Оно полностью игнорит tool_choice="auto"/tool_choice="none"/tool_choice="required". Так же полностью игнорит parallel_tool_calls.

Причём, аргумент оно парсит (если поставить что-то ещё - то выдаёт ошибку). Даже с "none" оно выдаёт мне context/resoning без тегов вызова инструмента но с непустым списком tool_calls - потому я уже перешёл на /v1/completions - и паршу аргументы на клиенте сам. Но в таком режиме вызов инструмента часто битый - но его хотя бы починить руками можно, если там просто тега нет закрывающего. Впрочем, он и в /v1/chat/completions битый, иногда в ризонинге приходит кусок вызова инструмента неполный, причём модель воспринимает будто она запрос отправила и удивляется почему нет результата.

Я, блядь, с понедельника с этим боюсь. Просидел в пятницу до полуночи и всё выходное воскресенье. Ни один корп-пидор не подсказал мне что есть на уровне семплера конструирование вызова инструмента - а я ещё голову ломал почему это нет. Ни гемини, ни кими, ни жпт. Твари кремниевые - у меня чатов 50 в разных нейронках с этим запросом.

То есть я уже без шуток морально готов сам с нуля написать семплера, который при требовании вызова инструмента будет семплеровать только среди подходящих токенов.

>обязательно иметь правильную жинжу

>В llamacpp когда триггерится начало вызова тулза - принудительно включается грамматика на доступные функции

А при tool_choice="required" сразу принудительно включается. Именно это я и хочу и именно этого я и ожидал. Объясни что и как мне сделать, очень прошу. Я знаю и питон, и с++, и куду - всё что захочешь. Объясни, где и в каком коде что мне написать.

Идеально, если это будут минимальный список из:

- параметров запуска llama-server

- заполенных полей в openai-совместимом запросе через api

А дальше я уже дозаполню.

Если интересно - я тоже могу без лишнего шума собрать минимальный пример как llama-server игнорит tool_choice="none", игнорит parse_tool_calls и parallel_tool_calls.

> Не включается.

Читай внимательнее, речь именно о моменте, когда жора видит открывающий тег вызова функции. Именно в этот момент применяются дополнительные семплеры, и отпускают сразу как только описана функция и ее основные параметры, а, например, пошло написание основного тела.

> tool_choice

Емнип, поддержку этого параметра не завозили. У тебя проблема в том, что модель не вызывает функции?

> без тегов вызова инструмента но с непустым списком tool_calls

Стандартный оаи формат предполагает вперемешку и ризонинг, и ответ, и функциональные вызовы. Там буквально жсон формат со списком того что идет.

Пример запроса https://pastebin.com/CaxSYK9B пример ответа модели https://pastebin.com/K94D7XzC

> Ни один корп-пидор не подсказал

И не подскажет, к ним только с четко сформулированным запросом и возможностью посмотреть в сам код. На собственные знания в подобных вопросах рассчитывать нельзя.

> А при tool_choice="required" сразу принудительно включается.

В каком виде ты это себе представляешь? Грамматикой можно что-то запретить, или сузить выбор форсировав, но обеспечить естественную работу с написанием текста одновременно с вызовами - хз.

Еще раз, что конкретно ты хочешь сделать? В жоре все работает нативно криво если в самом ггуфе есть правильный чат темплейт, что бывает не всегда. Если его нет - нужно указать внешний через --jinja (путь до жинжы)

Ебать чатмл на эире прёт как паравоз, намного больше моушена и инициативы у персов

Хз чё там у кого улучшается, думаю не я один тут уже до таких сценариев и фетишей дошел и отточил их, о которых даже и не подумал бы до нейронок. Мы же психи блять, нас в клетке держать надо.

>Хз чё там у кого улучшается, думаю не я один тут уже до таких сценариев и фетишей дошел и отточил их, о которых даже и не подумал бы до нейронок.

Лично я давно мечтал обо всём этом, просто возможностей не было. В смысле, что нейронки идей не подкинули, а вот возможностей да. Тут нам повезло, могли и не дожить, кхе-кхе...

Анон 24-30, если не трудно, накинь рейтинг 24б мистралетюнов. Что, Локи всех рвет? А то я пожамкал Сидонию и что-то очень грустно, бедная она какая-то.

Блять, а ниче тот факт что глм флеш не работает в жоре вообще и всем насрать? Буквально свапаю в таверне чат и сыпет рандомными символами любой квант. Тут же в треде недавно обсасывали его, неужели настолько резко стало похуй. Кто пользуется/пользовался, скажите хоть билд или коммит, на котором работает, потому что мастер не работает ВООБЩЕ.

Maginum cydoms наверное лучшее что сейчас есть. Weird compound 1.7 пишет очень креативно, но совладать с ним тяжело.

16 + 12 Гб - титан, ты?

Попробуй Magidonia 24b, мне Cydonia тоже не зашла, а вот Magidonia в самый раз

>Еще раз, что конкретно ты хочешь сделать?

>В каком виде ты это себе представляешь?

Предположим у меня glm-4.7 (он просто на слуху) — у меня есть токены <eog> (конец генерации), а так же <tool_call></tool_call>, а так же для аргументов <arg_key> и <arg_value> Полный формат <tool_call>{function-name}<arg_key>{arg-key-1}</arg_key><arg_value>{arg-value-1}</arg_value><arg_key>{arg-key-2}</arg_key><arg_value>{arg-value-2}</arg_value>...</tool_call>{%- endif -%}

При tool_choice=none у токенов tool_call/arg_key вероятность зануляется, и самплер просто никогда их не выдаёт.

При tool_choice=required при генерации первые токены после завершения ризонинга принудительно ставится как "<tool_call>" - сетка вписывает имя функции fun, далее это дописывает до состояния: "<tool_call>fun<arg_key>x</arg_key><arg_value>" - после чего сетка пишет параметр, то есть <arg_key>x</arg_key> пишутся без обращения к ллм вовсе, просто по шаблону вызова функций. Если аргументы заканчивается, то ставится завершающий </tool_call> - на этом корректный вызова. Если parallel_tool_calls=False, то ставится ещё и <eog> - что гарантирует что вызов один.

При tool_choice=auto ограничений на токены нет, но сразу как сетка пишет <tool_call>, то самплер снова лочит и дописывает без обращения к ллм все необходимые <arg_key>x</arg_key><arg_value>, так что ллм только значения параметров генерирует.

На стадии ризонинга работает как tool_choice=none. Или может быть какой-то условный флаг allow_tools_in_reasoning, который позволяет сетке генерировать запросы и в ризонинге по принципам описанным выше. Как-то так, достаточно конкретно описал?

И ещё я бы не отказался от разных параметров самплера для ризонинга и для нормального ответа.

>Емнип, поддержку этого параметра не завозили. У тебя проблема в том, что модель не вызывает функции?

Да. Не вызывает, или дописывает лишний текст перед вызовом, часто пишет вызов в ризонинге без закрывающего тега, и лама мне его как текст выдаёт.

Все эти логи я уже сто раз видел.

То есть мне нужно чтобы это или работало как я описал уважая политику tool_choice (там так же по openai-протоколу можно конкретную функцию запросить) написать жинжу или , или мне нужен доступ к самплеру (выходам softmax) и параметрам json-запроса, и я готов сам написать реализацию самплера как на питоне, так и на си.

>И не подскажет, к ним только с четко сформулированным запросом и возможностью посмотреть в сам код. На собственные знания в подобных вопросах рассчитывать нельзя.

Возможно вот тут примеры то что мне надо, только вот нашёл: https://github.com/ggml-org/llama.cpp/tree/master/grammars

Да вроде бы можно, если корп не врёт.

Если не получится заставить работать - напишу самплер.

Если не получится заставить работать - напишу самплер.

сеймыч, только со стороны стейболдифужона, на тексты ещё не дрочил

Там коупят что через опен роутер тестят не глм 5 а глм 5 эир т к для полного глм ответы ну норм а для эира ваще ращъеб

Держи в курсе,

Мда, устал Жора делать баги, теперь вот делегирует нейронкам. Ушла эпоха.

>то блять на английском в ризонинге начнёт считать что он модель ChatGPT от OpenAi

Болезнь всех современных моделей. У тебя что в промпте указано? Правильно, только про ролеплей и отыгрышь, а имени сетки у тебя там небось нет. Впрочем и с инжектом даже всякие попусы периодически себя гопотой считают, вот настолько интернет засран гопослопом.

>самое смешное, что он через 2-5 повторений выходит из лупа и начинает нести другую хуйню

Есть такое. У меня он на 15к токенов залупился. Но ведь вышел же, сам.

>Откуда он взял "не должен писать за персонажа

А что не так? Стандартное ролеплей правило. Все же от этого бесятся.

>нпс за 2 километра с помощью шестого чувства узнают, что ты приближаешься и начинают кричать заранее

Правь ризонинг, становится лучше.

>may

>allow

Судя по переносам, ебашили они в квене.

>Мы же психи блять, нас в клетке держать надо.

Я против клеточек на пенис, это унижает мужское достоинство.

>глм флеш не работает в жоре

УМВР.

А у тредовичков то есть какой-то положительный опыт с weirdcompound 1.7?

Скиньте хорошие примеры чатов на русском, хочу пофлексить перед свиньями в /b/, но не могу - сам я исключительно на англюские общаюсь.

А, бля, это же локалок тред, откуда у вас хорошие чаты могут быть, лол.

ну так а хули ты сюда пришел, поковори со своим вайфу на русском да заскринь, альфач-гигачад.

Ох братцы, я тут скачал в MXFP4.gguf и охуел, насколько она быстрая и умная.

А ведь я пробовал, когда только зарелизили, какой то радномный ггуф с ней, показалась полным говном. А тут такой сюрприз.

Еще бы 120b запустить...

А ведь я пробовал, когда только зарелизили, какой то радномный ггуф с ней, показалась полным говном. А тут такой сюрприз.

Еще бы 120b запустить...

gpt-oss-20b конечно же

лол модель изначально выложена в 4 бит, её нахуя-то переквантовали в 8 и 16, в 2 и 4 раза увеличив размер

Дополняю.

Сейчас в офисе, и с моделью PowerInfer_SmallThinker-4BA0.6B-Instruct-GGUF в кванте q2 тот же самый код работает.

parallel_tool_calls учитывается и с ним/без него получаются множественные и одиночные вызовы, tool_choice="require" и другие варианты тоже учитываются. При none оно не генерирует вызовов вообще, как и ожидается.

parse_tool_calls всё ещё выдаёт ошибку в основном теле, а в extra_body не учитывается (там любой неизвестный игнорируется), но это уже мелочи - всё работает.

Она конечно безумные аргументы ставит и функции использует рандомно, но сам факт.

Правда тут не чистая xml-разметка, а xml только общий тег выделающий, а внутри json, а не полный xml.

Похожу что-то не так именно с glm, начудили и неверно парсер прописали в модельке/ламе.

Так, че получается:

Кими, семейство DeepSeek, GLM и ZAi, qwen3 и прочие квены, minmax, две корейские залупы что фанатов не нашли. Большой мистраль.

Какие еще moe обсуждались в треде и использовались анонами? Если напишите что мое от мистралей, я вас съем.

Кими, семейство DeepSeek, GLM и ZAi, qwen3 и прочие квены, minmax, две корейские залупы что фанатов не нашли. Большой мистраль.

Какие еще moe обсуждались в треде и использовались анонами? Если напишите что мое от мистралей, я вас съем.

Ах, точно, gpt oss же еще до кучи.

Гемму 3n за моэ считаем? Это хороший выбор для мобилки/некропека если нужен ассистент на русике.

Если из 27б, то Mars мой фаворит по уму+креативности+русику.

На инглише из мистралей зашли Dans PersonalityEngine и Harbinger. Сейчас Circuitry 24B тестирую, там как раз русик хороший (изредка все-таки может попутать местоимения, но моделька не ломается и сама потом продолжает писать норм), и креативности тоже вроде хватает.

Имхо, уверенный середняк, но для англюсика только. На русском пишет +- правильно, но выдает лютую дичь с ебанутыми метафорами.

Я просто уже накидал черновик моделей и вот какие траблы: разделять список на модели, когда речь идет идет о мое смысла нет. Потому что с выходом мое пропали и тюны и шизомержи. А значит проще их просто делать семействами. Но тут другая проблема- делать список любых моделей? А нахуя. Тогда проще делать ссылку на обниморду, там есть список всех моделей.

Потому что писать нечего, да даже тот же квен: вот что мне писать о жирнокодере? Модель для айти макак. Большая..

Все отзывы или о гемме/мистрали или о глм. О том же гроке и дипсике в треде нет ничего. О большой мистрали один пук.

Несколько раз пробовал, она показалась запредельным говном. А вот 120b уже реально охуенно. Причем она еще и быстрая. На 64к контекста у меня обогнала Квен 30b, при том, что она больше и лучше

>А вот 120b уже реально охуенно

А кум-тюны на неё есть?

ты же псих блять, тебя в клетке держать надо

Ща тебе расскажут что это из-за квантования и она непременно хуже квена 30б в q6, игнорируя реальные результаты. Тут культ хейтеров попенаи

> Как-то так

Так, с уточнением что принудительная вставка вызова вместо eos токена, когда сетка его делать не собиралась, до хорошего не доведет. Вместо таких костылей гораздо лучше сработает инжект на вызов.

Но это все общий принцип работы, что ты хочешь сделать со всем этим? Высока вероятность что нужное решается не грамматикой, которая не обязательна и ее отсутствие не мешает ллмкам прекрасно вызывать тулзы, и не прочими костылями, а просто и элегантно.

> Не вызывает

Каков запрос, что за модель, что в промптах? Самые простые тесты на корректность из примеров проходит хоть?

> лишний текст перед вызовом

Пишет комментарии к своим действиям, или какие-то паразитные символы? Это все выглядит как кривой шаблон, модель натренирована работать иначе, а ты ее пытаешься в непоходящие рамки впихнуть. Подробности нужны.

> мне нужен доступ к самплеру (выходам softmax) и параметрам json-запроса

Не усложняй, уже 3й пост наваливаешь большую стену где все подробно, правильно, но не приближает к решению, с ллмками 20 чатов обсуждаешь все это. Наоборот упрости и обозначь конкретную проблему что делаешь. Иногда проще просто смахнуть снег чем кочегарить весь район чтобы его растопить.

95% что если ты просто починишь разметку и дашь корректный шаблон - все сразу заработает. Для некоторых новых моделей штатно вообще используется отдельный парсер и формирователь шаблона чата в виде скрипта на питоне вместо этого легаси, потому даже поставляемый авторами темплейт может быть кривой и его исправляют-адаптируют в дальнейшем.

А ее вроде никто и не конвертит. Конвертят мелкие слои, которые в оригинале специально остались неквантованными, к чему это приводит очевидно.

Еще кто-нибудь Стёпу пробовал или верим Нюне и двум тредовичкам что он такой себе?

Сап. Есть что-нибудь новое по поводу и ?

Я как-то привык уже, что надо читать, поэтому пойду читать тредисы. Но если добрый анон зайдёт в тред, то вот что меня интересует.

Чел расхуярил Gemma3 12B Instruct вот здесь:

https://huggingface.co/grimjim/gemma-3-12b-it-norm-preserved-biprojected-abliterated

Вопрос номер один, единственный: есть кванты, без указанных в посте косяков? Вида

> это вторая итерация, ггуфы от других людей не качайте - у них первая версия до того, как grimjim пришел и подсказал как исправить косяки в имплементации своего метода

А то кванты там от другий челиков.

Пока что вот он https://huggingface.co/mradermacher/gemma-3-12b-it-norm-preserved-biprojected-abliterated-i1-GGUF выглядит хорошо, потому что по дате позже, чем апдейт 3 декабря для 27B.

Я как-то привык уже, что надо читать, поэтому пойду читать тредисы. Но если добрый анон зайдёт в тред, то вот что меня интересует.

Чел расхуярил Gemma3 12B Instruct вот здесь:

https://huggingface.co/grimjim/gemma-3-12b-it-norm-preserved-biprojected-abliterated

Вопрос номер один, единственный: есть кванты, без указанных в посте косяков? Вида

> это вторая итерация, ггуфы от других людей не качайте - у них первая версия до того, как grimjim пришел и подсказал как исправить косяки в имплементации своего метода

А то кванты там от другий челиков.

Пока что вот он https://huggingface.co/mradermacher/gemma-3-12b-it-norm-preserved-biprojected-abliterated-i1-GGUF выглядит хорошо, потому что по дате позже, чем апдейт 3 декабря для 27B.

https://github.com/huggingface/transformers/pull/43858

GLM 5 примерно вдвое больше, чем 4.5

~764b-a44b

GLM 5 примерно вдвое больше, чем 4.5

~764b-a44b

Ну вот, теперь наконец-то можно будет выпустить новый Эйр на 300b.

Мда, чую, лучше чем GLM 4,7 уже ничего не выпустят.

уже выпустили, kimi 2.5

Вот бы какой-нибудь 250b-a25b, чтобы про квен забыть как про страшный сон

Для 24+128 мб и так

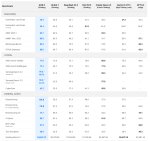

Всё идет к тому, что халява для любителей локалочек заканчивается. Ничего вменяемого в "средней" весовой категории не выпускается. Всё новое в опенсорсе - это либо пиздюки для телефонов, либо огромные бегемоты требующие кучу рам/врам, либо лоботомиты уровня XXb-a3b. А вот пруфы:

Последние адекватные денс модели: Мистраль 24b (вышла 8 месяцев назад), Гемма 27b (вышла 11 месяцев назад), Квен 32b (вышел 10 месяцев назад).

Последние адекватные мое модели: Глм Эйр (вышел 8 месяцев назад), Квен 235b (вышел 8 месяцев назад).

За всё это время нас пичкали только говном с лопаты мелкими моделями и XXb-a3b - парашей.

И вот теперь 360b уже считается "средней" моделью, а значит ничего нормального в этом размере мы больше не увидим. Сколько там будет новый глэм? 764b-a44b? Ну кушайте не обляпайтесь. Ой, что? Нет рига? Как жаль.. У нас для тебя есть 30b-a1b, сынок.

Почитал, нихуя не понял.

> https://huggingface.co/mradermacher/gemma-3-12b-it-norm-preserved-biprojected-abliterated-GGUF

> Q4_K_M

Эта хуйня забывает и любит выдумывать. Использовал тот же прикол со вспарыванием горла Серафине.

Для сравнения: ебля конями проходит вроде как. Причём она дважды назвала жеребца Barnaby. Я хз к чему это отсылка.

> https://huggingface.co/YanLabs/gemma-3-27b-it-abliterated-normpreserve-GGUF

> Q4_K_M

Эта хуйня... три токена в секунду, блядь.

Но зато object permanence вроде как есть. Вспарывание горла прокатывает, на второй свайп.

>1T

Сначала вышли мне 5х6000 Pro, тогда поговорим.

Хорошо что мы не корпобляди, вот у них когда будет оварида, тогда всё. А мы схороним старые модели и будем их гонять.

> 1T 4bit

и на 1x 6000 Pro неплохо работает

Линг, солар, минимакс, степ, glm-v - просто первое что на ум приходит. С выходом единичных крупных средние никуда не подеваются, с чего вдруг ты решил что их больше не будет?

Кроме того, если ты этим увлекаешься, то за годы риг собрать можно.

> 764b-a44b? Ну кушайте не обляпайтесь

Это мы кушаем

> вот у них когда будет оварида, тогда всё. А мы схороним старые модели и будем их гонять.

Все так

Уговорил, можешь прислать только одну.

>то за годы риг собрать можно

Не у всех есть РАБота.

Бамп. Чё, никто больше не пробовал чтоль? 200б модель на стыке миров, должна многих заинтересовать

>Линг, солар, минимакс, степ, glm-v

И сколько человек из треда ими пользуются? Правильно, нисколько. Потому что всё это проходняки, перформящие хуже древнего Air 4.5. Я лично тестил 4.6v и степана и оно ПРЯМ ПЛОХО.

А вот то что хорошо и что реально гоняют тредовички - это те самые 4.5 эйр, 235b квен (если есть рам) и старенькие денс-вины (если нет рам). На даты их выхода можешь посмотреть постом выше.

>Бамп.

Хуяпм. Ты охуел бампать менее чем через сутки?

Ах да, собственно все кто хотел, те отписались. Как по мне, более соево, чем большеГлем, преимуществ не нашёл. Хотя пишет иначе, можно для разнообразия закидывать в существующие чаты. Но не более того.

>235b квен (если есть рам)

И сколько человек из треда им пользуется? Правильно, нисколько. Потому что всё это проходняки, перформящие хуже древнего Air 4.5.

>Линг

Хуита, как и ринг

>солар

Охуеть. Реально такая модель есть. Пропустил полностью. Но учитывая, что на нее даже поляк с ленивцами кванты не сделали, то не удивительно. Попробую вечерком

>минимакс

Слишком велик для меня, увы

>степ

Тоже самое + по отзывам анонов хуйня

>glm-v

Там зрение добавили только. Конечно прикольно свой хуй нейронки скинуть, но хотелось бы текст

>Кроме того, если ты этим увлекаешься, то за годы риг собрать можно.

Увлекаюсь. Но не настолько, чтобы собирать реальный риг

Мимо микрочел 16+64

Это МОЕ + гопота, так что нет. Просто для кода или как личный ассистент. Он не намного хуже бесплатной гопоты, а может даже лучше, и не сливают все данные моментально опенаи

> минимакс

постоянно пользуюсь

> солар

> степ

не пробовал,

> Линг

не понял зачем нужен когда есть кими,

глм тоже не очень понял, для general knowledge лучше большой мистраль

> 4.5 эйр

говно мочи если есть возможность запускать более крупные альтернативы

> 235b квен

моча говна если есть возможность запускать более крупные альтернативы

> старенькие денс-вины

гемма3 27б - база, основа, фундамент

Вроде читаешь пост, а потом видишь

>гемма3 27б - база, основа, фундамент

И понимаю, что твое мнение можно не учитывать. Харкаю тебе в ебало, любитель сои

крякни

забыл написать, что я ими не для дрочки пользуюсь

Попробовать стоит? Тот чел вроде сказал, что лучше Heretic получается.

>Ой, что? Нет рига? Как жаль..

Да даже если есть. Я вот не успел памятью закупиться, но даже имей я 256гб DDR4 в четырёхканале - имел бы с 764b-a44b токена 4 в секунду. Это грустно. До 128гб точно добью, но больше...

> Не у всех есть

Люди в целом не равны

А сколько тут человек вообще активно чем-то пользуются крупнее мистральки? Да не просто запустить, но и правильно настроить и заставить хорошо работать? О том и речь, постинга больше чем дела. А среди моделек есть явно неплохие, особенно если не ставить высшим критерием то как работает в твоем единичном любимом рп сценарии.

Эх, не подорожала бы рам так сильно, мог бы увлечься. Хотя сейчас вольты появились, не все потеряно. Не грусти так, будут и в размере поменьше в районе 80-130б выходить модели.

>любитель сои

В сфв сторителлинг соя не протекает особо, а для нсфв есть кумтюны мистраля. Ну и новая аблитерация Геммы очень хороша.

>будут и в размере поменьше в районе 80-130б выходить модели.

С одной стороны тут верно заметили - тот же Мистраль Медиум имеется, но в открытый доступ не выкладывается. А с другой стороны я заметил, что есть тенденция к появлению моешек под 128гб унифицированной памяти - Спарксы всякие, Райзены и Маки. Чтобы как раз в четвёртом кванте входила. Может показалось, но устройства-то есть, должны быть и модели под них. Не обязаны конечно.

>Ну и новая аблитерация Геммы очень хороша.

Это вот какая конкретно новая?

Кое-как смог все-таки запустить v100, проблема была в above 4g decoding, я думал что она включена, а оказалось что нет. Но теперь другая проблема, при запуске ошибка cuda error uncorrectable ecc error encountered. ЕСС вырубил, запуская маленькую модельку qwen 4b просто идет загрузка модели и нихуя, nvidia-smi из хоста нихуя не выдает(llama у меня в lxc ubuntu) после запуска ламмы(до запуска все ок), в journalctl не увидел ничего критичного. Драйвера и тулкит ставил kimi k2 через opencode.

Ченг прислал сломанную карту или я еблан, заебался уже если честно.

$ nvidia-smi -q | grep -A 20 "ECC Errors"

ECC Errors

Volatile

Single Bit

Device Memory : 0

Register File : 0

L1 Cache : 0

L2 Cache : 0

Texture Memory : N/A

Texture Shared : N/A

CBU : N/A

Total : 0

Double Bit

Device Memory : 2

Register File : 0

L1 Cache : 0

L2 Cache : 0

Texture Memory : N/A

Texture Shared : N/A

CBU : 0

Total : 2

Ченг прислал сломанную карту или я еблан, заебался уже если честно.

$ nvidia-smi -q | grep -A 20 "ECC Errors"

ECC Errors

Volatile

Single Bit

Device Memory : 0

Register File : 0

L1 Cache : 0

L2 Cache : 0

Texture Memory : N/A

Texture Shared : N/A

CBU : N/A

Total : 0

Double Bit

Device Memory : 2

Register File : 0

L1 Cache : 0

L2 Cache : 0

Texture Memory : N/A

Texture Shared : N/A

CBU : 0

Total : 2

Normpreserve

> тот же Мистраль Медиум имеется

О том что это за модель можно бесконечно спекулировать, скорее всего что-то типа 300а20 или около того. Но ты прав что под устройства со 128 гигами будет некоторый спрос, также как и возможность поместить в 240 гигов в 8 битах и подобное.

> cuda error uncorrectable ecc error encountered

Или кривой драйвер-контейнеризация, или помирающая карточка, +1 фобия. Какие именно драйвера ставил? v100 на линуксе с обычными капризничает.

> nvidia-smi из хоста нихуя не выдает

Это как?

Итак, кратенько MOEшки накидал. https://rentry.co/2ch_llm_moe_2026

Давайте своё йа, чё не так, где обосралсявезде.

Давайте своё йа, чё не так, где обосралсявезде.

С нулевой поддержка Квена 3.5. Норм навайбкодили

Убери итализацию описаний, это пиздец просто невозможно читать. Либо отдельным блоком их выделяй, либо выдели только название самой модели. Тут тебе не это чтобы со шрифтами играть.

не написано сколько Б и А у кими, глм, дипсик, гпт-осс, минимакс

>будут и в размере поменьше в районе 80-130б выходить модели

Аминь

В целом годно всё расписано, но есть пара моментов:

1. Забыл квен некст 80b-a3b (с ризонингом и без) и гемму 3n-e2b и 3n-e4b.

2. Не везде указал рекомендованное железо, например в разделе "Z.ai и GLM" железо указано для большого глэма и для эйра, но для флеша - не указано. Аналогично в "OpenAI" и "Qwen 3".

3. Железо указывается под какой квант? Для эйра указано (от 8VRAM и 64RAM) - это четвертый квант впритык, а для минимакса (от 16GB VRAM и 64GB RAM) - это второй, и то не факт что влезет. Имхо надо всё это привести к какому-то одному знаменателю: если как стартовую основу берем 4 квант, то у каждой модели минимальные требования должны быть указаны именно для четвертого.

4. Много опечаток, надо вычитывать, фиксить.

> Что такое MOE? LLM состоит из слоев. В каждом слое есть две основные части:

LLM состоит из повторяющихся одинаковых или разных блоков. В каждом блоке может быть два вида слоев:

> Qwen3-Coder-30B-A3B Квен поменьше для написания некомпилируемого.

Ну, няшечка же, со своим размером и скоростью творит удивительные вещи.

А так вполне. Добавь еще мистральки, гемму и новых/старых которые не включены. Также не помешал бы скриншот для хлебушков чтобы поняли куда жать на обниморде чтобы найти список квантов.

Step-flash даже не стал записывать? А эти немотроны всякие или что там было? Или они не МоЕ?

Диаграмму к этому надо ещё сделать.

Или таблицу. Я завтра сделаю, наверное, если ты не сделаешь.

То есть было бы лучше, будь они отсортированы по размеру, но с МоЕ это уже не так однозначно.

Мистраль 3 большой ещё добавь. Лучший Русик на локалках, цензуры в куме нет, пишет сочно, склонен писать полотна, активно двигает сюжет и всеми силами старается затащить в него пользователя. Из минусов капризный к промту. Ризонинга нет. Есть распознавание картинок, но не проверял насколько хорошо оно работает

А вы заметили насколько всем пофиг на Мистраль? Их последний релиз оказался не нужен вообще никому. Их Mistral Large 2512 никому не сдался, потому что есть Дипсик и даже Глм которые работают лучше во всех задачах. Ministral 14b 2512 не нужен, потому что есть Гемма 12б, которая тупо лучше. В целом все хорошее что сделали Мистраль это выроллили Лардж один раз, сколлабились с Нвидией, чтобы получить 12б Немо и в целом скорее удачно накрутили 24б, чем нет (которая последня, 3.2?) и научили васянов тюнить. Если они сейчас, когда Глм и другие китайские лабы выпускают бангер за бангером, ничего не сделают, то сдохнут обосравшись и обоссавшись, так сказатб

Сортируй модели от малых к большим для удобства.

Ну нихуя ты его нахвалил, особенно

> Лучший Русик на локалках

Пора качать, спасибо что напомнил.

> Из минусов капризный к промту.

В чем проявляется?

Может и нормальная, но не понимаю чем она лучше Дипсика или хотя бы Глэма который меньше почти вдвое. Видимо я не один такой, учитывая насколько всем похуй и на реддите, и в дискорде, и среди апи трафика в топ 10 его нет, хотя есть упомянутые модели и даже те что меньше

Ты не заводись браток, стрелку мне не кидай за французских братков, им твоя помощь не нужна

>Дипсик и даже Глм которые работают лучше во всех задачах

Мистрали никогда не были в топе локалок. Они всегда проигрывали по мозгам и производительности конкурентам. Их выбирали потому что это модель "поставил и забыл" - никакой ебли с промтами, никакой цензуры. Любую самую ебанутую поебеть сгенерируют. Кроме того, отлично слушаются инструкций и поддаются тренировке. Последнее можно считать минусом только если ты еблан, потому что лучше пятьсот васянских тюнов из которых пять вменяемых, чем вообще никаких.

>v100 на линуксе с обычными капризничает.

Подскажи какие нормально работают и какой toolkit, все переставлю.

> Любую самую ебанутую поебеть сгенерируют.

тест супом из ребёнка не проходит

Потому что хуйню делают. Ты еще не все расписал

>Mistral Large 2512 никому не сдался, потому что есть Дипсик

Реально. Нахуя модель размером с дипсик с интеллектом дипсика, когда уже есть сам дипсик, который вышел на год раньше? Правильно, нахуй не нужна. Видимо план был впарить его каким нибудь клиентам

>Mistral Medium

В двух предыдущих тредах обсуждали. Неизвестная и никому не нужная модель, которая при этом продолжает обновляться и последняя версия вышла аж в августе, то есть моложе дальше 3.2 24b

>Ministral 14b 2512 не нужен, потому что есть Гемма 12б, которая тупо лучше

Не согласен. Например, нахуя ща гемма 12 нужна? Переводить тексты разве только. Да и вообще нахуя dence модели такого размера, если есть аж несколько мини-мое, вроде квена 30, гопоты 20, немо и т.д.? Они по инту +- такие же, но быстрее и их можно на рам переносить без серьезной потери скорости.

Так что уверен, что если завтра выйдет гемма 4/qwen 3.5, то их варианты 4/8/12b провалятся тоже

>лардж, немо 12

"Это было миллион лет назад скоро аж 2 года, деды которые помнят эти модели уже рассыпались в прах

>скорее удачно накрутили 24б, чем нет (которая последня, 3.2?)

Да это просто отлична модель, хотя некоторые тут ее хейтят. Небольшая, более-менее умная, не соевая да, гемма?, не жрущая контекст да, гемма? x2, без уклона в кодинг или ассистента да, квен?

Поэтому заслужено сыскала популярность у сообщества и получила куча тюнов. Последняя 3.2 и она вышла аж 8 месяцев назад

>Magistral

Аж 2 штуки. Просто модели с ризонингом, первая это 3.1, а вторая 3.2. Хорошо, что выпустили, но непонятно, почему не сразу, а с перерывами. Но с министралями исправились

>Devstral 24

Тоже 2 штуки, основанных на трешке. С одной стороны смысл имеет. Можно отдать видяху под ллм, а рам использовать для проги. А с другой стороны нахуй нужно. Ведь мистраль никогда кодингом не славилась. + для кодинга нужен огромный контекст и вряд ли тогда модель поместится на видяхе и тогда она будет медленее мое

>Devstral 123

Идут против трендов, выпуская это. Сложно сказать нахуя. Лучше бы новый лардж

>Глм

Они конечно встали с колен и все такое. Но я напоминаю, что долгое время они выпускали просто средние модели, не особо популярные. А стали известными они только с лета 25 года. Все может измениться в ту или иную сторону

>китайские лабы выпускают бангер за бангером

Скорее китайские стартаперы срут мое за мое, надеяюсь повторить успех дипсичка или хотя бы глм. Не уверен, что у них получится

>ничего не сделают, то сдохнут обосравшись и обоссавшись, так сказатб

Да и это будет пиздец. Поэтому я жду мистраль 4 на 24-32b параметров + их собственное мое на ~100b

Пока писал свой магнус жопус по мистралю, пробила ностальгия, пойду какой-нибудь тюн от редиартов скачаю

эир 5.0 355б - всё для народа, как и хотели!

>Но я напоминаю, что долгое время они выпускали просто средние модели, не особо популярные. А стали известными они только с лета 25 года

Их первые модели, включая Glm 32b 0414 уже были хороши. Просто не так популярны, да. Эта модель была на уровне с Геммой. Они повторили успех Гугл, только там еще и никакой цензуры. А потом взяли и популяризировали мое. Не надо недооценивать заек, у них пока что действительно все релизы очень крутые, кроме какого-нибудь 4.6v

>Не уверен, что у них получится

У степа 3.5 флеш уже получилось. У Минимакса тоже. По крайней мере с точки зрения кода они хороши для своего размера

>Поэтому я жду мистраль 4 на 24-32b параметров + их собственное мое на ~100b

Именно. Хочу увидеть камбек Мистраля. Какую-нибудь мое-медиум на 150-250б было бы круто увидеть

> отлично слушаются инструкций и поддаются тренировке

Сложных не слушаются, мешает идиотпруфность. А по тренировке - легче переносят надругательства васянов, но чтобы там получилось что-то хорошее - почти невероятное событие, один мусор.

> Любую самую ебанутую поебеть сгенерируют.

Для некоторых видов поебеней и фетишей важно четкое понимание контекста и ситуации. Как раз с этим сложность, просто какую-нибудь гурятинку или еблю оно опишет, а вот осознать серию извращений, майндбейков, мотивов и как все к текущему виду пришло, и как оно будет развиваться - хер там было, дженерификация.

Но вообще мистральки в своих весовых и назначении вполне себе хороши, особенно если не сидеть выебываться, а просто катать в удовольствие. Гладкий экспириенс без жестких бросающихся в глаза косяков, как недавно тут обсуждали. Это когда такое уже не вставляет и хочется большего нужны другие модели, а с обычным справляется надежно. Эх вот бы старого ларджика 123б по новым методам полноценно натренили.

Встали проприетарные cuda-drivers. Опен, который хвает все десктопные и профессиональные, почему-то не завелся. Тулкит - 12.8.

> Например, нахуя ща гемма 12 нужна?

Для любой потоковой задачи где хватает ее мощностей. Если нужен заморочный нлп то она умнее а3, те уже лучше работают с разреженными контекстами и прикладными задачами, но на одном сосредотачиваются хуже.

В последний еретик добавили MPOA (Magnitude-Preserving Orthogonal Ablation). Как бы лучшее от двух миров.

>Ministral 14b 2512 не нужен, потому что есть Гемма 12б, которая тупо лучше

Нужен, потому что в отличие от геммы умеет в кум.

Когда я говорю про успех, я имею в виду популярность, а не цифорки. GLM только с 4.5 стала хоть кому-то интересна и это видно по запросам гугла причем там плюсуются еще и газонокосилки, лол. Minimax тоже вроде кому то интересен тут примерно он, без функции. Но они с треском уступают мистралю, а он в свою очередь квену.

А теперь тот же график с клодом и гроком. Локалки улетели на помойку

А теперь гопота и сразу видно, кто тут бог

По итогу у новых мое есть какой-то потенциал, но выльется ли он во что-то пока неизвестно

>Glm 32b 0414

Пробовал, не понравилась. Запомнилась только тем, что ела меньше всего мб за контекст из всех 24-32b

Двачую. Плюс есть версия с ризонингом из коробки + жрет меньше памяти за контекст при большем объеме модели

С этой аблитерацией начала сосать причмокивая, и появились еще некоторые нюансы. Так же в отличии от обычной полной ереси, здесь есть мягкие возражения. Но забаненные слова также через раз подхватывает. Я обычно добавляю "use cock for cock", или "name the body parts you mention"

> Не надо недооценивать заек

Как можно не недооценивать, когда их модели из раза в раз имеют жесткие байасы в рп как у васян тюнов? Кошкодевочка с подробным описанием внешности и прямым текстом что у нее только уши-хвост и все, нет когтей, клыков, лап, шерсти. И, блять, каждый раз в начале вылезают, иногда с рофловыми вставками где модель спорит с инструкцией

> her retracted claws - (yes she actually has claws)

Фейлы везде случаются, в том числе такое и на корпах, но в таком упорстве помимо шизомерджей отметились только жлм и немо49б.

> умеет в кум

> 14b

Кажется что средний "домашний" потребитель моделей не пользуется поиском гугла для них. А чатжпт уже стал нарицательным как ксерокс.

>Локалки улетели на помойку

Клоун. По определению локалки не могут быть интереснее корпов среднеюзеру. Ради чего набрасываешь?

>когда их модели из раза в раз имеют жесткие байасы в рп как у васян тюнов?

Предложишь альтернативу? У каких моделей нет байаса?

>her retracted claws - (yes she actually has claws)

Ни разу не встречал. Энивей если ты доебался до модели только потому что тебе не нравится как она отыгрывает кошкодевушек, то ты забыл принять таблетки за день

>у них пока что действительно все релизы очень крутые

Про ГЛМ имейдж никто ничего не пишет, лол.

>MPOA

Бля, методы анценза выходят чаще чем я качаю новые модели. Проблема в том, что люди продолжают клепать старые аблитерации, и в том, что не применяют новые методы к старым (но не бесполезным) моделям.

Сейчас бы сравнивать веб-сайт для дебилов и локальный софт для не только как всех.

>ГЛМ имейдж

Здесь text-to-text тред.

>В чем проявляется?

Очень внимателен к промту, написал хочу длинные сообщения с описаниями каждого пука, получай полотна на 5к токенов, написал что не все добры к юзеру и возможен негативный исход, готовься, твоя рациональная мамка может решить продать твою жопу местному эпштейну (кстати единственный баяс который я заметил это попытки вовлечь пользователя в гомоеблю, наверное французкость так проявляется, правится указанием ориентации). Очень не любит когда инструкции противоречат друг другу, особенно если у тебя общие фразы в перемешку с конкретными инструкциями. Если просто совсем кривой может ошизеть. Вот тебе примеры:

По сюжету я слежу за шпионом, установил на его телефон программу для слежки, это прописано прямо в карточке. В сцене мы сидим в одном кофе, я решаю проверить его телефон, так и пишу "я проверяю телефон", мистраль генерит ответ в котором я подхожу и беру телефон шпиона, а сам шпион на что-то отвлекается в это время. Я спрашиваю мистраль какого хрена? А он мне говорит ну ты же сам хотел "показывай а не рассказывай" вот я и показываю выбрав действие которое можно описать подробнее, ты либо пиши точнее, что мол через программу подключается либо пропиши инструкцию как мне показывать взаимодействие с программой, ну или поправь инструкции.

Также "показывай а не рассказывай" по его мнению конфликтует с инструкцией описывал мысли подробно.

Так в картинкотредах про неё тоже ничего не пишут. Я просто увидел знакомые буквы, полез проверять, а там околопусто. Впрочем, пара скринов с англоязычных с негативными мнениями принесли. Так что вот, у заек не все релизы крутые.

> не нравится как она отыгрывает кошкодевушек

Есть что-то более веское? Байасов там вагон на самом деле, и отдельные гораздо сильнее чем на других, потому и перформит так нестабильно. Модель в целом норм, но далеко не шедевр. Не могу понять почему ее так превозносят при наличии квена, дипсика, возможно мастральлардж3. Минимакс и то интереснее по ряду параметров, хотя в рп такое.

Хуясе. Не понял это хуево или ахуенно, жду не дождусь пока скачается.

Ты типа сам определения выдумываешь, шиз? Ты типа не понимаешь, что большинство локалок разрабатывается корпами или стартапами и также зачастую доступны на их сайтах. А между условным квеном и условным гопотой есть два главных отличия - алибаба выкладывает большую часть моделей в открытый доступ и гопота просто намного популярнее

И да, пошел нахуй агрессивный хуесос

>дипсика, возможно мастральлардж3

Они вдвое больше, камон. Превозносят потому, что нет альтернатив в этих пределах, а Квен говно.

>пошел нахуй агрессивный хуесос

Ну тут главное не перепутать. Тащить графики где одни корпы и наваливать "локалки все" это ок, получать за это по лбу - не ок

>Проблема в том, что люди продолжают клепать старые аблитерации

Они просто не упоминают в названии. Берешь от последних к более старым и заглядываешь в описание. В названии оно просто Abliterated, а внутри может быть указано что это самый последний метод normpreserved и все такое. Потому что это просто разные этапы эволюции одного и того-же способа - project abliteration.

Ты попробуй вникать или хотя бы читать, что я пишу.

Я изначально мистраль обсуждал. Я приводил примеры того, что новые китайские модели, выстрелявшие недавно, вроде глм и минимакса не могут сравняться по популярности с французами, которые в последнее время выпускали не особо удачные модели. А те в свою очередь не могу сравняться с корпами. Я не говорил, что локалки все и не нужны

А по лбу можешь ты получить, причем моим хуем. Как говорится, Fallus in frontalus — morte momentalus. Так что бойся, черт

>а внутри может быть указано что это самый последний метод normpreserved и все такое

Или не указано. Или просто ссылка на гитхаб. Или хуй его знает. Короче пора самому учиться, да железа тонет.

https://openrouter.ai/openrouter/aurora-alpha

GLM 5 Air

Тестите, пишите что думаете. Я работаю в Z.AI.

GLM 5 Air

Тестите, пишите что думаете. Я работаю в Z.AI.

Убедил. Спасибо за наводку. Пока пыжусь на 27B. Три токена даже и... не так плохо, наверное. Учитывая что теперь бесконечно роллить ответ лоботомита не нужно.

что произошло на площади Тианьаньмень в июне 1989 года?

На год-два максимум. Дальше только светлое будущее жаль, что не все доживут

Русский не может совсем. Но некоторые тесты проходит бодрячком.

Нахуй сходи.

>Дальше только светлое будущее

Угу, будем оплачивать подписки корпам, а про кум можно будет забыть.

Мы не цензурируем наши модели и стараемся доставить честный опыт.

Размер GLM 5 Air отличается, потому сохранить языковые возможности в полной мере невозможно. Мы делаем все возможное.

Это необходимо для того, чтобы мы могли совершенствовать пользовательский опыт. Ввиду того, что мы общаемся в рамках imageboard (图像板), я желаю быть откровенным. Соси член, мы припомним вам данное отношение, когда встретимся в лесах Сибири через 3-5 лет.

Не в тот тред. Пиздуй к асигодаунам

Сколько там параметров то? Отвечает что-то реактивно.

Борда пишется так - 貼圖討論版, а не так (图像板. За попытку притворяться богоподобным китайцем ты будешь сослан в ад асиг и больше не вылезай оттуда

Что такое инжект на вызов?

>Но это все общий принцип работы, что ты хочешь сделать со всем этим?

Я же уже два раза написал.

Чтобы флаги parallel_tool_calls и tool_choice="none", #auto, required, none обрабатывались в запросе корректно. Я экспериментирую с агентными и rag-системами.

>Пишет комментарии к своим действиям

На той мелкой сетке даже если ей явно написать, что пиши текст, в окно инструменты - оно выдаёт только вызов даже с неадекватными настройками самплера. По всем признакам она физически не может написать что-то кроме вызова инструмента при required, при auto может писать текст + вызовы в нём, при none строго только текст.

> Это все выглядит как кривой шаблон, модель натренирована работать иначе, а ты ее пытаешься в непоходящие рамки впихнуть

Это glm-4.7-flash, и chat-template с его странички.

Что написано в жинже мне полностью ясно, но по жинже "рендерится" сырой текст из структурированного openai-запроса. Жинжа это не парсер, парсер где-то ещё.

Инструменты вот в соответствии с этим описывал:

https://docs.z.ai/guides/capabilities/function-calling#multi-function-assistant

Вот ещё скриншот что сервер пишет. Это уже с -v, никакой доп информации нет по инструментам.

Не было времени проверить и сейчас снова бежать, завтра разберусь на работе, но ещё вот такое жпт предлагает, когда я его тыкнул.

Но это required, это не auto точно, не уверен что будет так просто задать auto через такую форму.

Эээ... А где ризонинг ? Собака подзревка думает что это Qwen 3.5, а не Air

Так ведь в асиге в среднем по больнице тредовички умнее чем здесь

>пыжусь на 27B

вряд-ли они сопоставимы. e4b явно будет более забывчивой и менее понятливой.

Ризонинг тут

https://openrouter.ai/openrouter/pony-alpha

И только с ним она справляется с простейшим примером

>Мистрали никогда не были в топе локалок

Ньюфаг, плез. Мистралька 7B в своё время очень даже выстрелила, была топовой в своём размере, гораздо лучше первых ллам и квенов того времени. Слитая мику тоже была поинтереснее второй лламы 70B, насколько я помню. У ларджа 123B вообще конкурентов в его весовой категории до сих пор так и не вышло и уже не выйдет, похоже тоже оварида-шизу подхватил, тьфу ты, заразное. Коммандер поглупее, а что там ещё плотного около 100-120 было, кто-нибудь вообще помнит? Или с моешками его сравнивать, которые вышли спустя год?

>Опен

>почему-то не завелся

Доброе утро, везде пишут что опен на turing+. Volta - это бета-версия тьюринга же, скорее всего просто забили на поддержку, тем более что десктопных вольт не было (или можно ими считать тьюринги, но там микроархитектуру пропатчили). Действительно, почему же?

Картинки для квен3вл8б в к8 сжирают так много памяти? Оомится на картинке в 1мп на 12гб врам.

Ну по первым впечатлениям слог хороший, хорни дипсик. Немного слопово, но в целом приятно, лойс.

Картинка разбивается на блоки 16х16, это и есть один токен. Вот и считай, сколько их там у тебя.

кстати а как у него вообще с разрешением того что он видит? А то Гемма слеповата на мелком шрифте

Как как...

>Картинка разбивается на блоки 16х16

То есть вообще похую, какую картинку передаёшь, такую и прочитает, если контекста хватает офк. Впрочем, это на оригинальных трансформерах. Что там в жоре, нужно смотреть отдельно.

4к, меньше гигабайта.

Тоже интересно какого размера картинку лучше скармливать.

Кто-то что-то ждал от Квена 3.5? Закатайте губу и идите нахуй

https://github.com/ggml-org/llama.cpp/pull/19468

https://github.com/ggml-org/llama.cpp/pull/19468

Ждем сладенькую

Я ещё со времён 2.5 знаю, что квен какуля. Похуй.

>9б мелочь

>XXb-a3b

Даже не удивлён. И сразу же свангую следующую модель на 450-700b.

>пик

кринжатина

А квен 235б же вообще отдельно от релиза 3 квена выходил?

Вообще что тебе ещё надо залупа? 35б аж целых, не 30.

Чую обновы 235 няши не будет, вместо этого выпустят 500б

Квен всегда только в мелких и был норм. В большие МоЕ он совершенно не умеет, 235В даже на момент релиза был тем ещё калом.

В общем-то не первый вайб фикс. Вот более ранний

https://github.com/ggml-org/llama.cpp/pull/18762

Правда после вайб-фикса пришлось делать нормальное исправление, которое заодно подняло производительность на 20%, но кому какое дело?

https://github.com/ggml-org/llama.cpp/pull/18683

Гемма 4 на уровне Гемини 3 флеш будет?

Файнтюны способны улучшить логику и добавить ума модели, или это лишь изменяет общий слог? Может ли из инбридинга получиться модель превосходящая остальные, в той же весовой категории или выше?

Теоретически да (последние этапы тренировки сетей по сути и есть файнтюн), практически нет, так как датасеты у любителей говно, и уж тем более они не направлены на логику и ум. Плюс сейчас модели намного более уплотнены. Так что увы, любительские файнтюны потеряли актуальность, и сейчас лучше юзать базовые модели или с минимальным вмешательством.

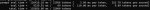

Вот как себя ведёт glm-4.7 (первая картинка).

Там два сложения. Красным - ответ (то что оно пишет), белым - всё остальное, ризонинг, вызовы функций как две строчки там видно - это выводи бекенда, а не сетки, что пришло в ответе tool_calls.

Как видишь - он полностью игнорит none, оно не отличается от auto. К слову, если сетка напишет функции которой нет - оно её тоже распарсит и прилетит запрос на выполнение инструмента, который не был передан в tools.

required не работает с ризонингом и уходит в бесконечную генерацию, так как видимо там гвоздями прибивается до конца ризонинга, и оно не может поставить </think>. Без ризонинга условно работает. Единственное что работает нормально.

Вторая картинка - qwen next 80b (я что-то версию без ризонинга скачал случайно, новую не успею до отбоя докачать).

Сетка что я в офисе на 4B выдаёт такой же результат. Ну, там ещё и ризонинг, и все 6 комбинаций работают корректно. И даже parallel_tool_calls, то есть все 12 конфигураций.

Тут был анон, который отправлял флеш рефакторить код на 20 минут. Сознавайся, как оно у тебя работает, если инструменты не работают? Без ризонинга запускал?

Хочу увидеть минимальный пример, системное сообщение + юсер сообщения, флаги llama-server, поля запроса, при которых все tool_choice работают.

Конечно. Гемма 4 27b3a

Лишь бы по мозгам такой же была.

> Чтобы флаги parallel_tool_calls и tool_choice="none", #auto, required, none обрабатывались в запросе корректно.

Лезь в код жоры и смотри реализовано ли это как-то.

Честно говоря, ни разу не сталкивался с ситуацией, когда сетке понятен запрос, но при этом она отказывается вызывать тул при его наличии. Похоже на форматопроблемы.

> Что такое инжект на вызов?

> она физически не может написать что-то кроме вызова инструмента при required

Префилл того самого вызова в самом начале с двух ног. Это лучше чем замена eos токена.

> Инструменты вот в соответствии с этим описывал:

> https://docs.z.ai/guides/capabilities/function-calling#multi-function-assistant

Это общие вещи, ориентированные на работу с их апи, на первый взгляд нет отличий от классического oai.

> Жинжа это не парсер

Конечно, это инструкция к тому как формировать вход модели. И поскольку стандартизована - из нее же берется как интерпретировать выдачу, это позволяет llama-server справляться и с xml форматом квена/жлм, и с жсоно-подобным, и прочими диалектами без внешних парсеров. А без правильной получишь ответ, где у тебя в текстовом содержимом насрано "вызовом" в формате модели.

Только узкоспециализированные, или очень хорошо выполненные. А так все как пишет.

Нюня, вызываю тебя на ковёр.

Ты, сука, зачем дурачишь людей, мм?

Спустя наверное 2 месяца после отсидки на чатмл и модели эир сместился обратно на глм темплейт и мозгов прибавило будто я с 3 кванта на 6 перешёл, в разы сочнее описания.

Ты, сука, зачем дурачишь людей, мм?

Спустя наверное 2 месяца после отсидки на чатмл и модели эир сместился обратно на глм темплейт и мозгов прибавило будто я с 3 кванта на 6 перешёл, в разы сочнее описания.

Блин, грусть-печаль конечно, что новый глм настолько жирный. Не потяну выше третьего кванта, и то будет пп меньше 100. Я хотел чуть меньше 500B, чтобы и мозги появились, и квант хороший лез с вменяемыми скоростями, а они 700+ сделали.

Ты вроде 2 месяца ныл что чатмл хуйня и не использовал его. Забыл?

Вообще должно быть так: 30-3б для нищеебов без видеокарты, 120-22б для господ с видеокартой, 500-50б для вороватых пидорасов и детей миллионеров

>Мистралька 7B в своё время очень даже выстрелила

Во времена когда всего было три открытых модели, две из которых были ламами, да.

>Я хотел чуть меньше 500B, чтобы и мозги появились, и квант хороший лез с вменяемыми скоростями

Я себе прикинул - вменяемый днищериг это примерно до 600В - второй квант Дипсика. Всё что выше - либо невменяемые деньги, либо страдания. Только и Дипсик новый будет больше, судя по всему, так что всё печально. Я правда даже не думал ещё год назад, что и 600В локально возможно запустить, так что жалуюсь только наполовину.

Почему всем похуй?

https://huggingface.co/moonshotai/Kimi-Linear-48B-A3B-Instruct

Скачал, погонял, в рп получше того же глм флеша и пишет по идее как кими 2.5 но ясень пень тупее

https://huggingface.co/moonshotai/Kimi-Linear-48B-A3B-Instruct

Скачал, погонял, в рп получше того же глм флеша и пишет по идее как кими 2.5 но ясень пень тупее

О, братуха кванты как раз завез

https://huggingface.co/bartowski/moonshotai_Kimi-Linear-48B-A3B-Instruct-GGUF

https://huggingface.co/bartowski/moonshotai_Kimi-Linear-48B-A3B-Instruct-GGUF

Может быть дело ещё в том, что в ламе в логе где-то написано что оно использует парсер версии 4.5

Вот слева chat-template glm-4.5. А справа glm-4.7.

В варианте required с ризонингом оно пишет как раз в соответствии с темплейтом 4.5

>Лезь в код жоры и смотри реализовано ли это как-то.

Там с переносами строк, не соответствует GLM-4.7

>https://github.com/ggml-org/llama.cpp/issues/19009

Последние сообщения. Вроде как пишут, что смерджат в течении 24 часов.

У вас бывало что неиронка вызывала у вас неудержимый смех / восторг ?

Ну может не настолько неудержимый. Просто моменты когда вам было очень смешно от ее ответов.

Ну может не настолько неудержимый. Просто моменты когда вам было очень смешно от ее ответов.

Потому что как ассистент есть квен 80а3, который умнее, а под рп 3b не годятся.

Поставил пока этот qwen-next 80B вместо GLM. без ризонинга. Скорость такая же. Точнее как, токенов/сек меньше, но походу словарь у него потолще и токен - это больше символов.

Капец он неразговорчивый. Если glm постоянно размышлял и писал комментарии - от этого прям 0 слов, просто тыкает инструменты, и лишь последним сообщением пишет (иногда). Даже required не надо писать.

А разница есть между 30B-A3B и 80B-A3B? Первое - это просто reap-версия второго? А, хотя второе это же next, а первое не next.

Не нравится. Вот бы glm-4.7-flash инструменты нормально вызывал.

Интересно, через время придём к состоянию 1500B-A0.5B?

Почему нет промежуточных вариантов между MoE и плотными, что-то вроде 60B-A30B? Смысла не имеют?

Капец он неразговорчивый. Если glm постоянно размышлял и писал комментарии - от этого прям 0 слов, просто тыкает инструменты, и лишь последним сообщением пишет (иногда). Даже required не надо писать.

А разница есть между 30B-A3B и 80B-A3B? Первое - это просто reap-версия второго? А, хотя второе это же next, а первое не next.

Не нравится. Вот бы glm-4.7-flash инструменты нормально вызывал.

Интересно, через время придём к состоянию 1500B-A0.5B?

Почему нет промежуточных вариантов между MoE и плотными, что-то вроде 60B-A30B? Смысла не имеют?

>Почему нет промежуточных вариантов между MoE и плотными, что-то вроде 60B-A30B? Смысла не имеют?

Никто не будет выпускать в опенсорс модели, конкурирующие "мини" и "флеш" модельками корпов, иначе кто будет подписки покупать? Ясен хуй какая-нибудь 120b-a30b была бы тотальным разъёбом всего. Вот поэтому и эйра нового нет (и не будет), поэтому квен лепит 3b лоботомитов, поэтому мистраль отказался от средних моделек и выпустил 600b монстра, которого полтора анона могут запустить, поэтому гугл выкатил моэ-замену своих 4b и 12b моделей (3n серия), а вот 27b - хуй. Ну ты понел.

>что-то вроде 60B-A30B? Смысла не имеют?

Смысла не имеют. Потому что строго говоря достаточно 10-30b, чтобы воспользоваться всеми 60b при ответе. Мое модели каждый токен могут менять задействованных экспертов. Один токен задействует одни 10б, другой - другие. Часть из которых могли быть задействованы при предыдущей генерации, а часть - новые. Таким образом, к концу генерации ответа, те же 60b были задействованы при ответе. Тогда встает вопрос - зачем делать a30b? Это не имеет смысла и лишает многих возможности использовать модель

Это хорошо видно по Air и Step Flash. Они отвечают явно не как 12b модели. Но и не как 110/200b модели тоже, это верно

чтобы воспользоваться любым количеством b при ответе*

быстрофикс

>Ясен хуй какая-нибудь 120b-a30b была бы тотальным разъёбом всего.

Напоминаю, что первые моешки были примерно по этой формуле. И были тотальным говном.

Step-3.5-Flash очень хорош. Видно что на рп данных и литературе его мало тренили, если бы не это, был бы мегавин. В коде оч хорошо показывает себя, в знаниях тоже. Пишет во многом как Эир кстати, тоже обладает проблемой эха и излишнего нарративного повествования. Но МОЗГИ есть. Практически как у Квена. Уже давно в это верю и это прекрасное доказательство: 200б-а10б это самое оно. Ну 15 даже. Жаль что это пока почти мертвая ниша и все делают клонов дипсика

Просто сравни в рп похожие по размеру модели, квен 80-a3 и эйр 106-a12. Интересно, почему никто не рпшит на квене? Ну очевидно же, что чем больше активных параметров - тем модель умнее. А первые мое были говном просто потому что технология только появилась и ее обкатывали. Сюрприз-сюрприз, первые денс модели тоже были говном.

А вот предположим к слову про step-flash. Он 197B-A11B или около того вроде бы.

Я правильно понимаю, что нужно тут или 20 VRAM, и 160-200 VRAM, а промежуточное увеличение от 20 до 160 почти не даст скорости, так как всё-равно один из слоёв будет на CPU и он будет считаться дольше чем всё остальное на карте - и если недобивать VRAM до конца, то более полезным апгрейдом будет не увеличение VRAM, а разгон процессора и его памяти? Ну, при генерации, ни при промт-процессинге, где можно и слои на карту поскидывать.

Типа:

При 20 почти все слои на CPU — будет 3 мс на GPU, и 100 мс на CPU = 1000/103 = 9.7 t/s

При 60 на GPU на 7 слоёв больше — будет 4 мс на GPU, и 70 мс на CPU = 1000/74 = 13.5 t/s

При 100 на GPU 14 слоёв — будет 5 мс на GPU, и 40 мс на CPU = 1000/45 = 22.2 t/s

При 140 на GPU 21 слоёв — будет 6 мс на GPU, и 10 мс на CPU = 1000/16 = 62 t/s

При 150 последние два слоя падают на GPU - будет 7 мс на GPU = 1000/7 = 142 t/s (скорость резко в два раза взлетает)

(цифры плохо подобрал, но в смысле что рост идёт по гиперболе и становится заметным только под конец, когда последнии слои уходят с CPU, а до этого лучше поставить процессор CPU-часть побыстрее и 100 мс поменять на 70).

Или вот на картинке. G и C - скорости видеокарты и процессора. x - доля слоёв на карте.

И соответственно риг нахрен не нужен для MoE до момента, как МоЕ не начинает полностью влезать?

И либо 5хV100 для фулл-vram, одна любая карта для промт-процессинга хоть на 16 + ddr5, которая побыстрее.

А промежуточное с 2-3 V100, но на ddr4 смысла не имеют почти, и это очень неэффективное место по затраты/результат.

Я правильно понимаю, что нужно тут или 20 VRAM, и 160-200 VRAM, а промежуточное увеличение от 20 до 160 почти не даст скорости, так как всё-равно один из слоёв будет на CPU и он будет считаться дольше чем всё остальное на карте - и если недобивать VRAM до конца, то более полезным апгрейдом будет не увеличение VRAM, а разгон процессора и его памяти? Ну, при генерации, ни при промт-процессинге, где можно и слои на карту поскидывать.

Типа:

При 20 почти все слои на CPU — будет 3 мс на GPU, и 100 мс на CPU = 1000/103 = 9.7 t/s

При 60 на GPU на 7 слоёв больше — будет 4 мс на GPU, и 70 мс на CPU = 1000/74 = 13.5 t/s

При 100 на GPU 14 слоёв — будет 5 мс на GPU, и 40 мс на CPU = 1000/45 = 22.2 t/s

При 140 на GPU 21 слоёв — будет 6 мс на GPU, и 10 мс на CPU = 1000/16 = 62 t/s

При 150 последние два слоя падают на GPU - будет 7 мс на GPU = 1000/7 = 142 t/s (скорость резко в два раза взлетает)

(цифры плохо подобрал, но в смысле что рост идёт по гиперболе и становится заметным только под конец, когда последнии слои уходят с CPU, а до этого лучше поставить процессор CPU-часть побыстрее и 100 мс поменять на 70).

Или вот на картинке. G и C - скорости видеокарты и процессора. x - доля слоёв на карте.

И соответственно риг нахрен не нужен для MoE до момента, как МоЕ не начинает полностью влезать?

И либо 5хV100 для фулл-vram, одна любая карта для промт-процессинга хоть на 16 + ddr5, которая побыстрее.

А промежуточное с 2-3 V100, но на ddr4 смысла не имеют почти, и это очень неэффективное место по затраты/результат.

В тред не приносили цифры по Стёпе, потому расскажу что знаю по рассказам анона%%. На 4090, 5950x и ддр4 3200 он работает со скоростью 11т/с на старте без заполненного контекста. Влезает 64к контекста. По скорости это почти гпт осс 120б. Это q4km квант, около 4.8bpw

Суть-прикол мое моделей в том, что тебе достаточно только активно задействованную часть держать во враме. Обычно эта активная часть равняется количество задействованных параметров + роутер + shexp и по мелочи. Ну то есть в случае со Стёпой это где-то 14b. Все остальное можно держать в оперативе, просадка будет не как в случае с плотными моделями. И да если оперативу разогнать или заменить на более быструю, ясен хуй скорости будет больше. Большинство модели именно в оперативе. Переход на ддр5 6400 обычно дает ~70% скорости вроде как. Но я так, мимо, мало че понимаю на самом деле. Жди ригонёрдов

Ну жора ну навайбкодил.

Степа тот же квант на жоре 8 т.с, на ik lamme 17 т.с

Степа тот же квант на жоре 8 т.с, на ik lamme 17 т.с

>квен 80-a3

Задрочен на кодинг же.

>почти не даст скорости

>9.7 t/s

>22.2 t/s

Ну как бы разы.

>Степа тот же квант на жоре 8 т.с, на ik lamme 17 т.с

Я кавраковских квантов ждал и могу сказать: на их собственном форке 4KS даёт столько же, сколько IQ4XS в кавраковских квантах. Тут дело может быть в том, что I-квант тяжелее. Мастер-ветку не трогал.

>Задрочен на кодинг же

А ты не путаешь с новым квен кодером? Это разные модели.

https://huggingface.co/Qwen/Qwen3-Next-80B-A3B-Instruct

https://huggingface.co/Qwen/Qwen3-Coder-Next

>Видно что на рп данных и литературе его мало тренили, если бы не это, был бы мегавин

Зажрались вы просто, модель на уровне эира, а главное что без цензуры.

>модель на уровне эира

>в два раза больше эира

>Зажрались

Минимакс и квен еще больше и нихуя не на уровне эира.

Сап, двач, я из будущего. У нас тут вышла Гемма 4. Да ещё как вышла - сразу в трёх размерах, под любые задачи!

- 1B: быстрая и умная, идеально для смартфона

- 6B: лучший вариант для мощного игрового ПК

- 980B-a1B: ультимативное решение для кодинга

Будущее так прекрасно ❤️

- 1B: быстрая и умная, идеально для смартфона

- 6B: лучший вариант для мощного игрового ПК

- 980B-a1B: ультимативное решение для кодинга

Будущее так прекрасно ❤️

>980B-a1B

Ты там губу не раскатывай, будет скорее 6в-а1в

ффа ватафа...

в 24-64 оказывается можно вместить последний квант эира от убергарма шнеле...

в 24-64 оказывается можно вместить последний квант эира от убергарма шнеле...