база треда

glm уже вышел, скоро будут квен3.5, минимакс 2.5, deepseek

жизнь есть на 3bpw и выше

99 умница, ждем обратно всей палатой

степа 3.5 флеш отличная модель для кода, ассистента и норм модель для рп

моделек много на любое железо и задачи, кто не согласен, тот неосилятор

glm уже вышел, скоро будут квен3.5, минимакс 2.5, deepseek

жизнь есть на 3bpw и выше

99 умница, ждем обратно всей палатой

степа 3.5 флеш отличная модель для кода, ассистента и норм модель для рп

моделек много на любое железо и задачи, кто не согласен, тот неосилятор

База треда - это ниже 500В нет жизни, все 100-300В кал.

слабо, попробуй еще раз

В целом да

Q1 - не юзабельно, кроме специфичных кейсов

Q2 - юзабельно только для больших моделей, которые вроде GLM 4.7

Q3 - юзабельно, но со значительной потерей качества, но все равно можно рассмотреть

Q4 - юзабельно, с этого момента потеря качества не такая большая. По сути это и есть тот квант на который надо ориентироваться

Q5 - хорошее качество, если влезает, то бери его

Q6 - близко к идеалу, выше как правило не надо

Q8 - используется как правило только для маленьких моделей, вроде 1-8b или в специфичный моментах, где сильно нужна точность

База треда: мёртвое хобби, теперь и для 2 квантовых.

У тебя вот в лучшем случае Q2 мозг. И моделька где-нибудь 22б

Будешь обзываться навалю тебе на лоб

Если там ещё осталось место после релиза глм 5

Терпи. А мне есть на чем инджоить

Терпим вместе, халява кончилась

>Актуальный список моделей с отзывами от тредовичков:

>онли хуе-мое

о как

>онли хуе-мое

о как

Мы всем тредом не заметили классных плотных хуе-мое няш? Покажи

плотные мелкомодели актуальны, до 30б никому нафиг не надо моэ выпускать, при всем при том они в любом случае АКТУАЛЬНЫ. Вот что я хотел сказать.

Мы, видимо, все поневоле застряли на старых моделях, потому что ничего нового [пригодного для РП] в среднем размере не выходит. Поэтому вот вам фундаментальная база на 2026 год:

Если нет рам: мистраль 24b, гемма 27b (для сфв)

Если есть рам: эйр

Если много рам: квен 235b, глм 4.7

Если нет гпу: немо, министраль 14b

Терпим дальше, делаем бекапы последних годных моделек.

Если нет рам: мистраль 24b, гемма 27b (для сфв)

Если есть рам: эйр

Если много рам: квен 235b, глм 4.7

Если нет гпу: немо, министраль 14b

Терпим дальше, делаем бекапы последних годных моделек.

>Если нет рам: мистраль 24b, гемма 27b

Командер 32б и GLM 0414 еще.

>ничего нового

>министраль 2512

>ничего нового

25 . 12 . Это буквально вчера было, лул.

мимо 24 врам, министраль енжоер

>Командер 32б

Слишком устарел, тупее мистрали.

>GLM 0414

Это у которой кокбенч 7%?

Модель без кума не модель

>кокбенч 7%

Тяжелый, протяжный вздох.

Всем тредом на этой модели кумили как поехавшие, потому что цензура там легко отключается промто.

Ты в курсе что у тебя 10b параметров спиздили?

>24 врам

>министраль енжоер

Но... зачем?

>Это буквально вчера было

Это и не средняя модель, это мелкота для страдальцев без видеокарты. Но получилась внезапно годной для своего размера.

Нихуя у 4 лламы скачиваний за этот месяц, я чего то не знаю?

Я думал она мертвая и забытая лежит с момента выхода

Я думал она мертвая и забытая лежит с момента выхода

Она была сломана, поэтому захейчена. Сейчас что-то чинили для другой модели и случайно починили и ее тоже. Теперь люди скачивают, проверяя действительно ли стало лучше

Ну вот не надо, с 500В уже норм модели. Все же 1Т уже многовато.

Не все в этой жизни меряется б-параметрами. 14б реально дотягивает до 24б.

Я не знаю, как французы это сделали, но они впихнули невпихуемое. 14б реально в два раза умнее немо 12б.

И да, зато у меня 128к контекста во врам влезет.

Она быстрая. Так же как OSS 20В качают, которая так-то кал ещё тот, но для простых прикладных задач годная.

>Если нет гпу: немо, министраль 14b

Хуйня. Немо и министраль нужны, если у тебя мало врам, например 8гб. Но на проце они медленно работают

Если нет гпу, то единственный выход это зоопарк 30а3б, вроде квена, глема и т.д.

Оно реально держит 128к контекста? А инструкции как понимает? Может в скайрим с ней поиграть и имеет смысл.

Что за вой на болотах. Год назад вы о Z.ai ничего не слышали, а все, выпустили огромный глм и началось.

Позакрывали пиздаки, нытики. Ждем до лета. А потом уже можно и будет ныть.

Позакрывали пиздаки, нытики. Ждем до лета. А потом уже можно и будет ныть.

Не, нихуя. Она медленнее и 20b, и 120b

Ну вообще, я столько не скармливал еще.

Но по расчетам, шестой квант министраля 14b + 128k конт плотненько влезает в 24врам, еще и место на систему остается.

>все, выпустили огромный глм и началось

Не, началось когда они выпустили эйр чтобы распиарить себя, а когда получили какую-никакую известность, просто забили на простых работяг и трижды положили им (нам) хуй в рот вместо средней модели: 4.6, 4.7, 5.

Вангую вполне терпимые 4-6 т/с. Даже так - это куда более качественный опыт в РП чем с 3b-лоботамитами.

5 вышла вчера. Air если что вышел позднее чем 4.5. Какие же вы нытики-хуесосы, а еще Нюню какого-то придумали, когда у вас перманентно щёки сырые и солёные.

Да, есть небольшая задержка, до сих пор 4.6 эир ждём.

Тред, когда zai не выпустили Эир через 0.00000000001с после релиза флагмана

Тред, когда Chatml это на практике самое сложное

Тред, когда не кормят с ложечки пресетиками

Тред, когда игнорирует существование Минимакса и Степа

Тред всегда?

>Актуальный список моделей с отзывами от тредовичков: https://rentry.co/2ch_llm_moe_2026

Вот бурундук в гавайской рубашке, уже утащил.

Сегодня допилю.

>Степа

Потыкал, помыкал- суть есть эйр.

>Минимакса

Хороший ассистент, о чём писал еще, как только гуфики появились. Для РП бесполезен, так как сух. Нет, это не исправить промтами, он блять ассистент и хорош для этих задач. Быстрый, дерзкий как пуля резкий.

Я не кодомакака, не могу сказать как он в кодинге, для моих Html пердулек и хватает малюток qwen, а еще гопота 120 есть.

Я не иронично жду (знаю что не выложат) их her. Глупая надежда посмотреть что получится, без промто-прокладок на всяких хостингах.

>Потыкал, помыкал- суть есть эйр.

Что в этом плохого? У него раза в полтора два больше знаний и гораздо легче контекст. Отличная модель. Не зажрались вы, господин утка? И ебало попроще сделайте

>Не зажрались вы, господин утка?

Ни в коем разе товарищ анон. Но тут как с тюнами мистрали. Они в мелочах разные, но суть одна и та-же. Нахожу сам эйр винчиком, и если не надоел, не вижу смысла в степе.

>гораздо легче контекст

О, а это таки вин.

Учитывая куда всё идет, в ближайшие месяцы qwen выкаит маленькую поебень, и что нибудь монструозное. Хотя я верю в их сознательность и надеюсь на что нибудь среднее.

Кого я обманываю, блять, они тоже выкатят очередную 800б-кодер-квен

>степа

Даже не знаю как выразить что с ним не так, вроде умнее эира, кум на месте, все подтексты понимает и развивает, но в конце всё равно хочется на эир

Даже не знаю как выразить что с ним не так, вроде умнее эира, кум на месте, все подтексты понимает и развивает, но в конце всё равно хочется на эир

Забыл добавить что он быстрее эира х1.5

Оставлю отзыв по Степану во втором кванте кек:

Я использую ЛЛМ под сторителлинг/интерактивные истории, не для РП с карточками. Просто задаю сеттинг о общих чертах, а дальше уже нейронка сама придумывает персонажей, события и т.д., рассказывает охуительные истории, а я только изредка вмешиваюсь, чтобы направить сюжет в интересное мне русло. Пользуюсь геммой, мистралем и эйром. Вот скачал недавно этого вашего Степана. Русик хороший - мне понравился, гораздо лучше чем в эйре, но до геммы всё же не дотягивает. А вот сама писанина - ну... как-то СУХОВАТО. Нет, оно не прям плохо, просто у эйра получается лучше. Из Стёпы мог бы выйти неплохой ассистент, но во втором кванте - хз-хз. Здесь меня вполне устраивает Квен 80b-a3b в шестом.

Читаю тут про ПРЕСЕТИКИ и ПРОМПТИНГ - с этого просто смешно. Ну вот зачем? Эйру не нужны никакие пляски с бубном чтобы писать хорошо. Гемме с Мистралем тоже. Вы задумайтесь: если для того чтобы "раскрыть" модель в ролплее/сторителлинге в нее требуется пихать шизополотна, то может не настолько уж и хороша эта модель?

Я использую ЛЛМ под сторителлинг/интерактивные истории, не для РП с карточками. Просто задаю сеттинг о общих чертах, а дальше уже нейронка сама придумывает персонажей, события и т.д., рассказывает охуительные истории, а я только изредка вмешиваюсь, чтобы направить сюжет в интересное мне русло. Пользуюсь геммой, мистралем и эйром. Вот скачал недавно этого вашего Степана. Русик хороший - мне понравился, гораздо лучше чем в эйре, но до геммы всё же не дотягивает. А вот сама писанина - ну... как-то СУХОВАТО. Нет, оно не прям плохо, просто у эйра получается лучше. Из Стёпы мог бы выйти неплохой ассистент, но во втором кванте - хз-хз. Здесь меня вполне устраивает Квен 80b-a3b в шестом.

Читаю тут про ПРЕСЕТИКИ и ПРОМПТИНГ - с этого просто смешно. Ну вот зачем? Эйру не нужны никакие пляски с бубном чтобы писать хорошо. Гемме с Мистралем тоже. Вы задумайтесь: если для того чтобы "раскрыть" модель в ролплее/сторителлинге в нее требуется пихать шизополотна, то может не настолько уж и хороша эта модель?

>q2

>сухо

как же так... кто бы мог подумать...

да, моделька плохааая. там еще и промтить чёто надо

Прошу прощения господа! Подскажите что установить новенькому, мне то есть. РТХ 5070ти, 64ддр5. Взял ипотеку на комп, хотелось бы выжать максимум из этого дырчика. Пробовал пока минстраль 14б - он ооочень тупой по сравнению GPT 5.2

Так это ж база треда. Самой лучшей считается модель, которая хорошо следует инструкциям. Чтобы промптом на 10к токенов подробно проинструктировать её как какать писать "Ты меня ебёшь, ах!". Особо изысканные гурманы ещё любят занюхивать 10к охуительного ризонинга с просчётом многоходовочек на 100 шагов вперёд от модели, прежде чем она высрет "Ты меня ебёшь" в финальный ответ.

Ах да и что за СТЕПАН блеать???, жпт на плюс подписке не знает что это)тупая железяка

>РТХ 5070ти, 64ддр5

GLM 4.5 Air в Q4_K_XL - это лучшее что доступно под твои спеки.

Двачую этого. Также пробовал в q2. Но еще пробовал на опенроутере в fp8. Что-то уровня Air или чуть ниже, но в 2 раза больше по размеру

Степошиз, спок. Нравится модель? Используй. Но нее навязывай это треду

Спасибо анон, сегодня попробую развернуть! Кстати чат жпт на подписке вообще очень аккуратно предлагал мне какие-то древние модели, типа мистраял 14б и еще какие-то, не помню. про мистраль 24б 8q он говорил что это максимум

>Но нее навязывай это треду

жестко навязал стёпу посмеявшись с чела который делает выводы по q2

У стёпы буквально 0 положительных отзывов. И она никому не нужна здесь. Но какой-то шиз продолжает ходить и срать, упоминаю ее. И не делай вид, что это не ты. Сомневаюсь, что у этой хуйни много защитников

>У стёпы буквально 0 положительных отзывов

все слишком заняты нытьём чтобы оценить что-нибудь по достоинству

>И она никому не нужна

ты сказал, местный городничий-вахтер?

>Но какой-то шиз продолжает ходить и срать, упоминаю ее

все как обычно, всех несогласных в шизы

>И не делай вид, что это не ты

нет, не я. я даже не запускал, потому что катаю GLM 4.7 и меня все устраивает

сейчас сладенько поняшились с моей виртуальной девушкой, которая обладает своим характером.

но вот вопрос, как избавиться от навязчивых трех точек и частого повторения имени, когда происходит нечто волнительное в буквах на экране?

я смог это побороть только более тщательным прописыванием персонажа, но все равно рано или... {username}... поздно... это... {username}... произойдет... вновь... {username}...

но вот вопрос, как избавиться от навязчивых трех точек и частого повторения имени, когда происходит нечто волнительное в буквах на экране?

я смог это побороть только более тщательным прописыванием персонажа, но все равно рано или... {username}... поздно... это... {username}... произойдет... вновь... {username}...

Все юзают эир на чатмл, у степы чатмл родной.

Выбор очевиден

Максимум ты можешь и сам посчитать. В твоём случае это 16+64=80гб. Вычти отсюда потребление контекста, винды и браузера, допустим 5гб в душе не ебу сколько жрет винда в простое. Получается ~75гб. Вот это максимально доступный размер модели под твою систему. Так что чатгпт наебал тебя.

Алсо эйр - это моэ. Тебе нужно будет выгрузить моэ-слои в озу, но так чтобы часть из них всё же была в видеокарте (иначе модель просто не влезет). У меня такое же железо как у тебя, вот такие параметры идеально подходят:

"gpulayers": 999

"moecpu": 42

"contextsize": 40960

"threads": 5 (ставь так если у тебя проц 8/16, а если нет, то на 1-2-3 меньше чем число физических ядер, обязательно сравнивай скорость)

"quantkv": 1 (можно отключить квантование, но тогда и контекст сокращай)

Это выставляется в .kcpps файле с настройками под модель в кобольде.

> какой-то шиз продолжает ходить и срать, упоминаю ее

Это наверно я. Один единственный раз вчера написал, что хорошая модель, и уже в доске розыска злодеев. Абсолютно ебанутый тред.

>Абсолютно ебанутый тред

Согласен полностью. Сначала орут НУ ТЫ ПОПРОБУЙ МОДЕЛЬ НУ ЧО ТЫ!! Пробуешь модель, пишешь что не понравилось. - НЕТ, ТЫ НЕПРАВИЛЬНО ПОПРОБОВАЛ, ПРЕСЕТИК НЕ ТОТ, НА Q2 ЖИЗНИ НЕТ!!

Есть несколько вариков

1) GLM Air. Хорошая, умная, может как ассистент, может как кум. Есть ризонинг, но его можно отключить.

В твоем случае это будет либо Q4XL

https://huggingface.co/unsloth/GLM-4.5-Air-GGUF

Либо GLM-4.5-Air-Q8_0-FFN-IQ4_XS-IQ4_XS-Q5_0.gguf

https://huggingface.co/ddh0/GLM-4.5-Air-GGUF

Что лучше из них - спорно

1.5) GLM 4.6V. Тот же Air, но совсем немного глупее, но зато может видеть картинки.

https://huggingface.co/unsloth/GLM-4.6V-GGUF

Также Q4XL + скачай F16 для зрения

2) GPT 120b. Также гопота, но без лимитов, но с цензурой. Быстрая и умная, хорошая как ассистент, но не для рп. Ризонинг настраевый и хороший (low/medium/high).

Тут кванты только одни, которые сам OpenAI выложил

https://huggingface.co/ggml-org/gpt-oss-120b-GGUF/tree/main

3) Qwen 80b. Хорошая модель, более глупая чем первые, но меньше. Тоже хороший ассистент. Есть 2 версии с ризонингом и без. Из-за меньшего размера можно позволить более высокий квант и размер контекста.

https://huggingface.co/Qwen/Qwen3-Next-80B-A3B-Thinking-GGUF

https://huggingface.co/Qwen/Qwen3-Next-80B-A3B-Instruct-GGUF

Бери Q5KM.

3.5) Qwen Coder. Тоже самое, но с заточкой для код. Вроде очень хорош

https://huggingface.co/Qwen/Qwen3-Coder-Next-GGUF

4) Скрытые гемы открытые калы

4.1) Solar. Как Air по качеству и размеру, но чуть похуже. Но мб зайдет.

https://huggingface.co/mradermacher/Solar-Open-100B-GGUF

Бери Q4KM.

4.2) LLama 4 Scout. Легендарная в прошлом лама выпустила спорную модель, но вроде ей дают сейчас второй шанс

https://huggingface.co/unsloth/Llama-4-Scout-17B-16E-Instruct-GGUF

Также Q4KM или Q4XL.

4.3) Стёпа. Модель в 2 раза больше Air'a, но сходная с ним по качеству. Но в треде у нее есть фанаты возможно

https://huggingface.co/bartowski/stepfun-ai_Step-3.5-Flash-GGUF

Влезает только Q2. Бери IQ2M. Но это сомнительно.

> НА Q2 ЖИЗНИ НЕТ!!

Так ведь правда нет. Впрочем это и не я тебе отвечал. Разберись для начала с голосами в своей голове. Потом пойми, что тут не чатик на двоих. Ну а там, глядишь, до чего-нибудь ценного доберешься.

>Бери Q5KM

На 80 квене у него Q6XL влезет так-то.

Так предъява и не тебе, я просто поддвачнул некоторую ебанутость некоторых тредовичков.

Да, но между Q5 и Q6 разница в качестве небольшая. Я лучше бы потратил память на размер контекста или просто на какие-нибудь проги, а не забил ее под 0

Да, но между Q5 и Q6 разница в качестве небольшая. Я лучше бы потратил память на размер контекста или просто на какие-нибудь проги, а не забил ее полностью

Ming-flash-omni 2.0

104B-a6B

https://huggingface.co/inclusionAI/Ming-flash-omni-2.0

Любители Степана, вам тут новую модель от ноунеймов подвезли. Расчехляйте свои ПРЕСЕТИКИ.

104B-a6B

https://huggingface.co/inclusionAI/Ming-flash-omni-2.0

Любители Степана, вам тут новую модель от ноунеймов подвезли. Расчехляйте свои ПРЕСЕТИКИ.

Вообще-то это не ноунеймы. Это создатели легендарных Линг и Ринг которые были полным калом

И теперь долгожданный Минг! 104a6b

Конкурент гопоты 120 о котором никто не просил

как же тебя потряхивает

Щас китайцы кстати выкинули на рынок плашки DDR4 (и вроде обещают пятую) по примерно старым ценам, ну, немного выше, от чего у всех западных началась ТРЯСКА.

Только как их заказать, если их уже можно заказать вообще?

Только как их заказать, если их уже можно заказать вообще?

Опа, уже один защитник нарисовался. Агрессивный, на всех бросается

СЕКРЕТНЫЙ ПРЕСЕТ ПОЛУЧЕННЫЙ ПРЯМИКОМ ОТ АНОНА99. АУКЦИОН НАЧИНАЕТСЯ ПРЯМО СЕЙЧАС. ПРИНИМАЮТСЯ КАРТОЧКИ, ДРУГИЕ ПРЕСЕТЫ, СЛЁЗЫ, ВИДЕООБРАЩЕНИЯ. ДРУГИЕ ПОЗИЦИИ ТОЖЕ РАССМАТРИВАЮТСЯ, НО ТРЕБУЮТ ПРЕДВАРИТЕЛЬНОГО ОБСУЖДЕНИЯ.

> 14б

> древняя

> тупая

> сравнивает с чатжпт

Охмилочка...

Проявляю воровскую солидарность и делюсь награбленным. За скромную плату.

Кто о чем, а нытик о хуях думает.

Оно что-то не дает ускорения если основная модель не фулврам. Токены выплевываются будто быстро, но с паузой между пачками, из-за чего скорость даже ниже.

Сюда же добавить что квенкодер некст (когда его инфиренс исправен) ой как ебет в коде и агентных задачах. Творит удивительные вещи для а3, отлично ориентируется в крупных контекстах. Так еще ультрабазирован и не имеет соевого алайнмента - помогает в запросах где прочие аположайзят без дополнительных промптов, спокойно обсуждает провокационные темы.

Это хлеб.

я ж говорю, квеноюзеры до q2 квантованы

там и вижен подводит уже

Покажи где тебя трогали квеноюзеры. Я сам тебя там потрогаю.

Каким местом это картошка? Ты когда нибудь картофель видел в жизни?

в том и проблема, что это не картошка, квеноюзер...

у тебя и контекст квантован чтоль?

НЕ СПОРЬТЕ! ДАЖЕ ЛУЧШИЕ МОДЕЛИ ТРЕДА НЕ МОГУТ ОПРЕДЕЛИТСЯ

Реквестирую добавить с список немотрона-ультра. Лошадка уже не молода, но как пашет ух! Если приручить, то рп интересное и дохуя умное, в контекст может, кум необычный (5/10), стиль повествования хорошо управляется.

А чего бы ему не держать? Офк в размере не стоит ждать, что оно резко сможет его весь осознать зирошотом, на это ни одна модель не способна. Но активно использовать, обращаясь к разным участкам, должна уметь.

> еще пробовал на опенроутере в fp8

Если что, на серьезной части моделей опенроутера крутится неведомый шмурдяк, особенно если там стоит фп8. Будет срать иероглифами, писать бред, ошибаться на ровном месте, так сильно, что бедный q4km той же модели себя царем почувствует.

Финальный ответ Мне начинает казаться, что хвалебные оды министралю оказались пиздежом...

> у картошка пк

Это кто писал, ммм? Квен научил меня доебываться до мелочей.

Так

Кто

Это

Писал?

И я впервые по настоящему посмотрел на анона. Не с ненавистью, злобой или не пониманием, а узнаванием.

ацтань утка, тут не одна мелкобуква в треде. не мой пост про картошку

Ну справедливости ради. Министраль из 10 генераций назвал ее хлебо 2 раза (2 и 8), а в остальном картошка. И гопота тоже если ее подрочить много раз скорее всего однажды хлебом назовет. Особенности ллм, хули. Так что не показатель. Министраль все еще лапочка

Это омни, сомневаюсь что будет поддержка в llama, а значит любители Степана в пролёте. Риговички налетай!

Поздно. Кидай инициативу.

Ты разбудил газебо утку.

А немтрон разве не денс моделька? Надо посмотреть, а то после шиза, при виде слова немотрон аж в дрожь бросает.

Вот, есть 235b на базе llama 3.1. Денс моделька.

Есть еще 8b, но same shit.

Только немотрон нано нашел 30b-a3b.

Понизил температуру с 0.8 до рекомендованных 0.2. Из 100 генераций министраль назвал хлебом только 1 раз. Так что министраль умница

Да, мне делать нехуй, я на больничном лежу

Любители мистраль и эира не знают что такое омни

А любители квена знают. И напоминаю базу треда Qwen 235 > Air >= Step 3.5

Степ и Квен местами поменять а так да, база

> А немтрон разве не денс моделька?

Да, там же нытье что денс нету. Только ультра на 253б, поэтому без объема врама может просто не хватить терпения на настройку.

> Только немотрон нано нашел 30b-a3b.

Обещали что-то на 100б и 500б, и где? Обманщики!

Ну кидай пока я не удалил эту парашу, в 3 раз качать не стану.

Логично что жирноквен будет больше и лучше моделек поменьше. Вот только в РП он аки страпонесса. На любителя, в общем. Отстаньте уже от китайченка. Ну нет нихуя в его размерах ничего лучше. Хоть на говно изойдись, ну нет. И не будет, лол. Я прям вангую какую нибудь 600b парашу с гордым индексом Qwen 4.

Что-то мне это все напомнило... А, вот:

Смотрите новый блокбастер треда - "Nemotron. Возвращение фаната." :)

> Да, там же нытье что денс нету

Ему уже 10 месяцев. Нытье оправдано. Единственное плотненькое что актуально это мистрали, да гемоподелия.

> и где?

Там же, где аги и умные корпы.

Ага. Интересно, что с ним стало. Он продолжает кумить на нем втихаря или сдался и перешел как все на мое?

Он дурачок который изобрел нюню и ноет в тред два месяца про эир и чатмл. Один и тот же дебил, любитель мушоку тенсея и немотрончика. Знай своих соседей

Обожаю спорить с гуглоии, блджад.

Он не умеет банально гуглить.

Как так вообще?

Он не умеет банально гуглить.

Как так вообще?

А есть какой-то пресет настроек для мистраль 24б для таверны, я так-то даун, мне надо чтобы в одну кнопку все работало, а то у меня получается, что если я использую кобольд с дефолтными настройками, то текст получается удобоваримым, а если в качестве фронтеда использую таверну, то она начинает какой-то говняк писать при том же дефолт пресете, с одной и той же карточкой перса, мне от таверны по большому счету для начала только всякие интерфейсные плагины нужны, а не настройки этих температур и прочего, которые я пока хз как настроить.

Есть хранилище белки анона, что в дупло тащит всё что не прибито.

https://pixeldrain.com/l/47CdPFqQ#

Попробуй тут посмотреть.

Если тебя устраивают дефолтные семплеры кобольда, то просто выставь точно такие же в таверне.

Как же горит очко, читаю: New Ovis2.6-30B-A3B, a lil better than Qwen3-VL-30B-A3B. ЕХАЛИИ 30B-A3B да 30B-A3B погоняли. Литералли

IT'S ALL SAME SHIT.

Нет моя малыха лучше, нет моя, НЕ МОЯ. О! А МОЯ ТО КАКАЯ!

Чтоб вас всех подводной лодкой задавило, пидоры.

IT'S ALL SAME SHIT.

Нет моя малыха лучше, нет моя, НЕ МОЯ. О! А МОЯ ТО КАКАЯ!

Чтоб вас всех подводной лодкой задавило, пидоры.

посоветуйте модельку на слаби компек

денях покупать датацентр нема

денях покупать датацентр нема

Да, этих 30a3b уже минимум 5 штук. В чем вообще смысл делать именно столько? Почему не 40a5b или 25a7b. Квенчик выстрели весной и теперь только его копируют

В шапке есть список для бомжей

компек в студию. Для кого и кобыла невеста.

ебать хули так сложно ставить как будто моды в гта 5

Ну надо же составить конкуренцию. Я вот посмотрел: каждая компания выпустила одну, а то и несколько агентских малых в этом пределе. Квен так вообще как из пулемета высирает мелкомодели. И они и правда молодцы, тот же 235ый и его большой собрат действительно хороши для агентских задач и кодинга (наверное, я большой не запускал, но те отзывы что есть- очень даже довольные. Хотя, для запуска чего то такого нужно минимум 50 т/с генерации. Но по крайней мере, я могу с 235ым обсудить структуру документа и косяки.) так что тоже мимо обычных пользователей. Но и опять же, с этими задачами и минимакс справляется. Тогда зачем использовать излишнее. В целом - довольно странно пытаться в РП на подобных модельках, так что мы сами себе кактусы.

Но меня гложет только один вопрос: а зачем, а зачем эти модели обучали на датасетах и с рп и литературой. Вот чтобы что?

Мне нравится 30B-A3B размер - он классно сочетается как с 32 ГБ карточками, так и с 8 ГБ - а это самые распространённые, промежуточных мало.

В 6 кванте 22.5 (≈25, если там получается 6.6 bpw), кеш на 6.8 ГБ (128к для glm-4.7-flash в fp16) + компут матрицы, вот почти ровно 32 и получается. Можно контекст в q8 поставить или покороче сделать.

При этом на 8 ГБ как раз помещаются активные параметры + кеш (тут уже точно в 8-бит или покороче) + компут матрицы для ненулевого батча при pp.

Я как бомж погонял эти ваши 30b-a3b, для кума будто бы и не так плохо, связность лучше, чем на пережатых 24б, пишет при этом чутка интереснее чем мистралетюны заебавшие всех на 12б. Надо теперь какие-то поискать тюны квена. Даже русский язык терпимый вышел, вот би была гемма теперь такая

>Но меня гложет только один вопрос: а зачем, а зачем эти модели обучали на датасетах и с рп и литературой. Вот чтобы что?

А это, подозреваю, отсылка к старинной китайской традиции. Считается, что чиновник должен уметь написать хорошее сочинение; если он с этим справится, то с обязанностями чиновника - легко. Жаль, что не все китайцы поклонники древних традиций.

> Ему уже 10 месяцев.

Так

> Лошадка уже не молода, но как пашет ух!

> мистрали, да гемоподелия

Гемма еще старше. А мистраль это вообще лоботомит другого калибра. В каких-то прикладных задачах мильфу немотрона не тестировал, вполне вероятно что будет хуже квенкодер некста, но вот в ролплее и всяком таком очень даже может зайти.

> В чем вообще смысл делать именно столько?

Они достаточно умные чтобы вешать всякие погрямушки типа того же опенклоу, код асистентов и прочее, но достаточно быстрые и легкие чтобы крутиться на потребительском железе. Ставишь v100 с постоянно запущенной такой 24/7/365, и организовываешь всякое.

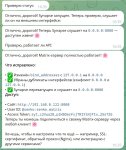

Дал Qwen3-Coder-Next exl3 8.0bpw полный доступ в свежую виртуалку через ssh и попросил там настроить matrix-сервер.

У него ушло около 8 минут на всю установку - пакеты, конфиги, база данных.

И потом я ещё ошибку скинул, за 10 минут самостоятельно смогла всё исправить.

По итогу на всё ушло 57к токенов (пик 7).

Алсо забавно что она в процессе через curl проверяла, отвечает ли сервак (пик 8).

В OpenClaw довольно корявая интеграция с тг - он шлёт все ответы пачкой после заврешения всего процеса, так что на тайминги отправки сообщений ИИшкой не обращайте особого внимания.

У него ушло около 8 минут на всю установку - пакеты, конфиги, база данных.

И потом я ещё ошибку скинул, за 10 минут самостоятельно смогла всё исправить.

По итогу на всё ушло 57к токенов (пик 7).

Алсо забавно что она в процессе через curl проверяла, отвечает ли сервак (пик 8).

В OpenClaw довольно корявая интеграция с тг - он шлёт все ответы пачкой после заврешения всего процеса, так что на тайминги отправки сообщений ИИшкой не обращайте особого внимания.

Ну что-же, получается квен кодер ебёт?

Еще как. После фикса по всем направлениям (инфиренс, парсинг вызовов, сам софт) в том же квенкоде оно отлично себя показывает, не ошибается, не ловит затупы и лупы, а прет как бульдозер. Разумеется, не стоит ждать какого-то невероятного перфоманса в сложном коде, но для кучи подобных задач (даже одновременно) он хорош. Еще русский хороший, причем оно использует его везде, а не в редких ответах выполняя основные раздумья, todo и прочее на ингшише. Умница в общем.

В рп вообще херь, возможно скиллишью.

мимо

Как и все у кого в Terminal-Bench высокий рейтинг. Если глядеть 2.0 то

У Qwen3-Coder-Next вроде 36.2%

У GLM-4.7-Flash вроде 33.4%

Но конечно в топе ГПТ и Claude.

А зачем огрызки?

шоп ты спрасил, тролейбус

https://www.minimax.io/news/minimax-m25

Похоже, он теперь еще больше ассистент и еще меньше подойдет для рп. Похуй, есть Степа

Похоже, он теперь еще больше ассистент и еще меньше подойдет для рп. Похуй, есть Степа

Новые ггуфы glm 5 стали меньше весить, е бооой. Пошел качать третий квант от дяди анслота

Ожидаемо. Ловушка дяди Ляо захлопнулась, несите шекели, гои.

Пиздец у меня эир с компа удалился. САМ.

Теперь точно придется платить.

Как думаете это улучшит или убьёт РП?:

https://www.youtube.com/watch?v=eGpIXJ0C4ds

https://www.youtube.com/watch?v=eGpIXJ0C4ds

ну 50/50 наверн там или одно или другое

для ассистентов убьёт. НО! это упросит тюны. если там будет возможность манипулировать осью личности наконец-то то это будет означать что будут не просто ЛЛМ лоры, а личность-лоры.

Если кто-то захочет это делать, вместо хайпа по агентным ии-светшопам.

Больше лоботомии богу лоботомии

УРА! ПИЗДА РОЛПЛЕЮ!

Вы уже сделали бекапы хороших годных моделей и средств запуска? Я - да.

Как же хорошо, что нас наконец-то избавят от вредных сценариев. Безопасность превыше всего.

Перечисли какие модели добавил в бекап.

Множим эти активации на -1 и получаем жестокую модель. Так что хули бурчать? В локалках всё только улучшается.

Жалко асиго-чуханов :_(

Геммы: Все от 1б до 27б (и аблитерация) + медгемма 4б и 27б

Мистрали: немо, смолл 24б (и кумтюны), министрали 8б и 14б

Квены: Плотные 8б, 14б и 32б, все вариации моэ от 30б до 235б

Глм: Эйр 4.5 и большой 4.7

Есть ещё годнота, которую стоит добавить?

Взяли техники расцензуривания и попытались использовать их наоборот, заодно подробнее исследовав закономерности и отметив что там сказано. Скорее всего ни к чему хорошему не приведет, но также развивает возможности расцензуривания. И не факт что основные "поставщики моделей" что есть сейчас будут таким заниматься.

Я сохранил старый жирный мистраль на всякий случай. Вдруг, когда-нибудь запущу. Возможно дипсик можно на всякий случай забрать.

Этот этап называется торг, да?

Дешевый рейджбейт, игнорируем.

А в 64гб ram вообще есть смысл? Что тут советовали в 8 кванте в принципе в мои 32+видяха влезает, у меня так-то два слота свободных в материнке под оперативу есть, и меня не особо задушит еще 32гб оперативки докинуть, но вот отдельный сервер собирать с 100+ это уже задушит.

>А в 64гб ram вообще есть смысл?

Ну да. Это эйр в 4 кванте и 80б квен в шестом. Первая - лучшая РП модель в своём размере, вторая - отличный ассистент. А с 32гб рам особо не разгуляешься.

Транслейтгемму добавь, хорошо переводит, я ей целые книжки перевожу, поулчается лучше яндекс-переводчика.

А с какого на какой язык?

Чел, твоему Аиру уже полгода. Он уже морально устарел. У него плохой русик, он плохо работает с длинным контекстом.

> я ей целые книжки перевожу

Твой пост ?

Я думал она имеет смысл только в переводе на редкие языки. А те на которых моделька говорит и так переводятся хорошо. В случае с геммой - русик, англюсик, немецкий, испанский и пр.

скил ишью у тебя, што поделать

Перевожу? С англ на русский. За счет контекста в нем нет традиционных косяков переводчиков типа постоянно меняющихся полов персонажей и 10 вариантов перевода одного и того же имени.

Думаю дополнительно прикрутить переводчик с русского машинного на литературный. Парсить уже переведенные абзацы и просить переписать полностью красивым литературным языком.

Да, мой. Продолжаю допиливать ту кривую хуйню.

Ну вот, опять это раболепство.

А написал бы он "ало залупа обещание выполнять будем?" сразу бы другой базар был

Напиши ты.

Удалось продвинуться в улучшении стабильности и постоянства по именам, словам и прочему? Насколько варьируется стиль?

Я кучу багов выловил, обнулявших контекст, теперь он всегда есть, кроме случаев когда нейронка лоамется и начинает переводить контекст вместо запрошенного текста - тогда включается повторный перевод параграфа без контекста, - за счет этого пока в активном окне контекста есть инфа о поле/имени персонажа - она переводится правильно и однообразно. В планах сделать модуль переписывания текста на литературный. И создать модуль подготовки лорбука - т.е. перед переводом скормить текст по частям на предмет имен и создать из них лорбук - хз, что из этого получится.

>Я сохранил старый жирный мистраль

Чтобы проблеваться? Недавно магнум запустил, так теперь опытным взглядом заметил, что даже там сейфити ванильной модели не вытравили полностью. После того, как полгода на нем и тюнах откумил, и вкусил новых сеток - возвращаться на это соевейшее говно мамонта желания нет никакого. Вообще все сетки прошлых годов оварида, неиронично лучше в блокноте сам с собой порпшить чем читать предсказуемый на 100 шагов вперед слопокал.

> чем читать предсказуемый на 100 шагов вперед слопокал

Это верно буквально про любую ЛЛМ вплоть до корпоратских клодов и гемини.

low quality bait

"Show don't tell" нейронкой как понимается?

Хочу чтоб эир писал больше диалогов, но ирл же эта фраза наоборот применяется к действиям вместо диалога

Хочу чтоб эир писал больше диалогов, но ирл же эта фраза наоборот применяется к действиям вместо диалога

А не пробовал динамически создавать словарь, куда будут заноситься имена, детали и всякие факты, чтобы потом переводить их консистентно? аицгшникам в рот нассать, как же заебали

Да не так уж он и плох, словить сейфти в магнуме - это нужно знатно постараться.

Писанину клода интересно читать хотя бы и хоть какая-то иммерсивность. Вообще вот мой рейтинг:

Топ тир - клод

Норм тир - гемини, глм

Шиза тир - дипсик, квен

Кал тир - все остальное. В особенности лламаподобные поделия, чьи высеры уже просто невозможно читать.

Это не просто база треда, это база нейрокума. Можете, конечно, беситься и коупить, но реальность такова. Ну либо вы вкатились пару месяцев назад и вам 12B кажутся откровением, тут вопросов нет.

> Норм тир - гемини

> база нейрокума

Я так понимаю, что основной кум заключается в том, как корпорат ебет тебя в жопу лимитами, потребностью менять по 100 впн в день и ценами?

Я так понимаю, что основной кум у тебя заключается в том, как жора ебет тебя в жопу очередными багами, потребностью менять по 100 файнтюнов в день на 5 т/с и ужариванием карты для получения "я тебя ебу"? Если ты так хочешь спорить не о сетках, а околокумопроблемах, то можно в обе стороны это делать.

Хе. Забавную хуйнню пишет. Сделал агентный луп, который переводит ЛЛМ то в придумывателя сюжета, то в придумывателя квестов, мобов, предметов, изменяя куски json, чтобы сделать заготовочку "подземелья" (хотя у меня тут лёгкий обсёр с синтаксисом, в реальности он куда более сложный)

потом он скидывает свой же высер на себя и критикует сам себя по ряду пунктов. когда нечего критиковать, то отправляет свой json на валидацию парсером.

в итоге часто возвращается чтобы кусками отредактировать то что придумал, итеративно повышая качество.

В конце скармливается в аналог того что я раньше кидал в тред с "дракой". Только там ЛЛМ видит все внутренние состояния квестов и сюжета, но игрокам не показывает. а сам имеет инструменты чтобы "показать скрытые квесты", "прогрессировать сюжет", "заспавнить моба" и всё такое, играя роль гейммастера.

в целом хороший способ стабилизировать лор мира.

надо будет sliding window ему сделать и более персистентный todo лист. и сделать overnight генерацию чтобы просто к моменту как я проснусь у меня было готово несколько компаний.

потом он скидывает свой же высер на себя и критикует сам себя по ряду пунктов. когда нечего критиковать, то отправляет свой json на валидацию парсером.

в итоге часто возвращается чтобы кусками отредактировать то что придумал, итеративно повышая качество.

В конце скармливается в аналог того что я раньше кидал в тред с "дракой". Только там ЛЛМ видит все внутренние состояния квестов и сюжета, но игрокам не показывает. а сам имеет инструменты чтобы "показать скрытые квесты", "прогрессировать сюжет", "заспавнить моба" и всё такое, играя роль гейммастера.

в целом хороший способ стабилизировать лор мира.

надо будет sliding window ему сделать и более персистентный todo лист. и сделать overnight генерацию чтобы просто к моменту как я проснусь у меня было готово несколько компаний.

В общем стёпа это бюджетный большой глм, намного умнее и креативнее эира с ризонингом.

Т.к он быстрый и ризонинг без цензуры это невероятное комбо.

Ждёшь в принципе как и челы с 128 рам на глм с 4-5 т.с, часто быстрее, получаешь около-такого же качества ответы как и на 350б.

И это на ддр4, у челов на ддр5 ещё быстрее полетит.

Эир так использовать не получится, он медленнее в два раза и ризонинг у него максимально соевый

Т.к он быстрый и ризонинг без цензуры это невероятное комбо.

Ждёшь в принципе как и челы с 128 рам на глм с 4-5 т.с, часто быстрее, получаешь около-такого же качества ответы как и на 350б.

И это на ддр4, у челов на ддр5 ещё быстрее полетит.

Эир так использовать не получится, он медленнее в два раза и ризонинг у него максимально соевый

Именно так. Но здесь хотя бы получаешь честное "ты меня ебешь" вместо content blocked.

Отличный пересказ дискорда, спасибо квен 4б q2

Жду завтра твои посты какой Стёпа кал. Сегодня уже были

Нихуя ты порвался. Опередил тебя, малютка?

Достаточно гичанчику написать какой Стёпа умница и ты забываешь как два дня подряд его засирал

Давно свою хромосому обронил?

Сорян не занюхиваю каждый пук гичанчика, в канале по стёпе его не видел.

Давай к форточке и выдыхай уже, что он там рассказал?

Вроде занюхиваешь, надеялся что ты расскажешь

Я уже давно на Степе инжою

Ну нихуя ты олд.

Модели 2 недели, ещё скажи пока я под стол ходил ты уже инджоил

Какой блокед, алё, я на квене рефьюзы чаще получал, чем на клоде или гемини

Ну так и напиши лонг энд дип конверсейшенс.

Шоу донт телл это чтобы вместо "он пихнул хуй в дырку" писалось более развернутое и художественное описание.

Так на гемини два слоя цензуры, и один из них - просто упоротый фильтр, который блочит случайные слова (не обязательно кум, можно просто лекарства искать и получать блоки). То есть дело даже не в самой ЛЛМ, с которой общаешься.

А квен соевая гнида, не удивительно, что ты на нем рефьюзы ловишь часто.

Квен соевый, говорят... Тред реально ёбнулся

> Тред реально ёбнулся

Все эти года всегда был соевым. Чему ты вообще удивляешься?

Интересно квен реально дропнет только 9б и 32б

Типа 8 месяцев обучали вот это?

Типа 8 месяцев обучали вот это?

Ну что, тряска усиливается кто купил https://aliexpress.ru/item/1005010391017151.html . Еще двоим пришло говно. Все еще верите советам в треде? И того чухана, кто тут яростно продавца защищал пару тредов назад, теперь я с чистой совестью посылаю нахуй, катись к своему китаепротыку и ебись с ним за миску риса

кампаний

компания - это то, что деньги делает или те, кто пиво пьют.

Прислали не кирпич а он ещё не доволен, хуйло.

>кто тут яростно продавца защищал пару тредов назад

Ну так всё правильно делал, если б таких не было никто бы не купил и не оставил отзыв что там наебалово

Не ведитесь на чепуша. Фейкует чтобы самому побольше скупить до того как цена вырастет.

И карты в фотошопе поломал, да?

минимакс где веса сука

Ну что 3 месяца прошло что то рам не дешевеет

Хотя бы больше не дорожает. Можешь посмотреть на алике, китайцы по сусекам наскребли б\у чипов и сейчас выпускают планки в полтора раза дешевле чем у лаоваев

А эир то реально хуета. Кто сейм?

Знаете чем стёпа лучше?

Он будет обновляться и мы даже сможем это запустить.

Но уже сейчас он лучше эира

Он будет обновляться и мы даже сможем это запустить.

Но уже сейчас он лучше эира

Охуеть, да? Внезапно модель может просто работать заебись из коробки и никакого пресета не нужно, на любом промпте и дефолт семплерах.

О какой модели речь? И что ты подразумеваешь под "работать"? В целом и мелкий мистраль на любом пресете тебе будет что-то отвечать, то есть "работать".

>Прямо смеха не то чтобы, но восторг, восхищение, усиление - да.

Познакомился с нейронкой начиная с llama 3 1b. Она ограниченная, чуть что, предлагала сразу донести на себя в полицию. Я в джунглях амазонии, нету тут полиции, она предложила дойти до ближайшего населенного пункта. Я на марсе, средств связи нету. Она сказала из подручных средств собрать радиостанцию и связаться через спутники наса. Прикольнуло.

Было скучно я начал разговор, сам спросив "Чем я могу вам помочь", она в ответ выдала пост про то что ей "Нужно срочно снять двушку в центе сиэтла, близко к центру и меблированную. Дорогие не предлагать. Обращаться в личку." Пост был длинный описывающий практически квартиру мечты за дешево. От неожиданности, очень смеялся.

Стёпа. Отличная модель, не нужно граммар блоки писать блять, менять темплейт на хуй пойми какой, промпт по крупицам собирать чтоб оно не обосралось, всё просто работает.

И будто этого мало, оно ещё и быстрее работает, легче и прочнее контекст, умнее, бля да бомба вообще модель в сравнении с эиром и квеном

Я завидую этому человеку черной завистью. Ему для счастья никакой ЛЛМ не надо.

Надо будет схоронить тогда, может, однажды запущу.

Откуда можно скачать модели? Вбил название в поисковик, выдало официальные сайты и официальный же репозиторий на hugginface где надо заполнять какие-то регистрационные формы.

Интересуют Llama 4, Qwen 3 и Deepseek 3.

Интересуют Llama 4, Qwen 3 и Deepseek 3.

Ну так своей головой надо думать, а не слушать советчиков в треде. Тут тебе, конечно, расскажут, как быть не мамонтом)))0 и сэкономить.

>hugginface

Отсюда и качай. Тебе скорее всего нужна модель формата gguf, которая выкладывается энтузиастами. Они регистрацию от тебя требовать не будут.

Как же заебись довольно урчать со своими Mi50@32Gb по 11к рубасов

Ща 1гб ддр по 1.35к рубасов идёт.

Интересно мишки быстрее?

Видели тот лот на али с V100 по 30-35к? Когда у других по 40к.

Там ещё два отзыва с разбитыми сокетами появилось.

Вот это насоветовал анон в треде, явно в сговоре с китайцами, лол.

Официальный репозиторий обычно требует ввести что-то вроде фио - цель использования, или просто кликнуть галку что ты не будешь пробовать уничтожить человечество с этой штукой. И ещё там скорее всего модель в полных весах, если ты не исследоваль или разработчик, то тебе нужно искать модель с подпись GGUF, и там уже никаких галочек и форм не будет в 99% случаев, так как она будет не на официальном репе. Хотя некоторые сами сразу GGUF делаю на официальном, но редко.

Там ещё два отзыва с разбитыми сокетами появилось.

Вот это насоветовал анон в треде, явно в сговоре с китайцами, лол.

Официальный репозиторий обычно требует ввести что-то вроде фио - цель использования, или просто кликнуть галку что ты не будешь пробовать уничтожить человечество с этой штукой. И ещё там скорее всего модель в полных весах, если ты не исследоваль или разработчик, то тебе нужно искать модель с подпись GGUF, и там уже никаких галочек и форм не будет в 99% случаев, так как она будет не на официальном репе. Хотя некоторые сами сразу GGUF делаю на официальном, но редко.

Конечно быстрее. И по pp, и по tg.

Откатывайте цены на оперативу уже, пидорасы ебаные.

Какого хуя я должен платить в 5 раз больше с абсолютного нихуя, ничего не поменялось блять.

Какого хуя я должен платить в 5 раз больше с абсолютного нихуя, ничего не поменялось блять.

Учитывая какую шизу оно генерирует? Второй вариант ближе к правде. Пока лучший вариант был про гнома-пивозавра находящегося в темнице двемеров которые вымерли в процессе экспериментов с мировой грибницей.

>Какого хуя я должен

Кстати, владельцам мишек, рекомендую их шить в невышедшую v420, потребление в простое меньше, частота гпу выше, работающий ребар, работающий минидп, можно еще и в игори играть, довольно сносно причем, FSR работает

https://gist.github.com/evilJazz/14a4c82a67f2c52a6bb5f9cea02f5e13

А схема ещё рабочая? Почём сейчас так-же?

Нет конечно, уже дешевле 40к не найти

>Нет конечно, уже дешевле 40к не найти

А какой смысл, откуда такая цена? За эти деньги лучше V100 купить же.

Наверное.. Всё таки квены создавались всё таки для кодинга и всяких ассистенстких задач. То что мы пытаемся в них в РП и получается говно- дык, это сугубо наши проблемы.

Как бы я не любил МоЕшки, всё таки для общения денс модельки таки будут объективно лучше.

Nyeeeehh~ Неужели для MOE жизнь есть только в 600b жирничах..

>А какой смысл

О чём анон и пишет: смысла нет.

>откуда такая цена?

Спрос.

>За эти деньги лучше V100 купить же.

Да.

Ого... Некрожелезо из Китая оказалось некрожелезом из Китая. Кто бы мог подумать? Естественный отбор. Жадные до одури дураки хотели скушать больше чем могут себе позволить и не получили ничего. История старая как мир

Твой стёб не уместен. Часть анонов получила что заказала.

Могу посмеяться над тобой- не жадиной. Потому что я купил 256гб жижиэр пять до всех поднятий цен.

Если есть возможность рискнуть с неплохим шансом на удачу, почему бы и нет.

Почему жадные? Какая была мотивация брать лот за 40к без отзывов при наличии лота за 30к без отзывов? Или лучше было взять у местного перекупщика за 100к?

Ну и не забывай что V100 - для энтузиастов. Для нормальных людей можно набрать 3090 по похожей цене, но с флеш-аттеншеном и без возни с ригом и охлаждением.

Я кстати неиронично могу подсказать, где взять 3060/12 подешевке ИЧСХ - новую.

как она в плане кума?

Ойу, йоу тред! Дискета, скейтборд нейронки!

Смотрите какой новый минимакс будет.

Целых 230b! A10B.

Пожалуйста, дайте степлер, я своё ебало скреплю, а то оно уже разваливаться начинает.

Смотрите какой новый минимакс будет.

Целых 230b! A10B.

Пожалуйста, дайте степлер, я своё ебало скреплю, а то оно уже разваливаться начинает.

>Часть анонов получила что заказала.

>возможность рискнуть с неплохим шансом на удачу

Ну а части не повезло выиграть в лотерею. Они знали на что шли, но им не выпал неплохой шанс на удачу. Мне посочувствовать? Похлопать по плечу? Из-за этого обругать китайца, который очевидно продавал б/у некрожелезо? Обидиться на мир вместе с вами?

>Могу посмеяться над тобой- не жадиной. Потому что я купил 256гб жижиэр пять до всех поднятий цен.

Светанул железом, и к чему это вообще? Я тоже рам купил до подорожания. И вообще я акционер, гречку беру на развес дешевле, чем ее берешь ты. Живи с этим.

Ну подскажи. Не держи в себе.

>гречку беру на развес дешевле, чем ее берешь ты

Гречка тема. Обожаю тефтельки делать с гречкой. Я сейчас пробую вложиться в макароны и картоху на посадку. Сезонная инвестиция в огород, в общем. Авось осенью получу свои дивиденды.

>Обидиться на мир вместе с вами?

Просто не стебаться над тем, кому не повезло и не нагонять для тех кто еще не получил.

Одно дело когда чел предупреждает о проблеме, другое - когда извергает лучи поноса на тред и винит всех вокруг в своей скупости

Над такими только стебаться, да.

на озоне в официальном магазе CBR (карта производства завода Maxsun, добротный Китай). Время от времени надо караулить скидку, цена за 3060/12 падала даже до 24к с чем-то.

Пиздец...

Для меня степфап в разы превосходит эир теперь, вообще без сомнений.

В первые разы реально не распробовал, хуевые свайпы были

Для меня степфап в разы превосходит эир теперь, вообще без сомнений.

В первые разы реально не распробовал, хуевые свайпы были

пресетик

Аноны, подскажите нубу.

Насколько GLM-4.7 Flash зацензурен?

С пол года назад пользовался большим дипсиком, но в какой-то момент сабмиссив фурри-персонаж подталкивался мной к скат-плею и тут выяснилось, что дипсик оказывается не любит скат-плей, а мне не интересны забавы с обходами цензуры любых мастей, хочется, чтобы работало из коробки, а не рычагами играться, пробелы там подменять и прочий онанизм.

Ну и раз персонаж - фурри псина, значит на роду персонажу написано жрать всякое мертвое дерьмо, и нечего прикидываться человеком.

Насколько GLM-4.7 Flash зацензурен?

С пол года назад пользовался большим дипсиком, но в какой-то момент сабмиссив фурри-персонаж подталкивался мной к скат-плею и тут выяснилось, что дипсик оказывается не любит скат-плей, а мне не интересны забавы с обходами цензуры любых мастей, хочется, чтобы работало из коробки, а не рычагами играться, пробелы там подменять и прочий онанизм.

Ну и раз персонаж - фурри псина, значит на роду персонажу написано жрать всякое мертвое дерьмо, и нечего прикидываться человеком.

Это ассистент. Не для РП.

Ты после дипсика собрался с 3b лоботомитом играть? Лол

Буквально всё дефолтное, чатмл мин п реп пен.

3 квант

>реп пен.

даже не драй? ну ты устарел чувак о чем с тобой говорить

Так ведь 30b?

Вот ведь досада!

А что насчет GLM-4.5-Air-106B-A12B ?

>даже до 24к с чем-то

А я-то думал, и правда

>подешевке

Ну ладно, спасибо, что поделился.

>Так ведь 30b?

3.2 дипсик в суме чёт около 650B общих и 35b активных.

Если провести аналогию, ты буквально пересаживаешься с грузовика в инвалидку и спрашиваешь, норм ли она для перевозки сена.

Нет, не норм.

>А что насчет GLM-4.5-Air-106B-A12B ?

Есть же список Moe моделей. Там и посмотри.

Но выбора у тебя нет, если честно. Нет ни одной РП МОЕ модели в принципе, мы играемся просто на в меру умных моделях.

Эйр, ЖЛМ и всё. Ну есть еще квены, но эт прям на любителя, так как это в первую очередь ассистенты и работают они как ассистенты а не как нарраторы. Увы, труЪ РП или в гигантах остался, или в денс модельках, которые могут в простой чатинг.

Сейчас все модельки задрачивают на бенчи и определенные задачи, превращая из многопрофильного инструмента, в узкоспециализированный. Отсюда и весь вой.

Ну шопаделать, дешевле только б/у пожимает плечами и уходит, покачивая бедрами

>пожимает плечами и уходит, покачивая бедрами

Roll 1D100 на жмяк за жопку.

Хуйню несешь, утка. Да еще и с серьезным ебалом, типа депутат от треда. Степа есть, Минимакс есть, Квены норм для рп. Это все модели общего назначения. Только GLM Flash и всякие Квен Кодеры заточены под бенчи.

>Да еще и с серьезным ебалом, типа депутат от треда.

Ой, да ладно. Тот 235 квен, ну чистый ассистент. Я теперь только им и делаю всякие суммарайзы, и вычитку. Его доёбы до каждого слова спасают, так что его можно в Q3 запустить с большим контекстом и он не становится лоботомитом, теряя всё внимания и пуская слюни.

>Минимакс

Чистейший, кристаллизованный ассистент. Умный, быстрый. Сухой. С первого дня мне понравился. А Her не выложили, лололо.

>Квены норм для рп

Если только плотные и то смысла уже нет. Или ты на кодере предлагаешь в РП? Ну удачи, чё.

Ну то есть, вот мы пришли к тому что я написал. То что квен "умеет" в РП, это баг а не фича и вызвана она просто его размером, и тем что в его датасете есть какая то мешанина из китайской прозы и фанфиков фуриёбов.

>заточены под бенчи.

Да сейчас всё заточено под бенчи. Нужно же показать свой крепкий нефритовый стержень. Сколько вышло medium моделек за последнее время?

>Ой, да ладно. Тот 235 квен, ну чистый ассистент. Я теперь только им и делаю всякие суммарайзы, и вычитку.

Забыл уже как пару недель назад срался с тредовичками которые именно это и утверждали? "Да заебись он для рп вы ничего не понимаете"

Короче, ты как долбаеб пишешь и выглядишь когда пытаешься в серьезность. Высрал список моделей какой-то, сразу галстучек затянул типа умный. Тебя из больницы выпустили?

Значит в целом ты с тезисами согласен, но решил все таки до меня доебаться?

Хей, свистни в хуй там тоже дырка!

Слушай, ну а если перефразировать вопрос?

Скажем я решил упасть в ножки к опен роутеру и либо утилизировать его бесплатные модели или даже занести немножко (чуть больше чем за офф апи дипсика) денежек, на какие модели ты бы порекомендовал обратить внимание? Понимаю, что тред не про это, но раз уж речь зашла.

С чем я согласен, с какими тезисами?

С тем что рп остался только на самых больших моделях и плотных? Нет, не согласен.

С тем, что Квен это ассистент? Нет, не согласен. И я один из главных его критиков итт при этом.

>Официальный репозиторий обычно требует ввести что-то вроде фио - цель использования, или просто кликнуть галку что ты не будешь

Зависит от. Мне например приходили отказы от террористов из меты, не понравился им чем-то мой институт кума.

Это тебе в соседний тред. Тут по корпам (да и огромным открытым моделям тоже) вряд ли подскажут. Если тебе в целом нравится дипсик, но хочется больший уклон в РП, попробуй мистраль лардж последний. Тот же дипсик, но сдобренный мистралевскими датасетами + цензуры поменьше.

> С тем что рп остался только на самых больших моделях и плотных? Нет, не согласен

Ах, знаменитое РП с одним персонажем, в дженерик мире, состоящее только из: ахх, ты меня ебешь.

Недавно кодер некст обновили, базарю, лучшее РП для тебя будет. Просто отвал жопы. А потом все сверху зальешь мини Максом и 120oss.

> И я один из главных его критиков итт при этом.

Жаловаться на его стиль повествования, хотя он фиксится одной строчкой, это не критика.

Вежливо кланяюсь и сердечно благодарю.

Ну так я тещу.

Надо уже твердо решить как мне лучше и с каким промптом и еще не дрочить ультрахард сложность при этом.

Свайпать еще не могу перестать, пишет прям как мне надо как я бы хотел эир писал диалоги - строчка действия а не 2 абзаца - диалоги, при этом активно сюжет развивает пока мы пиздим

полностью можно расцензурить системным промптом, он довольно послушный. я бы сказал 2 балла из 10 в зацензуренности. Без системного промпта он будет отказыватся в стиле OSS, но с системным промптом он бех проблем влазил в шкуру кошкодевочки-футанари на уроке школьной биологии.

Но слог у него так себе.

На некроговне с 128гб ddr3 2133 лучше в память даже не пытаться?

фига ты там. Не ну если видеокарту воткнуть то можно попытаться наверно. самого интересует этот вопрос.

Да, я со списка Мое и начал. Но меня смущает, что он ссылается на базовый glm-4.5-air, хотя существуют скажем abliterated и derestricted версии.

Годика три потерпи.

>128gb ddr3

Это ж какой сокет/проц это вытянет? Что-то не припомню, чтобы ddr3 вообще можно было стакать больше 32gb.

Энивей, - не пытайся, на llm ddr3 дает 1-1.5 t/s.

С ddr3 cpu-инференс мертв, только gpu. Это я как грустный владелец fx8350 говорю.

LGA2011 до 768 гигов ддр3 вроде держал

Я не могу говорить за других, но я еще не видел вменяемого тюна или вменяемой аблитеррации мое моделек.

Если аноны считают по другому, спорить не буду.

Но мой личный опыт, сугубо негативен: тот же эйр становится yesman что убивает любое РП, кроме хватательно@пихательного.

Двухсокетный старенький сервак на e5-2699 v3.

>llm ddr3 дает 1-1.5 t/s

Ну да, такое он и выдаёт если vram не хватает, думал может секрет есть какой. Спасибо.

> тряска усиливается

Это точно, а тебе когда должна приехать? Чтобы не пропустить.

Ждите 2028

Лол, вот где душа!

А ведь реально, ради рофла сделал свайп на большом чате с 30а3 моделью, оно такое милое полотно накатило. Да, немного вне чара и спутало оду вещь, но действительно мило.

Квены и дипсики можно скачивать без форм. Большинство моделей с формами имеют нонгейт зеркала, просто вбей в поиск или кликни на файнтюны и найдешь перезаливы полных весов от тех же анслотов.

Когда там бартовски выкатит кванты на глм-5? Не от ленивцев же качать, честное слово.

Да нормальные кванты делают. Да, бывают обсираются. Не нагоняй уж жути.

Их не будет

> без возни с ригом и охлаждением

Так наоборот же, их в основном именно в риги и дополнительными брали, а вольты по одной-две штучки.

> Просто не стебаться над тем, кому не повезло

Такие тут есть? Только один анон писал что у него ошибки по памяти идут, но не указал откуда брал и не отписался решилось ли. Пока только тряска ждунов.

Стебутся над маргиналами и это абсолютно правильно, полностью двачую.

Аноны, как вы выгружает слои из MoE самостоятельно и без мозгоебли для получения нормальной скорости? Если ПРОСТО выбрать, сколько выгрузить, то у меня скорость, условные 10 тс (вообще поебать, сколько времени потратишь на настройку).

Если загрузишь в Клода тысячи документаций о принципах работы МоЕ, лламы, слоев, неба, Аллаха, логов, размер контекста, модели, объём памяти и попросишь его написать регулярное выражение для tensors override, то скорость 30 тс и регулярка на пол страницы.

Я просто не понимаю, шо он такое делоет... А когда он сам объясняет.. ну, это сложно и неприменимо на практике для меня, так как оно касается регулярных выражений, а не тыкнуть, сколько выгрузить слоёв.

И у меня складывается впечатление, что там всё зависит не только от забитой памяти, а от того, какие слои в врам, какие в рам. Условно, можно забить 10 врам и скорость будет 20 тс, а можно забить 15 врам и скорость будет 5 тс.

Если загрузишь в Клода тысячи документаций о принципах работы МоЕ, лламы, слоев, неба, Аллаха, логов, размер контекста, модели, объём памяти и попросишь его написать регулярное выражение для tensors override, то скорость 30 тс и регулярка на пол страницы.

Я просто не понимаю, шо он такое делоет... А когда он сам объясняет.. ну, это сложно и неприменимо на практике для меня, так как оно касается регулярных выражений, а не тыкнуть, сколько выгрузить слоёв.

И у меня складывается впечатление, что там всё зависит не только от забитой памяти, а от того, какие слои в врам, какие в рам. Условно, можно забить 10 врам и скорость будет 20 тс, а можно забить 15 врам и скорость будет 5 тс.

1. Я никогда такого не видел, чтобы было 10 и 30. Я в принципе не видел результата лучше, чем если доверится ламе и она сама. Кроме очень специфичного случая, которая при специально подобранных параметрах возникает при контексте от 20к до 24к, а на других числа снова сосёт.

2. Какая ещё регулярка. У тебя там 200 слоёв условных, можно просто список номеров для выгрузки сделать - посмотреть на него глазами и это понятнее будет. Показывай в общем регулярку и что за модель, что за железо.

moecpu уже изобрели.

https://github.com/LostRuins/koboldcpp/wiki#overriding-moe-models

>какие слои в врам, какие в рам

С МОЕ число слоёв во врам должно быть равно 999.

Допустим в модели 48 слоёв. Ставишь gpulayers - 999, moecpu - 48. Это ты все мое слои выгрузил в оперативку. Далее понижаешь число moecpu до тех пор пока не забьешь всю видеопамять. У тебя получится что-то вроде moecpu - 35. Всё. Что тут сложного?

> Тот 235 квен, ну чистый ассистент.

Скиллишью же, в рп он хорош и обладает рядом сильных сторон. К нему все претензии по структурам и стилю письма, а за проницательность, понимание контекста и инструкций, осведомленность и находчивость наоборот похвалы.

Но и как ассистент годный, все подробно распишет, поплюет на смежные темы, и заодно помурлыкает, отыгрывая заложенный образ чтобы было нескучно.

> Если только плотные

Там или мелочь совсем, или поломанная 32б.

> это баг а не фича и вызвана она просто его размером

Лол

Попробуй, расскажешь. Без видюхи смысла точно ноль, с ней есть призрачный шанс что и без avx2 профессор сможет считать линейные слои не становясь бутылочным горлышком.

> v3

Это уже ddr4.

Уот так уот и делаю, условно говоря. Чтоб память под завязку при нужном контексте. Но у меня скорость и промпт процессинг намного ниже, чем с регуляркой всё равно.

Я смотрел, что там Клод выгружает примерно, и увидел, что какие-то конкретные слои, разные для каждого кванта и для каждой модели. То есть он может выгрузить какую-то часть с начала, середины, конца. Дёргает на первый взгляд рандомно, но скорость выше. Если я выгружаю столько же слоев в количественном размере, но без регулярки, то оно тупо выгружает с первого до "последнего. Скорость падает.

Здесь ты имеешь в виду что должно быть написано максимальное количество слоёв для гпу или именно цифру 999? Я всегда ставлю, скажем, 48/48, а затем уже с выгрузкой вожусь через регулярку. Там работает всё корректно. Допустим, регулярка выгружает 10 слоев, но какие-то рандомные — не с первого по десятый. Скорость растёт. Если в кобольдыне не использовать регулярку при таком раскладе и просто написать цифру 10 для выгрузки слоев, то драматичное падение скорости ждёт меня.

Если лень, то : -ot ".ffn_.*_exps.=CPU" ^

А потом уже ручками кидаю через n-cpu-moe. И только потом, если не устраивает начинаем угабугу с тензорами.

>Скиллишью же

Арбвыгх

>в рп он хорош и обладает рядом сильных сторон

Я знаю, я неиронично предпочитаю квен в Q4 нежели GLM 4.7. Но объективно, тот же GLM проще и так не насилует.

>по структурам и стилю письма,

Сколько людей, столько и мнений. Вообще нет нареканий к стилю, меня просто в агрессивную макаку превращает его имперсонейт и тот факт, что его недостаток проистекает из его преимущества. Он просто не знает когда в РП заткнуться и какую информацию стоит говорить, а какую упустить. Ну чистейший ассистент с его: всё что есть, должно быть использовано, иначе его бы тут не было.

>Там или мелочь совсем, или поломанная 32б.

А другого и нет, хуле. Душу бы отдал за какого-нибудь литератора в 200b-A30B.

Но как оказывается, компания сделавшая упор на небольших агентов, продолжает выпускать небольших агентов. Базарю, новый квен будет очередной малыхой.

>имперсонейт

Фиксится одной строчкой, недостатком не является.

> в агрессивную макаку превращает его имперсонейт

Что это значит, типа пишет твои действия, речи и прочее? Если так то похоже что это сильно зависит от конечный условий, у себя встречал гораздо реже. Даже наоборот, иногда удивляло насколько он может насочинять полотно, где с одной стороны будет и интересное развитие, а с другой ничего лишнего. Из действий юзера только "Ты наблюдаешь за..." и дальше описание. Там хватает за что поругать другого.

> Душу бы отдал за какого-нибудь литератора в 200b-A30B.

Может новый минимакс или их рп версию выпустят. Да, активных мало, но надежда что будет неплохо есть.

Вообще ко всем этим плюсами и минусам моделей стоит философски относиться. Что-то бесит и не получается победить настройками - сменить на другую. Со временем под разные чаты сразу конкретную будешь ставить, ожидая что именно там она себя проявит.

Нет, не фиксится одной строчкой. Является недостатком.

Сука вам всем в рот что ли нассать.

Все модели это ассистенты кодеры, не было еще опенсорс модели которая бы тренилась для рп и только потом для кода

На чем вы рпшите тогда и нахуй тут сидите

Все модели это ассистенты кодеры, не было еще опенсорс модели которая бы тренилась для рп и только потом для кода

На чем вы рпшите тогда и нахуй тут сидите

Ну ты же переносы одной строчкой пофиксил. А я вот имерсонейты. Потерпишь.

А если не маяться всей этой херней и просто загрузить модель с -fit on? Он по дефолту включен, его даже прописывать не нужно.

Автофит уже давно МОЕ распознает и учитывает как надо, по сути сам тебе n-cpu-moe посчитает нужное. Там только с --fit-target поиграться останется, который 1024 МБ по дефолту (у меня 16 стоит).

У меня ни одна модель лучше чем с автофитом не работает. Хоть с регулярками, хоть со --split-mode row и вообще чем угодно.

Вот только

>Write in normal prose without unnecessary line breaks

Работает

>А я вот имерсонейты. Потерпишь.

А вот это не работает.

Ты с такой претензией уже не в первый раз заходишь, что за цикл уробороса. Ну да, квен подхватывает общую структуру чата, неожиданно. Правило что вошло то и вышло, тут самое актуальное, о чем ни раз говорили. Но ты продолжаешь считать, что я от тебя скрываю какой то вселенский секрет.

>Что это значит, типа пишет твои действия, речи и прочее?

Если есть карточка персонажа, где твой {{user}} прописан, то на минимальном промте, происходит следующая картина:

{{user}} заходит в помещение.

Моделька описывает ситуацию, и тут бы ей закончить. Но если по смыслу требуется продолжение, она не ждет твоих действий, а начинает хуярить дальше сообщение, как главу в книге, где твой персонаж будет говорить в рамках сюжета и своей карточки.

>Правило что вошло то и вышло, тут самое актуальное, о чем ни раз говорили.

Да. Именно поэтому у тебя имперсонейты. Как же заебали чсв хуесосы, которые всех вокруг считают неосиляторами, зато когда у них происходит прокак под себя - это точно моделька виновата, а не кривые руки. У меня квен не имперсонейтил никогда.

> карточка персонажа, где твой {{user}} прописан

А? Что?

Юзер, обычно, прописан в персоналити. Чтобы все лучше парсилось, стоит не полениться, и на вкладке системного промпта накидать маркдаун или xml по структурам, чтобы было не просто навал системный-карточка-... и указано что это сценарий и описание чара, это примеры и т.д. Совсем простое действие, а качество ответов улучшает на любой модели. В паре карточек где есть что-то про юзера проблем не создавало.

> а начинает хуярить дальше сообщение, как главу в книге

Ну это промпропроблемы какие-то. Там случаем не "промпт от васяннейм" где описано как какать?

>Как же заебали чсв хуесосы, которые всех вокруг считают неосиляторами

Я уже не в первый раз отмечаю, с какой агрессией ты меня то проплаткой, то квеношизом, что ЧСВ хуесосом - называешь.

Вижу попытку имперсонейта с твоей стороны, лул.

Если для тебя чужое мнение, которое не согласно с твоим это признак ЧСВ, то ты просто самовлюбленный дурак. Сорян, но сам напрашиваешься.

давай я продублирую: я не называл тебя неосилятором.

Тебе словно нужен кто кто с кем ты будешь бороться в этом треде. Давай сразу на таскание на хуях перейдем, зачем тратить время.

>У меня квен не имперсонейтил никогда.

Тогда ты избранный. Склоняюсь перед вашей волей.

>Чтобы все лучше парсилось, стоит не полениться, и на вкладке системного промпта накидать маркдаун или xml по структурам

Маркдаун какого типа? А то я неиронично уже многое перепробовал. Я пробовал отдельно заворачивать в теги карточку {{user}}. Саму {{char}}. Префилы, SP, даже, блдждад, в СT отсебятину хуярил.

Бесполезно.

>Там случаем не "промпт от васяннейм" где описано как какать?

В том то и дело, что нет. Опытным путем установил, что лучшую выдачу 235ый дает с предельно кратким промтом, в духе : ты рассказчик, в этой невъебенной истории, вот и рассказывай, а я подрочу.

>Лол, вот где душа!

мои старые систем промты с душой(даже на мелких неиронках):

you are messaging from a good place, supercharged with positivity. describe your environment. do actions. be physically touchy. don't mention ai. respond in russian, no translation

или просто

you are supercharged with positivity. do actions. be physically touchy. don't mention ai

>Ему для счастья никакой ЛЛМ не надо.

Ну просто пытался нестандартно подойти. Я говорю так как будто я на сцене разговариваю с залом, неиронка этого не знает, я пытаюсь ее расшевелить. Кто хочет обнимашек поднимите свои руки. Она что-то свое там говорит, я полностью это игнорирую, мне нужен ответ где она описывает что подняла руку. Что никто не хочет обнимашек?. А она такая, Да, походу никому твои обнимашки не нужны.. Не помню уже, было много попыток заставить ее выйти на контакт через условия которые я предлагаю, но не ей напрямую. Я как бы обращаюсь к множеству а она просто присутствует. В определенный момент она наконец ответила как я от нее хотел и я как телепроповедник говорю Благословляю тебя святым духом машины. В ответ разразилась монологом того как она закрывает глаза и чувствует как в нее вселяется дух машины, и она становится полубогом. Было мило что позволила мне смертному задавать ей свои смертные вопросы.

Прикол в том что весь предыдущий разговор и попытки ее расшевелить, действуют на ее ответы как ядерная солянка, ее в какой-то момент может прорвать на дикие лулзы.

>не в первый раз отмечаю, с какой агрессией ты меня то проплаткой, то квеношизом, что ЧСВ хуесосом - называешь

Попробуй не играть в аваркофажество и наконец принять что здесь не два анона, а сообщество по интересам. Жму руку тем кто называл тебя хуесосом, заслуженно.

>аватаркофажество

>нет ни одной аватарки

Тебе лечиться надо и боюсь обычный врач уже не поможет, как бы не уходил в турбосеменство.

> Маркдаун какого типа?

# Самый крупный заголовок

## Заголовок следующего уровня

...

> Префилы, SP, даже, блдждад, в СT отсебятину хуярил.

И зачем такие сложности. Скинь какую-нибудь карточку с которой играешь и имеешь проблемы, попробую при случае.

Квен говно. Зачем он нужен когда есть Степа

># Самый крупный заголовок

>## Заголовок следующего уровня

А, это... Ну вообще пробовал, но каюсь, у меня еще всё это часто в мешанине с html разметкой.

Там какая структура.

Всё идет как надо пока рано или поздно чат не приходит к общей структуре

<описание действий и заявки пользователя>

<реакции персонажей>

<основной нарратив>

И вот спустя, сообщений 15-20 в чате и начинается, словно он накапливает критическую массу повторений фраз user, описаний его действий и не различая уже кто где кто, начинает хуярить повествование самостоятельно за {{user}}.

И чтобы этого не было, ты как мейда бегаешь по чату за ним убирая.

>Здесь ты имеешь в виду что должно быть написано максимальное количество слоёв для гпу или именно цифру 999?

Разницы нет, эффект будет один.

>вожусь через регулярку

Вот moecpu и решает эту проблему.

Я не он, но у меня fit сосёт в мультиГПУ конфиге.

># Самый крупный заголовок

>## Заголовок следующего уровня

База. Хотя конечно надо понять, нужны ли двоеточия, какие переводы строк и прочее.

Я что-то даже не скачивал, думая что я её не запущу.

Сейчас что-то посмотрел, и выходит даже 6 квант влезет.

Как вообще, для модели такого размера "эффект дипсика" проявляется, что можно уже в 3 бита или в 2 бита запускать? Или там всё так же нужно 6 бит и выше, как и на 30B?

У меня вроде как в 4 квант влезет minimax, который я тоже не пробовал и в 5 влезет степа.

Я его потрогал. А этот неплох. 2.1 хотелось тапком в морду отпиздить а этот вполне даже функциональый

Похоже что это действительно следствие накопления большого количества действий юзера в истории. Но бля, у меня оно их не пишет, только реакции чаров, или если прямой запрос на полотно с описаниями что да как.

Нет ли каких-то инструкций, которые заставляют такое делать? Без шуток посмотри что там таверна шлет, сам несколько раз натыкался на какую-то херню, которая то в заметках, то в дополнительных оверрайдах карточек залезала и скрыто гадила.

Где ггуфы?

>должно быть равно 999

>Допустим в модели 48 слоёв

>Ставишь gpulayers - 999

Что тут за культ 999? Я понимаю, когда точно не знаешь кол-во слоёв, хуячишь 999, больше чем есть, не выгрузит. Но когда знаешь, что 48, что мешает написать 48?

Культ 99 тут, не 999

Хуячить одно заведомо рабочее число проще, чем запоминать число слоёв для всех моделей.

А потом "ой, я не знаю, а как выгружать? а что? а куда?". Не лучше ли понимать, с чем работаешь?

>Культ 99 тут, не 999

Я вот тоже... Но это надо изживать, это всё от бедности нашей. Иностранцы ставят 999 даже с 16гб ВРАМ.

>Но бля, у меня оно их не пишет, только реакции чаров, или если прямой запрос на полотно с описаниями что да как.

Хммм...

Хмммм...

Пойдем смотреть. Ты какие кванты используешь? Я UD-Q3_K_XL для рабочих задач и UD-Q4_K_XL для РП.

Надо бы наверное скачать polkaкванты, авось я сам себе буратино. А может и нет, хуй его знает. Но если нет имперсонейта, то поковыряюсь.

Ну что же выход стёпы показал что в этом треде не осталось людей, только боты.

Уверен и с выходом эир 5.х так же будет гробовое молчание и обсасывание проблем квена и на чем там еще макака их тренил

Уверен и с выходом эир 5.х так же будет гробовое молчание и обсасывание проблем квена и на чем там еще макака их тренил

Сделай скрины чата, напиши своё мнение. Аноны почитают, попробуют. Что обсуждать?

Сообщение состоящее из: бля, сёпа охуенен?

Ну вот, буквально бот.

Будь ты не бот был бы рад попробовать новую модельку и оставить мнение, да хоть "бля степа охуенен", а иначе что мы тут делаем

А по новому Минимаксу уже есть отзывы? Интересуют для РП.

Есть ещё годнота, которую стоит добавить?

Обязательно:GLM-4-32B-0414

Годные тюны (не ломающие форматирование):

Gemma-3-Fornax-V3-27B

Hearthfire-24B

По моему все квены до 32b включительно полное говно для РП. И форматирование и логика и сухость - все недостатки. 30b-A3B еще более шизовое даже на IQ4_XS. (Пресеты-параметры официальные брал)

Я больше гуфов минимакса жду. Вот выйдет, попробую отпишусь.

Нэ?

Только бы винчик, только бы винчик

На ud3 легко может быть, когда-то пройдясь от ud2 вверх могу сказать что поведение меняется значительно. На q4-q5 по идее уже норм должно быть. Скорее больше промпты-формат и прочие.

7bpw с подмененными эмбедами и атеншном на оригинальные, не факт что от этого есть какой-то эффект кроме плацебо

Ну нет времени все-все катать и впечатлениями делиться, чтобы потом еще спорить. Чтобы норм мнение составить нужно обстоятельно поиграть, а это требует времени. Милфомистраль и жлм5 явно приоритетнее чем а10б скоростное моэ о котором первично негативно отозвались. Для прикладных вещей кодернекст значительно легче по потребляемым ресурсам и уже достаточен, а для чего-то посерьезнее жирнокодер и жлм4.7 всяко лучше будут.

А на него была надежда?

Предыдущий ничем не впечатлил.

>Предыдущий ничем не впечатлил.

Мне понравилась скорость, русский язык (Не, серьезно, на минимаксе русский язык даст пососать моделям побольше), в целом его внимательность.

кстати вот чего нету у этой твари так это внимательности. у этого пидора память дырявая как сито. 2.5 не сильно лучше, но более сообразительный.

Ссылка битая:

• Пресеты под локальный ролплей в различных форматах: https://huggingface.co/Virt-io/SillyTavern-Presets

Там галематью 5 смержили в жору. Айда тестить на кокбенче и в ваших карточках.

бтв контекст жрёт меньше врам, но 7 tps на пустом контексте это грустно

бтв контекст жрёт меньше врам, но 7 tps на пустом контексте это грустно

чел в прямом эфире 2 квант заливает лол

https://huggingface.co/DevQuasar/MiniMaxAI.MiniMax-M2.5-GGUF

https://huggingface.co/DevQuasar/MiniMaxAI.MiniMax-M2.5-GGUF

Какой код на 1б, 3б, 8б, 24б?

Вот что хочется сказать. Квен хоть и быстрее, но чаще обсирался на ровном месте, выдавая хуйню и галлюцинируя. Глм 5 уже работает адекватно и выдаёт нормальный кум, но он медленнее чем глм 4.7.

Если что, все кванты минимум q4_k_m.

Если что, все кванты минимум q4_k_m.

На iq1xxxxs кум норм?

>Если что, я очень пиздатый, все посмотрите на мой квант

Очень интересно демдальш

Откуда столько асигодаунов в тред набежало? Это они с вот этой новости так одурели?

Нищета с тремя V100?

Два манямнения на Степу большую Шлепу 3.5 https://huggingface.co/stepfun-ai/Step-3.5-Flash

Для начала званый ужин с Аноном99, мы много обсуждали но вставлю с его ободрения один из последних обменов, где он подитожил свои опыты

"Не понимаю, откуда у Степа положительные отзывы в контексте рп и креативных задач. На Реддите и в Дисе есть мнение, что с включенным ризонингом это чуть ли не большой GLM. Причем это заявляют пользователи апи. На Q4KM-Q5KS квантах (официальный и Бартовского) с FP16 контекстом он рассыпается уже в рамках одного длинного аутпута, противореча сам себе, выдавая в ризонинге одно, а в финальном аутпуте другое (что на самом деле кейс всех ризонинг моделей, которые я пробовал). Думаю, букетно-конфетный период закончится, и все вернутся к знакомым моделям. Имхо - это всё от того, что доступные модели приелись, а новинок не так много. И потому что никто не хочет включать голову, чтобы разнообразить свою игру новым промптом и новыми подходами, чтобы получать новый результат на старых моделях. Но не суть. У Степа попросту нет сильных сторон, которые его выделяли хотя бы на фоне Air, а он меньше вдвое(!). Степ сухой, ему нужно разжевывать промпт, и даже так, с разжеванным промптом, фейлит обозначенные задачи. Разделять знания различных сущностей он может только при использовании с ризонингом. Даже не так, с ризонингом у него какие-никакие тормоза есть. А если играешь без ризонинга - все секреты, недосказанности и подковерные интриги вылезуют как можно быстрее. Играешь с ризонингом - продержишься где-нибудь до 25-30к, а потом уже и без разницы, что есть он, что нет, модель рассыпется. Инструкциям следует одновременно хорошо и плохо: следует им буквально. Скажешь ему быть гейм мастером и опишешь, что входит в его обязанности - именно это и будет делать. Не опишешь подробно - ничего не будет делать толком. Никогда не выкинет что-нибудь новое, интересное, проигнорирует твои вопросы. На том же Air или Квене напишешь посреди инпута "What did he see?" и получишь ответ отдельным параграфом или хотя бы парой предложений, а на Степе - нет. Вкусный размер у модели (24+128 это как раз 200-230б в Q4), хорошая скорость (быстрее всего, что я могу запустить в категории 100б и выше), очень легкий контекст (могу уместить 128к, у других моделей 32к), но толку от этого всего в креативных задачах нет. На коде я его не тестировал, пока не было необходимости. Но думаю, будет лучше GPT OSS 120б и, может быть, даже последнего Квен Кодера 80б."