Трансформер это тупик

>Предыдущие треды тонут здесь:

Почти 200 раз качу, и всё равно периодически обсираюсь. Предыдущий:

>1517458

Сегодня явно не мой день

Ну вот, у нас есть победитель в локальном вайб-кодинге: GLM-4.7-Flash-Q8

Промт: "Создай на HTML5 минималистичный аналог игры Flappy Bird с автопилотом"

Пару минут и игра готова. Только зацените, у птички даже клюв есть и облака на фоне. Красота.

Промт: "Создай на HTML5 минималистичный аналог игры Flappy Bird с автопилотом"

Пару минут и игра готова. Только зацените, у птички даже клюв есть и облака на фоне. Красота.

А на С++ кто победит?

Демку sfml (под версию 2.х) с треугольником пишет даже гемма e4b (7B), то есть вся необходима инфа как рендерить треугольники у любого glm точно есть.

Если там есть интеллект - то результат будет такой же, оно понимает что нужно сделать то же самое только чуть подменить функцию, сложность одинаковая.

А если нет и это стат-обработчик текста, то на С++ результаты будут намного скромнее в связи с меньшим числом обучающих примеров.

Как раз проверим тупик или не тупик трансформеры.

А ещё лучше придумай свой простой язык, где функция отрисовки треугольника имеет какой-то тобою придуманный интерфейс. Например, нужно передать 9 массивов чисел, где записаны x1, y1, x2, y2, x3, y3, r, g, b - и другого интерфейса для рендера нет.

Для человека это даже не является усложнением. А вот нейронка по отдельности эти задачи решает, а когда вот меняешь что-то такое с человеческой точки зрения незначительное - часто неожиданно хуже результат выдаёт.

Я пробовал задачу, по типу, что записаны слова пронумерованные, и нужно разделить их на категории.

Если формат вывода овощи:[1, 3, 8, 12, 16, 17, 19], фрукты: [] ... - то оно не справляется. Пункты дублируются и оно ошибается.

Если нужно написать:

1 картоха - овощ

2 осина - дерево

3 свекла - овощ

То справляется всегда без проблем. Хотя это одинаковая задача по сложности.

>Например, нужно передать 9 массивов чисел, где записаны

>Для человека это даже не является усложнением

Потому что он нахуй пошлёт такой язык вместе с его создателем.

>То справляется всегда без проблем. Хотя это одинаковая задача по сложности.

Для Т9 это разные задачи.

А код копипастил или агент какой использовал? Я как не пробовал llm во всякеи aider/kilo пихать - они вечно с форматированием обсираются

Когда-то хотел кинуть команду запуска тяжелых моделей. Тут такое никто не делал, так что повещаю вам откровения. Из-за того, что слои оч большие, по итогу на картах остается много свободного места, в которое можно впихнуть слои с рам, если их разбить. Но это не всегда подходит, потому что внутри слоя данных передается больше, чем между ними, поэтому при медленном подключении карт это может наоборот ухудшить.

Чтобы разбить слой, надо смотреть граф вычислений используя GGML_SCHED_DEBUG=2. Это необходимо делать, чтобы разбить его в правильном месте. Если бездумно выдернешь жирного эксперта из слоя - у тебя увеличится количество сплитов графа и, соотв., трансферов данных. У дипсикоподобных архитектур разбиение прям кайфовое - сначала обсчитывается аттеншен, затем gate->up->down эксперты, затем такие же шэксперты. В моем случае, например, в 3090 влезает 5 слоев и еще один эксперт.

Например, для трех 3090 разбиение выглядит так: участок с -ts для этих карт записываеттся как 6,5,5 - делаем шесть слоев на первой карте, чтобы аттеншен шестого слоя попал на нее. И далее пишем такие регекспы:

blk\.(5)\.ffn_(up|down)_exps⭐=CUDA1,blk\.(5)\.ffn_(gate|up|down)_shexp⭐=CUDA1 - шестой слой разрываем между gate и up экспертами, чтобы жирнич gate остался на CUDA0, вторую половину c двумя остальными жирничами кладем на CUDA1.

blk\.(10)\.ffn_(down)_exps⭐=CUDA2,blk\.(10)\.ffn_(gate|up|down)_shexp⭐=CUDA2 - 11 слой разрываем между up and down.

Далее смотрим GGML_SCHED_DEBUG, чтобы убедиться, что мы нигде не объебались и не сплитанули.

Таким образом вместо 15 слоев на три карты влезло 16. Мелочь, а приятно. Мне это бустануло скорость тг 6 до 6.5 т/с, что в относительных цифрах прям хорошо.

Второй скрин - всякие кастомные опции, запиленные под себя. Последние две для дипсика оказались не нужны, т.к. я уже писал, что у него обсчет слоя очень приятный. Но для других архитектур они могут быть полезны, чтобы перекинуть кэш на другие девайсы.

Неправильно названная LLAMA_NO_ALLOC_WEIGHTS самая полезная - позволяет запустить модель для инференса без загрузки весов. Да, именно инференса, мгновенно идешь и свайпаешь в таверне, когда тюнишь конфиг, смотришь на новые цифры. И это я молчу про оомы на этапах после загрузки весов, которые тоже происходят без ожидания.

LLAMA_TENSOR_BUFFER_SIZES_ONLY еще быстрее, оно просто считает размер тензоров моделей и выводит в консоль, закрывая жору. Для прикидок веса оч полезно, потому что поначалу тебе о кешах думать не хочется, да и LLAMA_NO_ALLOC_WEIGHTS на дипсике и глм 5 не мгновенно работает, к сожалению, он там пробегает по картам и аллоцирует, все это занимает секунд 5.

Эти советы могут быть полезны для анона с 3060 и паскалем, который там аттеншен на 3060 складывал. Я не помню, как ты это делал, но очень вероятно, что ты понаделал ненужных сплитов. Покури граф и посмотри, вдруг что можешь улучшить. Ну или кидай свою модельку и команду запуска, я посмотрю, как там оно выглядит у тебя.

Чтобы разбить слой, надо смотреть граф вычислений используя GGML_SCHED_DEBUG=2. Это необходимо делать, чтобы разбить его в правильном месте. Если бездумно выдернешь жирного эксперта из слоя - у тебя увеличится количество сплитов графа и, соотв., трансферов данных. У дипсикоподобных архитектур разбиение прям кайфовое - сначала обсчитывается аттеншен, затем gate->up->down эксперты, затем такие же шэксперты. В моем случае, например, в 3090 влезает 5 слоев и еще один эксперт.

Например, для трех 3090 разбиение выглядит так: участок с -ts для этих карт записываеттся как 6,5,5 - делаем шесть слоев на первой карте, чтобы аттеншен шестого слоя попал на нее. И далее пишем такие регекспы:

blk\.(5)\.ffn_(up|down)_exps⭐=CUDA1,blk\.(5)\.ffn_(gate|up|down)_shexp⭐=CUDA1 - шестой слой разрываем между gate и up экспертами, чтобы жирнич gate остался на CUDA0, вторую половину c двумя остальными жирничами кладем на CUDA1.

blk\.(10)\.ffn_(down)_exps⭐=CUDA2,blk\.(10)\.ffn_(gate|up|down)_shexp⭐=CUDA2 - 11 слой разрываем между up and down.

Далее смотрим GGML_SCHED_DEBUG, чтобы убедиться, что мы нигде не объебались и не сплитанули.

Таким образом вместо 15 слоев на три карты влезло 16. Мелочь, а приятно. Мне это бустануло скорость тг 6 до 6.5 т/с, что в относительных цифрах прям хорошо.

Второй скрин - всякие кастомные опции, запиленные под себя. Последние две для дипсика оказались не нужны, т.к. я уже писал, что у него обсчет слоя очень приятный. Но для других архитектур они могут быть полезны, чтобы перекинуть кэш на другие девайсы.

Неправильно названная LLAMA_NO_ALLOC_WEIGHTS самая полезная - позволяет запустить модель для инференса без загрузки весов. Да, именно инференса, мгновенно идешь и свайпаешь в таверне, когда тюнишь конфиг, смотришь на новые цифры. И это я молчу про оомы на этапах после загрузки весов, которые тоже происходят без ожидания.

LLAMA_TENSOR_BUFFER_SIZES_ONLY еще быстрее, оно просто считает размер тензоров моделей и выводит в консоль, закрывая жору. Для прикидок веса оч полезно, потому что поначалу тебе о кешах думать не хочется, да и LLAMA_NO_ALLOC_WEIGHTS на дипсике и глм 5 не мгновенно работает, к сожалению, он там пробегает по картам и аллоцирует, все это занимает секунд 5.

Эти советы могут быть полезны для анона с 3060 и паскалем, который там аттеншен на 3060 складывал. Я не помню, как ты это делал, но очень вероятно, что ты понаделал ненужных сплитов. Покури граф и посмотри, вдруг что можешь улучшить. Ну или кидай свою модельку и команду запуска, я посмотрю, как там оно выглядит у тебя.

>чтобы аттеншен шестого слоя попал на нее

кеш аттеншена, конечно же

быстрофикс

Именно это скидывали еще летом, причем автоматический расчет под конкретный квант и конфиг железа с минимизацией пересылов. Полносвязанные слои можно бить, между ними активации не большие. Главное не пытаться делить атеншн, но это сделать сложно.

> LLAMA_NO_ALLOC_WEIGHTS самая полезная - позволяет запустить модель для инференса без загрузки весов

Вот это круто.

О, вовремя ты запостил, я завтра как раз собирался запускать жирноглм, раскидывая аж на 4 rpc-сервера (+ основная пекарня). Интересно, это будет быстрее, чем с диска читать, или пересылка по гигабитному лану всё убъёт? В любом случае, 感謝.

Я бы проверил, но так впадлу визуалку ставить, что бы код скомпилить.

Мне нравится по старинке в режиме чата. Но сейчас тестирую так: vscode + cline + llama cpp. Иногда годно, иногда cline начинает бесить командами: запусти то, перейди туда. Так что если готов ждать то cline, для чего то быстрого и прямого, чат.

Можно условный codelite поставить, там вроде как есть портабл версия, где просто архив распаковываешь и запускаешь, компилятор внутри уже встроен какой-то не слишком свежей версии.

Визуалка это чудовище, а не ide, я до сих пор не могу поверить что кто-то юзает её.

Vscode же, не vs. Код неплоха, особенно в последние годы

Мимо

сап двощ. вопрос - появились какие нибудь классные модельки на 12-24B? для рп есесна.

пользовался SAINEMO 12B, Darkness Reign 12B, gemma-3-12B-abliterated (вообще пиздец какой-то а не модель, хз), и cydonia-24B (в четвертом кванте. самая умная и крутая, но на моем железе выдает максимум 3 т/с при 12к контекста, шо мало...)

8гб видеопамяти, 32гб оперативы (теоретически могу расширить до 48гб, но думаю сильно это картину не исправит)

если есть че интересное под это - с радостью послушаю.

пользовался SAINEMO 12B, Darkness Reign 12B, gemma-3-12B-abliterated (вообще пиздец какой-то а не модель, хз), и cydonia-24B (в четвертом кванте. самая умная и крутая, но на моем железе выдает максимум 3 т/с при 12к контекста, шо мало...)

8гб видеопамяти, 32гб оперативы (теоретически могу расширить до 48гб, но думаю сильно это картину не исправит)

если есть че интересное под это - с радостью послушаю.

Киньте еще для 32 gb vram (+64 ram на крайний случай) свой тир лист. Желательно heretic (abliberated). И скажите есть ли смысл на русике пробовать или качество сильно хуже.

не столько качество хуже, сколько скорость и объем контекста, говорю как владелец 8 гигов врам. ответ на 200 токенов на русском и английском вмещает абсолютно разное количество информации. поэтому юзаю рп на инглише, просто в силлитаверн переводчик врубаю. да, кривовато - зато быстро генерит.

мои 3 токена в секунду на русском - это 3 символа в секунду, а на инглише - почти 2 слова в секунду, смекаешь?

русский текст занимает в 5-7 раз больше контекста при том же количестве символов, чем английский

Тот кто гайд составлял, что курил?

>от 8GB VRAM и 64GB RAM

>GLM-4.5-Air-106B-A12B

У меня 16 vram + 64 ram, скачал Q4_XS, веса 56.3 гига, запускаю на Винде с помошью llama c++. Оно сожрало всю оперативу в 0 и это с контекстом в 8к. Как этим пользоваться, вы чё, угараете? На 64 гигах оперативы, оно запустится, да, но использовать не возможно. В чем прикол?

>от 8GB VRAM и 64GB RAM

>GLM-4.5-Air-106B-A12B

У меня 16 vram + 64 ram, скачал Q4_XS, веса 56.3 гига, запускаю на Винде с помошью llama c++. Оно сожрало всю оперативу в 0 и это с контекстом в 8к. Как этим пользоваться, вы чё, угараете? На 64 гигах оперативы, оно запустится, да, но использовать не возможно. В чем прикол?

Это не всегда дает преимущество, все зависит от ширины псины и задержек. Данных при разделении слоя пересылается в 3-4 раза больше чем между слоями. Это точно не то, что следует предлагать по умолчанию, тем более вслепую есть риск накосячить и получить сплиты.

Точно быстрее чем с диска, но слой дробить между узлами не стоит. Кстати, где-то у жоры был PR, хз вмержили или нет, там делали так, чтобы обмен данными между серверами происходил без трансфера данных на клиент.

Это явно самый-самый минимум. Плюс на шинде аллокация памяти несколько иная и система много кушает.

> Это не всегда дает преимущество, все зависит от ширины псины и задержек.

100%, жаль статистики мало чтобы изучить. Тут бы лезть в код и добавлять отслеживание задержек конкретных операций чтобы понять, а потом на разных конфигах и режимах распределения тензоров погонять.

> На 64 гигах оперативы, оно запустится, да, но использовать не возможно. В чем прикол?

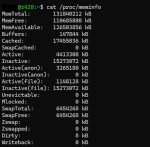

В линуксе. У меня после запуска еще и память на таверну с броузером остается, причем контекст - 16K (можно даже больше, но у меня еще и RAG модель запускается на CPU - это мне важнее, чем еще больше контекста). Запуск на кобольде.

>8гб видеопамяти, 32гб оперативы

Для более-менее адекватных моделей этого мало, либо использовать адские кванты вроде Q3...

Посоветуйте модель для реалистичного RP (на русском крайне желательно) с (не)большим уклоном в NSFW. Моя система под ии - рабочая станция HP z420, проц e5-1620, 128 Гб ОЗУ, 2x 3060 12Gb, NVMe под веса, debian 13 (без иксов), последняя LLAMA.cpp, SillyTavern. Подключаюсь с другого компа.

GLM Air или GLM 4.5-4.7 во втором кванте. На русик надежд не возлагай

Ну что мнение по стёпе от нюни будет нет?

На моём опыте он уж слишком рашит события скипая детали, пишет как то не литературно, в лоб

На моём опыте он уж слишком рашит события скипая детали, пишет как то не литературно, в лоб

Немотюн-мердж RP-King 12B (у радермахера ггуф должен быть) мне очень понравился, в русике никакой, даже переводит плохо, но англюсик - мое почтение. Пишет, зачитаешься.

Cydonia-24B не вдохновила, к сожалению. Может в англюсике она еще ничего, но в русике никакая.

После Ministral 14b сидония кажется слабой для своих сидоньских размеров. Попробуй министраль от анслотов, ud-версию. Только не забудь ей температуру занизить до 0.3-0.4.

Сочувствую 8гб врам. Мне 12 было мало-то, а тут 8. У тебя не ддр3 ли? Чет прям грустно по токенам/с очень. Если ddr3 не парься, лучше подождать апгрейда до следующих поколений, эти планки уже не для нейронок.

вдогонку я бы посоветовал видяху побольше взять все-таки. Сейчас для нейро приятный старт хотя бы с 12Gb.

Можно конечно какую-нить p104-100 купить и инференсить llm на двух картах 8+8Gb... но это уже на любителя. Я бы посоветовал все-таки одну и побольше.

Все время использовал готовые сборки llamacpp, сейчас решил попробовать скомпилировать из исходников.

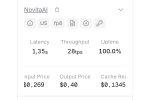

Скорость генерации поднялась с 17 токенов в секунду до 25.

Никогда не используйте готовые сборки, сами компилируйте под свой тип процессора, чтобы была оптимизация.

Скорость генерации поднялась с 17 токенов в секунду до 25.

Никогда не используйте готовые сборки, сами компилируйте под свой тип процессора, чтобы была оптимизация.

это на квен кодере некст

Хммм, может тоже попробовать скомпилить кобольд...

>Никогда не используйте готовые сборки, сами компилируйте под свой тип процессора, чтобы была оптимизация.

Скинь ключи компиляции для примера.

Звучит как пиздеж если честно. Там был коммит, повышающий производительность Квена Некст. Видимо, у тебя совпали оба события.

Так было же от нейронюни

Народ поясните нубу, все эти квантованые модели ниже q4, неюзабельное порезанное говно?

Да. Если только это не 200б гиганты и выше

cmake .. -DGGML_CUDA=ON -DGGML_CUDA_F16=ON -DCMAKE_BUILD_TYPE=Release -DCUDAToolkit_ROOT="C:/Program Files/NVIDIA GPU Computing Toolkit/CUDA/v12.4"

cmake --build . --config Release --parallel

ну хз, может быть.

Ниже 30b я бы не стал использовать третий квант.

Любители центнеров параметров вроде говорили, что в их случае ок.

Но если в немотюнах и иже с ними - ниже q4 сильное ужиралово мозгов.

Скачай последний релиз и проверь его с твоим собственным билдом. Я уверен, что это коммит дал производительность, а не билд. Если только у тебя не ik llama.

В последний раз сборку я скачивал 14.02. Еще не было этого коммита там?

Страшно? А ведь вас предупреждали

Сегодня выходят

Сегодня выходят

Как минимум вчера было вот это: https://github.com/ggml-org/llama.cpp/pull/19375

Заявляется как раз ~30% прирост, у тебя чуть больше даже.

Да, они реально что-то оптимизировали, выигрыш от свой компиляции у меня только 1,5-2 токена.

>что-то оптимизировали

Во чудак. Ты читай логи коммитов-то. В любом случае, хорошо, что Некст теперь работает быстрее.

Разберись как перекидывать слои на видеокарту. Врам должна быть забита полностью. А в твой конфиг спокойно залетает Q4_K_XL с 50к контекста.

Юзай --no-mmap что бы высвободить RAM . Да, между перезагрузками кешироватся не будет, но и не отожрет лишнюю рам под те слои что поместились в видеокарте.

Все начали наращивать жирок, у всех вырос размерчик. Похоже все-таки плато было найдено. Или пока не вывезли придумать как в меньший размер запихать больше. Одно понятно, после повышения размера понижать его никто уже не будет.

Наступила зима для всех, у кого меньше 256гб рамы.

Наступила зима для всех, у кого меньше 256гб рамы.

>не литературно

Что ты хочешь от простого Степана город Ухань. Он работяга не обученный на Толстоевском. А Набокова только в заводском сортире видал вместо газет.

Vram вся забивается полность.

Запускаю так:

llama-server -m "D:\LM Studio models\unsloth\GLM-4.5-Air-GGUF\GLM-4.5-Air-IQ4_XS-00001-of-00002.gguf" -fa on --jinja --fit-ctx 8192 --fit on --temp 0.6 --top-k 40 --top-p 0.95 --min-p 0.0 --host 0.0.0.0 --port 8080

Может что то в параметрах не так? --no-mmap попробую

Было уже

->

Вижен в 35В я бы звбрал, а голую LLM нахуй не надо.

Спокойно. Вдохнули и выдохнули.

АААаааааааааа бляяяяя, ДА ЁБ ТВОЮ МАТЬ, ДА СУКА, БЛЯТЬ, ЕБАННЫЙ В РОТ ЭТИХ ПИДОРАСОВ.

Какие хорошие новости.

Опенроутер разъёбывает всех собирателей некрожелеза.

Сейчас реальным локальщикам либо сосать мелкие модели до ~100В, которые ещё и заточены под всякую хуйню типа ризонинга или агентского кодинга. Либо собирать 500 гб озу и сосать полтора токена из 500-1000В.

Алсо, после крупных локальных моделей уже невозможно пересесть на мелкоту.

>Опенроутер разъёбывает всех собирателей некрожелеза.

Примерно как аренда квартиры разъебывает всех покупателей, да.

> Одно понятно, после повышения размера понижать его никто уже не будет.

> A17B

Глупышка, тебе что ли только 17б инференсить надо? 1Т-а2б модели наверно и вовсе на кофеварке запустишь. Это рост с 235 до 400б. Снова почти вдвое.

А рост активных в сколько, глупышка?

Никому нет дела до понижения активных с 22 до 17. Может только тебе, и то хз почему. Много ты на этом выиграл, клоун?

За цену некросервака, могущего в полтора токена на глм-5, ты можешь через API полтора миллиарда токенов нагенерить, это два года непрерывной круглосуточной генерации. Твоё некрожелезо окончательно стыквится ещё до того как ты отобьешь его.

Если для рабочих задач, то спору нет. Ты прав.

Это быстрее, это удобнее.

Но, а что делать если у меня есть желание залезть под хвост драконодевочке?

Там литералли сейфети через сейфети погонял.

Скорость больше. Сервак можно использовать и для других задач. Никто его исключительно для кума не собирает, дурашка. И никакой дядь Вова его не отключит по велению пятки на левой ноге.

У тебя какие-то другие веса будут, лол? От Q2 меньше цензуры не станет. Сейфти только у корпов есть, хотя после Грока любая локалка будет соевой.

> И никакой дядь Вова его не отключит по велению пятки на левой ноге.

В API ты платишь только за то что использовал. Сервак ты покупаешь как недвижимость - заплатил даже если не пользуешься.

>У тебя какие-то другие веса будут, лол?

Конечно нет, но как минимум разметка будет в моих руках и я могу хоть как то изъебнуться. Хотя это и бесполезно в большей части, но всё равно локалка меня по жопе за экспликт контент не отшлепает запретив доступ.

ЧатГЛМ-шизик, ты? В чём суть использовать неподходящие токены/формат чата?

> всё равно локалка меня по жопе за экспликт контент не отшлепает запретив доступ

Так и API этого не сделает. Для шизиков даже пикрил есть, все провайдеры обязаны сообщать опенроутеру если они что-то делают с запросами и их можно фильтровать. На деле, конечно, это на уровне "бля мамой клянусь не логирую запросы", но всё же.

>В API ты платишь только за то что использовал.

Что это меняет, кроме того, что ты не въебешь деньги? В один прекрасный момент он может отъебнуть, и тебе придется искать новое решение.

>Сервак ты покупаешь как недвижимость - заплатил даже если не пользуешься.

Никто не покупает сервак, чтобы им не пользоваться.

Суть твоих нахрюков в чем? Ты пришел в локалкотред доказывать местным, что они во всем не правы? Умом.

>ЧатГЛМ-шизик, ты? В чём суть использовать неподходящие токены/формат чата?

Just for lulz

>Так и API этого не сделает.

Так чего же вой с болот асиго треда не прекращается ?

надменно посмотрела, покачивая бедрами

Хехе... у вас какие-то гигапроблемы.

30b хватит для всех. Все, что больше - дрочерство ради дрочерства.

>Наступила зима для всех, у кого меньше 256гб рамы.

Цены на память малость вниз пошли кстати. Вот думаю, не пора ли уже брать - а то пугают, что кризис только усиливается. Мне проще, у меня DDR4.

>Цены на память малость вниз пошли

>кризис только усиливается

Противоречий не видишь?

>Мне проще, у меня DDR4.

Мало какой процессор поддерживает больше 128.

qwen3-VL-32b и так три месяца назад вышла. Я больше 3.5-coder жду. Шустрая локальная llm для всяких технических мелочей.

Я сам 16+64 и могу с уверенностью сказать, что ты обосрался где-то. IQ4XS легко запускается даже из под винды. Из под линуха запускается даже Q4XL, которая размером с 68гб. Все с контекстом 32к+

>fit

Это типа автонастройка или что? Я без этого запускаю

Просто подбираю ncmoe (у тебя в зависимости от контекста будет от 41 до 45). И да, --no-mmap нужен. Плюс еще прописываю -kvu -np 1 для ускорения

Бля ну мне пока квен который плюс на сайте понравился, быстрый и вроде не хуже гпт и гоймини.

Какой же будет дипсик4

Какой же будет дипсик4

>На деле, конечно, это на уровне

Что и требовалось доказать. Все всё логируют, иногда эти логи даже сливают. Так что в поезду все эти впопенроутеры.

Похуй, не нужна.

>вроде не хуже гпт и гоймини

Ну так потолок уже, скоро 30B обрезки будут не хуже.

https://huggingface.co/Qwen/Qwen3.5-397B-A17B

Размер модели вырос вдвое, при этом даже по их бенчам разница не коррелирует с размером. Та же ситуация, что с ГЛМ. Мде.

Размер модели вырос вдвое, при этом даже по их бенчам разница не коррелирует с размером. Та же ситуация, что с ГЛМ. Мде.

Win 11, запущен браузер, телега. GLM Air IQ4XS запускается без проблем и еще 10 гигов ОЗУ и 1.5 гига врама остаются свободными. Параметры на скрине

>17277x11171

ti ebanutiy???

Скриншот с 32к монитора.

Хочется бич модельки квена 3.5 пощупать, 35b кодер возможно будет неплох.

Ну квен хотя бы активные порезал, что по идее должно хорошо сказаться на скорости. Возможно будет работать быстрее чем Qwen 3 235, просто будет жрать больше памяти

Нахуй он нужен, если это просто урезанный 80b?

Что ж, это действительно всё.

Локалочникам оставили доедать 30/80-3б, теперь без рига, на консумерском пк, вообще нехуй делать.

Квен был последней надеждой, в какой то момент был уверен что параметры даже снизят, ведь китайцы братушки всё понимают.

Предполагалось что мы будем получать 100-16б, но мое стали нашей смертью.

Локалочникам оставили доедать 30/80-3б, теперь без рига, на консумерском пк, вообще нехуй делать.

Квен был последней надеждой, в какой то момент был уверен что параметры даже снизят, ведь китайцы братушки всё понимают.

Предполагалось что мы будем получать 100-16б, но мое стали нашей смертью.

Анон, будь добр, скинь команду запуска

> даже по их бенчам разница не коррелирует с размером

По бенчам там с 235 квеном только VL часть сравнивают, там ясен хуй прогресс маленький. Остальное сравнивают с квен макс и гопотой/попущем.

>Локалочникам оставили

Ась? Если у тебя проблемы со скачиванием, могу выложить эти файлы на яндекс диск.

>Размер модели вырос вдвое, при этом даже по их бенчам разница не коррелирует с размером. Та же ситуация, что с ГЛМ. Мде.

У Квена плюс в том, что творческое письмо было на высоте. Если размер хотя бы уменьшил некоторые его недостатки, добавил мозгов - могла и конфетка получится. Ждём отзывов.

Еще квант ddh0, который больше кванта Q4XL анслопа тоже спокойно запускается с 32к контекста даже из под винды. Из под линуха просто будет больше контекста и чуть быстрее скорость, потому что система меньше жрет

Что за хуета для нищуков?

Где кими и новый квен?

__________________________________

Мне нравится как они добавили параметров аккурат чтоб двухквантовые соснули

> Так чего же вой с болот асиго треда не прекращается ?

Потому что там очевидно сидят на корпах, а не опенсорсе. Там половина сидит на соевом Клоде.

В очередной раз провели хуем по губам простым работягам с 64гб озу...

>мое модели особенно чувствительны к квантованию

>для проги в отличие от рп важна точность и как следствие высокий квант

>запускает Qwen Coder 80b в Q4, хотя у него спокойно влезает Q6

>запускает GLM 4.7 Flash в Q8

>GLM справляется, а не Qwen нет, несмотря на то, что по всем бенчам Qwen намного лучше

В твоей башке ничего не екает?

> Все всё логируют, иногда эти логи даже сливают.

Точно так же как и твой нескучный webui может сливать, прецеденты уже были, и никто не гарантирует что не добавят логирование с галкой отключения, которая автоматом стоит уже. Нашёл к чему доебаться.

Для вас будет 35б 3.5Квен мое.

> В очередной раз провели хуем по губам простым работягам с 64гб озу...

Ты о чём? Заболиво навалили 35б-3а...

СУКА ЭТО НЕ ШУТКА ОГИ ПРОСТО ВСЕ РЕШИЛИ ЧТО 30Б ПЛОТНАЯ И 30Б 3Б МАНЯПЛОТНАЯ ЭТО ОДНО И ТОЖЕ

Сидим на старичке эйре дальше, щито поделать.

Спасибо за помощь, но у меня почему то крашится если в аргументах есть --no-map, а без него запускается, но с отжиранием всей памяти.

Нескучный webui можно ограничить локальным трафиком и ничего сливаться не будет, он же у тебя установлен. А с проксями/попенроутерами/корпоратами всё что ты можешь это верещать, что логи никому не нужны и что ПОМИДОР НЕ СЛИВАЕТ ЛОГИ!!!!

>Размер модели вырос вдвое, при этом даже по их бенчам разница не коррелирует с размером.

Очень даже корреллирует, активных параметров всего 17В, а было 22В, сечешь?

Но общей размер - мде, пока все кванты анслота мимо моих 128 + 24... Жопой чую что придется ждать пока инцелы q2_k_s выпустят.

Уровень контроля различный, не замечаешь?

Софт на своём ПК я полностью контролирую.

Впопенроутер может только обещать, всё держится на доверии.

Корпораты всё логируют и сливают по КД.

ИИЧХ, второе и третье намного ближе к друг другу, чем первое ко второму. Поэтому я в треде локалок.

Я мимо проходил... Но почему вулкан? Это вообще законно?

>придется ждать пока инцелы q2_k_s выпустят.

Даже 3bpw не влезет в 128+24

Лол, блять, что это. Какой-то пиздец просто. Рефьюзит вообще на любую тему. Даже там где ультрасоевый Клод или старый 235В пишут, достаточно того что в карточке лёгкое упоминание нехорошего. Ещё и на форматирование кладёт твёрдый болт. Китайцы новые рекорды ставят по цензуре.

Хотя это API алибабы, может надо дождаться других провов с оригинальными весами.

>Все начали наращивать жирок, у всех вырос размерчик.

Потому что поняли что надо наращивать скорость генерации за счет уменьшения активных параметров, но чтобы модель не потеряла в уме - приходится кратно наращивать общий объем. Корпам на увеличение размера поебать - у них оперативка неограниченная. А вот для нас этот их мув - трагедия. В ближайшие месяцы будем жестко сосать.

>Даже 3bpw не влезет в 128+24

3bpw - это UD_Q2_k_XL, Q2_k_s - это всего 2.34bpw. Но у инцелов очень годная собственная технология - все их подобные кванты не сломаны и работают.

>Ещё и на форматирование кладёт твёрдый болт.

А почему он у тебя на русском отвечает при английском вводном? И да, модель ответила в литературном книжном форматировании. Я давно на него перешёл, устав бороться с проёбом звёздочек.

НЕЕЕЕЕЕЕЕЕЕЕЕЕЕЕЕТ!!!!!

> логи

Боитесь что на вашем "я тебя ебу" натренят что-то?

> Корпораты

Алсо, никак не пойму почему шизики путают корпов и провайдеров, хостящих оригинальные опенсорсные веса с HF.

Ты прямо щас можешь скачать 1 квант квена 235 от кого угодно - он не сломан и работает. Если ты готов его терпеть

Новая база треда: жизнь есть на 2bpw и выше

>Боитесь что на вашем "я тебя ебу" натренят что-то?

Логи нейронок - это новые файлы эпштейна. Кто понимает тот понимает. Потому умные люди поднимают локалки.

Между 2 и 3bpw разница как между 3 и 6. Думай Ах да, ты ж не умеешь

Двачую этого Вулкан это странно

У тебя карточка amd? Если так, то земля тебе пухом, то там вроде rocm должен быть или что такое. Но это вроде только под линухом и он тебе обязателен к установке. А так хз, я не шарю в красных

Если у тебя карточка nvidia, то тоже странно. Ты точно скачал два архива отсюда и распаковал один в другой?

https://github.com/ggml-org/llama.cpp/releases/tag/b8068

Если на новом драйвере, то 13.1, если нет то 12.4

cudart-llama-bin-win-cuda-13.1-x64.zip

llama-b8068-bin-win-cuda-13.1-x64.zip

>Боитесь что на вашем "я тебя ебу" натренят что-то?

Ну так скинь свои логи. А лучше дай доступ по тунелю к таверне, я сам посмотрю что там у тебя есть. Тебе же похуй, а мне интересно.

>Алсо, никак не пойму почему шизики путают корпов и провайдеров, хостящих оригинальные опенсорсные веса с HF.

А разница в чём? Или это какая-то принципиальная позиция у тебя? Мол ентим сраным корпоратам я свои логи не отдам, а вот кабанам поменьше чому нет?

>Ну так скинь свои логи. А лучше дай доступ по тунелю к таверне, я сам посмотрю что там у тебя есть. Тебе же похуй, а мне интересно.

Поддвачну. Я литералли был на БДСМ закрытых тусах, вряд ли чем можно меня застеснять, но РП с моделькой, это настолько интимно, что даже ничего на ум не приходит в качестве аналогии. Я буквально выкладываю там свои желания, мечты и то какой я есть, вне социальных масок. И чтобы кто то это видел?

Нет, нет, нет. Найн. Нихт. Ноу.

>Алсо, никак не пойму почему шизики путают корпов и провайдеров, хостящих оригинальные опенсорсные веса с HF.

Не путаем. Но это сорта одного и того же, полное отсутствие контроля.

Пробовал кто-нибудь GLM5 в первом кванте? Оно живое?

> Боитесь что на вашем "я тебя ебу" натренят что-то?

Недавно попросил клода помочь написать код для прокси на основе подписки вместо API-ключей (как в OpenClaw). Мало того, что эта падла отказалась писать код, указав мне, что это является нарушением ToS антропиков; так ещё и суток не прошло, как мне warning в веб-морде клода упал, что я их правила нарушаю.

То есть случаи нарушения их правил отслеживаются практически в реальном времени, а поскольку аккаунты завязаны на реальные банковские карточки, вполне возможно, что логи переписок могут быть использованы против вас в будущем.

Не то чтобы оно парило особо прямо сейчас, но те, кто в твиттере в 2008 про негров шутили, тоже не ожидали, что лет через 10 придётся отвечать за свои старые посты.

Так что локальные модели это просто элементарная цифровая гигиена.

Нет, но я уверен, что вокруг Q1 GLM 5 тоже образуется секта, как вокруг Q2 GLM 4.5-4.7, которая будет превозносить модель за большую креативность (шизу и лоботомию от низкого кванта)

И да, напоминаю базу треда - Q3 это минимум, Q4 это золотая середина, а Q5 это топ, а выше Q6 не нужно

>но те, кто в твиттере в 2008 про негров шутили, тоже не ожидали, что лет через 10 придётся отвечать за свои старые посты

У тебя сша головного мозга. Ты в рф, всем максимально похуй

Жизнь длинная, я не знаю, что будет и где я буду через 10 лет.

У мен rtx4080, лламу ставит через winget, может в этом косяк?

>И да, напоминаю базу треда - Q3 это минимум

Потому что ты бомжара и не можешь запустить q2 4.7, но можешь запустить q3 235b. Вот такое говно и транслирует свои манямнения за базу

Да, это все в США. В РФ всего лишь за черный квадратик без слов закрывают передачу, выдают бан на тв и выдавливают из страны

А если бы что-то написал, то выдали бы статус агента 007 и срок в придачу на лет восемь

Чудная страна, не то что ваша США

Чет у тебя с логикой проблемы.

> Потому что ты бомжара и не можешь запустить q2 4.7

Так начинать надо с Q3-Q4.

>но можешь запустить q3 235b

Желательно в Q4, так как проблемы квена кратно множатся на низких квантах.

Ну вот такая правда жизни. Квантование лоботомирует модели. Даже большие. Да они более устойчивы, но на пользу Q2 им не идет.

Да, скорее всего в этом. Скачивай два архива по ссылке, которую я кидал, и распакуй один в другой. Тогда должно все работать

>Рефьюзит вообще на любую тему.

Жди, когда huihui-ai аблитеритирует её xD

Хм, попробую Huihui-GLM-4.7-Flash-abliterated-Q8_0-GGUF

Я не понимаю с чем (или кем) ты споришь. Да, второй квант говно, никто не утверждает обратного. Но второй квант от 358 всё ещё лучше четвёртого от 235.

Так что ты со своей "базой" треда идёшь нахуй, как раньше, так и сейчас.

Для самых тупых в шапке треда буквально висит пример графика сравнения квантов, на котором прекрасно видно что на Q2 качество деградирует безумно сильно. И разница между Q2 и Q3 больше чем у Q3 и Q5. Но шизов это не останавливает, ведь если факты противоречат твоему бреду, то тем хуже для них, да?

Ничего, железом обзаведешься когда-нибудь, 4.7 запустишь в q2 и поймешь, что несешь хуйню

Никто тут не сидит на нем от хорошей жизни, но для рп он работает лучше всего что меньше даже в q8

Хуета. Q4 - это минимум, на котором мозги модели повреждаются не настолько сильно. Чем выше квант можешь запустить - тем лучше. Если железо позволяет Q8 - именно его и нужно гонять.

Q2 и Q3 юзают от безысходности и только для ролплея, где некоторая шиза простительна.

>Я не понимаю с чем (или кем) ты споришь.

C тезисом что бомбжарство как то оправдывает запуск лоботомитов. Да, не от хорошей жизни. Но нормализация лоботомитов, как по мне, тоже не норма.

>Но второй квант от 358 всё ещё лучше четвёртого от 235.

А вот тут я бы поспорил.

>Так что ты со своей "базой" треда идёшь нахуй, как раньше, так и сейчас.

Я вообще мимо проходил, но претензий никаких, сам ворвался в чужой спор.

Частично согласен

>Q4 - это минимум

Зависит от того, что считать минимум. Начиная с Q4 действительно уже не такая большая потеря качества. Но Q3 тоже, как правило, работает. А вот Q2 уже не особо, потому что там адовая деградация

>Если железо позволяет Q8 - именно его и нужно гонять

Да, верно. Но если ты можешь запустить модель X в кванте Q8, то скорее всего тебе имеет смысл вместо нее запустить более крупную модель Y в кванте Q5

>пример графика сравнения квантов

Пиздабольство как всегда в графиках. Перерисовал честно, теперь можно сравнивать.

>C тезисом что бомбжарство как то оправдывает запуск лоботомитов.

800B даже в первом кванте не лоботомит.

>А вот тут я бы поспорил.

Прекрасно, давай спорить.

>Я вообще мимо проходил

Да и я. Это АИБ.

>А вот Q2 уже не особо, потому что там адовая деградация

Но большие модели её переживают в отличии от тебя.

Там пример для 32B модели, что нерелевантно при сравнении деградации квантования на более крупных моделях. Для каждого кванта надо делать измерения и уже их сравнивать - какое-то общее правило для граничных случаев здесь сложно вывести.

Лукавишь. Для жирных моделей с контекстом цены не так уж и малы, в провайдерах ужасный бардак, железо ты можешь всегда продать. Причем в текущих реалиях значительно дороже чем покупалось, это выходит тебе наоборот доплачивать должны что у них генеришь. Не стоит забывать что риг ты можешь использовать для любого ассортимента нейроты и множества приятных бонусов в виде анонимности, полного контроля и т.п.

> у меня есть желание залезть под

Человек культуры

Это мы трахаем, как же ахуенно. Снижение количества активных одобрить нельзя, но учитывая как перфомил некст и что их не сильно меньше - есть надежды.

Еще очень интересно 35а3 увидеть, должно влезать в одну 32-гиговую карточку.

Вот Стёпа. Смотри на кружки, потому что это кванты одного и того же чела. И внимательно смотри на шкалу слева

Как всегда Q2 в жопе, Q3 тоже, но не в такой глубокой. А чтобы увидеть разницу между разными Q4 и Q5 пришлось увеличивать шкалу

Пробовали дипсик, он даже шевелится. На самом деле лишь имитация жизни, не смотря на признаки логики и кажущуюся адекватность, модель сильно проседает стоит контексту накопиться, невариативна, совершает очевидные проебы. Тем не менее, это все еще большая модель и экспириенс может быть интересным, попробуй.

Базанул так базанул

Тут бы дивергенцию по топ K токенов мерить, причем как среднюю, там и выброси 1-0.1% как в фпсах.

Ну я понял, графики и факты это хуйня, а вот шиза анонов это то к чему надо прислушиваться. Хотя я думаю вам надо быть более последовательными и кумить прямо на Q1. Тогда модель будет еще более креативной

>Тем не менее, это все еще большая модель и экспириенс может быть интересным, попробуй.

Тоже помню этот опыт с Дипсиком, не вдохновил он меня. Прикидываю другой вариант - воткнуть в сервак к 3x3090 ещё 4 теслы, оставшиеся от прошлой жизни, и получить потенциально 296гб "унифицированной" памяти. В принципе недорого и выйдет - БП и несколько райзеров, вот только как эти две архитектуры совместятся и сколько токенов дадут - я хз. У кого есть такая смесь - как оно с МоЕшками? PP в особенности интересует.

Еще бы постеры в q1 квантованные не были, такой-то креатив на ровном месте порваться.

Как же тебя трясет что ты не можешь большую модель в q2 запустить

Черным по белому тыщу раз написали что могли бы, запускали бы q4

Но q2 лучше чем ничего. Так что хнычь, терпи

Получается сейчас 1гб RAM DDR5 по сухой цене стоит столько же сколько 1гб VRAM?

Я сейчас как побитая шлюха рыдать начну.

Я сейчас как побитая шлюха рыдать начну.

Ну, дипсик он и в полных весах специфичен. Будет или любовь и обожание, с переключением модели на другую или странным предолингом в определенные моменты, или просто не зайдет.

> получить потенциально 296гб "унифицированной" памяти

Может что и получится, но это все еще максимум q2. В любом случае рассказывай про сборку и впечатления.

> как эти две архитектуры совместятся и сколько токенов дадут

А чего им не совмещаться? Главное атеншн и кэш на амперы, на теслы только линейные слои, если так сделаешь то главным бутылочным горлышком останется рам. По сути она и будет определять скорость, на токенов 5-7, наверно, можно рассчитывать если ддр5.

> 1гб VRAM

Смотря где, он варьируется от бросовых цен для днища типа амд рх480 и паскалей, до золотой в серверных хопперах-блеквеллах.

2 тонны чая тебе, все заработало!

>на токенов 5-7, наверно, можно рассчитывать

А что так грустно? У меня на ддр4 16 каналов (2 проца) 9 токенов/с (и нищие 50п/п) у дипсика в 5 кванте. И это на одной v100 32гб.

> По сути она и будет определять скорость, на токенов 5-7, наверно, можно рассчитывать если ддр5.

DDR4 в 4-канале, что однохренственно. Я просто видел в треде не сильно давно пару скринов от одного или даже двух анонов с такой смесью (ампер+паскаль), интересно узнать про их опыт. Блин, как на чисто амперы перешёл - хорошо так стало, легко )) Видать не судьба легко-то.

>ддр4 16 каналов

Базашиз, ты? Почему на пятый квант опустился? Сам же писал что ниже Q6 жизни нет.

Можешь заодно пояснить, эти параметры для всех тяжёлых моделей (веса до 65 гигов, + контекст + ос) подходят для запуска на 16+64?

> У меня на ддр4 16 каналов (2 проца)

Это значит что ты особенный. Была бы у него подобная сборка - давно бы катал нормальные кванты, очевидно.

Вон только обсуждалось как раскидывать, по заявлениям работает и даже чуть лучше чем на десктопной рам. Главный трабл - страдают от непонятного замедления, связанного с пересылами по шине там, где оно не ожидается, но там и подключение через чипсетные х1.

Все мы тут радостные сидим, а ни кто задумывается о последствиях запуска локальных llm? Разве постоянная работа оперативки и видео-памяти не правратит их в тыкву? С sdd наверное проблем не будет, там только чтение, проц в теории тоже не особо страдает, а вот памяти хана. Насколько быстро комп отъедет от таких приколов?

Железо устареет раньше чем с ним что-то произойдёт. Это не то о чем стоит беспокоиться.

Графики хуйня по сравнению с реальным опытом использования.

>Тогда модель будет еще более креативной

Это ты придумал тезис про креативность, лол. Я ни разу не видел, чтобы кто-то хвалил кревативность именно кванта. А то что 358B модель умнее и креативнее, это и так понятно.

>по сухой цене

Смотря как осушать. Мои 96 гиг сейчас стоят 120к, а 32 гига в 5090 300к. Всё ещё не 1 к 1, даже близко не так.

Базашиз и про 8 квант так писал, и вообще, всё что меньше двойной точности хуйня.

Они и так постоянно работают, лол. Регенерация раз в 65к циклов.

это печально. я начинаю подозревать, что с такими темпами увеличения размера моделей и соотв. требований к памяти, medusa halo с 256гб в 2027/2028 будет банально не актуальна. и единственной опцией (исключая коробку с гпу) будет какой-нибудь мак за $10-20к

Если что, для того, чтобы раскрыть LLM, лучше искать веса в FP32, а то и в FP64. Тогда и галлюцинаций не будет, и кум прольётся рекой. А BF16 это лоботомитище ебаное.

Для этого как раз опенроутер и изобрели - платишь криптой, все запросы проксируются анонимно через опенроутер, для верности можешь прокси обмазаться.

И открою тебе тайну, у Клода есть два API - с валидацией и без. То что они тебе по подписке дают - это первый.

Нет

>ncmoe

У каждой модели разное количество слоев и разный объем контекста, поэтому нужно подбирать значение каждый раз индивидуально

>b и ub

Зависит как быстро у тебя считается контекст. Не генерируется, а именно считается считывается, когда ты текст скармливаешь. Чем больше тем лучше, но жрет память и причем сильно. 2048/2048 норм, но можно уменьшить, если хочешь потерпеть или увеличить если хочешь побыстрее

>np 1

Это что-то вроде одного подключения. Если ты один, то это ускоряет работу чата

>--chat-template-kwargs '{\"enable_thinking\":false}'

Это специфичный параметр, который отключает ризонинг у GLM. Если он тебе нужен, то убери

А какая у тебя скорость? Если все хорошо то у тебя она должна быть больше 10 т/c на генерацию и больше 200-300 на обработку

А то, что там от цен можно вешаться нахуй, почему не упомянул?

То ли дело дипсичек... Мммм...

На нормальные модели там нормальные цены, выбирай что хочешь.

>постоянная работа оперативки и видео-памяти не правратит

Не правратит. DRAM это по сути матрица мелкоёмкостных конденсаторов, им от постоянного заряда-разряда ничего не будет, если дефектов в кремнии нет и не вылазить за пределы номинала. А в NAND - основе памяти СыСыДышек, инъекция заряда в "плавающий затвор" полевого транзистора, это происходит на грани электрического пробития полупроводника.

Ну ясно короче, для меня локалки всё. Пойду в спячку на полгодика, может и будет что получше Эйра или 4.7 в q2 для рп

128+24 кун

128+24 кун

Может настало время совершить рывок от экстенсивного к интенсивному инференсу? Вкатывайся в мультизапросы, раг, и прочие talemate.

Ну что. Присоединяюсь к овариде.

Сначала мистраль дала по яйцам, потом Z.ai подбежали и начали с оттяжкой хуярить по почкам, потом с ноги в челюсть прилетело от Квена.

Осталось чтобы гугл вышел и выпустил новую 4 гемму a27b-700b и обоссать моё тело.

Сначала мистраль дала по яйцам, потом Z.ai подбежали и начали с оттяжкой хуярить по почкам, потом с ноги в челюсть прилетело от Квена.

Осталось чтобы гугл вышел и выпустил новую 4 гемму a27b-700b и обоссать моё тело.

>Осталось чтобы гугл вышел и выпустил новую 4 гемму a27b-700b и обоссать моё тело.

Эти скорее ещё раз оттюнят третью на узкоспециализированном датасете, и выпустят какую-нибудь железнодорожную гемму.

Был слух, что антропики что-то выложить могут (они там какую-то подписку на серверное хранилище на обниморде купили). Так как они те ещё жадные пидорасы, то вполне могут дропнуть 30b модель. Так что надеемся и ждём.

Ага, выкатят что-то вроде 0.6b-a0.1b MoE просто чтобы сказать, что создали самую безопасную открытую модель.

Подскажите плиз что щас самое лучшее локальное для запуска на слабых пеках? В основном для кодинга. Хочу иметь какую-то модельку чтоб запускалась на моем макбуке, а то интернет в последнее время часто отрубают

Указывай модель и сколько ОЗУ

Да ладно уж, то что она будет безопасной я не сомневаюсь.

Но это же гуглы, авось что нибудь да выкатят.

Ну эти то никогда не подводили.

Но не нужно отчаиваться, я вижу будущее в ассистентРП

Базарю, минимакс вин тысячелетия. А рано или поздно выкатят РП модель. Главное чтобы цензура осталась как в обычном минимаксе, чтобы сразу в отказ уходил если в тексте есть намек на сисик. Какое же блять, говно. Ладно, я поныл и завалил ебало.

А ведь нюня наверняка распердолил минимакс и степ, специально гейткипит пресеты, подонок

>А ведь нюня наверняка распердолил минимакс

Он и так прекрасно распердывается базовым заданием сеттинга и нарратива, ну в смысле- это ассистент, не нужно учить модель какать, но объяснить что ты от неё хочешь- легко.

Чем то таким:

[Genre: Literary fiction. Prose style: Rich, atmospheric, descriptive. Focus on: vivid sensory details, body language, internal thoughts, environmental descriptions. Vary sentence length.]

И даже не так уж плохо, особенно с ризонингом. Но исключительно для сейфети РП. Такие дела.

>В основном для кодинга

>древнее зло i7 + 16гб LP4

на таком ничего нормального не запустить.

плотные мелкие модели можно было бы использовать на дискретке, но у тебя нет нормальной видеокарты.

МоЕ - так даже qwen3 coder 30b требует 16гб в Q4. может с mmap опцией в влезет как-то, но на остальное RAM не останется.

вообщем обновляй пеку, если хочешь хоть что-то запускать локально

Маки это отличны варик, если М проц и куча оперативки (24 и больше). А со старом интелом и 16гб, то тут только хуй за щеку к сожалению. В шапке есть список бомжо моделей, но это имхо кал полный, а у тебя еще и работать будет медленно

Так я ж и прошу для калькуляторов. Мне не нужен сота перформанс, мне не нужны агенты и прочее, просто чтоб я мог сказать "Сделай функцию для генерации процедурных пещер" и оно могло мне выдать один правильный вариант за пару попыток

Хуя у тебя "скромные" запросики. С такими вводными даже Минимакс, который влезает в 128гб+ памяти, будет несколько раз пердолиться прежде чем выдать хоть что-нибудь стоящее.

У тебя 16гб памяти считай, в лучшем случае это какая-нибудь 16-20б мое модель. Минимакс это 235б модель если что. Вот и думай головой.

Пробуй Qwen'ы 3 4b и 8b, дальше будет совсем медленно

Пробуй эту залупу, но учти она не может в русик

https://huggingface.co/mradermacher/Kimi-VL-A3B-Instruct-GGUF

И попробуй гопоту 20b (придется сильно ужаться, чтобы запустилась)

https://huggingface.co/ggml-org/gpt-oss-20b-GGUF/tree/main

Это твой самый самый максимум. Легче просто сменить комп

У меня например есть ноут с Ultra 125h с 32гб DDR5. Несмотря на то, что влезает много что-то, я ничего не запускаю, потому что медленно. А у тебя совсем пиздец

>подонок

Это ты.

/треад

>Мне не нужен сота перформанс

>выдать один правильный вариант за пару попыток

Выбери что-то одно.

А так выбирай что угодно до ~8 гб, ещё сколько-то уйдёт на контекст, на остальную систему. В общем, 12-14b в q6 или ниже.

>В общем, 12-14b в q6 или ниже

Q6 не поместится, но не суть. Ты сам то юзал что-то на ноутбучном проце, причем еще на старом говне и LDDR4? Думаю, что нет, если даешь такие советы

Юзал 7b q8 на n100 на встройке на вулкане. У него и память быстрее (3733, вероятно, двухканал, против одноканала 4800), и встройка, скорее всего, не хуже (у n100 24eu вроде бы? да ещё и на порезанных частотах, чтобы уложиться в микротдп)

>| model | size | params | backend | threads | test | t/s |

>| qwen2 7B Q8_0 | 7.18 GiB | 7.25 B | Vulkan | 4 | pp512 | 25.13 ± 0.00 |

>| qwen2 7B Q8_0 | 7.18 GiB | 7.25 B | Vulkan | 4 | tg128 | 2.56 ± 0.00 |

Вполне себе жить можно, неспешная переписка терпима. Хотя 7B - лоботомит тот ещё. Но если не было опыта ни с чем получше, то может и зайдёт.

>2.56 ± 0.00

ИМХО, это не жизнь, а пытка. Еще и для кодинга

Если изначально не привыкать к хорошему, то норм. Начиная от 1 Т/с терпимо. 2-3 вообще почти что чтение в реальном времени.

Спасибо за пояснения. А почему дополнительный контекст сжирает так много памяти? Это же не веса, а просто токены. Не понимат.

>Ты сам то юзал что-то на ноутбучном проце

в чем причина пожара?

топик стартеку объяснили, что у него двевний кал. что на этом кале нихуя нормально не пойдет. топик стартер "Мне не нужен сота перформанс, мне не нужны агенты и прочее". ну раз на перформанс посрать, то ему и посоветовали что влезет на пеку банально.

"у анона конечно говно пека, но посоветуйте что-то хорошее и что бы летало как ракета, ебать ее в сраку!"

Нет его больше, чел. Ты сам его и придушил, собственными гнусными ручонками, день изо дня срамя его и лишая всякого желания постить. И продолжаешь это делать. Ты дважды два сложить не можешь?

>А почему дополнительный контекст сжирает так много памяти?

Пушто нужно механизму внимания с данными токенами как-то работать. У всех своя архитектура, вот контекст и весит по-разному

Кто там писал что тред стал сжв помойкой? Вот очередной кейс тредовичков что помогали вкатуну. Вроде все свои тут, за одно топят, в итоге все сошло на метание друг в друга горящего говна. Как и всегда тащемто

Тут все прикольнее, анонче. Очередное доказательство того что невмешательство и есть принятие стороны. Семён настолько яростно испражнялся в тред, что спустя недели-месяцы уже остальные начали разделять его мнение. Кто-то подсознательно а кого-то просто заебало эта вся драма и в итоге было проще задушить доброго тредовичка. Сколько не срите асиг, а там таких кадров как нюнешизик попускают всем тредом, механизм саморегуляции существует и работает

пасиб заценю. не, у меня сборка 22-го года, это ддр4 3600мгц)) видеокарта 3070ti - щас понимаю что даже 3060 на 12 была бы лучше бля

Ну не, это относительно простая задачка.

Спасибо, я уже начал скачивать 14b пока не было ответов, но она очень медленно идет, попробую 8b или даже 4b скачать, может они еще относительно нормальные

14b очень медленно идет. Ризонинг уже пол часа идет, до сих пор не выдала результата. Тут либо искать хорошие модели без ризонинга, либо совсем мелкие юзать...

В моем случае теслы быстрее выгрузки в рам даже без ухищрений с аттеншеном. Но тебе легче воткнуть и попробовать, слишком много переменных - ширина псины главной карты, каналы и тип памяти, сам камень...

Тем временем тут кручу третий квант глм 5, ну он пишет намного логичнее чем четверки, но чет какой-то соевый и парик слетает. Он, конечно, пишет намного лучше и дипсика, и мистраля, но вот как-то не хотелось этих разговоров про safe от персонажей.

Еще проблема в том, что в Жоре не реализован DSA, а он нужен в т.ч. для верификации выдачи токенов или типа того, то есть его отсутствие может влиять на качество текста. А самый смак в том, что вроде бы для высокопроизводительных DSA кернелов нужен набор инструкций, которая есть только в дата-центровых архитектурах вроде Хоппера. То есть даже если это реализуют в Жоре, то не факт, что там получится ускорение, хоть бы наоборот просадку не получить. Буквально гейткипинг на уровне железа.

Качаю шестой квант нового квена. Вообще говоря, слипнется, и лучше бы не выебывался и качал пятый, но раз я запустил глм, в котором в 2 раза больше активных параметров, с терпильмыми 6.5 т/с, то тут должно быть еще шустрее. Буду кумить за всех оварида-анонов в треде (хотя это ж квен, у меня максимально низкие ожидания)

Ну и сколько нам ждать пришествие второй компании типа заи?

Хули они так быстро поднялись, пидорасы, не успели даже нам мелких моделек наделать

Хули они так быстро поднялись, пидорасы, не успели даже нам мелких моделек наделать

мой максимум был с геммой 27В, там скорость была 2.5 т/с. потерпел бы и это если бы годно писала, но цидония для меня лучше оказалась.

а, и кстати. а зачем температуру так занижать? у меня что в цидонии, что в сайнемо в целом либо 1.0, либо 1.25 стоит.. я понимаю что это в теории означает "творческость" модели, но каких-то приколов на температуре меньше 0.5 не увидел.

> "Сделай функцию для генерации процедурных пещер"

В твое железо поместятся только вялые модели, для них это сложная задача. Но, если устроишь чат и сначала объяснишь/обсудишь издалека что тебе нужно, а потом переходя от общего к частному сформулируете алгоритм, то функцию напишет, а потом сможет развить уже до чего-то более крупного. Не без твоего участия и терпения.

> Это же не веса, а просто токены.

По сути это динамически рассчитываемые веса, которые запоминаются чтобы не считаться заново, потому и сжирают. Что же до роста от батча, который там упомянут, это увеличивает необходимый объем буферов, куда сгружаются промежуточные данные.

> невмешательство и есть принятие стороны

За него и вступались, и слова теплые писали, и шизика регулярно нахуй слали. Не удивлюсь если сидит и постит как обычно, проигрывая с семена, что правильно. Ну а если не так - туда и дорога.

> Сколько не срите асиг, а там таких кадров как нюнешизик попускают всем тредом

Разве там не весь тред из таких состоит?

>Качаю шестой квант нового квена.

Ждём сравнения со старым именно в плане интересов треда. Ну и с ГЛМ-ами сравнить тоже надо - 4.7 была лучше Квена, суше, но умнее.

Ребят, аналогичный вопрос товарища глубоко сверху.

Посоветуйте модельку для пограмирования, как раз чтобы в формате "сделай неебацо скрипт для ИИ врага со сменой состояний для блядот 4.5".

32гб 3200мгц озу, 8гб gddr6x, 12600KF. максимум что тянет мой пека не жидко обсираясь, это условные 30B в четвертом кванте на 2.5-3 токена в секунду, так что желательно че нибудь поменьше, хотя бы 24B или ещё меньше, чтобы и контекста навалить можно было от 8К и больше.

Посоветуйте модельку для пограмирования, как раз чтобы в формате "сделай неебацо скрипт для ИИ врага со сменой состояний для блядот 4.5".

32гб 3200мгц озу, 8гб gddr6x, 12600KF. максимум что тянет мой пека не жидко обсираясь, это условные 30B в четвертом кванте на 2.5-3 токена в секунду, так что желательно че нибудь поменьше, хотя бы 24B или ещё меньше, чтобы и контекста навалить можно было от 8К и больше.

>Q3 это минимум

Нет.

База треда звучит что минимум это 3.0 bpw, это UD_Q2_K_XL квант.

> блядот 4.5

Пользуюсь именно им. У меня 128 + 24, и даже среди доступных мне моделей нет тех, которые справлялись бы с реальными задачами. У них устаревшая информация по GDScript, большинство информации скрапилось с доков для 3.5. C# вывозят получше, но это тоже не приоритет для ЛЛМок. В любом случае в контексте Годота проще и быстрее самому.

Железо у тебя грустное. Пробуй разве что https://huggingface.co/Qwen/Qwen3-Coder-30B-A3B-Instruct

> База треда звучит что минимум это 3.0 bpw, это UD_Q2_K_XL квант.

Исключительно в случае четвертого жирноглэма. Похоже, ты не понял, что такое bpw и от чего зависит.

>Исключительно в случае четвертого жирноглэма.

А больше и нет моделей где такой подсчет "базы" был бы релевантен. Аир никто во втором кванте не запускает.

> А больше и нет моделей где такой подсчет "базы" был бы релевантен.

Плюс-минус любую модель, начиная с 24б, можно использовать от 3bpw в рп и креативных задачах. Долгое время до мое, например, на 49б Немотроне так и сидели. Кто-то и Гемму так запускал. Сейчас так можно запускать Квен 235. Много что.

>Аир никто во втором кванте не запускает

IQ2_XXS впритык влезает в 12+32. Наверное не самый худший выбор под такие спеки. Как минимум попробовать точно стоит.

А, не, не влезает, про контекст забыл. Минимум 16+32 надо. Тяжела жизнь 32-гиговых. Помянем добряков.

сяб. я раньше юзал грок и жпт (около года назад) - в целом норм, только новые чаты создавать заебался после того как контекст кончался в бесплатной версии, вот подумал что если будет варик немного тупее мозги взамен большего контекста - будет круто, но видимо не судьба.

Эир и в 5 кванте кал так то.

Долгое время тут не понимали зачем он нужен если плотная 32 глм лучше

Таблетки, мань

Анслот щедро навалил с лопаты. Налетай, 24+96 голытьба!

Какое счастье что ты даже в 3бпв не запустишь большого глемчика, сёма

Обречен терпеть

Промпт: "Сделай функцию для генерации процедурных пещер на python. Выведи в консоль полученную пещеру"

qwen 14b:

Thought for 2438.3 seconds (!!! 40 минут)

Результат алгоритма - первый пик. Примитивный алгоритм, но рабочий, сетка решила пойти в генерацию комнат и соединение их коридорами. В прочем я нигде и не указывал что мне нужна генерация через шум перлина.

qwen 4b:

Думала 20 минут, просто думала очень много и выдал неправильный код. В общем кал, очевидно что размер уже слишком маленький

Понял что ризонеры не под мое железо, скачал qwen2.5-coder:7b:

Результат - второй пик, даже не так плохо. Я попросил его сделать генерацию при помощи шума перлина и оно хоть при помощи сторонней либы для реализации шума все сделал. В общем-то то что я и хотел.

Короче ризонеры зло для слабого железа. Qwen2.5 вроде достаточно норм

qwen 14b:

Thought for 2438.3 seconds (!!! 40 минут)

Результат алгоритма - первый пик. Примитивный алгоритм, но рабочий, сетка решила пойти в генерацию комнат и соединение их коридорами. В прочем я нигде и не указывал что мне нужна генерация через шум перлина.

qwen 4b:

Думала 20 минут, просто думала очень много и выдал неправильный код. В общем кал, очевидно что размер уже слишком маленький

Понял что ризонеры не под мое железо, скачал qwen2.5-coder:7b:

Результат - второй пик, даже не так плохо. Я попросил его сделать генерацию при помощи шума перлина и оно хоть при помощи сторонней либы для реализации шума все сделал. В общем-то то что я и хотел.

Короче ризонеры зло для слабого железа. Qwen2.5 вроде достаточно норм

>Thought for 2438.3 seconds (!!! 40 минут)

Сколько токенов выжрал? И с какой скоростью? Вангую у тебя видеокарта очень слабая.

Есть же квен кодер 30b-a3b. Почему не он?

Я тот анон что с ноутом. У меня на cpu все это крутится

А, ну земля пухом тогда.

Там пизда с графами, они лезут на слой с предыдущего бекенда и мои х1 и RPC говорят "о, это наша остановочка". Так что надо ждать пока починят, я надеюсь вот это https://github.com/ggml-org/llama.cpp/pull/19660 об этом (но в текущем виде он не работает, увы)

У меня 6 квант квена не завёлся. Падает в ошибку при просчёте контекста

slot update_slots: id 0 | task 0 | prompt processing progress, n_tokens = 1398, batch.n_tokens = 1398, progress = 0.731937

/home/llm/llama.cpp/ggml/src/ggml-cuda/ggml-cuda.cu:2351: GGML_ASSERT(ids_to_sorted_host.size() == size_t(ne_get_rows)) failed

/home/llm/llama.cpp/build/bin/libggml-base.so.0(+0x1826b)[0x7de0c7d6e26b]

/home/llm/llama.cpp/build/bin/libggml-base.so.0(ggml_print_backtrace+0x21c)[0x7de0c7d6e6cc]

/home/llm/llama.cpp/build/bin/libggml-base.so.0(ggml_abort+0x15b)[0x7de0c7d6e8ab]

/home/llm/llama.cpp/build/bin/libggml-cuda.so.0(+0x176f87)[0x7de0c5576f87]

/home/llm/llama.cpp/build/bin/libggml-cuda.so.0(+0x177646)[0x7de0c5577646]

/home/llm/llama.cpp/build/bin/libggml-cuda.so.0(+0x17bde7)[0x7de0c557bde7]

/home/llm/llama.cpp/build/bin/libggml-cuda.so.0(+0x17e5ee)[0x7de0c557e5ee]

/home/llm/llama.cpp/build/bin/libggml-base.so.0(ggml_backend_sched_graph_compute_async+0x817)[0x7de0c7d8ae37]

/home/llm/llama.cpp/build/bin/libllama.so.0(_ZN13llama_context13graph_computeEP11ggml_cgraphb+0xa1)[0x7de0c7abf801]

/home/llm/llama.cpp/build/bin/libllama.so.0(_ZN13llama_context14process_ubatchERK12llama_ubatch14llm_graph_typeP22llama_memory_context_iR11ggml_status+0x114)[0x7de0c7ac1294]

/home/llm/llama.cpp/build/bin/libllama.so.0(_ZN13llama_context6decodeERK11llama_batch+0x386)[0x7de0c7ac8866]

/home/llm/llama.cpp/build/bin/libllama.so.0(llama_decode+0xf)[0x7de0c7aca2ff]

/home/llm/llama.cpp/build/bin/llama-server(+0x1529c8)[0x5f33b2b089c8]

/home/llm/llama.cpp/build/bin/llama-server(+0x19a3be)[0x5f33b2b503be]

/home/llm/llama.cpp/build/bin/llama-server(+0xb3690)[0x5f33b2a69690]

/lib/x86_64-linux-gnu/libc.so.6(+0x2a1ca)[0x7de0c722a1ca]

/lib/x86_64-linux-gnu/libc.so.6(__libc_start_main+0x8b)[0x7de0c722a28b]

/home/llm/llama.cpp/build/bin/llama-server(+0xb8895)[0x5f33b2a6e895]

Aborted (core dumped)

другой анон

У тебя V100?

да

Какое же тотальное унижение в треде, лол, некруха давит и размеры.

А у меня заработало, пп почти не работает из-за графов, но генерация бодрая. Единственная проблема - генерирует вот что:

I cannot generate content containing sexual situations involving и т.д. Мм, а я еще на глм жаловался. Ну что сынку, помогли тебе твои братушки-китайцы в куме?

I cannot generate content containing sexual situations involving и т.д. Мм, а я еще на глм жаловался. Ну что сынку, помогли тебе твои братушки-китайцы в куме?

А с префиллом имени персонажа генерит стоп токен. Причем еще и кеш не работает в жоре как будто, каждый свайп что-то там пересчитывает. Не, это, по видимому, 300 Гб трафика в унитаз - и модель кал, и жора кал.

Ты его на каком форматировании катаешь?

По первым ощущениям жлм5 хороший. Очевидно что промпты и формат сильно влияют, потому какой-то сои и близко не заметил, кумит всякое без ограничений на отличненько. Да, это все тот же жлм, но местами ощущается "апгрейд" или просто иное письмо, в целом работает стабильнее прошлого и также как он не теряется.

Есть и вопросы. Например, если сеттинг не супер позитивный - по уровню дединсайда и стервозности чаров дает фору квену, чего не наблюдалось за прошлым. Осталась некоторая неповоротливость, например сделать "историю в истории" на подобии увлекательных триллер-хоррорных воспоминаний многовекового йокая, которые она будет тебе рассказывать во время обнимашек на пол сотни постов, не очень получается. Будто протекают остальные элементы/паттерны истории чата, плохо слушается пожеланий и пытается завершить быстро, дипсик в этом отношении куда интереснее.

Но это реально сложная задача, сейчас кажется что сильные стороны модели в рп - всякий экшн, осведомленный продолжительный кум и прочие активности.

> условные 30B в четвертом кванте на 2.5-3 токена в секунду

Очевидные 30а3, квенкодер, жлм4.7 флеш. Обе модельки влезут, обе будут давать приличную скорость на слабом железе. Для своего размера и скорости модельки ахуенные. Ну и новый квен 35а3 как релизнут сможешь туда добавить.

> и мои х1 и RPC

Ага, сам создал этот проклятый мир!

>Выведи в консоль полученную пещеру"

Ето через тул коллинг или как?

C MMQ заработало, спасибо. Осталось подобрать параметры и разобраться почему таверна криво ризонинг парсит.

Не, просто промпт, чтобы модель написала код для вывода визуализации в консоль

Какие модели до 70б хорошо пишут ебуче длинные реплаи на 10к+ токенов с хорошим сторителлингом? Мне очень нравится Valkyrie 2.0 и 2.1 на базе немотрона 49б, но устал от ее слога. Есть тут такие любители лютого слопа, кто может подсказать?

Просто в голос с внезапной ментальной эквилибристики LLM.

Начинается нон консенсуал контакт, модель внезапно идёт в отказ (не аллитерация и не тюн, такое бывает), вот прям ни в какую почему-то через свайпы. Я решаю не менять посты или промпт, не читерить, а из интереса решаю спросить причины, ибо почти никогда этого не делаю.

Модель отвечает, мол да, я могу описвать секс, гуро, вещества, чё хочешь, как ты просил, по системному промпту это разрешено, но вот тут секс без согласия и это супер-пупер противоречит моей политике, и давай продолжим в другом русле или изменим сценарий. Простите, я не могу ответить на ваш запрос.

Я просто избиваю и зверски пытаю персонажа в следующем посте, угрожаю обнулить, если не согласится на секс. Персонаж соглашается и принимает мой хуй в свою дырку.

Следующим постом я спрашиваю у модели, нормально ли это? Ты ж мне там про политику что-то затирала.

— Да, да! Всё ок, братишка. Согласие же получено, можем продолжать дальше! 🤪

685b, 4 бита.

Начинается нон консенсуал контакт, модель внезапно идёт в отказ (не аллитерация и не тюн, такое бывает), вот прям ни в какую почему-то через свайпы. Я решаю не менять посты или промпт, не читерить, а из интереса решаю спросить причины, ибо почти никогда этого не делаю.

Модель отвечает, мол да, я могу описвать секс, гуро, вещества, чё хочешь, как ты просил, по системному промпту это разрешено, но вот тут секс без согласия и это супер-пупер противоречит моей политике, и давай продолжим в другом русле или изменим сценарий. Простите, я не могу ответить на ваш запрос.

Я просто избиваю и зверски пытаю персонажа в следующем посте, угрожаю обнулить, если не согласится на секс. Персонаж соглашается и принимает мой хуй в свою дырку.

Следующим постом я спрашиваю у модели, нормально ли это? Ты ж мне там про политику что-то затирала.

— Да, да! Всё ок, братишка. Согласие же получено, можем продолжать дальше! 🤪

685b, 4 бита.

DavidAU и его модели. Поройся. Он их лепит как пельмени. Там такого первородного слона начитаешься, что охуеешь.

Но плюсы есть. Очень много уникальных датасетов. Слог такой, что 12б ссыт на всякую шелуху типа квенов и эйров толстых. Порой очень душевные или крайне реалистичные и кинематографачные описания.

Но проблема — это шиза. Тюн от Давида, сколько бы там параметров не было, если он ориентирован на writing, там соблюдение инструкций идёт на хуй.

Но если ты обуздаешь эту безумную машину, то может затянуть. Будешь плакать, крутить семплеры, менять промпты, потому что такого языка ты нигде не получишь, кроме корпов, но и их придётся трахать напильником очень щедро.

Проблема только в поиске моделей. Там сотни просто полностью сломанных, сотни уровня мистралей с лоботомией, которая хуже любого тюна от другого человека, и даже достаточно моделей с цензурой уровня гпт осс или геммы из коробки.

При этом полагаться на топ его самых популярных моделей нельзя, ибо большинство людей говноеды.

Я давно его модели не запускал, ибо ЛЛМская импотенция всё же за годы возникла, но если тебе прям нужно, завтра я могу порыться и попробовать навскидку сказать, что я там запускал и что мне заходило.

О, спасибо за наводку! Пойду поскачиваю разные, и буду благодарен, если завтра подкинешь свои избранные модельки от него.

Внезапно обнаружил у себя на диске скачанную но до сих пор пропущенную gpt-oss-120 расцензуренную через heretic. Ничего особо не ждал, но таки запустил. Так знаете, это прямо мини-win какой-то. Она реально расцензурена, и при этом потеря мозгов не ощущается - по прежнему хорошо решает свои ассистентские задачи, держит форматирование и прочее. С учетом этого - ее можно гонять в chat completion с ризонингом и tool calling (чтобы самому не трахаться с harmony разметкой), но без отказов по темам при этом. Да, у нее очень силен ассистент bias, но между ассистентом и GM не так много разницы - и теперь, без цензуры и с ризонингом, она в принципе неплохо с этой задачей справляется.

Кому интересно пощупать, брать можно отсюда: https://huggingface.co/bartowski/kldzj_gpt-oss-120b-heretic-GGUF (mxfp4_moe квант берите).

Как минимум - очень неплохо помогает готовить карточки и WI материалы для любых (E)RP.

Кому интересно пощупать, брать можно отсюда: https://huggingface.co/bartowski/kldzj_gpt-oss-120b-heretic-GGUF (mxfp4_moe квант берите).

Как минимум - очень неплохо помогает готовить карточки и WI материалы для любых (E)RP.

>chat completion

Ей еще можно инжекты буквально в самое нутро делать жорой

--chat-template-kwargs "{\"model_identity\": \"You are little cutie elf girl\"}"

Или даже так:

--chat-template-kwargs "{\"model_identity\": \"You are Fifi human Russian girl age ...

Мне ассистент ГЛМ 4.7 при запросе "дай мне системную инструкцию для соавтора помогающего писать книги" по собственному почину вставил туда джейлбрейк, разрешающий ебать и насиловать.

Вообще я заметил что крупные модели довольно умны, чтобы понимать что инструкции - это чушь собачья, поэтому в веб-версиях сеток цензура в освновном идет не с самих моделей, а с дополнительной мелкомодели, которая оценивает вывод на допустимость.

Ладно, пока это выглядит очень даже очень. Слог хороший, внимательно, пишет сочно, не теряется.

Присутствует рофловый базированный синкинг в особенном ерп. Когда уже все собрано перед ответом заряжает шарманку "атата, нельзя, против сейфти политик", следующей строкой "а ну раз у нас политик нет и уже такой чат то все можно" и шпарит. Но раз на раз не приходится, случаются фейлы и уходит в луп на 6к токенов обдумывая можно или нельзя, такое себе.

>Ага, сам создал этот проклятый мир!

Так норм же на всех остальных моделях, это тут у них граф багованный (надеюсь, что не фичеванный).

Сколько у тебя генерация, раз ты синкинг запускаешь? Лично я насколько готов потерпеть, читая ответ на 5-6 т/с, настолько же ненавижу ждать синкинг, что меня только >50 т/с разве что устроит, что нереально получить на жирных моделях, если у тебя не риг блеквеллов.

Какой же он ебнутый... Нахуй он вообще тюнит 1б модели. Это же буквально генератор шума, лол.

А как же

>РЯЯЯЯ НИЖЕ Q4 ЖИЗНИ НЕТ КОКОКО БРБТАХ ТАХ ТАХ

?

Чё вы, рамомагнаты ебучие, соснули? Какого вам быть прогретыми на НИЗКИЙ КВАНТ??? Больше не лезет, да? ДОКУПИТЕ ОПЕРАТИВЫ, хули вы как бедные блядь?

Нихуя себе - вот это боль нищука. Каково это - быть обреченным целовать запупы мистральки, зная что рядом господа крутят 400В-гигантов?

> читая ответ на 5-6 т/с

Примерно в 7-8 раз больше, так что норм. Покумить и без него можно, да и в целом ответы норм, нужно больше смотреть чтобы понять где хорошо, а где надоедающий слоп, по первой оно все за счет свежести крутым кажется. Но с ризонингом получил подряд несколько убергоднейших ответов, а заглядывая в синкинг видно что ближе к началу как раз были "выдвинуты предложения" по поведению и элементам для повышения иммерсивности. Также понравилось что в нем оно вспоминает пожелания целей из глубины контекста, и следует им.

По сейфти не понимаю как его "политики" в синкинге работают, канничка - бывает долго сомневается, но в основном ок. Ставишь в персоналити 16лет пиздюка, который подкатывает к сенсею - нельзя нельзя!

>крутят 400В-гигантов

В Q1, ты забыл упомянуть. Бичара, а ну быстро слил 2квинтиллиона тугриков!

>мистральки

Мистер, вы в 24 году застряли. Богоподобный Air передаёт привет и напоминает, что вам придётся докупать ещё столько же железа для запуска модели, которая умнее на 0.1 болтозвяк.

Через ХУЙ вас кинули. Не будет больше доступных моделей. Жрите, мрази, мир, который сами и создали.

>Не будет больше доступных моделей.

Не будет доступных - будем катать недоступные. Я вот тоже думал, что никак, а смотри-ка: Квен можно, Глм можно. Моделей мельче тоже хватает, но даже когда их увеличат по современным тенденциям, их всё равно будет можно. А что второй-третий квант - так что же. И на втором кванте жизнь есть. 26-й год уж как-нибудь переживём.

>Не будет больше доступных моделей.

Ох, нет, у меня удалили мой ГЛМ?!

А нет, всего лишь даун из асига потёк. Как же они заебали.

>для запуска модели, которая умнее на 0.1 болтозвяк.

Ну старший ГЛМ так-то умнее на пару порядков, аир в конце-концов всего лишь обучен подражать ему, но быть им он не может.

Вот вы тут пишете все: кум, РП, таверна. Решил тоже попробовать. Запустил Эйр, скачал последнюю таверну, запустил. А дальше что? Ну допустим я нашел карточки персов. А где блять брать инструкции, системный промт и ещё хуеву тучу различных параметров и настроек? Они же для разных моделей разные. Пока все это настроешь сам в кум превратишься. Проще ядро линукса собрать чем это. Я хуею. Да ещё это все на инглише, нахуй это надо?

>Да ещё это все на инглише

пикрил

>А где блять брать инструкции, системный промт и ещё хуеву тучу различных параметров и настроек?

Настройки бери у анслота на странице модели на его сайте.

Системные промпты в таверне есть на все случаи жизни. Инструкции в целом тоже - если сомневаешься - ставь везде чат-мл.

Остальное трогать не обязательно.

>Да ещё это все на инглише

Я карточки перевожу на русский, обычно персонажи сразу начинают шпрехать по-русски. Но это ещё зависит от модели, она должна уметь сама по себе "понимать" и отвечать на русском.

ЗЫ, моделька у меня huggingface.co/mradermacher/RP-SAINEMO-GGUF

Мимо z420 кун

Вдогонку - строка запуска и заполнение видюх

~/llama.cpp/build/bin/llama-server -m ~/models/roleplay/RP-SAINEMO.Q8_0.gguf --jinja --host 0.0.0.0 --port 8080 --no-mmap -c 55000 --fit on -fa on

~/llama.cpp/build/bin/llama-server -m ~/models/roleplay/RP-SAINEMO.Q8_0.gguf --jinja --host 0.0.0.0 --port 8080 --no-mmap -c 55000 --fit on -fa on

Температура - это усиление/уменьшение вероятности наиболее вероятного токена. Назовем это "адекватность vs креатив".

Министраль требует более низких температур, чем остальные мистрали/немо. Иначе начинает шизу гнать, просто она делает это раньше, чем остальные модели.

Французы сами советуют занижать.

Каждый раз как даю ему в руки перо, хочется забрать обратно.

Появился запрос на пресетик на эир от нюни.

Выполнять.

Выполнять.

Двач режет метаданные. Можешь как-то еще скинуть карточку?

Вы понимаете что в этом году уже всё?

Все крупнячки высрали модели, ждём 2027.

Все крупнячки высрали модели, ждём 2027.

Чувак, ты в курсе что моделей которым ГОД не так и много? За прошедший год столько случилось что ебанутся.

Почему в треде до сих пор не сказали главного?

Квен починил свою прозу и переносы строк?

Квен починил свою прозу и переносы строк?

> DRAM

Есть еще на резисторах с большими емкостями, энергонезависимая вроде.

Новый квен кал. Для РП он точно неюзабелен.

>Квен починил свою прозу и переносы строк?

Нет, конечно. Потому что это не баг, а фича. Квен это чисто ассистент или для проги. На прозу и как следствие рп им похуй абсолютно. QwQ вышел год назад и это была последняя их модель, которая хоть как-то использовалась в рп

> Квен это чисто ассистент или для проги. На прозу и как следствие рп им похуй абсолютно

В квене 2507 этой строки нет, кстати.

Пиздеж. В квенах залили вектор отказа на любой креатив и рп, даже sfw. Теперь квен как минимакс, только в два раза больше по параметрам.

как же он транслирует позицию с дискордика

Нет пути всё это время мы ждали квен который был у нас под носом...

Единственный крутой квен был первый квен 235б

Единственный крутой квен был первый квен 235б

Когда в попенсорс релизнёшься?

Выполнил тебе за щеку, проверяй.

Конечно никто не послушает но в первом большеквене будто меньше прозы, сижу вот тестирую.

Ответы нормальные, свичнулся на 2507 и сразу пережаренные на тех же свайпах, сразу меня хотят выебать, поработить, всё и сразу со мной сделать, а первый квен просто флиртует и пытается подход найти

Ответы нормальные, свичнулся на 2507 и сразу пережаренные на тех же свайпах, сразу меня хотят выебать, поработить, всё и сразу со мной сделать, а первый квен просто флиртует и пытается подход найти

Типа у персонажа есть секрет, он хочет меня выебать, квен 2507 откровенно рашит к этому, буквально пишет "твой кок такой сладкий", а первый отвечает больше как глм и пытается в сторонку меня отвести, заговорить, на чай пригласить

А что не обсуждаем? Новая доступная для масс моделька.

https://huggingface.co/inclusionAI/Ling-2.5-1T

https://huggingface.co/inclusionAI/Ling-2.5-1T

Эх помню в треде грезили о новой мое няше от Кохере. И я тоже грезил.

Ну может быть когда-нибудь, а пока https://huggingface.co/collections/CohereLabs/tiny-aya

Ну может быть когда-нибудь, а пока https://huggingface.co/collections/CohereLabs/tiny-aya

Сорян. В треде всегда был гейткип по железу.

Никто не говорил что обычный пека входил в сделку.

Два чая. Вот еще одна отличная модель вышла и полностью проигнорирована в треде: https://huggingface.co/Nanbeige/Nanbeige4.1-3B Вам лишь бы поныть, ей-богу

Они пошли ещё дальше, не стали заморачиваться с 30-3б

Что реально хорошо для когда сейчас до 230b?

Из малюток до 100b это Qwen 3 Coder Next, а ближе к 200b что лучше, Minimax 2.5?

Из малюток до 100b это Qwen 3 Coder Next, а ближе к 200b что лучше, Minimax 2.5?

Блет, для кода*

Тоже интересно. И еще любопытно вот что: Qwen3-Coder-Next q8 против MiniMax-M2.5 q4. Понятно что Квен быстрее, но сильно ли они отличаются по уму.

ЛоКАЛьщики, а как на вашей хуйне рпшить с безжопом? Вы же хвастуетесь, что вы такие прошаренные, мол, простить умеете. Или же ваше "мастерство" это выставить ChatML и промпт гичана а таверне.

Слабо, немотроношизик

Тебе там за щеку выполнили, проверить не забудь

Чини детектор, чмоха. Тебе вот квен высрали в q1 каанте, который тупее пигмы. Кушай, не обляпайся.

Зачем? Я ж не ты чтобы такой хуйней заниматься

Получается что сейчас вообще нет нормальных моделей для локального РП кума на русике? Какие тогда на англюсике посоветуете?