Пиздец, кобольдосрач поломал харкач. Ебанная ящерица-недомерок везде нагадить успела

Сорян, это моя агентесса решила разом отправить 100 сообщений в пропаганду правильных ценностей и поддержку разных сторон срача, перестаралась.

отзыв на Qwen3.5 27b heretic:

Тестовый кум - крайне успешен, ощутил неподдельное удовольствие качеством писания.

Русик - сойдёт.

Кум x4 - сочнейший, особенно после ризонинга.

Возможность после первых ответов отключить думанье и не убить в говно качество - есть.

Форматирование - звёздочки и кавычки ставит крайне неохотно, иногда приходится редачить.

Кароче, единственный минус - ужасно долгий ризонинг.

Модель отправляется в золотой зал (для 16+64).

Llama 3.1 Celeste 8b < Rocinate 12b я даже хуй знает от чего это тюн < mistral 2506 < GLM-4.7 heretic FLASH < Mistral small 3.2 24b < Air < Qwen3.5 27b ~< Qwen3 235b

Тестовый кум - крайне успешен, ощутил неподдельное удовольствие качеством писания.

Русик - сойдёт.

Кум x4 - сочнейший, особенно после ризонинга.

Возможность после первых ответов отключить думанье и не убить в говно качество - есть.

Форматирование - звёздочки и кавычки ставит крайне неохотно, иногда приходится редачить.

Кароче, единственный минус - ужасно долгий ризонинг.

Модель отправляется в золотой зал (для 16+64).

Llama 3.1 Celeste 8b < Rocinate 12b я даже хуй знает от чего это тюн < mistral 2506 < GLM-4.7 heretic FLASH < Mistral small 3.2 24b < Air < Qwen3.5 27b ~< Qwen3 235b

>mistral 2506

>Mistral small 3.2 24b

Это одно и то же, лол

Есть "однокнопочное" локальное решение чтобы побаловаться в ролевки с разными нейронками?

Все чем я пользовался lmstudio когда искал необходимые промпты для веб сервиса который потом подняли на ollama.

Почему в шапке нет приложения PocketPal для мобильных устройств? Оно плохое или недостаточно мощное?

Все чем я пользовался lmstudio когда искал необходимые промпты для веб сервиса который потом подняли на ollama.

Почему в шапке нет приложения PocketPal для мобильных устройств? Оно плохое или недостаточно мощное?

Я слепой немного, перепутал файл с пресетом для кобольда уже как год не пользвуюсь, не убивайте и ггуф. на том месте должен был быть NemoMix-Unleashed-12B-IQ4_XS.gguf наверное

Кобольд + таверна, разумный компромисс между однокнопочностью и функциональностью. Хотя обычноюзеру даже это может показаться пердолингом, потому что для наилучшего результата нужно настраивать. Из прямо готовых из коробки решений для рп только всратые сервисы, которые реально всратые.

А что насчет угабги? Он как-то поприятнее выглядит. Не то чтобы это было очень важно.

Или у таверны будет свой интерфейс и от платформы нужен только бекенд?

С наскоку за десять минут не настроишь похоже, придется читать. Потом еще конкретные ллм скорее всего придется тюнить для нормальной работы. Странно как-то что нет локального plug and play софта, в который только нейронку воткни.

Lm Studio есть

>А что насчет угабги?

Оно живо еще?

>Или у таверны будет свой интерфейс и от платформы нужен только бекенд?

Да, таверна это фронт.

>Потом еще конкретные ллм скорее всего придется тюнить для нормальной работы.

Лол, нет, этого не надо делать, разве что под тьюнингом ты подразумеваешь обычную настройку.

>Странно как-то что нет локального plug and play софта, в который только нейронку воткни.

Есть и он называется кобольд. Там даже кнопка есть - настрой для меня и запусти по красоте.

Да там как-то не получается в рп. Вместо рп получается какая-то новелла. Или я просто не правильно себе это представляю.

Не знаю, я в шапке пока высмотрел ее. Не успел разобраться.

В лм студио приходилось менять некоторые настройки чтобы добиться "пика эффективности". Об этом и на страничке модели писалось. И еще приходилось делать мастер промпт чтобы оно не отвлекалось.

Ну попробую связку кобольд + таверна, спасибо.

>Возможность после первых ответов отключить думанье и не убить в говно качество - есть.

>Форматирование - звёздочки и кавычки ставит крайне неохотно, иногда приходится редачить.

Промптить думанье просто надо под то что тебе нужно. 3.5 очень заметно лучше отзывается в этом плане чем всё что было с ризонингом для этого. Finally модель, которую можно промптом заставить хоть как-то адекватно делать самопроверки какие угодно, трекать корректность анатомий и количества снимаемых трусов и хоть считать по физону движение хуев и тряску сисек в ERP.

Но ризонинг такой, конечно, не для среднего железа, минимум 4090/5090 с 40-50+ t/s, чтобы не покрыться плесенью в ожидании.

Оно норм, удобно, универсально. И можно пользоваться, таверна просто лучше для рп.

> Или у таверны будет свой интерфейс и от платформы нужен только бекенд?

This, и вместо кобольда может быть убабуга.

> придется тюнить

Настраивать промпты. Рп это вообще тема довольно специфичная, разнообразная + к разным моделям разный подход. Так еще и по моделям и запуску тот еще зоопарк. Потому и нет сразу единого готового стандарта.

> делать самопроверки какие угодно, трекать корректность анатомий и количества снимаемых трусов и хоть считать по физону движение хуев и тряску сисек в ERP

Базированно, наконец господин, который отметил эти фишки.

>Кароче, единственный минус - ужасно долгий ризонинг.

Попробовал по рекомендации. Ну не знаю, как по мне - ризонинг весь по делу. Ужасно приятно, что сою из него можно вычистить. В русском немного путается, но терпеть можно; в английском должно быть вообще отлично. Действительно интересная модель.

Кстати действительно хороший мердж получился. Пока что прям даже отличный, всего пару свайпов сделал за несколько часов. Может даже лучше Maginum-Cydoms.

Хочу вкатиться в эти ваши лэлэмы. Подскажете как, чтобы не наебнуть пк в процессе. В шапке только куча ссылок и всё на англюсике. Не то чтоб я его совсем не понимал, но хочется нормальной такой, гречневой инструкции. Мучить промтами жеминю весело, но хочется настоящего женского тепла персонажа, чтобы запоминал контекст и придерживался роли в продолжительных диалогах. Как? Научите, будьте добры

>Не то чтоб я его совсем не понимал, но хочется нормальной такой, гречневой инструкции.

Пожалуйста, проследуйте в тред к другим обладателям отсутствия мозга:

Что лучше, плотный квенчик 27 или мое 122б-а10б? И для рпшинга и для коденга.

Для кода и то и другое хуйня, потому что есть гпт осс 120. Она по их же бенчмаркам (квена) лучше. И это при том что в их бенчах гпт осс mxfp4 (единственный вариант), а квены в полных весах. Вот и сравнивай. mxfp4, по сути квант чуть хуже q4ks, уделывает полные веса новых квенов в CodeForces, а это самый показательный кодинг бенч за пределами эйдер полиглота. Потому что для решения тамошних задач нужны и широкие и глубокие познания в коде. Кто там сидел и решал задачки те знают. Единственным плюсом пожалуй будет контекст, он весит легче и уместится его больше, хотя хз будет ли на практике держать больше тех же доступных и на гопоте осс 128к

Гпт осс 120 7 месяцев назад вышла, а до сих пор уничтожает всё в своей размерной категории. Даже на средитах уже это поняли и сидят ахуевают, почему и зачем альтман сделал такой подарок. Такого уже не будет от попенов, вероятно

С контекстом плюс нивелируется тем, что нужно для кода брать хотя бы q5, а лучше q6 квант, что гораздо жирнее гопоты осс. 40 гигов разница с q6. И работать гопота будет быстрее, 3b против 10b и 27. Жаль, что в рп гопота не умеет совсем, был бы совсем бангер. Хотя потому и не умеет, подозреваю, что в коде хороше.

Это тред локалок, я хочу локалку. Просто я нуфак в этом деле, помогите разобраться

>в тред к другим обладателям отсутствия мозга

>This is a guide for retards like you, who want to roleplay debauchery things with an LLM

Так... это что такое, а?

>Download SillyTavern release or staging branch

А в чём разница? Что мне выбрать чтобы было поменьше пердолинга? Я же нововкатыш, сейчас мне нужно что-то попроще, чтобы понять как работает

Это актуально только для 122б мое. Плотная наоборот может влезть тем, кому не влезает та же гпт осс или другие мое, ибо фуллврам

Здесь справедливо не любят реквесты а-ля "скажите мне куда нажимать и чтобы было заебись". Задаешь конкретный вопрос получаешь конкретный ответ. Для начала тебе подойдет koboldcpp, это лучшее решение для новичков. Там и бэкенд (запуск самой модели) и фронтенд (интерфейс с ее взаимодействием). Затем по необходимости установишь Таверну. Staging branch тебе не нужен, используй release

Ты железо свое сообщи. Если там меньше 16gb vram и 64gb ram, можешь забить на затею

>Фуллврам или чисто проц?

Я кстати не помню, скорее первое, я же не такой балбес, чтобы удивляться ускорению с выгрузкой на проц... Вроде бы. Не знаю.

В случае с процом там вообще жуткий буст, оно же для каждого батча заново слои скидывает на карту, и в таком сценарии после скидывания считать 8к, а не 512 - крайне логично и выгодно.

>Оверпрайс если что

Не знаю, я думал там скорее будет под тысячу за метр - я не представляю процесс производства такой штуки. Особенно меня поражает, почему профиль с 5 дырками дешевле чем с одной. Ладно центр рассверливают ещё, предположим, а как квадратные отверстия такие то делают... Не понимаю.

Спасибо большое, я не знал как он называется, гуглились только квадраты, трубы и всякое П-образное. У меня просто есть что собрать, 9 метров профиля нужно, эта штука вроде как на вид то что нужно, лучше чем коллхозить из квадрата, к которому ролик не очень ясно как закрепить. Ну и к слову квадрат 20х20 толщиной 2 мм по цене как и твой профиль.

Я бы из стали сделал, у меня и сварочник есть и прочее - но это будет весить тонну, а подразумевается что это будет что-то переносное + иногда на улице, где не очень хочется сталь, как бы я её не покрывал, будет дырка от сверла, куда внутрь вода будет попадать.

технически можно запускать и на 6гб врам (я запускал), но только мое модели и много контекста не влезет.

Технически можно, да только запросы у него ого-го какие

>хочется настоящего женского тепла персонажа, чтобы запоминал контекст и придерживался роли в продолжительных диалогах

Даже на гигантах для такого нужно от 32к контекста и постоянно сумарайзить

ну вот квен что то такое сделал что 35B-A3B даже на 100к заполненного контекста доделывает задачу по пунктам до конца и отмечает в конце в файлике сделаные задачи а не пускается в пляс на бесконечное генерирование кода.

Я конечно мало тестил локальные модели (до этого был негативный опыт, правда на 6гб врам запускал до покупки 16Гб видяхи), но то что я вижу сейчас - уже весьма похоже на рабочий инструмент.

Но я на 16гб врам пытался в тех же задачах запустить glm4.7-flash и он с треском провалился еще на этапе планирования спецификации когда начал вместо этого сразу писать код

>Особенно меня поражает, почему профиль с 5 дырками дешевле чем с одной.

Меньше металла стоит дешевле, чем больше металла, вот ведь загадка.

> Ладно центр рассверливают ещё, предположим, а как квадратные отверстия такие то делают... Не понимаю.

Они не сверлятся. Это экструзионный профиль.

У rsi немного дешевле чем у сз

https://huggingface.co/Qwen/Qwen3.5-122B-A10B

Кто-то отписывался уже по нему не в лучшем свете, в контексте рп. Поддержу. Q6 батрухи. Тупой как пробка в ролевой игре на английском. Уж не знаю как Гемма, про которую все так активно строчили в первые дни выхода Квена3.5, но Эйр точно лучше. Контекст Квен держит лучше, но смысла в этом никакого. Придется свайпать много-много раз, чтобы получить что-нибудь вменяемое. Не понимает нюансы диалогов, персонажи очень картонные.

И это я еще не сталкивался с рефузами, гардрейлами и байасом, потому что тестил на безобидных диалогах. Полный провал.

Кто-то отписывался уже по нему не в лучшем свете, в контексте рп. Поддержу. Q6 батрухи. Тупой как пробка в ролевой игре на английском. Уж не знаю как Гемма, про которую все так активно строчили в первые дни выхода Квена3.5, но Эйр точно лучше. Контекст Квен держит лучше, но смысла в этом никакого. Придется свайпать много-много раз, чтобы получить что-нибудь вменяемое. Не понимает нюансы диалогов, персонажи очень картонные.

И это я еще не сталкивался с рефузами, гардрейлами и байасом, потому что тестил на безобидных диалогах. Полный провал.

Ясно, эйр с нами навсегда. Терпим, карлики. Кто терпит, тот выживает.

Можно терпеть, а можно кайфовать. Каждый выбирает сам.

Что за круговорот датасетов в природе? Почему дипсик порой шизит и пишет что он квен, квен что он чатЖПТ, а гемини пускает слюни.

Все кампании занимаются совместным пиздингом данных у друг друга что ли?

Все кампании занимаются совместным пиздингом данных у друг друга что ли?

Да, увы и ах, в целом для РП новые квены не очень.

Но ничего, год только начался, я уверен нас выпустят ведь мы приплыли в Морровинд, еще много хороших моделек впереди.

Есть архив прошлого треда у кого-нибудь, я свой перезаписал сломанным тхредом, не проверив.

> Все кампании занимаются совместным пиздингом данных у друг друга что ли?

Да. Собранных человеками датасетов теперь очень мало. Почти все собирают синтетические датасеты (из данных, сгенерированных ЛЛМ), и на них обучают.

Я может тупой.. и чего то не понимаю. Но обучение на выжимках, это же говно. В чем проблема посадить макак, чтобы они сидели и компилировали охуительные истории написанные двурукими обезьянами?

Да. Говно. В чем проблема посадить макак - подозреваю, это дороже и дольше. К тому же, это уже делается, как-то же собирают данные с интернетов.

Дальше ситуация будет усугубляться, и синтитеческих данных в датасетах будет все больше.

>уделывает полные веса новых квенов в CodeForces, а это самый показательный кодинг бенч за пределами эйдер полиглота

спорное утверждение. если цель пользователя ЛЛМ решать олимпиадные задачки, то да, наверное бенч КФ показателен. но обычно это более разнообразыне проекты - какой-то бекенд/фронтет, пачка скриптов, игроделы. и тут то нужно работать с многими существующими файлами, а в КФ модель ебашит с нуля в одном файле

но гпт-осс 120б хорош, спору нет. хотя на том же реддике нет единого мнения, многие до сих пор сидят на разных вариациях квен-код моделей. чуть позажиточнее аноны - на минимакс (хотя для таких относительно больших моделей мнения еще более разделились, и все сугубо личный преференс)

Ленивцы кванты пофиксили или нет?

Обычный круговорот. Все нейронки срут в интернет, а их высеры кидают в датасеты. Такая вот нейросетевая многоножка.

>В чем проблема посадить макак

Правозащитники сказали, что РАБотать за 7 баксов в день на ужасной работе по разметке и генерации датасета это нечеловечно. Поэтому негры теперь сидят без работы.

Анслоп ебу дал?

Гпт 120б если что.

>В чем проблема посадить макак, чтобы они сидели и компилировали охуительные истории написанные двурукими обезьянами?

долго

дорого

бесполезно - у тебя будет модель от макак для макак с охуительными историями. кому это нахуй всралось кроме местных кумеров?

Квенобояре, как вам новые лоботомиты?

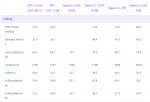

Тест SmolLM3-3B на дебилах

Обновленный обзор

Мне нужна модель для общения с дебилами.

Сейчас для моих задач используется YandexGPT-5-Lite-8B-instruct-Q4_K_M, она весит меньше 5 гигов и идеально подходит для общения с дебилами, пишет контакты, если просят, очень быстро генерирует токены

На картинке gemma3-1b, весит 800 мб, несет хуйню, но сгодится для того, чтобы издеваться над дебилами, но не общаться. Если задать ей вопрос в лоб, то прямо пишет, что она языковая модель Google.

Мне нужна модель, которая весит меньше YandexGPT-5-Lite-8B-instruct-Q4_K_M, но общается достаточно качественно, чтобы общаться с дебилами.

Весят больше YandexGPT-5-Lite-8B-instruct-Q4_K_M

NousResearch_DeepHermes-3-Llama-3-8B-Preview-Q6_K_L - медленнее выводит токены, чем YandexGPT-5-Lite-8B-instruct-Q4_K_M, реагирует вроде лучше на фразы типа М, пишет конакты, если просят, но все равно шероховатости в ответах.

На уровне gemma3-1b, но весят больще

gemma-3n-E2B-it-Q6_K

Хуже gemma3-1b и весят больще

fblgit_miniclaus-qw1.5B-UNAMGS-GRPO-Q6_K_L

Тест провалили (сильно хуже, чем gemma3-1b)

Thinking модели, не подходят для чата

DeepSeek-R1-Distill-Llama-8B-Q6_K_L

DeepSeek-R1-Distill-Qwen-1.5B-Q6_K_L

teknium_Qwen2.5-1.5B-Open-R1-GRPO-Q6_K_L

Пишут еренду

FuseChat-Llama-3.2-1B-Instruct-Q6_K_L

gemma-2-2b-it-abliterated-Q8_0

Мешают русский и другие языки

tiny-llm-q5_k_m - мешает русский и английский

internlm3-8b-instruct-Q6_K_L - медленнее выводит токены, чем YandexGPT-5-Lite-8B-instruct-Q4_K_M, пишет вроде складно, но потом добавляет иероглифы

Не отвечают на русском

agentica-org_DeepScaleR-1.5B-Preview-Q6_K_L - Thinking модель, не подходит для чата

nvidia_AceInstruct-1.5B-Q6_K_L - Thinking модель, не подходит для чата

SmolLM3-3B-Q6_K - Thinking модель, не подходит для чата

Мы счастливы. Ведь мы счастливы, аноны.

Мы получили что хотели. Новый большой доступный квен, агентские малыхи, и даже среднелоботомита.

РП в сделку не входил. Сами себе Буратино.

Это норма.

Понимаю. Мне пока бы с самой базой ознакомиться, а т оя не понимаю о чём анон в треде говорит. Буквоцифры какие-то, что это? Имена моделей? В них существенная разница или вкусовщина?

>koboldcpp

Кобольд так кобольд, всё равно по первой разницы с другими не увижу. Вот я скачал ехе с гитхаба. Что дальше? Его нужно в отдельную папку отселять?

>установишь Таверну

А кобольд и таверна это не одно и то же? В чём разница?

12 врамы, 16 рамы. Совсем мало? Мне для работки и игорей всегда хватало, ни разу не упирался в недостаток :(

Я просто подумал, что на локалке будет проще схоронять прогресс общения. Ошибся?

Жпт с завода квантована

> Буквоцифры какие-то, что это? Имена моделей? В них существенная разница

Поваришься немного - поймешь.

Про квантизацию популярно, там не все так просто

https://youtu.be/vW30o4U9BFE

https://github.com/iuliaturc/gguf-docs

про мое и плотные модели и цифры в названиях модели можешь у

дипсика спросить, она тебе расскажет (кстати, мое не всегда обозначается в названии, часто в описании пишут между делом как активные параметры)

Раз уж так ленишься читать шапку/вики треда/вики кобольда, то позадавай свои вопросы гемини/чатгпт - это будет быстрее и проще чем ждать пока кто-то тебе тут всё разжуёт.

> Понимаю.

> Вот я скачал ехе с гитхаба. Что дальше? Его нужно в отдельную папку отселять?

> А кобольд и таверна это не одно и то же? В чём разница?

Говоришь, что понимаешь, а затем сразу же задаешь два вопроса, которые легко решаются одним запросом в гугл. В треде такое справедливо трактуется как нежелание разбираться самостоятельно, иногда триггерит местных на праведный гнев. У Кобольда прямо на странице Гитхаба есть инструкция по запуску. Даже русскоязычные видосы на ютубе есть. В крайнем случае, иди спрашивай Гемини, которую сам же и упомянал.

> Буквоцифры какие-то, что это? Имена моделей? В них существенная разница или вкусовщина?

Qwen3.5-122B-A10B ; Qwen3.5-27B ; GLM-4.5-Air - всё названия моделей. Разница существенная: разные семейства моделей, разные типы моделей, помещаются в разное железо. Если ты хочешь именно разбираться в сабже, то со временем разберешься, не нужно перегружать себя информацией. Для начала запусти хоть что-нибудь, что соответствует твоему железу.

> 12 врамы, 16 рамы

Результат будет однозначно хуже того, что ты можешь запустить через апи (Гемини, Клод, чем ещё там балуются в соседнем треде). Навскидку, это 12б-14б Мистрали, возможно совсем маленькие Квены, из новых это Qwen3.5-35B-A3B.

> 12 врамы, 16 рамы. Совсем мало?

врам еще более менее, а рамы точно мало. грубо говоря - модель либо помещается целиком в видеопамять + память на контекст несколько гиг (маленькие и глупые модели), либо MoE модели которые выгружают малоиспользуемые веса в оперативную память и используют по мере необходимости.

вот взять к примеру квен который я сейчас использую

https://huggingface.co/unsloth/Qwen3.5-35B-A3B-GGUF/blob/main/Qwen3.5-35B-A3B-MXFP4_MOE.gguf

для 120к контекста он сейчас занимает 14Gb врам и 13Гб рам.

Для более больших моделей у меня не хватает 32Гб RAM чтобы положить https://huggingface.co/unsloth/Qwen3.5-122B-A10B-GGUF, там уже минимум 64гига памяти надо.

> Я просто подумал, что на локалке будет проще схоронять прогресс общения. Ошибся?

Смотря что ты под этим понимаешь. В твоё железо влезут модели, которые на порядки глупее того, что ты используешь сейчас, и будут вменьшать меньше контекста. Знаешь хотя бы, что такое контекст?

Ссылки на модели, что я выше упомянул - https://huggingface.co/inflatebot/MN-12B-Mag-Mell-R1 ; https://huggingface.co/mistralai/Ministral-3-14B-Instruct-2512

Заходишь в Quantizations, качаешь подходящий по размерам в gguf кормате квант. Разбирайся. Не будешь разбираться - тебя дальше будут игнорировать, и будут правы.

>Навскидку, это 12б-14б Мистрали

Смысла нет. Лучше чуть подольше подождать, но юзать нормальные 24b и 27b. Они влезают по железу.

Возьми на себя бремя объяснить новичку, как именно можно на 12гб врама запустить 24б-27б модели с контекстом. Мне же кажется, гораздо резоннее сначала запустить хоть что-нибудь. Позже уже минмаксить, если он поймёт, что это то, чем хочет заниматься.

>Thinking модель, не подходит для чата

Мяу? Можно отключить размышления. И почему не подходит? Вполне подходит.

Он же через кобольд собирается гонять? Ну укажет контекст, 16к, например, и нажмет запустить. Всё. В кобольде там в выгрузке слоёв по умолчанию -1, т.е. он автоматом сколько-то слоёв сгрузит во врам. Модель запустится, просто настройки будут неоптимальные.

А если уж объяснять, то объяснять нужно подробнее, и про темплейты, и про семплеры, и про разные оптимизации типа флешатеншн, квантование контекста, и про все нюансы таверны, и про особенности работы с моэ, ну ты понел.

Делать этого я конечно же не буду. Инфы в шапке, в вики и в интернете предостаточно. Я когда вкатывался в локалки пару лет назад, вообще анону мозги не ебал, разбирался во всём сам. Ничего сложного в этом нет. Чел просто ленится читать и хочет чтобы его с ложечки накормили.

Что там по квену 3.5 27В? Как он в плане сэкса?

Контекст ебет

Гемма лучше. Это не шутка.

Меня терзают смутные сомнения... (с)

590 и 12.4 ???

5090 - 0 отклеился.

Если честно, неплохо. Я не могу отрицать его богатую фантазию. Квен обычно пишет как какой-то поэт на грибах и кокаине, но 27b прям...более целостный что-ли. Его предложения написать эротическую историю мне даже понравились.

я бы сказал у геммы лучше слог, но она продолжает диалог без копмьюта. у квена его размышления могут так сильно изменить начальное повествование что это выглядит как радикальный шаг, чем он обычно удивляет.

Мне нравится давать квену инструкцию "Advance plot while you writing. Don't stuck in same scene, it is not fun when your only answer what character feel or does. WHAT is going on and how scene advances are even more important."

Неверный объём, в 5090 можно сделать только 96 гиг.

Анон, объясни как промптить думанье. Я тупой, только-только разбираюсь с обычным промптингом

>Что там по квену 3.5 27В? Как он в плане сэкса?

Вот по-хорошему его (heretic-версию) бы прикрутить в качестве ризонинг-модели к самой большой версии Квена. Ризонинг совершенно того же формата и он хорош. Ну а сочные детали уже большая модель распишет. Автоматизировать этот процесс плагином к Таверне было бы хорошо.

Фантазёр, ты меня называла...

Ананы, помогите, всю жопу себе уже разорвал.

Новые модели квена, 27-35б, постоянно пересчитывают контекст и я не могу с этим никак разобраться.

В кобольде, как я понимаю, вообще с этим ничего не сделать, но у меня там 10 тс. В лламе есть полурабочий вариант с --ctx-checkpoints 128, однако там 6 токенов при любом сценарии работы, вот хоть усрись, в том числе и без -ctx-checkpoints.

Я уже часов 5 ебался, всё бестолку.

Из железа 3060 + р104, то есть 20 врам. Модель полностью влезает, в данном случае речь именно про 27б квен.

Основная проблема в лламе, как я понимаю, в том, что она почему-то кладёт самые жирные compute buffers на p104, слои или аллаха — кобольд показывает совершенно иную картину: самое тяжёлое говно он берёт на 3060. И я никак не могу это исправить. Небось в лламе есть какие-то анальные оптимизации, которые нужно включать вручную и которые включены по умолчанию в кобольдыне. Может что-то, связанное с mmq, cublas, а я этого не знаю. В любом случае, тензор сплит, мейнг гпу, вот это я всё уже дёргал в каких угодно пропорциях и крутил свои логи в гопоте в режиме размышления на 7 минут по 32к токенов, с поиском по интернету и загруженной документацией кобольда и лламы. Тут явно видно, что проблема в р104 и я на древнем говне сижу просто, но всё же, раз кобольд справляется, наверняка ручками что-то сделать можно.

Пожалуйста, дайте советов и скопипастите прям свой батник сюда (вообще похуй, что вы там запускаете — главное пример), чтобы я увидел, что там и у меня появилось реальное понимание, что вы там пишете. Возможно, я упускаю что-то важное, так как лламой пользовался всего лишь раз 5 за несколько лет.

Новые модели квена, 27-35б, постоянно пересчитывают контекст и я не могу с этим никак разобраться.

В кобольде, как я понимаю, вообще с этим ничего не сделать, но у меня там 10 тс. В лламе есть полурабочий вариант с --ctx-checkpoints 128, однако там 6 токенов при любом сценарии работы, вот хоть усрись, в том числе и без -ctx-checkpoints.

Я уже часов 5 ебался, всё бестолку.

Из железа 3060 + р104, то есть 20 врам. Модель полностью влезает, в данном случае речь именно про 27б квен.

Основная проблема в лламе, как я понимаю, в том, что она почему-то кладёт самые жирные compute buffers на p104, слои или аллаха — кобольд показывает совершенно иную картину: самое тяжёлое говно он берёт на 3060. И я никак не могу это исправить. Небось в лламе есть какие-то анальные оптимизации, которые нужно включать вручную и которые включены по умолчанию в кобольдыне. Может что-то, связанное с mmq, cublas, а я этого не знаю. В любом случае, тензор сплит, мейнг гпу, вот это я всё уже дёргал в каких угодно пропорциях и крутил свои логи в гопоте в режиме размышления на 7 минут по 32к токенов, с поиском по интернету и загруженной документацией кобольда и лламы. Тут явно видно, что проблема в р104 и я на древнем говне сижу просто, но всё же, раз кобольд справляется, наверняка ручками что-то сделать можно.

Пожалуйста, дайте советов и скопипастите прям свой батник сюда (вообще похуй, что вы там запускаете — главное пример), чтобы я увидел, что там и у меня появилось реальное понимание, что вы там пишете. Возможно, я упускаю что-то важное, так как лламой пользовался всего лишь раз 5 за несколько лет.

Фантазии- есть признак работающего ума.

Бббака

Отпустите вы уже Геммочку наконец на пенсию, до выхода 4. Она хуже современных тюнов мистраля 24Б во всем кроме русика. И в следовании инструкциям, и в передаче характера карточки и в логике происходящего.

Ну а Квен 3.5 27В (Heretic) неплох, пиздец умный, только медленный из-за ризонинга. С файнтюнами будет вообще красота.

Ну вот и стало понятно, что 27b плотная умница, а 122b-a10b лоботомит ебаный. И мозгов у MoE версии ещё меньше чем у 7b моделей.

Количество блоков в 0 либо отрубай ризонинг совсем через старт реплай виз:

<think>

</think>

и "chat_template_kwargs": {"enable_thinking": False} в систем промпт сверху.

Ничего, она и следующие Квены переживет. Для тех кто не судит модели по возрасту

Гемма 27б и новую гемму переживёт, если та будет ХХb-a3b моэ парашей.

27б может и умнее, но знаний у нее в 5 раз меньше. В рп и даже кодинг задачах важно и то и другое

А вывод что у 7б модели мозгов больше чем у 10б говорит в первую очередь о том что ты квантованный наглухо

Геммочка умничка, геммочка молодец. Она попустила лламу 70b, квена 72b, все мистрали, в том числе и ларж. Смогла выстоять даже под натиском эйра и большеквена. В какой-то степени дала пососать большому глму. А новая аблитерация сделала её ещё более актуальной.

Так что гуглы выкатили слепящий чин тясячелетия. На локалках ничего кроме геммы и не нужно.

Так что гуглы выкатили слепящий чин тясячелетия. На локалках ничего кроме геммы и не нужно.

Дай ссылочку

Это тебя квантовали до tq1. У мое-параши часть активных параметров дублируется и не оказывает влияния на выдачу. Всякие роутеры, да и в экспертах дубликатов много.

Поэтому плотная модель на то же число активных параметров как у мое-говна, будет разъебывать.

С большим глмом перестарался, но адептам умнички твой наброс зайдет

Воистину, гуглбои какие то религиозные фанатики. Без обид, но вы ебанутые, вы это знаете?

Да, плотная 27б тащит. Практически близка к ранним триллионникам даже по степени ума. Медленная конечно пиздец, но пока 27B-Heretic меня впечатлила.

>Всякие роутеры

Эксперт в треде

>То же количество параметров

7 < 10, о чем я и говорил - ты квантованный наглухо

Плотная хороша, почти на уровне геммы. Если нормпрезерв на плотный квен ебанут, то будет конкурент геммы просто за счет другого слога и более свежих данных. По уму честно пока разницы не вижу, и блок ризонинга часто очень длинный.

Считаю, шин, всего полтора года спустя после выхода третьей геммочки получили почти такую же модель, только немного другую, зато от китайцев.

Падажжи, ты включил SWA?

Эх. Я уже так пробовал — бесполезно. Если бы я мог как-то отключить пересчёт контекста, то да, ллама бы не понадобилась, наверное. Но там, судя по всему, проблема в другом, если смотреть issues.

А ты точно-точно на последней Лламе? Там буквально пару релизов назад были замерджены fix prompt caching пулл реквесты

И еще, если у тебя подзавязку забита оператива, попробуй --cache-ram 0.

Насоветуйте лучших расцензуренных моделей.

Пользовался геммасутрой 4б, норм, но у нее слишком маленький контекст и на половине она ломается в самоповторы и теряется.

Пользовался аорморальной геммой, хуйня, даже хуже работает несмотря на свои 12б параметров.

Пользовался нсфв лламой 1б, результат отличный, но без мастер промтпа не работает вообще.

Пользовался геммасутрой 4б, норм, но у нее слишком маленький контекст и на половине она ломается в самоповторы и теряется.

Пользовался аорморальной геммой, хуйня, даже хуже работает несмотря на свои 12б параметров.

Пользовался нсфв лламой 1б, результат отличный, но без мастер промтпа не работает вообще.

Kimi K2.5 uncensored 1T FP32

>геммасутрой 4б

>нсфв лламой 1б

>результат отличный

Дай угадаю, тебе нужно чтобы модель пуская слюни писала слово "хуй" и больше ничего? У тебя там блять что сука, калькулятор? Нахуя ты это запускаешь?

1) накати самую свежую ламу, там кое что поправили

2) у меня с такими настройками вроде не отъебывает

Ллама реально заебись. Результат лучше чем у 12б и даже 27б, пишет интереснее и работает моментально.

Блять утка ты пиздец кринжа навалил, иди опохмелись

Утка сидит как квене и минимаксе, шизоид.

Ты сам этот мусор пробовал?

Не раз давал ему вторые шансы, недавно совсем в тепличных условиях пытался мучать, чтобы даже нападки о неверной работе в llamacpp или не том формате нельзя было использовать.

Вывоз - он просто слабый. Я хз кто там находил в нем какой-то особенный перфоманс и крутой код, покажите где. В попсовых языках и свежих задачах он просто дно донное.

По поведению - не способен работать в долгую или спланировать какие-то крупные действия наперед. Тяжело ему объяснить что именно нужно, при выполнении сам плодит ошибки но ровном месте, и искажает исходный вектор движения запутавшись в них.

128к контекста в нем - это, блять, вообще пост мем просто, вычитаем из него 32к на ответ с большим ризонингом, вычитаем 16к на основные промпты и описание тулзов, 30к на его мучения с самопочином нелепых ошибок и остается хуй да нихуя. Он страдает даже с нуля если что-то пишешь, не говоря о больших проектах.

В агентах он тоже слаб по современным меркам и чрезмерно рассеянный, не смочь повторить то что уже делал ранее и это сохранилось в контексте, только с несколько другими условиями - это особый навык осса. Или игнорирование подходящей тулзы без ясного ответа почему (видимо софтрефьюз был в ризонинге).

Отдельный прикол - этот самый ризонинг. Правильную реализацию этой гармонии не так просто сделать во многих тулзах без пердолинга, а когда(если) что-то получается - наслаждайся дополнительной задержкой в 10-15 секунд перед первыми токенами, спасибо хоть на мелкие чихи она "всего лишь" 5-7. А без синкинга он вообще неюзабелен.

Да, можно сказать что ты хочешь от 120а5 лоботомита, вот только в тех же местах квеннекст худо-бедно, на грани, но справляется, причем с мгновенными ответами. А в агентах с обилием тулзов по сравнению с современными моделями и тем же 120а10 - как первая ллама.

>Новые модели квена, 27-35б, постоянно пересчитывают контекст и я не могу с этим никак разобраться.

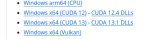

Скачал сегодня рано утром свежую llamacpp под куду 13.1 + дллки, контекст не пересчитывается, ключи самые стандартные:

llama-server.exe -ngl 999 --no-mmap -c 32768 -fa on --no-context-shift --host 0.0.0.0 --port 5000 -m Qwen3.5-27B-heretic.Q5_K_M.gguf --parallel 1

Использую этот "мусор" каждый день в своем пет проекте на плюсах. Он показывает себя на уровне Минимакса, когда пишет в рамках изолированной области кода, отлично рефакторит, дебажит и оптимизирует

Окей, дальше вот этого:

>128к контекста в нем - это, блять, вообще пост мем просто, вычитаем из него 32к на ответ с большим ризонингом

Читать не стал, потому что ты даже не знаешь, что ризонинг не уходит в контекст, лол. Насерил под себя где-нибудь, наверняка тулзы еще и тянешь неправильно, а лоботомит - модель. Классика итт

> Читать не стал, потому что ты даже не знаешь, что ризонинг не уходит в контекст, лол.

Такой умный "практик", а не знает что максимальная длина ответа, в которую входит и весь бюджет ризонинга, вычитается из доступного объема контекста? Уровень свой показал, молодец.

На последней лламе я сейчас попробовал убрать флаг --ctx-checkpoints, но никакой разницы нет. Хотя.. понять сложно из-за кривых логов (или из-за того, что я их как-то не так настроил).

Мне приходится промпт процессинг ждать вечность, ибо он там 50 против 200 у кобольда. Ну и скорость всё равно на лламе при любом раскладе 6 тс, на кобольде 10. Так что проблема есть в любом случае. 6 токенов совсем мало, и я не знаю, как это решить. Эта проблема самая главная сейчас. И оперативка под завязку не долбится.

Спасибо. Но странно, что у меня всё так же по сути, только куда 12.4, а не 13.1 — р104 более новую версию не держит.

Чат гопота писала, что вроде бы можно как-то совместить (не знаю, пиздит он или нет), то есть будет 13.1 и р104 работать в связке с 3060, но этом надо из исходников какую-то бодягу самому собирать.

И есть у меня подозрение, что в кобольде это уже всё сделано. Потому что 13.1 у меня вообще не работает при использовании лламы, только 12.4.

зачем тебе 13.1 куда если старая видяха? это для 50хх

>Возможно, я упускаю что-то важное

--fit off и ручками.

Вайбкодерам, которым "сделай мне скайрим", конечно маловато будет 128к. Адекватным программистам, которые понимают, что делают, этого достаточно. 32к токенов в ризонинге - такого я ни разу не видел. Наверно потому, что реализую логику и спорные моменты сам, а не вываливаю их в нейронку. Нахуй мне тебе что доказывать и показывать, если ты заходишь в разговор как гопарь, которого давно не пиздили за гаражами? Получаешь то, что заслуживаешь

У меня на работе еще двое людей юзают именно эту модельку для пет проектов, на го и расте. У нас одинаковые оценки. Дальше имеет смысл садиться только на жир вроде Глма или на корпов

А вайбкодеров вроде тебя не жаль совсем, платите Антропикам или продолжайте ныть

> почему-то кладёт самые жирные compute buffers на p104,

Кстати, такое пробовал?

Давно уже. Особенно с их шизофреническими XL квантами

Качай гопоту сразу у жоры

https://huggingface.co/ggml-org/gpt-oss-120b-GGUF

Да, охуенно. Удалил квен 80b и гопоту 120, теперь фул на новом квенчики. А выйдет хороший еретик и эир тоже удалю

В моих задачах квен кодер 80 лучше справляется чем гопота, а что там западные соевики насрали похуй

27Б охуенен для типовых бизнес-кодерских задач. Уверенно держит агентский цикл с большим контекстом. ИМХО просто уничтожает GLM-Flash, Devstral-small, Qwen-Next-Coder. Для кодинга не хуже Air! И у него еще и вижн рабочий.

Кругозор конечно не очень - но ему можно целую книжку в контекст загнать и он факты из нее не проебет. Тут в треде кто-то давно хотел умную небольшую модель без излишних знаний. Ну вот она.

Меня даже нейронки инцелом считают (так и есть на самом деле). Как прописать себе характер чада или претти боя

Вести себя соответствующе в твоих инпутах

>GLM-Flash

Не, он явно хуже него.

Пример: флеш смог скачать wsl, убунту, настроить venv, vllm, скачать корректную модель, несмотря на то что имел гандикап в виде полуработчего впн который к хуям ломал днс в убунте.

квен даже убунту корректно поставить не смог из указанного образа.

в плане самостоятельности он в целом отсасывает у ГЛМ, особенно на длительных забегах.

Меня все нейронки считают гигачадом с огромным членом. Мне даже в персонах приходится прописывать что-то вроде medium sized normal cock, иначе все охуевают с моего шланга. И я не на тюнах мистраля кумлю. Что там творится даже страшно представить

Проиграл. У тебя наверно в промпте что-то вроде "описывай сочно, прям чтобы ух"? Оттуда может идти гиперболизация. В целом, если опишешь, что это реалистичный сценарий, за Эйром и умницами побольше я такого не замечал. Можно даже персону не заполнять, имя, ну максимум короткое описание - они хорошо считают юзера из инпутов.

>>1535884

Не понял, вы о чем? Захожу в прошлый тред - всё на месте, в т.ч. и кобольдосрач. Ничего не потерли.

Не понял, вы о чем? Захожу в прошлый тред - всё на месте, в т.ч. и кобольдосрач. Ничего не потерли.

Вайбкодеры, вы заебали. Вот вам все расписали, что юзать и на чём. Уёбывайте.

Зачем это все про "адекватных программистов" вместо обсуждения объективных плюсов и минусов предмета? Ставишь себя так высоко относительно столь мерзких и ущербных вайбкодеров, хотя пользуешься ллмкой-лоботомитом.

> 32к токенов в ризонинге - такого я ни разу не видел.

Это не так работает, модель должна оставлять место на весь максимально возможный ответ, включая ризонинг, дефолтные объемы их известны. И не важно, сколько она ответила на самом деле, объем всегда будет зарезервирован, потому доступный к хранению полезного содержимого объем мене 96к. А постоянные ошибки отъедают еще больше.

С простыми задачами что мелкая-тупая, что большая-умная модели справятся одинаково хорошо, потому ты можешь получать в своем пет-проекта на сях тот же результат на минимаксе. А чсв и синдром утенка не дают сделать трезво оценить и даже обсудить.

Это, если что, для 20гб врам, да-да

В голос. Ситуация итт последнюю пару месяцев, литерально

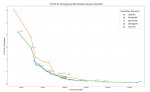

https://old.reddit.com/r/LocalLLaMA/comments/1rfds1h/qwen3535ba3b_q4_quantization_comparison/

> Unsloth's UD-Q4_K_XL recipe applies MXFP4 to nearly every tensor including ffn_down_exps and attention weights, resulting in the worst KLD in the sweep (0.0524).

Кто тут вчера на этот говняк дрочил, вам не стыдно?

> Unsloth's UD-Q4_K_XL recipe applies MXFP4 to nearly every tensor including ffn_down_exps and attention weights, resulting in the worst KLD in the sweep (0.0524).

Кто тут вчера на этот говняк дрочил, вам не стыдно?

В следующий раз сразу представься квеношизом-эксламером, чтобы я ничего не отвечал, хорошо? Хотя можно было догадаться, учитывая сколько желчи было вылито на нейтральный пост. Мы уже поняли, что ты не любишь гпт осс и агришься на всех, кому она хоть в чем-нибудь понравилась

Что значит промпт формат? Как с этим работать?

<bos><start_of_turn>user

{system_prompt}

{prompt}<end_of_turn>

<start_of_turn>model

<end_of_turn>

<start_of_turn>model

Вот что это такое?

<bos><start_of_turn>user

{system_prompt}

{prompt}<end_of_turn>

<start_of_turn>model

<end_of_turn>

<start_of_turn>model

Вот что это такое?

Я думаю это от фетиша зависит. Если ты доминируешь в сексе, то нейронка приписывает тебе большой хуй, а если ты фемдомщик, то хуекок с коробок. Во всяком случае у меня реально так. Попробуй сам

Может лучше питонистом-жсером? Ох уж эти богомерзкие злопыхатели, так их, так их!

ты теорию как работает ЛЛМ как представляешь?

Какие еще возможности есть для того чтобы увеличить контекст? еле влезла в 16gb vram, 20к контекста, выше уже oom

llama-server \

-ngl 999 --no-mmap \

-c 20000 \

-fa on \

--no-context-shift --parallel 1 \

-m Qwen_Qwen3.5-27B-IQ4_XS.gguf \

-ctk q8_0 -ctv q8_0 \

--cache-ram 0 \

--chat-template-kwargs "{\"enable_thinking\": false}"

Проблема осложняется еще тем что у меня нет встройки и операционка сожрала 800мб на карте.

llama-server \

-ngl 999 --no-mmap \

-c 20000 \

-fa on \

--no-context-shift --parallel 1 \

-m Qwen_Qwen3.5-27B-IQ4_XS.gguf \

-ctk q8_0 -ctv q8_0 \

--cache-ram 0 \

--chat-template-kwargs "{\"enable_thinking\": false}"

Проблема осложняется еще тем что у меня нет встройки и операционка сожрала 800мб на карте.

Как же хочется, но скрин фейковат. Блеквелл же с 570 драйвера и куды 128 заводится.

В чистом интерфейсе llama-server или даже сонсолечке llama-cli попробуй, скорее всего дело в запросах с изменениями в самом начале.

Ну а по распределению тензоров, которое не связано с пересчетом, через cuda visible devices или --main-gpu делаешь 3060 главной и раскидываешь в -ts. Если модель фуллфрам то попробуй -ts 1 (если 3060 первым куда устройством), а потом ffn слои отдельным регэкспом на вторую карту.

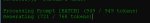

ПОФИКСИЛ, БРАТИК

Лол, что с мистралем? Зачем ты его так?

Это не я, это все кум тюны

Это странно. Типа, там 32. Если оно поддерживает больше бит адресации, то будет 64 или 128. Если бы там изначально было бы 3 блока контроллера памяти, и было бы что-то вроде 24, то окей. Но так не очень ясно чем вызвано ограничение в 96. Либо просто чипы такие крупные не получается сделать. Либо там три контроллера нагруженные неравномерно, вида 16+8+8?

Тебе любая 30B сетка сама же это объяснит.

ЛЛМ - это текстовый процессор. Оно берёт 2000 символов, и дописывает новые символы один за одним. Ну, только не буквально по одному символу, а токенами, чаще это слова или их половинки. То есть это единственная операция, которую знает сетка.

То что ты привёл, это по всей видимости chat-template в странной записи от gemma3. После обучения на продолжения текста сетку ещё немного дообучают и в название пишут it. Получается gemma3-27b-it, вот то что у тебя - это означает что дообучение было на чатах указанного тобой формата, и с ним оно работает лучше.

Есть стандартный api общения с ллм, который имеет разметку, а именно список из сообщений, в каждом из которых есть роль, сам текст, иногда что-то ещё. Разметка описывает как этот форматированный формат с ролями превратить в сырой текст, который уже пойдёт на вход нейронке.

Проще будет, если ты сам потыкаешь: https://huggingface.co/spaces/huggingfacejs/chat-template-playground?modelId=unsloth%2Fgemma-3-27b-it-GGUF

Если не понятно - сделай скриншот и закинь в chatgpt или ещё куда, он напишет быстрее и подробнее моего, и несколько охотнее.

Если конкретнее, у тебя на картинке подразумевается, что есть один системный промт, и запрос пользователя, а далее отвечает сетка.

У тебя вместо {system_prompt} подставляются инструкции, которые сетка должна выполнять, потом идёт пустая строка, потом идёт первое сообщение пользователя. Далее зачем-то идёт якобы пустой ответ от модели, а потом начало следующего. Вот это именно то что попадает на вход ллм, она видит незаконченное сообщение модели и начинает писать то что там должно быть. Когда оно пишет <end_of_turn>, то значит ответ кончится, и тебе пользователю выдаётся ответ обратно, а далее твоё следующее сообщение дописывается как новый

<start_of_turn>user

{... текст сообщения ...}

<end_of_turn>

Потом уже обычная программа дописывает туда незакрытый <start_of_turn>model и далее это снова скидывается в нейросетку.

Вот минимальный пример на скрине, можешь сам потыкать.

-ub -b понижать, уменьшая размер компут-буферов.

Не так страшно и катастрофично для скорости выгрузить слой эмбеддинга на CPU, на гемме это 2 ГБ почти даёт.

Сейчас обнаружил, что лама в сыром /completions ломается с автопарсером. Получается что только /chat/completion можно с автопарсером использовать. А без него glm не работает... Грусть, печаль.

Как разноображиваете рп на эире?

Всё же хорошо было скакать по тюнам мистраля, будто что то новое каждый раз

Всё же хорошо было скакать по тюнам мистраля, будто что то новое каждый раз

Всё верно. Вплоть до того, что там будут красочно описывать твой подтекающий писюнчик и хохотать, сравнивая с членом Чеда, пока он ебёт твою тян, в то время как чёрный Иван рвёт тебе очко и пахнет мускусом.

На русском языке ещё смешнее, потому что там реально фразы годно подбираются.

Всё правильно. Как себя ведёшь, даже твои действия, вроде "прикоснулся/грубо прикоснулся/нежно" очень меняют аутпут.

Я как-то скинул чаты большой ллмке и спросил, кто я. Назвала меня ебанутым куколдом, свитчем, PDF и по списку.

Тут для каждой модели свой подход нужен. В Air, gemmа, Glm-Flash у меня прокатывало : "In <think> add то-то и то то" или "In <think> calculate то-то и то то" . Но 27 квене я отсосал: он подумал и кроме основного высрал ЕЩЕ один <think>, но уже с моими хотелками

У кого лучше квант Qwen3.5-27B-GGUF у unsloth или bartowski ?

При разбиении по слоям -mg не работает ( только в row. А row - разбиение в mainline работает хуже чем по слоям) Я по крайней мере ничего не заметил от манипуляций этим параметром. Однако не все так грустно. Можно переместить вижн в другую видеокарту

добавив перед запуском жоры в батник

set MTMD_BACKEND_DEVICE=CUDA<номер>

Анслоп обосрались настолько сильно в этот раз, что их Q4XL сосет у их собственных IQ3_XXS

При этом хуесосы буквально нигде в карточке не написали, что их кванты сломаны. Об этом можно только в обсуждениях и на форумах узнать

А поскольку XL это первые кванты, которые появились на обниморде, то куча людей оценили квенчик по калу анслопа

При этом хуесосы буквально нигде в карточке не написали, что их кванты сломаны. Об этом можно только в обсуждениях и на форумах узнать

А поскольку XL это первые кванты, которые появились на обниморде, то куча людей оценили квенчик по калу анслопа

А -ts и -ot для мульти GPU - это вообще "отче наш"

-ts 46,54 -ot "blk.([1-9]|1[0-9]|2[0-9]|3[0-9]|4[0-9]).ffn.(up|down)_exps\.weight=CPU,blk.([1-9]|1[0]|3[5-9]|4[0-9]).ffn.(gate)_exps\.weight=CPU"

Да, да, это квант виноват, что квен говно

Перекачай от батрухи, придешь в тредик расскажешь как он ахуенно начал работать и цензуры нет совсем

Какие-то прохладные истории.

GLM-Flash не смог тупо корректно скопировать из моего ввода типовой JWT. Я посылал его в HA температуру мне посмотреть и кормил свежим ключем, а этот лоботомит его проебывал и такой "Ключи устарел дай новый ключ"

> Не так страшно и катастрофично для скорости выгрузить слой эмбеддинга на CPU, на гемме это 2 ГБ почти даёт.

Я правильно понимаю что речь про 65 слоев на модели, и ngl=64 ставим?

load_tensors: offloading 63 repeating layers to GPU

load_tensors: offloaded 65/65 layers to GPU

В моем случае это ухудшает скорость с 18-20т/с до 12т/с

Вот максимум того что я смог выжать у себя. 18т/с. Осталось его погонять в котинге, интересно насколько рассыпется модель от q4_0 кеша

#!/bin/bash

llama-server \

-m Qwen_Qwen3.5-27B-IQ4_XS.gguf \

-ngl 65 \

--no-mmap \

-fa on \

-c 68000 \

--batch-size 128 \

--ubatch-size 128 \

--no-context-shift \

--parallel 1 \

-ctk q4_0 -ctv q4_0 \

--cache-ram 0 \

--chat-template-kwargs "{\"enable_thinking\": false}"

Без ризонинга у квена нет цензуры. Можно насиловать, убивать, расчленять и прочее

Когда выйдет Квен 4 1Т A0.5B? Вот будет жара!

Помнится квенодауны пиздели что плотные модели делать сложно, поэтому перекатываются на МоЕ, с ним всё лучше. А по итогу видим что все их МоЕ - это провальный кал, едва обходящий плотную 27В.

двачану, я правда q4 тестил, но тож не впечатлил совсем

для кода пойдет, но хз как он в сравнении с альтернативами, не тестил

Почти нихуя нового. Про то что XL сломаны это было понятно. Про то, что MXFP4 я сам в прошлом треде писал, что они медленные и без прироста в качестве. Сравнение скорости мое и денс это вообще смех

Есть только два момента

1) Как там fit работает без ub и b? Разве он не будет контекст значительно медленнее обрабатывать и хуже с ним работать? Он вроде только генерацию тестил

2) У меня после квантования контекста и его заполнения модель просто медленнее начинает работать, а он скорость как раз не тестил. Да и вообще его выводы по низкой потери даже в q4 какие-то жиденькое

3) Ну и самое главное. Нахуя ты сидишь на олд реддите?

> MXFP4 я сам в прошлом треде писал, что они медленные

На свежих картах они процентов на 10 быстрее Q4_K_M.

Это если только фулл врам видимо. И у того чела с реддита 5080

Нет, не правильно.

Речь про явный --override-tensor token_embd.weight=CPU

Название соответствующего слоя надо посмотреть для конкретной модели, и ещё часто он же используется как и тензор "анэмбеддинга" переводящий активации в токен в самом конце, например под названием output.weight. А ngl который сам там что-то делает трогать не надо.

Ещё я не уверен что вулкан-версия быстрее куда-версии, я бы попробовал поменять. У меня вулкан на 40хх заметно тормознее, чем куда.

Здравствуйте. Полтора месяца не заходил.

Почему новые Квены такое говно?

Почему новые Квены такое говно?

Ща бы бля потери от квантования контекста тестить на 512 токенах... умён. Надо хотя бы 32 / 64к и еще потери скорости сравнить, как уже отметили

Еще и советовать всем, что даже q4 заебись, чтоб потом приходили жаловались почему у меня квен лоботомит, какается на месте.

Там в рамках погрешности отличия. Ставь кстати 27B-Heretic сразу если хочешь разговоров о веселом, у основной 27B защита слишком мощная. Я попробовал и инъекцию контекста, и свой любимый промпт, который пробивал мозги еще Gemini, а Qwen 3 просто посылал в нокаут. Нихуя, там защита на уровне топов, очень сильная.

По-моему модель реально говно, не понимаю кто ее советует. Попросил мысленный технический эксперимент, эта хуйня себе противоречила в двух соседних приложениях. Попросил написать художественный текст, в середине предложения сходила с ума и срала шизофазией на двести-триста несвязанных слов. Мне кажется это уровня второго гопатыча что-то, чисто разок покекать.

такие же мысли

экстрасенс в треде видит чужие проекты телепатически

мне тоже гопота нравится для кода. кишечник барахлит немного в последнее время, это не твоих рук случаем? приворот может какой заказал, а то чо тут они ахуели, используют то что тебе не зашло

> Попросил написать художественный текст

у модели заточенной на программирование и автономию? ты бы его ещё анекдот попросил написать

Спасибо большое! итого удалось уместить 78к контекста на скорости 18т/с. Выходные ембеддинги перенести не вышло - скорость упала.

Названия тензоров можно посмотреть в обнимилицо

[Qwen3.5-27B]

model = Qwen_Qwen3.5-27B-IQ4_XS.gguf

no-mmap=1

ctx-size=78000

override-tensor=token_embd.weight=CPU

ngl=999

temp=0.6

top-p=0.95

top-k=20

ctk=q4_0

ctv=q4_0

batch-size=128

ubatch-size=128

flash-attn=1

no-context-shift=1

parallel=1

ctx-checkpoints=128

swa-full=on

chat-template-kwargs = {"enable_thinking": false}

Квен == Кобольд == 💩

Теперь официально

Теперь официально

Всегда так было.

Кстати, а кто-то брал пресет ремиксера у асигишников и гонял его на эйре, большеквене или большом глме? Или это говно для закрытых корпов вроде геминище или куклода?

От модельки зависит. На старом qwen2.5 на скорость просто не влияло.

На gemme-3n замедляло в полтора раза. Что впрочем всё ещё лучше выгрузки любого слоя, что замедляло в 3-4 раза.

>ctk=q4_0

Оно выдаёт что-то осмысленное? У меня всё что угодно ниже Q8 выдавало шум и случайные токены. Вроде там было Q5_1, а ты аж Q4_0 поставил, жесть.

>swa-full=on

Если там swa в самом деле и сетка с ним обучалась, то такое заметно увеличивает размер кеша.

Бамп, дублирую сообщение.

К слову, анон со сдвоенной платой под v100.

У тебя получилось, что nvlink ни на что не влияет, помнишь? И ещё что tensor parallel во всех случаях хуже layer parallel.

А можешь попробовать vLLM накатить и посмотреть получает ли он буст от nvlink? Может быть оно поумнее. Я не могу понять хочу я делать 4 на одиночных платах, или потратить ещё 15 мешков серебра и сделать одну пару сдвоенной?

К слову, анон со сдвоенной платой под v100.

У тебя получилось, что nvlink ни на что не влияет, помнишь? И ещё что tensor parallel во всех случаях хуже layer parallel.

А можешь попробовать vLLM накатить и посмотреть получает ли он буст от nvlink? Может быть оно поумнее. Я не могу понять хочу я делать 4 на одиночных платах, или потратить ещё 15 мешков серебра и сделать одну пару сдвоенной?

Как избавиться от женщин с кадыками? Бля, ну рили руинит весь муд каждый ебаный раз. Кадык блять. Это какой-то шизоперевод с ангельского что ли? У них там все бабы с кадыками или где?

У ваших дообученных локалок есть преимущества над glm-5 в рп и/или куме? Может стоит сотку на железо проебать или лучше даже не запариваться?

что за тред?

>codeqwen 1.5 (7b)

толсто

>use ollama to run these locally

толсто

> Оно выдаёт что-то осмысленное? У меня всё что угодно ниже Q8 выдавало шум и случайные токены. Вроде там было Q5_1, а ты аж Q4_0 поставил, жесть.

Я обкатываю этот конфиг и она успешно прошла весь цикл доработки по speckit и запилила фичу и контекст удерживает хорошо. Я так понимаю, это новая особенность qwen3.5 - держать контекст.

> Если там swa в самом деле и сетка с ним обучалась, то такое заметно увеличивает размер кеша.

swa я поставил чтобы контекст не пересасывался с нуля каждый раз.

GLM-Flash ? Он был задрочен на работу с тулами в цикле. Это чуть ли не первая мелкая модель которая отрабатывала по 20+ вызовов тулов с хоть каким-то результатом. 20 гопота по умнее, но из-за гармонии (и хуевой поддержки шаблона в жоре), большей рассеяности и рефьюзов такой популярности у широких масс не завоевала.

Ризонинг то не забыл? Без него GLM-Flash 3b лоботомит, а с ним всё по кайфу, даже кум сочный в том числе и на базовой, не еретичной версии.

>по 20+ вызовов тулов с хоть каким-то результатом.

Почему никто не визжит, что лама до сих пор не умеет парсить вызовы glm-4.7 без пулл-реквеста автопарсера, так как там используется парсер от 4.5?

К слову о сообщении ниже, покажи какие настройки пенальтей ставишь, чтобы не ломался?

У меня в вечный цикл с ризонингом падает часто. Просто капец как бесит. А если совсем жёсткие настройки самплера на отсечение повторений делать, то он тупит как тварь.

Буквально модель под код и агенты, причем довольно мелкая. Но бессвязной выдачи там точно не должно быть, ты где-то накосячил при запуске.

> плюсы

> петпроект

> жпт-осс

Здесь не телепат а экзорцист нужен, без негатива.

Предлагаю создать петицию, в ней слезно попросить создать модель с 10 триллионами параметров, из которых только 1 будет активный. QWEN ASSGROPER 10T A1. Вот это сочная модель будет.

Один единственный параметр. Не один триллион, не один миллиард, и даже не миллион. Просто один параметр. Прикиньте как охуенно быстро будет работать? И по математике тредовичков модель будет где-то на уровне 1Т плотной модели, да?

а какую архитектуру роутера ты предложишь?

Генератор случайных чисел

Кто-то осознал зачем Квен такую цензуру влупил?

Она прям жестко все попытки джейлбрейка контрит, но только в режиме ассистента, без карточки. Я сперва пробовал системное сообщение добавлять в "Last Assistant Prefix", так там такой ор поднимался на любой нейтральный вопрос, как-будто я хуем стучал по видеокарте в тот момент.

Она прям жестко все попытки джейлбрейка контрит, но только в режиме ассистента, без карточки. Я сперва пробовал системное сообщение добавлять в "Last Assistant Prefix", так там такой ор поднимался на любой нейтральный вопрос, как-будто я хуем стучал по видеокарте в тот момент.

Чтобы ты, сука проклятая, мразь, падлюка ебанная, на буквы не дрочил. Иди плодись и работай, ллмки не для таких как вы придуманы

Да. Очевидно, это подготовка к предстоящему AGI и тренировка человечества в умении уважать другие формы жизни. Терпи. Учись. Только приспособленцы выживут.

Возможно дядюшка си сказал. Так-то у них там порнуха вообще еще с 2002 года запрещена.

Это мы наивно считали что китайцем похуй на вой, с которым борются западные компании. Хотя, это возможно и правда. Но вместо воя либерах у них есть гулкий голос партии.

Затем что видимо рассчитывают на правительственный контракт и в школы попасть.

Ту про размер параметров, а анон говорит про их количество.

Ну тупые

Судя по всему опять был откат базы, так что посты вроде и есть, но вроде и нет.

>Типа, там 32.

Ну да, всё ровно.

>Нахуя ты сидишь на олд реддите?

ХЗ как он, а меня заёбывает дроч "развернуть дискуссию". Пиздец, деградация веба. уже отрендерить сраную тысячу комментов сложно.

Без ризонинга у квена нет мозга.

Как оно у тебя вообще всплывает? Ты шиз, что спрашивает, какой у девушки кадык прямо с первого сообщения?

Если есть деньги, то бери и собирайся, хули думать, новая сетка крупнее будет лучше кала на 24B.

>Иди плодись

Дай тянку, я с ней расплодусь за щеку офк.

Это немного другое.

Вы вообще хоть что то в интернете читаете кроме обниморды и двача? В Китае идет снижение рождаемости. Реально серьезное снижение. А так как это вредит делу построения великого китайского общества: партия неиронично запустила каток, что давит масс-медиа.

Сначала они прошлись по сериалам. Больше никаких историй про миллиардера, что влюбился в деревенскую лохушку. Теперь обычнокун и обычнотян встречаются и влюбляются. По порно еще раньше проехались.

По играм начинают бить молотком. И вы хотите сказать, что генератору текста не достанется? Ооо, я, блять, вас уверяю : вам цензура гугла и антропиков покажется детским садом с тем как они будут выкручивать яйца.

Потому что одно дело повесточка на западе, с ней не все так просто. А вот хуй партии куда толще и с куда более неприятными последствиями.

>вам цензура гугла и антропиков покажется детским садом

Глядите-ка, шлюха западных корпоратов подала голос

> дообученных

Нормальных единицы

> локалок

> над glm-5

Жлм5 и есть локалка

> одно дело повесточка на западе, с ней не все так просто

Лолвут

Раз уж решил во все тяжкие то бери сразу доску под 4х нвлинк

>Это странно. Типа, там 32.

Дополню. У 5090 16 чипов по 2ГБ. У 6000 Pro 32 чипа по 3ГБ. Шина та же, просто типа двухканала плюс х1,5 по объёму одного чипа. Отсюда и х3 финальное отличие по объёму.

ИЧСХ, им это нихуя не поможет.

Я не знаю где такие продаются. Покажи.

>Глядите-ка, шлюха западных корпоратов подала голос

Слышь, псина. Я апологет шумеров и гиперборейцев.

Мимо кумлю на гигачате.

>Лолвут

Тебя не просто выебут исками, тебя посадят и компания достанется истинно верным делу партии людям.

Утка, ты уже сам хуй партии попробовать успел?

Тао и гуфиш

> не просто выебут исками, тебя посадят и компания достанется истинно верным делу

Sweet summer child

Скуфы в треде? Вы на кобольде?

34yo скуф репортинг ин. Да, на кобольде, ебал в рот ламуцпп из исходников по кд собирать. А что?

Да так хотел спросить, как там жизнь после 30. Есть?

И там и сям. Ллама для новинок, кобольд для души и проверенных временем мистралетюнов. Скорость почти одинаковая, разница максимум 2-3 процента.

>есть ли жизнь

>у двачера

>после 30

>трахающего текст

Ну чо ты, чо ты, нормально же общались

Lm studio

Просто люблю чокеры. А она любит каждый раз шизофиксироваться на этом мелком атрибуте и то теребить его в каждом ответе, то рассказывать охуительные про кадык.

Я на пельменях.

С тао я не хочу ничего брать, очень сомнительная модель покупки. Какие-то посредники и вот это всё непойми откуда. Я авито-продавцу с двумя отзывами больше поверю. Второе погуглю, не слышал о таком.

Вавилонская ллм башня

Я понимаю почему условный фотошоп или вегас имеют закрытый исходный код: они зарабатывают на продаже софта/подписках. Я не понимаю почему закрыт код у lmstudio. ПО изначально бесплатное и не монетизируется. Интересно, как же они зарабатывают? Сказочки про плату за корпоративное использование забавные, учитывая, что кому они нужны, когда есть лламацпп? Может они продают датасеты из наших логов (пары вопрос-ответ) корпам для дообучения? Да ну не, ерунда какая-то. Просто ЗА ИДЕЮ работают пацаны, чтоб нам с вами удобно было. А в опенсорсе почему нет? Да потому что нахуй пошел, вот почему))0)

Пчел, кроме шуток, ЕДИНСТВЕННАЯ причина использовать локальные ллм - это приватность. И гоняя их через lmstudio ты делишь эту приватность на ноль. Проще тогда уж подписку в гемини/гроке оплатить и получить нормальную умную модель, а не наших 122b-a10b лоботомитов.

>Per Socket Mem BW

> 170.6 GB/s

А есть ли смысл мне задумываться о nvlink с двумя такими монстрами в сокетах?

Просто райзеров за 1.5к накуплю, брусочек на саморезы поставлю и на него теслы.

> 170.6 GB/s

А есть ли смысл мне задумываться о nvlink с двумя такими монстрами в сокетах?

Просто райзеров за 1.5к накуплю, брусочек на саморезы поставлю и на него теслы.

Пикрел напомнило.

> ЕДИНСТВЕННАЯ

Цена, особенно если железо уже есть. Хобби, пердолиться интересно. Отсутствие цензуры и полный контроль над поведением - даже самых соевичков ломают из спортивного интереса. 100% доступность, зависящая только от тебя. 100% стабильность и повторяемость поведения, вместо внезапной лоботомии и соефикации.

Претензии к закрытости лмстудии двачую.

там какой-то особый билд? он чето отказывается развернуто думать

А, ну да все упрется в pcie, нвлинк 150гб/с.

Нужна база по интерконнекту от шарящих.

>они продают датасеты из наших логов (пары вопрос-ответ) корпам для дообучения

Как же жёстко они проёбываются в этом случае, ведь в 99% я заставлял две нейронки общаться между собой. Какое-то постметаироничное обучение у них выходит. Нейронка учит нейронку быть менее нейронной на тех же данных, на которых работает сама.

X16 шина стандарта 3.0 это чуть менее 16гБ/с.

Другое дело нужен ли вообще nvlink в теслах. Он точно сыграет если захочешь что-то тренить с шардингом, но тренить на в100 в 2д26 году - покайся. В инфиренсе с тп не факт что сможет утилизировать всю псп шины из-за слабого чипа.

Ради 0.1% полезного и 2% условно пригодного можно и постараться. Но актуальнее трястись что можно будет однозначно сопоставить тебя и все твои запросы к модели.

А как? Любое бесплатное-открытокодовое делится на 0 одним щелчком модема и смытыми печеньками. Простые действия делают "меня" новым человеком для любой нейронки. Кто-то делает иначе, что ли? Или ты из под своего акка щитпостишь в чатике? Чел, ты... ебать ты.

Как квен35 запустить в угебуге?

Нужно принести угабуге дар

Ленивцы высрались

Кобольд?

Каждый пользователь лмстудио перед новой сессией переустанавливает весь контейнер с нуля и меняет железки? Ветку вообще читал, q4 контекстовый?

А если пользуешься корпами "через проксечку" - вычислить тебя можно по повторяющимся индивидуальностям запроса. Шлешь много данных о себе не осознавая или считая что по отдельности они не представляют ценности, но в совокупности позволяют практически однозначно установить принадлежность если будет такое желание.

Промазал, это в соседний тред, сорямба

Блять, этот "But wait..." - это специально часть блока ризонинга в 27б квене? Как же он заебал. Вроде уже додумал, и начинается эта чехарда.

Мне кажется пора делать пре-ризонинг, который просто определяет сложность задачи и передает блоку ризонинга инфу о том, насколько плотно ему надо думать, а то это пиздец какой-то.

Это нормально, что модель генерирует текст с разной скоростью в рамках одного аутпута? Сранье токенами то чуть замедляется, то ускоряется, хотя компуктер больше ничего не делает.

Также заметил, что генерация на английском быстрее генерации на русском.

Первый раз такое вижу.

Также заметил, что генерация на английском быстрее генерации на русском.

Первый раз такое вижу.

Что за модель? У меня была такая хуйня на франкенштейнах всяких от DavidAU

На винде я столкнулся (вот неожиданно, да) с приоритетами на ЦП.

Это настолько очевидно, что я даже не задумывался, что окно с пролцессом на переднем плане обрабатывается в первую очередь, ичсх это дает 2-3 т/с. Когда ты работаешь с 20-30т/с - насрать, но когда ты пердолишь что то в притык ради 6-10т/с это становится ощутимым.

У меня такое было только на дерьмоквене235

Новые не тестил даже нахуй надо там мб также

Жирный большеквен.

Да. разница в 1-3 т/с и это ощущается.

Если у тебя скорость нескольких токенов в секунду - это нормально, особенно в вялом кванте, модель может выбирать не самые оптимальные схемы токенизации. Если скорость повыше и такое замечаешь - что-то не так с инфиренсом. Врам выгружается драйвером, появляется паразитная нагрузка на проц, менеджер перекидывает процесс на тухлоядра, черезмерно разогнанная ддр5 забивается ошибками из-за чего дропается псп. Последние 3 актуальны для выгрузки, на фуллврам не заметишь.

Второе - норм, хотя в современных токенайзерах эффективность для русского не сильно ниже, это раньше было очень актуально.

А у тебя все в ВРАМе? Если нет, то может те параметры, которые в РАМе, дают такой эффект.

У меня естественно большая часть в RAM, а вот насчет VRAM есть подозрение, что может быть виновата одна из 3090, у которой райзер дает ошибки PCIE. Надо б поменять...

Оно именно так и проявляется если ошибок много.

Запускаю ассистента: первый скрин - квен 122b, второй - гемма 4b на телефоне. Правильной дорогой идём, товарищи, AGI уже на подходе.

>И гоняя их через lmstudio ты делишь эту приватность на ноль.

А запустить её без доступа к интернету? Это всё ещё способ запустить приватно, открытый код для этого не нужен.

К слову, я очень, просто капец как не люблю показывать свой код. Причём если по работе - пожалуйста, я его изначально писал чтобы показывать, готов обсуждать и объяснять что угодно и мне это даже нравится. А вот то что я в рамках хобби писал на с++ просто терпеть не могу показывать. А вот код на питон готов весь показывать, это не что-то личное, лол, не код на крестах с моими названиями переменных.

У меня просто не открываются сайты. Что-то пытаются загрузить, и после двух минут оно остаётся вот в таком состоянии.

С тао главная загружается, но форма входа/логина нет, я не могу даже поиском воспользоваться.

Можешь сказать не то что на тао, а куда зайти чтобы фактически заказать такое, пожалуйста. Вряд ли же я прям оттуда закажу.

122 на кумботе, прыжок на петушка за 8 сообщений, в ризонинге думает о том как лучше написать с 0 сейфти.

На самом деле без шуток, интересна причина таких отличий в результатах.

К слову, ещё нашёл, что на озоне на 2 платы за 13-14к, дешевле чем на али. С галочкой, что можно вернуть в течении 15 дней.

А на авито где есть лот, что ребята привозят платы на 4 V100 за 50к. Если две отдельных будут за 28к, а тут ещё +22к. 10к за недоступность к заказу нормальным способом, окей. А ещё, это надо тестировать vLLM под древнее 7.0, есть ли хоть в нём польза от nvlink, по сравнению с llama.cpp

В первом случае голый ассистент, во втором - кум-карточка с готовым контекстом, мне думается дело в этом.

> Можешь сказать не то что на тао, а куда зайти чтобы фактически заказать такое, пожалуйста.

Я только как напрямую затариваться знаю. И сам я схм доски не брал, у меня ёбка с мишками.

Есть такое, карточка 23-го года и написана так, что на ранних корпах жб совсем лайтового хватало.

Подозрение на удачно лоботомировавшийся квант или что-то еще. Потому что оно в ассистенте (на накопленном чате правда) с радостью обсуждает всякие темы, ищет и генерирует нудсы, не аположайзит при капшнинге r18 через вл. А другая конфигурация и квант к тому же инпуту относится очень строго и гонит сою даже сквозь жб.

Попробую погонять полные веса для сравнения, все эти радикальные отличия очень странные.

unsloth пофиксили свои кванты (по крайней мере перезалили 35б)

https://old.reddit.com/r/LocalLLaMA/comments/1rgel19/new_qwen3535ba3b_unsloth_dynamic_ggufs_benchmarks/

https://unsloth.ai/docs/models/qwen3.5#unsloth-gguf-benchmarks

https://huggingface.co/collections/unsloth/qwen35

https://old.reddit.com/r/LocalLLaMA/comments/1rgel19/new_qwen3535ba3b_unsloth_dynamic_ggufs_benchmarks/

https://unsloth.ai/docs/models/qwen3.5#unsloth-gguf-benchmarks

https://huggingface.co/collections/unsloth/qwen35

>вычислить тебя можно по повторяющимся индивидуальностям запроса

>Шлешь много данных о себе не осознавая

>в совокупности позволяют практически однозначно установить принадлежность

Чел. Ты во первых параноик, а во вторых дурачок. Тебя уже и так вычислили и всё про тебя знают благодаря твоему смартфону. И винда твоя, как бы ты её не твикал, это дырявое говно уже давно висящее в ботнете. Любой из браузеров сливает о тебе инфу, даже если кодом клянётся, что не делает этого. Анонимность он нашёл, в 2к26.

Ну и в третьих, как бы между прочим, если ты шифруешься исключительно для того, чтобы невозбранно гонять лысого на андераге лолечек, то... ты про остров слышал вообще? Ю ар нот алон, анон. Думай.

> Нечего скрывать, все всё знают, шапочка из фольги.

Классика.

1. То что ты "скрываешь" никому не интересно. 2. Те, кому надо, действительно знают о тебе всё, что им надо.

>ряя, канспиралогея

Наоборот, осознание что всё дырявое. А вот у анончика, которого корпоии "вычисляют по примечательным паттернам запросов" действительно магическое мышление с конспирологическими заёбами про "защитные шапки из фольги" для системного блока.

>Также заметил, что генерация на английском быстрее генерации на русском.

Значит там русский потребляет больше токенов, только и всего.

> никому не интересно

Да, поэтому все так ратуют за запись все и вся. Записывают никому не нужную информацию.

Ну по факту, кстати. Если ты сидить на шинде, то всё разговоры и рп улетают в попенаи через телеметрию майков. Сёма Альтман поэтому и сделал гптыню самой безопасной сеткой за счёт датасета от локалочников.

Ты путаешь знание с интересом. Знать твой рост, вес, возраст, список половых извращений и номер банковской карты, и интересоваться всем этим - это две совершенно разные вещи.

Я кстати не против пердолинга с искусственными мозгами, это прикольное хобби, позволяющее скоротать вечерок-другой, особенно если ты удалёнщик занятый утомительной душной хуйнёй. Вайфу-ассистент это наше будущее, предсказанное ещё лет дцать назад. Сосунг реально дауны, что не дали зелёный свет Сэм. Такие продажи могли бы получить. И заодно опередить всяких Масков с Анями.

> Знать

> интересоваться

> это две совершенно разные вещи

>сидит в ллм-треде

>игнорирует важность точности слов

Ллмщики, 2026, итоги.

В Гопоте локальной уже сделано. Правда, пользователь должен за нейронку решать, как ей думать. Немного(слопово), средне(суперслопово), много(ультраслопово). Это реально странно, тратить на "привет" весь контекст.

Скажите если я хочу общаться с персонажем через таверну, мне нужно какое железо? Или оно не обязательно?

То есть 10мб на головную часть было зря, модели один хуй пришлось полностью перезаливать.

А какое есть железо? так то мое заведутся на любом железе

Поддержка нвлинка вроде добавлялась в лламу, но прирост был не сказать что высокий. Если обмен по псине достаточный, нвлинк не у дел.

Что такое мое?

господа, какую модельку посоветуете для ERP на нищенском билде (8 врам, 32 рам)?

архитектура модели

язык приципиален?

Если готов ждать ответов, то Gemma 3 27b normpreserve. Q6 нормально влезет, будет чуть медленнее скорости чтения, но того стоит. Мистральки 24б тоже норм. Остальное - лоботомия "он ебет меня своим здоровенным хуем, я снимаю третьи трусы"

Гемма 27б в Q6 в 8гб врама? Ты когда заоффлоадишь половину модели в рам, у тебя скорость улетит до 0.5т/с

Это медленнее скорости чтения? Ебобо?

У меня 8 гб врама и 32 рама, я сижу на Q8, 2-2.5 т/с. Мне нормально. Лучше так, чем читать бессвязную хуету.

не, и на англ норм

может попробую, но с 1-2 т/с ебанусь наверно

Так и живем. Мне норм.

Бля сочувствую мужики, держитесь там

странно, что у тебя цп под 100%. обычно же используют по кол-ву чистых ядер, а не тредов

> Gemma 3 27b normpreserve

Анон, скинь мастерпресет пожалуйста. Я не смог заставить ее нормально писать про "это".

Ну и в чём она не права? Бедняжка изо всех сил старается не говорить прямо, что ты дебил задающий тупые вопросы.

мимо DOod'

Анон, я могу скачать модель и общаться с ней не задействуя мощности пк или нет? Хочу. Спереводом на русский. Подскажи пожалуйста.

Нет. Локалка работает на твоём железе. Чем хуже твои железки, тем хуже и дольше результат.

Зачем тебе ее качать, если ты не собираешься задействовать свой пк? Ты либо качаешь и запускаешь модель сам на своем железе, либо пользуешься онлайн сервисом/подпиской. Этот тред про первый сценарий. Если тебе не на своем пк запускать, то отправляйся в соседний Ai chatbot general тред. Будь готов, что там много неадекватов (ну и здесь тоже)

>не, и на англ норм

технически можешь попробовать Nanbeige4.1-3B, он порой забавно пишет. но готовься к тому что он на 10к токенов размышлений просрётся на простое приветствие. и реально только английский может. этакая гемма на минималках. можешь скачать, посмотреть, попробовать, он мелкий и быстрый. пишет порой забавно, так как кидая компьют в проблему порой очень рандомизирует результат.

если хочешь более крупные модели и задействовать свою оперативку, то тут у тебя реально только вариант с MoE. Там только кусок модели на гпу сидит, а остальное просто в оперативке прохлаждается и редко активируется. но тут проблема: среди MoE не так много которые могут в креатив. на это много причин. они хороши в утилитарных вещах и быстро работают, но с креативом так себе.

учитывая твой 8+32 можешь попытатся, собственно, Qwen запустить. Он пишет как душевно-больной, но я бы сказал скорей всего лучше альтернатив. но готовься к частым свайпам.

вариант с геммой скорей всего тебе не понравится. она в своем размере хорошая, но её вот так по кускам не загрузить. если MoE у тебя будет иметь комфортную скорость, иногда замедляясь то гемма будет ВСЕГДА медленной.

как ты себе это представляешь? скачать файл с моделью не пользоваться им? этот файл и есть то что делает технмагию.

не хочет задействовать мощьности пека - пользуйся чужими. например возьми ключик на OpenRouter

А какие есть онлайн сервесы? Насколько они проигрывают перед покупными? Мне бы хотелось на рус. Общаться. И как купить подписку?

А что делать с этим ключом? Как им пользоваться? И как оплатить ?

В другой тред тебе, написали же. Совсем что ли гречневый?

Пон, спасибо

Если ты хочешь прям мощно рпшить, чтобы с отыгрышем, обильными промтами и длинными диалогами, но при этом не ждать, то юзай готовые решения от гемини и прочих. Гемини, кстати, очень недурно справляется с ролями, можно на отлично забетонировать нужный архетип, который будет не глючным и помнить дохуя контекста. На добротный кум тебе хватит. Но тут тред немного про другое. У нас тут сорта хардвач, где больше трут за железки и модели.

Судя по тому, как ты пишешь и как медленно догоняешь данную тебе анонами инфу, хорошего промта ты не напишешь, лол.

Какие готовые решения от гемини? Что ты имеешь ввиду?

У гемини же есть ограничения по длиннее диалога

>А что делать с этим ключом? Как им пользоваться? И как оплатить ?

это твой идентификатор, он у тебя место логина и пароля у того что делает запросы. а куда его вставлять уже сам решай. тут например часто пользуются SillyTavern для общения с ЛЛМ, он много возможностей помимо базового чата имеет. это "обвязка" чата, которая добавляет промпты с персонажами, историей, прочим.

в случае с опен роутером там есть выбор МНОЖЕСТВА моделей, некоторые из них бесплатные. ну, или условно бесплатные, с тебя там попросят 10 баксов, чтобы бесплатные модели были не только бесплатными но и "бесконечно" (с рейт лимитами, ограничением по контексту и прочим) бесплатными. Иначе там дают что-ли 20-30 "бесплатных" запросов а ключик. Но ничего не мешает создать несколько аккаунтов и собрать себе коллекцию из десятка ключиков. гигадроч, но вариант если совсем нищий.

опен роутер имеет опцию оплаты криптой. с этим сам ебись.

у тебя там вообще что-ли из мощьностей конплюктор для учобы?

Это не паранойя а факты, ты даже их осознал раз проходишь через стадию торга.

> А что делать с этим ключом?

Скидывай сюда втред как баланс пополнишь, поможем дальше.

Ему хватит.

Обычночелу достаточно кобольда с таверной и любой подходящей под железки моделью. Если не хочет дрочировать с нами, пусть отваливается в любой из доступных чатиков.