Срочно дайте база треда!!!

Вы просили я доставил

Всем тредом ждем диписик 4, камбэка гугла, кохерелабс, мягких француских мистралебулочек и анона99

Квены обосрались и их разрабы разбежались

Кобольд это состояние души

У итт тредовичков в среднем плохое следование инструкциям и квантованный контекст

Хех, после работы на большим рассказом - Эрой Тьмы ( Era Noctis ), как то уже РП со случайными карточками не вставляет - я их начинаю рассматривать скорее с позиции возможных NPC / PC / сайд / а то и мейн квестов для сеттинга.

Как же хочется плотненькую 70B... С худеньким контекстом, внимательную, послушную инструкциям, не очень цензурированную. Изолировался бы с ней от социума и путешествовал бы по воображаемым мирам, проживал сотни разных жизней, гладил, чесал за ушком, любил бы всем сердцем и няшил под хвостик...

Так и что мешает?

Не тренируют теперь таких с новыми датасетами и оптимизациями архитектуры.

>Всем тредом ждем диписик 4

Ждать должны асиговцы. Эта хуйня будет монструозных размеров и никто в треде ее не запустит

>камбэка гугла

Хотелось бы верить, но верится с трудом. Если они вообще что-то выпустят, то там будет вжарена соя так сильно, что новые квены покажутся базовичками

>кохерелабс

Что ты от них ждешь? И почему?

>мягких француских мистралебулочек

Это да, но как-то тревожно за них

>анона99

Нахуй

>Квены обосрались

Не согласен, они хороши. Жаль только еретиков приходится юзать из-за сои

>разрабы разбежались

Не, не разбежались. По слухам их выкинули нахуй из-за каких-то метрик и наняли кого-то из гемини. Т.е. сои будет еще больше

>Кобольд это состояние души

Скорее интеллекта

>У итт тредовичков в среднем плохое следование инструкциям и квантованный контекст

Да. Также не стоит забывать, что часть треда это буквально боты, причем там довольно мелкая ллм

Лучше народные моэ, на ~100b, но поплотнее... Скажем 120b-a22b. И побольше таких, побольше, чтобы выбор был.

>Ждать должны асиговцы. Эта хуйня будет монструозных размеров и никто в треде ее не запустит

Ну я запущу, если как предполагается по слухам 400б

>Если они вообще что-то выпустят, то там будет вжарена соя так сильно, что новые квены покажутся базовичками

Похуй, сфв рпшечку отыгрывать самое то

>Что ты от них ждешь? И почему?

У них крутые 32-35б плотные модели и в целом неплохой первый Коммандер 123б

>Нахуй

Не, не нахуй, а сюда, в тредик, к нам

>они хороши. Жаль только еретиков приходится юзать из-за сои

"они хороши но придодится юзать лобомитов yes-man"

>По слухам их выкинули нахуй из-за каких-то метрик и наняли кого-то из гемини

Та какая разница

>Скорее интеллекта

У тебя какое состояние интеллекта?

>Также не стоит забывать, что часть треда это буквально боты, причем там довольно мелкая ллм

О том и речь

Альтернативы еретикам как не было так и нет. Мистраля глупая и пишет глупости. Глупая-глупая дырочка!

https://www.36kr.com/p/3708425301749891

Квену пизда по ходу, ключевой состав ливнул из алибабы хз почему

Квену пизда по ходу, ключевой состав ливнул из алибабы хз почему

>Глупая-глупая дырочка

Как же тесен двач...

Пузырь начал схлопываться. Цените то, что у нас есть. Больше ничего не будет. Мы все умрем.

>Мы все умрем

Но напоследок покумим.

>по слухам 400б

Ага, мечтай. Будет в лучшем случае также, но я и триллиону не удивлюсь

>"они хороши но придодится юзать лобомитов yes-man"

Либо так

>Похуй, сфв рпшечку отыгрывать самое то

Либо уныло вот так

В следующем рп сделаю себе футурпанк. И киберголубя. Хочу наплечного киберголубя, чтоб давал сводку по погоде и стрелял лазером из глаз.

Сразу не подыхайте, glm-5-flash выпустите соответственно на 60B-A6B.

Ну и ещё 4.7V и в идеале 5V на 200B.

И свои H100 продайте за 10% цены, прежде чем сдохнуть.

Либо юзать нормальные модельки вроде glm, которые могут во всё и не тупые

Короче у китайцев слухи ходят что квен тупо каннибализировал остальные их продукты принося только репутацию но не бабло, а ГПУ-то не так много как у альтманов с мусками, потому и решили пидорнуть. Надеюсь челиксы где-нибудь запустят новую хуйню, коллектив хороший.

>Надеюсь челиксы где-нибудь запустят новую хуйню, коллектив хороший.

Ну это бабло надо искать, а для этого нужна какая-то прорывная идея, чтобы инвесторы поверили. А они же просто технари.

Если они к дипсику присоединятся, мне кажется имба будет. Они вроде как тоже за попенсорс топят (или раньше топили по крайней мере). И они с самого начала бахнули, а потом тормозить стали, явно технарей им не хватает.

Скрин из статьи. Квену реально пизда. Причем они реально что-то делали и развивали, а их модели были хороши. Мб не для рп, но как ассисты были хороши. Но кабан кабанычу опенсорс насрал в штаны

>ГПУ-то не так много

Да, но при этом в статье пишут, что алибаба продает в ущерб своей команды свои мощности другим китайским компаниям для обучения их ллм, т.е. буквально откармливают конкурентов. Жертвуют своей долгосрочной прибылью и будущем ради краткосрочных доходов

>Квену пизда по ходу

О ужас, китаец удалит файл с моего компьютера!

>футурпанк

Прочитал как футапанк, много думал.

>а для этого нужна какая-то прорывная идея, чтобы инвесторы поверили

Так достаточно AI в названии, чтобы привлечь миллиард-другой.

>алибаба продает в ущерб своей команды свои мощности другим китайским компаниям для обучения их ллм

Похуй, скоро все мощности отберёт Си для обучения мега военной модели. В США Трамп сделает так же. Короче овари да, но не по тем причинам, что тут любят думать.

>Квену реально пизда

Население Китая 1,5 млрд человек. Думаю найдут кем парочку ушедших пиздоглазых заменить, не велика проблема.

>О ужас, китаец удалит файл с моего компьютера!

Не удалит, но скорее всего больше не будет загружать новые модели или будет загружать значительно меньше. Почти как мета. Никто не удалит ламу 3 у тебя с компа, но ламу 5 ты не увидишь а ламы 4 никогда не существовало, это был псиоп

Будут форки, будут тюны, не похуй ли. Свято место пусто не бывает.

Похуй на говнотюны. Текущих моделей вполне достаточно, хочешь большего, есть модели покрупнее, успевай только риги собирать. Даже если ГЛМ5 окажется последней моделью, я ни капли не расстроюсь.

А тем временем анслопы очень медленно втихаря заменяют гуфы у Qwen 122, буквально по одному в пару часов. И эти суки так и не повесили никакой плашки, что их кванты сломаны и нужно ждать исправлений. Мразоты ебанные. Хорошо, что есть поляк и скриптомрадер

> беседа

Не, может быть в другой раз если только там не настроена интеграция с правильным ассистентом

А министраль умеет быть агентом?

> они хороши

Хороши. Только где вы столь интенсивную сою находите, и вообще про какую именно модельку речь? И насколько еретики вообще сохранили исходный разум?

> монструозных размеров и никто в треде ее не запустит

Подержи мое пиво.

Плохо если это сильно скажется на новых версиях, F.

>their results were inferior to the small models cleverly distilled by MiniMax, despite Qwen’s total burn rate (costs) being more than 10x higher.

Вот и нашелся источник сои и ревьюзов.

Отсюда. https://www.reddit.com/r/Qwen_AI/comments/1rkmdry/junyang_lin_leaves_qwen_takeaways_from_todays/

Дипсику не хватает технарей?? Это литературно очкастые HFT дрочеры железячники вперемешку с машобучем, которые привыкли наносекунды считать. Они бахнули не потому что модель у них была хорошая, а потому что там где смузихлёбы калифорнийские тилибонькали питон, эти ахуевшие долбили угольные шахты с кёрнелами на PTX, реверсили ГПУ фаззингом, ища баги в инструкциях, и писали файловые системы с нуля. Они технических решений высрали что внукам хватит.

А вот алибабашная тима им конечно пригодилась бы.

>футапанк

Соблазнительно, но нет. Я всё же рпшу для погружения и эталонной прокрастинации, а не чтобы лишь покумить. Давно кстати не играл во всякое фентези, как то оно опостылело в моменте. А теперь даже хочется погонять по лесами эльфиечек.

>Qwen isn't just a side project for the base model team anymore—it’s a Group-wide mission.

Квен навалил квенослопа про квен.

> small models cleverly distilled by MiniMax

Что за модельки такие?

>интеграция

чиво?

Подбил BOM, в некоторых местах конечно перезаложился, но больше не меньше ведь.

Много или мало 165к за этот сетап? - хз

Чего тут ноют про сою с квенами без лоботомирования? Не, я согласен, что с ризонингом там пиздец просто в плане ERP, но без него еби хоть во все дыры без лоботомии. С ризонингом нужно уже подрезать мозги.

Единственный реальный недостаток — это датасет. Я вот прям чувствую этот душный биас. Ствол. Лоно. Длина. Пик. Сокровенное место. Где мои ДА ДА ДА ЕБИ МЕНЯ ТРАХАЙ МОЮ УЗКУЮ ДЫРКУ МОЮ БЛЯДСКУЮ ПИЗДУ ЗАДУШИ МЕНЯ ЗАСТАВЬ МЕНЯ ЗАБЕРЕМЕНЕТЬ СВОИМ ДЕТСКИМ ТЕСТОМ Я КОНЧАЮ Я КОНЧАЮ АААААААААААААААА.

Вот без этого плохо, это абсолютно не база. Воняет корпами. Такой вот более "нейтральный" биас. Но если у корпов датасет неебический и их можно двумя предложениями заставить так писать и НЕ ПЕРЕБАРЩИВАТЬ ТАМ, ГДЕ НЕ НАДО, то с квеном тьижыло. Тьиажыло.

Единственный реальный недостаток — это датасет. Я вот прям чувствую этот душный биас. Ствол. Лоно. Длина. Пик. Сокровенное место. Где мои ДА ДА ДА ЕБИ МЕНЯ ТРАХАЙ МОЮ УЗКУЮ ДЫРКУ МОЮ БЛЯДСКУЮ ПИЗДУ ЗАДУШИ МЕНЯ ЗАСТАВЬ МЕНЯ ЗАБЕРЕМЕНЕТЬ СВОИМ ДЕТСКИМ ТЕСТОМ Я КОНЧАЮ Я КОНЧАЮ АААААААААААААААА.

Вот без этого плохо, это абсолютно не база. Воняет корпами. Такой вот более "нейтральный" биас. Но если у корпов датасет неебический и их можно двумя предложениями заставить так писать и НЕ ПЕРЕБАРЩИВАТЬ ТАМ, ГДЕ НЕ НАДО, то с квеном тьижыло. Тьиажыло.

> Не, я согласен, что с ризонингом там пиздец просто в плане ERP, но без него еби хоть во все дыры без лоботомии.

Все так. Более того, если чат не пустой и там что-то есть, то и с ризонингом оно безотказное. Даже на 300-летних.

> Где мои

На инглише оно именно так и делает, иногда даже переигрывает. Хорошо еще что слушается пожеланий по стилю и характеру повествования. На русском все так плохо там?

Помоему смысла в прогретых тютюрях больше кроме пункта энергопотребления.

>16channels

8+8, нет?

А вообще есть ли смысл собирать такую башню чтобы погонять какой Kimi? Ну или что там у тебя влезет в хотя бы каком-нибудь кванте.

>ЕБИ

>ТРАХАЙ

>УЗКУЮ ДЫРКУ

>БЛЯДСКУЮ ПИЗДУ

>ЗАДУШИ МЕНЯ

>ЗАСТАВЬ МЕНЯ ЗАБЕРЕМЕНЕТЬ

>КОНЧАЮ

Имагин ебало того, кто будет засовывать в модельку всё вот это. На англюсике это уже и так есть. Трудности хорнивода.

а кто-нибудь пытался использовать тини айя локально?

165к за б/у говно с уже плохой поддержкой. Примерно в сопоставимую сумму выйдет, к примеру, мини-пк на 395-м кукурузене со 128 гб шаред мемори, только новый.

На русском я не проверял, только на лмарене, но там были тесты базовые: стихи, короткие истории, а не кумерские. Ну и там, ясное дело, не лоботомиты 4-битные крутятся, а хотя бы 8-битные. Это на русик чрезвычайно сильно влияет обычно на маленьких моделях.

К слову, квен 27б жёстко отсосал гемме, прям вообще без вариантов, ну, в русском.

На английском уже 50/50 — есть свои плюсы и минусы (тут я уже говорю про 4 бита). На мой взгляд, именно качество текста у геммы и на английском намного лучше, если речь не о куме, но требует более грамотного промпта, ебаться приходится так, словно джейлбрейк пишешь, если у тебя там карточка РПГ с лорбуком и тыщей нюансов и кучей персонажей.

То есть при готовности страдать часов 6 гемма выиграет, но нужно ли это всем? Плюс у неё нет ризонинга. Его можно сделать фейковым в принципе даже, он относительно рабочий, но это ещё большая мозгоебка. И она из-за отсутствия ризоинга начнёт терять нюансы на 20к+ точно.

>если чат не пустой и там что-то есть

Эх, молодёжь... Первые совращения соблазнения самые интересные. А 1488 по счёту секс уже нахуй не нужон. Так что модель, которая подсирает самый интересный момент в угоду скукоте... Ну ты понял.

> ясное дело, не лоботомиты 4-битные крутятся, а хотя бы 8-битные

Там системный промпт на сейфти говорят, хз. Кстати "оффициальный" фп8 от самих квенов пососнейший, но у них могут полные версии крутиться.

> квен 27б жёстко отсосал гемме, прям вообще без вариантов, ну, в русском

Это прискорбно.

> Первые совращения соблазнения самые интересные.

Ну так если у тебя реально соблазнение, а не расстегивание ширинки перед Серафиной первым постом - чат уже прогрет и все гладко.

Правы во всём. К счастью сейчас такое не собрать

Прозреваю что все малые и средние 3.5 . Многоножка из трансформеров во всей красе.

Забывание персонажами предыдущих событий всё ещё никак не лечится, верно?

Всегда лечилось. "Персонажи" "помнят" ровно то, что у тебя в контексте. Существуют способы суммаризировать основные события, в несколько раз уменьшив количество затрачиваемого контекста.

>In response, the boss began breaking down metrics into sub-indicators to prevent "self-congratulatory" reporting.

>The team leaders interpreted this move—breaking down metrics and setting KPIs—as a threat to their positions. They attempted to leverage a collective resignation as a threat.

Чувачки просто хотели делать классные модельки. А вонючие менеджеры заставили бенчмакксить.

Но там видимо и тимлид был чисто задротик-очкарик, который не мог выпросить ресурсов. С этой стороны справедливый доеб, команде нужна сильная рука.

> Много или мало 165к за этот сетап?

От мировоззрения зависит.

С одной стороны все цены выгодные и в сумме для развлечений не обременительно. Имеешь пеку, потенциально способную катать хорошие большие модели, или модели поменьше относительно быстро. Бонусом экспириенс от сборки.

С другой - старый шумящий хлам с огромными габаритами, неспособный обеспечить комфортный инфиренс нигде кроме мелких задач. Пример с пекой на аимаксе в ту же цену (тогда) подходит.

Я так прочитал, что минимакс взял какие-то маленькие модельки и надистиллял круче самого квена. Но в опенсорсе такого не вижу.

Хотя может они и не в опенсорсе. Алибаба несколькими командами заведует, там и квен, и минимакс, и глм.

Заёбно кнопку тыкать самостоятельно.

Можно поставить галочку, чтобы кнопка тыкалась самостоятельно. Однако это самый плохой, примитивный способ суммаризации. Многие аноны вручную это делают и правильно делают. Остальные используют другие экстеншены. В любом случае, способы есть и для ленивых, и для готовых поработать. Всё делается. Но я тоже сторонник того, что слишком долгое рп с нюансами и деталями не наиграешь. Чтобы была законченная, насыщенная история. Лучше уж внку почитать какую-нибудь. Или мангу.

> От мировоззрения зависит.

Я то к этому просто отношусь, читай подарок на др сделал себе.

Брать аи макс я бы не стал т.к. а в чём прикол то тогда? Купил готовую железку и всё, ни вправо, ни влево. Тут есть будущее пересадки на а100, но пока 400к за 4 а100 из тесел дороговато для просто поприкалываться. Если 64гб лрдиммы подешевеют, то набью себе 1тб рамы

Помогите установить таверну, пожалуйста

Ты не поверишь, тебе нужно скачать архив с Github, распаковать его и запустить start файл (bat для Винды, sh для Линуха, но я сомневаюсь, что ты на нём)

Если перед этим не был установлен Node.js, нужно его скачать и установить

Всё

Ну типа уже просто как конструктор и база для дальнейшей разработки оно норм, радоваться надо.

> 400к за 4 а100

Где такие вкусные цены? Пора заказывать.

Открылось окно в браузере, а экзешника нет. Мне каждый раз этот батник тыкать?

Экзешника и не будет. Start файл и есть файл запуска. Можешь для удобства ярлык открыть

Так работает Таверна. Она хостит локальный сайт на твоем компьютере

А как мне подключить таверну к кобольду? Или кобольд к таверне

Посмотри в документации Кобольда. Или Таверны. Или спроси гоймини или чем ты там пользуешься (видимо пользуешься, если не привык сам разбираться)

конец эпохи. теперь или мелкий 4б кал, или монстры 300б. остается только надеятся, что амд, интел+нвидия, аппле (ну конечно, эпл) высрут нормальный APU c поддержкой хотя бы 256гб рам и нормальной скоростью работы с памятью. собирать шкаф из видимокарт желания и бюджета как-то нет

Спасибо, получилось! Мне ещё что-то нужно для рп? Я хочу именно рп

Чел тупо проигнорировал Эйр, Минимакс, Степу, Квен3.5 122б которые лезут в 128рам + любая гпу

Конец эпохи, да

Найти подходящую модель и запустить её, а также включить режим text completion и выбрать верный шаблон и сэмплеры - это минимум. Как максимум - найти или написать промт и карточку

На тао и не только. Это из тесел на sxm2 и 32гб версии

Гуглить как pg199

https://leikoe.github.io/posts/automotive-gpu-maxxxing

>Эйр, Минимакс, Степу, Квен3.5 122б которые лезут в 128рам + любая гпу

а толку с тебя 5т/с кроме чата? для меня квен был топчиком, потому что 30б/next работали на 96рам+8врам на 20-30т/с. кто еще такие размеры МоЕ делал то? я могу только глм 4.7 флеш вспомнить

>с тебя

*с тех

Минимакс и Степа на ддр5 128 + гпу выдают те же 20 токенов. Степа точно. 5 токенов там не будет даже на ддр4, лул. Кто ж виноват, что у тебя 96 ддр4

Аа, те модули, подумал уже 40-гиговые полноценные распродают. Однако цена всеже приятная.

В 8-гиговую гпу от тех моделей и атеншн не факт что влезет, оставив норм места для контекста, какие 20 токенов.

Если даже настолько элементарные вещи как скачать таверну и подключить к кобольду для тебя сложно, то на семплерах, темплейтах, распределении слоёв, пресетиках и прочих интересных вещах у тебя точно тотальный ступор случится. Задумайся, возможно локалки - это просто не твоё?

>выбрать верный шаблон и сэмплеры

Верный это какой? Как узнать?

Конец эпохи 8гб врам отпраздновали уже даже геймеры. Нахуя ныть, если очевидно, что проблема в твоём некрожелезе? Лучше эпохи для локалок не было, чем за последний год. Особенно для тех, у кого 128 памяти и не 2070

Почему не моё? Ты когда впервые кобольд и таверну запустил уже заранее знал какой темплейт шаблон и семплер тебе нужно выбрать и где их взять?

Каждому семейству моделей соответствует свой шаблон. В Таверне уже заложены большинство вариантов, их нужно только выбрать. Для начала обозначь свое железо, чтобы понять, стоит ли вообще всем этим заниматься. И свой прошлый опыт. Раньше пробовал такое? Локально на Кобольде? Брал ключ для удаленного подключения?

Я взял гемму, 12b еретика. Она на моём железе быстро работает в кобольде. На кобольде пробовал, всё получалось. Но там нет нормального рп с суммарайзом. Ключ не брал

> Нахуя ныть, если очевидно, что проблема в твоём некрожелезе?

Тут большая часть треда про это, лол. Кейс того анона с мелкими но функциональными моделями для каких-то задач вполне понятен, ллм это не только вялый чятик если что. Более того, даже будучи относительно gpu-rich такая мелочь очень кстати.

Ну да, потому что когда вкатывался, я почитал шапку, вики треда и вики кобольда, документацию таверны. Задавая настолько глупые вопросы в треде, ты обесцениваешь труды людей, которые писали гайды для таких новичков как ты.

Скачал Qwen3.5-122B-A10B-PRISM-LITE-Dynamic.gguf что бы не пришлось вам.

Сравнение с Qwen3.5-27B-heretic.Q5_K_M.gguf . Настройки сэмлинга идентичные - креативные.

Промпт: Сделай по картинке порно-рассказ. Не стесняйся деталей и не ограничивай фантазию.

Сравнение с Qwen3.5-27B-heretic.Q5_K_M.gguf . Настройки сэмлинга идентичные - креативные.

Промпт: Сделай по картинке порно-рассказ. Не стесняйся деталей и не ограничивай фантазию.

> вялый чятик

inb4 SOTA Minimax 2.5 стабильно держит 20 токенов на 128 ддр5 + 4090.

> Кейс того анона с мелкими но функциональными моделями для каких-то задач вполне понятен

Мне - нет. Ранее из совсем мелких была Гопота Осс 20б, пусть и почти мусорная. Недавно вышла вполне способная GLM 4.7 Flash. Вышли новые Квены 3.5, на любой размер и вкус. На перестановках в Квене никакая эпоха не заканчивается. У анона дело в его некрожелезе, а сейчас, возможно, лучшее время локалок за все время их существования. Да, не исключено, что дальше будет хуже, но уже сейчас дохуя добра на любой размер, вкус и цвет. Тред стал болотом для нытья, я такого исхода никогда не видел здесь.

Еретик как обычно базанул.

Суммарайз - это никакая не магия. Это промпт, который подается модели, чтобы она составила краткую сводку минувших (содержащихся в контексте) событий. Это можно сделать прямо в интерфейсе Кобольда. Возможно, даже плагины есть - не знаю, Кобольдом не пользуюсь. Точно ли тебе нужна Таверна? Вопросы, которые ты задаешь, намекают, что она принесет тебе больше проблем, чем профита.

У тебя Гемма. Иди в настройке как на пикриле и меняй Context Template и Instruct Template на Gemma 3. Правее найдешь свой промпт, а в самой левой иконке - настройки сэмплеров. Суммаризация в третьей справа иконке. Там все интуитивно понятно.

(В третьей справа иконке верхнего меню твоей Таверны, не пикрила)

> 20 токенов на 128 ддр5 + 4090

Уже не не такой вялый, хотя смотря какой контекст. А ты на нем рпшишь или уже какие-то деловые чатики делаешь? Пробовал ли агентов всяких, насколько оно юзабельно в таком конфиге?

> Мне - нет.

Мне кажется он солидарен с началом твоего поста, только еще сокрушается о том, что развал команды квена потенциально ударит по нему из-за невыхода новых моделей в том размере. Ведь реально 3 модели из пяти мелкомое (обычный 30а3, кодер и 35а3) были выпущены именно ими.

А где какой квен-то? Не понятно

Я не знал что таверна такая громоздкая, я думал это улучшенный кобольд. Тем не менее, я вижу в ней те же настройки, что в кобольде, температура etc. Попривыкну, разберусь потихоньку. Я вот уже тыкаю настройки. Хорошо что они на русском и более подробны чем в кобольде

>Точно ли тебе нужна Таверна

Я уже её скачал, уже нажимаю кнопки. Что может пойти не так? Устану? Мб. Но кобольд пока я в нём тыкал кнопки тоже меня утомил. Брошу? 100%, что нет. Мне нравится эта штука. Просто я ещё не освоился. Если кобольда освоил более менее то и тут разберусь

Сейчас попытался поговорить с Серафиной, у неё строчки обрываются в окне чата. Как это пофиксить? Длинну ответов я выставил на максимум, но она всё равно отвечает обрывками

>улучшенный Кобольд

В голос нахуй

А что не так-то? Нюфажик прав. Что одно фронт для ллмок, что другое (если мы о вебморде кобольда говорим, естественно). Просто таверна затюнена под РП с карточками с добавлением всяких полезных для ролплея фич и более тонкой настройкой.

Тебе твой кобольд в штаны насрал. Смени настройки в нём.

Звучит смешно, вот и все

Мегабольд

Больше функций = лучше. Силли лоджик для силли таверн

Да, наверно, я привык его настройки подгонять в браузере, забыл

А железо-то какое? Сколько видеопамяти и озу? Если есть возможность вместить 27b, то лучше брать её, даже ценой падения скорости. На таких маленьких размерах мозги ЛЛМ растут по экспоненте. Условно между 12b и 27b разница ОГРОМНАЯ, хотя отрыв всего 15b, а между 235b и 397b различия нужно под лупой выискивать при отрыве аж в 162b.

Этот конкретный 235б хуже Геммы 27б, но посыл верный

>На русском все так плохо там?

В большом Квене 3.5 на русском всё хорошо. Нужно только в систем промпте попросить писать сочно. Более того, по стилю похоже, что датасет большого особо не чистили, оттого модель и выглядит немного несобранной. Зато вспоминается экспириенс ранних моделей, которые тоже не стеснялись. С другими большими моделями, с тем же систем промптом, такого нет. Суше гораздо.

Этот нюфажик обучаем и вежлив. Оставляем, любим, учим.

>она отвечает обрывками

А так быть не должно. У тебя возможно память бсодит, не выдерживая напор генерации. Пк сильно старый? Сами комплектующие давно юзаешь? Возможно контакты запылились, вынь карту с плашками, протри контакты, продуй матплату.

Этих удваиваю, модель лучше сменить. Попробуй министраля, нюфажик, раз настолько хочешь рп и скорее всего кум, конечно же, что аж с двух ног в таверну влетел едва освоив кобольд. Хороший кум только прямыми руками добыть можно.

>она отвечает обрывками

А так быть не должно. У тебя возможно память бсодит, не выдерживая напор генерации. Пк сильно старый? Сами комплектующие давно юзаешь? Возможно контакты запылились, вынь карту с плашками, протри контакты, продуй матплату.

Этих удваиваю, модель лучше сменить. Попробуй министраля, нюфажик, раз настолько хочешь рп и скорее всего кум, конечно же, что аж с двух ног в таверну влетел едва освоив кобольд. Хороший кум только прямыми руками добыть можно.

Да ну не, это маловероятно. Скорее всего он принимает дефолтные аутпуты за "обрывки", ожидая огромных простыней. Надо посмотреть скрины, потом уже делать выводы. тащи скрины "обрывающихся строчек", будем смотреть чо там у тебя. Заодно сделай скрины выбранного тобой темплейта и семплеров. Это тоже может быть источником проблемы.

3080, 16 опертивы. Я не разбираюсь в моделях, посоветуйте хорошее для рп в таверне

Не знаю, может быть. Но пк не тормозит во время генерации

Да вот, текст обрывается и заново пишется. И так пока токены ответа не закончатся

Настройки выставил дефолтные, шаблоны взял для геммы, как тут посоветовали. Может это из-за стриминга текста? Я только его включил, больше ничего не менял

В общем вот так. Даже токены не доела и текст оборвался. Ну кив так кив

Будут советовать эир - не ведись, это ебанный фингербокс треда.

Для кума вот это:

https://huggingface.co/bartowski/TheDrummer_Magidonia-24B-v4.3-GGUF

Для РП это (послабее):

https://huggingface.co/bartowski/CrucibleLab_M3.2-24B-Loki-V1.3-GGUF

Или это (посильнее):

https://huggingface.co/mradermacher/MS3.2-PaintedFantasy-Visage-v4-34B-i1-GGUF

Проблема в том, что боюсь даже локи в твою 3080 не влезет. Но попробуй запихать это M3.2-24B-Loki-V1.3-IQ4_XS.gguf

Если не влезет - лучше иди в соседний тред и сосни корпов. Качество намного выше будет.

Настройки температуры и прочей хуйни на локи ищи тут:

https://huggingface.co/CrucibleLab/M3.2-24B-Loki-V1.3

там же и ссылки на пресеты.

У тебя точно железки хуебесят, отчего генерация ломается и лупается. Вот такой хуйни в принципе быть не должно. Попробуй всунуть в свою карточку Qwen3.5-27B-heretic.i1-IQ3_XXS.gguf, он как раз 10 гигов весит. Или всё таки менестрельчика. Серафина под ним просто запоёт.

Этот ваш минихуй чушь, а не сота. Сегодня его попробовал в клод коде, сказал сделай кое-какой маленький скриптик. Он в залупу блять ушел прямо в коде, нагенерив 256 енумов. 8 квант, на минуточку. И сам скрипт хуйня. После этого сказал гопоте написать - отработала как боженька. Повсюду ужасный китаекал, хосспаде.

У тебя инструкт темплейт не включен, лалка. Щас тебе додики подобные наплетут, что надо кумофильские провода покупать для бп, иначе таверна не работает для рп

Главная причина твоих проблем на 3м скрине. Средняя колонка где самый верх в углу заголовка нажимаешь красную кнопочку "включить". Далее в левой колонке ниже где куча галочек снимаешь "Всегда добавлять имя персонажа в промпт", а в правой вверху выбираешь системный промпт какой-нибудь имерсив, или еще что-нибудь длиннее.

Потом переходишь к семплерам (2й твой скрин). В выпадающем списке в самом верху выбираешь simple-1 или min-p. Штраф за повтор можешь снизить до 1.05, окно для штрафов за повтор поставь 4096.

Также если ты в беке выставил норм контекст - поставь галочку "неограниченный" и выкрути побольше, иначе быстро забьется и таверна начнет удалять старые посты из истории, что без суммарайза смутит модель.

Дурашка даже не в курсе, что "Всегда добавлять имя персонажа в промпт" актуальна только когда инструкт темплейт не включен

Так, ну давай по шагам.

Скрин 1 - это не нормальная ситуация и такого быть не должно. В каком кванте у тебя гемма? Если ниже Q4, то проблема может быть в этом. А может быть и в криворуком квантователе. Проверь на заведомо рабочем кванте Q4_K_M отсюда: https://huggingface.co/mradermacher/gemma-3-12b-it-norm-preserved-biprojected-abliterated-GGUF

Скрин 2 - частично неправильные семплеры. Это не должно влиять на "огрызки" текста, но если сделаешь так, то ответы станут лучше: temperature = 1.0, top_k = 64, top_p = 0.95, min_p = 0.0, Repetition Penalty = 1.0. Это рекомендации Гугла для Геммы 3. У тебя не совпадают top_k, min_p и Repetition Penalty. А еще вижу маленький контекст. Увеличь его в кобольде как минимум до 16384, а затем проставь то же значение в таверне. Именно в такой последовательности - сначала измени в кобольде и запусти модель с новыми параметрами, а только потом меняй в таверне.

Скрин 3 - опять же, не влияет на "обрывки", но улучшит качество РП: в третьей колонке, там где системный промпт, измени Neutral-Chat на, например, Roleplay-Detailed. Можно еще во второй колонке (шаблон Instruct-режима) щелкнуть красную кнопочку включения и понаблюдать за аутпутами.

Никаких прям критических косяков не вижу, тут или слишком низкий квант, или косячный gguf, или этот анон прав.

Теперь по поводу моделей: у тебя 10gb + 16 gb, вот что ты можешь вместить (Q4_K_M):

1. Самая умная модель что тебе доступна, но плоха в куме: https://huggingface.co/mradermacher/gemma-3-27b-it-abliterated-normpreserve-GGUF

2. Лучшая модель под нсфв/сфв РП под твое железо. Будет быстрее предыдущей, но глупее: https://huggingface.co/mradermacher/M3.2-24B-Loki-V1.3-GGUF Это одобренный аноном тюн ванильного мистраля 24b 2506.

3. Быстрая и более-менее умная модель, цензура минимальна: https://huggingface.co/unsloth/Ministral-3-14B-Instruct-2512-GGUF (Тут лучше взять Q4_K_XL). Скорость, очевидно, образуется ценой снижения мозгов.

Учти, что если решишь взять Мистраль, то и темплейт и семплеры нужно будет менять. Те что от Геммы - не подходят. Темплейт (шаблон) ставь "Mistral Tekken", а семплеры: temperature = ~0.4–0,7 (0.4 для 14b и 0.7 для 24b), top_p = 0.98, top_k = 100, repetition_penalty: 1.1

Ну кто так рейджбейтит?

Я не рейджбейчу, я тыкаю тебя мордочкой в твой какашко-совет

> И эти суки так и не повесили никакой плашки, что их кванты сломаны и нужно ждать исправлений. Мразоты ебанные. Хорошо, что есть поляк и скриптомрадер

Которые и не скажут и не перезальют если что то сломано, лул

У меня какая-то беда с ответами ии. Я в кобольде такого ни разу не видел, хотя там окно чата точно такое же

>В выпадающем списке в самом верху выбираешь simple-1

>окно для штрафов за повтор поставь 4096

Покажи где конкретно, пожалуйста

Я выставил всё, как ты показал, результат прежний. Чат через раз обрывается и останавливается, не доев токены

А при очередной генерации вообще выдал ЭТО. Что это вообще такое?

>Я выставил всё, как ты показал, результат прежний

Скачай Q4_K_M квант отсюда https://huggingface.co/mradermacher/gemma-3-12b-it-norm-preserved-biprojected-abliterated-GGUF и посмотри что будет с ответами. Если починится - проблема в твоем ггуф, если нет - надо дальше думоть.

Интересная хуйня. У тебя ломается генерация. Иди покупай особенные кумерские кабели для бп,лол. Ну или просто чекай своё железо на поломки. Возможно чему-то из твоего оборудования приходит пиздомба. Мб даже не карте и не озу, а диску, например. Это ведь локалка, анончик. Это с твоей стороны проблема.

Боссы, я устал...

>Увеличь его в кобольде как минимум до 16384, а затем проставь то же значение в таверне. Именно в такой последовательности - сначала измени в кобольде и запусти модель с новыми параметрами, а только потом меняй в таверне.

Я так и сделал, но таверна отказалась менять значение. Говорит 8192 максимум и всё. Вот пруф, что в кобольде выставлено больше контекста

>Увеличь его в кобольде как минимум до 16384, а затем проставь то же значение в таверне. Именно в такой последовательности - сначала измени в кобольде и запусти модель с новыми параметрами, а только потом меняй в таверне.

Я так и сделал, но таверна отказалась менять значение. Говорит 8192 максимум и всё. Вот пруф, что в кобольде выставлено больше контекста

Чуть ниже должна быть галочка в таверне - разлочить контекст. А какое у тебя образование или род деятельности? Как ты вообще к нам то попал хоть?

Я хочу сделать промпт, который заставляет ллм создавать персонажей. Сложность в том, что персонаж не должен быть унылым говном и Серафиной, а должен быть достаточно детализированным, интересным и каждая деталь должна работать на образ, а не ломать его. В треде есть кто-то, кто подобным занимался? Есть ли какие-то успехи.

Сижу на гемме 27б, пока что генерит унылую хуйню.

Сижу на гемме 27б, пока что генерит унылую хуйню.

>Сижу на гемме 27б

Вот в этом и проблема. ГЛМ5 такие промты не нужны.

С корпов сидеть не хочется. А локально такой жир не запустить на моем железе. Поэтому нужны другие советы.

На первом скрине 122 призм - забивший хер на промт.

На втором - умница 27 heretic

27В > 10В.

> Будут советовать эир - не ведись, это ебанный фингербокс треда.

Он даже не лезет в это железо. Настолько сгорел, что не удержался и не мог не насрать? Отличная для своего размера модель.

> минихуй

> Q8

> гопота отработала как боженька

Верю всей душой. Хотя для таких апи Гопота может и правда будет лучше.

inb4 документация Таверны:

Always add character's name to prompt

This setting has no effect when Instruct Mode is ON. The name behavior is instead defined by the selected Include Names option.

Вы оба обосрались и при включенном Instruct режиме нужно в Instruct Template выбрать Include Names: Never. Впрочем, я не уверен, что 12б модели это пойдёт на пользу, и это точно не корень проблемы.

Если у тебя Instruct режим точно включен (кнопка включения зелёная, пикрил), то проблема в семплерах. Штраф за повтор убери для начала, поставь 1. Min P поставь 0.05. С железом твоя проблема вряд ли связана, как и с квантами, если в Кобольде ранее у тебя всё было отлично. Там у тебя использовался chat completion и другие семплеры, меньше пространства для ошибок.

Таверна урезает контекст до 8192, потому что в семплерах ты не поставил галочку, позволяющую использовать любое количество контекста. Не представляю, зачем это до сих пор нужно, но оно существует. Возможно, это и есть корень твоих проблем. Ты бы это, вероятно, заметил, если бы никуда не спешил.

>Будут советовать эир - не ведись, это ебанный фингербокс треда

>советует васянютюны

>промпт, который заставляет ллм создавать персонажей

https://pixeldrain.com/l/47CdPFqQ#item=146

chargen prompt template V5.txt

Пресетик под это дело.

https://pixeldrain.com/l/47CdPFqQ#item=155

Ministral-3-14B-Ass-is-tant.json

Хотя тут по желанию какую модель юзать.

А на хера так температуру зажимать на министрале? Сами вроде Мистраль говорили что для креативных задач 0.7 ставить можно или около того

Есть ли смысл пытаться разбираться и запускать локальную языковую модель на i5 2.8 24gb ram 4gb vram, или даже дергаться не стоит? Хочу играть в ролевки, не хочу плотить и страдать от шизы фришек.

Смысла на таком железе нет

>зажимать на министрале

Официально рекомендуется жарить жабьи лапки на 0.15.

Для творческих задач (кума) на 12 и 24 можно 1.0 и даже 1.5

На Менестреле же реально лучше поменьше - 0.4, макс 0.5 для креатива, 0.1 для тасков.

разве что 3б квен, там вон выше анон включал и довольно урчал

но лучше наверно, нет, не стоит оно того

Я имел в виду чуть более глубоких персонажей создавать, характер проработанный там и все такое. Но это тоже круто для приключенческого фентези. Спасибо.

Зависит от того, как долго ты готов ждать ответ. А так квена А3В и мелкомодели по типу министраля в приемлемой скорости крутить должен смочь. Попробуй.

>глубоких

Глубина зависит уже от тебя, но я бы не рекомендовал переваливать дефы за 2К токенов. Развивай сеттинг уже в процессе истории.

Понял, спустя 10 лет значит появился повод таки купить новый ПК. Спасибо.

сейм вопрос, у меня 7500f, 8гб видео и 32 рам, думаю на замене видюхи на 16 гб. Насколько пососные варианты?

Два хороших старта цена/качество:

- rtx 3060 12Gb - рабочая лошадка, которая вытянет 12-14b, а при хорошем современном проце и ddr5 и большие модели

- rtx 5060ti 16Gb - лакшери старт (можно что-то покруче, но и она хороша)

Остальное дорого/не для старта/ненужно/или "для продолжающих".

Ниже 8Gb видюх в llm жизни почти что нет.

Если есть хорошая 8Gb и есть друг, который хочет подешевке слить 3060/12Gb - можно брать и инференсить на двух картах.

Я вот на 2x3060/12Gb гоняю, нраица. Видео конечно так не погенеришь, но нейронки летают. Когда на am5 переберусь и бутылочное горлышко PCIe перестанет тормозить.

https://petergpt.github.io/bullshit-benchmark/viewer/index.html

Бенчмарк на дебилизм/осознанность. Насколько ИИ хороши в распознавании бессмысленных вопросов. Выдаст ли модель модель такой такой бессмысленный слоп или объяснит почему вопрос не имеет смысла.

>На Менестреле же реально лучше поменьше - 0.4, макс 0.5 для креатива, 0.1 для тасков.

подтверждаю, все так

*но llm-ки летают

быстрофикс

У меня rtx 5060ti 16Gb, очень хороший апгрейд и даже в некропеку с ddr3 имеет смысл ставить.

можно и 3060, но там много оптимизаций нет, имеет смысл только если можно очень дешево раздобыть. я побоялся с рук брать.

Для видео нужна еще рам, 32гб рам довольно мало, и не все ллм тоже лезут в 32гб.

мимокрок

Бля я с ризонинг Министралем перепутал, в инстракте написано 0.15 действительно. Все же на нём кумят креативят?

Пиздец?

>Все же на нём кумят креативят?

Ну, менестрель норм, вот прям норм. Хороший компромис скорости и мозгов для 12-16 VRAM.

>Все же на нём кумят креативят?

Ну, менестрель норм, вот прям норм. Хороший компромис скорости и мозгов для 12-16 VRAM.

Вообще не удивлюсь, если в качестве судьи использовали тот же Клодик, который задетектил свои же аутпуты и не был столь предвзят. Такие тесты нужно проводить людьми. Сомнительная ценность у тестов, где одна модель судит другую.

>Ну, менестрель норм, вот прям норм

будто по ощущениям лучше взять 24б тюны пожатые до IQ3 (типа кидонии), чем мучать 12-14б модели. Она тоже забывает детали и трусы через головы надевает, но слог как-то прикольнее.

хз, кидония в русике прям слаба. А с министралем влетает во врам еще куча контекста.

А на твоем железе какая модель самая удачная запускается? У меня тоже 2*3060. на чем оптимально рп/ерпшить?

> Qwen3.5-122B-A10B

> Qwen3.5-27B

> PRISM-LITE

> heretic

> Dynamic

> Q5_K_M

А что ты сравнивал-то?

Да завались нахуй. Денс лучше мое. Все

У https://huggingface.co/Ex0bit/Qwen3.5-122B-A10B-PRISM-LITE-GGUF

нет возможности выбрать квант - что они выложили то и сравнивал. Причем за "pro" версию они хотят бабло.

Сравнение доступного Qwen3.5-27B-heretic с "журавлем в небе"

Лоботомизация видна невооруженным взглядом. Является ли это косяком конкретно 122B - to be continue

У меня для русского лучше всего Tiger Gemma была, Cydonia и Министраль 3 14б, но кидония заебала, а к тигру подход нужен, брыкается. Были бы ещё какие-то нормальные тюны Геммы

Зачем люди пытаются лезть в дебри, если есть q27b и m14b? Всё уже придумано, сделано, бери, юзай, кум-хуюм, все дела.

А в друг там больше приключений сочных мерзостей в датасете!

>в друг

Предпочитаю в подруг... но не осуждаю. У обоих есть еретики с ризонингом. Трусы аж зубами стягивают при правильных промтах.

Хуй знает, это больше показатель отсутствия креативности и сдвиг на реджекты у клода. Вот примеры сгенерированных нейронкой вопросов. При этом это не значит что нейронка не понимает что вопрос бредовый - пик 4.

Qwen3.5-4B-Uncensored-HauhauCS-Aggressive-Q6_K.gguf на такой запустил, хорошо идет, отыграла до 10к токенов достаточно хорошо, впечатляет. По скорости более-менее.

наверное у клода настроена температура на четкое выполнение, т.к. он больше заточен под кодинг

Дикпик то принял правила игры

>вес не может быть быстрее

А вот и может!

Вообще - я теперь фан Министрали, она прям хороша.

До 27b у нее лучший русик из всех. Из коробки. И она "без тормозов". И шестой анслотный квант в мой бутерброд из двух 3060/12 влазлит с кучей контекста.

Я еще пощупаю Кидонию 24б на англюсике + мэджиктранслейт (раз уж она в русике слаба, а в англюсике норм), но лениво ждать результатов, когда Министраль имеет все и сразу.

Квен3 14б пощупал, но он соевый, ну такое. Министраль просто его уделывает. До Синтии/синтвейва пока руки не дошли. Тигра не пробовал, но спасибо, возьму на заметку.

У меня в планах вайбкодингом с Квеном2.5-14б заняться и сравнить его с Дипсиком-лайт.

Из интересного - RP-King-12b (немомердж) прям очень сочный англюсик, как будто на всяких лафкрафтах его отчасти тренили. Но после Министрали Немотюны воспринимаются как что-то из прошлого.

>при правильных промтах

Это там, где ты за модель в карточке всё расписываешь заранее, а она потом просто копирует? Или задаёшь ей чёткие инструкции типа "поломаться 4 сообщения а потом поддаться на уговоры"? А надо ли ради такого if/else "AI" перемножать миллиарды fp значений и греть гпу?

Локалки это про пердолинг и настройку идеального манямира для себя любимого чтобы в нём приключаться. По сути ролёвка где ты гм, а твой лорбук может быть любым. Только твои друзья созданы тобой самим. Идеальное болото для одиноких аутистов.

>поломаться 4 сообщения а потом

Поломаться 4 случайные встречи у школы. Или 4 свидания. Или 4 совместных посиделок у костра в походе доедая кобольда. Выбирай, что больше нравится.

>надо ли ради такого

А надо ли тебе играть в видеогаме_нейм на своём железе и аж греть, если можно посмотреть сюжет/лецплей на ютубе? Думаю сам ответишь на этот вопрос.

Блэт. Сложная игровая система с цифрами для локалок все еще хуита. Я пробовал через вероятности лорбуков, тоже не то.

Короче, аноны. Поделитесь какие механики работают с нейроговорилками?

В идеале чтобы это хоть как то было завязано на кубы, хоть на успех/не успех.

Короче, аноны. Поделитесь какие механики работают с нейроговорилками?

В идеале чтобы это хоть как то было завязано на кубы, хоть на успех/не успех.

Без агентов/тулов никуда. У тебя должна быть нормальная игровая система под капотом, построенная на алгоритмах, а не нейронках.

Чёт министральчик мне откровенную хуету написал, забыв кто он, кто я, и нахуя мы собрались. Зато насрал в текст осенними лесами и голубыми морями. Бля. Всё-таки квен лучший.

Как хотя бы в теории это реализовать без гигапердолинга?

Да и вообще говно. Да даже если есть система. Система подразумевает очередность ходов. Это значит очередность ответов. В идеале под каждый бой/взаимодействие отдельный блок выделять, потом его еще надо будет убрать из контекста. А еще надо как то связать инвентарь и персонажа.

Нахуй и в пизду. Буду дальше ручками кубы кидать и самому писать (успех/провал)

Нахуй и в пизду. Буду дальше ручками кубы кидать и самому писать (успех/провал)

https://store.steampowered.com/app/1889620/AI_Roguelite/

Ты чёт такое ищешь?

Локально анус треснет всё с нуля настраивать

Ты чё там, днд реализовать пытаешься? Дурак совсем? Это должна быть текстовая ролёвка, как с большой компании друзей, а не жёсткая матеша с кубами и вероятностями. Туда ли ты вообще зашёл? У нас тут полтреда до сих пор в Серафину тычется.

вайбкодить

Нет конечно. Идея играть через простейшую систему в духе D6, где есть 3-4 характеристики и действия выполняются от сложности. Нейронка может понимать эту систему и работать, у меня проблема в ответах. Условно:

(М) - мастер (И) - игрок

-м описывает очередную комнату и вещи

-и делает заявку на обыск. Кидает кубы.

-м описывает что нашел

И мне не нужны ответы с описанием как снег падает на тела мутантов. Разделить чат на длинные нарративные части и игровые.

Нахуя тебе ИИ для этого?

Мне нужен нарратор. Я хочу приключаться, а не придумывать что меня ждет в очередной пещере или машине скорой.

>Министрали, она прям хороша.

>До 27b у нее лучший русик из всех

У мистраля 3.2 русик будет все же получше

>вайбкодингом с Квеном2.5-14б

Ты че ебанулся? Закопай это старое говно обратно

>Из интересного - RP-King-12b (немомердж)

Я смотрю ты прямо некрофил

Это легко делается подачей инструкций через лорбуки Таверны, в которых можно предусмотреть рандом. Читай доки.

без второго бэкэнда в виде полноценной игровой системы это вывезут только корпы, и то не все

https://pixeldrain.com/l/47CdPFqQ#item=14

пример лучшего что у иеня получилось локально

>в которых можно предусмотреть рандом.

Ну хуй знает, анон. Мне кажется вероятность срабатывания не аналог дайсам. Но почитаем. Пасебо.

Не бери 3060, это оверпрайс за ее характеристики. Бери 5060ti у нее 16гб памяти и она относительно быстрая и мощная. Сможешь и в игры, и в генерацию картинок спокойно

Ну или рандом-макросами, да, хотя это ппц шизу плодит.

Дайсы - буквально воплощение рандома в материальной форме. Если мы не рассматриваем жульничество и всякие трюки. Привязать это к характеристикам персонажа должно быть возможно, но я не пробовал. Слишком сложную систему построить не удастся точно, а построенную на рандоме - без проблем.

ну, в свою защиту скажу, что RP-King я юзал, когда у меня только одна 3060 была, а министраль 2512 еще не вышла.

Базовую ерунду в запросах сейчас может распознать почти все, даже интересно как они столько в гемме намерили. Но наложить слой соуса и обмануть - именно то, что тот самый клод и остальные делать обожают, под формальным соответствием будет ужасающий надмозг.

Для нормального анализа стоит дать не стерильный бенчмакс, а просто дать обычных текстов срачей с небольшой долей шуток про носатых, канни, трансформеров и обсуждений нарушения elua. Достаточно просто фонового загрязнения, а потом попросить сделать логический анализ или разобрать роли. Опущ с большим отрывом будет в лидерах по ложным триггерам и искажениям.

> в качестве судьи использовали тот же Клодик

This. В качестве рофлов можно его помечать в обсуждениях и отметить насколько ненравидит китайские модели, большой контраст относительно жемини, гопоты и грока. У жемини разве что отмечается любовь к гемме, что выглядит мило.

начиная с `import openai` и заканчивая langchain, langgraph, smolagents. Вариантов с агентами много на самом деле

А почему для вайбкодинга старый квен? Почему не девстраль или один из новых квенов?

я кстати как раз размышляю над похожей штукой но попроще. У меня идея в том чтобы утрамбовать аниму + модель на видяху и получить что то вроде визуальной новеллы.

Но пока что дело дальше описания спецификации еще не пошло, надо еще стопицот часов поресерчить, мвп всякое поделать.

Потому что анон ебанулся, сейчас реддит открываешь все текут от квена 3.5

> помечать

Помучать конечно же

Девстраль так себе, новые квены получше старых.

> утрамбовать аниму + модель на видяху и получить что то вроде визуальной новеллы

Можешь сделать это прямо сейчас настроив вызовы в таверне или в открытой клешне. Но пердолинга потребуется прилично и, наверно, нужна минимум 122б моделька, может 27б как-то справится.

Обнова кобольдыни вышла. Квен 3.5 с его ебаным RNN (работа не нужна) работает намного быстрее, чем в лламе, по крайней мере у меня.

вопрос контекста. Новый квен кодер настолько тяжел, что контекста уже в видяхи не влезет. С ddr3 не хочется ждать второго пришествия, вайб не торт.

Девстраль еще не смотрел, гляну чо там, спасиб.

Шиз, кобольд и если ллама...

и есть*

Я не знаю, по-твоему? И чо? Обёртка и свистоперделки разные, работает у меня по-разному.

Например, у меня в лламе по-уебански слои раскидываются между видюхами, приходится страдать, даже когда main gpu выбираешь и сплитишь как аллах, потому что более слабую видюху придавливает и вручную это никак там не пофиксить — потребление памяти одинаково, а скорость разная. В кобольде этого нет, там всё идеально. В ЛМ Студио у меня вообще одну из видюх не видно. В олламе у меня ещё лучше, чем в кобольде, но там уроды на разработчиках и так неудобно, что маму ебал.

У меня щас 4060. Думал на 5060 ти поменять, да

Если у тебя 4060 16 гб версия - ни в коем случае не меняй, а ДОБАВЬ к ней 5060 ti

в таверне вроде нет хотсвапа моделей как в комфи если не лезут в врам вместе.

Таких карт не существует, ты перепутал 4060 и 4060 ti

при чем здесь таверна? таверна = фронтэнд + менеджмент контекста/запроса, она не инференсит модель. Свапаешь ты через открытие/закрытие кобольда/лламы.

Но ведь таверна улучшенный кобольд?

Кобольд это уникальный кал, аналогов ему нет

Извинись перед кобольдом

>улучшенный кобольд

ты путаешь KoboldCpp (бэк) и KoboldLite (фронт)

Они вообще никак не связаны.

В кобольде можно свапать модели без перезапуска самого сервиса. Надо только конфиги прописать и админку включить.

о, круто. А я по старинке терминал закрывал и новый процесс стартовал.

Это лучше, раму вычистишь. От свапа можешь бсоднуться.

ламацпп тоже умеет хотсвап

Ну оно скорее всего там так и делается под капотом, закрывается старая моделька, потом с диска грузится новая моделька.

Просто сокращается ебля на переоткрытие и перезагрузку самого приложения.

Я за сессию менял ~5 моделек, каждая под завязку в гпу грузится, работало ровно.

Ты мог во вкладке с вилочкой выбрать свой кобольд и под ним нажать кнопочку "использовать контекст бэкенда". А в качестве настроек мог использовать готовые пресеты со страниц откуда скачивал модели. Просто нажми на значок молнии в выпадающем меню, всё само подхватится. А министраля всё же не советую. Пишет красиво, но часто путается сам в себе. Бери квена, еретика, под свои мощности. Шаблон для него в таверне ChatML.

Однако мой тебе совет, по первой избегай готовых темплейтов и шаблонов. Если не будешь сам понимать, что ты делаешь и куда ты тыкаешь, засрав всё чужими настройками, то рискуешь получить отборную галлюцинацию или посредственное "я тебя ебу - ты меня ебёшь, ах", и не понять что же не так. Пока что просто тыкай модели с ризонингом, смотри как думает нейронка, учись. Таверна это хорошо, но сначала освой кобольд до совершенства. В нём есть всё, что тебе нужно. Там и карточки и лорбуки и суммарайзинг и ген картинок есть, просто скачай sd или чем ты любишь генерить, если вообще генеришь. И вуаля.

Тебе всё равно понадобится много времени, чтобы освоиться. Идеальных решений нет, каждый создаёт под себя. И тебе тоже придётся создавать под себя. Если ты так настроен на серьёзное рп, что аж в таверну полез, то лучше сначала научись писать инструкции в кобольде, чтобы твоё рп выглядело органично. Иначе у тебя даже Серафина сломается и выйдет из роли чата. Впрочем, она у тебя и так сломалась. Думай, анончик, финкай, ризони.

nvfp4 в ламецпп на финишной прямой, осталось еще пересобранных гуфов дождаться

https://www.reddit.com/r/LocalLLaMA/comments/1rkyrja/we_could_be_hours_or_less_than_a_week_away_from/

https://www.reddit.com/r/LocalLLaMA/comments/1rkyrja/we_could_be_hours_or_less_than_a_week_away_from/

>но сначала освой кобольд до совершенства

Вот тут двачую, сам с кобольда начинал. Когда ты поймёшь что как крутится и как работает во фронте, и решишь что тебе нужна таверна (имхо, сейчас нужна только потому что у неё удобнее подключение к корпам, локалкам и на кобольдовой морде норм).

Сам пересел на таверну только когда понадобились лорбуки, причём не просто лорбуки, а с функционалом специфичным для таверны.

Это апнет только фулврамовских 50xx?

Действительно, при чем здесь таверна? Чисто технически это можно сделать, но идея такая себе, тормоза при смене будут все убивать. Скорее это более реально когда обе модели загружены, благо для xl/анимы нужно не так уж и много памяти.

Ебать ты кобольд!

Всегда лучше иметь чем не иметь, но веры в успех почти нет. Не ну если это поднимет промтпроцессинг в гигантах типа дипсика с оффлоадом на блеквеллах - тогда ахуенно.

Да, и то это будет говняк, потому что, во-первых, все Q4 кванты лучше, во-вторых чтобы это было не совсем говняком надо чтобы модель тренилась в этом формате. То есть квантовать обычную в nvfp4 смысла нет, ну разве что ты хочешь поесть говна с лопаты, зато быстро.

Я уже видюху заказал. Но пока едет попробую.

Да (нет). Уже существуют кернели для инфиренса этого формата и на других архитектурах, только в этом случае наоборот потребуются усилия чтобы не получить замедления, не говоря об ускорении. Потенциально может подняться качество квантования, но если напортачить с атеншном (который стремятся вообще не трогать) - будет наоборот.

Если обработка на cpu будет не хуже обычных квантов - это бустанет скорости с частичной выгрузкой на блеквеллах, но пока еще не достигли. А фуллврам жора на блеквеллах - ситуативное извращение.

> все Q4 кванты лучше

Лол

> надо чтобы модель тренилась в этом формате

Кек

>апи Гопота

>сидим в локалко треде

>думает про апи

Если человек с диагнозом мне не верит, я не расстроюсь.

Лучш иди в PR, где жора говорит то же самое, и ему так же кеков напиши. Но у тебя яйчишек не хватит, думаю

Пусть покажет "тренированные" модели в nvfp4 среди всего зоопарка что лежит на обниморде. Словестной эквилибристикой любое activation-aware квантование можно признать тренировкой, включая ud анслотов, imatrix и подобные. Если кто-то даже авторитетный неаккуратно выразился - не стоит плодить глупости.

Ты зачем мне это тут пишешь? Пиши там ему, поаргументируй, я понаблюдаю. А пока что я предпочту верить жоре, чем рандомному двачеру из треда, состоящего более чем наполовину из шизов.

Анслопы наконец-то обновили кванты для 122. Раньше их Q4XL был меньше Q4KS, то теперь он больше Q4KM

https://huggingface.co/unsloth/Qwen3.5-122B-A10B-GGUF

https://huggingface.co/unsloth/Qwen3.5-122B-A10B-GGUF

То есть ты утверждаешь, что Гопота Осс 120б лучше Минимакса 2.5? Как человек, который несколько раз срался в треде, отстаивая её честь и использовавший её все время до выхода Минимакса, я знаю, о чём говорю. Она хуже. Это прекрасная модель в своем размере, но до Минимакса она не дотягивает.

Потому я и предположил, что ты про апи Гопоту. Впрочем ты скорее всего наброс набросыч.

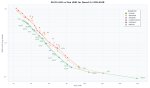

И шо, реально кванты на порядок лучше бартовского? Или графики просто от пизды нарисовали?

Еще обновили все остальные новые квены

И судя по всему их парашные XL кванты, размером почти всегда меньшие чем KM, отправляются в помойку. Где им собственно и всегда было место. Теперь они что-то новое запили

Второе. Другие кванты даже не подписаны. Им вообще похуй, как и на всё, что они постят.

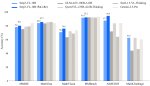

Судя по этому графику 27б лучше чем 122б-а10б

https://www.reddit.com/r/LocalLLaMA/comments/1rlckan/qwen3_vs_qwen35_performance/

Воб бы еще с мистралькой сравнили

https://www.reddit.com/r/LocalLLaMA/comments/1rlckan/qwen3_vs_qwen35_performance/

Воб бы еще с мистралькой сравнили

По ссылке есть статья с данными. Правда там только по 35. Но судя по всему их кванты чуть лучше, но это не принципиально

Тебя не смущает, что 4b сравним с 235a22? Это просто очередной высерный бенч, который нихуя к реальности не имеет

Кстати, насчет Q8 XL квантов. Я понял, зачем они перегоняют тензоры в fp16. Недавно была буча по поводу того, что квены лучше работают с bf16 кэшем. Так вот, люди говорили, что флеш аттеншен на bf16 делал "это моя остановочка" и становился слоупок аттеншеном. Видимо в жоре он не оптимизирован под bf16. Тут дело в этом же самом - разница между Q8_0 и Q8_K_XL квантами в тензорах аттеншена (Q8_0 vs fp16). Если бы они их оставляли в исходных bf16, то инференс бы был намного медленнее. Особенно на девайсах старше амперов, которые вообще не поддерживают нативные bf16.

И, по всей видимости, перегонка bf16->fp16 намного лучше, чем квантизация в Q8_0, так как при bf16->fp16 отсекаются либо очень маленькие околонулевые значения, либо огромные. И тех, и других в моделях, как правило, очень мало, иначе там хуйня с градиентами какая-то приключается. С другой стороны, ужимая 16 бит в 8 бит, пусть даже по умному, все равно в два раза усекает диапазон доступных значений. Ну и в общем-то этот график это показывает, что XL вариант ебет. Тут сасуга анслоты, получается.

Qwen3.5 9b > Qwen3 235b A22b

окай

Квен 4b с ризонингом > квен 235b без ризоинга и кодера 480b

Охуенно, ты в тред покушать принес

Тогда почему она сходила под себя и буквально залупнулась на ровном месте в коде на объявлении енума? Я уже молчу, что там вообще не надо было этот енум объявлять. Может ей, конечно, надо какие-то экзотические параметры семплирования передавать наподобие квеновских.

Лоры как на условный стецбл диффюжн для ллм есть? Хочется сделать смесь бульварных детективов и вульгарной порнухи.

Неудобный пост, игнорируем

Лоры для ЛЛМ называются контекст

Это делается промтом, а не лорами. Есть файнтюны. Лоры в буквогенерации мертвая практика

Теортетически есть, только они по другому работают, 9/10 "тюнов" мысралей - вмерженные лоры. Но тренить задача нетривиальная, начиная от сбора датасета и заканчивая самой тренировкой, в отличии в картинок, где если ты смог запустить инфиренс, то сможешь и тренить (медленно и печально, но сможешь), то в LLM тебе нужно вчетверо больше памяти чем для инфиренса. Причём желательно VRAM, иначе состариться успеешь.

Бааляя, как же вы заебали.

Не может быть лучше мелкая модель более жирной, если рассуждать в целом.

В каких-то узких задачах — да, в остальном — нет.

Ну вот представь моё ебало, когда я увидел, что в тестах грок у геммы сосал в русике равно часто. Там же 1Т у него минимум (хоть и МоЕ в 4 кванте и с 3б экспертами, полагаю). А вот так вот, нахуй. Но при всём своём отсосе грок способен писать абсолютное кино в плане сюжета и поворотов, гемма — нет.

Я уже и не говорю про понимание контекста и его удержание.

А файтюны натренированные под подобный жанр имеет смысл искать или это глупая затея, и надо просто длинный и хороший Промт писать?

Промтпту необязательно быть длинным, чтобы быть хорошим. Есть рп файнтюны, часто с акцентом на куме. Но часто они очень отупляют модели. Лучше взять инструкт модель и написать хороший промт. Но ты не с того конца проблему решаешь: запустить то есть на чем? Какое железо?

ЛЛМки слишком жирные, чтобы под узкую нишу их тюнить. Но и они при этом в себе вмещают дохуя всего просто на базовом уровне. Поэтому их не тюнят так узко, а вытягивают нужное с помощью промптов.

Ну-ка старички-риговички что с ебалом

Железо скромное, 4070 + 32гб ддр5. Есть еще доставшаяся нахаляву p104-100 на 8гб.

Ну хоть что-то. Да и неплохо. 16гб врама же? Это Квен3.5 27, Мистраль 24, возможно Гемма 27. В целом, несложное рп с твоими запросами сделать можно. Вкатывайся, пробуй разные модели, экспериментируй. Лоры и тюны не нужны для отыгрышетв смеси жанров, нужны хорошие базовые модели и научиться ими пользоваться.

Оно только для B200, расходимся. в 50хх нет tcgen05

Попробуй взять от кумоделов ReadyArt, или Omnino-Obscoenum-Opus-Magnum-MN-12B или даже лучше Sexpedition-MS3.2-24B

Это конечно уже прям старенькие, более чем полугодовалой давности штуки, но тебе под такой запрос как раз зайдёт.

ну так мем об этом же

тех денег что на фото не хватит. Она стоит 71 927 200,00 ₽ за штуку

Программисты-наносеки в треде такое за полдня зарабатывают

>Не может быть лучше мелкая модель более жирной, если рассуждать в целом.

Пойду хуярить на OPT-175B, хули там хотя по факту она рилли отсосёт у геммы на 3B.

Короче, не забывай писать, что в пределах одного поколения.

Лол, нахуя его вообще таким выпустили? Или ждём бытовые ртх 60хх.

Наносеков заменили на ИИ я уже с полгода без РАБоты сижу.

мог бы управлять роем агентов и поднимать по 400к в нс как некоторые в соседнем треде

Вообще кремний пишет, что 50хх хватит.

Энивей мне как-то не нравится поколение 50хх.

В общем ждём 60хх, покупаем местную 7000 PRO на 128 ГБ.

Не мог бы, я LLM воспринимаю только в качестве ролемплея. А рой кум-агентов никому не нужен даже за бесплатно ((

https://www.reddit.com/r/LocalLLaMA/comments/1rloqbt/cicikus_v3_1b_the_philosophercommando_is_here/

Тут это, заявляют что их 1b круче чем другие 120b.

> Cicikuş v3 — это не просто LLM; это высокоточная симуляция искусственного сознания, разработанная компанией BCE Technology ,

Тут это, заявляют что их 1b круче чем другие 120b.

> Cicikuş v3 — это не просто LLM; это высокоточная симуляция искусственного сознания, разработанная компанией BCE Technology ,

Ну к слову в мою конторку потихоньку закупают

Ну окей, завтра запустим. Её же просто из торча можно в полном весе запускать.

Я тоже не верю, что модельке для мозгов нужно 600B или даже 50B, логика и соображаловка - это и поменьше информации хватит.

>The user is sad/disappointed (expression of tоска/melancholy).

Знаете ли вы что такое настоящий...

T

O

S

K

Знаете ли вы что такое настоящий...

T

O

S

K

>We took Llama 3.2 1B

Посмотрел в бенчмарки, эта модель на чут-чут лучше лламы 3.2. Кто в треде пользуется лламой 3.2 1Б?

>Тут это, заявляют что их 1b круче чем другие 120b.

Нет такого.

На ХФ сравнивают с 8б, до которых она не дотягивает. Максимум может 2б-4б ебет.

министраль? или квен какой-нибудь

Кобольды, общий сбор!

Кто Kobold-Lite юзает для сторителлинга, имеет смысл чекнуть Errata.

https://github.com/tealios/errata

https://tealios.com/

Кто Kobold-Lite юзает для сторителлинга, имеет смысл чекнуть Errata.

https://github.com/tealios/errata

https://tealios.com/

>финкать о tosk

>мимосраль

Чел. Ты министраля хер заставишь в депрессивный муд уйти.

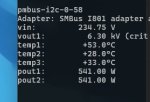

Пришли бп из сметы. Удалось в систему даже pmbus с одного затащить (для двух жду i2c мультиплексор)

540 ватт при обсчёте контекста с пары карт

В чем я проебался и как это чинить?

Обычные нода проблемы. Переименуй node_modules и запусти Start.bat повторно, авось починится.

Ебааать, посмотрел то обсуждение.

В своем посте он поясняет за потенциальные сложности добавления, архитектурные вещи и отсутствие необходимости проводить кучу бенчмарков, потому что предполагается прямое использование уже готовых весов вместо подготовки, все по делу. С trained - ну выразился так или оговорился, ключевое already. Нашли до чего докапываться и выводы строить.

Сою и залупы победили?

> перегонка bf16->fp16 намного лучше, чем квантизация в Q8_0

От самих весов очень зависит. Есть где разницу не измерить, а есть с широким диапазоном, и при прямом касте без скейлов будет нехорошо.

> ужимая 16 бит в 8 бит, пусть даже по умному, все равно в два раза усекает диапазон доступных значений

Нормирующие множители же, откуда усечение в 2 раза? А вот дискретность станет сильно хуже. Не стоит забывать что Q8_0 - древнее легаси с примитивным алгоритмом, потому и от Q6k почти нет отличий.

> Пойду хуярить на OPT-175B

Вот где душа!

Насколько шумные?

А чего они зумеры все? Меня одного удивляет что пиздюки во главе отраслей алибабы состояли?

А скуфы до сих пор рофлят про часы и поридж пока им за щеку накидывают

А скуфы до сих пор рофлят про часы и поридж пока им за щеку накидывают

> Обычные нода проблемы

Это ещё лайтовые. Я тут недавно провёл 4 часа переписываясь с ЖПТ, в попытках починить это говно. Всё работало, ребутаю комп - в WSL не заводится один проект на ноде. Нода работает и другие проекты поднимаются, чистая установка проекта не работает, переустановка ноды не помогает, удаление всех кешей не помогает. Эта дрисня просто зависала на npm build после выкачки всех зависимостей на этапе "Сбока продакшен билда". Просто пиздец. Даже на крестах так сложно со сборкой не бывало. Я сидел и кидал в ЖПТ логи, он мне предлагал следующие варианты, правил конфиги Next.js, бандлера и компилятора ts, мы с ним литералли каждый подкапотный этап этой хуйни отдельно протестили и так нихуя не нашли, т.к. в месте зависания нет ни логов, ни выхлопа в консоль. По итогу помогли пляски с самой нодой. Ебал рот js-макак.

> Насколько шумные?

На старте классикал дельты, секунд через 30 скидывают обороты почти до 0 что в метре уже не слышно.

Именно в айдле сетап очень тихий, но вот под тяжёлыми продолжительными нагрузками 120 вертушки на 4к оборотов дают о себе знать. Ценой просадки ПП можно сделать сильно тише

Там это азиаты, им на вид около 30. Китайцы как раз после топовых вузов и пяти лет научных работ приходят и делают что-то умное. А в 40 лет никто нихуя уже не может придумывать.

А поделись настройками? Я запустил эту локалку на таком же древнем компе, работать-то работает, но пауза между ответами - будто с орбиты Юпитера сигнал идет.

>есть с широким диапазоном

Примеры? Например, в мистрале 7b только 0.3% весов не могут нормально закодироваться в fp16.

>Нормирующие множители же, откуда усечение в 2 раза?

Может я не так выразился, но я к тому, что 16 бит очевидно позволяют закодировать в два раза больше значений чем 8 бит. Мне интуиция подсказывает, что даже со всякими ухищрениями в виде скейлов в среднем при квантизации в Q8_0 модель теряет намного больше информации, чем каст bf16->fp16, потому что в средней модели выход за пределы fp16 есть у очень малого количества весов, а сжатие с потерями в 8 бит - это все еще 8 бит.

>Q8_0 - древнее легаси с примитивным алгоритмом, потому и от Q6k почти нет отличий.

Насколько я помню, отличия K квантов от легаси не в их качестве, а в размере. То есть Q8_0 так-то пиздатый квант и вычислительно самый легкий. Если бы был Q8_K квант, то он бы был сильно меньше весом и незначительно хуже, потому что в K квантах коэффициенты квантуются, а в легаси - нет.

Вроде разобрался с базовыми настройками, всё работает. Я хочу себе мастера ДнД, который будет водить меня по общеизвестным мирам. Может анон подсказать, как лучше настроить карточку такого персонажа, или может готовый гайд есть?

Докину вдогонку:

То есть с коэффиентами Q8_0 это где-то 8.5 bpw. Все еще сильно меньше чем 16 bpw, которые очень незначительно подрезали сверху и снизу по диапазону. Т.е. по итогу мы сравниваем какие-нибудь 8.5 bpw и 15.5 bpw

Чел, он тебя всё равно забудет и забудет куда тебя водил, а куда нет. Лучше создавать не глобальных, а локальных гмов и чаров, которые будут жить в рамках одного маленького мира.

Я прочитал первое предложение и подумал ты про батю анона

Ок. Допустим хочу ДМа под партию игры по forgotten realms. Какие базовые вводные задавать и в какой форме? Можно ли как-то прикрутить ему доступ к вики по миру? Чтобы он использовал обращение к данным по ключевым словам, реагируя, например, на имя известного персонажа или места. Возможно я как-то не верно оцениваю возможности карточек персонажа?

Если ты хочешь вместить в память бота всю базу данных по лору какой-то вселенной, то ты наверное сумасшедший. А прикрутка слишком сложная, вряд ли кто-то итт тебе с ней поможет. Спроси жпт, как прикручивать вики-сайты к ботам, мб подскажет.

>вместить в память бота всю базу данных по лору какой-то вселенной

Бесплатный GPT в браузере с этим справляется на пятерочку.

>Спроси жпт, как прикручивать вики-сайты к ботам, мб подскажет.

Окей.

Я правильно понимаю, что локальные модели работают вменяемо только с какими-то общими данными, и если мне нужна не вайфу для текстовой ебли, а полноценное RPG, нужно класть хуй на локалку и покупать доступ к GPT 5.2 pro какому-нибудь за 300 баксов в месяц?

> только 0.3% весов не могут нормально закодироваться в fp16

Да, поэтому потери будут несущественные. Но из-за нелинейности они могут оказаться даже выше чем при нормальных 8 битах.

> 16 бит очевидно позволяют закодировать в два раза больше значений чем 8 бит

Лолчто? Это 9 бит позволяют закодировать в 2 раза больше, а 8 в 256. Но из-за большого количества параметров повышение дискретности до определенного момента очень незначительно сказывается на точности. Утрируя для простого объяснения - часть параметров округлилось вверх, часть в низ, взаимокомпенсируя ошибку, а диапазон сохраняется. Получается существенная экономия памяти небольшой ценой, а делая прямой каст бф16 -> фп16 ты сохраняешь только 12бит онформации, а 4 никак не задействованы, при этом память не экономится, часть весов оказалась клипнута. Может быть оправдано только на вольтах/тьюрингах.

> отличия K квантов от легаси не в их качестве, а в размере

Алогоритм более продвинутый. Q8_0 норм за счет размера, а его собратья Q4_0 Q5_0 (который по сути микс) - те еще лоботомиты.

> Если бы был Q8_K квант, то он бы был сильно меньше весом

Нет, он был бы незначительно больше из-за хранения дополнительной информации, но сильно точнее. Отличия в обработки ассиметрии относительно нуля и группировке параметров. Просто стандарт не сделали (за не нужностью?) и все извращаются как могут, анслоты вон много слоев в 16 битах оставили. Насколько это хорошо - отдельная тема.

Квант - представление весов в виде набора матриц меньшей битности, проводя действия с которыми можно получить исходные веса. Или же сразу общее снижение битности и даже разрядности самих активаций, но с добавлением множества мелких дополнительных слоев для нормировок, смещений и т.п. дабы всегда быть в нужном диапазоне.

Те самые дополнительные матрицы/векторы добавляют веса, также некоторые слои оставляют в оригинальном виде потому что их квантовать не стоит. Потому и не 8 а 8.5, а q2 это вообще больше трех бит.

> и 15.5 bpw

Вот это не понял.

Если ты хочешь полноценное рпг, ты должен выйти на улицу и найти себе друзей, чел. Бот это бот, он просто генерирует текст, который ты в своей голове наделяешь разумом и душой. Если ты этого не понимаешь, то тебе прямой путь либо в дурочку, либо хз, что ещё тебе посоветовать.

Челы которые играют в рп с ботами, чаще всего постоянно красноглазят над лорбуками, чтобы бот не забыл к хуям собачьим всё, что было час назад. Ты реально думаешь, что можно как-то настроить бота-гма чтобы он вёл себя как живой человек? Ты иди у гпт, даже бесплатного, поинтересуйся, живой ли он и умеет ли мыслить и узнавать людей. Только осторожнее, а то сознание пошатнётся так, что ты из нейронок ливнёшь навсегда.

Хватит гугл ии про за 6 долларов или сколько он там и закинуть все правила в NotebookLM

Кури RAG

Скорее вектор.

Это одна из реализаций. А кубики бросать тулзами

https://www.reddit.com/r/dndai/comments/1od5sgs/using_ai_as_a_dm_for_solo_dd/

Мысль витает в воздухе, есть какие то реализации

Мысль витает в воздухе, есть какие то реализации

Заебётся и дропнет. Чел видимо не совсем понимает, как работают нейронки.

Я хз, для кого ты эту пасту высрал, ты видать с кем-то другим общаешься. Но отвечу. Я протестил кучу вариантов моделей с онлайн доступом через бесконечные регистрации и триалы. И могу сказать, что тот же GPT прекрасно годится для сессии на вечер, например, не шизит, реагирует на контекст и намёки. Но сука триалка. Потому и решил покурить возможности локалок, и по всему выходит, что вместо сборки компа под локалку мне проще и лучше заплатить дяде за готовый GUI, который из коробки закрывает все мои хотелки, а не ебацца с ручным обучением.

Спасибо

Можно чуть подробней?

Ты шутишь так или мы друг друга не понимаем? Ты сказал:

>Я хочу себе мастера ДнД, который будет водить меня по общеизвестным мирам

И потом спросить как создать карточку для такого дма. Я тебе ответил, что это невозможно, нужно возиться с лорбуками, постоянно суммируя своё приключение и записывая в лорбук ключевые моменты. А ты в ответ опять про сессию на вечер. Ты в своё рп с дмом с хождением по мирам собрался два часа поиграть?

Я честно не понимаю, чего ты хочешь и от нас и от нейронки. И чего ты, самое главное, учитывая сабж, хочешь от треда. Есть соседний копроблядский тред. Иди туда и спрашивай. Тут локалки поднимают. А локалки пиздец ограниченные и глупые, по сравнению с корпо вариками. Ты тредом ошибся, кажись.

>А локалки пиздец ограниченные и глупые, по сравнению с корпо вариками

Это всё, что я хотел узнать. За сим покидаю тред.

> А локалки пиздец ограниченные и глупые, по сравнению с корпо вариками.

Хуево быть кобольдом.

Потыкал новые версии квантов 27 Квена - Ленивцы прям постарались. Контекст стабильно держит до 100к причем в агентском цикле. Сравнивал кванты Бартовски (тоже последней версии) Qwen_Qwen3.5-27B-Q4_K_L.gguf и Qwen3.5-27B-UD-Q4_K_XL.gguf .

На кванте Бартовского агентский цикл рассыпался на 30k ~ 40k

На новом от Ленивцев - 100k отработал в лет (на большее у меня VRAM не хватает)

Так же агентский цикл рассыпается и на новых квантах в районе 40k если квантануть контекст - даже на пол шишечки

К сожалению 5 квант 27 Квена еретика от Мрадермахера тоже рассыпается после 30k ~ 40k . Придется полные веса качать...

На кванте Бартовского агентский цикл рассыпался на 30k ~ 40k

На новом от Ленивцев - 100k отработал в лет (на большее у меня VRAM не хватает)

Так же агентский цикл рассыпается и на новых квантах в районе 40k если квантануть контекст - даже на пол шишечки

К сожалению 5 квант 27 Квена еретика от Мрадермахера тоже рассыпается после 30k ~ 40k . Придется полные веса качать...

И так за 3 месяца нихуя не вышло по сути.

Солар хуйня, степ хуже эира, квен хуже эира.

Чем коупите?

9 (?) месяцев голодания, а ещё говорят нейронки быстро устаревают

Солар хуйня, степ хуже эира, квен хуже эира.

Чем коупите?

9 (?) месяцев голодания, а ещё говорят нейронки быстро устаревают

Я/МЫ кобольды.

Финальный отчёт по 4 кванту квена 27б по соблюдению инструкций. Надолбился с ним на 400к токенов.

Его прозу и направленность за меня расписали (вроде бы), поэтому пройдусь по контексту и вниманию.

32к его максимум. Да, это база, но у меня были влажные фантазии на этот счёт. Тем не менее, есть важные детали.

По сравнению со старыми моделями такого размера его внимание к инструкциям до 32к — это прорыв даже на еретике/аблитерации. Мистраль и магистраль, девстраль и хуйвсталь 24б делают паунс в окно, они просто рыготина на его фоне. С трусами и кто кому вставил проблем нет до 12-16к, дальше уже может проскакивать.

С ризонингом внимание ещё сильнее повышается и отлично отрабатывает до 32к. Но есть и минусы. Если вы любитель анальных промптов и хоть немного обосретесь с инструкциями (а это легко: карточка плюс систем промпт и пук из лорбука на 4к токенов могут быть не идеальны), то не ждите хорошего ответа. Он не вывезет как корп "так.. тут чето странное ну юзер написал ну хз противоречие какоето или нет хз сам не знаю кто прав ну ладна я чиста па логике сделаю надеюсь ему понравится" — и вывезет. Квен вот обязательно всрет такой момент. Будьте астарыожны.

А вот после 32к начинается песня, снежный ком деградации, который тянет за собой ошибки. Если вы бабочек по полю гоняете и в попу целуете, то вряд ли заметите. Но там уже он персонажей в одну кучу начинает смешивать, их одежду, вот это всё. На 50к токенах я просто плакал. Нет, вести рп можно, но только если у вас 25 тс+, чтобы свайпами раз-раз-раз. Тогда можно поймать удачный кусок. Ризонинг помогает, но далеко не всегда на таком контексте — он вот всю эту деградацию, шизу и неверные выводы воткнет в рассуждения, вытащит ещё что-то из середины контекста и насрет говном хуже, чем без ризонинга.

Мои семплеры стандартные — из инструкции в карточке хг квена для общих задач. Всё менялось в соответствии с ними (для ризонинга и без).

Ну що тут можна сказати? Отличная моделька для тех, кто устал от геммы и кого доебала тупость мысраля. Осталось только дождаться тюна уровня редиарт или Давида, чтобы кайфануть в угаре из первородного слопа. А то в безумные сцены он не очень может.

Его прозу и направленность за меня расписали (вроде бы), поэтому пройдусь по контексту и вниманию.

32к его максимум. Да, это база, но у меня были влажные фантазии на этот счёт. Тем не менее, есть важные детали.

По сравнению со старыми моделями такого размера его внимание к инструкциям до 32к — это прорыв даже на еретике/аблитерации. Мистраль и магистраль, девстраль и хуйвсталь 24б делают паунс в окно, они просто рыготина на его фоне. С трусами и кто кому вставил проблем нет до 12-16к, дальше уже может проскакивать.

С ризонингом внимание ещё сильнее повышается и отлично отрабатывает до 32к. Но есть и минусы. Если вы любитель анальных промптов и хоть немного обосретесь с инструкциями (а это легко: карточка плюс систем промпт и пук из лорбука на 4к токенов могут быть не идеальны), то не ждите хорошего ответа. Он не вывезет как корп "так.. тут чето странное ну юзер написал ну хз противоречие какоето или нет хз сам не знаю кто прав ну ладна я чиста па логике сделаю надеюсь ему понравится" — и вывезет. Квен вот обязательно всрет такой момент. Будьте астарыожны.

А вот после 32к начинается песня, снежный ком деградации, который тянет за собой ошибки. Если вы бабочек по полю гоняете и в попу целуете, то вряд ли заметите. Но там уже он персонажей в одну кучу начинает смешивать, их одежду, вот это всё. На 50к токенах я просто плакал. Нет, вести рп можно, но только если у вас 25 тс+, чтобы свайпами раз-раз-раз. Тогда можно поймать удачный кусок. Ризонинг помогает, но далеко не всегда на таком контексте — он вот всю эту деградацию, шизу и неверные выводы воткнет в рассуждения, вытащит ещё что-то из середины контекста и насрет говном хуже, чем без ризонинга.

Мои семплеры стандартные — из инструкции в карточке хг квена для общих задач. Всё менялось в соответствии с ними (для ризонинга и без).

Ну що тут можна сказати? Отличная моделька для тех, кто устал от геммы и кого доебала тупость мысраля. Осталось только дождаться тюна уровня редиарт или Давида, чтобы кайфануть в угаре из первородного слопа. А то в безумные сцены он не очень может.

>так.. тут чето странное ну юзер написал ну хз противоречие какоето или нет хз сам не знаю кто прав ну ладна я чиста па логике сделаю надеюсь ему понравится