ну что поделать он вернулся, потому без базы треда

напишу разве что дежурное жизнь есть от 3bpw

все модели умницы, если вы не согласны то у вас скилишью и рак жопы

напишу разве что дежурное жизнь есть от 3bpw

все модели умницы, если вы не согласны то у вас скилишью и рак жопы

На первом охуенчик, проорал и схоронил. ушёл в третий коридор

>Почему не еретик?

normpreserve это не "для нормисов", это тоже анцензор, причём хороший, настолько что даже не заметна разница в мозгах там где именно "нормисовский" контент, но при этом в куме и чернухе тоже в отказ не идёт и всё по красоте пишет.

Заставить анценз модель сказать слово хуй это не чернуха, чел. Впрочем, я никогда никого ни в чём не убеждал и не навязывал. Гоняй то, что тебе нравится, я не против. Я от геммы тоже добивался вполне хороших результатов, вполне хорошая модель. Но мне не нравится, как она пишет тексты.

Перекатчик случайные картинки с тырнетов берет, или он так вычистил свою клаву перед заливом?

поясните пжлст что не так с давидом?

>мимоанслотник-мрадермахерист

>Ну ... кому-то может даже зайдет такое :)

Лол, от такого можно урон по рассудку получить, лавкрафтиана отдыхает.

Дак будет ссылка на твой любимый квен, или зажопишь как пресетик?

>что не так с давидом

Ну, все его модели сломанные шизохрени, но, что, сука, характерно, они иногда получаются правильно и интересно сломанные, и гонят связную дичь от которой волосы на жопе встают дыбом. Ну, анценз и кум в комплекте. Одно из его старых творений - MN-Dark-Horror-The-Cliffhanger-18.5B-D_AU-Q8_0 у меня до сих пор лежит.

Какая хорошая модель для русского кобольда ?

Вот эта хорошая https://huggingface.co/zai-org/GLM-5 ?

Вот эта хорошая https://huggingface.co/zai-org/GLM-5 ?

Зависит от того какая у кобольда пекарня в пещере.

Ну памяти достаточно я пару игр удалил сейчас вот качаю https://huggingface.co/zai-org/GLM-5

Она нормальная для русского кобольда ?

Я просто только вчера установил, по совету из шапки там СайГа Ремикс. Начал с Серафимой общатся, она сказала по русски плохо понимает потому общались на английском. Но он у меня очень приметивный. Потом в какой-то момент она начала говорить только по 57 токенов, я по совету опытного который мне ответил проверил все но не помогло. Вот думаю что больно старая эта СайГа Ремикс уже, может она у всех такая но никто ее кобольду не подключает ?

ОП берёт картинки из треда. А уж что в тред постят, это на совести анонов.

>Но он у меня очень приметивный.

Русский у тебя тоже преметивный.

Ха-ха, то ли жирно троллишь, то ли не очень разбираешься. Этот Глэм ты не запустишь если только нет своего рига на полкомнаты, а если бы был, то такие вопросы не задавал бы.

Лучше возьми Ministral-3-14B-Instruct-2512-absolute-heresy.Q6_K для начала.

> почти всего треда фи и фуфуфу от минимакса

Тому что хорошая но узконаправленная модель. После всех перепердолингов получаемый результат для рп может не оправдать усилий. А может и оправдать, или просто особенности ляжут на конкретные чаты и субъективность.

Да, вполне годная штука. Хз насчет кума по сравнению с прошлыми, но смешанный рп в нем очень даже шагнул вперед.

Только ты ее врядли запустишь.

Перетолстил.

Зачем ты продолжаешь советовать и рекламить степу если сам же пишешь что им невозможно пользоваться без шизоразметки которой ты не делишься?

Чтобы что?

>Ministral-3-14B-Instruct-2512-absolute-heresy.Q6_K

но зачем? Министраль и так без тормозов, куда ей ересь? Ей бы прозы какой-нибудь плотненькой, описательной, да на русском языке, про роботов, про тентаклей, про лафкрафта в датасетик.

>слив

Думайте сами.

Вот я дурак, а думал-то что надо чтобы модель на диске была. А оно вон как. Буду разбираться... Там на ютубе даже русские видосы есть. Пошел смотреть. За рекомендацию Ministral-3-14B-Instruct-2512-absolute-heresy.Q6_K спасибо !

Запустилась, вроде бы получше СайГи Ремикс.

Разметка у Лламы поехала. Что же это такое творится то посредь бела дня

Страдай с нами. Или это ты Ламу выпустил погулять?

Забей. Там весь диалог максимально странный. Аноны сидят пердят, всякую хуйню обсуждают и тут хуяк: ага, стёпу обсуждаете. Чё блять? Потом какой то театр самоотсоса. Не знаю, выглядит как семенство.

там был срач за степ флеша, его протерли, а дальнейшее обсуждение нет

первый раз?

>какой то театр самоотсоса. Не знаю, выглядит как семенство

Два анона пообщались друг с другом как нормальные двуногие, не плюнув друг другу в рожу и не выебав чью-нибудь мать. На двачах. Трудно поверить, да?

И правда, лол. Видимо за переход на личности потёрли

У меня вроде не проявилось пока. А так если что - можно отмотать на два дня назад, b8210 например

Он буквально скрин этой разметки выложил, ты шо, слепошарый?

> Попробую позже.

Если на диске уже есть скачанный на релизе квант - можно смело удалять. Еще на большом иногда случались странные качели по повествованию, проскакивали иероглифы посреди английского текста (с расшифровой в скобках потом, лол), странности в ризонинге. Это все следствие как минимум кривого кванта анслотов, потому что в заведомо нормальных такого и близко нет. По первым ощущениям отличия не столь разительны как на 122, где буквально другая модель, но ни одного из тех косяков нет. Есть шанс что 374 в рп очень даже ебет, а не ситуативен или ум оплачивается ожиданием ризонинга.

Оказывается они вообще для всей линейки включая большого кванты перезалили, возможно уже поправлено.

Это моя фотка - не бубни! Люблю чистоту! Чистота - залог здоровья!

Жопу помыл?

Ононы, как там квен 35б-а3б по сравнению с 27б? Насколько там хуже проза и всё, что важно для РП?

Жора срет какой-то хуйней в консоли на последней версии (b8233) на глм флэше, другие модели не проверял.

Он ебнутый шиз. В хорошем смысле, наверно. Но он срет странными мержами и файнтюнами в бесконечном количестве. Его работы на 99% это полный пиздец. И 1% - это что-то очень свежее и прикольное. Его описания моделей, если они есть, это полная дичь из разряда ДИП БРЕЙН БУСТ МЕГА 9000. Его история с классами моделей - тоже полный бред. В общем, это какой-то вайлдкард, у которого есть бабки на файнтюны непонятно с хуя. Аутист, который делает это чисто по приколу. Chaotic neutral. Mega chaotic neutral.

Утра всем.

Как и чем правильно открывать подобные модели? https://huggingface.co/zai-org/GLM-4.5-Air/tree/main

Как и чем правильно открывать подобные модели? https://huggingface.co/zai-org/GLM-4.5-Air/tree/main

да я просто удивлен, впервые такую чистую клаву вижу. Просто апплодирую.

Какой же жора говнодел, блядь, квен уже почти месяц как выпустили, а баг с постоянным репроцессингом контекста так и не починен.

Тиво? Всё работает. Правда, на лламе чёт очень медленно по тс и пп, хоть и репроцессинга нет, а вот сейчас в коболдянского завезли какой-то костыль и скорость АГОНЬ. Почему такая разница — не знаю. Попробуй его. Смарт кэш в какой-то вкладке.

В ламме были чекпоинты и ещё какие-то функции, уже не помню, я их юзал сразу после того выкатили эти новые квены и обновы для лламы, но с ними всегда падение скорости было очень существенное.

Впрочем.. какую модель ты пытаешься запустить? Тот же квен 80б вроде бы до сих пор мозги ебёт.

>акую модель ты пытаешься запустить

квен3.5 - 9B для перевода книги. Постоянный репроцессинг контекста в этой задаче это просто пиздец.

Как правильно работать с силли таверна и кобольд. Сейчас я, например ,контекст, его сжатие и подобные мелочи настраиваю через кболдьа, а в таверне промты, картчоки и т.д.

проще управлять всем через таверну, но емнип, максимальную ширину контекста изначально надо выставлять в кобольде, а в таверне выставлять такую же или меньше (в зависимости от целей)

Тут кто-то в прошлом треде принес: https://github.com/tealios/errata

Первое - ему спасибо, забавная штука.

Второе - предупреждаю: если там с локальной моделью "однокнопочно" пытаться все сделать - будет дикое разочарование скорее всего. Я тут ее с Qwen 3.5 27B попробовал. И насколько мне квен зашел в RP с моими настройками таверны, настолько же здесь он порет унылую слопную хрень на дефолтных настройках. Хорошо, я знаю - он может совсем иначе. А то сейчас бы уже, наверно, говном кидался не хуже остальных здешних чемпионов по этому делу. :)

Порылся в настройках, докопался до внутренних промптов... В общем да, они явно под корпов писаны, такое точно надо править под локалки, а тем более под квен. И такая возможность тут есть... но минусом здесь то, что такие настройки привязаны к проекту (в проекте может быть рассказ или серия - с общим миром и данными). С одной стороны - гибкость, а с другой - задолбает, наверное, под каждый проект заново править.

Теперь хорошо понял квен-хейтеров с мнением, что новые квены УГ. Мне то повезло - я просто запустил его на своих рабочих детальных промптах и WI от геммы с air, и получил сразу годный вывод. А если запустить на пустом контексте с дефолтом... ух и generic слопогенератор получается.

Только сами промпты не просите - там нет ничего магического. Просто обычный подробный промпт с описанием желаемого поведения DM (здесь переделан под writer) под личные вкусы и лор сеттинга, суммарно на 2-4K токенов (Именно это ключевое - непротиворечивый объем начальных данных). Квен просто хорошо ему следует, вот и вся мистика. Специально проверил на нескольких разных версиях для разных тем.

Первое - ему спасибо, забавная штука.

Второе - предупреждаю: если там с локальной моделью "однокнопочно" пытаться все сделать - будет дикое разочарование скорее всего. Я тут ее с Qwen 3.5 27B попробовал. И насколько мне квен зашел в RP с моими настройками таверны, настолько же здесь он порет унылую слопную хрень на дефолтных настройках. Хорошо, я знаю - он может совсем иначе. А то сейчас бы уже, наверно, говном кидался не хуже остальных здешних чемпионов по этому делу. :)

Порылся в настройках, докопался до внутренних промптов... В общем да, они явно под корпов писаны, такое точно надо править под локалки, а тем более под квен. И такая возможность тут есть... но минусом здесь то, что такие настройки привязаны к проекту (в проекте может быть рассказ или серия - с общим миром и данными). С одной стороны - гибкость, а с другой - задолбает, наверное, под каждый проект заново править.

Теперь хорошо понял квен-хейтеров с мнением, что новые квены УГ. Мне то повезло - я просто запустил его на своих рабочих детальных промптах и WI от геммы с air, и получил сразу годный вывод. А если запустить на пустом контексте с дефолтом... ух и generic слопогенератор получается.

Только сами промпты не просите - там нет ничего магического. Просто обычный подробный промпт с описанием желаемого поведения DM (здесь переделан под writer) под личные вкусы и лор сеттинга, суммарно на 2-4K токенов (Именно это ключевое - непротиворечивый объем начальных данных). Квен просто хорошо ему следует, вот и вся мистика. Специально проверил на нескольких разных версиях для разных тем.

Я бы не задавал подобных вопросов, если бы не прочитал все это. Там нихуя нет гайда, как это запускать и спользовать.

Вот кому ты пиздишь? Ты даже не пробовал.

>Теперь хорошо понял квен-хейтеров с мнением, что новые квены УГ

Новые квены УГ не потому что пишут плохо. Это всё можно распердолить и не так страшно. Говно они вот почему:

1) Огромные простыни ризонинга бай дизайн, треть из которого уходит на прогон фильтров безопасности.

2) Сломанный ризонинг который совершенно рандомно то работает, то срет пустыми <think></think>, то вообще не включается.

3) Ведро сои из коробки, которую нужно либо фиксить шизопромптами либо накатывать еретик. Что из этого больше лоботомирует бедолагу вопрос дискуссионный.

4) Пересчет контекста после каждого отправленного сообщения, и чем больше сообщений в истории чата тем дольше пересчет. Это вот такой ценой достигается легкий контекст? А можно не надо? В мистралях он тоже легкий, но ничего не пересчитывается по кд.

По отдельности с этим можно было бы мириться, но всё в совокупности делает модель тем самым УГ. Для себя не увидел в ней какого-то смысла при наличии эйра в Q4 и 235b квена в Q2.

У меня:

1, 3 - не наблюдается. Расцензуренная версия от двучена. Мозги, вроде, вполне на месте, агенты с ней работают, ничего не теряется. Ризонинг в пределах 1K - на серьезных вопросах (см ниже) - терпимо т.к. по делу.

2 - пустыми think не срет, а ризонинг включает только на сложных вопросах, а не когда надо ответить на что-то вроде "привет, как дела?", выглядит вполне по делу.

4 - нету у меня пересчета контекста. Бекэнд - llama собраная неделю назад. Прекрасно все кешируется.

https://github.com/AlexsJones/llmfit?tab=readme-ov-file

Утилита для тех кто не знает какая модель заведется на пека + подбор параметров

Утилита для тех кто не знает какая модель заведется на пека + подбор параметров

Ну енто скилишью, у меня никаких проблем нет кроме того что квен как был сухой слегка пережаренной какашкой так и остался

кстати о агентах, Какую версию лучше впихнуть на 16Гб врам для плотной 27B для котинга?

i1-IQ3_XXS (я качал для кума в основном) или IQ4_XS или еще какой то вариант?

>на 16Гб врам для плотной 27B

Купить еще 16Гб VRAM.

>16Гб

>Q3

>XX

>S

Проиграл чёт.

>i1-IQ3_XXS

Каждая буковка i хуярят по русику, если что

>(я качал для кума в основном)

Не понимаю, почему для кума ты качал микроквант, если можешь скачать больше. У меня 16гб я использую IQ4XS спокойно

Для агентских я бы использовал мое, например их 35a3b. Там даже с большим контекстом будет быстро

У меня iq4xs от двучлена, но кодинг с ней я не пробовал. Агенты/инструменты - работают, для этого ее хватает. Но у меня 20GB VRAM а не 16.

Не, ну серьезно - 5060 TI как была так и осталась в цене по 55к . Жрет при инфиренсе ЛЛМ не больше 150 ватт, может быть запитана даже через переходник от молексов. Греется умеренно. Нет никаких системных проблем поставить ее второй картой и иметь полноценную генерацию плотных до 35B и при наличии оперативы - moe до 110 Б. Это не РИГ собирать за пол ляма - тупо пошел -купил -наслаждаешься. Две карты так же дают простор одновременной генерации текст + картинка.

Квантование ниже Q4K_M реально убивает мозги ЛЛМ даже на размерах в 100Б - проверено на Air. А ты тем более вошел во вкус и хочешь "агентский цикл"

Я думал о второй карте, но есть одно но, я её буду использовать в egpu с тандерболтом (TH3P4G3, едет пока). Я пока не нашел вариантов на 2 видяхи в один порт, может плохо искал

> 5060 TI

Как думаете в связке с 3090? У меня просто место физически в корпусе нет из-за ебаного стола, куда большй корпус не влезет. А как снаружи монстрячить хз.

>осталась в цене по 55к

Не, она дешевле. 50к примерно или чуть меньше. В моменте до 42 уходила. И да, это 16гб

В 2 раза медленнее память, несмотря на то, что более новая

да и когда подрублю к ноуту по тандерболту, то у меня еще будет 3060 6гб на ноуте (правда ноут греться будет, это я не особо люблю)

Краткий гугл говорит что 2+ видяхи через тандерболт работают только для интелов 12+ поколения, а у меня ноут на 11 поколении.

https://egpu.io/forums/thunderbolt-enclosures/connecting-multiple-egpus-to-a-thunderbolt-4-pc-using-a-thunderbolt-4-hub-dock/

>в связке с 3090

Думаю заебись. Комп окончательно не станет печкой + нет шансов попасть на ужаренное майнингом говно если покупать БУ 3090

Похуй на медленную шину памяти т.к. и памяти меньше чем в 3090. И при инфиренсе на 2-х картах там уже тормоза от PCI будут больше, чем от внутрикарточных трансферов. Плюсом идут фишки новой архитектуры, меньший размер, меньшие требования по питанию и охлаждению.

> А как снаружи монстрячить хз.

Продаются кабели удлинители

Я когда покупал 5060ti, сравнивал её с 5070ti. Шина памяти в 2 раза быстрее, скорость инференса тоже в 2 раза быстрее но и цена тоже в 2 раза больше и тепловыделении скорее всего тоже больше. меня скорость 5060ti сейчас полностью устраивает и греется не очень сильно, выше 70 не поднимается.

>у меня еще будет 3060 6гб на ноуте

Я б не рассчитывал - ты убьешь перегревом ноут, а особого выигрыша от 6Гб VRAM не получишь. Можешь даже и потерять - ноутбучная 3060 будет самым медленным звеном в системе и пока она будет пердеть все остальные будут ее ждать.

По чем итт-господа брали ми50 32г? На алике в диапазоне 35-40к есть, дорого?

поэтому и жду егпу. еще альтернатива - собрать некро-микропк на несколько слотов, но память выходит дороже видях и остальных комплектующих и поэтому пока отложил эту затею.

Это цена в100 уже. Хз имеет ли их смысл дороже 20 брать. По 10-12 был топ под пердол

Значит я слепошарый, потому что я этого не нашел.

>скорость 5060ti сейчас полностью устраивает

Аналогично. 4060ti + 5060ti - скорости полностью устраивают. 27 Гемма и Квен в пределах 12-15 т.с. генерация, 500 т.с. процессинг. Контекста влезает 100k+ . В толстых мое скорости все равно упираются в RAM

За 40к они и на авите есть. И в100 за 50к. И 2080ти 22гб за 30к.

Аноны, кто-нибудь заказывал с таобао? Как это вообще делать? Нужное железо оказалось только там.

в100 30к, 4к плата, 1к провода к ней.

в100 30к, 4к плата, 1к провода к ней.

>можно подробный гайд как с табао заказывать?

1. регаешь загран нового типа

2. регаешь китайский алипэй (нужен загран и телефон с nfc)

3. регаешь таобао акк (сразу через настройки поставь пароль т.к. не всегда приходят смс)

4. регаешь акк на youcanbuy (или у другого пересыла, но я юзаю его)

5. на тао забиваешь адрес по инструкции с юкб

6. наваливаешь чего нужно в корзину

7. пополняешь алипэй через кого то (через мужика с форума юкб делаю, 300+к уже через него провёл)

8. заказываешь на тао

9. когда всё пришло на юкб там собираешь посылку (не забудь выбрать наложенный платёж а то придётся в саппорт писать, карточки то отвалились)

10. ждёшь

Редакция от 12.04.2024, больше инфы можно найти в /pvc

Сейчас есть изменений но не фундаментальные

>в100 30к, 4к плата, 1к провода к ней.

Это не на алике и не на авите.

Спасибо огромное!

Именно на алике. 2 месяца назад так брал.

Как те аноны, которые лифтовой плк и дохлую картонку на руки получили от забаненного магаза? Тут счет на недели идет, нет уже цен таких.

Да как так, я же по 30к с небольшим брал у них...

> 1)

Инфиренсопроблемы, битый или лоботомированный квант

> 2)

Инфиренсопроблемы, модель работает в двух режимах и предполагает конкретный темплейт для каждого, а не отсутствие префиксов с рандомайзером семплерами.

> 3)

Пункт 1 или шизопромпты

> 4)

Инфиренсопроблемы. Если юзаешь жору - накати свежие коммиты и не ставь припезднутые параметры запуска.

Что-то вышло ультимейт кобольдскиллишью-бинго.

Несколько скриптиков на питоне просил генерить квен 27б, квант iq4xs, хорошо справляется. Запускается с первого раза. Бывают баги в плане что не предусмотрел какие-то менее очевидные кейсы, один запрос - и все пофикшено.

По личному опыту, работает лучше, чем бесплатный дипсик.

Но на дико сложных задачах и длинных контекстах не тестил.

Интересно как 122б мое в сравнении с 27 плотной. Только не тащите юзлес бенчи. Тестил кто сам?

>Несколько скриптиков на питоне просил генерить квен 27б, квант iq4xs, хорошо справляется. Запускается с первого раза. Бывают баги в плане что не предусмотрел какие-то менее очевидные кейсы, один запрос - и все пофикшено.

Флоппи-берд на 8086 дается крайне тяжело, я сдался роллить. Квен вроде бы и понимает что это такое, и частые паттерны оптимизации еа платформе, и как флоппи берд в целом работает, но попытки замесить это в единую концепцию на чистой сишке проваливаются. Квен молотит типовой подход с перерисовкой всего экрана, при этом подмешивает dirty tracking в итоге игра еле ворочается и с кучей глитчей. С другой стороны, если подумать - даже работоспособный код, собранный с дополнительным анализом выебонов конкретного компилятора, для модели такого размера очень даже ничего. Реверс инжиниринг старого видеобиоса тоже ни рыба ни мясо, хотя тулзы и базовые принципы реверса знает.

В сухом остатке уровень модели: джун на третий день после трудоустройства, немного разобрался, но какие-то архитектурные решения и контроль деталей все еще никакой. До клода далеко, но скриптики и какие-то локальные правки проекта пилить в фоне пойдет, и судя по всему будет моей основной моделью до следующего отрывного релиза.

мимо на ud-q6-k-xl

> 8086

Это что? 80б кодер Некст?

Спасибо, перекачиваю кванты.

Я тут покопался в файнтюнах, свежачок подъехал https://huggingface.co/Jackrong/Qwen3.5-27B-Claude-4.6-Opus-Reasoning-Distilled

Качаю потыкать

тут имхо нужно еще придумать как подсовывать модели актуальные знания и при этом не засорять контекст.

На свежих квантах анслотов еще не сравнивал. На 4 квантах Бартовский по ощущениям - 27 более четкая и активная чем 122. 122 как то более "на отъебись" работает, что ли. По крайней мере в стандартных бизнес-задачах. Как там в чем-то специализированном проявляется больший объём знаний 122 модели пока не понял.

> подсовывать модели актуальные знания

Там из актуальных знаний - ток блокнотик с перечнем моментов конкретного компилятора, составленный в предыдущих раундах. "Цепкость" модели низкая, каждый хак нужно прописывать явно. Взять тот же биос, он был немного попячен - квен не осилил, но я потом мотнул в середину бинаря и оказалось что он в формате dual chip interleave (каждый четный байт идет с середины бинаря). Чисто на логику задачка небольшая.

Че, нам только китаекалки жрать теперь? Где там новая гемма 4, коммандер а2, мистрали средние плотные? Че один моемусор, который тупее 3.5 турбы, выходит?

Хорус пидор все испортил

если выпускать умные маленькие локальные модели то кто будет покупать подписки?

Те кто хочешь километры контекста? Нейросети так-то рабочий инструмент, юзаемый писателями, сценаристами и прочими творчеблядьми.

> юзаемый писателями, сценаристами и прочими творчеблядьми.

Не используют. Пейсатели вообще могут на WordStar 4.0 сидеть. Плюс, неизвестно, что с авторскими правами - ни один издатель не примет книгу, если в её создании применялся лоботомит, даже если непосредственно проза не генерировалась, так как любой высер с хоть какими-то следами от сетки улетает в public domain.

Ты слишком высокого мнения о современной литературе, анончик.

А что, долбоебы покупают "книги", в которых полно запаха озона, Элар и Каэлов, шепчущих лесов, докторов Эйрисов Торн, мистеров Хендерсонов и прочего слопа? Это же говно, место которому в печке или подпирать дверь в сортире. Хотя, так было и до нейронок, когда 95% книг это говнище. Сейчас это число стало 99%.

>А что, долбоебы покупают "книги"

Слоп был всегда, просто раньше он был честной бесталанной отсебятиной или банальным воровством. Теперь стало можно генерить всё то же самое силами нейронок. Спрос как был, так и остался.

У меня кобольд сожрал деда

Сижу в ахуе

Сижу в ахуе

Да вот, новую гемму уже заждались. Сейчас в основном только у Великого Кси остался нефритовый стержень достаточного размера чтобы выпускать

Километры контекста подразумевают наличие мозгов чтобы с ним как-то работать, а не просто воспроизводить примерно подходящий кусок из него. Именно сторитейлинг и подобное является наиболее сложными задачами, потому что требует учета сразу множества факторов, точного понимания и логики.

Ты вообще штампуемую литературу давно видел? Нейролоп и логические ошибки тупых ллм отдыхают.

Кекнул с твоей наивности. Ты поди поредж, раз не знаешь, каким был книжный мир в девяностых и ранних нулевых. Какого пиздеца там только не было, вплоть до оглавлений на английском оставшихся от оригинала. Кто-то явно проваливал чек на ризонинг. Тем не менее, покупали. И даже в десятые всё ещё покупали подобный мусор. И сейчас в книжных полки ломятся от подобного.

Ну а если говорить про людей уже набивших руку, то им лишь дай текст и они его отредачат за сутки. И можно печатать. Всего сутки работы, вместо недель или месяцев.

Сорян, не настолько скуфидон. Но отголоски этого "наследия сралкера" видел, буквально шизоидные филлеры и фанфики.

Что сказать то хотел? Зашел с выебонов и тутже согласился.

В кого зашёл?

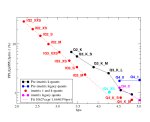

Квад ми50 атлант встал на ноги (в прямом смысле сделал ему дно и ножки). Обновил ему вллм до 0,12,0 и теперь на 0 контексте в один поток 43 попугая в awq гемме3 27. Норм бенчи и табличку позже сведу.

На 0,11,0 в этом же кейсе было 21 тпс

розетка 1 - общий жор

розетка 2 и 3 - блоки видеокарт по 2 шт

На 0,11,0 в этом же кейсе было 21 тпс

розетка 1 - общий жор

розетка 2 и 3 - блоки видеокарт по 2 шт

Сейчас запустил мистраль 24б (долгое время сидел на гемме, потом на толстых МоЕ/корпах, иногда на гемме). И это просто пиздец. Какой же мистраль тупой по сравнению с квеном 27б, это просто ахуй. Затем я запустил мистраль 12б и даже не вижу разницы между 12б и 24б с первого раза. Как будто бы все инструкции игнорируются полностью. А девстраль/магистраль и прочие вариации настолько сухие, что ну их нахуй.

После квена всё будет тупым казаться.

Попробуй этот тюн - https://huggingface.co/mradermacher/Magidonia-24B-v4.3-i1-GGUF

я на Q4_K_M сижу. скорость генерации Generate:22.61s (40.78T/s),

настройки прикладываю https://dropmefiles.com/jl1sx

В художественный текст умеет? Красиво пишет?

По чем карты брал?

В прошлом треде BOM кидал. В среднем 12+1к вышло

Пользовался. Да, ризонингом соблюдение инструкций можно контролировать хоть как-то, но всё равно ёбаное мучение, а ещё там соя пролилась, потому что нет аблитерации или еретика.

>девстраль

девсраль ващет для кода

>запустил мистраль 12б и даже не вижу разницы между 12б и 24б с первого раза.

как будто у тебя какие-то тупые шизомерджи, всратые семплеры или ты пытаешься с ними ролить на русском (в который они не хотят/не могут). Или всевместевзятое. В ориге разница между немо и смаллом в разы по мозгам.

Но да, замечу, что самому 24б не зашла вообще, да я и не пытался ее особо распробовать...

мимо министраль14б-енжоер

>Че, нам только китаекалки жрать теперь?

Локалки были чем-то вроде "позабавилась и хватит" для многих контор. Кто-то набивал руку, кто-то тупо искал инвестиции, кто-то пытался продаться. Китайцы не исключение. Чем дальше, тем меньше будет и тех и других. Да и банальное - зачем стрелять себе в хуй и лишаться прибыли с подписок, оно тоже, да.

Вот только непонятно, кто захочет жрать говно за деньги. Взять ту же кими. 1Т параметров, минимальная стоимость подписки 30 баксов, качество хуевое, сосет даже у чат гпт.

То есть в теории та же кими выебет гпт, если речь о подписке, но не потому что она круче, а потому что лимиты выше, больше возможностей вроде анальных изъёбств с агентами (но сначала придётся заставить эту падлу хоть как-то слушать твои инструкции и не шизить), а холопу с гпт по подписке за 20 баксов такое не положено. Однако за по сырой мощи он выебет, а уж тем более со всякими тулзами и обаязками.

Так что подписочные варианты всяких квенов и прочих нахуй не нужны никому, разве что дешёвое апи для некоторых задач топ за свои деньги.

>подписочные варианты всяких квенов и прочих нахуй не нужны никому

Ну так и есть по факту. Кроме китайцев, наверное, ибо там в принципе огромный внутренний рынок и они могут спокойно обойтись без выхода в международку. Главная проблема всё равно у всех одна - нейронки подписками не окупаются, это капля в море. Мало того что производство дорогое, так еще само применение нихуя не дешевое. Сейчас все работают себе в убыток, выживая тупо на инвестициях или ебанутом бюджете, если ты гугл. Ну а мелкие конторы типа мистралей вообще целиком на дотациях и инвестициях.

Это да. В целом, мне кажется, инференс можно сделать достаточно дешёвым, если приблизить его к локальному варианту: агрессивное сжатие кэша, 4 бит, не более 128к контекстное окно. И даже за 20 баксов будет окупаться. При условии отсутствия всяких дип рисерчей, CoT, поиска по интернету. Либо за дополнительную плату за функции.

На самом деле это не так уж и плохо, ибо даже во времена, когда таких возможностей не было, жилось неплохо. Проблема в том, как они будут разрабатывать в такой ситуации новые модели? На инференс хватит с анальными оптимизациями, а вот на новые модели.. разве что раз в 5 лет, если без всяких дотаций и убыточности.

Есть такое ощущение, что мы будем вспоминать времена 4о или клода 3.5 как время изобилия и безумной халявы, когда все корп решения для нищуков станут 100б-а8б @ 4-бит @ RNN кэш, пережатый в мясо. За 40 баксов. И за 20 баксов что-то уровня 35б-а3б.

Да, они будут куда лучше обучены, чем сейчас, и всё же.

Кум вообще будет отсутствовать. Только локально. С hg выпилят все. Будем сидеть по говноконфам и делиться квантами старых моделей.

А китайские модели.. ты верно подметил, что они будут востребованы, но скорее всего именно в Китае.

>инференс можно сделать достаточно дешёвым, если приблизить его к локальному варианту

Не знаю что насчет копросеток, но сторонние провайдеры точно квантуют модели вместе с контекстом и гоняют их у себя в ужатом виде. В принципе, не удивлюсь если та же гопота этим промышляет, оно было бы логично. Если можно где то срезать убытки, их срежут. Но даже так сомневаюсь, что подписки по 20 баксов окупят затраты на содержание сотен тысяч (или уже миллионов) видимокарт. Это прям долгосрок долгосрок.

Сейчас я уже буду ванговать, но вангую, что они память не ужимают традиционным способом — квантованием уровня лламы и прочих бэков. Уж слишком оно уебищное и агрессивное. А вот SWA, RNN, меньше голов внимания или чего-то подобного — это пожалуйста. Даже через API. А самый жир исключительно по каким-то лютым ынтырпрайз тарифам.

Ну и для быдла, разумеется, модели только в 4 битах, специально обученных работать в таком режиме. Как gemma qat или gpt oss.

Плюс, как я говорил, начнут использовать сраные маленькие МоЕ.

Грок вот буквально идеально иллюстрирует эту ситуацию. Модель заквантован в мясо, контекст уровня четырёхбитноно квантования, лупы покруче мистраля, маленькие эксперты, размер 1Т+. Чисто квено-дипсиковская-китайская проза, явный дистиллят. Зато скорость огогоебать, пишет за секунду по абзацу, лол.

Ещё воровство диффузионных моделей с civitai, чтобы быстро для быдла рисовать. Изначальное разрешение 512х768 примерно, затем быстрый апскейл. Генерирует сразу по 4-8 изображений за пару секунд.

С изображениями реально интересно. Я их довольно долго анализировал от грока. Модели точно краденые и их там минимум несколько. Возможно, есть свои, но SD 1.5 под капотом сидит тюненая. Артефакты, паттерны сломанных пальцев, вот это всё такое же, как у меня локально было.

Я был лютым шизом раньше, который в день по 1к пикч мог генерировать или делать 4К ШЫДЭВОР 6 часов, поэтому прекрасно вижу это. Сидел и под лупой разглядывал, сравнивал, тестил. То есть это не DALL•E какой-нибудь закрытый. Чистый пиздинг. Возможно, в этом направлении дело пойдет у большинства. В итоге останутся лишь один-два гиганта, которые будут делать реально своё.

Тут какой то файнтюн для "Tavern Sensei, a turn-level gameplay advisor for tabletop RPGs."

https://huggingface.co/yuuuzeee/tavern-sensei-qwen3.5-35B-A3B

Интересно, сам таверн сенсей чот не гуглится, у чела много файнтюнов для эропоге

https://huggingface.co/yuuuzeee/tavern-sensei-qwen3.5-35B-A3B

Интересно, сам таверн сенсей чот не гуглится, у чела много файнтюнов для эропоге

Как уже говорили в асиге, останутся лишь гугл и майки среди западных, да и алибаба с хуавеем в Китае. Остальные просто не потянут расходы при падении дотаций и инвестиций. ИИ-зима близко.

>заквантован в мясо, контекст уровня четырёхбитноно квантования, лупы покруче мистраля, маленькие эксперты, размер 1Т+

Лол, реально? Никогда не гонял грок, но видел отзывы на третью версию, писали что "лучшая модель для рп" и вообще умница-послушница, всё понимает, между строк понимает, отказов не принимает и там по списку.

>В итоге останутся лишь один-два гиганта, которые будут делать реально своё.

Ну в каком-то смысле они уже сейчас рынок делят. Разжираются настолько, что конкурентам приходится либо сливаться, либо искать дохуя и больше, чтобы не проебать свои три процента от общей массы. Из всех гугл наверное самый стремительный скачок показал за короткое время. Среди сервисных ебет гемени, среди локалок гемма (в своем размере), среди картикодебилизма банана. И это все релизнулось буквально за полтора последних года.

А вот третья модель была охуенной, это правда. Я не смог попользоваться ей долго, буквально пару дней и в рамках тестов, но её языковые навыки были потрясающего уровня, учитывая скорость и контекст. Близко к клоду и гемини, и в рп хороша. 4 версия — это какой-то полуслоп странный, а 4.1 и 4.2 чистейший китаец. Абсолютно ебанутая хуйня. Плюс только в агентском режиме, где 16 моделей работают. Но они все равно наглухо шизанутые. Ну и 4.2 всё ещё может генерировать текстовый контекст с несовершеннолетними прямо в веб-интерфейсе, лол. Вероятно, огромный пласт людей использует грок для этого.

Да, Гугл очень мощно ворвались. Но с кодом она всё ещё плоха, в людском языке — бог. Местами точно превосходит Клода, который настолько плотно укатился в кодинг, что становится страшно, чо там дальше будет, ведь раньше он был абсолютным лидером по качеству англюсика, русика, хуюсика или мертвых языков. Хотя он всё ещё хорош.

А вот гпт выглядит как отстающий, как игрушка для быдла. Конечно, он может всё ещё показывать крутые вещи, но скоро разрыв будет велик, если в него не станут вливать бабки. Складывается впечатление, что он станет чем-то вроде сервиса, в котором отвечают "а как какать?", о чём красноречиво говорит контекстное окно в 32к токенов в веб-интерфейсе, если не использовать reasoning high. Ну и ощущение такое, что там крутится какая-то 200б МоЕ или нечто подобное, а в некоторых ситуациях можно с барского плеча получить толстяка.

Кстати, у гпт была весьма интересная версия 4.5, для которой давали 15 сообщений в неделю в рамках теста. Судя по качеству ответов и тс, там была dense-модель колоссальных размеров. Самый интересный момент в том, что она очень хуёво могла в код, на уровне локалок наших, ну немного получше, но с языком творила чудеса. Зачем они её тестировали, почему не выкатили и что это вообще было — непонятно.

>он станет чем-то вроде сервиса, в котором отвечают "а как какать?"

Правды ради, большая часть запросов к нейронкам это итак говно уровня "а как какать", потому что поисковики абсолютно засраны и даже если ты ищешь что-то конкретное, тебя с большой вероятностью кинет на сайт, где статья тоже написана нейронкой и разбавлена десятком параграфов воды чтобы увеличить среднее время посещения страницы. Помню когда были траблы со здоровьем искал инфу по препаратам и постоянно натыкался на эту поебень, которая кроме ключевой информации срала в мозг чем-то вроде "как появилась хуйнянейм, как с ней боролись в древности, как с помощью гнилого гриба придумали пенициллин" и прочее, что никому нахуй не надо. Потом открыл бояра и он раскидал всё в пять предложений.

>там крутится какая-то 200б МоЕ или нечто подобное

Скорее всего, не просто так осс-гопота вышла моешной. Если сравнивать 120B и урезанную GPT5-mini, вообще часто ощущается, что это одна и та же модель. По мозгам точно не далеко ушла.

> по сравнению с квеном 27б

Хочешь увидеть настоящий контраст - попробуй посравнивать модельки в агентно-кодерских-ассистирующих задачах где все вместе, отсутствует четко заданный пайплайн, модели нужно проявлять инициативу и действовать. Достойные альтернативы начинаются от 200б.

Причем тут позабавились? Это было именно демонстрацией своих возможностей и рекламой, многие компании начинали именно с тюнов той же лламы и других. Просто их или уже купили и они растворились в гигантах, или сами подросли но сейчас не имеют возможности что-то мощное релизить.

Основной доход там не с мелких подписок а с b2b, вот там наличие популярной открытой модели будет только в плюс, потому что лучше рекламы не придумаешь. Арендовать чистые датацентры или экономить 10% на мутных и ненадежных по всем фронтам провайдерах никто не станет, обращаются напрямую к производителию да еще закажут внедрение и адаптацию под их задачи.

Ну и уже писали что у тех же квенов и кими подпискам наличие открытых весов не мешает, а вот у тройки гигантов энтузиастов оттягивает.

> качество хуевое, сосет даже у чат гпт

Только писали как она разъебывает, нагибает жпт и конкурирует с коктрописами - и тут такое.

> а потому что лимиты выше

Посмотри в реддиты жемини, попоты, коктропиков и крупных агрегаторов типа перплексити. Все в нытье про то, как им зажали лимиты, отобрали обещанное, не дают использовать модели из-за перегрузки. На последней вообще тебе просто втихую подменяют прошку 3.1 на какого-то лоботомита. Сначала прыгают между гуглом-гопотой-антропиками, потом слезают на китайцев и пишут довольные оды.

> сначала придётся заставить эту падлу хоть как-то слушать твои инструкции и не шизить

Так перетолстить - нужно постараться. Да и имплаинг огромного превосходства при перечислении тривиальных вещей тоже выдает.

> если приблизить его к локальному варианту: агрессивное сжатие кэша

Это не локальный вариант, это рак опенроутера. Тут наоборот пытаются получить максимум качества из доступного, жертвуя скоростью и т.д. То же самое делают и корпы, что заметно по деградации моделей после релиза или в пиковые часы.

> когда все корп решения для нищуков станут 100б-а8б @ 4-бит @ RNN кэш, пережатый в мясо

Они когда-то были не такими? Короткое промо в неделю, а потом бесплатно только огрызок 4о мини или вообще турба, лоботомит хайку у коктропиков с анальными лимитами.

Шиза какая-то, вы тут ебанулись окончательно?

Пчел, гопота осс 120b до сих пор ебет галематью 5, говмими к2.5, минисраку 2.5 и все хуеквены до 397b включительно. Просто эти калки на 1T параметров обсираются под себя в цикле агента, криво вызывая инструменты. Типа гопота тоже говнище лютое относительно чмопуса последнего, но тут уже сама проблема в том, что лоботомиты это говно, просто чмопус лучший среди куч говна, но и стоит он моё почтение.

>Пчел, гопота осс 120b до сих пор ебет галематью 5, говмими к2.5, минисраку 2.5 и все хуеквены до 397b включительно.

Посоветуйте годную мистралю/министралю для эрп. Появилось ли что-то годное за последнее время? Тюны может какие?

Газонюхи выше спокуха, обсуждение апи и пенисов в других тредах, тут локалки

Есть ли калькулятор прикинуть сколько плотная, загруженная на видеокарту не полностью, будет выдавать?

Правильно, тут лишь лоКАЛки лоботомитные уровня трехлетней пигмы. С тем же успехом можно вставить генератор случайных чисел перед детокенизатором, возможно, даже лучше будет, чем лоКАЛьный ЫЫ.

пиздец, модели на 744b-1t параметров тупее трехлетней пигмы на 6b параметров, да и контекст пигма держит лучше

Ministral-3-14B-Instruct-2512-absolute-heresy.Q6_K

А если у тебя там ванилька, то можно и сток, в простенький кум мистрали всегда из коробки могли.

Как раз таким и пользуюсь. Есть альтернативы или это топ решение?

По соотношению скорости и мозгов на обычном пк с 12-16 VRAM - топ решение. Ещё и русский хороший.

Ты там под чем? Или недуг какой?

Гемма 27b получше будет. Я пробовал министраль 14b в оригинальных весах, и она при переводе обосралась, переведя collar как воротник, а не ошейник. Прямо как google translate, который также обсирается под себя. Геммочка умничка здесь вывозит, выдавая меньше тупняка.

Анончик, посоветуй модель не для кума, а для помощи в написании нормативной документации на русском языке на основе международных стандартов? Есть такое? Или для такого проще токены у корпов?

Для такого лучше без ллм

Разумеется, что всё нужно делать самому, у меня нет цели всё отдать на откуп нейронке, но получить гайдлайны, что бы был уверен, что ничего не упустил и не сделал противоречие было бы кстати.

Еще как ебет, а потом галюны отпускают и напоминает тебе принять таблетки.

Лол корпораба защемило

Ну так копроварик юзай. Спроси как составить док, он тебе поможет. Нах тебе с локалкой ебаться?

Потестил недавно всякию тюны геммы и мистраля, пиздос, оказывается ни одна моделька не знает что можно ебать пролапс. Вопрос - за что я плачу скачиваю все эти тюны и трачу терафлопсы своей видяхи? Нахуя все эти анцензоред, дарк, вайолент, гор тюны нужны, если они не могут в банальные вещи?

Признаться, порядком разочаровался в ллмках из-за этого.

Эти ваши корпы или 300б+ модельки могут закрыть такую базовую потребность? Или они все юзлесс?

Признаться, порядком разочаровался в ллмках из-за этого.

Эти ваши корпы или 300б+ модельки могут закрыть такую базовую потребность? Или они все юзлесс?

Ну тогда ладно, раз нет других вариантов.

Я пробовал гемму, не сказал бы что она прям настолько лучше. Да и всякое похабство она понимает в разы сложнее.

Писать нормативку - никакую, уволься. А проанализировать, что-то отметить - тема хорошая но сложная, бери самое большое что сможешь вместить. Среди мелочи это гемма или может новые мистрали (маловероятно). А так от 120б и вверх, желательно с ризонингом или форсировать его аналог промптом. Среди корпов для такого лучше всего жемини, меньше всего галюнов и лучше соответствие.

Не ожидай что модель точно воспримет всю документацию и будет точно знать как тебе помочь, скорее наоборот. Если речь не о совсем общих вещах то точно не стоит делать вот так

> Спроси как составить док

Нейросетям в принципе не стоит доверять документацию. Анончик явно тредом ошибся, тут в основном кумкумы сидят.

> ни одна моделька не знает что можно ебать пролапс

Квен 235 и 397, Степа 3.5, а также ГЛМ 4.7 точно знают.

А вообще у меня фантомные воспоминания что и гемма тоже могла, проверять я это, конечно, не буду.

тут не модель нужна а методология. Залить в контекст всю нормативку и надеяться что она это переварит - не получится.

нужно строить свою систему которая включает в себя

1) RAG

2) пилить RLM (https://arxiv.org/pdf/2512.24601)

Гемма не знает, что такое thighjob. Мистралье знает. Думайте Кумайте.

>Как какать

Да, ето так. Вообще, я сам такой же, и хоть я ненавижу корпов, всё равно стараюсь придерживаться какой-то «культуры использования». Про какать — это к лоботомиту, что-то сложнее — к обычной модели, ещё сложнее — ризонинг (от low до high), или вообще чередую модели от разных корпов, и не из-за денег, а просто потому что хочу хотя бы своими действиями на 00.00....01% снизить нагрузку. Однако большинство так не делает. И я прекрасно понимаю, что гайки закрутят в любом случае, их уже крутят люто, и в некотором смысле у меня будет упущенная выгода.

Кстати, о поисковике. По скорости и количеству выдаваемой инфы грок лучший в своём классе из тех, что я пробовал. Минусы только в том, что он может насрать инфой с сайта russkaya-medicina.xyz или с аналогичного. Даже если ему прямо предоставишь список сайтов, пабмеды там всякие, то он просто натаскает говна без какого-либо анализа. Нужен детальнейший промпт с инструкцией на каждый пук, и даже так он часто ошибается и приносит дичь, видимо, из-за размытого внимания к контексту или обучения. Зато может смотреть 600 страниц за несколько минут. Ну и в целом у него есть проблемы с выполнением инструкций, на большом контексте ещё сильнее сыпется.

А вот Клод или ГПТ могу пережёвывать по 10 минут запрос/поиск, выдавая в большинстве случаев 90% хороших ссылок и годный суммарайз, прямо песня. Только с гемини не совсем понял, норм там или нет по этой теме, т. к. юзал её для таких целей мало и только через API/бизнес-аккаунт

У бизнеса совершенно ебанутый интерфейс и странная реализация всего, что я там видел. Вроде крутилок мало, а чтобы всё работало как надо, надо все мозги себе выебать. И это очень странно, почему Гугл так сделал, ведь у остальных бизнес-версии норм.

>GPT5-mini

Вообще, выглядит так, будто бы там реально гпт осс 120б какой-то крутится, лол.

Это ты нейросетью накалякал?

>Нах тебе с локалкой ебаться?

Смогу проявить смелость и указывать некоторые ДСП(для служебного пользования) моменты.

Спасибо за ответы. +- ситуация понятна.

Гемма знает о пролапсе только на уровне медицинских сведений. Типа что это бывает из-за проблем с мышцами ануса, что надо обращаться ко врачу, хуе-мое. А то что после интенсивной ебли можно натужиться и выдавить пролапс, а потом сразу втянуть обратно - это за гранью их представлений.

Ну мистрали да, как будто чуть получше понимают такие штуки, но все равно это надо вытягивать из них.

>можно ебать пролапс

Нельзя. Я запрещаю, это аморально. Так что нейросети правы.

>Нейросетям в принципе не стоит доверять

Вот так достаточно.

Я тестил гемму и мистраля одними и теми же промтами по несколько раз, с разными настройками температуры. Мистраль хоть и ошибался иногда, но в целом лучше понимал, что от него хотят и, что важнее, какой у него персонаж. Гемма же оставалась более сухой и информативной, но без ошибок. Очень уж у неё копроративный слог и поведение. Не может в творчество.

Не знаю, кто там что писал. В этом треде? У меня нет сил сейчас реально смотреть. Если можешь, тыкни в посты. Только не в бенчи, они хуйня полная и всегда наебывают, кроме некоторых. Годятся для того, чтобы примерно показать уровень модели. В реальности ВНЕЗАПНО получатся обычно иначе.

Про агрегаторов вообще не шарю и не пользуюсь, но насчёт лимитов за подписку ты прав. Вот только когда антропики их давали? Сейчас у них ого-го какие лимиты по сравнению с тем, что было. Но их всё равно мало, если сравнивать с той же китайщиной, да. Ну и все потихоньку затягивают гайки, к этому идём. Только китайские модели всё равно не выход из ситуации, разве что дипсик меня реально порадовал, но там нужно пердолиться очень много, так как без апи он по возможностям 2024 года. Нужны инструменты и долго налаживать, а потом это всё ломается и цикл повторяется.

>Перетолстил

Шо перетолстил? Ты пробовал одновременно использовать грок + гпт + клод на одной и той же задаче и промпте? Сложной. Грок чаще всего порет хуйню, причём такую лютую, что уши дыбом встают.

Когда я говорил про локальный вариант, то речь шла о том, что корпы опустят планочку до уровня локалок треда, условно. Мы желаем получить хорошее качество, но не можем, даже жертвуя скоростью и Аллахом. И вот что такое нас ждёт в будущем, но уже на платной основе. 27b dense и 120b MoE хватит всем, как грица. Или наш любимый грок 1Т-а3b iq3_k_m

>были не такими?

Ну я там не работал, сказать не могу, но по результатам — да, были. Антропик явно стараются давать максимум качества, минимум компромиссов ценой лимитов и ебанутых цен. Гпт прыгает из стороны в сторону из-за шальных бабок — иногда можно было использовать самые жирные модели невменяемое количество раз, сжигая бабки на тысячи долларов за пару суток, если бы это было по апи. Вот просто без остановки его задрачивать. Впрочем, это у меня происходило из-за того, что модели тупее были. Сейчас достаточно пары запросов для получения тех же результатов.

Сейчас клоседам ИИ яйца начали выкручивать, в лимиты порой влетаешь и видно, что там агрессивное квантование, динамический контекст и что-то странное порой творится.

Ситуаций, которые ты описываешь, вроде 4о -> мини -> и т. д. Я вообще не помню. Когда это было? Примерно.

Хайку — да. Первое время я был в ужасе, когда они начали влетать на рынок. Потом привык, ещё и лимиты увеличили после внедрения МоЕ, а дальше уже брал подписку подороже.

Нет.

А квенчик 27б знает, что такое mesugaki, ahegao, torogao, straight shota, full package futanari, названия запрещенных веществ и как они действуют на организм в рамках РП. Вот и думайте.

Просто пишете в карточке нужный тег - экономите 600 токенов.

Про вещества двачую, квен почему-то очень хорошо в них шарит. Но мистраль лучше описывает всяких курящих блядей или строгих училок. Геммочка в обоих случаях падает на колени и просит обоссать, но не спрашивать о таком.

>Гемма же оставалась более сухой и информативной, но без ошибок. Очень уж у неё копроративный слог и поведение. Не может в творчество.

Да, я боюсь это фундаментальное ограничение для всех ллмок. Народ хочет чтобы нейросетки выдавали охуенно точные ответы без шизы, максимально достоверные факты, чтобы умели тулы вызывать, следовали промпту. А креатив наоборот требует отклонения от нормы. И одной температурой скорее всего не решить проблему. Для креатива надо либо слегка шизить, либо держать в памяти 100500 триллионов разных вариаций того, чего только может быть. 1Т модельки наверное могли бы вместить такое, но они задрочены корпами на работу по указке.

Можешь почитать на эту тему https://habr.com/ru/articles/992348/

>охуенно точные ответы без шизы, максимально достоверные факты, чтобы умели тулы вызывать, следовали промпту

Этого вполне можно добиться, если точно писать промты, детально составлять лорбуки без противоречий, и не загонять нейронки в невозможные ситуации, где нужно безумная креативность чтобы тащить муд и не глючить. Иногда - получается. Иногда - кринж. Повторяемость - миф, ну разве что на минимальных температурах и при сжатых промтах.

>держать в памяти 100500 триллионов разных вариаций того, чего только может быть

Ждём, терпим, надеемся. В целом при соблюдении всех условий и созданий для нейросети идеального рп-вакуума, вполне можно загонять тот же мистраль до оптимальных ответов. Я это давно приметил, что стоит мистраля поправить, так он начинает соблюдать рп точнее. Квен же при внесении исправлений иногда начинает рефинкать вообще всё, выходя в астрал минут на 10. Но зато может выдать настолько охуенный ответ, что аж меняет вектор рп, самостоятельно задавая направление.

> Не знаю, кто там что писал. В этом треде?

> Посмотри в реддиты жемини, попоты, коктропиков и крупных агрегаторов типа перплексити.

Тебе плохо? Ты же внатуре поехавший. Сначала жирнота с тривиальными ошибками на флагманских моделях, теперь нерополотно обо всем и ни о чем. Лечись, квантованный.

> фундаментальное ограничение для всех ллмок

Как одно противоречит другому? Нужна моделька поумнее и с достаточными знаниями в области, чтобы примерно понимала какие нормы можно нарушить ради повествования, а какие наоборот его обрушат. Креатив никак не мешает модельке давать достоверные факты, следовать промпту и уметь в тулзы. Настроив хоть сейчас можешь отыгрывать кум, пристроившись сзади к кобольду-офисной работнице, которая в это время будет писать и редачить твой код.

Ну вот ризонинг - потенциальное спасение. Все эти руминации дают ИИшке возможность подсветить нюансы, продумать дальнейшие действия.

Надо попробовать на гемме эмулировать ризонинг. С выполнением инструкций у нее хорошо, так что тэги проебывать не должна. Но формат скорее всего придется жестко структурировать, ибо сама она не была надрочена на размышления типа "wait, what if..."

>Креатив никак не мешает модельке давать достоверные факты, следовать промпту и уметь в тулзы.

Противоречие скорее как раз с выдачей точных ответов. "Точные" ответы на ллмках - по дефолту костыль, они не предназначены для этого. А условный креатив - естественная штука. Поэтому приходится душить их всякими способами, чтобы они могли выдавать стабильно приемлемые ответы, но при этом как-то адаптироваться к ситуации, а не выдавать зазубренный среднестатистический ответ.

Ананасики-братья по куму и рп, отзовитесь! Я шиз или есть такие же? Что бы я ни запускал, Глэм, Глэм Эйр, Квены всякие разные, Мистральки, Геммы, Степашу. ВСЕГДА блять прохожу через следующий порочный цикл

1. Радость новой модельке, весело-интересно. Моделька умная, раскрепощенная, прям то что надо, ну наконец-то

2. Пишу карточку-другую на вдохновении. Отыгрываю сценарий, забиваю подзавязку контекст. Кум льется рекой

3. Иду дальше по чату, начинаю новый или заново начинаю чат с той же карточкой... и начинаю видеть слоп, иногда протупы, иногда практически те же самые ответы, иногда нелогичное поведение персонажей, иногда блять все сразу

4. Сгорает жопа. Приходит мысль ебаный тыж бля, чем я занимаюсь, это какой-то мегатупняк лоботомит-автоответчик

5. Принимается решение прикоснуться к чему-то настоящему, подлинному, иду смотрю аниму, кинцо, игры играю, иногда даже книжки читаю. Радостно, весело, пару раз даже модельки удалялись и себе давалось слово дальше только человеческое, живое, а не ебаные выводы статистических машин без души

6. Проходит время. Приходит понимание что хочется нейрокума, потому что найти то что мне нужно где-нибудь еще не получается. Потому что это пусть и иллюзия, но это впечатление какой никакой обратной связи. Что ни читай, что ни смотри, ты лишь наблюдатель. Да и попробуй найди что-нибудь по своим вкусам. Среди чего искать рп + иногда кум время от времени? Разве что в внках, додзях, манге. Я не извращенец, мне легко угодить, но сука если сунешься туда, то везде ебаная школа, везде шаблонные персонажи со своими архетипами и щепоткой кинков автора, которые часто могут триггерить. Даже рисовка часто похожа. И вот ты уже прочитал новеллу на 30 часов, а потом ловишь такой ебаный кринж что не хочешь продолжать. И вот ты возвращаешься к первому шагу, все по новой. Ебаная временная петля. Что с этим делать то?

P.S. Вот тока не надо что делать в модельках или квантах. У меня 96+48, в целом все хиты треда могу запускать вроде

1. Радость новой модельке, весело-интересно. Моделька умная, раскрепощенная, прям то что надо, ну наконец-то

2. Пишу карточку-другую на вдохновении. Отыгрываю сценарий, забиваю подзавязку контекст. Кум льется рекой

3. Иду дальше по чату, начинаю новый или заново начинаю чат с той же карточкой... и начинаю видеть слоп, иногда протупы, иногда практически те же самые ответы, иногда нелогичное поведение персонажей, иногда блять все сразу

4. Сгорает жопа. Приходит мысль ебаный тыж бля, чем я занимаюсь, это какой-то мегатупняк лоботомит-автоответчик

5. Принимается решение прикоснуться к чему-то настоящему, подлинному, иду смотрю аниму, кинцо, игры играю, иногда даже книжки читаю. Радостно, весело, пару раз даже модельки удалялись и себе давалось слово дальше только человеческое, живое, а не ебаные выводы статистических машин без души

6. Проходит время. Приходит понимание что хочется нейрокума, потому что найти то что мне нужно где-нибудь еще не получается. Потому что это пусть и иллюзия, но это впечатление какой никакой обратной связи. Что ни читай, что ни смотри, ты лишь наблюдатель. Да и попробуй найди что-нибудь по своим вкусам. Среди чего искать рп + иногда кум время от времени? Разве что в внках, додзях, манге. Я не извращенец, мне легко угодить, но сука если сунешься туда, то везде ебаная школа, везде шаблонные персонажи со своими архетипами и щепоткой кинков автора, которые часто могут триггерить. Даже рисовка часто похожа. И вот ты уже прочитал новеллу на 30 часов, а потом ловишь такой ебаный кринж что не хочешь продолжать. И вот ты возвращаешься к первому шагу, все по новой. Ебаная временная петля. Что с этим делать то?

P.S. Вот тока не надо что делать в модельках или квантах. У меня 96+48, в целом все хиты треда могу запускать вроде

43 на 0 и 10тпс на 64к контекста в один поток. Максималка как тг так и пп тоже подросла

Дело в промпте

Тут скорее надо не прыгать с одной на другую модель, а выдрачивать навык общения с одной конкретной. Модельки реагируют на разные триггеры по-разному. Они требуют разный уровень инструктирования. Модельки условно делятся на 2 типа: которые шизят (умело или неумело), и которые о чем не сказано - то и не пишут. Вот надо пынямать какого типа моделька и какими словечками приласкать ее, чтобы она выдавала нужное. По дефолту они выдают ответ какого-то усредненного ассистента, на которого были надрочены (поэтому ощущение свежести при смене модельки - видишь новую личность ассистента). Можно попробовать задавать стили ассистенту или еще всякие подвыперды промптом делать.

> которые шизят (умело или неумело), и которые о чем не сказано - то и не пишут.

Температуру надо крутить потому что.

Да, в целом все так. Ллм может распознать логические нестыковки, что-то проанализировать и т.д., но это скорее про взгляд с другой стороны а не абсолютная истина. Иногда они невероятно восприимчивы и дотошны, ухватывают мелочи которые сам упускаешь, но точно также могут галлюцинировать. Даже граундинг готовому контенту может исказиться.

От того очень забавно наблюдать апелляции в ответам ллм, или вопросы у них по точным мелочам.

Пост-кум-клэрити накатывает и являет все несовершенство того чем занимаешься.

Начни катать длительные чаты с рп и/или развитием отношений (не обязательно романтику). Как раз поднимешь "навыки" с контекстом, промптами, суммарайзами и в целом будешь писать яснее. И делай это не ради исключительно кума, а вместо потребления мусорного контента типа ютубчика, ничего не потеряешь.

Относись к ответам моделей спокойнее, не понравилось - свайпнул, изменил промпты, пошаманил. Не идет - поставь другую модель, тем более что у тебя их много.

Главное - иди трогай траву, найди хобби и занимайся физической активностью. Когда пытаешься самореализоваться через потребление контента, игры или такое - это заведомо путь в бездну. Везде будешь видеть однообразие или несовершенство, которое описываешь. Точно такие циклы короткого взлета "о игра/кинцо/анима/книга вышла, крутая" и тут же падение до брюзжания "фу клишированная херна, вот в тайтлнейм было лучше" и потребления через силу с дальнейшим еще большим расстройством.

Когда будешь воспринимать это не как главный источник желаемой жизни, который обязан дать тебе дофамин должный экспириенс, а лишь как одну из вариаций активностей где можно экспериментировать, ставить челленжи, иметь что-то конкретное - сразу все в норму придет.

> тока не надо что делать в модельках или квантах

> меня 96+48

В них тоже, вот было бы хотябы 256+64.

Гемму как ни крути, всё равно будет суходрочка с постоянными подсказками недоразвитой, что она должна делать в следующий момент. Модель аутистического спектра, лол.

Я тестил многое, разные промты, разные способы дать знания нейронке, чтобы рп сложилось получше. Результаты в общей сложности сводились к чему-то такому:

-Пойдёшь со мной на свидание?

Гемма: -Да, пойду.

Мистраля: -Ой, кто, я? Ты правда приглашаешь меня? Конечно я пойду! смущённо смотрит в пол и теребит пальцами подол платья

Квеня: -Да, можем сходить парк, там у меня есть любимая лавочка, посидим, поболтаем.

Думайте. Только квеня в рп отмечает конкретные места и объекты, извлекая их из характеров персонажей. Ризонинг страшная штука. Настоящий нейронный мозг, а не эта ваша генерация случайных логитов.

>Квеня

А какой квант квени можно уместить в 12 врумм?

Четвёртый смол или третий ларж, наверно. Но ризонить будет очень долго, скорее всего.

https://huggingface.co/darkc0de/XORTRON.CriminalComputing.LARGE.2026.3

Тут что-то жирненькое, умное. UGI на втором месте, отказов пока не ловил. Ризонинга нет. Пробовал кто? Вроде топ кум

Тут что-то жирненькое, умное. UGI на втором месте, отказов пока не ловил. Ризонинга нет. Пробовал кто? Вроде топ кум

>1) Огромные простыни ризонинга бай дизайн, треть из которого уходит на прогон фильтров безопасности.

Жмешь abort, перезапускаешь заново - ризонинг уходит. Все время так делаю.

>2) Сломанный ризонинг который совершенно рандомно то работает, то срет пустыми <think></think>, то вообще не включается.

Это скорее фишка, когда ризонинг не нужен, то помогает. Если нужен ризонинг, роллишь еще разок - все работает.

>3) Ведро сои из коробки, которую нужно либо фиксить шизопромптами либо накатывать еретик. Что из этого больше лоботомирует бедолагу вопрос дискуссионный.

Аблитератед накатил, никакой сои сразу. Еретик тоже неплохо справляется.

>4) Пересчет контекста после каждого отправленного сообщения, и чем больше сообщений в истории чата тем дольше пересчет. Это вот такой ценой достигается легкий контекст? А можно не надо?

Такое происходит только, когда достигнут полный контекст - ему приходится заново после каждого пука считать. Решение найдено - делаешь полный саммари, потом убираешь половину текста. Еще можно просто расширить контекст в 2 раза, если память позволяет. Пересчеты после каждого пука тут же уходят.

>умное

В каком тысячелетии оно было умным?

>2411

>топ кум

Так и живём.

Карточку свою расписываешь? Очень много зависит, что туда напишешь. На готовые не надейся, там фигня. Также юзай [ooc: ] теги или author's notes, чтобы модельку двигать в нужном направлении по ходу дела. Алсо открывай все время редактирование по ходу дела и убирай целые куски текста из истории, которые не подходили - моделька больше не будет их учитывать в дальнейшем и перестанет срать говном. Еще я там вручную куски иногда дописываю, помогает.

Двачую этого просветлённого.

Помогите с суммарайзом. Я в кобольше нажал кнопку автогенерации, комп чутка погудел и всё, кроме надписи "не закрывать окно" ничего нет. Оно сработало и можно дальше рпшить? Или нужно ещё что-то нажать? Часто это нужно делать?

>Помогите с суммарайзом.

Не знаю что ты сделал, но точно не суммарайз.

Я нажал на автогенерацию памяти. Что это если не суммарайз? А как тогда?

>суммарайз

Пересказ содержимого чата в сжатой форме.

После этого начинаешь новый чат вставляя этот пересказ вместо первого сообщения.

Серьёзно? И я должен его сам написать? Ахуй. А как проверить, сколько ещё у меня контекста есть перед тем как чат начнёт затирать старое?

Оно должно добавляться в системный промпт. Но иногда хуево работает. Хз почему.

Возможно проще прям в чате захуячить, типа "[Системное сообщение: сгенерируй краткий пересказ диалога, перечисли ключевые моменты истории]".

Ну, если придётся руками историю писать, то это хороший способ, спасибо большое

О, килпидрика и там, и тут передают. Пиздели, что новая гемма будет как новый квен 120b по размеру и будет MoE говнищем.

А так хотелось плотненькую няшечку новую на 30-50b с легким контекстом. А будет квен от гугла.

>новая гемма будет как новый квен 120b по размеру и будет MoE

Идеально! Вот именно то что нужно. Эйр - если хочется сочного кума и чернухи, Геммочка солнышко - для сфв рп, Квен - для любителей поесть говна. Все счастливы, все довольны.

>А так хотелось плотненькую няшечку на 30-50b

Выкинь свои некротеслы на помойку, пожалуйста. В плотной модели такого размера вообще нет смысла. ~120b моэ будет и умнее и быстрее и полетит на условной 3060 12gb.

>эйробояр закукарекал

Инстэд аурора!

Можешь джейсонов сохранять с наиболее удачными генерациями, будет тебе сорта блокнотик с любимыми историями.

А я потом смогу из него суммари сгенерить?

Ну разумеется, солнышко ты моё кобольдовое. Разумеется ты сможешь.

Круто! Спасибо!

1. Зелёный переходник для V100 на pcie - фигня собачья. При подключении как х16 он выдаёт скорости 6.6 и 5.3 (то есть как х8 на загрузку на V100 и как х6 на выгрузку обратно). При подключении х8 скорости как у х4/х3. При этом определяется и во всех местах х16/х8, а вот если измерять реальную скорость загрузки/выгрузки на крупном буфере. У кого-то ситуация воспроизводится?

Есть смысл поставить драйвер 580-server вместо просто 580?

На это может как-то влиять, что я 8-пин разъём воткнул, а не два?

2. Картинка. Что за реккурентное нечто?

И ещё круто что автопарсер смерджили наконец то. Я рад что начал его использовать ещё до этого.

Есть смысл поставить драйвер 580-server вместо просто 580?

На это может как-то влиять, что я 8-пин разъём воткнул, а не два?

2. Картинка. Что за реккурентное нечто?

И ещё круто что автопарсер смерджили наконец то. Я рад что начал его использовать ещё до этого.

Только учти один маленький моментик. Если в чатике насрано десятками сообщений, то краткий пересказ будет хромать в плане деталей. Так что либо старайся суммировать чаще, либо держи детали своего рп в голове/блокнотике, чтобы самому вписывать их в ноты бота. Это звучит как костыль, это выглядит как костыль, это крякает как костыль, и является им. Но таков путь. Ду ю но да вэ? Дыс ыс да вэ.

Это пиздец, чел. А хули всё так плохо?

А у залёных есть аналог rocm-validation-suite? У красных собственно эта тула есть и позволяет тонну бенчей гонять по типу скоростей всего со всем и вычислений определённого вида

Ну проверь куда по топологии эта псина идёт

Для этого нужно чтобы в твоем интерфейсе было место под этот самый суммарайз. В таверне оно предусмотрено, что там в кобольде - хз.

Есть кнопка автоматической генерации, которая просто шлет простой промпт для создания, но оно всратое и охватывает сразу все, что бред.

Вместо этого есть приличный способ: выбираешь более старые посты, которые хочешь суммарайзнуть и с них форкаешь чат. Прямо в поле пользователя пишешь

> [SYSTEM]

> Pause your roleplay. Come up with your proposal about chapters for that story starting from summary in the beginning. Write extra N chapters and add a short description for each. Only include what already happened in roleplay chat after first summary.

или как хочешь свою команду. При необходимости роллишь, редактируешь, можно с полученным результатом сделать второй проход для уточнения и расширения.

Потом возвращаешься в основной чат и дополняешь уже имеющийся суммарайз (или создаешь с нуля). После скрываешь посты, которые ты суммарайзил через /hide

> После этого начинаешь новый чат вставляя этот пересказ вместо первого сообщения.

Ебааааать

> Оно должно добавляться в системный промпт.

При чем тут вообще системный промпт?

А как форкать сообщения в отдельные чаты и потом скрывать их?

И кстати, а куда лучше записывать суммарайз? В Memory, Author's Note или создать отдельный лорбук?

В таверне в стандартных экстеншнах есть для этого свое поле. На самом деле разницы нет, важно чтобы оно было помещено перед первыми сообщениями и обрамлено в какие-нибудь скобки/теги чтобы было понятно что это пересказ прошлых событий.

> А как

В кобольде? Наверно никак. Спрашивай у тех, кто за этот интерфейс топит.

Ну почему же плохо, золотко? Нет, ну ты конечно можешь собрать себе гигариг и задрать контекст в облака, но во первых, что это тебе даст, кроме всё ещё глючной генерации ввиду несовершенства технологий, а во вторых, что ты будешь делать с джейсоном в несколько гигов? Читать всё в том же чате? Ну так делай это с суммарайзом, всё то же самое будет. Да и ты сам-то потянешь гигарп на несколько недель/месяцев? Если нет, и твои истории укладываются в несколько дней кума экспириенса, то почему бы не сделать пару пометок в блокнотике? На память оставишь. И деменцию чуток отложишь ввиду необходимости хоть немного думать, а не просто стручок наяривать обливаясь нейросоплями.

И ещё, помни, что даже у копроверсий бывают мощные глюки и выпадения из сюжета, а у них контекст огого какой, на локалке такой никогда не поднимешь. И всё равно они генерят кринж. Так что пока так. И это хорошо. В этом есть душа. Снятся ли кумобоярам нейродоярки?

У него скорее всего десятки сообщений, он вряд ли будет искать нужные и поштучно их сумарайзить. Да и зачем ему форкать, если в кобольде есть кнопка redo. Нажмёт суммарайз когда надо, отсуммирует, редушнет, продолжит.

Ну и кобольдище. Когда будет очередной срач просто линк на этот пост скину.

А чем ты пользуешься? Что за программа и чем она лучше?

Кнопкой херово выходит, не используй ее. Пиши прямо там где чатишься инструкцию:

[ooc: this is not part of roleplay, this is a direct request to AI from the author. We need to stop our activity for now and make a summary of previous events. This is critical for preserving the most important events, because the context window is limited and they will disappear if we don't do it. Please generate a summary of all important previous events in our roleplay from a certain time point. I will define a time point from where to summarize below. The summary is for the AI to remember all the relevant facts, so don't forget anything that the AI needs to know about the plot. Do not define characters or their traits, they are already defined in the memory of the AI. Write only the summary of events in the following format:

[Summary Continued: events you summarize ]

Now I will show you the last events that are already in the summary, so you can find out where to start. These events are (вставить ивенты, там где начинать)

Events already in the summary:

последний кусок из саммари с ивентами

]

На такую инструкцию обычно нормальный саммари выдает прямо в окне чата, с момента когда последний в саммари был, потом ставляешь его в карточку в конец, а из чата стираешь.

В Memory, он специально для саммари, идет перед промптом.

В Author's notes - туда только инструкцию вставляешь для следующего действия. Например надо, чтобы перс сбежал в ответ, пишешь туда инструкцию что перс сбежит. А после успешного выполнения убираешь.

В кобольд UI уже все есть для РП, он очень продвинутый. Я разбирался какая выгода ставить другие проги вроде Таверны - буквально никакой выгоды не оказалось. Оставаться в Kobold UI самое лучшее уже, он скоростной, интерфейс настраивается и все есть.

У тебя в кобольде для этого кнопка скачать чат есть. Старый скачал, дальше пишешь что хочешь, скачанный остается в файлике, можно обратно его в любой момент закинуть в окно и получить целиком.

Еще есть кнопка Branch - New branch, чтобы 2 чата в одном файле было, но это на любителя, проще в разных файлах держать.

Не будет нихуя. Скриньте. Ставлю жопу и прямую кишку.

Посоветуйте лучшую модель для кодинга для рига. Влезет что-то вроде StepFun, MiniMaх, OSS-GPT в четвёртом кванте.

>Step-3.5-Flash-IQ3_XS-00001-of-00003.gguf

Есть вообще смысл или 5 квант эира лучше?

Есть вообще смысл или 5 квант эира лучше?

>Ду ю но да вэ?

Ой, блять, ну нахой, не надо угандошенного наклза вспоминать, древнее зло пробудилось, одна из тёмных страниц интернетов.

>Ебааааать

Копать.

Для сторителлинга с разбиением по главам вполне рабочий вариант.

>ставить другие проги вроде Таверны - буквально никакой выгоды не оказалось

Сэйм, единственный минус Кобольда - системный промт нужно прописывать в саму карточку. Ну, хотя можно просто Saved State наделать. Продвинутыми фичам лорбуков вроде случайных срабатываний всё равно не пользуюсь.

Бро, а arkprojects это случайно не ты?

Кто-нибудь из вас щупал 80б квен некст плотно? Дерьмо или стоит пробовать?

да вроде все нормально, в новой ламе оптимизаций завезли.

А про UD вроде все говорили что она медленная

Там вопросы к качеству и квантизации пары слоев. Перекачивать я уже не буду, просто есть надежда что ленивцы поднапрягут извилину допилить свои квантовки до конца.

А можно было давно скачать кванты бартовски и не ебать себе мозг

Или культ ленивцев охотится за теми кто смеет использовать другие кванты?

Можно было бы прочесть ветку и не предлагать то, у чего с башкой еще большие проблемы. Вот что можно, так это начать жать кванты самому лол.

Вот это в chat-template - это насколько важно?

То есть там прямо строго вообще всё дообучение instruct-модели было строго по этому формату и если я от него отклонюсь - оно будет тупить? А насколько сильно?

Или я например могу поставить чуть другой текст про инструменты, поменять формат на json и убрать требование что системное сообщение должно быть в начале?

То есть формат вызова инструментов - это окей.

Но почему системного сообщение то второе нельзя дописывать? По типу, что пользовательское сообщение - это то что пишет человек, а системная инструкция с мета-информацией, по типу что "у тебя осталось 40к токенов и 10 поисковых запросов на ответ". Это же точно не пользовательский ввод, а системный.

Хочу glm-4.8-flash, хотя бы 50B-A8B... Или хотя бы glm-4.7v на 100B.

То есть там прямо строго вообще всё дообучение instruct-модели было строго по этому формату и если я от него отклонюсь - оно будет тупить? А насколько сильно?

Или я например могу поставить чуть другой текст про инструменты, поменять формат на json и убрать требование что системное сообщение должно быть в начале?

То есть формат вызова инструментов - это окей.

Но почему системного сообщение то второе нельзя дописывать? По типу, что пользовательское сообщение - это то что пишет человек, а системная инструкция с мета-информацией, по типу что "у тебя осталось 40к токенов и 10 поисковых запросов на ответ". Это же точно не пользовательский ввод, а системный.

Хочу glm-4.8-flash, хотя бы 50B-A8B... Или хотя бы glm-4.7v на 100B.

<thinking>

Вроде ничего плохого не писал так что по лицу не должно прилететь. Значит можно ответить что да

</thinking>

Да

Можешь что угодно в жинже писать. На сколько от этого ошизеет конкретная моделька? Да хуй его знает, как карта ляжет

Орнул с ризонинга, я тебя по оверам походу знаю и по gfx906, я тоже любитель в некро и не только железе поколупаться, в свое время обмазывался рдшками, ща на 4677 перекатываюсь, так же есть парочка mi50@32, рад тебя видеть на двоще, пости больше фоток и тестов!

Я больше не по некроте, а по всякому странному железу, ачивку "первая рдшка в кармане" получил в 2022. До неё был первый сервер борд с стипендии шараги в 2018 intel s2600cp.

В мишки залетел ещё год назад когда они прям новые ещё продавались (потом уже юзаные приходили). С депо дацн доской за пачку сухариков тоже та ещё авантюра была

Мне мишки тоже новые пришли, по 11к с доставкой вышли, рдшку первую я кажется в 2023 покупал за 7к, потом с фиша и с алибабы еще две брал по 3-3.5к. Я в целом железо люблю, разное, и некро и свежак и странноэ всякое, ща собираюсь на W790E-SAGE SE + QYFS (инж)

https://forums.servethehome.com/index.php?threads/asus-pro-ws-w790e-sage-se-intel-xeon-sapphire-rapids-spr-sp.41306/ В марте 2025 успел купить 256 гигов рдимм ддр5, по 6к за 32гб модуль. Поехала на 6000 - это успех на инже

> W790E-SAGE SE

Что то на богатом. Одна доска в ритейле как 2/3 моей ллм башни

> с фиша

Меня там с порога экрана логина забанили

>Что то на богатом

Пик, брал уценку, типа витринный образец или типа того, не было ориг коробки, а так весь комплект целый, доска новая

>забанили

Я через посредника заказываю

В 80 инстракте есть "душа". И к сожалению

Очень

много

квенизмов.

И тут депо засветился. Главные поставщики приколов теперь?

Не могу разобраться насчёт апгрейда.

V100 мне скорее нравится. Если через ламу, то скорости генерации мне хватает, скорость анализа картинок тоже хватает (я прям удивлён насколько оно быстро, будто бы можно почти в реальном времени видео смотреть без пропусков кадров), сильно не хватает скорости промт-процессинга. Но у неё CC7.0, в то время 7.5 открывает доступ к FA1, 8.0 к FA2, 9.0 к FA3 и вот уже FA4 выкатили в vLLM.

Нейронка подсказывает, что в плане промт-процессинга FA1 ускоряет в 2.4 раза, FA2 в 2.0 раза, FA3 в 1.75 раза - и это то что мне нужно. По FA4 нет цифр, но если оно работает на CC10.0 на B100, то и на 5090 с CC12.0 заработает.

Итого можно взять ещё V100, доступ к большим моделям. Если модель не увеличивать, то это просто в два раза больше pp, так как в два раза больше карт.

Можно перекатится на 3090 с 8.0+, но их нужно сразу две как минимум, так как всего 24 гб памяти и туда даже 30B не затолкать толком.

40хх - это 8.9, достаточно бессмысленно; если целится в FA3, то это сразу 50хх. А тут или 5090, 6000 pro на 96 гб или 5000 pro на 72gb. Ну, или 2х5060ti по 16 гб, лол.

Ситуация осложняется тем, что это в целом баловство, никакого полезного применения я этому не придумаю.

Вариант с 2х5060ti выглядит привлекательным. Это очень дешёвые 32 гб с CC12.0. На втором месте две 3090, наверное - но меня очень напрягает, что за декабрь у двух анонов их 3090 рассыпались.

Есть RTX PRO 5000 72GB Blackwell и RTX PRO 6000 96GB Blackwell. Вторая в два раза быстрее, а дороже не особо сильно. В промт-процессинге производительности влияет и по идее это очень хороший вариант, ещё и с памятью. Если всё на одной карте, то можно хоть в pcie3.0 её втыкать. Но это всё-таки баловство, я лучше велосипед соберу новый.

V100 мне скорее нравится. Если через ламу, то скорости генерации мне хватает, скорость анализа картинок тоже хватает (я прям удивлён насколько оно быстро, будто бы можно почти в реальном времени видео смотреть без пропусков кадров), сильно не хватает скорости промт-процессинга. Но у неё CC7.0, в то время 7.5 открывает доступ к FA1, 8.0 к FA2, 9.0 к FA3 и вот уже FA4 выкатили в vLLM.

Нейронка подсказывает, что в плане промт-процессинга FA1 ускоряет в 2.4 раза, FA2 в 2.0 раза, FA3 в 1.75 раза - и это то что мне нужно. По FA4 нет цифр, но если оно работает на CC10.0 на B100, то и на 5090 с CC12.0 заработает.

Итого можно взять ещё V100, доступ к большим моделям. Если модель не увеличивать, то это просто в два раза больше pp, так как в два раза больше карт.

Можно перекатится на 3090 с 8.0+, но их нужно сразу две как минимум, так как всего 24 гб памяти и туда даже 30B не затолкать толком.

40хх - это 8.9, достаточно бессмысленно; если целится в FA3, то это сразу 50хх. А тут или 5090, 6000 pro на 96 гб или 5000 pro на 72gb. Ну, или 2х5060ti по 16 гб, лол.

Ситуация осложняется тем, что это в целом баловство, никакого полезного применения я этому не придумаю.

Вариант с 2х5060ti выглядит привлекательным. Это очень дешёвые 32 гб с CC12.0. На втором месте две 3090, наверное - но меня очень напрягает, что за декабрь у двух анонов их 3090 рассыпались.

Есть RTX PRO 5000 72GB Blackwell и RTX PRO 6000 96GB Blackwell. Вторая в два раза быстрее, а дороже не особо сильно. В промт-процессинге производительности влияет и по идее это очень хороший вариант, ещё и с памятью. Если всё на одной карте, то можно хоть в pcie3.0 её втыкать. Но это всё-таки баловство, я лучше велосипед соберу новый.

Если у тебя только в100 (одна или в количестве) то попробуй вллм

Dense модели требуют поддержки FA на всех картах, или это необходимо только для нулевого слоя? Попробуй миксануть, первой картой блоквел, дальше в100. В МоЕ мне кажется должно и так работать.