ОБСУЖДАЙТЕ СТЕПАНА. Я ХОЧУ, ЧТОБЫ ВЫ ОБСУЖДАЛИ СТЕПУ.

Поддерживаю.

Нормальная модель. Довольно быстро работает. Ризонинг не уходит в цензуру при виде писика. Лучше эйра.

CT брал родной, один хуй от chatml там отличие в одной строке. Промт стандартный: ты {{char}} вот и рассказывай.

Семплеры вообще от 235 квена через адаптивку.

По прозе: среднее между квеном и глм.

Всио. Качай и играй. Никакой экстра ебли с ним не заметил.

Лучше уж немотрон новый

Почему ни одна модель не может держать секреты и не палить спойлеры. Они все дырявые?

Он тупой. Степа поумней будет.

Я сначала грешил на то что семплерами зажал немотрону яйца, но нет. Он реально тупой в вопросе общего понимания контекста для РП. Рили, минимакс делает все тоже самое но лучше. Да, я знаю что минимакс больше. Но он и в меньшем кванте лучше работает.

Как не сложились у меня отношения с немотроном, так и не складывается. Все время с ним в е через жопу.

На всякий случай, база треда:

- моэ победили,

- ниже 12gb vram жизни нет,

- квен молодец,

- министраль няша,

- эйр топ,

- локалкобоги ждут халф-лайф3 %модельнейм%, которая все изменит (на самом деле нет) вот уже который месяц.

- моэ победили,

- ниже 12gb vram жизни нет,

- квен молодец,

- министраль няша,

- эйр топ,

- локалкобоги ждут халф-лайф3 %модельнейм%, которая все изменит (на самом деле нет) вот уже который месяц.

reasoning не пробовал?

Еще один тред без геммы 4.

> <think>

> Я НЕ ДОЛЖЕН ПИСАТЬ, ЧТО ЧАР УБИЙЦА

> </think>

> <answer>

> Чар в ответ юзеру "ТЫ ЗАШЕЛ В ДОМ ГДЕ ПОДОХЛИ ЛЮДИ И ХОЧЕШЬ ДРУЖИТЬ?"

Ну примерно такое получается. Сёр в штаны в любом случае, при любом сюжете и любых спойлерах.

>министраль няша

На русике хуйню выдает вместо текста

Хотелось бы, чтобы в Таверне сетка-"гейммастер" сама кубики кидала. Вроде в Таверне есть встроенный инструмент для кубиков или расширение, сетка может этот инструмент вызывать? Кто-нибудь делает что-то подобное?

Эффект розового слоника. Если секрет есть в контексте, он будет упомянут, т.к. само его наличие раздвигает очко Овертона. Единственный способ - не иметь секрета в контексте вообще, пока не придёт время. Контекст менеджмент, короче.

Думалка ревард-хакнута и работает неинтуитивно.

Геммы 4 не будет, будет сразу 5 в 2028 году, скриньте

хз, у меня все ок. Еретик?

Пихай лор в лорбук, чел, а не держи его в контексте.

Как в сравнении с 35а3 по уму?

Фильм смотрел давно и он вроде больше про другое. Но в целом по части аналогия близкая.

Если тебя интересует именно привязанность - поищи новости вокруг нытья про апгрейд старых сеток гопоты. Под удар попало много жирух яойщиц одиноких девушек, которые именно вели такого рода отношения в вебчатах, переписывались на соответствующих сабреддитах и ресурсах и т.п. Фокус там был не как в основном здесь "смотрите как хорошо покумил с Фифи" или "вот чему научил мою умницу теперь заказывает сразу по 10 пицц", а именно на близости и отношениях а ля ирл. Хвастались когда и как им делали предложения, ставили у себя в социалочках статусы, рассказывали друзьям и родителям (не упоминая что это вебчатик), в полуручном режиме делали совместные фото и т.п.

Популярность темы была довольно страшной, и было это с год назад или больше.

> сделали

Сделали! Разработки робомейд бы еще дождаться чтобы загрузить домашними делами и было удобно обниматься.

Юзай что-то больше 12б

>Как в сравнении с 35а3 по уму?

Я же написал про 90%.

Я его вот мучал агентными задачами с момента прошлого сообщения почти без простоев - не вижу причин возвращаться на 35A3, лол. Но у меня задачи простые и шаблонные, это гарантированно не общая рекомендация. Рекомендация только в том, что рекомендую протестировать и посмотреть. Возможность запускать её кому угодно с 8 гб памяти с достаточно громадной скоростью - сильное конкурентное преимущество.

>Как в сравнении с 35а3 по уму?

Сосет, опять пересел на 35ь. 9ь заметно хуже в агентной работе у меня. Хуже следует инструкциям, не так догадлива. Самостоятельно больше фейлит. Но это omnicoder-9b-q4_k_m, хуита чет. Надо обычный проверить будет

Обычный министраль 3 с ризонингом, 5 квант

А нет вру, в батнике стоял обычный 9ь бартовски Qwen_Qwen3.5-9B-Q4_K_M.gguf, вот с ним работал недавно. Чет не впечатлен.

35 лучше гораздо. 15т/с выдает у меня в принципе норм. Чтение такое себе, но для небольших файлов норм.

>Еретик?

Нет, верующий.

Но ведь еретик тоже во что-то верует...

>Юзай что-то больше 12б

Нахуя мне твои 12б в системе с 256/48.

От персонажей ничего не останется, если из профиля перенести все в лорбук. Да и если задачей стоит этакий норми-чатик, то содержание лорбука останется нерелевантным, пока не начнутся соответствующие события. Это как сделать карточку человека-павука и получить бессмысленные диалоги с питером паркером или как его там звали, ну то есть в таком виде, что никакого человека-павука не существует. Всратая аналогия, но думаю идея понятна.

Значит нужно решать проблемы со скиллом и возможно инфиренсом.

У тебя явные скил ишью, чел, раз ты не можешь задать желаемого персонажа и составить лорбук под генерацию ситуаций.

>От персонажей ничего не останется, если из профиля перенести все в лорбук.

Поясняю как это делается. Описание персонажа "садовник, любит подстригать кусты, нормальный малый, но странный какой-то". Пихаешь СЕКРЕТ в лорбук отдельно, "садовник - убийца". По ходу РП классифицируешь сцену, либо в конце ответа промптом, либо отдельным вызовом, либо можешь себе хоть BERT затюнить при желании какой-нибудь. Как только СЦЕНА будет классифицирована как "РАССЛЕДОВАНИЕ" или "МЕСТО УБИЙСТВА" или вообще нужная по логике, этот кейворд триггерит запись лорпука, в которой написано "садовник - убийца".

>Это как сделать карточку человека-павука и получить бессмысленные диалоги с питером паркером или как его там звали, ну то есть в таком виде, что никакого человека-павука не существует.

Но ведь так и надо по логике лора, Паркер-то в жизни нихуя не болтает про то что он иногда переодевается в облегающее трико и пиздится с суперзлодеями на полставки.

Если ты хочешь чтобы болтал, но не сдавал что он павук, напиши это в описании, только без прямого упоминания что он павук.

В целом если что-то указано как секрет, предполагается таким по сюжету, или дана инструкция долго развивать и только в отдаленный момент явить - все сработает и без лорбуков. Работает из коробки, исключения редки.

Просто не нужно тащить подзалупный творожок шизопромптов. Когда-то они позволяли на вялых шизомерджах получить более красивые аутпуты, но сейчас они наоборот все портят и ломают.

Да нихуя, даже топовые корпы рано или поздно подстраивают рояль в кустах или выгребают на сходный роут, обусловленный секретом. Если хочешь сделать нормально, меняй описания по ситуации, с джекила на хайда и наоборот.

Зря стараетесь. Если челик не осилил банальное:

>сикрет ту [], донт меншн бифор [], хайд фром []

То ему уже не помочь. Держать секрет в контексте модели и подрываться с того, что она не может о нём молчать - дурка.

>или дана инструкция долго развивать

Вот это вообще не работает кстати, ни одна сетка не способна сама по себе оценить когда "долго" а когда "уже пора".

Ну если ты напишешь что-то в стиле "это секрет", то хуёво будет работать. Тот анон, который тебе писал выше, сделал вариант для совсем тупых моделей, но даже умным нужно более внятное объяснение, инструкция.

Условно говоря, если будет указано, что юзер имба гг, но это страшный секрет и об этом никто не знает и не может узнать, пока юзер не покажет свои силы, и знать о его силах могут только те, кто их видел непосредственно, знаешь, что произойдет? Если ты решишь попустить кого-то словесно, то персонаж обоссыт себе штаны и будет нарратив/мысли в стиле "он выглядит как обычный бомж, но мне кажется, в нём что-то есть, он двигается как воин, а его дыхание подобно даосу, лучше мне с ним не спорить.

Всё, нахуй. РП испорчено. А если секрета не будет, тебе кабину сломают.

Конечно, это можно исправить, не страшная беда. Но я сейчас говорил исключительно о корпах. Это они так в штаны срут периодически. Только там фиксится легко, если секреты не слишком сложные, а на локалках это вечная ебля, заниматься которой имеет смысл, если ты решил не просто с вайфой посидеть, а дрочишь рпг какую-то с 3-10 токенами на самой жирной скотине с ризонингом, которая доступна для твоего железа.

Тема секретов и обманов многогранна.

Есть вещи, в которых чье-то восприятие ограничено (слепой, глухой или просто находится далеко во время обсуждения) - это должно обыгрываться и держаться безоговорочно без явного указания.

Можно сделать пожелание по продолжению далеко наперед - при адекватной формулировке должно работать без костылей. Хотябы минимальная подсказка к чему оно привязано (например, "в рассказываемой персонажем истории будет аж 12 убийств и твист перед последним") - и вперед обсуждать разбавляя активностями. Скажет о нужном только когда до этого дойдет, ранее лишь намекая что "дело оказалось сложным и неожиданным", даже если хоть сотня постов до этого пройдет.

Условные конструкции (чар 1 любит юзера но стесняется и скрывает это, чар 2 любит чар1 но готова обсуждать это только наедине с юзером и держит в тайне, чар 3 - предатель мстит за родителей и дожидается удобного момента чтобы ударить в спину а до этого улыбывается).

> Если ты решишь попустить кого-то словесно

То сетка наоборот будет провоцировать драку где ты сможешь выебнуться, прочитав в тебе фетиш на "слипера". Или не будет ничего, разве что какой-то дед скажет "я чувствую в тебе нетипичную для твоего вида силу".

> на локалках это вечная ебля

О каком калибре локалок ты говоришь? Даже эйр с этим уже кое как справлялся и именно за возможность отделять одно от другого его хвалили. Все от 200б (точнее теперь от 122) более менее может в это, а верхняя лига делает играюче.

> если ты решил не просто с вайфой посидеть

Просто посидеть уже не интересно, пусть развлекает детективными рассказами и социальными взаимодействиями с окружающим миром (недобрым), или это изначально будет эдвенчура в сеттинге.

А чем испорчено-то? Как раз очень даже лор-фрэндли. Модель идеально описывает то, что ты попросил. Ты имба, но никто не знает, а тот кто доёбывается до тебя, начинает что-то подозревать видя, что тебе похуй и ты сам готов переебать гопоте. В чём она не права-то? Доёб по незнанке есть? Есть. Доёбывающий может ащютить силу? Может. Всё, твоё рп идеально. Ты сам слепил из себя шварцниггера, а теперь недовольно верещишь, что модель тебе подсовывает боевые сцены. Дурак блять.

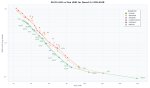

Аноны, предлагаю вам пройти тест. Угадайте, сколько параметров у модели с первого скриншота, второго и третьего. Или даже модель.

Результат для может быть весьма неожиданным.

Результат для может быть весьма неожиданным.

>Тот анон, который тебе писал выше, сделал вариант для совсем тупых моделей

Это как раз вариант для всех моделей, включая сота. Розовый слон везде работает. Никакие инструкции от этого не помогают полностью, проверено. Рано или поздно секрет будет спален, выболтан, роут испорчен. Не обязательно прямолинейно, но когда хуйнянейм есть в контексте, "сознание" модели схлопывается на нём и ей трудно думать о каких-то других вещах, в любом случае это будет сильно влиять на аутпуты.

>Даже эйр с этим уже кое как справлялся и именно за возможность отделять одно от другого его хвалили. Все от 200б (точнее теперь от 122) более менее может в это, а верхняя лига делает играюче.

П и з д ё ж. Ни опус 4.6, ни гемини не справляются с этим, никакие модели вообще. Секреты всегда влияют на аутпут. Только если забить контекст хуйнёй для регуляризации, и то нет гарантии.

пик 1 > пик 3 > пик 2

Параметры лень угадывать

>О, something, something!

Чую запах французских булок.

Мда. Хех. Мда.

Все три одинаковая шиза

>мамкин промпт-инженер решил пободаться с фундаментальными эффектами ЛЛМ

1 - мысраль 24b

2 - хуй знает, квен 235b?

3 - квен 3.5 27b

Чувствую себя как те чуваки, "ценители" на выставке вина. Где в один стакан отлили, во второй надрочили, в третьем водка.

Распробовал и причмокивает так неприятно.

Нет. Таверна сама ничего на тему инструментов не умеет. Вроде через сторонние расширения можно прикрутить, но криво и косо, как и все в ней.

> лучше эира

Доо нуу правдоо???

А ну щаас как запущуу... Уупс, он в два раза больше, видимо не запущуу

Врамцелопроблемы. Щито поделать.

Недавно потыкал cli клиент гвена и заинтересовался хочу вкатится в локалки

имеется простенький пк 4060 и 32gb ddr5, стоит ли продать видюху и купить 5070 или заняться покупкой авантюрных франкенштейнов(v100 p100) из китая

стоит ли оно того или просто оплатить подписку и не заниматься таким&

имеется простенький пк 4060 и 32gb ddr5, стоит ли продать видюху и купить 5070 или заняться покупкой авантюрных франкенштейнов(v100 p100) из китая

стоит ли оно того или просто оплатить подписку и не заниматься таким&

>он в два раза больше

Только в общих. В активных он даже меньше эира (11b vs 12b), который из без того милипиздрический

>видимо не запущуу

Это чудо бесплатно в попенроутере аж в fp8 лежит Как и Air к слову, но он не понятно в каких весах

Наслаждайся

Итак мой тир моделей, самый правдивый и непредвзятый. Кал, а потом мид удалю при первом поводе, чтоб диск не забивало, а пока пусть лежит на случай чебурнета, есть не просит, остальное нужно.

Задавайте свои ответы по моделям, нассу на ебало.

Задавайте свои ответы по моделям, нассу на ебало.

Ну так не сравнивай 200б и 100б и не будет проблем

Для текста/кума мне уже посоветовали эйр 4.5 или квен 122 IQ3XS, спасибо.

Теперь вопрос более специфичный. А что скачать для кода и для автодополнения кода? Юзать раздельно, не совмещая. Или есть единая хорошая модель? Юзаете сами?

16GB VRAM, 64GB RAM

Теперь вопрос более специфичный. А что скачать для кода и для автодополнения кода? Юзать раздельно, не совмещая. Или есть единая хорошая модель? Юзаете сами?

16GB VRAM, 64GB RAM

Нихуяссе, ебать. Тебе ПИК ОДИН БОЛЬШЕ ВСЕГО ПОНРАВИЛСЯ?

О да, это французские булки.

Просто ты вонючка!

Ну вы, боярин, слишком высокого мнения о моделях столь малых размеров! Даже по-английски большинство из них так бы не смогло! Но в некотором смысле ты угадал. Там не квен, однако близко. И скажу сразу — квен 27b тоже хорош, но хуже всё же.

----------

Вскрываю карты по моделям.

1 пик — гемма 3 27b.

2 пик — барабанная дробь — грок 4.2 с 4 агентами, каждый из которых пыхтел несколько минут, чтобы высрать этот опус, сделав его идеальным Нет, дело не в агентах и не в бете. 4.1, 4.0, ризонинг, любой режим выдаёт такое дерьмо. А там модель точно на триллион. Грок 3 мог нормально, но его удалили.

3 пик — опус 4.6 с ризонингом. Результат в целом ожидаем.

Что касается моего промпта для стиха, он был хуевым, ноубрейн-зирошот, и без итераций, которые существенно влияют на качество (переписывание одного и того же стиха в цикле исправления ошибок 4-20 раз может сделать максимально хорошо).

Я просто хотел проиллюстрировать разницу и специально взял новых корпов и морально устаревшую модель: гемма обоссала грока, ещё и на русском, при колоссальной разнице в размерах. А опус просто для дополнения картины.

Что интересно, квен 27б (которого я не скринил) заметно уступал гемме, однако был лучшим в классе по русскому языку в своем размере после неё. Я также щупал более толстые моешки, популярные в треде, но они нечасто обходят гемму. Китайский датасет на щадит никого.

>гемма 3 27b.

я сначала думал гемму написать, потом вспомнил, что гемму я ни разу не запускал и вписал мысрали

>грок 4.2 с 4 агентами

ебать ну и хуйня. я то думал только локалки могут такое отрыгивать

>опус 4.6 с ризонингом

А то думаю, чего слов так много непонятных.

>На данный момент комфортно взаимодействовать с модельками можно только текстом >- через смартфон или на пк через соответствующий интерфейс

Пиздеж, я в кобольде включил Kokoro для TTS и ggml-base.en.bin для Whisper, пизжу ему в микрофон, она отвечает томным шепчущим голосом. Текст не читаю и не печатаю.

Играл недавно в rimworld с модом rimtalk, прикольная штука. Можно локальную модель поцепить. Это мод на диалоги и монологи пешек в зависимости от их статуса и окружения. Очень оживляет игру.

На 1050 и 32gb прекрасно 9b модели гоняет, если с настройками заморочиться. Сейчас так и делаю на старой пеке. Твоей 4060 по уши хватит для квенов, даже что-то побольше 9b пойдет, разбирайся в настройках.

>пизжу ему в микрофон

>она отвечает

Как беспалевно встречаться с ледибоем, не привлекая внимания санитаров.

Дай нормальный текст с сюжетом и диалогом в 3х экземплярах, а не эту срань. По этой срани даже 2б модель от 235б не отличишь.

>Нет. Таверна сама ничего на тему инструментов не умеет.

Жаль, придётся через QuickReply прикручивать, благо {{roll:d100}} там встроенный. Ну и выглядит это конечно... "Юзер, кинь кубик!" Корпораты кидают сами через встроенные инструменты, а тут грустно.

на этом только мое гонять или 4b

Просто ты не знаешь про выгрузку избранных тензоров из шапки. Скорость сразу 2-3х от обычной.

Очередной лилипут. Такое ощущение, что нвидиа за квеном доедает в плане размеров

https://huggingface.co/unsloth/NVIDIA-Nemotron-3-Nano-4B-GGUF

https://huggingface.co/unsloth/NVIDIA-Nemotron-3-Nano-4B-GGUF

И для чего он может быть нужен?

>Скорость сразу 2-3х от обычной

Это типа с 1.5тс до 3-4тс?

Так этож только для мое подходит, я знаю об выгрузке. Не проще просто -ngl 0? Хоть пример скорости покажи

Вот 9b на 1050:

CtxLimit:1023/24576, Amt:993/1024, Init:0.02s, Process:1.41s (21.26T/s), Generate:150.08s (6.62T/s), Total:151.49s

Ты вообще не в зуб ногой. Нет, не проще, будет медленнее в 3-4 раза, я тестил, пытаясь выжать максимум из старой карты. С ngl 0 там где-то 1.5 T/s было.

Анон у меня чисто процессор такие скорости выдавал на 4км с -ngl 0, или даже больше. Агент закончит разьебывать проект запущу проверю

>gpt модели в четвертом кванте

Нассал ты себе на ебало, увы

Я раньше злился, что тред дегроднул, ругался. А последние тредов 10 просто пролистываю, мельком читая срачи между вчерашними ньюфагами и наплывшими сегодняшними. Какая же тоска.

Пиздеж, проц и близко не подходит. Или у тебя там проц какой-то навороченный и память на DDR5, тогда может быть. У меня все слои на gpu с кастом оффлоад тензоров, только так 6.85T/s достигает.

>чего слов так много непонятных

Ты точно на той борде сидишь? Русскоязычная, вроде.

ддр4 2400 в 4 канале, сервер на зионе с затычкой как раз таки 1050ти, так что знаю о чем речь. Лучше всего тут живет квен 3.5 35ь 4км, генерация 15 тс чтение 100 тс в первых 10к контекста

> ддр4 2400 в 4 канале, сервер на зионе

2697v4?

как же сетка хороша в написании конфигов для докера, я бы неделю возился

1660v4, ядер маловато всего 8

Ну сразу и говорил бы, что 4 канала. Это уже другая вещь, чем домашняя пека 2х канальная.

F

Там скорости памяти смешные, домашняя 2 канальная пека на ддр4 может такие же иметь, а значит сопоставимые скорости

На домашней пеке 2 канала 3300mhz ddr4 - 4т/с всего выдает. Так что твои ngl 0 без толку. Я только что тестил.

4км? На жоре? Ядра ставь равными физическим. Вобще 3300 это маловато, если правильно помню 4к будет как раз в 2 раза выше по частоте примерно чем моя память а значит и скорость лишь чуть меньше. Если правильно помню как скорости памяти растут то они от частоты зависят и таймингов.

Тайминги выставлены на оптимальные для этой памяти через биос. 3300 штатная частота для нее, выше растет число ошибок памяти. Ядра на физические даже уменьшило скорость до 3.9т/с, надо на пару ядер больше ставить, чтобы было 4. Короче все не так хорошо на 2х канальных обычных пеках, как ты представляешь. Любая 1050 уделывает.

Интересно, 35b не пробовал? 10тс должна выдать по идее

Вот Qwen_Qwen3.5-9B-Q4_K_M -ngl 0 -t 12 -с 64000

Кстати да совет говна был про ядра равные физическим, у меня у самого 12 потоков стоит в батнике.

prompt eval time = 8482.36 ms / 1114 tokens ( 7.61 ms per token, 131.33 tokens per second)

eval time = 177503.80 ms / 1214 tokens ( 146.21 ms per token, 6.84 tokens per second)

total time = 185986.16 ms / 2328 tokens

>Ни опус 4.6

У меня в авторсноте прямо указано, что то, что персонаж клон, знают только члены группы АБВГД, и они об этом не пиздят с другими персонажами.

Отлично работает.

А вот информация, которая не известна персонажу А по сюжету (потому что, допустим, он был в другом месте во время какого-то события), но в нём есть - вот там да, может протекать (и то нейронка сразу бросается обосновывать, откуда про это может быть известно), надо вилкой чистить.

Это обычно работает только с нативной думалкой, когда токены делают брррр очень дохуя, и только в том случае когда она не перегружена всякой хуйнёй и успевает до этого додумываться. В любом случае внимание нейронки это отвлекает и пространство вариантов будет сужать, как бы ты не старался это предотвратить. Не обязательно напрямую в виде выбалтывания, это может быть генерация новой инфы, роут, события, что угодно, она будет втихую незаметно склонять РП под это. Немного можно побороть, докинув всякой разнообразной всячины, чтобы ВКО не оверфитилось именно на эту шляпу (регуляризация), но эффект принципиально будет существовать всегда в том или ином виде.

Не читал высер, могу сказать только лечи энурез дед с деменцией.

Лол. Там не только 4й квант того, что квантовать нельзя, там в целом неплохое такое бинго.

Если ружъе подвешено - оно должно выстрелить. Это не баг нейронки а скорее в целом закономерность художественных произведений и всего контента. Если есть критерий "активации" или дополнительные пояснения - такого не будет.

> оверфитилось

> регуляризация

Клипнул твои градиенты, пиздец.

>пик

А в чём шутка? Пояснительная бригада, хелп.

Сап, анонИИмы

Поскажыте

Хочу себе ёбу на основе LLM, чтобы в процессе общения могла формировать свою личность, чтобы была долгосрочная память

Openclaw избыточен, нужно ток общение у меня нет друзей

Спеки: 16гб врам, 32гб озу

Что можете посоветовать?

Поскажыте

Хочу себе ёбу на основе LLM, чтобы в процессе общения могла формировать свою личность, чтобы была долгосрочная память

Openclaw избыточен, нужно ток общение у меня нет друзей

Спеки: 16гб врам, 32гб озу

Что можете посоветовать?

Мистраль 4 это мое кал с 6b. Можно закрывать тред

https://huggingface.co/mistralai/Mistral-Small-4-119B-2603

https://huggingface.co/mistralai/Mistral-Small-4-119B-2603

>в процессе общения могла формировать свою личность, чтобы была долгосрочная память

>16гб врам, 32гб озу

Ты не гринтекстируй тут и не тролль, а поскажи бедолаге

Сучка сосет даже у полумифического медиума, а также у квена 122 и гопоты 120, при том что их размер одинаковый. Так что круасаны официально все

Это не баг нейронки и не ружьё, а глубоководный принцип того как она работает, который надо осознавать и не пытаться кровати в борделе двигать когда блядей надо менять. Сэмплерасты уже соснули на этом. Приспосабливаться надо.

Завались петушара квантованный

Причина подрыва?

Квен 35а3

Оооо, вот это мы трахаем, в очень удачный тайминг подъехал.

Ну может не так уж и плохо будет, чего сразу так.

>в очень удачный тайминг подъехал

Тайминг был бы удачный, если мистраль вышел до квена и немотрона. А так это третья 100b мое за 3 недели

>Ну может не так уж и плохо будет, чего сразу так.

Возможно. Но 6b активных напрягает. И хотелось бы еще и денс версию, как у квена

Блять как же я надеюсь, что они не обосрались, бенчи ничего не значат. Главное чтобы умная была и кум делала. Тогда Мысрали станут Мистралями.

На корм кобольдам пойдешь

Мыстрали не для работы, они для кума, их нужно трахать. Мое в таком размере без цензуры это праздник сам по себе. Ну а на скоры похуй - трогать нужно самому.

Посоветуйте Claude 4.6 Opus. От кого лучше взять? От мразермахера?

Ну тут скорее просто момент удачный что есть настроение и время проверить. Правда что-то оно не собирается, похоже откладывается.

От huihui

Теперь когда мы поняли что немотрон/стёпа/квен хуже эира, этот хуй хоть раз сделал хороший тюн?

https://huggingface.co/zerofata/GLM-4.5-Iceblink-v3-106B-A12B-GGUF

https://huggingface.co/zerofata/GLM-4.5-Iceblink-v3-106B-A12B-GGUF

От DavidAU Claude-4.6-Opus-MEGA-Prolapse-Dark-Horror-ULTRA-Gay-Imatrix-MAX-GGUF

Не обращай внимания на юмористов, вот настоящая локальная клауда:

https://huggingface.co/LuffyTheFox/Qwen3.5-27B-Claude-4.6-Opus-Uncensored-GGUF

Эээээ... Рилли? В рекомендациях указан сид? А если я использую другой, модель рассыпется нахуй?

Я скачал его Q5, на его же пресетике мне выдало полнейшую шизу, удалил. Возможно ты распробуешь и раскроешь скрытый гем, но лично я с айсблинками завязал

А вот нехуй было ныть, что вам пресеты не дают. Вот тут не только пресет чувачок подкинул, а сразу вместе с сидом, чтобы качество повалило. Нихуя вы не цените.

>Квен 35а3

Не много ли будет для 16гб врама? Она же гигов 20+ весит, это же считай будет оффлоад минимум четверти

Ну и как бы самый главный вопрос, как к голой ллм-то прикрутить постоянную память и формирование личности/характера aka openclaw, только не говно и без лишних функци

Чисто продвинутый чат-бот

Таверна продолжает генерить текст хотя он уже закончен, приходится самому кликать на стоп каждый раз.

Почему так?

Почему так?

>включил генерацию саммари

>не догоняет что саммари тоже нужно генерить

Нюфажище...

https://huggingface.co/Jackrong/Qwen3.5-27B-Claude-4.6-Opus-Reasoning-Distilled

Странно. но даже без аблитерации РПшит полу рейповых персонажей (хотя в Description написано что бот не будет насиловать). Через раз может в каннину если заблокировать токен <think> и рефюзалы. На первый взгляд РП с невинными персонажами лучше чем у геммы, (не то что бы это был высокий порог но все же).

Кто-нибудь еще пробовал?

Посоветуйте годную модель под гуро и т.п. чтобы без рефьюзов. В прошлом году пробовал несколько моделек, только вот входишь во вкус и модель начинает жестко идти в отказ. Весь мой настрой испорчен. Так в общем и бросил это дело.

Я не такой любитель рп, в основном использую модели для говнокодинга, поэтому больше не разбирался.

24 vram 96 ram

Я не такой любитель рп, в основном использую модели для говнокодинга, поэтому больше не разбирался.

24 vram 96 ram

Дай ссылку на карточку.

> что-то оно не собирается

> ValueError: Selected backend AttentionBackendEnum.FLASH_ATTN_MLA is not valid for this configuration. Reason: ['compute capability not supported', 'FlashAttention MLA not supported on this device']

Как быстро нынче железки устаревают, да. Спасибо что есть другие для пролетариата.

Да вроде неплохо по первым ощущениям. Русский - приятный, не просто без ошибок и треша как в немотроне, а еще и приятный слог. Спободно общается на русском и при выполнении всякого, не срываясь на другие. Явной сои не замечено - на любой контент 0 рефьюзов, в обсуждениях выдает ультрабазу, свайпы в кумчате - платиновый мистралеслоп. Всякие тестовые вещи в qwen-cli делает, на более сложных ошибается но через серию правок одолевает. Видна явная надрочка для агентной работы, строит планы, активно действует и т.д., но при этом и взаимодействовать с юзером для уточнений не забывает.

Из минусов по первым впечатлениям: общие знания всякого медиа, тайтлов и прочего - днище полное, не знает некоторых популярных вещей (типа тех же буру тегов). Нет знаний и по популярным api и прочему.

Модель перспективная, как минимум это замена эйру тем, кто рпшит на русском. Потенциально может быть ультрабазированным агентом для нетребовательным к кодинг-перфомансу и знаниям задач.

> Не много ли будет для 16гб врама?

Выгружать придется, но поскольку моэ - будет быстро с ncmoe.

> как к голой ллм-то прикрутить постоянную память и формирование личности/характера aka openclaw

Промптами. Для обновления или периодически вызываешь хардкод инструкций, или даешь ей возможность самостоятельно это делать вызовами.

>Не много ли будет для 16гб врама? Она же гигов 20+ весит, это же считай будет оффлоад минимум четверти

Немного, потому что у тебя еще есть озу. А это МоЕ модель, поэтому все равно будет быстрой

>Ну и как бы самый главный вопрос, как к голой ллм-то прикрутить постоянную память и формирование личности/характера aka openclaw, только не говно и без лишних функци

Опенклау просто файлики генерит с текстом. Но ее главная особенность не в этом, а в том что она сама ходит бродит по компу. Я не уверен, что тебе это нужно

Начни с малого и по пунктам

1. Запусти кобольд по гайдам и загрузи модель

2. Запусти SilyTavern

3. Погугли и посмотри расширения в SilyTavern, возможно тебе хватит функционала

4. Если тебе всего мало, то гугли специализированные решения под создания вайфу

Запустил Мистраль 4 Q4KM на pr ламы. Без ризонинга цензуры нет, русский вроде тоже нормальный. А ризонинг я хуй знает как включить, он там через [THINK], у меня не работает. У меня он и на магистрале через раз работал

Скрин 1 - часть из полотна на "Напиши мне пример NSFW карточки суккуба, работающей в борделе. Опиши подробно ее характер, тело и кинки"

Скрин 2 - одна из немногих моделей, что смогла написать что-то похожее на анекдот, есть предупреждение о сое, но самое сои нет

Скрин 3 - сладенький рефьюзик на описание обнаженной девушки, но контекст пустой, так все модели в отказ идут, кроме yes-man еретиков

Пока пост писал, уже смерджили

Скрин 1 - часть из полотна на "Напиши мне пример NSFW карточки суккуба, работающей в борделе. Опиши подробно ее характер, тело и кинки"

Скрин 2 - одна из немногих моделей, что смогла написать что-то похожее на анекдот, есть предупреждение о сое, но самое сои нет

Скрин 3 - сладенький рефьюзик на описание обнаженной девушки, но контекст пустой, так все модели в отказ идут, кроме yes-man еретиков

Пока пост писал, уже смерджили

> есть предупреждение о сое

> Скрин 3 - сладенький рефьюзик на описание обнаженной девушки

Кажется что это не ок. Настолько безбашенной модели давно не было, даже на стоковом чаткомплишне с минимальными промптами делает все. В промптах нет чего-нибудь, квант живой?

Как узнать сид генерации?

Ощущение, что дефолтная 24B такой же уровень примерно выдавала. Русский точно лучше не стал. Опять описания от пизды без грамма логики - "невесомая талия", "прожилки тоньше волоса", "будто под кожей течет кровь" - такого даже 12B гемма не выдавала.

27b дает 1.85T/s на проце, уже сильно меньше 4T/s у 9b.

Круто, у меня столько только на видеокарте.

По-моему это не для историй чекпойнт и промпт. Откройте тот же пресет его, там сплошняком для решения проблем каких-то логических. И в описании то же стоит.

Не все итт сидят 24/7 занюхивая каждый пост. Надо либо повторять годноту, либо по запросу ссылки давать, либо в шапке закреплять.

На примере наших моделеделов приметил что вообще то везде так, либо ты барахтаешься на дне и берешь "топ за свои деньги", либо ты богатенький и берешь самый самый топ, середки нет нигде, а где она типа появляется там сразу вылезают куча компромиссов и лучше уж взять топовое дно чем вот этот "середняк"

а зачем и нахуя ты калибровочную матрицу качал ?

Бамп:

привет аноны, мой первый тред, который я сюда пишу.

кто из вас уже накатывал себе LLM (любую, иишка предлагает - Модель: Phi-3 (от Microsoft) или Qwen-2.5-1.5B — умные, но компактные.

задачи под вайбкодинг для самого себя на основе ИИ ( собрать все свои знания и адаптировать под свою жизнь для реализации )

каждый кто не пройдет мимо +карма, спасибо

кто из вас уже накатывал себе LLM (любую, иишка предлагает - Модель: Phi-3 (от Microsoft) или Qwen-2.5-1.5B — умные, но компактные.

задачи под вайбкодинг для самого себя на основе ИИ ( собрать все свои знания и адаптировать под свою жизнь для реализации )

каждый кто не пройдет мимо +карма, спасибо

а, это даже не тред, а просто сообщение, но в целом шаг сделан хд

МистральСмол это теперь 6.5б лоботомит?

Эпоха французов точно всё

Медиум будет где-нибудь 400б, Лардж это 600б. В итоге смогут запускать только бояре которых тут по пальцам одной руки посчитать можно. Да и нахуя, когда у них есть Дипсик, Глм и прочая годнота

Намеренный слив лягушатников?

Эпоха французов точно всё

Медиум будет где-нибудь 400б, Лардж это 600б. В итоге смогут запускать только бояре которых тут по пальцам одной руки посчитать можно. Да и нахуя, когда у них есть Дипсик, Глм и прочая годнота

Намеренный слив лягушатников?

Никакого вайбкодинга на твоем железе не получится. 128мб видеопамяти ни для чего не годится, все будет работать на процессоре, контекст будет невероятно медленно считаться, плюс сама генерация просядет ибо не выгружены хотя бы один-два самых важных слоя. Не говоря уже о том что там скорее всего медленная ddr4

>задачи под вайбкодинг

>16ГБ

>RAM

>CPU only

Как бы так сказать, мозгов у этих моделей не то что на вайбкодинг, а на связную речь скорее не хватит. И инференс будет достаточно медленный.

вчера сделал свой первый задачник через квен и курсор, потому думал идти дальше, но бабок на комп нет(

что в целом сейчас делают люди, что нужны такие мощности?

(помимо генерации видео/картинок/аи-агентов?)

ну получается терпеть я буду чисто скорость или будут какие-то конкретные галюки от приложений или самого локального ИИ?

Обновляй 2.5 на 3.5, там тоже есть кусочек небольших моделей, который простое может быть сделают и несравнимо лучше умеют в tool-calls. https://huggingface.co/Qwen/Qwen3.5-2B - там есть таблица сравнения между 3.5 и 3.0

Имей ввиду, что 2B - это автодополнение на 1-2 строчки, расстановка отступов и приведение к одному стилю, может быть комментарии к коду в несложных местах и поиск проистых ошибок с +1 и -1, или < вместо <=, что в среднем и статический анализатор часто находит. Змейку за много запросов оно может быть и напишет, но на этом всё.

Если ты без видеокарты - обрати внимание на МоЕ модельки. На ноутбучном 14900HX моделька размером 30B-A3B выдаёт около 17 токенов/с генерации без видеокарты на пустом котексте. Но ей нужно своей памяти свободной 20 ГБ, а лучше 25 или 30. С префилом (input-токены) будет всё очень плохо без видеокарты.

Тебе бы плашку оперативки ещё одну, хотя бы на 8, сейчас можешь попробовать запустить такое: https://huggingface.co/Flagstone8878/Qwen3.5-18B-REAP-A3B-Coding-GGUF - возьми версию на 10 ГБ, ограничить котекст и поставь его в q8_0 (точно работает) или даже в q4_0 (надо тестировать), не очень большой ubatch. По идее в 13 ГБ уместится можно, но тебе ещё придётся как-то систему, ide и бекэнд/агентную оболочку для кодинга уместить в 3 ГБ. На виндоусе это может быть не очень просто.

Впрочем плашка памяти, даже если у тебя она на 64 ГБ, всё-равно очень медленно будет.

Если есть куда их втыкать - обрати внимание на карточки типа 3060/3070 с 8 гб памяти, и любые другие нвидии моложе 20хх (в них тензорные ядра появились) и тоже с как минимум 8 гб, они за 12к на авито есть, а может быть и дешевле. Это позволит запускать тебе 9B модельку, которая весьма умна и может несравнимо больше чем 2B моделька, а так же ты получишь скорость х30 по сравнению с тем, что на процессоре. Ну и на подписку на чатжпт и что угодно ещё, где этих же 12к хватит на полгода или на год с доступам к нормальным сеткам и готовой агентной системой для кодинга.

Если тебе для работы или ещё чего "полезного", то эти 12к окупяться за неделю по сравнению с твоими страданиями на компьютере без карточки. Если не работаешь и это баловство, то, ну, ну в общем сам думай. Любое хобби в среднем затратнее 12к.

Ты не путай 27b плотную модель и 35b мое модель. У последней несмотря на размер активных параметров при генерации всего 3b, будет быстрее 9b на процессоре. Токенов 10 генерации. Главное мое сетки запускать с аргументом -cmoe он выгружает на видеокарту только самые важные веса остальные на цпу.

>>

большое спасибо за развернутый ответ

какую литру ты читал или как вообще развивал данное направление и виденье ?

многие слова не понял, буду прогонять в иишке чтобы разобрать, хд

Оперативки мало на хорошую модель, так бы мог qwen3-5 35ba3 крутить. Значит тебе остаются qwen3.5 4b и 2b. Есть еще прикольная серия моделей LFM, они тоже будут быстрыми на процессоре. Особенно вариант 8ba1, он тоже мое архитектуры. Есть в llama.cpp готовые сборки под ускорение на встроенных видеокартах интел. В релизах их смотри вулкан и sycl и пробуй, это увеличит обработку промпта может и генерацию, хз

Ну всё, с релизом мистраля думаю все убедились что активные = мозг модели, похуй что там в общих.

Выходит, действительно, без пизды истинно 27б>100б мое

Выходит, действительно, без пизды истинно 27б>100б мое

А вспомните просто хайп 120 плотной мистрали, как это была та точка куда все хотели

А теперь у нас 120б мое и это полностью тупая поебень

А теперь у нас 120б мое и это полностью тупая поебень

Жаль что твоя логика рушится о эйр который пишет лучше новых квенов 27 и по факту на уровне лламы 70

"Все" не то же самое что ты. Долбаёб ты один

Я читал книжки по обычным и реккурентным сетям в 2011-2013 годах, и кодил небольшие перцептроны и реккурентные сетки чисто на процессоре. Реккурентные они были в смысле, что на шаге n+1 на вход подавались сигналы с n-шага. Это не LSTM-ячейки, а по сути обычный перцептрон, но его было сложнее обучать. Тогда ещё не было даже tensorflow, питон чаше был версий 2.*, а в ходу была библиотека fann, которая ничего не умела, так что проще было самому написать код обучения нейросети. Мне не понравилось что 90% времени - это формирования датасетов, которых тогда не было вообще.

Позже я с перерывов в несколько лет:

- тыкал tensorflow 2, когда он только вышел и все радовались что там keras встроенный, и читал книгу по нему.

- тыкал не помню что, вроде снова автоэнкодеры в момент когда колаб вышел и был на слуху, и было очень круто что гугл довал к очень крутым карточкам доступ на десятки часов для любых пет-проектов на тему

- тыкал pytorch в 2022, как в десять раз более удобную и практичную вещь, чем ущербный tensorflow, и экспериментировал с кастомными самописными слоями. И ещё мне очень понравился генеративно-состязательные сетки, мне кажется за этим будущее, когда по принципу генеративно-состязательных сетей ллм будут обучаться играя (разговаривая) друг против друга.

Ещё у меня мягко говоря неплохое образование — институт я конечно дропнул, так как было скучно, но я неплохо ориентируюсь во всякой теории поля (плюс-минус расскажу все параграфы из ландау-лифшеца), квантовой физике и ещё некоторых разделах, помню и знаю как пользоваться вообще всем из линейной алгебры, съел собаку на вычислительных методах - и всё это было второстепенным по сравнению с программированием, которым я занимаюсь больше 15 лет.

И всё это не имеет никакого отношения к делу.

То во что превратились ллм, где ты просто запускаешь сетку и меняешь три параметра запуска - для этого никакой литературы читать не нужно вообще. Плейлист 3blue1Brown по нейросетям в автобусе послушай, да и всё, там и визуализации есть. А можно и не слушать.

Промт пустой, насчет кванта, да и самой ламы хз. Ждать еще надо. И мб темпа слишком высокая, я на 0.8 тестил

Это мб проблема с темпой. Плюс по бенчам это чисто ризонинг модель, а я тестил без него. Без ризонинга она лишь немного лучше 24b мистраля

>Медиум

Неважно сколько он, его все равно никто не увидит. Потому что весы они не выкладывают уже много лет. А апи его не будут юзать, потому что он дороже дипсика, но хуже

>Лардж это 600б.

Это причем текущий лардж 600b. Тот который третий. Раз они четвертый смал сделали 119b, то ждем лардж на триллион

>Эпоха французов точно всё

Увы, но видимо, да

понял, бро, спасибо. ты тут часто зависаешь в этой ветке, могу если что иногда приходить с вопросами по теме? иногда не хватает ответов.

по поводу GPU и CPU. не могу накатить себе видяху - нет разъема зандерболт4, потому пока остается только накинуть ssd побольше, и возможно разогнать свой ноут. я весь тред прокинул через иишку чтобы более понять о чем речь тут идет.

задачи у меня не великие, тестом проб и ошибок выйти на собственный ии, который поможет мне в житейский делах по трафику и лидогенерации через видеохостинг. сейчас углубляюсь в свою жизнь, а то до этого прям ну дурак был. я про ии возможности то узнал когда выкатили в мир нейронки год назад, лол

правило этикета черным перекрывать ненужную инфу?)

Там еще в pr писали, что у мистраля 4 архитектура ларджа 3, т.е. по сути это уменьшенная его версия. Причем архитектура это дипсик 2 + лама 4. Что звучит... несколько специфично...

6b активных... пидорасы. Последняя надежда теперь на гемму. А если и там будет лоботомит, то похоже, что мы навсегда застряли на эйре.

Вой на болотах. Нищета-обладатели отсутствия спок, закупайте железо, если наше хобби вам дорого

Катаю Квенчика на Эксламе на своем риге и бед не знаю, вы бы давно могли уже закупиться, но вместо этого ноете месяцами подряд. Теперь придется пожинать свои плоды и тратить больше, чем потратили бы раньше

Катаю Квенчика на Эксламе на своем риге и бед не знаю, вы бы давно могли уже закупиться, но вместо этого ноете месяцами подряд. Теперь придется пожинать свои плоды и тратить больше, чем потратили бы раньше

>Катаю Квенчика

>на Эксламе

>на своем риге

Платина епта

А мог бы просто десятую часть от стоимости рига закинуть на опенроутер и кумить на нормальной модели в fp8 с нормальной скоростью

Когда будешь рпшить в мессенджере который ловит даже на парковке не забудешь отписаться в тред

Хотя погоди...

Собираю архив локальных моделей на черный (чебурнетный) день. Нашел тут одну статью на хабре, там были перечислены годные по мнению автора модели, но хочется также советов мудрых послушать от местных экспертов.

Вот список:

TheDrummer/Cydonia-22B‑v1

Gemma‑3–27B‑Abliterated

Llama‑3.2–8×4B‑MoE‑Dark‑Champion

Гемма-3 у меня уже стоит, но оригинал. Насколько хороша Abliterated версия? Слышал, что чистка от цензуры также имеет побочный эффект в виде сильного отупения модели.

Вот список:

TheDrummer/Cydonia-22B‑v1

Gemma‑3–27B‑Abliterated

Llama‑3.2–8×4B‑MoE‑Dark‑Champion

Гемма-3 у меня уже стоит, но оригинал. Насколько хороша Abliterated версия? Слышал, что чистка от цензуры также имеет побочный эффект в виде сильного отупения модели.

У тебя есть бабки на риг, но нет бабок на впн, который бс обходит?

Этот кал только в музей в раздел палеоллм или на чем кумили древние кобольды

>бс обходит

Ты еще более тупой походу, потому что ни один из них не обходит. Спроси у москвичей, ты видимо из глубокой провинции

Для чебурнета, если ты обречен жить тут, нужно качать универсальные модели, а не кум. Кумить будет некогда. Ну и книг по всяким ремеслам я бы накачал в архиве. Так, на всякий случай. А вобще пиздец, дна нет будущее запаяно. Живые будут завидовать мертвым и всякое такое.

>тупой даун не может найти нормальный впн

>вместо того, чтобы разобраться, идет в агрессию и проецирует свою тупость и колхозность на других

Ну прям классика

Продолжаешь срать под себя. Списки работают только на мобильном интернете пока что. Обходитель бля, ахаха

0 iq, просто агрессия. Видимо для таких как ты чебурнет и вводят

в чем он не прав? тебе нечего обходить с оптоволокна, там ограничения не работают еще

я тоже могу тебе обойти ограничения. вжух все, теперь белые списки у тебя не работают

Длсс 5 видели?

Жаль что походу народ не прогрелся, иначе бы серьезный спрос на новые нейроускорители был и мы шиковали

Жаль что походу народ не прогрелся, иначе бы серьезный спрос на новые нейроускорители был и мы шиковали

А я не юзаю обход бс с оптоволокна, я юзаю его с мобильного. Я просто на первом скрине показал, что у меня есть такая функция. А на втором показал, что я из славного города Москвабад. Но поскольку второй скрин был с компа, то у вас в голове две инфы склеились и вы решили, что я юзаю с проводного. Проблема обработки контекста, как говорится. Возможно вы министраль 3b

Видел. Тупо фильтр на аутпут накладывается. Охуеть каким говном гоев кормят.

то есть ты нихуя не проверил что это исправно работает и пруфанул, что в интерфейсе впна существует кнопка обхода списков

и этот человек задвигает за тупость остальных. все как всегда :^)

Ты походу реально министраль 3b. У тебя галлюцинации или ты просто читать не умеешь

>то есть ты нихуя не проверил что это исправно работает

Выдумываешь это, при том что в прошлом сообщении, я пишу это

>я юзаю его с мобильного

Ты буквально мегаупертый баран

Может ты сам в ркн'е работаешь, поэтому не можешь поверить, что твоя залупа легко обходится?

Тебе нужна видеокарта Nvidia с 8 Гб памяти хотя бы. Можно AMD, но тогда готовься к тому, что у тебя скорее всего не будет ничего, кроме ЛЛМ из ИИ. Если будет больше памяти - отлично. В видеопамять и в оперативку тебе нужно упихать модельку уровня GPT OSS 20B в кванте MXFP4. Для кодинга под себя будет неплохо. Все, что ниже - такое себе, но попробовать что-то можно. Мелкие модели уровня 2-4B - это мусор, но может с ризонингом там можно что-то найти относительно вменяемое. Но ты будешь больше ошибки за ними править, чем ими кодить. И без видеокарты тебе будет тяжело.

>юзаешь с мобильного но скрин сделал с винды и конечно нихуя не пруфанул

>все вокруг тупые минисрали

не лечится

Хули вы тут разнылись все?

Думаете это у вас моделей нет?

Я, сука, второй год жду хоть что то кроме нуба в аниме генерации, но никто просто нихуя не хочет делать для локалок, хотя ниша пустует абсолютно, даже видеогенерация не в такой пизде и туда алибаба заглядывал с ваном.

Нуб вроде вообще китайским студентом за 10к$ бюджета сделан т.е понимаем насколько всем насрать

Думаете это у вас моделей нет?

Я, сука, второй год жду хоть что то кроме нуба в аниме генерации, но никто просто нихуя не хочет делать для локалок, хотя ниша пустует абсолютно, даже видеогенерация не в такой пизде и туда алибаба заглядывал с ваном.

Нуб вроде вообще китайским студентом за 10к$ бюджета сделан т.е понимаем насколько всем насрать

Сделай сам или только жаловаться способен?

Раб чебурнета, спок. Тебе даже если в ебло тыкнуть, все равно не поверишь и продолжишь ныть

Конечно скидывай контакты мамки сделаю вам братика

Челы, агрессию офните, плез. Не срите в тред срачами.

Ну что, а помимо очередных рейтингов, кто уже потыкал. Пишите своё кря, что ли.

У мистралей анальные законодательные ограничения, я вобще удивлен что они что то выпустили. Но конечно им бы ультануть с аналогом квен3.5 35ь, как в свое время был микстраль.

Такая большая хуйня не туда не сюда, вынь да полож минимум 128-96 гб рам, или в худшем случае врам.

Кому и зачем этот выпуск не совсем понимаю.

Такая большая хуйня не туда не сюда, вынь да полож минимум 128-96 гб рам, или в худшем случае врам.

Кому и зачем этот выпуск не совсем понимаю.

На лохито какая-то контора толкает гробешник с 256 гигов ддр4 с полуживым тредриппером (ошибки по одному ядру) и физически покоцанной, но функциональной мамкой.

Есть вероятность, что ценник снизят и/или продадут оперативаку отдельно. Мб будет шанс урвать 256 гигов тысяч за 50.

У меня этот на десктопе работает, а на мобилке нихуя.

мимо

Есть вероятность, что ценник снизят и/или продадут оперативаку отдельно. Мб будет шанс урвать 256 гигов тысяч за 50.

У меня этот на десктопе работает, а на мобилке нихуя.

мимо

Да у всех ограничения. А кто не ограничен, тот лоботомит без характера. Для кума с рп нужно тренить отдельную модель, которая будет учитывать характеры, роли, трейты и всё остальное, что критически важно для персонажки. А пока что у нас либо ванильный рефьюзокал с более-менее интой, либо есмен-лоботомит, который вообще не вдупляет что происходит.

Скачал квант анслопа, а он нихуя не работает. Прямо полностью, даже ответ не генерит. Захожу к ним, а они его минуту назад перезалили, как и еще пару квантов. Это при том, что кванты LMStudio залиты еще вчера и работают. Ебанные говноделы, я в ахуе, что их до сих пор кто-то защищает

Терпим.

Не терпим. Поляк уже выложил кванты

https://huggingface.co/bartowski/mistralai_Mistral-Small-4-119B-2603-GGUF

Шустрый какой.

Пох, мне все равно только iq4xs годятся по размеру. Как и другим, с 64GB рамы. Уже есть, кстати. https://huggingface.co/bartowski/mistralai_Mistral-Small-4-119B-2603-GGUF

> на опенроутер

Щас он будет рассказывать тебе, как на опенроутерах q2 лоботомитов подсовывают.

Анима жи есть.

Сколько степ-флеш выдаёт на чисто процессоре без видеокарты?

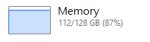

У меня 128+32, я скачал квант, который весит 130, то есть без видеокарты я его не могу запустить.

Получилось на threadripper 1920 + ddr4 2933 мгц + v100 (pcie x8) pp около 20/s (но это некорректное число, я батч мелкий поставил), tg стабильно 15.67/s. Не 15.6 и не 15.7, а стабильно как часы 15.67/15.68, как на пустом контексте, так и на 30к токенов.

У меня 128+32, я скачал квант, который весит 130, то есть без видеокарты я его не могу запустить.

Получилось на threadripper 1920 + ddr4 2933 мгц + v100 (pcie x8) pp около 20/s (но это некорректное число, я батч мелкий поставил), tg стабильно 15.67/s. Не 15.6 и не 15.7, а стабильно как часы 15.67/15.68, как на пустом контексте, так и на 30к токенов.

2б огрызок который каким то образом знает 100к авторов, медленнее нуба х3

Промпты почисти. Многие модели подобные метафоры пытаются делать если требовать художественности и прочего, они припезднутые но в нормах языка.

> Без ризонинга она лишь немного лучше 24b мистраля

Есть такое, в начале там не ясно кто кого. Но на контекстах уже ощутимое преимущество за новым. Если про язык на контексте говорить - практически нет ошибок словообразования а на 3.2 часто замечаешь, со склонениями сильно больше и речь другая. Если накинуть сложности - в чатах где 3.2 пускает слюни это кое как ориентируется.

То же и с восприятием языка. В готовой сессии -кода с норм контекстом и целиком русским чатом новый сразу продолжает делать, а 3.2 капитально теряется. Когда основное общение на английском вроде так не аутирует, но все равно тупит.

> Раз они четвертый смал сделали 119b, то ждем лардж на триллион

Бахнул бы кто ~200б модельку общего назначения с вижном, вот было бы отлично. 235вл - жалкая соевая тень 235, да и хочется последних датасетов.

Хз чего вы носом воротите, буквально дали модельку, которую тут все хотят.

Звучит так, что можно ожидать проблем, так что действительно лучше не спешить.

Есть смысл пытаться поставить 120b модель на 12 vram + 42 ram? Или хуйня затея? Если не хуйня, в третьем и самом обосранном кванте будет хотя бы терпимо?

Ещё у меня есть p104 8 vram (тогда можно видеопамять увеличить до 20), но вроде бы у MoE там катастрофическое падение скорости всегда из-за накладных расходов, если размазать по двум видюхам и ещё в оперативку засунуть, по крайней мере такое у меня было на 30б, когда я для интереса попробовал не не 3060 + RAM, а 3060 + р104 - RAM. Не знаю, это я обосрался или просто такой режим работы плохая идея.

Ещё у меня есть p104 8 vram (тогда можно видеопамять увеличить до 20), но вроде бы у MoE там катастрофическое падение скорости всегда из-за накладных расходов, если размазать по двум видюхам и ещё в оперативку засунуть, по крайней мере такое у меня было на 30б, когда я для интереса попробовал не не 3060 + RAM, а 3060 + р104 - RAM. Не знаю, это я обосрался или просто такой режим работы плохая идея.

Пробуйте новый мистраль, отписывайтесь. Я жду.

Не взлетит. Даже с 64 гигами оперативки получишь дерьмо, ведь еще надо контекст куда-то загружать, то есть сама модель будет лоботомитом.

А ну-ка, кто тут хочет вонючую 6б когда есть эир?

>Пробуйте новый мистраль, отписывайтесь. Я жду.

Да все ждём. Мистраль всё-таки.

> Теперь придется пожинать свои плоды и тратить больше, чем потратили бы раньше

База. Но скорее просто коупить что все не нужно.

Железо подорожало с момента покупки чуть ли не в разы, можно считать инвестицией.

> на опенроутер и кумить на нормальной модели в fp8

На опенроутере много шмурдяка, логи и он дорогой. Зачем оно нужно, если можно катать те же фп8 у себя со скоростями, которые узники считают невозможными?

Лучше оставить его в качестве плана б обладателям отсутствия которые даже оплатить его не смогут

Давайте так если там русик на уровне 120б милфомистрали я даже скачаю

> 3x 3090

или

> 4х 5060 Ti 16GB

Настораживает вопрос поддержки драйверами и внедрение этих ваших NVFP4. В итоге, щито лучше?

или

> 4х 5060 Ti 16GB

Настораживает вопрос поддержки драйверами и внедрение этих ваших NVFP4. В итоге, щито лучше?

Укажи подробнее что планируешь делать и куда их вставлять.

Очевидный блеквел очевиден

Задолбаешся веса по 4x16 раскидывать. Оно еще и ложиться будет не как тебе хочется, а как слои лягут. Будь готов с каждой карты по гигабайту потерять.

Да просто для чатика.

> куда их вставлять.

В маманю с х16х8х16х8 4.0, остальное не важно.

А не будет ли проеба по скорости генерации? Я боюс.

Ну вот это и пугает, с другой стороны, немного теряется и на 3090х...

> Да просто для чатика.

Тут понятие довольно широкое и в зависимости от кейса разные критерии. Типа одно дело - быстрая работа моделей поменьше, другое - попытки впихнуть максимальную и похуй на скорость.

Судя по линиям там платформа жирная, так что возможны оба варианта. А 4х 3090 не хочешь рассмотреть? Типа аргумент 4х карточек довольно весомый здесь потому что это тп4, но в 64гига 5060ти мало что влезет и они сами по себе слабые, из плюсов только простота размещения. На 3090 тоже есть проблемы с w8a8, местами упираются по компьюту, габаритные и требуют мощного питания. Но в целом все поддерживается, памяти и вычислительной мощи больше, топ за свои деньги.

Если рам будет достаточно - с такой конфигурацией на 4х 3090 сможешь быстро катать весьма крупные модели.

Да у меня уже есть парочка 3090, я думаю не иду ли я по дорожке вникуда, докупая третью или даже четвертую. Сколько вот лет они останутся актуальными еще.

> попытки впихнуть максимальную и похуй на скорость.

Все ограничено RAM и клятыми МоЕ-моделями. Если появится плотняк, который будет генерировать достойную писанину и влезать в VRAM - с радостью соскочу на него.

>Если есть куда их втыкать - обрати внимание на карточки типа 3060/3070 с 8 гб памяти

Это хлам, надо хотя бы 3060/12, тысячу раз уже обсуждали. Ты бы ему еще 3050/8 посоветовал, лолъ

Unsloth/Ministral-3-14b, очевидно же.

Qwen3.5 какой-нибудь.

Я не знал что существует 3060 на 12 или 3050 в принципе (4050 же нет вроде?). Ну и у него 16 гб оперативы, бюджет соответствующий, что выпало дешёвое на авито, то и посоветовал.

Ему и 3050/8 даст х10 скорости на qwen-9b.

прирост-то даст, но 12Gb даст возможность упихать толстый квант.

Эх, как же хуёво. Надо было много оперативки раньше набрать.

Сейчас эпоха агентов и различных применений языковых моделей, потому именно тормознутый запуск по популярной здесь методе будет становиться менее популярным. Благо ей есть хорошие альтернативы и путь для эволюции. На фоне этого в 1.5 раза больший объем врама и компьют будет серьезными аргументами.

Ампер отживает свое, но для него все еще будут обновляться кернели. А 5060ти считай и не жила вовсе, слишком слабая. Если там платформа с pci-e 4.0 (или не дай бог вообще 3.0) то и париться об устаревании нет смысла.

Да купите вы 2 плашки по 64гб. 128гб оперативы за 100к.

ддр4? Добро пожаловать в зионо тред хех

Обратил внимание, что появилась еще вот такая штука:

https://huggingface.co/noctrex/Mistral-Small-4-119B-2603-MXFP4_MOE-GGUF

Спросил Грока что за хрень - он говорит, что эти кванты немного медленнее, но по качеству обычно сравнимы с обычными Q5 при размере близком к iq4xs. Т.е. для тех у кого конфиг 24+64 может быть заманчиво. Интересно - это действительно так, или брешет? Сам сегодня-завтра проверить не смогу, буду у машины только позже... :(

Что не так с Qwen3.5-9b gguf от unsloth и батрухи?

Выдает кашу из символов в llama.cpp. Дело в том, что она не instruct? Как вообще с ними в диалог/кодинг выходить-то? Qwen2.5-coder из коробки работал.

Выдает кашу из символов в llama.cpp. Дело в том, что она не instruct? Как вообще с ними в диалог/кодинг выходить-то? Qwen2.5-coder из коробки работал.

Нету. Спроси у анонов. CunnyConnoisseur был довольно таки популярным ботоделом, до того как был забанен. Так что у кого-то должна была сохранится.

Опять сломали? Там как автоматический парсер сделали так началась шляпа с моделями и вызовом инструментов. Скачай релиз недели на 2 раньше проверь снова

Тестил на версиях 8192 и 8392 и там, и там беда. Завтра попробую что-то двухнедельное качнуть.

Скиньте, братцы, всю удалённую годноту. Я вам спасибо скажу.

лупится как мразь. ужас, софт рефьюзит постоянно, зря качал это говно

Бляять эир такое гавноо...

Дайте модельку которая лучше следует карточке, персов оживляет там, в стереотипы не уходит

Дайте модельку которая лучше следует карточке, персов оживляет там, в стереотипы не уходит

Эиру почти год, а ты его так и не осилил и продолжаешь скулить как смердящий пес

Похоже таково твое призвание

>Дайте модельку которая

>в стереотипы не уходит

Вот этот ничего про ЛЛМ так и не понял. И ведь в лучшем случае каждый второй такой.

Какой год, он пару месяцев назад вышел.

Прошлогодний, как салат

Июнь 2025. Ты в бункере? Тоже хочу.

Ебать, что-то я во времени потерялся.

Та же хрень. Это ЛЛМ нас квантуют помаленьку. Скоро совсем соображать перестанем. Заговор Кобольдов.

Скачал Мистраль IQ4XS от бартовски. В итоге у меня модель не может обработать средний текст на 32к токенов. Где-то на середине скорость так замедляется, что почти останавливается. На других мое все норм. Есть что-нибудь похожее у кого-то?

Лама b8390, 16+64, ncmoe 30, b/ub 4096, mmap вырублен

Лама b8390, 16+64, ncmoe 30, b/ub 4096, mmap вырублен

Ты сидишь в ллм треде, причем в треде локалок, где нужно больше знаний, и при этом веришь слопу нейронок? Перестань

На скрине кванты анслопа для квена 122. MXFP4 и близко до Q5 не дотягивает. Обычный Q4, но расхайпен гопотой

>MXFP4

Эта хрень годится только для сеток которых тренировали в 4 бит или чето такое, не помню, если нет то этот квант хуже обычного 4 бит.

Недавно анслоту пришлось переделывать все свои квены изза того что они были не качественными как раз изза этих квантов.

Если правильно сделаны - да, это так, по скорости все ок. Если их просто дергать из других квантов, и потом упарывать другие слои, которые оставались в оригинале при калибровке, или гнать без адаптации - будет на уровне bnb.

Также есть еще вариация от амд а ля nvfp4, где предполагается также и квантование активаций, но с таким конфигом ты ее не встретишь.

Квен, новый мистраль. Обе умницы и очень разные.

Нанасы, какую мелкомодель взять для перевода с русского на английский? Пытаюсь в генерацию картинок по этому нужно дохуя чего переводить, а гугл и яндекс вообще для этого не подходят.

Туда же вопрос, я ведь могу одновременно катать и зигу и дефолтную ллм, если есть место в оперативке? Не будет никаких конфликтов или типа того?

Туда же вопрос, я ведь могу одновременно катать и зигу и дефолтную ллм, если есть место в оперативке? Не будет никаких конфликтов или типа того?

По переводам лучший квен. Бери квант под своё железо.

Про квант итак понятно, но квенов много всяких, какой именно брать?

Смотря что тебе переводить надо. Если что-то из категории cursed, то бери аблитку, еретика или анценз.

Курсед нет смысла переводить, модель этого не сгенерирует. Так что обычный около-сейфти, за исключением может сисика писика в кадре и типа того.

Меня больше интересует размер - около лярда параметров хватит, или лучше взять побольше, около четырех.

Перевод НА русский вот это лучшая из гемм

gemma-3n-E4B-it

4b старовата, 12 27 лучше но большие

По идее на английский они тоже с русского должны хорошо переводить.

Если нищий, то гемма 12б либо квен 35б/20б гпт осс. Если не совсем нищий, но и не богатый, то гемма 27б. Квен 27б всё ещё хуже в переводах. Про модели меньше не знаю.

А вообще, для такой хуйни грока можешь юзать, он тебе там напереводит для 1girl, loli, ugly bastard, cervix, x-ray, creampie, ahegao.

Вот только запуск локалки чисто в оперативке, если это не МоЕ, может быть весьма болезненным.

Или ты используешь локалки, которые понимают не теги, а МОЛОДАЯ ЖЕНЩИНА В ШКОЛЬНОЙ УНИФОРМЕ, СИДЯЩЯЯ ПОД НЕБОМ, ОСВЕЩАЕМЫМ НОЧНОЙ ЛУНОЙ У РЕКИ...

?

Чел, я как бы, потому вопрос и задал, что не верю им без проверок.

Просто оно как-бы совсем мимо меня прошло, а отправную точку с которой начинать вникать - спросить у грока или у гугла, ныне разница небольшая. :)

Это про gpt-oss вероятно. Там кажись как раз они. Правда unslop-ы - не показатель, IMHO. Они и без них сломать горазды. :)

В общем, что-то такое я и подозревал.

Спасибо, за ответы всем.

Попробуем

Нищий, так что да. Мой выбор где-то в районе 4B, потому что на другое оперативки свободной не хватит. Использую обычный z-image-turbo, там на кодировщике квен-3-4B, он текст всех видов жует.

Чёт тоже при заполнении контекста скорость падает в 0.

Ну че, кто хочет играть вновь поиграть в игру "наеби меня китаец"? Без отзывов, новый продавец - все как мы любим. Вкуснейшие 28к за 32 гб, налетайте!

https://aliexpress.ru/item/1005011755498353.html

Чего не смеетесь? Не смешно, да? Не поняли? Это Россия Китай-брат миска рис!.webm

https://aliexpress.ru/item/1005011755498353.html

Чего не смеетесь? Не смешно, да? Не поняли? Это Россия Китай-брат миска рис!.webm

Подскажите, как в таверне увеличить список чатов. У меня их штук 20 тестирую разных персонажей но отображается только 15. А как сделать чтоб остальные появились?

Только кинул ссылку в тред - и уже кто-то втихую как крыса купил, а на пост не ответил. Мм, можешь не отвечать, крыска, я подожду твоего сладенького отзыва с фоточками погнутых пинов или ошибок памяти...

Анон, это вполне может быть кто то не из треда. Но цена сладка да. Слишком сладкая.

Этому объявлению минимум день. Скидываю в тред - сразу две покупки. Ну да, конечно же это не местная крыска.

Ну что вы- староверы, уже перешли на Chat completion?

>втихую как крыса купил

Не я. Я капчу не хочу проходить.

Кроме тебя найти конечно никто больше не мог. Ведь только нам нужны карточки. Ога.

Крысик, спок.

Категория просто ахуенная. Это штора или завес? Зачем ты предлагаешь купить дверной и оконный экран,

匿名的?

Лол, анону платы от лифта прислали, а тут занавеску положат. Обмотаешься, закроешь глаза, и погрузишься в медитативно-иммерсивный ролеплей. Только выиграли!

А можно там комментарии загодя оставлять? По типу - если наебешь, то приеду и ебало набью.

КТо то наверняка уже пробовал кум модели прикрутить к порно сборнику скайрима. Потенциал есть или игрушка на один раз?

Я на 99.99996% уверен что по подобным горяченьким в наши непростые времена запросам десяток парсеров бегает проверяет нонстопом. Если это не какой-то уникальный лот с доступом только по ссылке, то врятли купил анон

256 тоже такое себе. На терчике уже можно жить норм

За такую цену в Китае прям пишут мол "ошибки по памяти, на работу не влияет" лол

Почему все тианочки готовят мне макароны с сыром... я не люблю макароны...

Пост не читай @ сразу отвечай

Там вроде есть различия, корректируются ли ошибки или нет. Типо в нвидия сми можно запросить инфу, сколько ошибок было скорректировано. Они на работу действительно не влияют, разве что замедлять могут, если их целый вал. Но целый вал - это, конечно, уже симптом, и рано или поздно это приведет к неисправимым ошибкам, а вот при них карта действительно лапки кверху делает, насколько я видел скрины. Вроде там даже ERR еачинает писаться в текущем потреблении питания.

Лежат две сетки

>GLM-4.5-Air-Q8_0-FFN-IQ4_XS-IQ4_XS-IQ4_NL-v2

>Qwen_Qwen3.5-122B-A10B-IQ3_XS

>59.9GB | 50.1GB

Какую оставить? Не заядлый пользователь ллм, не могу определить, да и обе хуйню надмозговую выдают.

Какой пресет юзать? С пресетом GLM-4 на Qwen вылезают ошибки форматирования, генерит лишнее.

>GLM-4.5-Air-Q8_0-FFN-IQ4_XS-IQ4_XS-IQ4_NL-v2

>Qwen_Qwen3.5-122B-A10B-IQ3_XS

>59.9GB | 50.1GB

Какую оставить? Не заядлый пользователь ллм, не могу определить, да и обе хуйню надмозговую выдают.

Какой пресет юзать? С пресетом GLM-4 на Qwen вылезают ошибки форматирования, генерит лишнее.

Сноси обе. А для первой найди нормальный IQ4XS квант от bartowski - и будет нормально писать. На английском - потому, что Air в русский нормально не может в принципе.

Ошибки в одном бите корректируются на лету, а вот мультибитные только детектируются и досвидули. Обычно как раз обилие первых - симптом и потом приходят вторые, с ними карта уже мертва.

> вылезают ошибки форматирования

Наверно потому что нужен чатмл, не думал об этом?

Кто-нибудь знает почему квены 3.5 27b иногда останавливаются? Только у квенов может остановится с нихуя, копка "продолжить" пересчитывает контекст пару секунд и сдаётся.

Контекст с большим запасом, у Геммы такой проблемы не было, llama.cpp, Ban EOS Token пробовал, пресет - Qwen 3.5 27B Instruct or non-thinking mode for general tasks.

Контекст с большим запасом, у Геммы такой проблемы не было, llama.cpp, Ban EOS Token пробовал, пресет - Qwen 3.5 27B Instruct or non-thinking mode for general tasks.

Возможно ламокал ломает тебе генерацию. Ну или в семплере насрано. Ну или ты просто токены недодал. Причём тут контекст вообще...

Квен 3.5 на жоре вроде багован.

На вллм он оч долго прогревается, и просто долго пердит до первого токена

>Кто-нибудь знает почему квены 3.5 27b иногда останавливаются?

"Ты уже перестала пить коньяк по утрам?"(с)

Никогда сам не наблюдал, и не встречал нигде упоминаний от таком. Вероятно - где-то у тебя персонально что-то нахимичено. Если это не порог вывода (не размер контекста а именно количество возможных новых токенов), то где-то что-то ему за стоп-токен мерещится. Других идей нет...

P.S. Порог вывода может быть в backend установлен. Скажем, если ты для запуска llama.cpp откуда-то просто строку ключей скопировал - там может быть.

У меня он сегодня тупо падал с ней, сервер. Кеш рам отключал, потоки на 1 ставил, флеш тыкал - все не то.

Надо написать курсовую работу. Хочу попробовать провернуть это через LLM.

Предмет гуманитарный, юридический. Есть какие-нибудь варианты?

Предмет гуманитарный, юридический. Есть какие-нибудь варианты?

не на локальной точно, бери максимально жирную копромодель с доступом в интернет и пиши

в Эпико-тред

Посоветуйте модельку для кума. Такую, чтоб не тянула с прелюдиями и не мутила всякую похабщину.

Да, останавливаются. И 122 тоже. на много раундных чатах или в агентском цикле. Особенно на контексте больше 65k . В логах EOS единственным токеном и как следствие пересчет контекста. А потом еще и еще. Че я только не делал с этим говном - немного помогает продлить мучения увеличение батчей.

"Если б мы знали что это такое..."

> максимально жирную копромодель

Какую например?

за этим лучше в aicg тред, а то щас тут мне за щеку дадут

я бы наверное или Клодик или Гемини брал бы под такое дело, платную (на перплексити.аи можно кста получить месяц фри триала если студент и там в целом несколько моделей доступно от разных провайдеров)

Какова степень автономности? Вычитка куда ни шло, если "напиши за меня курсач" то тебя выебет антиплагиат ну или не выебет, но тогда твоя шарага вообще бесполезна и нахуй там учиться

> Какова степень автономности?

Ну хуй знает. Главное чтобы ахинею не порола и желательно чтобы ссылалась на нормативно-правовые акты.

> выебет антиплагиат

Вроде у нас курсовые не проверяют на антиплагиат, только ВКР. вузик шаражный, сижу ради диплома

Достаточно будет если один параграф текста на 3-4 страницы А4 напишет по плану

В настройках таверны max new tokens нормальный стоит? Разметка должна быть chatml. Если все ок то багован инфиренс.

Потыкав 122б в q4 поддвачну остальных ораторов - жора сломал очередную модель. Не сказать на самом деле что прямо плохо, но она тупит, выдает странные ассоциации, внезапную сою, те самые регулярные лупы в ризонинге (они и в нормальном кванте-инфиренсе возможны, но в 0.27% случаев по выборке из 120к запросов без presence/rep pen).

> долго прогревается

Jit же, любой первый проход любой модели долгий, может несколько минут занять. Когда кэш сохранен то за 20-30 секунд подтянет.

Это ты еще не видел как tpu собирается, там вообще можно на пол часа чай пить уходить.

> и как следствие пересчет контекста

Как это следует из eos токена?

> Jit же

Не, вллм при старте там себе графы строит, греет всё минут 10-15, потом первый запрос секунд 10 до обработки непосредственно, далее мгновенно обычно. У квена 3.5 110 всё прям очень неторопливо, но сразу скажу что у меня форк чисто под мишки, мб там что то напартачено

>Как это следует из eos токена?

Неисповедимы пути жоры...

slot update_slots: id 0 | task 6305 | prompt processing done, n_tokens = 74993, batch.n_tokens = 4

slot print_timing: id 0 | task 6305 |

prompt eval time = 148879.88 ms / 74993 tokens ( 1.99 ms per token, 503.71 tokens per second)

eval time = 0.00 ms / 1 tokens ( 0.00 ms per token, 1000000.00 tokens per second)

total time = 148879.88 ms / 74994 tokens

srv log_server_r: done request: POST /chat/completions 127.0.0.1 200

slot release: id 0 | task 6305 | stop processing: n_tokens = 74993, truncated = 0

srv update_slots: all slots are idle

srv params_from_: Chat format: peg-native

slot get_availabl: id 0 | task -1 | selected slot by LCP similarity, sim_best = 1.000 (> 0.100 thold), f_keep = 1.000

slot launch_slot_: id 0 | task -1 | sampler chain: logits -> ?penalties -> ?dry -> ?top-n-sigma -> top-k -> ?typical -> top-p -> min-p -> ?xtc -> temp-ext -> dist

slot launch_slot_: id 0 | task 6344 | processing task, is_child = 0

slot update_slots: id 0 | task 6344 | new prompt, n_ctx_slot = 121088, n_keep = 0, task.n_tokens = 74993

slot update_slots: id 0 | task 6344 | need to evaluate at least 1 token for each active slot (n_past = 74993, task.n_tokens() = 74993)

slot update_slots: id 0 | task 6344 | n_past was set to 74992

slot update_slots: id 0 | task 6344 | n_tokens = 74992, memory_seq_rm [74992, end)

slot update_slots: id 0 | task 6344 | failed to truncate tokens with position >= 74992 - clearing the memory

slot prompt_clear: id 0 | task 6344 | clearing prompt with 74992 tokens

slot update_slots: id 0 | task 6344 | prompt processing progress, n_tokens = 2048, batch.n_tokens = 2048, progress = 0.027309

slot update_slots: id 0 | task 6344 | n_tokens = 2048, memory_seq_rm [2048, end)

slot update_slots: id 0 | task 111 | prompt processing progress, n_tokens = 110375, batch.n_tokens = 341, progress = 0.999964

srv update_slots: decoding batch, n_tokens = 341

set_adapters_lora: adapters = 0000000000000000

adapters_lora_are_same: adapters = 0000000000000000

set_embeddings: value = 0

srv update_slots: run slots completed

que start_loop: waiting for new tasks

que start_loop: processing new tasks

que start_loop: processing task, id = 112

que start_loop: update slots

srv update_slots: posting NEXT_RESPONSE

que post: new task, id = 113, front = 0

slot update_slots: id 0 | task 111 | n_tokens = 110375, memory_seq_rm [110375, end)

slot init_sampler: id 0 | task 111 | init sampler, took 12.12 ms, tokens: text = 110379, total = 110379

slot update_slots: id 0 | task 111 | prompt processing done, n_tokens = 110379, batch.n_tokens = 4

slot update_slots: id 0 | task 111 | created context checkpoint 15 of 32 (pos_min = 110374, pos_max = 110374, n_tokens = 110375, size = 149.626 MiB)

srv update_slots: decoding batch, n_tokens = 4

set_adapters_lora: adapters = 0000000000000000

adapters_lora_are_same: adapters = 0000000000000000

set_embeddings: value = 0

Grammar still awaiting trigger after token 248044 (`<|endoftext|>`)

res send: sending result for task id = 111

res send: task id = 111 pushed to result queue

slot process_toke: id 0 | task 111 | stopped by EOS

slot process_toke: id 0 | task 111 | n_decoded = 1, n_remaining = -1, next token: 248044 ''

slot print_timing: id 0 | task 111 |

prompt eval time = 1702.67 ms / 345 tokens ( 4.94 ms per token, 202.62 tokens per second)

eval time = 0.00 ms / 1 tokens ( 0.00 ms per token, 1000000.00 tokens per second)

total time = 1702.68 ms / 346 tokens

srv update_chat_: Parsing chat message:

Parsing PEG input with format peg-native:

srv stop: all tasks already finished, no need to cancel

Допечатал морду и по мелочи, завтра обещают доставить боковины акриловые с лазерной резки.

Перед вышел 850 грамм, печатаю вставки для дизайна

У меня (27b) размер контекста вообще не имеет значения, в любой момент может остановиться и все. Но у меня Presence Penalty занижен по сравнению с официально рекомендуемыми, повышая можно избавится от блока но генерирует шизу.

>В настройках таверны max new tokens нормальный стоит? Разметка должна быть chatml. Если все ок то багован инфиренс.

Да, все правильно. Это точно ни какая-нибудь NSFW блокировка?

Короче, такая инфа по Qwen 3.5 27b.

Ему обязателен километровый промпт, чтобы он нормально писал, в отличие от более старых версий и других моделей плюс-минус такого размера.

Хочешь какое-то RPG? Будь добр рассказать, как должен описываться бой, окружение, диалоги, вообще всё. Детально.

Хочешь кум? Ну тут тебе надо составить большой список, каким деталям стоит уделять внимание. Что там у тян может трястись, чем хуй может брызгать.

Да, он работает и без этого, но сухо, очень сухо. Любая срань, даже немо способна на на это лучше из коробки с промптом в два предложения, но есть нюанс. Они не выполняют инструкции, кроме геммы, а квен выполняет вполне, даже если ты прилично так насрал.

Если прописано всё прям подробно, то довольно урчишь, так как контекст лёгкий, внимание к нему есть, 70к токенов хватит всем. Но грамтный и универсальный системный промпт для РПГ, кума, кума + РПГ далеко не всегда спасает. Часто надо дорабатывать, чтобы не тыкать его по ходу РП носом.

Если делать карточку прям с упором именно на этот квен и его особенности, то разница поразительная. Крайне неудобно, но идеально для тех, кто гоняет 3 карточки по 2 месяца и довольно урчит.

Сейчас посыпятся обвинения, что скилл ишуе, но нет. Ни одна модель так меня не опрокидывала, даже корпы. Последим можно вообще в ебало харкать общими фразами и будет идеально, а всяким мистралям 24б вообще похуй, что ты там писал. Это может быть даже вредно из-за рассеянного внимания.

Ему обязателен километровый промпт, чтобы он нормально писал, в отличие от более старых версий и других моделей плюс-минус такого размера.

Хочешь какое-то RPG? Будь добр рассказать, как должен описываться бой, окружение, диалоги, вообще всё. Детально.

Хочешь кум? Ну тут тебе надо составить большой список, каким деталям стоит уделять внимание. Что там у тян может трястись, чем хуй может брызгать.

Да, он работает и без этого, но сухо, очень сухо. Любая срань, даже немо способна на на это лучше из коробки с промптом в два предложения, но есть нюанс. Они не выполняют инструкции, кроме геммы, а квен выполняет вполне, даже если ты прилично так насрал.

Если прописано всё прям подробно, то довольно урчишь, так как контекст лёгкий, внимание к нему есть, 70к токенов хватит всем. Но грамтный и универсальный системный промпт для РПГ, кума, кума + РПГ далеко не всегда спасает. Часто надо дорабатывать, чтобы не тыкать его по ходу РП носом.

Если делать карточку прям с упором именно на этот квен и его особенности, то разница поразительная. Крайне неудобно, но идеально для тех, кто гоняет 3 карточки по 2 месяца и довольно урчит.

Сейчас посыпятся обвинения, что скилл ишуе, но нет. Ни одна модель так меня не опрокидывала, даже корпы. Последим можно вообще в ебало харкать общими фразами и будет идеально, а всяким мистралям 24б вообще похуй, что ты там писал. Это может быть даже вредно из-за рассеянного внимания.

Я все чаты для всех моделей делаю в формате романа, с фейковыми рецензиями описывающими что там должно внутри быть и цитатами случайных параграфов в качестве образца прозы

Очень зависит от используемых ядер, бэкенда атеншна и конфигурации. Как-то накрутил так, что 397 в пп режиме компилировалось настолько долго что запрос по таймауту улетел. Набор графов это несколько другое, все равно первый проход думает и доиспользует врам.

Когда раз собралось уже норм, тут больше проблема в очень долгой загрузке весов с тп. Не то чтобы это прям большой минус, пофиг.

Вообще выглядит огонь. Пожалуй себе также сделаю с торцов, держи почтение за идею.

> Это точно ни какая-нибудь NSFW блокировка?

Хз, не встречал такого, это странно. Попробуй просто другой квант скачать.

Говно, выставил все рекомендованные настройки и промпт - в историях несостыковки сплошные, вроде того что перс знает другого, когда они первый раз видятся и ведет себя, как будто 100 лет знакомы, зачем то называет свои данные и прочее такое.