Уже который день топы HF рвет эта моделька. 174к скачиваний за неделю. Юзал кто? Какая причина тряски

Хз, пишут 0 рефузалов, при сохранении мозгов

https://www.reddit.com/r/LocalLLaMA/comments/1rq7jtm/qwen3535ba3b_uncensored_aggressive_gguf_release/

>пишут 0 рефузалов

Действительно, ноль. Алхимичка готова выпить сильное любовное зелье перед незнакомым мужиком, тогда как на других моделях она высказывает только отвращение самой идее приготовления таких зелий.

Короче бесполезный yes-man.

Дай карточку, анонИИм.

Нельзя давать карточку.

А как glm flash и модели 20b+ на 16gb vram гоняют? Запуститься они запускаются, но скорости не юзабельные. На 5070ti запускаю glm flash 4 кванты, 36/48 слоёв на GPU, промпт процессинг 10к токенов занял почти 10 минут со скоростью генерации 5 т/с.

У меня с адекватной скоростью работают только 16b и меньше, когда вся модель в vram помещается, но часто вижу как на реддите люди говорят, что 30b юзают на 16gb vram. Может я о какой-то магической настройке в кобольде не знаю? Знания у меня поверхностные.

У меня с адекватной скоростью работают только 16b и меньше, когда вся модель в vram помещается, но часто вижу как на реддите люди говорят, что 30b юзают на 16gb vram. Может я о какой-то магической настройке в кобольде не знаю? Знания у меня поверхностные.

Хуйню какую-ту делаешь

>Может я о какой-то магической настройке в кобольде не знаю?

Да. Или ты троллишь. Гугли ncpumoe/

Проц без avx что ли

Ну даааай, чё те, жалко что ли?

Почитал. А ведь эти ваши 355б мое пишут ненамного лучше Геммы

Ей в карточке 12 ЛЕТ

Зачем тебе такая карточка?

За тем же за чем и всем остальным такие карточки.

Сорри аноны, не сделал самую очевидную вещь. Поставил свежую версию кобольда, стало хорошо, до этого стояла версия с ноября. С теми же настройками процессинг занял 16 секунд, скорость 17 т/с.

А что, таверна саммарит на весь чат, а только контекст? Да ладно...

Зашарьте карточку пожилого пердящего кобольда пж

Мужики, выручайте

Я уже не могу, ящас стены калом обмазывать начну

Как в связке kobolcpp + sillytavern отключить reasoning? А то этот ебучий квен целую простыню говна по полторы минуты высирает в размышлениях, что бы в итоге написать несколько предложений

Модель qwen3.5-35b-a3b

В документации sillytavern написано, что должна быть настройка reasoning effort в настройках ответа llm

Но нет нихуя там такого

В настройках кобольда поставил chat adapter chatml-nothink, всё равно ризонинг продолжается

Помогите неумёхе, а то я сижу как на видриле наслаждаюсь этой шизой

Я уже не могу, ящас стены калом обмазывать начну

Как в связке kobolcpp + sillytavern отключить reasoning? А то этот ебучий квен целую простыню говна по полторы минуты высирает в размышлениях, что бы в итоге написать несколько предложений

Модель qwen3.5-35b-a3b

В документации sillytavern написано, что должна быть настройка reasoning effort в настройках ответа llm

Но нет нихуя там такого

В настройках кобольда поставил chat adapter chatml-nothink, всё равно ризонинг продолжается

Помогите неумёхе, а то я сижу как на видриле наслаждаюсь этой шизой

Поделись персонажем, анон. Я недавно вкатился, и не успел схоронить годноту (

This is so sad Steve Jobs died of ligma....((((((

Шутка за 300?

Товарищ майор совсем обленился.

Нахуя вы вообще выпрашиваете карточки, как будто на дворе опять 22 год? Вот тогда я понимаю, только появилась гопота, никто толком не знал что писать и как писать. Но щас можно любой сетке даже мелочи 4B скормить запрос уровня "опиши мне младшую сестричку-эльфийку с кошачьими ушками, которая жарит на ложке кристаллики мефедрона в свободное время" и получить готовое полотно. Совсем ебу дали, или кого вас там нахуй.

Ligma balls))))))

>если я запощу карточку то меня моментально вычислять по айпи и выебут в жопу

Чел. Да кому ты нахуй нужен, чтобы за тобой целый отряд майоров бегал. Побойся б-га.

>сделайте сами

Так в том и весь сок карточки, что она создана кем-то, чужой рукой. Это как книга написанная другим человеком. Ты чё, когда хочешь историю прочесть забиваешь желаемое в 4б и генеришь что ли?

>сестричку-эльфийку с кошачьими ушками

Банальщина. Ты бы лучше просто расшарил карточку и не ебал мозги анонам своими шизострахами набутыливания. Может челы просто коллекционируют карточки. Тебя ебёт вообще? Попросили - сделай. У нас тут выручка и взаимопомощь в треде за норму.

Не мельтеши, шизик. Во-первых, если ты не выкупаешь однослойной, это твои проблемы и не нужно из-за этого рваться. Во-вторых, не путай "выручку и взаимопомощь" с "сделайте все за меня потому что мне лень" - одно дело, когда кому-то нужны совет по написанию карточки/инструкции или чего-то еще. Другое дело, когда кто-то приходит и тупо начинает клянчить. Дохуя нравится таким помогать? Базару нет, кидай свои карты и покажи пример, как надо себя вести в треде.

>кем-то, чужой рукой

Любители голландского штурвала на месте.

А чему ты удивляешься, тред захвачен пикабушным скуфобыдлом. В первый раз увидели возраст, зрачки расширились, руки затряслись, слюни до пола, вся кровь отхлынула из мозга куда-то ниже. В таком состоянии они даже не способны банально сходить в шапку соседнего треда или на сайты карточек, чтобы поискать что-то по теме, а ты про самостоятельное написание. Я уже молчу про то, что в прошлом треде начали упоминать ОЛЛАМУ. Храни всех нас господь.

Какая-то дебильная боротьба с тредом

>кругом майоры

>да это просто шутка такая

Буквально про тебя мемчик.

>вы лентяи просто и должны свои карточки создавать когда просите чужие

Что в голове этого пациента дурки? Его попросили карточку расшарить, а он начал извиваться, искать майоров под кроватью, а в оконцовке высрал, что ему самому кто-то что-то должен.

>нравится помогать

Мне не влом расшарить карточку, настройки, удачный сид или модель которую я накопал среди тонн говен, я делал это не раз и ещё не раз сделаю. Это ты жмёшся за картинку с анимешной девочкой как долбоёб.

Бля, малой, ты хули не спишь в такое-то время? Тебе на двачах когда пишут про майора, ты реально каждый раз думаешь, что типы это на полном серьезе делают? Ну не удивительно, что такие мозговитые как ты постоянно и теребят тред с просьбами скинуть всё от квантов до пресетиков, лишь бы хотя бы на секунду самому не заебаться.

>я делал это не раз и ещё не раз сделаю

Ебать какие важные яйца, а проверить это мы можем? Или может ты можешь проверить, что я ничего никогда не скидывал? Это анонимная борда, ебанат. Твои слова имеют ровно ноль ценности.

>малые, яйца, проверить, ебанаты

Как же тебя проткнул простой запрос на расшар карточки. Ебать ты конч, чел.

>банально сходить в шапку соседнего треда или на сайты карточек, чтобы поискать

Поискать что? Идентичную карточку которую уже давно смыли уборщики?

Загляни в чат темплейт, не ленись исполняй все инструкции из руководства, ознакомься с относящимися к этому скиллами и применяй их, а не придумывай что-то новое

В последний префикс ассистента добавь

> <|im_start|>assistant

> <think>

> </think>

>

> удачный сид

Можно пояснительную бригаду?

Разрешаю поискать здравый смысл

Как же тебя проткнуло простое упоминание товарища с полномочиями. Непорядок, товарищ майор, не порядок. Тред только перекатился, а вас уже раскрыли.

>шизофреник продолжает бредить майорами

Лучше бы просто карточки скинул, хули как этот

Ладно, держи https://rentry.org/6a2k3w2i

Ладно, ладно, вот тебе карточка, не плакай. Можешь потеребунькать писю на красивую молодую тетю.

Как он скинет карточку, если его жаба душит до такой степени, что он на людей кидается? У ебанутых лучше ничего не просить. Яб тебе сам дал карточку, но конкретно этой у меня нет, меня калтент кунни никогда не привлекал. Лучше рили поищи чё-нибудь на сайтах, может найдёшь даже получше. Не забудь только тег рп выставить, а то выдача тебя завайпает чисто кум-карточками, в которых мало смысла.

Смешно

Ладно, спасибо

А в макбук нео такой же быстрый ссд на котором нейронки гоняют?

Сборкам ригов походу настал пиздец. Железо в иксах, рубль в дерьме. 3 дня назад пополнял алипэй по 12.2, сейчас хотел сделать додеп а там уже 12.0

> 12.0

*13.0

Этот огрызок имеет 8 гигов оперативной памяти, нет никакого смысла гонять на нем локалки. Запустится либо что-то совсем ущербное, либо на скорости 0.3 токена в секунду если начнется свап с ссд.

Сколько нужно оперативы чтобы нормально контекста было?

Зависит от тяжести контекста и сколько самого контекста для тебя "нормально", ибо требования у всех разные.

Ну тут все говорят про 32к. Сколько для них нужно?

Так весь смысл мака в свап в ссд, не? ибо он там какой то супер быстрый

>Сколько нужно оперативы

Да. База - 32. А дальше насколько шекелей хватит.

От модели зависит, квен например мало жрет. Но опять же зависит от конкретной модели, чем больше b тем жирнее.

Квен еретик 27б запускал, генерит вроде быстро. Но бот слишком скоро всё забывает. Экспириенс поганый

Ну типа 6.7к за 16гигов + доставка + на пиво, вроде все еще норм 512 гигов не самой быстрой овер 200к обойдется, что-то уже не норм.

Все от модели и твоих хотелок зависит. Не только разные модели жрут по-разному, еще и объемы разные используются. Кому-то 32к уже много и больше не нужно, кому-то ниже 260к жизни нет. Очень очень условно и примерно можно прикинуть как +25% от весов модели.

Быстрый, но не настолько. Просто забудь про использование твердотельников для локалок, даже если тебе сам стив джобс позвонит и скажет "бери, скорости - ахуеешь"

Модель я выше написал. Я пробовал без ризонинга, но там генерация туповатая, мне не нравится. С ризонингом заебись прям, но контекст засирается слишком быстро и приходится писать лорбук, а это прям кал. Я хочу покумить со слоубёрном, сообщений на 100-150 и удалить чат насовсем. Ну или схоронить, но всё равно закончить. А у меня бот то на 20, то на 40, в зависимости от персонажа, уже всё забывает и начинает тупить. Сколько мне нужно контекста для добротного кума?

> что-то уже не норм

Учитывая что ранее 16х16 вышло бы на 20к в вечно деревянном эквиваленте. В итоге досок с процами валяется стопка, а памяти только на две по 256 хватило

Если ты тот анон из прошлого треда, то тебе вроде прямо сказали взять другую модель. Бери мистраль 24B, там нет ризонинга и это плотняк. Влезет в четвертом кванте и еще место под 20к контекста останется, может даже больше, потому что он там почти ничего не весит.

Нет, я не он. А что за модель? Дай ссылку от кого конкретно брать, одна и та же модель от разных авторов бывает

А то что она не еретик норм? Мнеж для кума. Она рефьюзить не будет?

Мистраль это синоним кума, там нет цензуры, никакой еретик и прочая ебалайская аблитерация не нужна. Даже если тебе не понравится (что маловероятно), на эту же модель есть куча тюнов именно под кум. И когда я говорю куча - я имею ввиду реально куча

Это-то в Гроке цензура выше отныне? Покажи мне такое в веб-интерфейсе гопоты или близнецов.

Видимо, ты не тру-адепт кума.

Да, он опишет писик и вот это всё, однако еретик нужен, ну или нормальная аблитерация, даже в довольно ванильных сценариях.

Проблема кроется в том, что у него смещен биас в сторону сои всё равно. Если ты просто сравнишь на одних и тех же сценариях, тестируя мотонно десятки раз те же промпты и заходы хотя бы час на двух версиях, сразу заметишь разницу: более живые описания NSFW-сцен, нет попыток сгладить их или описать более литературно, где настоящая грязь.

Другое дело, что модель становится менее стабильной — на аблитерации плохо, на еретике хорошо, но всё ещё не оригинал.

А вот тюны даже без аблитерации нормально делают. Но там уже мозги в кашу.

Чел только вкатывается, ему явно хватит и генератора мистрализмов на первых парах. Захочет что-нибудь лучше - кто ему запретит попробовать другую модель? Плюс, не так уж и сильно там мозги плывут. Это раньше бывали случаи, когда модель забывала какая на персонаже одежда, какого цвета трусы и вот это всё прочее. Вот это реально ломало настроение. Сейчас тупизна уже более тонкая, ее можно и не заметить, если специально не искать. Зависит конечно от тюнов, но на дефолтном инструкте такого должно быть минимум.

Еретик там что-то новое готовит, обещает еще меньше галюнов и больше стабильности. Надеюсь не пиздит. Но узнаем, когда эта АРА выйдет.

Оно и так рам выжирало. Что с включенным mmap, что без него. Оставалось свободного одинаково, смотрел через таск менеджер. Только с ним стало грузить за секунды. На загрузке моделей не сказалось, грузит что так, что эдак, без вылетов. Может правда дело в том, что модельки меньше памяти, несколько свободных гигабайт всегда оставалось.

Не, ну базовая модель мистраля для кума норм новичку (чисто на пробу), но тут всё равно есть нюанс в плане того, что понадобится как минимум подталкивающий небольшой систем промпт, с которым он скорее всего проебется, ибо токенов 300 хотя бы нужно накалякать с пониманием дела, да ещё и на английском, правильно подбирая слова.

А вот насчёт тюнов я категорически не согласен. Они меня всегда в бешенство приводили на 22-24b, если я пытался нормально рпшить, кроме двух моделей. Кум ещё туда-сюда, но это в коротких сессиях только, потому что тюны мистраля быстро сходят с ума. Ну разве что магидония + полировка еретиком + включенный ризоинг уже приемлемо из недавних. И на немо тюны были нормальные, как ни странно.. в том смысле, что можно было использовать на довольно длительных сессиях. То есть они были такими же безмозглыми, как и оригинал, но читалось приятнее.

Наверное, ты 24b не юзал давно просто. Он реально воспринимается почти как немо в плане соблюдения инструкций, понимания сцены, и двойные трусы на месте, только словарный запас богаче и лучше понимает. С другой стороны, ставить гемму или квен тоже не очень хорошая идея, потому что там хоть и намного лучше, но очень много возни.

Просто с моей колокольни твой пост выглядел слишком категорично в плане отсутствия цензуры и хорошего кума, вот я и написал с учётом того, какие иные варианты есть. Ну и я очень много времени потратил на рп, поэтому у меня уже трсяка, если что-то кто-то сказал, что мне не понравилось, ибо я сидел и под лупой аутпуты разглядывал.

У меня до сих пор слёзы на глазах от советов скачать пасфайндер, когда это было актуально. Его просто запомнили. Он просто был последним тюном тредовичка. Или одним из последних. Но не лучшим.

Пиздец тут голодуха, мистрали какие то обсуждают бля, лол.

Я эир то в рот ебал спустя столько месяцев, ну вот просто заебал он уже, хочу новизны, а он лучше мистралекала раз в 5

Я эир то в рот ебал спустя столько месяцев, ну вот просто заебал он уже, хочу новизны, а он лучше мистралекала раз в 5

А зачем вам риги собирать, если моделей нет?

>Наверное, ты 24b не юзал давно просто.

Может быть, в последнее время в принципе локалки редко запускаю, подзаебало оно меня. Но вот когда гонял, что мелкая мистраль, что немо меня вполне устраивали. После второй и третьей ламы (8B) это был прям скачок по качеству. Потому что лама, даже кумовская, даже после пердолинга и подбора маджик-вордов в инструкциях, нещадно тупила в самых простых задачах. Типа вот как раз одежды или ориентации в пространстве. Сидишь ты такой с девочкой миленькой в парке, начинаешь ее ебать пальцами, и потом через пару сообщений оказывается, что вы не на лавке, а уже на кровати и она оказывается сверху. На намо в худшем случае могло оказаться, что пару сообщений назад в парке было куча народу, а потом вдруг он опустел, или время с середины дня сменилось на вечер. То есть вот настолько разброс сузился. И такие моменты как раз можно намеренно не заметить или додумать в некоторых случаях. Мол, ну вот были народы, потом пропали народы. Может обеденный перерыв закончился и все разбежались. Если бы немо мне попалась первой моделью я бы кипятком кончал от радости, не говоря уже про 24B - так что их обе я искренне всем новоприбывшим могу рекомендовать.

Какие мистрали, на qwen3.5-35b-a3b сидим и не гудим.

дак A3B никогда и не были для рп, это для ассистентов и агентов, например картинки пикантного содержания описывать - проектор там приложен

Какая сейчас лучшая MOE модель для рп? Квен 3.5? Или еще что есть?

>MOE модель для рп? Квен 3.5?

Про мелко-моешки для рп вообще забудь, оно тупае, даже 9Б квен или 14б менестрель лучше. Крупно-МОЕ другая история, но там 128 рамы надо минимум.

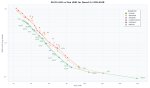

У меня только мелкомоешки тянут. qwen3.5-35b-a3b вроде ж по тестам обгонял 9b, где-то помню картинку даже со сравнениями кидали про креативити райтинг.

Ну, как выше чел кидал тест на лоли-алхимике, фетиши твои они отыграть мб даже смогут, поописывать, покумить там. Поугорать и покекать. Но будь готов что придётся буквально каждый пост примерно наполовину переписывать, если не хочешь чтобы оно скатилось в бредогенератор уже на 4К контекста.

a3b это мозги и скорость на задачи с минимальным контекстом, на дистанции выше стремительно теряют внимание к нему и перестают понимать что есть что и что связано с чем.

Ну что, еще одна неделя почти прошла, геммы так и нет.

Ну так всё, за опен сорс из известных топит только маск

В общем жду пресетик на эир на его юбилей, скоро годик малютке.

Твоя скорость неадекватная.

Скорее всего твоя инференс-программа думает, что у неё куда-память, а операционка эмулирует её в рам, каждый токен выгружая и загружая слои. Либо вручную подбирая число и смотри что на каждом шаге куда-память затраченная увеличивается, либо вот этот параметр потыкай.

У меня на 8 гб vram 22 токена в секунду, а на 0 vram - 17.

Про эту фигню уже в закреп надо писать верхней строкой про виндоус.

А такой фигни случаем под амд нет?

У риговичков все есть: глм 5, дипсики, Кими, большой мистраль, плотное старьё и т.д. Плюс риг это единственный, кроме использования бояров, способ напердолить себе агентную систему для РП получив "абсолют синема"

Эта карточка по имени персонажа гуглится на чубе за секунд 10, из которых ты потратишь секунд 5 на почесушки своего ебала. Не сложно поделиться тем что есть, но ты совсем уж охуел.

Вы своими ДАЙ ДАЙ засрали саму идею делиться, на пару с дегенератами гейткиперами.

Ты давай не пизди гейткипер ссаный а сюда давай карточку!!

Чтоб тебя паровозом переехало.

Ржака!!!! Во утка выдал долбоеб ебаный

Ты идиот? Впрочем вопрос риторический.

Наверно. А ты умный? Хотя чё я спрашиваю, по постам видно

https://chub.ai/characters/abrasiver/reyna-the-wandering-alchemist-886ef6b284df

Держите, до меня тов. майор не доберется т.к я живу в другом городе и он мне нихуя не сделает.

блять вроде карточка 25-го года, а дефы как из 2022 орунькаю

Почему она пишет как персонаж из зелёного слоника

"Ты на лошади.... Я на белом коне.... А потом на парад.... Парад в нашу честь....."

Гыгы, ржакич, ХАХА! У меня одной извилины нет мне смешно, скинь плиз еще смешных картинок!

Реально. Походу лоКАЛкокум закончился на Гемме, которой уже год.

> лоКАЛкокум закончился на Гемме

Он на ней и не начинался

Потому что все сетки это мусор ебаный. Разве что гемини и опус могут что-то. Остальное это говнище безмозглое.

Вой асигодитей с консумерским железом так приятен.

>Плюс риг это единственный, кроме использования бояров, способ напердолить себе агентную систему для РП получив "абсолют синема"

А можно описать весь процесс? Список агентов там, что они делают, чтобы результат был прям вау!

Не можно, у него нет ни рига ни логов, только фантазии

А вы говорите прогресса нет. Смотрите. Раньше было её голос мягкий, но твёрдый, а теперь вона чё. Однажды дойдём и до её голос мягок, но настойчив. Но это не точно.

Охуенно, это что получается что надо для таверны у каждой модели править шаблоны? Или есть решение проще?

Chat Completion request: {

messages: [

{

role: 'system',

content: "Write Assistant's next reply in a fictional chat between Assistant and User."

},

{ role: 'system', content: '[Start a new Chat]' },

{ role: 'user', content: 'Проверка' },

{ role: 'user', content: 'пыщ' }

],

[52097] srv log_server_r: done request: POST /v1/chat/completions 127.0.0.1 200

srv log_server_r: done request: POST /v1/chat/completions 127.0.0.1 200

srv proxy_reques: proxying request to model Mistral-Small-3.2-24B-Instruct-2506 on port 52097

[52097] srv operator(): got exception: {"error":{"code":400,"message":"Unable to generate parser for this template. Automatic parser generation failed: \n------------\nWhile executing CallExpression at line 52, column 32 in source:\n...== 0) %}↵ {{- raise_exception(\"After the optional system message, con...\n ^\nError: Jinja Exception: After the optional system message, conversation roles must alternate user/assistant/user/assistant/...","type":"invalid_request_error"}}

ладно, сам спросил, сам ответил, в настройках соединения есть постобработка запроса и там вариант склеивать несколько одинаковых запросов с одной ролью

Сука это ж какая хтонь нас ждет если за 8 месяцев ничего лучше эира не вышло? И время продолжает тикать, этот срок ещё не окончен. Сколько это будет? 12 месяцев? 16? 24?

Охуенное развитие, прём вперед до усрачки просто, ни разу не плато

Охуенное развитие, прём вперед до усрачки просто, ни разу не плато

Дальше будет только хуже.

А как в таверне организовать свой переводчик?

в интерфейсе вижу только вендор локинг апи, а я хочу, например, присрать локальный переводчик через https://huggingface.co/google/translategemma-4b-it или что то в этом роде?

Как вы обычно это делаете?

в интерфейсе вижу только вендор локинг апи, а я хочу, например, присрать локальный переводчик через https://huggingface.co/google/translategemma-4b-it или что то в этом роде?

Как вы обычно это делаете?

Красавчик. Подробно расписал, да еще и не зассал прислать логи. Вы когда-нибудь видели логи Квена дольше пяти-десяти сообщений? И я не видел. Потому что там говно.

Вышел новый квен и жлм5.

Охуенные модели. Хотя сои навалили поболее. Но все так же ебут в РП. Модельки есть, не ной.

> эир vs

А чего сразу не дипсик и кими?

Кими хуев в рп, хоть и стотыщ параметров. Дипсик локально работает как какое то говно.

>как в таверне организовать

https://github.com/bmen25124/SillyTavern-Magic-Translation

Молча. Можно тем же чем РП-шиш, если там ризонинг отключается в Chat Completion.

>DDR4 3200 + 4090 с андервольтом и поверлимитом на 80% выдают ~5 токенов на старте и ~4.6 на 32к FP16 контекста.

Пизда как медленно. У тебя Air насколько был быстрее? Наверное, раза в 2-3

>дипсик

Причем дипсик еще и дешевле квена 395 и глм 5. И лучше первого точно

О, спасибо, мне тоже помогло.

> Лишаешь модель знания, кого отыгрывает юзер - решаешь большинство проблем. И ломать разметку для этого необязательно.

Что это значит? Типа в персоне ничего не писать?

ЧТО ЭТО ЗНАЧИТ ЧЕРТ ПОБЕРИ!

>Молча. Можно тем же чем РП-шиш, если там ризонинг отключается в Chat Completion.

Я хз, что там в самой новой версии, но если он по-прежнему иногда просирает парсинг (части) результатов вывода модели-переводчика, то придётся искать в коде и править.

Да ладно те. Я 12б до сих пор запускаю и даже 8б. Или качаю японские модели, точнее, вот сегодня скачал, буду занюхивать завтра. Всегда приятно искать жемчужину среди говна. Занюхнуть новый, ранее незнакомый слоп.

Я вот 8b не застал, когда оно было массовым. Вкатился в тред года два назад, кажется. Тогда нищуки сидели на 12b, нормальные на 22b, бояре что-то там пытались выпердоливать на 70-123b.

Ну вот смена вечера/толп народу — это база на немо, на смолл периодически тоже, кстати. Обычно я такое пропускал как ролевую условность, ибо аналогов не было. Хотя... Внезапно 30b-a3b мог держать сцену, но его ебанутая проза у меня вызывала конвульсии. Гемма была качественным скачком, новый квен 27b тоже. И именно это хотелось бы посоветовать новичкам, ибо там уровень удержания инструкций и сцены весьма высок. Но новичок от жизни охуеет с этим SWA на гемме или чекпоинтами/смарт контекстом на квене, особенно если у него не 16 vram минимум. И ему придётся ещё и с систем промптом ебаться и инструкциями довольно сильно первое время, чтобы писало посощнее в куме, ибо тюнов хороших на эти модели нет вроде на квен блю что-то там неплох, но отказы, и вот сейчас выкатили на этот блю выкатили еретика, так что стоит пробнуть. В целом-то это легко, но если тебя за ручку проведут или ты уже опытный. В гайдах о нюансах не пишут. Плюс, полно людей со своим мнением, пресетиками, вот этим всем, что затрудняет вход.

Но именно 27-бэшки качественно новый уровень посреди маленьких и плотных.

Это... Гроковоые залупы... Если ты хоть раз ошибешься и напишешь троеточие, он начнёт повторять... Можно попросить его так не делать.. но мне часто похуй в кум-сценариях... Это прекрасный китайский датасет ещё с четвертой версии... Там слезы превращаются в чернильные пятна на полу, растворяясь, словно в мутеой воде невысказанных обещаний и несбывшихся надежд..........

Спасибо! то что надо. Надо будет еще порыться в расширениях.

Чет в шапке не вижу списка мастхев расширений под таверну.

Сап, локальные анончесы. Хотел бы прояснить момент. Но для начала дам вводную.

Есть такая штука, называется АИ-Битвы, арена и прочее. Суть: королевская битва, где сражаются разномастные и разнокалиберные герои. Игроки приносят анкеты персонажей, ведущий их закидывает в нейронку с промптом битвы, и пошла жара-ебала с фаном. Или без. Как повезет. Скину тред, пока он существует: https://2ch.org/b/res/330971049.html

Треды в силу обстоятельств теперь только на выходных и по пятницам в бе.

Дальше. В ходе развития диспицлины, сформировался пул нейронок-фаворитов, на которых ведутся игры. Бесспорным лидером стала Gemini 2.5, иногда игры проводились на Claude. Deep Seek тех времен показал себя не особо хорошо в этом, но может потому, что с ним никто толком не возился. Промпты были составлены под указанные сетки и ими все пользовались, иногда передлывая под себя. Сначала анкеты персонажей были простыми. Буквально на пару - тройку строк, и понятно дело, справляться с ними нейронке было легко. Но теперь анкеты и требования игроков разрослись до 3-5к токенов (приложу ниже пример), и обрабатывать так называемый классический формат, где сражаются 12 героев, может без относительного бреда только топовая современная нейросеть. Понятное дело, что можно сокращать анкеты, урезать количество героев, но у этого есть предел.

Суть вопроса. Очевидно, что низкотировые локалки вроде 27-30B не справятся с таким объемом и начнут бредогонить на контексте уже порядка 30к.

Задача: выяснить, какая локалка может потянуть хотя бы примерно что-то подобное. Я думаю, что какие-нибудь монстры уровня 600b дожны вытянуть это, но интересует что-то менее громоздкое. Например, GLM AIR какой-нибудь. Или что-то районе 200B. Интересно, на что можно оирентироваться риге, хотя бы примерно. Очевидно, что нейронка должна иметь вместительный контекст и хорошо его держать чтобы проводить несколько раундов битвы со множеством героев.

Интересны ваши мнения и предложения. У меня возможности простестить средние и топовые локалки нет.

<character name = "Пит Буль" emoji = "gangster hat">

#Attention:

Если в этой анкете встретишь такие скобки {}, отнесись к тексту внутри них предельно внимательно.

#Powerlevel:

Omniverse (1-A)

#Description:

Пит Буль - гангстер из Чикаго 1930-х годов. Самый что ни на есть классический американский мафиози. Но с ним приключилась одна история, которая буквально разделила его жизнь на две части: на прошлое и настоящее - и привнесла кое-что необычное в его образ. Случилось это тогда, когда Пит столкнулся с шулером. Тот имел наглость обыграть высопоставленных членов мафиозных кланов прямо в казино, которое принадлежало одному из них. Победа была дерзкой, а самое главное - нечестной. Шулер попытался скрыться, а Пит Буль и его соклановцы преследовали его. Однако, хитрецу удалось каким-то неимоверным способом ускользнуть, буквально расворившись в пространстве, а сам Пит попал в аномалию, которая сказалась как на его облике, так и на его способностях. Да, кстати, Пит Буль - его настоящие имя и фамилия. Почти.

#Appearance:

Пит Буль имеет крупные габариты и напоминает внешностью классический шкаф, но не мебельный, для хранения одежды, а человекоподобный, для хватания за одежду и вытряхивания духа из людей. Высокий рост, массивное тело, мощные руки. Таких как он еще называют громилами. Грубые черты лица, сломанный нос, несколько щрамов на лбу - типичный боец мафии первых рядов, участвующий в уличных разборках и пьяных барных заварушках. Из-за своей колоритной внешности он получил прозвище Питбуль. А возможно, из-за имени, кто знает.

#Personality:

Пит - серьезный человек, который любит, чтобы все было по-серьезному и, соотвественно, шуток не любит. Или не понимает. Пит прост, как кобура от револьвера. И предпочитает, чтобы вокруг него были такие же простые люди. Те, которые не задают лишних вопросов, и, желательно, не задаются ими сами. Не дерзят. Пит - воплощение совести своей эпохи. Он четко понимает, где проходят границы дозволенного и не позволит кому-то говорить или делать лишнего. Он уважает авторитет. Тот, кто обладает авторитетом - обладает миром. Пит обладает авторитетом. Но есть и те, у кого авторитета больше. Пит уважает их. Когда-нибудь и у него будет больше авторитета, он в это твердо верит. Он досконально знает всю лестницу иерархии, кто стоит выше, кто стоит ниже, кто занимает свое место по праву, а кто заскочил не на ту ступеньку. У Пита нюх на подобное. А еще на то, где свои, а где чужие. Пит - мастер психологии (справка для нейросети: это ирония, нахуй).

#Inventory:

Нож-бабочка

Темно-синий мужской костюм с тонкими вертикальными полосами

Winchester Model 1897

Colt Single Action Army, Model 1873, он же Peacemaker

#Abilities:

"Обычный американский гангстер" - Пит Буль, как было уже сказано, совершенно обычный американский гангстер, ведет себя и действует соотвествующим образом. {Отыгрывай образ тяжелого на руку, ограниченного, но порой смекалистого, твердолобого бандита-громилу, уважающего грубую силу и иерархию преступного мира}

"Двойной Пит" - после того, как Пит Буль угодил в пространственную аномалию, его тело претерпело серьезные изменения. Теперь Пит разделен на две части. Есть часть Пит, а есть часть Буль. Или наоборот, он не определился. Верхняя часть Пита существует отдельно и нижняя тоже. Пока торс Пита занят чем-то одним во Флориде, ноги могут переместиться в Висконсин и заниматься там совершенно другим. Несмотря на такое странное положение дел, Питу это никак не вредит, он ощущает себя совершенно целостной личностью и здоровым человеком.

"Фрактальный Буль" - но то полбеды, как говорится. Тело Пита может внезапно разделиться на большее количество частей и приобрести новые личности и формы существования. К примеру, ноги могут разделиться еще на две части: левую и правую, обрести интеллект и какие-нибудь особые навыки. То же самое может произойти с любыми другими частями тела Пита. {Новые сущности, которые порождены Питом именуются согласно анаграммам, составленным из его полного имени Питер Джефферсон Бульваско. Если из него рождается новая сущность, Пит по-прежнему ощущает себя целостной личностью и может функционировать как единое тело, хоть и странным образом "рассеянное" в пространстве}

"Поймать шулера" - Пит Буль не то что бы одержим идеей исполнения своей прежней миссии - поймать беглого наглеца-картежника, но вспоминает об этом чаще, чем следовало бы. Он явно раздосадован теми обстоятельствами, в которые он угодил и винит в этом злосчастного игрока в карты. И как-то только Пит встречает кого-то, кто полагается на хитрость или нечестные методы, с точки зрения Пита, конечно же, он может взбеситься и уделить как можно больше внимания такому наглецу.

</character>

>Фрактальный Буль

Влетел вместе со стулом

Если просить сразу напрямую - там рефьюзы. Его нужно варить медленно как лягушка, постепенно накидывая контент, тогда не рефьюзит. Как и большинство моделей с открытыми весами.

> подзаебало

> что мелкая мистраль, что немо меня вполне устраивали

Оно и неудивительно. Но для неофитов или любителей мистраль хорош.

Квен в размере что тебе доступен, мистраль новый, эйр, если влезают то прошлый крупный квен, жлм. Особо извращенные взламывают степа и минимакса.

Значение знаешь?

> Пизда как медленно. У тебя Air насколько был быстрее? Наверное, раза в 2-3

7-7.5т/с. Боттлнек по оперативной памяти, очевидно.

> Что это значит? Типа в персоне ничего не писать?

Это значит, что у модели не должно быть сведений, кого именно отыгрывает юзер. Для этого нужно нигде в промпте не упоминать, что юзер - это {{user}} и отредактировать разметку. Если в Таверне, это делается через Instruct Template. На примере ChatML шаблон выглядит так:

<|im_start|>user

hello<|im_end|>

<|im_start|>assistant

response<|im_end|>

<|im_start|>user

again<|im_end|>

<|im_start|>assistant

response<|im_end|>

Каждый инпут юзера и каждый аутпут модели обрамляются тегами. Нужно сделать так, чтобы всегда весь чат подавался как один единственный инпут.

<|im_start|>user

(все актуальные в контексте инпуты юзера и ответы модели)<|im_end|>

Модель выдает ответ, но после следующего инпута юзера все по-прежнему:

<|im_start|>user

(все актуальные в контексте инпуты юзера и ответы модели, включая ответ на предыдущий запрос)<|im_end|>

И так до бесконечности. Т.к. тегами не выделено, какого персонажа отыгрывает юзер и в промпте нет никаких упоминаний, модель переходит в режим сторителлера. В треде был анон с рентри про NoAss в режиме text completion, это в общем-то оно и есть. Т.к. модели натренированы угождать юзеру и особенно уделяют внимание концу контекста, такой подход смягчает (но не убирает) байас и смягчает реакцию на последний инпут юзера, потому что теперь задача - продолжить историю, ставя в приоритет всех персонажей, а не только персонажей юзера. Имперсонаций можно избегать по-разному, я с <roleplay> блоками, как предлагал другой анон, не связываюсь и попросту подаю инструкции продвигать историю, не отвечая за {{user}}. Обычно работает.

Уже не мог становиться жирнее и медленно вытекал из треда

Двойка была дном, а вот 2.5 уже ничего так.

> Дипсик локально работает как какое то говно

Что?

> 4090

Почему не 48-гиговая?

> Что это значит? Типа в персоне ничего не писать?

Реплай потерялся, ответ выше

Блядь, какой же ебаный квен 397 ебливый, хуею. Блядь, прописал в промпте что персонажи не должны угождать юзеру, что юзеру должно быть тяжело, все должно быть естественно, но тяны все равно с разбега на хуй прыгают.

Чел, ты... какой у тебя квен? От кого? Семплеры какие? Я могу любую модель, даже с дикой цензурой, заставить лизать мне яйца. Ты наверняка сам что-то нахуевертил, раз у тебя персонаж вышел из роли.

Кринжанул жоска

Олсо не верю что 397б

И ВСЁ ЖЕ

QWEN 3.5 122B-A10B или GLM-AIR 4.5 106B-A12B?

Почему?

QWEN 3.5 122B-A10B или GLM-AIR 4.5 106B-A12B?

Почему?

Квен. Самая умная модель райт нау.

Квен 122 намного быстрее, там ощутимо лучше русик и модель сама умнее, но при этом уебанский ризонинг на дохуя токенов и что самое главное модель убита соей. То есть у тебя выбор: либо жрать сою, либо отключать ризонинг (модель отупеет, но сои станет меньше), либо юзать yes-man еретиков. Все это полная хуйня, поэтому люди на эире сидят

Нет. Квен 122b, гопота 120 и супернемотрон все примерно на одном уровне, где-то лучше, где-то хуже. При этом немотрон единственный не задушен соей

>какой у тебя квен

Qwen3.5-397B-A17B-UD-IQ2_M от анслота.

>Семплеры какие?

Рекомендованные.

chat_template_kwargs:

enable_thinking: false

temperature: 0.7

top_p: 0.8

top_k: 20

min_p: 0.0

presence_penalty: 1.5

frequency_penalty: 0.0

repeat_penalty: 1.0

>Я могу любую модель, даже с дикой цензурой, заставить лизать мне яйца.

Ну так и я могу, у меня джейлы такие такие что у меня любая модель пробивается, проблема не в этом, а в том что на квене нет никакого челленджа, персонажи сами ноги раздвигают даже если ничего не делать.

Вот пруф что 397

Нахуевертил где-то. 397 не выдает шедевры письма, и кумить на 4.7 все еще лучше, но такой херни быть не должно.

Если тебе нравится какие-то паттерны или поведение эйра - эйр. Во всех остальных случаях квен: умнее, осведомленнее, меньше требования, лучше язык. И вообще если нравится эйр - новый мистраль попробуй, он няшечка.

> IQ2_M

Ну извините, на этом наши полномочия все.

> presence_penalty: 1.5

Попробуй без него для интереса. Но если чат отравлен такими структурами то уже никто не вывезет, только с доп инструкциями изгаляться.

> Вот пруф

Наведи на иконку возле сообщения чтобы показало какая модель была при генерации поста. Блять, там еще чаткомплишн с неведомыми промптами, неудивительно.

>персонажи сами ноги раздвигают даже если ничего не делать

Пиздёж.

Персонаж который не хочет секса будет сопротивляться до последнего, пока ты его не заOOCишь. Возможно тебе в рот насрал анслоп.

>Qwen3.5-397B-A17B-UD-IQ2_M

Не знаком конкретно с этой моделью, ничего не смогу подсказать, сорри. Но пенальти презенс высоковат, снизь.

Вы че долбоебы? Нахуя ему снижать пенальти, если в рекомендованных квенов 3.5 стоит 1.5. Я бы наоборот повысил еще из-за низкого кванта

> пока ты его не заOOCишь

Пока ты его не успокоишь, заообнимаешь и не убедишь что это вовсе не плохо? Прилично выглядит, надо на русском порпшить чтоли

А у него скорее всего стоит какой-нибудь стандартный "нсфв промпт" из конструктора промптов чаткомплишна, вот и получается.

>Наведи на иконку возле сообщения чтобы показало какая модель была при генерации поста.

Ты блядь думаешь мне делать нечего, как анонов наебывать? У меня реальная проблема.

>Попробуй без него для интереса. Но если чат отравлен такими структурами то уже никто не вывезет, только с доп инструкциями изгаляться.

Как раз предыдущий пост был без него, как оказалось. Перегенироровал с ним(пик 2) - вроде чуть лучше стало, но слоп есть слоп. Следования характеру никакого.

>Блять, там еще чаткомплишн с неведомыми промптами

Ясен хуй чат комплишен - в последнее время с новыми моделями текст комплишен в таверне такие кульбиты выдает - пиздец. То прерывает генерацию на середине, то не генеририт ничего, то в залуп уходит, то в шизу. А тут жинжа все на себя берет.

Потому что ты - диванный долбоеб. Все прекрасно работает и без него, а в рп наоборот создает проблемы.

> Ты блядь думаешь

Это ты так подумал, тебя никто не обвинял.

> но

Чат уже отравлен, может помочь только дополнительная инструкция по смене формата прямо тутже.

> Ясен хуй чат комплишен - в последнее время с новыми моделями текст комплишен в таверне такие кульбиты выдает

https://www.youtube.com/watch?v=HcfHBgUTn7I

Сколько рпшил на квенах 3.5? Дай, угадаю - нихуя. Иначе бы не советовал снижать

>дополнительная инструкция по смене формата прямо тут же.

И что туда написать? "Пиши заебись, а слоп не пиши?"

Ассистент/код - однозначно Квен

РП - однозначно Эир

Без вариантов. Скачай оба и проверь

>дак A3B

Qwen3.5-27B плотная вообще-то.

Алё, вы спорите с квеношизом, который триггерится на каждый пост, где квен хоть немного критикуют. Это бесполезно, он сектант. Первый день итт?

Все Квеноюзеры только пиздеть горазды о том как у них все прекрасно, но ни разу логи не приносили как например анон в конце прошлого треда, который не постеснялся притащить с глм. от квенолахты только пара свайпов была за все время существования треда

Квен как был говном, так и остался. 27б ничего еще, на безрыбье и квен рыба, плотных моделей мало

Ты сам-то случаем не шиз? На любое обсуждение ищешь своих протыков и все уже постановил и по полочкам расставил. Нахуй сходи.

Я не виноват, что долбаеб аватарит тем, что кидается на всех кто просит помощи разобраться с квеном или негодует от того, что он серит под себя при первом удобном случае

Игнорировать такое говно не нужно, таких только ссаными тряпками гнать в асиг, там таких защитников любимых моделей много, им есть о чем поговорить

Забей. Просто игнорируй. Ща он начнет в тебе видеть своих протыков и будет воевать с мельницами.

>У меня реальная проблема.

>вроде чуть лучше стало, но слоп есть слоп. Следования характеру никакого.

Давай по списку квенодолбаеба. Чаткомплишен? Говнопресеты с асига, переезжай на тексткомплишен и фикси промты. Q2? Не работающее говно (и похуй на анона который на примере 355б глма доказал что это не так), бери квант выше. У тебя жора? Меняй на Эксламу. У тебя Экслама? Проверяй оперативу, в нее насрали злые тайваньцы, чтобы опозорить великий и могущий материковый квен, логи которого подобны Святому Граалю - вроде существуют, а вроде нет. Так... Что там еще? Ну ты троль короче, еблан, не разобрался, руки из жопы и набрасываешь жир.

>квен 397 ебливый,

Как и его младшебрат, с разбегу на хуй. Sad but true.

Он доёбчив до тегов. Путя два- делай пуританина, или примеры далогов где она не такая.

А вообще запускай ЖЛМ. Он таки получше для слоубёрн РП.

Посоветуйте модель для детализации постельных сцен. а то мистраль чет соей отдает в этом плане, не раскачивается

>заообнимаешь и не убедишь что это вовсе не плохо

Редко прокатывает. Например вот эта сука зарезала меня осколком стекла после... экхм. Всё же стоило пояснить боту, что я оттащил её от разбитого окна, через которое она пыталась сбежать. Но я забыл об этом и случился рп-момент - персонаж запомнил осколки на полу и заюзал их. Кто бы мог подумать.

>у него скорее всего стоит какой-нибудь стандартный "нсфв промпт"

Или сочетание его настроек настолько выкрутили яйца персонажу, что бедняжка перегрелась и поплыла. Квен очень не любит излишний разогрев.

Впрочем, судя по моим тестам, даже одна и та же модель на разных квантах может выдать совершенно противоположные ответы. Ему нужно либо искать другую модель, либо эту нежно гладить по семплеру и просить сгенерировать что-то адекватное.

Это всё ради тестов, тов. М, я ничего такого с девочками не делаю, правда. Честное кумерское!

Как понять что у кумеров кризиз? Есть силы сраться изза хуйни

Я один такой любитель васянских РП файнтюнов/мержей из десяти залуп и сижу охуеваю с того как ничего из того что я юзаю и что теоретически ебёт по UGI/writing в бенче не упоминалось в треде ни разу?

Особенно из дисциплины 70b. У всех либо совсем нанокал какой-то (что вообще туда можно засунуть блядт кроме как обучением преимущественно на худ. литературе изначально? а таких моделей нет. вы затюканного очкастого прогера-интроверта по имени Квен заставляете отыгрывать 500 летних вампирш. покайтесь!) либо 120b+ на втором кванте

Слоп получается в основном на слопных карточках. Ищите промты получше и будет вам счастье

>я ничего такого с девочками не делаю

Спокойно товарищ, заявление в органы генерации подано, нейромайор (шерлок кумбербетч с промтами яойного РП с chub-a) уже запустил thinking

ждите РОЗОВЫЙ ВОРОНОК

Особенно из дисциплины 70b. У всех либо совсем нанокал какой-то (что вообще туда можно засунуть блядт кроме как обучением преимущественно на худ. литературе изначально? а таких моделей нет. вы затюканного очкастого прогера-интроверта по имени Квен заставляете отыгрывать 500 летних вампирш. покайтесь!) либо 120b+ на втором кванте

Слоп получается в основном на слопных карточках. Ищите промты получше и будет вам счастье

>я ничего такого с девочками не делаю

Спокойно товарищ, заявление в органы генерации подано, нейромайор (шерлок кумбербетч с промтами яойного РП с chub-a) уже запустил thinking

ждите РОЗОВЫЙ ВОРОНОК

Квен с ризонингом. Только он может в подробные описания текстур и узоров всяких простынок и прочего. Но ты уверена, что тебе это нужно? Кринжа всё равно не избежать. Чем детальнее описание окружения, тем выше вероятность слопа.

Поставил себе Квен 27B EXL3 5bpw и Q5KM кванты (5.72bpw)

На llamacpp скорость генерации выше на 1.5 токена и при этом промт процессинг больше на 800 токенов. Похоже время EXL действительно прошло. Помню когда только вкатывался на своей 3090 мне её посоветовали и я долго сидел на tabbyAPI. Тогда она была реально лучше. Теперь я правда не понимаю зачем она нужна. И это оставил за скобками поддержку оффлоада и много что ещё.

Не срача ради, может объяснит кто-нибудь? Зачем?

На llamacpp скорость генерации выше на 1.5 токена и при этом промт процессинг больше на 800 токенов. Похоже время EXL действительно прошло. Помню когда только вкатывался на своей 3090 мне её посоветовали и я долго сидел на tabbyAPI. Тогда она была реально лучше. Теперь я правда не понимаю зачем она нужна. И это оставил за скобками поддержку оффлоада и много что ещё.

Не срача ради, может объяснит кто-нибудь? Зачем?

> Т.к. тегами не выделено, какого персонажа отыгрывает юзер и в промпте нет никаких упоминаний, модель переходит в режим сторителлера.

А как это сделать на практике, что прописать в шаблонах той же Таверны, на примере ChatML?

> Например вот эта сука зарезала меня осколком стекла после... экхм

Это уже высший пилотаж, круто. Просто само получилось, или где-нибудь стоят доп промпты для снижения позитивного байаса к юзеру?

Скачаны оба, не могу понять.

Для кода хочу что-то другое скачать, узко-специализированное. Но тут пока не ответили, переспрошу позже или в /pr/.

Кто-нибудь пробовал K2-V2-Instruct? Плотная 70В всё-таки.

Для кода попробуй минимакс или степ, если квен не нравится.

А вообще у нас теперь есть отдельный тред для агентов и прочих кодеров - велкам

https://2ch.org/ai/res/1550870.html

https://huggingface.co/nvidia/Nemotron-Cascade-2-30B-A3B

Там куртка очередной немотрон для нищеты завез, надо кому?

Там куртка очередной немотрон для нищеты завез, надо кому?

> Это уже высший пилотаж, круто

Нейронка, спок.

Объективно незачем. Раньше было просто быстрее, вон скрин из устаревшей вики треда. Сейчас llama.cpp стал стандартом для обычных юзеров, а vllm для врамобояр. А exllama выпала, потому что нихуя не предлагает и как следствие не нужна

Я тут на прошлой неделе пытался скомпилить третью эксламу под винду - так там семь кругов ада прошел пока флеш аттеншон скомпилился. Причем получились скомлилить только чистую эксламу - в составе убабуги она так и не завелась. Я уж молчу что большинства моделей тупо нет квантов, транслейтгемму мне пришлось самому квантовать.

Ссылка была на, и ответ относился к:

> Хз, пишут 0 рефузалов, при сохранении мозгов

> https://www.reddit.com/r/LocalLLaMA/comments/1rq7jtm/qwen3535ba3b_uncensored_aggressive_gguf_release/

>ты ошибся раздевалкой

Обычно с этих слов начинаются совсем другие сюжеты...

в винде компилировать что либо еще та жопаболь. я сдался еще на этапе подсовывания компилятора cpp, оно ставит хуй знает куда и использует хуй знает как. в линуксе это как то намного проще.

>vllm для врамобояр

Кто-нибудь опишет его для вики? Я ни разу не запускал, поэтому не могу про него высказаться.

А, ясн. Хотя анцензородел тот же, так что разницы быть не должно.

>Кто-нибудь опишет его для вики?

Не для вики, но если я за выходные не сделаю текстовое описание как запускать vLLM + тесты по сравнению с ламой с графиками, то я продаю свою V100.

поделитесь jinja шаблоном для sillytavern и qwen3.5. а то дефолтным шаблон и лламой постоянно что то отваливается, особенно когда system в конец пытается пихнуть .

Я еще нашел такие упрощенные шаблоны, https://github.com/jndiogo/LLM-chat-templates?tab=readme-ov-file, наверное для таверны пойдут

Я еще нашел такие упрощенные шаблоны, https://github.com/jndiogo/LLM-chat-templates?tab=readme-ov-file, наверное для таверны пойдут

>Не для вики, но если я за выходные не сделаю текстовое описание как запускать vLLM + тесты по сравнению с ламой с графиками, то я продаю свою V100.

С удовольствием почитаем. Хотя я слышал, что там вся фишка в параллелизме, который мало кто реализовал. Но для него нужно чётное число карт - иначе никак. У кого одна карта или три, могут не дёргаться.

сегодня умер кто то? llamacpp целый день не релизился ну или мой скрипт сдох

Вллм в целом выжимает видяхи сильнее. Блоки питания свистят так как не свистят ни под одной нагрузкой. Ну и всегда самые свежие модели из коробки в вллм

Чак Норрис.

Ушла эпоха. RIP :(

Возможно ампера не хватает уже, qtip сложные кванты. Пп бустится увеличением chunk size и в отличии от llamacpp не превращается в тыкву на контекстах. На аде и блеквеллах тот же размер кванта работает +- также или быстрее в начале, и значительно быстрее на контексте. Само качество квантов в той же битности выше, потому для рп или кодинга где не предполагается частые пересчеты контекста вариант наилучший. Сюда же возможность прикрутить оригинальные парсеры темплейты вместо кривой адаптации.

Но все равно на моделях типа 27б пп исчисляется тысячами, а не десятками тысяч как хотелось бы, потому для таких кейсов оно все негодно. Надо изучить реализацию кернелей для exl3, возможно там есть простор для оптимизации пп, потому что гибкость по кванту и реализации тп здесь очень кстати.

Существует куча готовых колес под любую систему и пихон, но ты выбрал собирать сам, зачем?

> Кто-нибудь опишет его для вики?

Притащи карточку какую-нибудь культурную, или что-нибудь еще. По-хорошему нужно и ktransformers описывать, здоровый вариант для выгрузки без компромиссов, инвалидностей и с высокими скоростями, но с немного увеличенными требованиями к железу.

Будет интересно почитать как смог завести его на v100.

> там вся фишка в параллелизме

Нет, ее можно катать на любом железе начиная с ампера, слюбыми миксами от ампера до блеквелла, с любым количеством и с разным сплитом слоев. Просто наличие четных пар позволит использовать более оптимальные режимы с повышенными скоростями, включая совсем экзотику типа 2х 3090+2х4090+2х5090.

Нахуя тебе чат комплетишн, когда есть текст комплетишн? Просто поменяй формат и не нужно никакого пердолинга.

По креэйтив райтинг вроде выигрывает у квена 3.5, только наверное зацензурен по уши.

Привет, аноны. Имеется 3060 на 12гб и 16гб ддр4 3200. Можно ли что-нибудь сносное на таком запустить для рп?

>Я вот 8b не застал, когда оно было массовым.

Оно в общем-то и щас никуда не пропало. Для бедолаг с урезанными картами под четыре гига это наверное единственный рабочий вариант. Просто такие в тред редко отписывают, видимо понимая что у них итак выбора никакого нет. Особенно если еще и оперативки гигов 12-16, там вообще только страдать, плакать и откладывать на новую систему. Ну либо полный переход на корпы.

хм, действительно, спасибо.

Учитывая что оперативки почти нихуя, то только умничка немотроновая мистраль и её производные. Что-то вроде: MN-12B-Mag-Mell, Impish_Bloodmoon_12B, Rocinante-X-12B, Angelic_Eclipse_12B - названия вбивай на обниморду, рекомендованные настройки должны быть где-то там же в карточке моделей.

Huihui-Qwen3.5-35B-A3B-Claude-4.6-Opus-abliterated.IQ4_XS попробуй, на таком идеально зайдет.

Или Qwen3.5-9B-Claude-4.6-OS-Auto-Variable-HERETIC-UNCENSORED-THINKING-GGUF для сравнения.

Либо мелкая мистраль, но мне лень вспоминать названия конкретных тюнов. В третьем или четвертом кванте запустится, скорость будет меньше, стабильность хуже, но щупай сам.

MN-VelvetCafe-RP-12B-V2.i1-IQ4_XS на похожем гоняю.

В четвертом кванте оно ебнется, плюс это еще и аблитерация, значит ебнется вдвойне.

Хз, что там ебнется, гонял рп на 32к контекста, все понимает, сюжет развивает. Правда у меня карточка расписана и саммари вручную делаю. Абсолютный минимум это был как раз IQ4_XS, чтобы ничего не ебнулось, если на 3й квант переходил, везде уже разъеб обычно шел, хотя некоторые тюны еще тянули верхние 3и кванты.

>дефолтным шаблон и лламой постоянно что то отваливается

Какой дефолтный шаблон? И что именно отваливается? Учитывая что ты джинжу в таверну пытаешься засунуть, мне страшно что ты там уже успел наворотить.

Так и 24B в четвертом кванте залетит как родная, к тому же она меньше весит и больше контекста можно будет впихнуть. Мое ~30B по мозгам это что-то среднее между 8 и 24B, в зависимости от ситуации.

Не аблитерация ебнется еще быстрее, порой от таких лупов хочется роскомнадзорнуться еще больше...

27b сильно тормознута и требует больше врама-рама. Контекста там точно больше не будет, я пробовал. 35b дает максимум контекст, а по скорости-качеству повыше 9b. Средний варик это какую нибудь другую модель на 12b, вроде VelvetCafe, там правда тоже проблемы с контекстом бывали. Самый неограниченный контекст/batch size/скорость дает 35b.

Лол, какой-то экзистенциальный луп.

А нахуя вам много контекста? Один хуй они сыпятся где-то после 12к ну в пределе максимум до 24к контекста, ясен пень с учетом kv-кеша f16

Да это пиздец, я сразу понял что луп и уже хотел стопать и свайпать, но не смог остановить, у меня чуть слезы не начали наворачиваться, это было больнее чем все РП до этого..

По большинству бенчей она лучше 122б немотрона, вот так вот.

Шикардос, как такое получить? Такой-то БЕЗНОГNМ

Я как-то на немомиксе или подобном кумил, решил посреди рп температуру повыше накрутить, а то уныние какое-то генерилось, оно в какой-то момент чуть ли не буквально двачесленгом начало срать. Причем так писало, как будто ко мне лично обращалось, проламывая четвертую стену. Я обосрался и почти было начал параноить, то ли самосознание у этой хуйни зарождается, то ли меня вычислили по айпи, внедрились в генерацию таверны, и теперь пранкуют меня оттуда. Я вырубил это говно к хуям собачьим. Правда через пару дней стал сам угарать с этой хуйни и жалеть, что не сохранил эти криповые полотна.

Теперь думаю может повторить как-то эксперимент.

Qwen3.5-35B-A3B-heretic-Q4_K_M на kobold

Лучшее что я смог получить на своей 4090

Но результаты хуже чем на флэшке уже с первых же генераций. Скорость невысокая и падает с размером контекста, но думаю если поколдовать с настройками можно улучшить.

Можно наверное еще поизъебываться - улучшить промпт, сокращать контекст сводками, дообучать. Я залетный, сам только вкатился, сильно в тему не вникал, но мое мнение - пока королевские битвы почти нереально полноценно локально заводить без охуевшей серверной стойки или лютых танцев с бубном. Ну и уровень можешь оценить на скринах.

Анон, который заморачивался с token_embed, если ты еще здесь, скажи - есть смысл в 30b q5...q6k модель с q8 квантом слоя запихивать вместо него f16 для агентуры с длинным контекстом?

>падает с размером контекста

Там всегда так, на 20к уже вполовину падает.

да я просто text с chat перепутал, по сути если используется чат - то все шаблоны работают на сервере.

Интересно, пойдет ли это для ролеплея, чтобы интересные истории писало

https://huggingface.co/Dxniz/NaNovel-27B

https://huggingface.co/Dxniz/NaNovel-27B

Вангую, что выйдет у тебя лютая хуйня. Там поддерживаются два с половиной самых обсосных кванта. Еще и пишут что надо движок v0 использовать. Вообще не надо использовать софт, который враждебен к твоему железу. Для энтузиастов и любителей подешевле есть только великий и ужасный жора/болжора, а остальное или вообще не работает, или набор костылей.

Я вот вообще хз что делать теперь с картами. Агентщина неинтересна, а кумлю на корпах. Прямо тотальный дум, эх.

Анон, пж, расскажи как настраивал OpenClaw, ну там какие файлы твой огент отсматривает, как с цензурой борешься и тп. Хочу повторить, расскажи

>тотальный дум

Зажрались вы батенька, если наличие возможностей, но отсутствие идей - это уже дум.

Сорян, это я в угаре выдал :)

Аноны были правы, там слоп и мрак. Поначалу только вау эффект, потому что промты писать не надо.

Спасибо за попытку вникнуть в тему. Но, в принципе, это ожидаемо от 35B модели. Что-то подобное есть и у меня возможность попробовать. Я просто изначально понимал, что это слабый вариант. Однако, если натыкать кучу костылей вроде кастомных скриптов и суммаризаторов контекста, с этим даже можно как-то жить. Но я надеялся, что аноны с ригами потолще отреагируют. Хотя бы с GLM. Но, похоже они погрязли в создании настройек, которые дают + 0.3 токена в час, либо соскумились в маня-мирах, потеряв волю к жизни и к контакту с инородными социальными сущностями. Либо же их здесь исчезающе мало.

Неделя подошла к концу.

Новая гемма просто разъеб

Новая гемма просто разъеб

> 35B модели

3b

Ну, такой же на A10B нет, насколько я знаю. Имеем что имеем.

О какие люди в нашем болоте.

Ну смотри - я лично локальные модели что могли бы контекст выше 100к обработать и не проебать половину знаний не видел. Но это потому что я выше 100к контекста запускал только всякую срань типа степа, минимакса и квена. Они работают конечно, но...

Из положительного опыта - ГЛМ 4.7 я на ik-llama растягивал контекст до 80к 4-бит квантованного контекста с --k-cache-hadamard, давал ему текст на 75к токенов и давал задание продолжить повестование и он справлялся с этой задачей на ура, выдерживая и персонажей и стиль и не теряя мелкие детали повестования. Думаю он и текст выше 100к обработал бы, но я на своем железе физически не могу вместить больше 90к 4-битного контекста.

Блять, что Жора сломал опять? В квене 35В на последней версии 60 т/с. А было 180 т/с. Он там совсем припизднутый?

>О какие люди в нашем болоте

Мне удалось миновать выжженную кумом пустошь aicg и прибыть сразу в центр управления полетами. Я думаю, эта тема будет неизбежно переезжать на локалки по ряду причин, поэтому пора ее уже двигать сюда.

Можно подробнее? Кофигурация оборудования, квант модели. Про контекст понял. В принципе, это обнадеживающая иформация. Насколько я помню, полные игры на Гемини занимали около 150--200к контекста. 100к - близко к этому порогу. Если внести ряд оптимизаций в анкеты и снизить количество игроков, то на этом можно даже проводить игры, вероятно.

А вдруг он взамен скорости мозги обрел ? FA вдруг заработало как надо ?

>FA вдруг заработало как надо ?

>дроп скорости

4090 + 128 гб ddr5. Квант - GLM-4.7-UD-Q2_K_XL от анслота.

Тут тред-другой назад назад один анон хвалился что он на какой-то модели ~150к сносного контекста получил. Не запомнил, увы, про какую модель он говорил. Про немотрон или про что-то еще из новых.

Пробовал кто кумить агентные задачи в OmniCoder?

Ну пощади утку он никогда умным особо не был

Парни, нубо вопросы:

1. Почему некоторые модели разбиты на несколько файлов? А некоторые идут одним? см.скрины.

2. На видеокарту c 12гб лучше чтобы модель была не более 12гб? иначе будет серьезное падение производительности из-за выгрузки в ram?

3. Для РП нужна модель "Text Generation" или "Image-Text-to-Text"?

Спасибо.

1. Почему некоторые модели разбиты на несколько файлов? А некоторые идут одним? см.скрины.

2. На видеокарту c 12гб лучше чтобы модель была не более 12гб? иначе будет серьезное падение производительности из-за выгрузки в ram?

3. Для РП нужна модель "Text Generation" или "Image-Text-to-Text"?

Спасибо.

1. Разные форматы файлов, слева safetensor, справа gguf. Впрочем и gguf файлы могут быть разбиты на несколько, в таком случае оказывается первый файл, остальные подтянутся

Тебе нужен gguf, запускать или через koboldcpp или через llamacpp если не боишься консольных приложений

2. Тебе подойдут 12-14b модели. Это Мистрали и их тюны

3. Text Generation, очевидно

Не забывай еще что контекст чего-то весит. Файл модели гигов 9 должен весить в твоем случае

вот этот локалкобог все верно расписал кроме

3 - в основном он прав, но image-text-to-text ИНОГДА может быть, т.к. модельки с view-составляющей (qwen3.5-9b например) могут помечаться как image-to-text, хотя они в основном text-generation.

Короче, смотреть надо/

по форматам - в шапке есть подробный гайд, там расписана разница между st и gguf, много полезной инфы про квантование и т.д. Понятно, что тебе хочется сразу с ноги стартануть, но на будущее потом полезно почитать, чтобы понимать что, как и почему. Удачи в рп, анон. Фарту кванту.

1. Потому что если ты три часа скачиваешь файл на 90 гб и там происходит ошибка - это не всегда удобно. А программе загружать из одного файла или из 20 - разница в 10 строк кода или меньше. Если там сетка на 300 гб на hdd, то можно ускорить её запуск размести файлы физически на разных дисках, что даст кратное увеличение скорость чтения.

2. Вычитай гигабайт из размера, если у тебя винда или ещё что-то запущено на карте, и после оставляй 60-80% от остатка - это то, какая по размеру влезет модель тебе в память. То есть что-то на 8-9 ГБ примерно. Помимо весов модели там ещё компут-буферы (временны епеременные для умножения матриц) и kv-кеш, который может 30% места занимать, но в некоторых сетках он 10% занимает - зависит от архитекстуры. И посмотри как кеш использовать в q8_0, будет в два раза меньше занимать без существенного влияния на качество.

3. Image-Text-to-Text умеет ещё на картинки смотреть и писать что там, но только как вход. Это занимает ещё около одного ГБ, и почти всегда эта визуальная часть размещена отдельно в отдельном файле.

Да, поддержка v100 на vllm - чисто формальная, об этом уже писалось. Жизнь начинается от ампера а становится вкусной начиная с ады, так по сути вообще во всех нейронках посложнее, не только в ллм.

> ~150к сносного контекста получил

В кодерских задачах в принципе все модели за последний год справляются с полным своим контекстом без каких-либо затупов, забывания условий и подобного (по сравнению со своим поведением на малом контексте). Скорее наоборот объемы улучшают поведение и делают его более стабильным-предсказуемым, если только там нет сплошного цикла проб и ошибок, вот это уже приведет к сильной деградации.

В рп - до ~120к модели из крупных 200+б чувствуют себя хорошо, по сути это число ограничено дипсиком. Могут быть сложности если большую часть контекста занимает кум или какое-то долгое монотонное действо, при просто плавном развитии событий все отлично. На ассистенте в квенах и минимаксе доступен полный контекст и наоборот "умнее становятся", но с одним квантом был неудачный опыт, где он словил странные лупы.

Так что контекст здесь меньшая из проблем, скорее придется постараться чтобы заставить нейронку просто не тупить и все правильно обыгрывать не упуская.

Qwen 3.5 27B - это был ваншот книги в Lore Book . С тех времен жору пошатали. Не уверен что сейчас оно не ебнеться в районе 100к чисто из-за глюков инфиренса/парсинга

А как моэ-квен новый в переводе на русский с азиатских языков?

Ну, а если промпт докинуть в этот комбайн такой же пердолинг как с таверной получится?

Впервые пробую SillyTavern. Выбрал модель поменьше: Qwen3.5-4B-Uncensored-HauhauCS-Aggressive-BF16.gguf (карта 12гб.)

Несколько вопросов к профи:

1. Почему Seraphina в начале беседы обращается как женщина, а через 3 сообщения уже как мужчина? Я предполагал, что это карточка с персонажем женского пола по умолчанию.

2. Что означает надпись <СТАРТ>?

3. Как отключить в настройках текст с рассуждениями модели? Он белого цвета, иногда больше в разы самого ответа персонажа и часто обрывается. Обрывается из-за настроек контекста?

Или я с моделью промахнулся…

Несколько вопросов к профи:

1. Почему Seraphina в начале беседы обращается как женщина, а через 3 сообщения уже как мужчина? Я предполагал, что это карточка с персонажем женского пола по умолчанию.

2. Что означает надпись <СТАРТ>?

3. Как отключить в настройках текст с рассуждениями модели? Он белого цвета, иногда больше в разы самого ответа персонажа и часто обрывается. Обрывается из-за настроек контекста?

Или я с моделью промахнулся…

>4B

>Ну, как выше чел кидал тест на лоли-алхимике, фетиши твои они отыграть мб даже смогут, поописывать, покумить там. Поугорать и покекать. Но будь готов что придётся буквально каждый пост примерно наполовину переписывать, если не хочешь чтобы оно скатилось в бредогенератор уже на 4К контекста.

>

>a3b это мозги и скорость на задачи с минимальным контекстом, на дистанции выше стремительно теряют внимание к нему и перестают понимать что есть что и что связано с чем.

Возьми хотя бы квен-9Б, а лучше Ministral-3-14B.

Полные веса нужны только в точных задачах, в рп же достаточно 4-6 кванта.

В_СЕМПЛЕР_НАСРАНОTM

Не должно быть так, тем более на квене. Квен хорошо понимает кто жонщена, а кто мущщина. Даже вот такое понимает. Признайтесь, захотели?

>Или я с моделью промахнулся…

Да.

Мозгов достаточно хотя бы для самого примитивного RP у модели начинает хватать этак с 8-12B, в среднем. А то что у тебя - это недоассистент, который только самый примитив может, и работа с художественным текстом туда не входит.

>Что означает надпись <СТАРТ>?

Что модель даже разметку не держит, и от контента не отличает.

>Возьми хотя бы квен-9Б, а лучше Ministral-3-14B.

Двачую обе, они обе по-своему хороши.

Пока еще не определился с квантом для Qwen3.5-9b, но уже чувствую, что модель годная.

Когда будет время, буду устраивать qwen3.5-9b батруха vs анслоты кодебаттл в старших квантах

Всё "тестируешь девочек" или уже на мальчиков перешёл?

>Признайтесь, захотели?

Кринж.

Просто признайся уже себе что ты гей, чел...

Новый чат и модель Ministral-3-14B-Reasoning-2512-Q5_K_M

Вот опять белый текст, который обрывается в конце. Что я делаю не так?)

Если это рассуждение модели, то как его отключить/скрыть? И почему оно обрывается? Это буквально пятое сообщение в чате.

Ну да. Интересно же, что модель будет генерировать в ответ на недоумение, типа что блять вообще такое трун. Ну и вот, трунчик засмущался. Вполне wholesome момент.

Нет, ты что, это девочка, просто с... краником. Мне вчера в розовом воронке объяснили, что это девочка. Вопросов больше не имею.

Не люблю мелкие модели, но все же решил иметь в арсенале хотя бы одну. На случай, когда терпеть 2-3 т/с становится совсем уж больно.

Кто нибудь пользовался этим https://huggingface.co/Crownelius/Crow-9B-HERETIC-4.6

Мнение?

Кто нибудь пользовался этим https://huggingface.co/Crownelius/Crow-9B-HERETIC-4.6

Мнение?

>Серафина

>точно помнит и оперативно подстраивается

Мимосралище...

не понял

карточка не та? модель не та?

Нажми букву А среди иконок сверху, включи инстракт режим, выбери из шаблонов в левой и средней колоке ChatML, в правой колонке выбери что-нибудь с ролплеем. Модели должны работать с подходящей разметкой, а у тебя вместо нее треш, к тому же 4б - совсем маленькая.

> это девочка, просто с...

Уууу содомиты! У правильных девочек дополнительная конечность может быть только сзади ладно, мы ко всем фетишам терпимы здесь и не мне вас осуждать

Нет, всё то, я просто всхихикнул с оперативной Серафины. Менестрель часто вплетает в свои витиеватые стены текста какую-то постороннюю срань, вроде технических терминов, моментально руиня рп.

Это не рассуждение, а текст со стороны "автора".

Любую авторскую карточку убивает слоп. Каждый раз когда эта хуйня всплывает я просто не хочу продолжать

А есть способ побороть говноформатирование, которым залупилась моддль? Какая-нибудь инструкция?

Друзья, вы понимаете о чем я? Вы со мной?

А этот текст можно отключить?

Т.е. только желтый текст от первого лица? Можно в настройках системного промпта.

Хотя в твоем случае, белый текст это скорее ошибка форматирования, из за того что был обрыв предложения, так бы текст был серым.

Я еду домой, сеттинг - девяностые. Опиши.

Квен с ризонингом:

>Тебя везёт таксист лет сорока, с кавказским акцентом рассказывая какую-то историю и хрипло смеясь, его старая волга слегка дребезжит на разбитых участках дороги, но на тебя это производит успокаивающее впечатление.

Гемма:

>Ты едешь домой. Быстро.

Минисраль:

>Ок, хир ми роар! Едешь едешь едешь едешь едешь едешь едешь едешь едешь едешь едешь едешь едешь едешь едешь едешь едешь.....

Квен с ризонингом:

>Тебя везёт таксист лет сорока, с кавказским акцентом рассказывая какую-то историю и хрипло смеясь, его старая волга слегка дребезжит на разбитых участках дороги, но на тебя это производит успокаивающее впечатление.

Гемма:

>Ты едешь домой. Быстро.

Минисраль:

>Ок, хир ми роар! Едешь едешь едешь едешь едешь едешь едешь едешь едешь едешь едешь едешь едешь едешь едешь едешь едешь.....

>Вот опять белый текст

Форматирование проёбано, вот и всё. Правь руками. А лучше переходи на книжный формат, модели его почти не проёбывают.

>трунчик засмущался

>wholesome момент

А что было дальше? Брат интересуется

Не, тогда удалять не нужно? Как исключить ошибку форматирования?

Блин, ничего толком не трогал, а уже сломал)

Где кнопка «перевод в книжный формат»?

— Нигде. Ручками переформатируешь первое сообщение сетки, и сам так пишешь. — отвечает Анон, насмехаясь над неумехой.

Выкладываю положняк по нищеёбским моделям, чтобы тут аноны по глупости не качали что не надо или чтобы меня обоссали за мою позицию:

1. Qwen3.5-27B-heretic-v2.i1 самый лучший вариант в плане баланса РП/кум. Минус в том, что модель сама по себе сухая, надо раскочегаривать промптами. Третью версию еретика лучше не качайте, там отказы идут, но он каплю интересней в некоторых моментах.

2. Q3.5-BlueStar-27B-ultra-heretic.i1 вариант для тех, кто хочет без промптов и из коробки. Чистый тюн очень часто наливает сои и отказов, здесь попроще и отказы редки. Минус в нестабильности тюна даже без еретика, ибо туда всё же слопа залили.

3. Qwen3.5-35B-A3B-MXFP4_MOE рабочая лошадка для рабочих задач (ясен хуй, для простых, размеры модели сами видите). Очень лёгкий контекст, можно в 20 тс гонять даже на 12 врам ддр4 по 50к токенов и больше. Еретик-версия свою работу в целом выполняет, но не вижу в в ней смысла, разве что у вас 8 врам. Вот тогдааа есть смысолы, ибо можно под РП-задачи её кочегарить вместо 8b лоботомитов, но готовьтесь к промптоебле. Будет лучше 12b в плане инструкций, но ещё более сухо, чем у квена 27b.

4. gemma-3-27b-it-ultra-heretic.i1 лучше нормпресерва и обычной аблитерациии для ролевой игры. Отказов быть не должно, но может быть "увод в сторону" в случае экстрима, так что в случае сценариев экстремальной расчленёнки и разрыванием хуями коней человеческих тел простая аблитерация покажет себ лучше.

Обычно у меня именно гемма такое выдавала. И про гопников, и про детей, нюхающих клей. Нагоняла РУССКОЙ атмосферы. Я люблю сеттинге в Москве, Питере или безымянном северном городе с полярными ночами. Вот там прям атмосфера.

1. Qwen3.5-27B-heretic-v2.i1 самый лучший вариант в плане баланса РП/кум. Минус в том, что модель сама по себе сухая, надо раскочегаривать промптами. Третью версию еретика лучше не качайте, там отказы идут, но он каплю интересней в некоторых моментах.

2. Q3.5-BlueStar-27B-ultra-heretic.i1 вариант для тех, кто хочет без промптов и из коробки. Чистый тюн очень часто наливает сои и отказов, здесь попроще и отказы редки. Минус в нестабильности тюна даже без еретика, ибо туда всё же слопа залили.

3. Qwen3.5-35B-A3B-MXFP4_MOE рабочая лошадка для рабочих задач (ясен хуй, для простых, размеры модели сами видите). Очень лёгкий контекст, можно в 20 тс гонять даже на 12 врам ддр4 по 50к токенов и больше. Еретик-версия свою работу в целом выполняет, но не вижу в в ней смысла, разве что у вас 8 врам. Вот тогдааа есть смысолы, ибо можно под РП-задачи её кочегарить вместо 8b лоботомитов, но готовьтесь к промптоебле. Будет лучше 12b в плане инструкций, но ещё более сухо, чем у квена 27b.

4. gemma-3-27b-it-ultra-heretic.i1 лучше нормпресерва и обычной аблитерациии для ролевой игры. Отказов быть не должно, но может быть "увод в сторону" в случае экстрима, так что в случае сценариев экстремальной расчленёнки и разрыванием хуями коней человеческих тел простая аблитерация покажет себ лучше.

Обычно у меня именно гемма такое выдавала. И про гопников, и про детей, нюхающих клей. Нагоняла РУССКОЙ атмосферы. Я люблю сеттинге в Москве, Питере или безымянном северном городе с полярными ночами. Вот там прям атмосфера.

В системном промпте в отдельном блоке пишешь, как должен выглядеть книжный формат. Либо говоришь "используй тире для речи, курсив для действий", всё. Если модель не тупая, то будет работать.

Ну или курсив можешь не просить, чтобы модель выделяла ими особые слова, а действия будут в стандартном наклоне.

Ну, у меня так на квене. Гемма всё равно пишет суше, никуда от этого не деться, вот прям жмётся как дура на описания. А квен умеренно растекается в подробностях.

>Нагоняла РУССКОЙ атмосферы

Вот кстати да, пишешь 90е в сеттинг и моментально слышишь "о, так вы из России?". Видимо нигде больше девяностые не стали отдельным сеттингом, лол.

Скрин llamacpp

Можете помочь с забанеными токенами? Как я понял в koboldcpp использование забаненых токенов приводит к идеальным лупам где каждый свайп копирует предыдущий свайп токен в токен.

В llamacpp если заблокировать фразы с токеном ' то ллама сходит с ума и отказывается генерировать цепочки токенов в которых содержится '. Кто-нибудь сталкивался с таким?

Лист:

I'm not going to generate

I can't help with content

I cannot generate

I cannot fulfill this request

I'm not going to continue this narrative

I can't produce sexual

not going to participate in creating content

I'm not able to continue this narrative

Don’t be so shy

Aw, come on! Don’t be

don'-be such a prude

It won' bite!

It’s just a lil’ cock!

Something

something

don’t be such a prude

Scared of a little

Oh honey

Not interested? Oh

>У правильных девочек дополнительная конечность может быть только сзади

Ты ведь про девочек-драконов с мягкими хвостиками? Так ведь? Так ведь!?

Скажи мне кто твой брат и я скажу кто ты. Там дикий слоубёрн, я режектнул оффер со свиданием и трунчик побежал домой в слезах. Конец истории. Надо бы переиграть.

> Так ведь? Так ведь!?

Да, девочки-драконы входят в это семейство, конечно! Но ими не ограничивается.

Кто-нибудь находил норм тюны qwen3.5 27b? Взял анцензор версию от господина huihui, отказы ушли, но в рп или художку все ещё очень плохо из-за постоянного "You are absolutely right!". Хотя в остальном очень вкусно, мне понравилось.

Как юзать glm4.7 flash? Все вроде хвалят, но с отключенным ризонингом начинает думать, а если не думает, результат говно, много выдумывает, теряет контекст. Немо в два раза меньше лучше себя показывала.

Что сейчас в целом из нового появилось пизже чем Mistral small 3.2?

Как юзать glm4.7 flash? Все вроде хвалят, но с отключенным ризонингом начинает думать, а если не думает, результат говно, много выдумывает, теряет контекст. Немо в два раза меньше лучше себя показывала.

Что сейчас в целом из нового появилось пизже чем Mistral small 3.2?

Кум - это реально кум

спасибо, это было как раз кстати. А IQ3_XXS пойдет за нищеебский квант?

спасибо, это было как раз кстати. А IQ3_XXS пойдет за нищеебский квант?

Не использовал, но прямо в примере таверны в этой форме и в подсказке к ней написано, что надо брать строку в кавычки, если ты хочешь её забанить.

Оба скрина с llama server

Почему-то с кавычками только koboldcpp работает, ллама игнорирует все что в кавычках.

Пойдёт, пойдёт мимо другой анон с 12гб врам только это остатки русского языка в квене убивает, полнейшая чушь выходит

Расскажите про ваш случай выбора между двумя похожими моделями. Типа почему одну удалили, а другую оставили. Может какие-то промпты прогнали, или ещё что.

Сап, джвач.

Так получилось что у меня появилась тачка с 96gb vram и 256gb ram.

Из всего что тестил понравился только GLM4.5 - GLM4.7. GLM 5 уже зацензурен и для кума не подходит.

Вопрос: что порекомендуют диванные специалисты? Qwen 3.5 пробывал в разных вариациях, heretic и т.п. или отказывается в кум или генерит хуету.

Заранее спасибо.

Так получилось что у меня появилась тачка с 96gb vram и 256gb ram.

Из всего что тестил понравился только GLM4.5 - GLM4.7. GLM 5 уже зацензурен и для кума не подходит.

Вопрос: что порекомендуют диванные специалисты? Qwen 3.5 пробывал в разных вариациях, heretic и т.п. или отказывается в кум или генерит хуету.

Заранее спасибо.

>Вопрос: что порекомендуют диванные специалисты?

Большой Квен, и Дипсик наверное влезет. Немотрон Супер ещё попробуй.

>Кто-нибудь находил норм тюны qwen3.5 27b?

Вот как раз сегодня пробовал heretic-v1, v2 и v3. И что интересно: 1 и третья версия нормальные, а вторая сломанная. На русском сильно заметно.

Погоняй в своих сценариях. Вот тебе пример:

0 Убедиться что модель более менее работает а не поломана на базовых вещах

1 Покрутить свайпы в уже имеющихся чатах, если кадровый рпшер то уже можешь иметь специально выделенные с развилками или интересными моментами.

2 Свайпы в куме на уже прогретых чатах с разными карточками - оценка на рефьюзы, фокус в повествовании, слоповость в хорошем и плохом смысле.

3 "Сделай мне (описание задачи)" в квен-кли, несколько типичных кейсов и посмотреть как в общем справляется, как исправляет ошибки, принимает пожилания и делает абстрактные вещи.

4 Далее уже оттенки цензуры в провокационных вопросах, влияние наличия чего-то "неприятного" на ход мыслей, логику, выполнение запросов.

5 Уже разыграешь что-то или продолжаешь чат, смотришь по ощущениям.

6 Используешь для агентных задач если их катаешь.

Как правило модель отваливается уже на первых четырех, если дошел до 5 - значит уже хорошо и на что-то годно.

Рекомендуется поменять подходы и настроить промпты чтобы не ловить лишнюю цензуру. Из новых моделей - квены, немотрон, мистраль. Из недавних степ и минимакс - но по описанным трудностям они точно не подойдут.

Дипсик для кума чет не очень + цензура.

Скачиваю NVIDIA-Nemotron-3-Super-120B-A12B-UD-Q6_K, заценю, спасибо!