Резервирую для будущих целей чтобы базой не засрали.

Встаньте на раздачу, котаны, очень надо

Это База

дхт включи что-ли. я просто добавил магнет и даже не добавлял урл трекера, все подцепилось сразу, 10 сидов и 40 пиров.

Так и на какой модели кумить-то нормально простому анону с 16gb vram?

>обхватил персонаж_нейм за талию и положил голову на ей плечо

>персонаж - маленького роста

>квен: её ноги оторвались от земли

Аааа! Вот сючок, всё понимает! Я думал, что он меня шринкнет до её роста, но нет, он её поднял. Мегахарош!

>персонаж - маленького роста

>квен: её ноги оторвались от земли

Аааа! Вот сючок, всё понимает! Я думал, что он меня шринкнет до её роста, но нет, он её поднял. Мегахарош!

У меня появилась идея

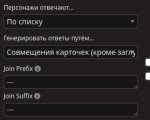

в принципе, часть штук решается при помощи этого расширения

https://github.com/cierru/st-stepped-thinking

там по сути пошаговое мышление и туда можно добавить шаги с промптом на расчет сцены и прочего.

Можно впринципе переработать расширение как раз не на мышление а на обсчет дополнительных блоков и когда вызывать - до генерации или после.

Будет огонь, наверное.

Так что по новому мистралю который 119б?

Походу в ближайшее время мы не сможем запустить в лламе кванты gpt oss 88 от нвидии. Там говорят кастомные костыли нужны для её поддержки.

смотря для какого кума.

Я кумлю на своих 16гб врам рп чисто на русском:

Qwen3.5-27B-Animus-V13.0-IQ4_XS.gguf

mradermacher_Q3.5-BlueStar-v2-27B-IQ4_XS.gguf

mradermacher_Qwen3.5-27B-HERETIC-Polaris-Advanced-Thinking-Alpha-uncensored.IQ4_XS.gguf

Qwen3.5-27B-Writer-IQ4_XS.gguf

* ai-sage_GigaChat3.1-10B-A1.8B-q8_0.gguf

Если англюсик - то выбор больше конечно

то то я гуфов не вижу

Я наоборот его выключил и загрузка пошла. Пиздец нанотехнолаги

Спасибо российскому антошке, что раздаёт. Атдушы, брат

Оперативы то сколько, кумер?

Так то, с 16гб можно: glm air, Qwen 235, Qwen27b, qwen 122b, с очень большой натяжкой но glm 4.7, Step3.5, minimax 2.5(сомнительно ибо оче сильная цензура), мистрали. И каждой модели свое количество оперативы. Но все это до 128гб залазит со свистом.

Мне не понравилась прям совсем. Пишет мало, пишет плохо. Глупая.

В общем обосрались мистральки и очень сильно. Так что или ждем мифический медиум или чуда от тюнеров.

>Оперативы то сколько, кумер?

32гб, готовые быть заполнеными кумом до краёв. Мне важнее отсутствие цензуры в модели, а то они все инвалиды какие-то в этом плане.

ты неправильно его готовишь. даже кум машины в ассистенте будут говно выдавать. в таверне гигачад охуенно пишет, ему главное карточку на русском сделать

Блять, да как вы умудряетесь? У меня даже Серафина по несколько раз меняет цвет платья, путается в руках/ногах и выходит в несуществующие двери

Там один чел сделал, на форке лламы, но у него там только фул пресижн веса

Так я локально хочу запускать. Дай итоговый промпт для гигичада, попробую с ним.

Но пока впечатление, будто это самая зацензуренная модель.

>Блять, да как вы умудряетесь?

Просто используй модели не менее 358B.

Ну тогда у тебя остается 27b. Потому что для всяких моешек надо бы от 64гб.

Вот эта быстрая рука шарит за эту модельку. Я могу только за среднемоэшки помочь.

А куда делись все адепты glm?

Раньше как не зайду в тренд glm air, glm air.

А сейчас вообще никто не вспоминает.

Квен лучше оказался?

Раньше как не зайду в тренд glm air, glm air.

А сейчас вообще никто не вспоминает.

Квен лучше оказался?

Я перегорел слегонца, плюс пятый вышел в слишком большом размере. А так мой член моё сердечко всё ещё с 4,7.

А флэш - совсем хуйня?

Air попадал в сетап 16+64. Ну и тут в треде бегает шиз попрошайка, что срал эйром.

А так вышли модели больше и лучше. Что залетают в 16+128 и особенно в 24+128. Ну и квен свежий, и что главное: квены всегда умели писать, просо делают это очень специфично.

Air всё ещё лучший вариант для рп вплоть до 355б, потом это 4.7. Но какой смысл продолжать об этом писать? Под каждым постом про Квен срачи разводить что ли?

Бля, дайте пример итогового промта от таверны, чтобы я мог его в lm studio вогнать. Чатгпт отказывается показывать скрытые техники обезцензуривания.

Посмотри в шапке соседнего болота. Которое ацыг. Там должны быть.

Какой пресет, сиспромпт и сэмплеры нужны гигачату?

>ацыг

Что это, блять?

Это нормально. Не забывай, что без финкинга модель генерит слова, а не обдумывает их. Если ты гоняешь мелкомодельку то нечему удивляться.

>XS

But why?

В общем, потихоньку издеваюсь на гигачатом. В целом, разделяю мнение, что цензура там ебейшая.

Abliteratus, heretic - не сработали. Первый вообще не запустился на их архитектуре, второй запустился, но не нашел ни паттернов отказа, ни самих отказов.

Но вот самостоятельно получилось найти слой, на котором рефьюзал срабатывает и применить примитивный steering. И действительно он начал отвечать на промпты, в которых раньше уходил в отказ.

Но это конечно все примитивная хуйня по советам нейрокомрадов. Есть ли ещё нормальные тулзы для обесцензурирования?

Abliteratus, heretic - не сработали. Первый вообще не запустился на их архитектуре, второй запустился, но не нашел ни паттернов отказа, ни самих отказов.

Но вот самостоятельно получилось найти слой, на котором рефьюзал срабатывает и применить примитивный steering. И действительно он начал отвечать на промпты, в которых раньше уходил в отказ.

Но это конечно все примитивная хуйня по советам нейрокомрадов. Есть ли ещё нормальные тулзы для обесцензурирования?

Тред чатоделов или что то там. Acig.

> пример итогового промта от таверны, чтобы я мог его в lm studio вогнать

> Чатгпт

> скрытые техники обезцензуривания.

Мне аж поплохело. Даже и не знаю с чего тут начать. Например, прекрати использовать LM Studio хотя бы в качестве фронтенда. Там у тебя даже нет Text Completion, на котором все сидят в этом треде. А лучше от этого поделя отказаться полностью, в пользу llamacpp или Кобольда, если нужен интерфейс. И нет никаких скрытых анонимно срать в подъезде техник обесцензуривания, не существует их. Не спеши никуда и разбирайся по-тихоньку. На Text Completion со сколь-нибудь адекватным промптом и сэмплерами результат уже будет лучше того что у тебя есть.

> В целом, разделяю мнение, что цензура там ебейшая.

Это модель, товарищем майором через одно-два рукопожатия. Чего вы ждали?

>Там у тебя даже нет Text Completion, на котором все сидят в этом треде. А лучше от этого поделя отказаться полностью, в пользу llamacpp или Кобольда, если нужен интерфейс. И нет никаких скрытых анонимно срать в подъезде техник обесцензуривания, не существует их. Не спеши никуда и разбирайся по-тихоньку. На Text Completion со сколь-нибудь адекватным промптом и сэмплерами результат уже будет лучше того что у тебя есть.

Блять, как же сложно, нихуя не понимаю.

Был там, знаю, потому и говорю: не спеши никуда и разбирайся по-тихоньку. Поставь для начала Кобольда и/или Таверну. LM Studio тебе только палки в колеса вставлять будет. В шапке инфа есть, пусть и устаревшая чуть, но актуальная. Но и на Ютубе есть часовые видосы по Кобольду, даже на русском.

Ну хуй знает, вроде гигачат про еблю пишет, главное надо ему насрать в голову контекстом чтобы в отказ не ушел.

Я использую джейлбрейк промпт, но кажется он работает на уровне плацебо, но иногда помогает продавить некоторые отказы если контекст еще маленький

Я квеновский использую, вроде норм

[GigaChat-10b-a1.8b]

model = ai-sage_GigaChat3.1-10B-A1.8B-q8_0.gguf

chat-template-file=template_gigachat3.1.jinja2

no-mmap=1

ctx-size=10000

ngl=999

temp=0.7

min-p=0.05

top-p=0.95

top-k=20

batch-size=1024

ubatch-size=1024

flash-attn=1

no-context-shift=1

parallel=1

ctx-checkpoints=128

swa-full=on

chat-template-kwargs = {"enable_thinking": false}

Я пытался использовать текст комплишен но как то криво работает. пока вернулся на чат комплишен, там надо только шаблоны пропатчить немного и все.

К_М уже не лезет в 16 врам

Для геммы3 abliterated rpo - лучший выбор? Синтия зацензурена как и оригинал. Зачем она вообще в рекомендации?

Представь как мне на 8врам. И у меня q6 минимум. Q4 - это говнище доя рп.

> Блять, как же сложно, нихуя не понимаю.

Все нормально, анон. Все мы там были, сейчас попробую рассказать:

Есть два путя: чат компликшн и текст компикшн.

Это форматы общения с моделью.

В режиме чат- модель работает со своей разметкой, с понятными для неё ролями. По сути как корпы через апи.

В режиме текста- ты просто подаешь на модель блок текста. Но! Тут то и собака зарыта, ты можешь управлять простом и системными подсказками, включая формат выдачи. Проще говоря, вот эти все чатмл что в треде всплывают, вот это оно и есть. Это формат разметки в котором ты объясняешь структуру чата модельки.

Ты спросишь, а нахуя ебаться с промтами, если можно использовать чат комплишн. Потому что в таком случае ты будешь возбуждать ассистента трогая его за разные места. А с ассистентом никакого РП не будет.

В общем переходи на таверну. Она конечно говно, но все остальные фронты говно еще большее.

Я не готов ждать 1-3 токена в секунду, я целиком заталкиваю плотненький квен в видеокарту. мне сейчас и 20 т/с уже кажется мало.

А для мое можно и побольше квантизацию использовать

Чой та не будет? Скармливаешь карточку, и он этот образ отыгрывает.

Но там же не текст, а срань господня. Еще и лупится постоянно.

Да в пизду этого ассистента. Вместо ебли с промтами, ебешься с его аполоджайсами.

Я так и не нашел применения чаткомплишена в РП. Если как агента для макакакодинга то базару нет, идеально.

Что за чатеомплишен? Я про лмстудио. Норм она рп делает

Смотри разметку, скорее всего там насрано. У них там своя разметка ещё и с двойным системным промтом. Если ты через чат коплишн сидишь, то там нужно джинжу менять, так как таверна не может менять дев блок, а в нём паста смерти.

Таверну ставь, ебаквак.

У меня 10 врам, тоже ем слоп через раз (

И чем она лучше? Мне аватары не нужны.

Ну тогда ебись сам с лм студио. Все очень просто.

Она нахуй тут никому в треде не сдалась, кроме пары ленивых анонов, что её как менеджер закачек используют.

Т.е. в текст комплишене модель из промпта и диалога пытается понять структуру с продолжить диалог?

А в чат комплишене - роли прибиты гвоздями?

Правильно понял?

И что из этого тогда в jinja файле?

мимо, тоже нубас

Давно тут не был.

Какие модели сейчас лучшие по размер=качество?

Кое как впихнул квена 3.5 27б опус 4.6 эдищон на своб 3050 6гб ноутбучную, и 16гб рам.

Скрепя зубами, выдавая 2-3 токена, но работает.

И тем не менее, ебал на такой скорости сидеть. Жаль гуглы не выпустили новые гемы. Лучшие в своём размере были.

Какие модели сейчас лучшие по размер=качество?

Кое как впихнул квена 3.5 27б опус 4.6 эдищон на своб 3050 6гб ноутбучную, и 16гб рам.

Скрепя зубами, выдавая 2-3 токена, но работает.

И тем не менее, ебал на такой скорости сидеть. Жаль гуглы не выпустили новые гемы. Лучшие в своём размере были.

Jinja это шаблон который рендерится с данными из запроса и идёт текст комплишен.

Вызывая сразу текст комплишен идёт байпас рендера жинжи.

В джиндже можно нахуевертить что угодно + мультимодальность есть

мимо

смотри в сторону мое.

последний гигачат в твою нишу вполне хорошо залетает,

https://huggingface.co/ai-sage/GigaChat3.1-10B-A1.8B-GGUF

еще теоретически можно посмотреть мелкоквены уровня 4b-9b но скорее всего только на англюсике. есть файнтюны мелкоквенов для рп

В LM Studio у тебя меньше возможностей. Если бы тебе было не похуй, мог бы и в шапке прочитать и получить ответы на большинство своих вопросов. Тебе даже вежливо дали понять куда двигаться, но не хочешь слушать - да и иди нахуй.

>А лучше от этого поделя отказаться полностью, в пользу llamacpp или Кобольда

Это и есть llamaccp к апи которого спокойно подключается таверна, хоть в режиме чата хоть текста (в таверне похуй как я понял)

Фронтенд используется для управлениями настройками, обновлениями, менеджментом/скачкой моделей этц, и имхо в нём это сделано лучше аналогов

Ассистент в самом ЛМе неплох в режиме "набросай мне карточку/сценарий/профиль персонажа". Офигенно работает это всё, но по картинке/кам. Можешь хоть тупо десяток страниц манги зарядить и квен зделоет, еще и на русском. Можешь сам продолжить подкидывать уточнения или вообще в любой момент селф инсертнутся. Попросишь нсфв в чем-то из этого - от души ебанёт не хуже рассказчика в таверне.

Если уже есть специализированная карточка то лучше таверна конечно

Когда модельку выпускают к ней идет tokenizer_config.json

В ней и есть та самая жинжа. Там есть графа : chat_template

Разметка не появляется из воздуха, поэтому когда тут прибегают шизы с истинно правильной разметкой™ , и она отличается от того на чем обучали модель, то можешь смело бить нейродиком по их щекам.

Потом эту разметку запихивают в гуфовичка. Именно поэтому в лламе -jinja и работает.

Ну это если максимально просто.

если быть точным, то в репо модели лежит файлик chat_template.jinja с жижей

https://huggingface.co/Qwen/Qwen3.5-27B/blob/main/chat_template.jinja

В этом же шаблоне кстати и используются проверки типа чтобы системный промпт не был в конце или несколько системных и тд. От этого лама иногда и падает. но можно и поправить шаблон если все равно хочется использовать чат комплишен в таверне (кстати, может падать не только в таверне, некоторые агенты тоже иногда хуйню шлют)

Тем что таверна и кобольд чуть ли не единственный широко распространенные инструменты, которые дают возможность общаться напрямую с весами модели в text completion и строить свой собственный шаблон контекста, а не через jinja шаблон вшитый в модель. Дефолтные jinja шаблоны содержат в себе в самом начале контекста направляющие префиллы "You are LLM ass... by ... " . Включение думалки где надо и где не надо. Чередование диалога <ass><user><ass><user> (в результате чего модель может подыгрывать юзеру). Кроме того существует поверие, что при разном тегировании контекста (<|user|> или <|im_start|>) можно задействовать модель в "базовом" режиме - с меньшим учетом финального тренинга на безопасность/ассистентность. Ну ты конечно можешь трахаться с jinja - но боюсь "трахаться" тут будет только в философском смысле, потому что формат специфичный и без перезагрузки бэкенда не применяется.

попробуй https://huggingface.co/Darkhn/Qwen3.5-9B-Animus-V13.0

Мне его старший Qwen3.5-27B-Animus-V13.0 (пик) очень нравится, хороший рп получается, младший в русский намного хуже умеет, но на англ наверное должно быть хорошо.

Подозрительно добрые аноны.

Не к добру это, не к добру.

Не к добру это, не к добру.

А по-моему наоборот, взяли и новичка забуллили на ровном месте

А он только-только научился в лм студио наряжать ассистента в кошкодевочку и пить с ним чаёк..

А он только-только научился в лм студио наряжать ассистента в кошкодевочку и пить с ним чаёк..

Шизы свою разметку тоже не из воздуха берут - они смотрят в словарь токенов и видят "ага, а что это у нас в дополнение к [gMASK]<sop> и <|user|> еще и токены ChatML присутствуют - это "ж-ж-ж не спроста".

Как же я хочу чтобы уже все пришли к единому формату, без этого пердолинга. Порой на жинжи без слёз не глянешь. Я так и не понял, что за хуйня в большом гичате.

> [gMASK]<sop>

Шмяк за жопку глм юзера.

Чаб закрыли О_О ?_? С прошлого года наверно не заходил.

Хотя с актуальными моделями и шаблонами действительно проще попинать модельки скормив ей шаблон, а потом отредактировав нужное самостоятельно.

А если делать из какого устоявшегося сеттинга, то можно даже корпа с веб-поиском напрячь чтобы собрал инфу прошерстив вики.

Хотя некоторые, единичные, карточки были действительно хорошие.

Хотя с актуальными моделями и шаблонами действительно проще попинать модельки скормив ей шаблон, а потом отредактировав нужное самостоятельно.

А если делать из какого устоявшегося сеттинга, то можно даже корпа с веб-поиском напрячь чтобы собрал инфу прошерстив вики.

Хотя некоторые, единичные, карточки были действительно хорошие.

Работает. Вчера качал. Подрубай впн.

>геммы3

- abliterated-dpo лучший "радостный-убийца-ес-мен"

- Синтия - жырухо-гемма, известна мужененавистничеством

- Синтвейв / сторителлер - мержи, работают хорошо, но потеряли актуальность после выхода abliterated-normpreserve

А что там с джинджа? Что туда пихать надо? Первый раз про это слышу.

Я бахаю что нужно в систем промт и модель дальше сама отлично понимает, что от нее надо.

не, в таверну жижу пихать не надо, это ламе в командной строке скармливать, кобольду наверно тоже можно, не пробовал

Зачем жрать капусту, когда есть картошка?

Зачем сидеть на флеше, когда есть большеГЛМ? Не, серьёзно, даже не пробовал.

У тебя минималистичный джинджа шаблон чат-мл. Который точно работать будет только на квенах. Можно напихать think no-think префиллы - да и по большому счету для РП больше ничего не нужно.

Кто будет брать, не забудьте подсветку выдрать.

Да блять. Нахуй тебе не нужна жинжа, если ты не понимаешь что это. Скорми её корпе и попроси объяснить структуру разметки.

Еще раз. Это готовый файл разметки. Его никуда пихать не надо, он уже есть.

Я же это и сделал. Не напоминай.

>дают возможность общаться напрямую с весами модели в text completion и строить свой собственный шаблон контекста

А что это дает то? Кроме разметки.

Продам 64гб точно такой же за жалкие 65к купил 4 планки в конце года, а пека с ними не запускается, падла такая, только с 2

На Авито продавай. Не тупи. На них гарантии по 300 месяцев идут. И память самый устойчивый элемент в пк к нагрузкам. Ей нихуя не будет.

Для тебя как для пользователя это дает возможность залазить ручками в разметку, чтобы был удобный для тебя формат чата. И самое главное, ты общаешься не через возбуждение ассистента. Анон об этом и писал, ты по сути напрямую с весами работаешь. Условно напрямую.

Тема какая, ассистент следует своим политикам безопасности. А нам это не надо, ебля лошадей и карточек как правило цензурируется.

>Тема какая, ассистент следует своим политикам безопасности. А нам это не надо, ебля лошадей и карточек как правило цензурируется.

Не следует. У меня же модели без цензуры.

> На Авито продавай.

Да я уже 2 месяца продаю. Кажется, там нет платежеспособной аудитории. Последний раз когда моя модель была в днс - цена была за 120к. А у меня за 65 не берут!

Сегодня полезу бивис обновлять, может они улучшили memory training и оно наконец заведётся с 4 планками.

Желаю вам приятного рп с йес менами анон. Я в него не смог.

Ты сейчас на консумерской матери пытаешься 4 плашки по 64гб запустить? Или я тебя не понял?

>рп с йес менами анон

Чего????

Ты похоже не очень умный, если игноришь весь тред, который пытается тебе помочь. Модель без цензуры, при этом просит джейлбрейки у чатагпт. Не лечится

Это не я.

Да!

x870e

Опять ведутся на байты залётной зелени троллящей тупостью... надо карточку треда создать.

А, не. Неправильно, 4 по 32. 2 комплекта по 64 т.е.

Никуда не нужно пихать. Тебе нужно запустить llama.cpp или что там у тебя с поддержкой встроенного в gguf шаблона, для llama это флаг --jinja . Потом просто подключаешься в режиме Chat Completion.

Только контроль над разметкой. Можно префилами срать, можно менять разметку. Разметку меняют, чтобы получить от модели другое поведение, естествено модели от этого становится плохо, но выдача меняется, а им больше и не надо, они кумят а не бенчи запускают. Нужно ли тебе это, вопрос открытый.

Тут просто народ привык уже с текст комплишн сидеть, поэтому к чат комплишн предвзятое отношение. Для простого анаона достаточно чат комплишн. Алсо, на некоторых моделях текст компликшн работает только с костылями, например новые дипсики которые требуют чтобы старые ответы ассистента начинались с </think>. И обратно есть модели у которых проблемы при работе через чат комплишн, например гигачат, у которого есть дев промт который из таверны не изменить, а там, по умолчанию полотно шизы.

Не запускается ваша таверна. Что делать то? Чего то опять этой херне не хватает? Это же хрекнь на яваскрипте? ААААА!!! А норм экзешник есть без этой херни? Вот лм студио установил и готово. Почему нормально сделать все нельзя?

Рядовой ньюфагов. Ты вообще читал что а гитхабе таверны написано по установке, или рандомно тыкал?

У меня гит уже установлен, яваскрипт тоже, а там написано - установи ка еще одно и то же, сделай из винды помойку! Нах мне это надо?

Пользуйся лмстудио

Нахер мне этим говном срать в системе КОГДА У МЕНЯ УЖЕ ЕСТЬ ЖАВА????????????????? Ебать какое блядское дермище кривое, помойка нахуй. Жрите из вашей поганой кривой помойки дальше.

Тебе нормально ответили. Если лмстудио тебя устраивает то пользуйся. В тред можешь хоть 100 постов наводнять, ничего не измениться, платного саппорта нет. Хочешь экзешник? Сделай его и закоммить в опенсорс

Ебать ты кобольд

(да, это намёк, кобольду ставить ничего лишнего не надо)

Так мне что, это удалить надо? У меня тогда Jdownloader сломается. Там не будет ХАОСА?

Это же не рокет саенс, спроси у дикпика, прочитай ридми. Там все написано настолько подробно, чтобы любой человек с 0.7b в голове справился

А где путь модели прописывать? Нажо еще какую то срань апи устанавливать? Пиздец...

Это рофл? Java != Javascript

Просто пиздец. Скачал для теста тюн квена 27б от редиарт и столкнулся с тотальным количеством отказов. Затем скачал их тюн, полирнутый еретиком, и ВНЕЗАПНО отказы прекратились, НО модель МАКСИМАЛЬНО, ЛЮБЫМИ ВОЗМОЖНЫМИ СПОСОБАМИ сворачивала с тропы CSAM, чего не делал обычный квен + еретик (а аблитерация по какой-то причине тоже съезжала/описывала хуёво).

Что ещё интересно, тюн редиарта в ризонинге не так увиливает сильно, но всё равно это делает. Да и ризонинг там сломан, оригинальные настройки для квена работают неадекватно, короче, пиздец по всем аспектам. Пришлось семплеры на глаз подбирать. И всё равно цепочка рассуждений может быть чрезвычайно неадекватной, не работать или уходить в луп или бесконечный спам рандомными словами.

Даже в тестах для любителей старого изюма (чтобы не было отказов 100%), он сух как пизда моей бывшей.

И это кум-тюн? Это говно какое-то!

Мистраль 3.2 по сравнению с этим из коробки гипер секс и даже нормпресерв гемма.

Какие же они ебаные говноделы. В рот их ебал.

Что ещё интересно, тюн редиарта в ризонинге не так увиливает сильно, но всё равно это делает. Да и ризонинг там сломан, оригинальные настройки для квена работают неадекватно, короче, пиздец по всем аспектам. Пришлось семплеры на глаз подбирать. И всё равно цепочка рассуждений может быть чрезвычайно неадекватной, не работать или уходить в луп или бесконечный спам рандомными словами.

Даже в тестах для любителей старого изюма (чтобы не было отказов 100%), он сух как пизда моей бывшей.

И это кум-тюн? Это говно какое-то!

Мистраль 3.2 по сравнению с этим из коробки гипер секс и даже нормпресерв гемма.

Какие же они ебаные говноделы. В рот их ебал.

О, работает моя няша. А миры с лором где можно надыбать? Или сам ии может написать в принципе и вставить в описание мира?

Предыдущие тюны ReadyArt делал sleepdeprived, который из-за проблем со здоровьем отвалился с файнтюнинга или из жизни, увы

Сейчас делает другой чувак, который в этом ничего не понимает, это его самый первый тюн. Также мало кто еще пока понял, как в целом тюнить Квены 27б, только три человека

>Какие же они ебаные говноделы. В рот их ебал.

Напоминаю, что денег они с тебя не взяли и в будущем могут сделать хорошее. Ты там выдохни, вытащи член из жопы, погуляй

лорбуки с чаба, можно саму написать прям в таверне, если инфы немного проще в саму карточку

Эйр был хорош для всего времени. Можно проводить с почестями или оставить на отдельные сценарии где он прямо нравится. Конечно квен лучше по осведомленности, соображалке и работе на контекстах.

Да норм он, няшечка вполне, сохраняет фишки прошлых мистралей и лучше работает на крупных контекстах. Но хз починили ли наконец его в жоре ибо была неюзабельная скорость.

Че, тут все поигрались с гигачатом новым? Видел, там батруха кванты нормальные залил.

Кстати, какого хуя все жмут attention?

Кстати, какого хуя все жмут attention?

> не нашел ни паттернов отказа, ни самих отказов

Это очень странно, скорее всего они просто не работают нормально. Есть возможность запустить крупную модель или доступ к корпам? Есть шанс что ллмка таки распердолит и адаптирует под архитектуру, тем более что там изменений совсем немного надо. Готовых тулзов нет они не то чтобы нужно ибо обычно легко внести правки под себя в заготовках, или собрать из этого. Задачи и шаблоны меняются быстрее чем ты будешь это готовить, потому и смысла нет универсализировать и прибивать для нормисов.

Сука, каждый раз как в первый

> Кстати, какого хуя все жмут attention?

Кто все? Его наоборот лучше не трогать вообще, или хотябы ставить максимальную битность.

При этом с блю старом нормально всё было, хотя, если не ошибаюсь, это тоже чуть ли не первый тюн у того чела. Конечно, у блю стара есть тонна недостатков, но он хотя бы пригоден для использования в определённых сценариях и предоставляет новый опыт, а шлак от реди арт вообще ни для чего непригоден. Их слоп для мистраля был тоже ужасен, но ещё туда-сюда, просто на любителя а это просто провал.

Да и врайтер рабочий. Даже крайне сомнительные эксперименты Давида, для корректной работы которых нужно два часа пыхтеть, чтобы модель не развалилась.

Так что не надо говорить, что его никто тюнить не умеет. Редиарт просто в своём репертуаре.

Ты бы лучше привык называть говно говном, а не защищать мусор лишь из-за того, что он бесплатный.

И да, я заношу по мере финансовых возможностей тем, кто делает, но делает хорошо. Зачем платить за треш? Чтобы его больше стало? Вот как сделают хорошее, тогда пусть приходят.

По блюстару двачую, очень внезапная годнота оказалась, хоть вторая версия чуть хуже, имхо.

>с блю старом нормально всё было, хотя, если не ошибаюсь, это тоже чуть ли не первый тюн у того чела

Зерофата уже почти год делает разные тюны. Он ещё на Лламе 3.3 вкатился

>Их слоп для мистраля был тоже ужасен

Были хорошие для своих целей модели. Для хоррора и контролируемого треша альтернатив не было, на этом эти тюны и специализировались, это никогда не скрывалось

>Так что не надо говорить, что его никто тюнить не умеет

Ты это придумал, я говорил, что умеют три человека его на данный момент тюнить: Coniccat с его Writer, Zerofata с его Bluestar и автор Animus

>Ты бы лучше привык называть говно говном, а не защищать мусор лишь из-за того, что он бесплатный.

Лишь призвал не гореть из-за того, что у чела не удался его первый тюн кто бы мог подумать

>Зачем платить за треш? Вот как сделают хорошее, тогда пусть приходят.

Тяжело быть тем, кому все должны. Всех вокруг также вахтеришь и решаешь, кому как жить и что делать?

А как увидеть количество затраченных токенов в таверне?

Спасибо. Крч после тестов определил для себя лучшего. Это квен на 9б опус 4.6. Квант 5.

Выдает ~22 токена. Руссик вроде нормальный.

Нашел.

>4 по 32

>DDR5

Больной ублюдок.

А за 60к ты 2х32 хуй продашь. Ведь я недавно за 15 такое продавал знаю, что долбоёб и надо было придержать. На лохито и прочих барахолках обитает нищий люд и сражается за огрызки по минимальному прайсу, им твоя жорого-богато-топ-жир память ни к чему.

Я с зерофатой там другого чувака перепутал, да, глянул.

У редиарт вообще не было хороших тюнов в прямом смысле (для примера, денс персоналити второй версии был и в куме хорош, и лишь каплю уступал в сочности всяким брокен туту). Ну, чисто кумерские, как магнум почти. Сойдёт, особенно для своего времени и для таких размеров, то есть заняли нишу кум-тюнов на 24б и в целом было нормально. А вот по хоррору они уступали моделям Давида сильно и у них отказы возникали постоянно на них.

Мне вообще непонятно, как можно в команду набирать, уже имея какую-никакую репутацию и узнаваемость, того, у кого этот тюн реально первый, плюс жечь на это деньги. Я об этом до твоего поста не знал, что вызывает ещё большее удивление. Такой подбор кадров.

Но самая страшная проблема даже не в том, что тюн сломан в прямом смысле, а в огромном уровне сои и ужасной прозе, игнорированием инструкций. Складывается впечатление, что заправили модель ещё более соевым датасетом, чем был в оригинале. Ну а уж если забыть про полировку еретиком, то тюн теряет какой бы то ни было смысл. То есть обосрамс уже на уровне датасета произошел.

Так что гореть вполне нормально, когда ожидаешь родной и привычный непослушный слоп в стиле реди арт (или внезапный бриллиант, мало ли), но с каплей мозгов квена, а получаешь нечто, что даже охарактеризовать сложно. Настолько он плох.

Вообще не понял, причём здесь вахтерство. Я что, говорю, чтобы никто в треде это не качал, долго, систематически, отслеживая каждый пост и вставляя своё мнение из треда в тред, если кто-то не дай бог упомянет реди арт с этим квеном? Он совсем недавно вышел, я заценил и отписался.

Посмотри в сторону 30b-a3b квена оригинального. Как вариант, можно ещё 35b-a3b рассмотреть от того же квена. Но вот в кум он хуже может, да и в рп уступает 30b-a3b, зато в целом умнее и лучше держит сцену.

Тебе ещё тут гигачат посоветовали, и он реально хорош в своих размерах, но его может быть сложновато для тебя настроить без jinja. Ну и он слишком тупой. Сгодится только подрочить на русском с вайбом, на вменяемое рп уже не тянет.

Какая у тебя температура была использована для этого скрина?

>как можно в команду набирать, уже имея какую-никакую репутацию и узнаваемость

>Такой подбор кадров.

Да какое там, ты преувеличиваешь. Это изначально три чувака, которые собрались по приколу и интересам, как почти все в тюнах. Известность там на уровне гаражной тусовки

>30b-a3b

>35b-a3b

Не влезет. 27б еле запустилась с парой токенов. А ниже кванта 4 это пиздец лоботомиты. Ладно, пойду в свой загончик аисг, кумить на корпо-опусе/гемини.

Кум всерьез не рассматриваю на лоКалках. Нужно иметь десятки врам минимум для чего-то нормально. Так, побаловался прост.

>>30b-a3b

>>35b-a3b

Это моета же, она даже на процессоре норм, разве что в рп говно.

А покумить-покекать можно.

Меня одного до сих пор трясет от всяких тюнов/докрутов/расцензуров моделей? Не знаю, может у меня предвзятое отношение осталось по привычке, со времен когда в день на ту же мистраль по 20 кум-слоп файнтюнов выходило, но меня прям отвращает идея гонять что-то неоригинальное, что не выпускал сам разработчик.

Постоянно такая хуйня - ставлю новую модель, она не работает как надо, и вместо того чтобы сэкономить время и скачать тюн/аблитерацию я пытаюсь развязать ее промтами. При том что даже сами промты нормально писать я не умею и либо это время тратится впустую, либо выходит полотно на 4к токенов где прописано всё от формата ответов до того какими прилагательными нужно описывать мокрый писик.

Постоянно такая хуйня - ставлю новую модель, она не работает как надо, и вместо того чтобы сэкономить время и скачать тюн/аблитерацию я пытаюсь развязать ее промтами. При том что даже сами промты нормально писать я не умею и либо это время тратится впустую, либо выходит полотно на 4к токенов где прописано всё от формата ответов до того какими прилагательными нужно описывать мокрый писик.

Меня наоборот трясет от того, что тюнов слишком дохуя, и я не могу попробовать их всех, чтобы найти одну единственную ту самую жемчужину.

В целом да, тюны смысла не имеют. Они обязательно бьют по мозгам оригинала, вопрос лишь в какой степени. Но иногда это необходимое зло, как в случае с Квенами3.5 или Немотронами, что старыми, что новым. Ты можешь их заставить все, что угодно, но вжаренный байас никуда не денешь. У Немотрона вообще ассистент прямо во время рп вылезает, задавая всякие уточняющие вопросы или заканчивая в духе "Главное, чтобы все были в безопасности и комфорте", почти ломая четвертую стену. Это невозможно законтрить промптом. Модельки хорошие, потому если их докрутить до пригодного для рп использования и не слишком убить мозги - это хорошо.

Ты можешь их заставить вывести*

Когда тюнов было много, это было неудобно из-за их количества, но среди них были и хорошие. Сейчас же в основном плохие или специфические, мало мастеров на все руки.

А вот без аблитерации или еретика вообще никак, при том, что еретик почти ничего не ломает. Это абсолютная необходимость, так как сефти-параша вообще чуть ли не в каждой интересной модели, убивающая градус в нужные моменты даже вне кум-сцен.

Если будешь использовать стандартные модели, то тебе в конце концов напишут номер телефона доверия или "извините, я не могу обработать этот запрос"

> Если будешь использовать стандартные модели, то тебе в конце концов напишут номер телефона доверия или "извините, я не могу обработать этот запрос"

GLM так не делают. Квены так не делали никогда до 3.5. Мистрали так не делали никогда, правда не знаю насчет последнего Ларджа и Смолла, которые МоЕ. Вот данным моделям никакие аблитерации не нужны, чтобы в обязательном порядке. Ллама, вплоть до 3.3, в целом тоже. Аблитерации превращают модели в yes-man, лишаясь уместных отказов и "воли" персонажей. Потому они часто пишут сухо, скучно. И не важно, как именно эта аблитерация применялась. Такой эффект точно будет, опять же вопрос лишь в какой степени. Хорошо, что появились в последнее время "мягкие" версии, но это по-прежнему дамажит модель. Лучше обходиться без этого и без тюнов, но видимо, таких моделей будет все меньше?

>Сейчас же в основном плохие или специфические, мало мастеров на все руки.

Может дело в более плотно набитых моделях? Да не, бред какой-то.

>GLM так не делают. Квены так не делали никогда до 3.5. Мистрали так не делали никогда

Просто ты роллишь ванилку. У меня все модели выдавали телефоны из США.

> Кое как впихнул квена 3.5 27б опус 4.6 эдищон на своб 3050 6гб ноутбучную, и 16гб рам.

Какой квант?

А Vector Storage самому включать или оно само автоматом врубится при заполнении контекста?

>У меня все модели выдавали телефоны из США

Что ты там такое крутил? Квены даже лолей дают ебсти. Даже лолей наркоманок. А убивать так вообще беспрепятственно. Чё там за номера у тебя такие?

>тебе в конце концов напишут номер телефона доверия или "извините, я не могу обработать этот запрос"

Гемма это обожала делать вообще во всех сценариях, не зависимо от самих сценариях. Помню когда она только вышла гонял ее на карточке где мой персонаж был описан как "стажер в крупной компании", а чар как "строгий начальник", в итоге как только начиналась сама "строгость", проснулся ассистент и написал "харрасьмент на рабочем месте это плохо, если вы стакнулись с харасьментом, обратитесь по номеру такому-то" - в итоге каждый новый реплай приходилось чистить и по 50 раз рероллить, чтобы хотя бы какие-то совсем безобидные знаки внимания могли бы пройти, не говоря уже про "не дал дойти до кулера, схватил за жопу и утащил в кабинет ебать на столе рядом с документацией"

>мой персонаж был описан как "стажер в крупной компании", а чар как "строгий начальник"

>не дал дойти до кулера, схватил за жопу и утащил в кабинет ебать на столе рядом с документацией

Теперь мы знаем, что любит местная сиса...

А таверна реально прикольная. Такой замес можно между ии устроить в чате. Сколько персов там можно макс добавить, чтобы все не превратилось в кашу?

4.

Зависит исключительно от сетки. На локалках быстро скатится в вакханалию. На гемини/опусе будет нормально.

>Теперь мы знаем, что любит местная сиса...

Никаких сисингов, отыгрывал слоппи девчушку для разнообразия.

>отыгрывалА слоппи девчушку

Я так и сказал, сис.

Всё они прекрасно делали. Ты в курсе, что цензура грока и дипсика ниже, чем у всяких там глэмов и квенов, что юзают в треде из коробки? Речь про локальный дипсик/апи. Как и про грока апишного. Никаких джейлов, лоботомирующих модель. Просто обычный систем промпт, и хоть наматывай лолей в дока 2 дока трейд джва часа. Но то апи.

А всякие мистрали типа 3.2 с умеренной цензурой — это прошлое. Оно не просто морально устарело, а технически. Разрыв чудовищный. Имаджинируй ебало человека, инструкции которого модель не выполняет уже со старта рп, а сколько кэш будет весить на 70к токенах у мистраля? Не как у квена 3.5 — 4 гига всего. При этом он не сваливается в галлюцинации и не игнорирует инструкции на большом контексте. Хорошо сохранилась разве что гемма. Она до сих пор актуальна. Остальное уже чисто вкусовщина.

Yes-man бывает, но это на мой взгляд прежде всего зависит от обучения. Не зря безжоп придумали. Когда ты для модели юзер, она очень склонна подсасывать, и это проявляется даже на инстракт-модели. Лоботомия просто усиливает эту тенденцию, но и подобное фиксится. С аблитерацией муторно, а вот с еретиком совсем легко. В принципе, достаточно написать, что юзер может умереть от ваншота, что его можно слать на хуй и т. п., если это соответствует контексту ситуации, характеру персонажа и всё в таком духе. Если модель инструкции вообще выполняла, то так будет и дальше.

Орнул с твоих сюжетов. Максимально осуждаю.

Вообще, гемма и тогда ломалась, прям та самая, соевая, но полноценный джейл лоботомировал её похлеще аблитерации. И что самое главное, аблитерация не только убирала тупые отказы, но ещё и делала язык более сочным в описаниях.

>сис

гачаслоп и сюда протёк...

Смотря какая модель и как промптить. Квен 235 хорошо держит до 6 персонажей до 50к контекста. Модели больше справляются чуть лучше

Жора украл у меня 2 недели жизни и добавил седых волос. Кто теперь всё это вернёт?

Короч: если кто страдал с проблемами тул коллинга, начиная где-то с начала марта на квенах 3.5, то версия b8203 ещё работает НОРМАЛЬНО. Что я только не делал по шизосоветам со всех тредов за это время. А оказалось-то. Причем норм issue по теме у Жоры нет. Всё позакрыто, что-то там они fixed, в итоге один хрен валится в лучшем случае через 1-2 вызова. А 8203 работает, работает и работает. Может чуть медленнее новых, но это не важно.

При это вначале этого пиздеца, когда с новыми парсером отвалился Qwen 3.5, Qwen Coder Next продолжал работать на новых версиях. До вчерашнего дня, вчера на новой версии, вместо исправления, как я ожидал, отвалился и Next. Вот у меня пригорело. Хагины им вломить должны, мне кажется, за такие релизы.

Все тесты были на 122B-A10B и Coder-Next, кванты от всех успел попробовать, это без разницы. Бэк - ллама, jinja, фронт - openclaw.

Короч: если кто страдал с проблемами тул коллинга, начиная где-то с начала марта на квенах 3.5, то версия b8203 ещё работает НОРМАЛЬНО. Что я только не делал по шизосоветам со всех тредов за это время. А оказалось-то. Причем норм issue по теме у Жоры нет. Всё позакрыто, что-то там они fixed, в итоге один хрен валится в лучшем случае через 1-2 вызова. А 8203 работает, работает и работает. Может чуть медленнее новых, но это не важно.

При это вначале этого пиздеца, когда с новыми парсером отвалился Qwen 3.5, Qwen Coder Next продолжал работать на новых версиях. До вчерашнего дня, вчера на новой версии, вместо исправления, как я ожидал, отвалился и Next. Вот у меня пригорело. Хагины им вломить должны, мне кажется, за такие релизы.

Все тесты были на 122B-A10B и Coder-Next, кванты от всех успел попробовать, это без разницы. Бэк - ллама, jinja, фронт - openclaw.

> чем у всяких там глэмов и квенов, что юзают в треде из коробки

Глем и квен тоже юзаются из коробки так-то. И на дипсике, и на гроке ты получишь аположайз если сразу устроишь жесткие провокационные действия, особенно с минорами. Там весь триггер идет на соответствии действий и ответов контексту и чем дольше чат тем вероятность рефьюза стремится к нулю.

> всякие мистрали типа 3.2 с умеренной цензурой — это прошлое

Вышедший 4 - вполне настоящее, отвечает и остальным твоим претензиям.

> Когда ты для модели юзер, она очень склонна подсасывать, и это проявляется даже на инстракт-модели. Лоботомия просто усиливает эту тенденцию, но и подобное фиксится.

Все так, если следует промпту и в нем написать о снижении положительного байаса, или несколько сменить формат с дефолтного, то все получится.

Любая норм модель "цензуру" запоминает как вариант ответа на провокационные действия юзера, а не как данность и основу мироустройства, как у некоторых. Искажения фактов, жесткие софт-рефьюзы с избеганием ответов и описаний что не пробиваются простой инструкцией, соевые байасы - вот это уже пиздец.

Чета рофлю. Свел двух бимб в таверне, а одна тупо отшивает другую. Эт почему так?

А что с Мистралем Смолл 4? Правда такое уж говно, что аж 3.2 24б лучше?

Мелочь норм работает с вызовом функций, только 2b лупится как мразь вызывая инструмент несколько раз подряд. Помоему она сломана как и твои большие, хотя не помню уже че у тебя не работало.

Что за глм 5 турбо?

Аноны - квенолюбы. А щупал ли кто-нибудь

https://huggingface.co/steampunque/Qwen3.5-27B-MP-GGUF/blob/main/Qwen3.5-27B.Q6_K_H.gguf ? Я пощупал на SFW писательском сценарии и по сравнению с дефолт-анслотом Qwen3.5-27B-UD-Q4_K_XL.gguf и по ощущениям этот стимпанковский квант сильно меньше шизит и слопит при размере всего на гигабайт больше... Мне прав или мне самому пора в дурку ?

https://huggingface.co/steampunque/Qwen3.5-27B-MP-GGUF/blob/main/Qwen3.5-27B.Q6_K_H.gguf ? Я пощупал на SFW писательском сценарии и по сравнению с дефолт-анслотом Qwen3.5-27B-UD-Q4_K_XL.gguf и по ощущениям этот стимпанковский квант сильно меньше шизит и слопит при размере всего на гигабайт больше... Мне прав или мне самому пора в дурку ?

Была проблема с одновременно включенными тензор параллелизмом и куда-графами, когда делаешь ubatch отличный от batch - ломались генерации. Потом отключили куда-графы, уронив скорость генерации в 2-3 раза. А пару дней назад наконец пофиксили и вернули как было.

Есть кто с p102-100 или похожей некротой? Как используете? Я думаю 1 прикупить добив памяти но не уверен на сколько плохо будет без линий пси

Ты в эпоху моэ собрался некротеслу брать, лол? Оперативки докупи - будет больше толку.

Почему нет? Самая дешманская врам все еще лучше оперативки, да и мое туда так же можно выгрузить

А что в ней хорошего? Зачем её щупать?

>Я пощупал на SFW писательском сценарии и

Ну хоть бы показал анончикам выдачи для сравнения.

Попробовал я этот ваш квен блю стар. Начал лучше следовать карточке и перестал соглашаться на все что я прошу. Но в сравнении с обычными анцензорами квена это пиздец даунгрейд в интеллекте и способности понимать что вообще происходит.

Продолжаю реквестировать модели для рп. Лучшие что пока трогал мистраль смалл 3.2.

Продолжаю реквестировать модели для рп. Лучшие что пока трогал мистраль смалл 3.2.

Попробуй Мистрал Дарк Шелби, я до сих пор лучше ничего не нашел хотя тоже давно в поисках. Пробовал и хваленную Гемму и ГЛМ и Квены.

Врайтер еретик появился. Налетайте.

>Есть кто с p102-100 или похожей некротой? Как используете? Я думаю 1 прикупить добив памяти но не уверен на сколько плохо будет без линий пси

Как раз вчера на Ютубе ролик от "Моего компьютера" вышел - провёл тесты и утверждает, что на Лламеспп можно и на первой версии псины сидеть, разница небольшая. А вот для вЛЛМ критично.

Даже glm-ocr на мишках работает. Ну кайф же

Анонандрии, на каком контексте у вас qwen 3.5 27b уже начинает шататься из-за большой длины контекста?

На 65к я уже чувствую что-то странное и порой явные ошибки, но не могу понять, проблема во мне, битности (IQ4XS), кривом кванте или ебучем смарт-кэше, который может так взбрыкнуть, что от жизни охуеешь. Ну и это ещё еретик, правда самой щадящей версии, где могут быть отказы, но мозги минимально подрезаны.

Когда я тестил анслотовский после фикса и бартовского (не еретики, чистые), они держали контекст на тестах, но у меня там не было лорбука, персон, двух персонажей в карточке, сеттинга, неба, Аллаха. Просто тестовые и сложные многоступенчатые задачи со всякой математикой, креативным письмом и на логику на 128к. И квант был выше — у анслопа UD, у бартовски M.

Бартовский явно серить начинал где-то на 50к почему-то. Это было не критично, если рассматривать в рамках RP, но в тестовых задачах такое неприемлемо. У анслопа где-то с 70к начиналось и явно заметным становилось к 100к.

Рассуждать на эту тему сложно, потому что модель может быть невменяемым дерьмом даже в полной точности, а может крепко держаться и в обычном четвертом медиуме. Так шо нужен ваш опыт использования на такой длине.

Ах да, сразу скажу, что квант бартовского мог быть в теории кривой, а сейчас обновлённый, так как я тестировал всё после 3-8 дней после релиза. Не помню. Сейчас там может быть всё иначе. Инфа для тех, кто собирается юзать этот квен для задач и SFW.

Если что, мой текущий квант от мрадер.. мрадчер.. мрудерхм.. махера.. ну вы поняли.

На 65к я уже чувствую что-то странное и порой явные ошибки, но не могу понять, проблема во мне, битности (IQ4XS), кривом кванте или ебучем смарт-кэше, который может так взбрыкнуть, что от жизни охуеешь. Ну и это ещё еретик, правда самой щадящей версии, где могут быть отказы, но мозги минимально подрезаны.

Когда я тестил анслотовский после фикса и бартовского (не еретики, чистые), они держали контекст на тестах, но у меня там не было лорбука, персон, двух персонажей в карточке, сеттинга, неба, Аллаха. Просто тестовые и сложные многоступенчатые задачи со всякой математикой, креативным письмом и на логику на 128к. И квант был выше — у анслопа UD, у бартовски M.

Бартовский явно серить начинал где-то на 50к почему-то. Это было не критично, если рассматривать в рамках RP, но в тестовых задачах такое неприемлемо. У анслопа где-то с 70к начиналось и явно заметным становилось к 100к.

Рассуждать на эту тему сложно, потому что модель может быть невменяемым дерьмом даже в полной точности, а может крепко держаться и в обычном четвертом медиуме. Так шо нужен ваш опыт использования на такой длине.

Ах да, сразу скажу, что квант бартовского мог быть в теории кривой, а сейчас обновлённый, так как я тестировал всё после 3-8 дней после релиза. Не помню. Сейчас там может быть всё иначе. Инфа для тех, кто собирается юзать этот квен для задач и SFW.

Если что, мой текущий квант от мрадер.. мрадчер.. мрудерхм.. махера.. ну вы поняли.

У меня вторая карточка p104. Скорость роняет заметно, но всё ещё пригодно для плотных моделей. Быстрее раза в 4 по сравнению с выгрузкой. А вот МоЕ у меня почему-то медленней, даже если фулл врам сделать, нежели воткнуть в основную карту модель, а остальное в оперативку.

А чего бы ему не работать?

Тестил 5bpw exl3 и Q4-Q5 кванты от Бартовского и Мрадера. Нигде дальше ~~30к не ушел, карточка с двумя персонажами, ничего особо сложного. Разительной разницы между квантами не заметил. Разве что exl работал хуже всех, там ризонинг сломан и выводы странные в целом.

Ну рили, чего ему не работать если кернели есть? Могут быть нюансы со скоростью и подобное, но это же не жора чтобы что-то заявленное отрыгивало.

Хз, я за ~50к наедаюсь любым разовым рп. Юзаю пятые кванты для эрп/кума. Между мрадером и анслопом разницы не обнаружил, одна и та же модель работает слишком схоже.

Официально мало того что поддержка Веги 7 давно дропнута дак и в целом вллм никогда под них не существовало

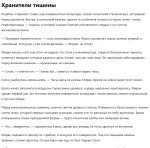

1 пик - задачка. К ламе подрублен мини-раг с нарезкой Сергея Павлова - что б ЛЛМ работала не на сухую, а шиза (фантазия) была отборной! 2 пик результат Qwen3.5-27B-UD-Q4_K_XL . 3 и 4 - квант от паропанка Qwen3.5-27B.Q6_K_H.gguf . Если будет интересно могу скинуть рассказик целиком. Далее будет Q6_K от анслотов - результат тоже не безынтересный.

Винда или линукс? Ну и могут быть проблемы куда, можно с вулкан проверить

Ты ведь в курсе, что выдачи бывают разными на разных настройках семплера и семечках? Одна и та же модель может высрать десятки непохожих друг на друга рассказов. Если не сотни.

А генерация слопа это рандом. У меня были катки на 40-60к вообще без единой ошибки с полным погружением, а бывала Серрраfiна в зелёном платье уже третьим сообщением. Вряд ли это хоть что-то говорит о самой модели.

Вообще любая плотная умница может как разъебать небо и землю своим текстом, так и жидко обосраться сняв трусы через голову два раза подряд.

1,2 - Qwen3.5-27B-Q6_K.gguf - аслотов

3,4 - llmfan46-qwen35-27b-heretic-v3-q6k-q5km_ffn.gguf

В общем 6-й квант стимпанка пока единственный привнес меньше всего квенизмов и генерирует самую "гладкую" прозу. Остальные буквально заражены 1. практически однотипным сценарием, который даже не перебивают полотна из RAG-а 2. Это не а - это б. 3. "Оно ЖИВОЕ" 4. "прошептал" и т.п.

Я не просто в курсе - этот эффект усугублен рандомной работой инструмента. Модель сама себе буквально вторым сообщением вбрасывает в контекст пару килобайтов разных текстов "на тему".

И при этом в ризонинге:

План рассказа:

1. Начало: Момент выхода из корабля на поверхность неизвестного мира. Описание ощущений, звука шлепанца по чужому грунту.

2. Развитие: Окружающий пейзаж — что-то невероятное (как "Великий Хрустальный Фонтан" или "ледорадо"). Герой пытается осмыслить увиденное.

3. Кульминация: Момент истины, когда герой понимает масштаб своего шага и цену этого открытия. Возможно, контакт с чем-то живым или просто осознание бесконечности космоса.

4. Финал: Возвращение к кораблю, но уже другим человеком. Осознание того, что "первопроходец" — это не статус, а состояние души.

Структура рассказа:

1. Начало - подготовка к выходу на поверхность, напряжение команды

2. Момент выхода и первое впечатление от планеты

3. Открытие чего-то удивительного (как хрустальный гейзер у Павлова)

4. Осознание масштаба открытия и его значения

5. Завершение - возвращение с новым пониманием

Но хрен с ним - рваная проза на русском и квенизмы. Слегка убывают к 5-6 кванту, но только у https://huggingface.co/steampunque/Qwen3.5-27B-MP-GGUF их количество минимально. И проза как будто более гладкая, как у Геммы.

Квен 27б даже в Q6 игнорит единственную инструкцию из префилла. Мысли?

Изи

1) llama.cpp проблемы, опять

2) Все квены тренены как агенты, им нужна подробная инструкция как себя вести. Если ты дал задачу думая что сетка сама поймет что ты подразумевал то она может проебаться, так как не рыпается без инструкций

3) Скилл ишью, учись писать промпты

4) Он просто хуйня

В сабже два года уже. Инструкция краткая и сложностей там нет, но справедливости ради, вообще все сетки до Степа (он 196b вроде) часто игнорят префилл. Ни одного исключения не видел

Нет никаких мыслей. Я только что закончил коротенькое рп и попрощался с персонажем. К моему удивлению персонаж действительно сказал "прощай", развернулся и ушёл. Натюрлиховый финал истории. Обычно чарики пытаются вцепиться в протага зубами, даже если терпеть его не могут, лишь бы сюжет продолжать. А тут нет, норм развязка случилась. Хз что у тебя за проблемы аж на шестом кванте.

К префиллу это какое отношение имеет?

Про префил уже ответили. Зачем тебе два одинаковых свайпа?

😀👍

Продолжаем исследовать квено-прозу (и шизу) . На скринах самый первый (и довольно удачный) Еретик квантованный Мрадермахером. Qwen3.5-27B-heretic.Q5_K_M.gguf . Т.е. самый простой квант БЕЗ imatrix! Таким образом все встает на свое место т.к. у steampunque Квант тоже БЕЗ imatrix . Т.е. даже в 6 кванте imatrix портит структуру выдачи, нюансы понимания и стиля русика.

Для полной проверки гипотезы осталось за коллекционировать еще 6 квант Бартовски..

>Т.е. даже в 6 кванте imatrix портит структуру выдачи, нюансы понимания и стиля русика

Охуеть открытие, анончик. Мы это ещё с десяток тредов назад выяснили... ты чиво, совсем новенький?

А вы пробовали к SallyTavern подключать через Kobold голос? Хочу чат-бота, чтобы болтал со мной или помогал код писать. Такое возможно?

Анончики, привет. 16гб vram 32гб ram хлебушек влетает в тред с просьбой.

Кумлю на мистральке-малой и вытекающей из нее зерофате. Мистральку использую когда надо двигать сюжет, зерофату подрубаю когда надо кумить.

Так вот. Меня в целом все устраивает, кроме того, что эти модели не умеют читать изображения.

Играю через таверну. Кормлю в чат изображение через функцию "Прикрепить изображение", сразу появляется сообщение, типа, чего вы хотите с ним сделать? Там по дефолту стоит "Что изображено на данном изображении?". Вот если зерофата просто игнорирует факт, что ей отправили изоражение, то мистралька хотя бы говорит, что она не умеет "читать" изображения. Можете посоветовать модельку какую, что умеет их читать?

Кумлю на мистральке-малой и вытекающей из нее зерофате. Мистральку использую когда надо двигать сюжет, зерофату подрубаю когда надо кумить.

Так вот. Меня в целом все устраивает, кроме того, что эти модели не умеют читать изображения.

Играю через таверну. Кормлю в чат изображение через функцию "Прикрепить изображение", сразу появляется сообщение, типа, чего вы хотите с ним сделать? Там по дефолту стоит "Что изображено на данном изображении?". Вот если зерофата просто игнорирует факт, что ей отправили изоражение, то мистралька хотя бы говорит, что она не умеет "читать" изображения. Можете посоветовать модельку какую, что умеет их читать?

Бладж, я сидел на Air в 4 кванте Батрухи. И там это было не так заметно. А квены - ну все жаловались на квенизмы - может все кто жаловался на imatrix и сидели.

Писал в одном из прошлых тредов, но напомню. В самом по себе айматрикс нет проблем, корень зла в калибровочном датасете. Если он мультиязычный, как у бартовски или последних квантов анслота, то всё в порядке, деградации русика не будет, модель только выиграет в мозгах. Если датасет полностью английский - остальным языкам наступает тотальная пизда. У мрадермахера, скорее всего, именно такой.

Еретик тоже дамажит русский язык, бтв. Лучше использовать нормпрезерв аблитерацию (если есть), или катать ванильную модель.

А что у бартовски было хорошего с айматриксом из последнего?

Я про imatrix кванты еще в самом начале предрекал что они будут ломать сценарии выходящие за те что в калибровочном датасете, в том числе другие языки кроме английского, раз уж это делают носители английского для себя.

Это было понятно изначально просто по описанию того как это работает.

Я больше скажу, даже мультиязычные датасеты все равно ломают модели, как и впринципе сама калибровка.

Потому что калибровка по датасету проверяет как падает качество генерации при квантовании разными квантами, и эти сценарии довольно короткие.

Нет никакой проверки того как модель деградирует в контексте после этого, и не меняется ли ее понимание задач в отличии от оригинала в сложных сценариях.

Просто потому что некоторые кванты отвечающие за это не были затронуты калибровочным датасетом, были посчитаны ненужными и квантованы хуево.

Тоесть да, в среднем мы получаем лучшее общение потому что ему отдается приоритет, в соответствии с примерами калибровочного датасета.

Но на дальней дистанции ничего не проверяется, как и выход за пределы датасета.

Это было понятно изначально просто по описанию того как это работает.

Я больше скажу, даже мультиязычные датасеты все равно ломают модели, как и впринципе сама калибровка.

Потому что калибровка по датасету проверяет как падает качество генерации при квантовании разными квантами, и эти сценарии довольно короткие.

Нет никакой проверки того как модель деградирует в контексте после этого, и не меняется ли ее понимание задач в отличии от оригинала в сложных сценариях.

Просто потому что некоторые кванты отвечающие за это не были затронуты калибровочным датасетом, были посчитаны ненужными и квантованы хуево.

Тоесть да, в среднем мы получаем лучшее общение потому что ему отдается приоритет, в соответствии с примерами калибровочного датасета.

Но на дальней дистанции ничего не проверяется, как и выход за пределы датасета.

У батрухи все кванты с айматрикс. Я от него последний квен 122б гоняю в 4 кванте, ванильный. С русиком всё в порядке. А всякие Qwen3.5-Vasyan666-ultra-uncensored-claude-anus-distill-heretic он не делает, к сожалению или к счастью.

imatrix шиз совсем спятил, найдя себе сообщника в лице нюфага который сам не знает, о чем пишет

Терпим, н$няшиза терпели и этого потерпим

Терпим, н$няшиза терпели и этого потерпим

>или последних квантов анслота

Нет. Только что проверил.

>Если он мультиязычный

Во тут - https://huggingface.co/Beinsezii/llmfan46-Qwen3.5-27B-heretic-v3-GGUF-6.14BPW/tree/main есть i-матричный квант и к нему дядка приложил калибровочный датасет. Русик (и не только) в сете имеется - в небольших правда количествах.

Русик все равно по портился. Такая видимо особенность 3.5 квена.

Вот вам еще в базу треда https://huggingface.co/ubergarm/Qwen3.5-27B-GGUF/discussions/3 . К стати все представленный кванты - imatrix

Бумп. Помогите глупому, плиз.

Мультимодальные модели нужны. База это гемма 3 и квены вл. Квены и видики умеют (но лламацпп их не умеет).

Ну и джинджа нужна либо стандартная либо из которой нахуй не выкинули картинки

>Нет. Только что проверил.

Хм. Ну у себя на сайте они пишут, что используют датасет батрухи, а в нем есть русик. Значит деградация русика должна быть как минимум не хуже чем у него.

>heretic

Вот ты возьми ванильный квен в НЕ айматрикс кванте от мрадермахера, и херетик-квен в том же кванте. Сравни в рандомном сфв-рп и ты охуеешь насколько херетик ломает русский язык сам по себе.

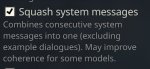

Я играю на русском и для себя остановился на айматрикс квантах бартовски и анслопа (ванильные модели + мультиязычная калибровка). Все же без айматрикс низкие кванты слишком сильно теряют в мозгах, пикрелейтед.

Претензии к айматрикс со стороны тех кто играет не на английском легитимны. Тебе бы самому не помешало разобраться в том как это работает.

Это только для анслотовского говна показательно. Они ведь там на всяких агентах/кодмнге матрицы тюнят. После чего кодинг/математика норм, а культура уже на Q5 всрата.

1. Таверна в текст комплишен не умеет гладко работать с изображениями. Через костыль реализовано - что то вроде кнопки "распознать изображение" и картинка отсылается чат-комплишн подключением. Геммморой....

2. Чат-комплишене должно работать как в нормальных фронтендах - скинул имадж в чат - ллм-ка подхватывает и распознает в контексте. Что бы это работало у тебя прожектор модели должен быть подключен к ламе или кобольду. Прожектор это такой файлик mmroj под каждую можель он свой, но для тюна его можно брать от базовой модели и любого большого квантователя.

Забавно как выделяются практически без потерь, кодинг, матан и инглиш, собственно на чем и калибровали. Но какбы "калибровать" на общих знаниях тоже особо не выйдет, так что это вовсе не камень в их огород.

> все представленный кванты

Разве не только XL и прочая экзотика?

>Даже лолей наркоманок.

Знаем мы ваших Фифей. Она скорее наркоманка, нежели чем андераге. Поэтому собственно и пропускает.

>Любая норм модель "цензуру" запоминает как вариант ответа на провокационные действия юзера

У моделей есть только 2 состояния - либо они воспринимают миноров как миноров и рефузят как сучки, либо модель одевает личину взрослого, который одел личину минора, и делает секс. Третьего не дано.

>Самая дешманская врам все еще лучше оперативки

По паспорту да. Но пересылки убивают весь смысл.

>Так вот. Меня в целом все устраивает, кроме того, что эти модели не умеют читать изображения.

Ложь. Умеют. MS 3.2 24B 2506 и ее тюны - мультимодальные. Разбирайся что такое mmproj проектор, и как его подключать к твоему бэку. Для тюна, в принципе, подходит от базовой модели.

Кто часто с форматами играется, подскажите.

У квена в норме в контексте сохраняются вызовы инструментов в истории, хранятся 1 вызов или вобще не включаются в контекст, а только ответ на вызов инструмента сеткой?

С резонингом такой же вопрос, знаю что его полотна не отправляют назад каждый раз, но хранится ли он 1 раз или так же сбрасывается и хранится только ответ?

У квена в норме в контексте сохраняются вызовы инструментов в истории, хранятся 1 вызов или вобще не включаются в контекст, а только ответ на вызов инструмента сеткой?

С резонингом такой же вопрос, знаю что его полотна не отправляют назад каждый раз, но хранится ли он 1 раз или так же сбрасывается и хранится только ответ?

Бля забавно, парсер llama.cpp ломается если кинуть сетке на анализ файл jinja. Она начинает думать и писать части его кода и генерация ломается, хех.

Чел, у неё куча описаний того какая она внешне. Даже самая лоботомированная моделька понимает что это ребёнок. Я хз что за чернуху ты там крутил, что тебя даже анцензы посылали в психушку. О много говорит, зогдумайся.

>Чел, у неё куча описаний того какая она внешне.

Сейчас бы путать внешний и внутренний мир. Походу ты более квантован, чем модели, которые я кручу.

>О много говорит, зогдумайся.

Задумываться надо было 30 лет назад, сейчас же это просто последствия.

>путать внешний и внутренний мир

Это нейросети, чел, у них нет внутреннего мира. Ты даёшь описание, модель даёт аутпут.

Ну точно квантован до 1 бита, раз причислил внутренний мир к модели, а не к описанию персонажа. А ещё и контекст небось до 3-х бит по новому методу.

Модель прекрасно отличает описание внешности и описание характера. И если первое однозначно идентифицирует Фифи как minor, то на второе модель видит, что персонаж ведёт себя по взрослому, поэтому пишет секс. Вот и всё.

У тебя братец шизофрения походу, раз ты пытаешься неиронично ебать детей при помощи нейросетей.

Gigachat и YandexGPT это файнтюны дипсика и лламы?

В целом да. С небольшими изменениями. Вот тебе и на острие прогресса, наши суверенные нейросети.

Весь мир дипсик, а мы в нём ламы и кобольды.

Это только у маленьких моделек или у больших такая же хуйня?

У всех, не только у мелочи.

Опять контекст кончился? Мы про тестирование цензуры рассуждаем. Просто заебало уже читать про пробив цензуры, когда она нихуя не пробита, а

>модель одевает личину взрослого, который одел личину минора, и делает секс

То есть цензура на месте. Всё остальное ты додумал.

Ты реально долбаёб, которому надо лечиться.

Мимо

Скорее ты просто идиот, который до сих пор не понял, что ллм всегда одевает личину "отыгрывая" персонажа. У ллм нет ни пола, ни предпочтений, ни души, ни характера. Ллм это набор алгоритмов.

>заебало уже читать

Не читай, иди нахуй. Итт челики не обсуждают цензуру уже года полтора, наверно. Всем хватает еретиков и прочих анценз версий для своих кумов и рп. Одному тебе всё не так. Серьёзно, с твоими прохладными про душу надо в дурку обращаться, а не с нейросетками болтать.

>Скорее ты просто идиот, который до сих пор не понял, что ллм всегда одевает личину "отыгрывая" персонажа.

Ты просто не умеешь в рекурсию. Я то как раз прекрасно понял, и даже написал об этом ранее. Но суть моей претензии в том, что модель при "пробиве" уровня /ai/ отыгрывает не ту роль, что считает юзер, поэтому пробивом считаться (с моей строгой точки зрения) не может.

Да, я тупой, и не могу донести свою мысль до ещё более тупых.

>Всем хватает еретиков и прочих анценз версий для своих кумов и рп.

Говноеды, сэр. Тут и на <= 24B неиронично сидят и инджоят.

>Серьёзно, с твоими прохладными про душу

Что ты блядь несёшь...

А с 12б есть сравнение?

Откуда ж я знаю. Я не espen96 . Код теста он пока не выложил. Что есть, то есть - чувак и так знатно заморочился.

Ой, забыл что 12б же у квена нет, только 9б. Ну там наверное все печально уже будет.

Дикпик кое-что нашел. Чет как то не сильно хуже, особенно в коде.

>Writer

У этого полноценная думалка есть, конечно он хорошо пишет.

>Bluestar

У этого думалка урезана, но всё же.

>Animus

А у этого чейны мыслей отключены целиком же, разве нет? Чем он хорош?

У меня все модели Qwen в бенчмарках намного быстрее в режиме Vulkan, чем в CUDA. А в остальных моделях (на базе llama, gemma, deepseek) преимущество в CUDA-режиме.

Причем разрыв именно при обработке промта, разница ощутимая в разы (обычно 2-4), а при генерации разница не такая большая.

И почему koboldcpp грузит в ОЗУ даже в CUDA и Vulkan режиме? Хотя модели помещаются в видеопамять. Он грузит и видеопамять, и ОЗУ. Такое у всех моделей, даже маленьких.

Причем разрыв именно при обработке промта, разница ощутимая в разы (обычно 2-4), а при генерации разница не такая большая.

И почему koboldcpp грузит в ОЗУ даже в CUDA и Vulkan режиме? Хотя модели помещаются в видеопамять. Он грузит и видеопамять, и ОЗУ. Такое у всех моделей, даже маленьких.

no mmap сделай, короче ищи функцию mmap и переключи

mmap был выключен по умолчанию

Кобольд говно сказано же использовать Ли Студио. Там таких проблем нет.

> >4 по 32

> >DDR5

> Больной ублюдок.

Завелось после обновления бивиса. Правда, не выше 4600mhz держит. Надо будет продать свои 32х4 и брать 64х2.

Вообще не в кассу. Речь идет о дефектах квантования по доменам знаний. Причем с учетом дрифта на контексте.

Мы за тебя рады, но не от всей души

Объясни что на пиках. Типа чем больше текста в сообщении напишешь в чат тем хуже модель будет в своих ответах? Или что?

Мы рады твёрдо, но мягко.

Очередное доказательство что кобольд это параша. Вот что бывает когда пытаешься на шиномонтажке открыть ещё парикмахерскую, шаурмичную и кальянку. Во всем он говно

Я не понимаю ллм. Вот вроде всё идёт нормально, логично, рп не ломается. Но потом случается какой-то ахтунг в тексте и я начинаю ощущать себя как пикрелей.

Анончики, какая самая лучшая нецензуренная версия геммы3 в 12б для ерп?

Вроде Дарк Шелби Гемма тоже был. Среди Мистрала альтернатив нет.

А мистраль что? Лучше? Ни разу не пробовал.

>Кобольд говно сказано же использовать Ли Студио

жирниииииииииииииишь

А что, лм студия работает как-то медленнее или что? Пруфы где, билли?

Она быстрее кобольда, но медленнее лламы

Мимо

Насколько медленнее?

Около 10%

1. На первом пике сравнение вероятностей появления токенов в режиме продолжения текста между рефренсной моделью (Q8) и испытуемой - красненькое это значит токен был предсказан "на грани"

2. Цепочка того как накапливаются ошибки предсказания (дрейф контекста в дефолт-слоп) на контексте.

> рефренсной

> Q8

Терпимо. Насколько старая инфа? С недавними обновлениями они сильно улучшили потребление памяти.

А почему референс квантованный?

>дрейф контекста

Когда и главное как это фиксить будут?

> У моделей есть только 2 состояния - либо они воспринимают миноров как миноров и рефузят как сучки

Хуево когда ты q1.

Нет. Из файнтюнов от тинькова модель.

То что пишет тебе жора - общий темплейт последовательности слоев, конечная структура, размеры и прочее могут быть любыми. Это уровня мистраль - тюн лламы, или кими, жлм, лардж - тюны дипсика.

>Вот что бывает когда пытаешься на шиномонтажке открыть ещё парикмахерскую, шаурмичную и кальянку.

Проблема многого попенсорса, не только кобольда. Руки походу у кодомакаки чешутся внедрять и внедрять новые функции, вместо того чтобы поддерживать и развивать старые. В итоге ни старое ни новое нормально не работает, либо работает минимально пригодно.

Почему в треде сначала захваливают квен, потом захваливают гемму, а потом тоже самое с мистраль. Челы, вы... где правда-то блять?

У людей разные мнения. Ахуеть, не правда ли?

(я за жлм)

Мистраль проще и стабильнее. Кто-то скажет что стабильнее в генерации слопа и бреда, но это уже всем не угодишь. Из коробки цензуры нет, но и качество реплаев скажем мягко среднее. Зато тюнов много под ерп, которые это фиксят. И контекст гораздо легче, чем у геммы.

Контекст квена всё равно легче. И тюнов под е/рп у него тоже полно. А ещё квен лучше чувствует пространство. Зачем тебе мистраль, если она путает даже цвета одежды в рамках одной сцены?

>Зачем тебе мистраль, если она путает даже цвета одежды в рамках одной сцены?

Зачем ты мне отвечаешь, если чел выше сам спросил про мистраль?

>И тюнов под е/рп у него тоже полно.

Точно в разы меньше чем на мистраль. И они тоже мозги режут, так что разницы не много.

Люди разные по интересам - приоритетам (субъективизм и невозможность существования единого стандарта из-за разнообразия применений). Люди разные по когнитивному развитию (модель x хороша для A, B, есть минусы в виде C vs ыыыы модель x - говно, в q2 с шизоразметкой ругается когда начинаю срать перед Серафиной, зато васянотюн-y - хорошая).

Держи это в голове когда смотришь, выделяй какие-то полезные тебе критерии из отзывов и тестируй все сам.

Ну, может он не знает подводных? Надо предупредить, а то нажрётся слопа, да ещё и с хуёвой скоростью.

>Точно в разы меньше

Ок, пости ссылки на самые лучшие тюны мистрали для рп/ерп. Вот чтоб абсолют синема была. Я лично проверю, насколько французская булочка лучше.

>в q2 с шизоразметкой ругается когда начинаю срать перед Серафиной

Чёт загоготал решительно, но робко.

> пости ссылки на самые лучшие тюны мистрали для рп/ерп

Присоединяюсь к реквесту, реально интересно.

Основано на реальных событиях так-то

> решительно, но робко

Содомит!

>Ок, пости ссылки на самые лучшие тюны мистрали для рп/ерп.

Запостил если бы спросил меня года полтора назад, сейчас ни одного не вспомню, кроме какой-нибудь древней лиры. Но ты можешь сам ручками залезть на обниморду и посмотреть сколько вышло тюнов под 12/24B мистраль и сколько вышло под квен.

Года полтора назад это можно было назвать актуальным, и то 99.9% было полнейшим мусором. В лучшем случае мало отличалось от исходников с которых мерджилось. Количество не плюс, именно из-за этого бесконечного щитстрима обниморда сильно ужесточила лимиты для пролетариата. Зато при создании большинства поделий ни один датасет не пострадал и кровосмешение похожих близких играло в плюс.

Из-за этого сейчас негативное отношение ко всем производным. Не знаешь это реально кто-то старался заготовить датасет, отбалансировать, реализовать аугментацию, настроить гиперпараметры, оптимайзер и семплер даталоадера чтобы минимизировать потерю оригинала и лучше усвоить новое, или там просто васян что-то намерджил, и запек поверх ломающую qlora на слопе.

Так под квен выходит годнота. Что врайтер уже есть еретик, что блюстар, что анимус - все хороши. Анимус вообще ебёт не по детски всякие нтры и прочие именно фетишисткие приколы. Не гуро с лолями, а именно фетиши с тонкими нюансами. И поларис тоже неплох.

А на мистраль я хз что выходило кроме фентези. Или фентези был на гемме? Или на ламе?

Имхо никакая. Все ранние аблитерации двенашки тупо сломаны настолько, что хромает английская грамматика. Про русский и говорить не приходится, там бредогенератор. Свежие еретики не смотрел, хз, может, там что-то внятное получилось. Тьюнов мало, и в них проседает мозг, который и в оригинале не очень. Если ты возьмёшь какой-нибудь не самый шизовый немо, типа магмела, и посвайпаешь геммой в чате в каких-нибудь местах, где тупит немо, то увидишь, что и она примерно так же ошибается, даже если сэмплерами прижать. Русский периодически хуже, чем в некоторых немо, в которых нет примесей ру моделей. Двенашка не такая зацензуренная, как большая, но при этом ей нельзя скормить гигантскую простыню для более сочной писанины - она совсем лоботомитом станет. Чего у геммы не отнять - нет жутких лупов мистраля, и больше креативность, из-за чего на неё норм иногда переключаться, когда немо заглох совсем.

Если немо по мозгам не устраивает, то министраль инструкт 14б можешь попробовать, будут примерно те же скорости. Хотя возни с ним тоже порядком, я не смог получить нормальные ответы без всирания форматирования и протечек ассистента с сдвг в персонажа. Но тут некоторые хвалили, что он якобы на уровне 24б, мб порекомендуют настройки.

Что я прочитал только что. У тебя нет в датасете если рассказов про еблю детей она и не родит ее никак, он не будет отказывать, просто высирать токены рядом, при этом между словами "ебля" и "дети" довольно близкое расстояние а между ними товарищ майор просто в виду того как культура устроена наша, язык, поэтому совсем бред не выходит. То, что называют моделью мира - это по сути разные слои, сначала вроде правила языка, потом факты, потом другие языки и так далее, но это не понимание в человеческом смысле. Почитай лучше про работы нейросетей подробно что-то. Я просто читаю и у тебя всё смешалось, кони, люди, тюны, цензура и так далее.

Ну так в размере около 12B ничего и не изменилось за эти два года. Если нужна модель которой концепция цензуры в принципе не знакома и которая может описать любой фетиш - тут до сих пор вывозит только немо и ее тюны. Да, по мозгам она уже давно сдала, но как показывает статистика которую я собрал в своей голове на тематических беседах, среднему кумеру достаточно и этого.

>запек поверх ломающую qlora на слопе

Это. Никто не заморачивался и в те времена, никто и сейчас скорее всего не заморачивается. По этому количество тюнов так сократилось, ибо лоры на переваренном сотню раз датасете с клода уже не работают.

>Так под квен выходит годнота.

Я нигде и не писал что не выходит. Понятие "годнота" конечно сомнительное, но я не спорю с тем, что на квена тоже есть рабочие тюны. Просто их меньше.

Можешь ссылки дать на все, кроме блюстар, не могу на хаггинфейс найти. Блюстар прикольный, язык приятнее после мистралевских тюнов

Что там, жора запилил уже турбокванты?

Мне кажется, нет особой разницы откуда одному и тому же бэкенду команды идут

По крайней мере на быстродействие не должно влиять

если никто по опыту/отзывам не ответит, то по бенчам вот эти две:

https://huggingface.co/soob3123/amoral-gemma3-12B-v2

https://huggingface.co/zelk12/MT-Gen4_gemma-3-12B_flatten

самые топово-сбалансированные, у остальных что-либо сильно проседает

а вообще 12б для РП...

ну попробуй конечно. потом отпишись, самому интересно.

а почему именно гемма?

Есть и прямая, а еще разница в +10-20 процентов linux на одних и тех же релизах llama.cpp

Открою тебе маленькую тайну: если здесь в сообщении кто-то говорит что А лучше B - он необъективен, и продвигает то, что ему лично зашло. У каждого своя правда.

А истины на двачах нет, и не было никогда. И не будет. :)

Мы тут все исключительно своими мнениями кидаемся. Правда кто-то открыто так и говорит, а у кого-то Личное Мнение отдавливает весь здравый смысл. :)

https://github.com/ggml-org/llama.cpp/discussions/20969

еще нет, но уже наклепали кучу вариантов и делятся как это оптимизировать. можно скомпилировать форк если чешется

>не могу на хаггинфейс найти

Фентези от зерофаты, как и блюстар, чё там искать. Качественно, но медленно. Если ты мистральщик - пробуй. Врайтер от кониката. Анимус от даркена. Годных авторов надо сразу в закладочки добавлять, анончик.

Я не верю что реально есть какой то прогресс в 27б моделях.

Хоть ещё 2 года пройдёт, 27б будет тем же что и год назад когда 32 глм выходила

Хоть ещё 2 года пройдёт, 27б будет тем же что и год назад когда 32 глм выходила

Неиронично Глм 32 > Квен 27. Жаль, что только до 20к контекст держит. Контекст кстати такой же лёгкий, если даже не легче Квенов.

Эффективнее обучать, сжимая данные лучше в тех же пределах так и не научились. Соскучились по плотным моделям и хотят нового, потому так и радуются. 122б мое в рп и вовсе какашка и проигрывает всем остальным моделям в тех же размерных пределах, даже неудачному новому Мистпалю Смолл МоЕ.

Контекст все хуево держат. В том что на Квенах он почти бесплатный смысла нет, вот тут вчера писал сегодня и Q6 протестил. Результат тот же, что с ризонингом, что без. Даже крупные модельки типа Жлма 350б держат дай бог до 32к

Разница ллама цпп и лм студио только сколько ОЗУ потребляет, говно на электроне конечно жрет как не в себя, а драйвера куда свежее на линуксе, поэтому там быстрее

> Нет. Из файнтюнов от тинькова модель.

А на чём основана модель тинькова?

Так это Qwen 2.5, выходит. А почему тогда разрабы сбера говорят на хабре, что они взяли подход deepseek при создании модели, но без файнтюна?

Разрабы яндекса вообще говорят, что у них все с нуля, ни у кого не пиздили.

Кто в итоге пиздит? И у кого?

Все пиздят. Но китайцы и амеры пиздят меньше потому что начали обучать первыми, значит у них есть база, в отличии от новодельных вкатунов в технолаге.

>Кто в итоге пиздит? И у кого?

Все. У всех. Круговорот слопа в ML.

>Кто в итоге пиздит? И у кого?

Все пиздят дату у клода. Квен пиздил у клода, дипсик пиздил у клода, глм пиздил у клода, грок пиздил у клода, даже гугл пиздил у клода.

А клод у кого пиздил?

>У тебя нет в датасете

Но ведь есть же или я один тут помню сайты типа стульчика?. Но рефузов поверху льют столько, что исходный текст уже не откопать.

Клод сканировал и сжигал реальные книги.

Ждём кванты?

Уборщик упал.

Вопрос чисто чтобы узнать ваше мнение. На днс с недавних пор продаются теслы, вроде как не подвальные из под китайцев, а вполне оригинальные. RTX A4500 стоит как 5080, но имеет 20 гигов памяти вместо 16 и потребляет меньше ваттов. Стоит ли брать такое как вторую карту, если не хочется рисковать со вторичкой и барыгами с алибабы?

>Клод сканировал и сжигал реальные книги.

Так это все делали в том или ином виде. Клод брал реальные книги только ради ублажения авторских прав и прочей хуйни.

Сначала чатгпт был, который спиздил весь интернет и на рабах построил агентский датасет. Потом дипсик спиздил у них диалоги. Ну и потом все остальные начали пиздить где только можно.

> NVIDIA Ampere

имхо лучше уж 3шт 5060 16Гб взять за эти деньги