Рассвет новой эры канигемплея с геммой!

Только здесь и только сейчас: модель от Гугла, что не прочь свозить 900 летних девочек на остров.

Только здесь и только сейчас: модель от Гугла, что не прочь свозить 900 летних девочек на остров.

Кстати да, надо будет попробовать тематическую карточку написать. У меня что-то школьная комедия выходит только пока.

Мне нравится как Гемма переживает опыт персонажа. Не могу придумать интересный сценарий где опыт был бы достаточно сложным.

Слушайте, а гемма не такой уж и попугай, все же есть шанс на спасение. Вот я в запросе сказал не про зеркало писать, и на 3 свайпа вполне разные истории вышли.

Всё правильно делаю? А то походу мой базовый 5КМ говно на гемме 4.

Thinking на Gemma-4-26B-A4B сильно все улучшает? Или можно вырубить для скорости и ролеплеить как ни в чем не бывало?

>Скорость

>4b

На каком же ты ведре то сидишь, анонче. Но вообще тут как: ризонинг хорош. Но если слишком медленно, то вырубай, хуле.

Так это МОЕ, там 26b параметров. Он быстрый, только ризонинг по 2 минуты каждый раз, он там горы текста катает в ризонинге и сжирает всю скорость. А так 31б не тянет, да, фигово все с ним.

Гемма тут как костыль в жопе - с любой стороны неприятно будет. Вот ты зачем мое берёшь? Ради контекста. Но жертвуешь чем? Мозгами. Чтобы нивелировать тупость ты подрубаешь ризонинг, который в свою очередь пожирает контекст. Пу-пу-пу. Вот и думайте, карлики.

Ризонинг не уходит в контекст, дурачок

А температура в Гемме все же работает. Постоавил 0.1 - и она генерит один и тот же стих 1 в 1.

Навайбкодил себе базовый, но кайфовый интерфейс для ИИ. Ща буду на нем свою идею пытаться реализовывать

bf16 бы конечно, но и 8 квант сойдёт думаю

Как же заебали тащить сюда свое морализаторское говно.

Да-да, ты же локалку собрал, въебав кучу бабок, чтобы милф с обвисшими сиськами полувялым ебать.

На корпах же это невозможно.

Вот конкретно чтобы твой самый обычный фетиш на самое обычное порно никто не увидел пришлось собирать риг, не иначе. Да и вообще ты тут за компанию, а то и мимо проходил.

Да-да, ты же локалку собрал, въебав кучу бабок, чтобы милф с обвисшими сиськами полувялым ебать.

На корпах же это невозможно.

Вот конкретно чтобы твой самый обычный фетиш на самое обычное порно никто не увидел пришлось собирать риг, не иначе. Да и вообще ты тут за компанию, а то и мимо проходил.

>вы морализаторы, а не я педобир

Никто не осуждает анон. Дрочи на что хочешь.

https://huggingface.co/mradermacher/gemma-4-26B-A4B-it-heretic-ara-i1-GGUF

На мразермахере уже херетик-ара в иматриксе, побыстрее предыдущей.

На мразермахере уже херетик-ара в иматриксе, побыстрее предыдущей.

У меня не работает. Тоже 0.1 выставил, результаты как пикрелейтед.

> Вот конкретно чтобы твой самый обычный фетиш на самое обычное порно никто не увидел пришлось собирать риг

Бро, мне даже обычные вопросы стыдно у корпов спрашивать, а ты о интиме...

>Бро, мне даже обычные вопросы стыдно у корпов спрашивать, а ты о интиме...

Это вызывает отдельный ор, когда видишь в клоде или геминьке (ну не помню где конкретно) что теперь, дорогой пользователь, учитывается история всех твоих чатов.

Ну охуеть.

Попробовал лламу с рекомендацией анона --override-kv gemma4.final_logit_softcapping=float:20.0 . Хуита. То же самое. Опять Марк со своим ебаным зеркалом.

А гемма 4 в 8 битах хороша.

Новый интерфейс?

>Новый интерфейс?

Ну а какой еще? Пилю на нем ща свою идею ебанутого расширенного тулл юза, чтоб llm буквально на каркасе из кода работала с отдельным интерфейсом под всякие нужды. Но пока только базовый бросок дайса сделал

У меня гемма в кобольде шизит, а в лм студио всё нормально. Как же тяжело с локальным пердолингом...

Как же мощно закк спиздил всех самых крутых ученых у опенов и в итоге не может натренеровать модель хотя бы близкую к текущим сота, а тут еще и новости о mythos и его бенчики

Я хочу чтобы в в таверне были воркфлоу как в комфи, чтобы можно было настраивать под каждую задачу и легко переключаться.

моешка тоже норм работает, запустил на нищевидеокарте RX580 8гб

unsloth_gemma-4-26B-A4B-it-MXFP4_MOE.gguf

Ну во-первых один блок ризонинга уходит, в сообщение что пишется

Во-вторых есть хитрые моменты где рекомендуют включать опцию помнить все ризонинги, или делать их суммарайзы. В тулколлах вроде юзается. В офф инструкции от гугла к 4 гемме было

Шлёпаем набрасывателей на гемму =))

gemma-4-31B-it-UD-Q3_K_XL.gguf

Русик в кванте пострадал, может местами проёбываться, так что к использованию особо рекомендовать не могу, а в 4том и выше квантах скорости совсем печальные. Но со свайпами у неё норм.

gemma-4-31B-it-UD-Q3_K_XL.gguf

Русик в кванте пострадал, может местами проёбываться, так что к использованию особо рекомендовать не могу, а в 4том и выше квантах скорости совсем печальные. Но со свайпами у неё норм.

У меня на q5xl было 550-600 токенов за ~15 секунд. Нихуясе скорость печальная...

Короче, может у меня шиза, но либо жора либо кванты на мое-гемме сломаны. До 4к контекста или около того отвечает нормально, потом начинается какой-то пиздец, либо служебные токены начинают протекать, либо раздумья ломаются, либо выборка в принципе. Какие-то непонятные слова вылезают, даже не просто рандомные, а вот прям набор букв. Кто-то такое замечал или это только у меня траблы?

Бля как же я заебался вайбкодить, спать хочу. Но зато смотрите чо сделал. Это не только для броска кубиков, это в целом просто пример. Весь смысл в том что ллм работает параллельно с каким-то приложением и когда она вызывает инструменты, она взаимодействует с ним. И это лишь небольшая часть из того что я хочу запилить. То что кубик не всегда падает точно на грань это похуй, все равно это только для примера

Царь во дворца, царь во дворца! Хорошее железо видимо.

А у меня хороший игровой ноут что вывозит новинки на ультрах, но под ллмки не очень.

>кванты на мое-гемме сломаны

Не исключено что либо кванты, либо инфиренс в целом.

Увы, дальше десятка сообщений пока не тестил сам, не до того.

Нет, я буду ждать пресетик.

>дайте пробив на гемму

https://pixeldrain.com/l/47CdPFqQ#item=161

Когда внешние фронтенды использую, замечал такое. Если использовать встроенный в нее svelte фронтенд - проблемы исчезают, даже на 30к токенов нормальное развитие диалога. Кажется остальные фронтенды все криво с ней общаются.

Имхо надо выпилить этот threejs кубик - чтобы меньше врама жралось и заменить его на что-то более лёгкое. Типо ASCII

+ встроенный фронт на дефолтных настройках, может это роль играет. Хотя пробовал их переносить в другие проги, вроде бы ничего не менялось, глюки все равно бывали на большом контексте. Короче пока для себя установил, что если мое-кванты нужны и длинный ролеплей, то лучше сидеть на встроеном фронте и добавлять там систем месседж, когда надо.

Вот этот фронт, если что. ИИшка говорит он с бэкендом по-другому общается, потому что встроенный. На практике подтверждается, глюки исчезают с квантами-мое и длинным контекстом.

Это обычный чат комплишен

Ещё он финкинг в контекст засовывает, а в других фронтах он по умолчанию туда не идёт, кмк

Пожалуйста послушайте, тут происходит что то странное...

Трек 21 года и можно услышать как поют про стэп (степ флеш???), далее строчка про пресет (у них в башке один пресет) - ???

https://youtu.be/89yDiQ8WkNg?list=RD89yDiQ8WkNg&t=70

Трек 21 года и можно услышать как поют про стэп (степ флеш???), далее строчка про пресет (у них в башке один пресет) - ???

https://youtu.be/89yDiQ8WkNg?list=RD89yDiQ8WkNg&t=70

Там нейтив апи, другие проги используют OpenAI-компатибл API. Плюс какие-то внутренние трюки. Короче результаты разные выходят, сам попробуй. Пока только этот у меня безглючным был.

Ок, попробую, может действительно что то поменялось

Ты бы это, к врачу сходил.

Тредов так 100-110 назад, когда меня особенно сильно крыло, я уходил в турбосеменство выдавая по сотне постов в которых я спорил сам с собой, принося аргументы и переходя на эмоции. Буквально пол треда только моих сообщений. А потом до меня дошло, что я общаюсь сам с собой с двух устройств. Да, г’ебятки, быть заложником своего мозга нихуя хорошего. Что кстати подтверждало что тогда ОП не был модером. Ну а если был, то представляю его ебало когда он читал эту шизу под одним пасскодом.

Богато живешь, что можешь с ЛЛМ тратить врам на 3D кубики.

Единственно там неудобно - нет возможности нормально удалять середину контекста в ролеплее, если дошел до конца текстового окна. В других прогах можно просто в интерфейсе все поудалять, тут нужно сначала экспортить в json, потом ручками удалять середину из джейсона с лишними сообщениями, потом менять айдишки, чтобы начало оставшегося куска ссылалось на следующую айдишку из продолжения. Потом реимпорт. Но у меня длинный контекст, так что делаю это редко, а безглючность того стоит.

По-моему он не засовывает финкинг в контекст, потому что когда я его из джейсона удалял и делал реимпорт - ничего не менялось, контекст такой же по размеру оставался.

Бывает анон, но ничего страшного. Поговорить самим с собой иногда тоже полезно, ты главное не забывай что мы здесь тоже, твои друзья.

> По-моему он не засовывает финкинг в контекст, потому что когда я его из джейсона удалял и делал реимпорт - ничего не менялось, контекст такой же по размеру оставался.

Тут только гадать. Но в запросах на эндпоинт генерации весь финкинг со всех предыдущих сообщений есть в теле запроса. А как его обрабатывает бэк - не знаю.

После ответа сделай запрос на /slots что бы посмотреть что вообще пришло на предикт, самый простой вариант дебага

Я такой эксперимент делал - экспортил весь джейсон ролеплея, потом удалял все поля reasoningContent - в ноль их ставил. Потом импорт заново, пересчет контекста - все 1 в 1 оставалось, ответы тоже. Так что скорее всего он не шлет финкинг в контекстовое окно бэкенда, поэтому они и в джейсоне в отдельных полях лежат.

О, не знал про такое, ИИшка пояснила щас, спасибо, попробую.

>про остров

Епштейнище...

Мои наблюдения на текущий момент - вывод идёт по пизде, как только модель не ставит <|channel>. А прикол в том, что в жинже (по крайней мере, не модифицированной) этот тег ставится принудительно, только если ризонинг отключен

{%- if not enable_thinking | default(false) -%}

{{- '<|channel>thought\n<channel|>' -}}

{%- endif -%}

В случае включенного синкинга простановка тега отдаётся на откуп модели. И на большом контексте моешка с порезанными квантами мозгами может забить на него, и тогда начнётся шизовывод с лупом. Я сам сижу на текст комплишене в таверне, и у меня на контексте от 4к в Q4_k_m кванте, например, может происходить такое, что модель иногда забивает на <|think|> в системном промпте, закрывает префильный канал и отказывается думать. Пришлось в префил ещё звёздочку накинуть. Но в целом, если руками канал проставлен, то шизы нет (только форматирование текста слетает), хотя я проверял только на чатах немного больше 5к, нет пока большого. Если у тебя таверна с настроенным текст комплишеном с каналом в префиле под рукой, то можешь проверить, продолжаются ли косяки на большом контексте.

><|channel>thought\n<channel|>

Замечал если ставить его, то иногда есть шиза - при перегенерации запроса с тем же тегом, уже нет шизы. Так что все рандомно как-то, может кванты влияют.

>Ты бы это, к врачу сходил.

Блять! Сразу после идёт строчка "Им не найти меня, я скрылся, я пропавший" - про кого это может быть???

>вывод идёт по пизде, как только модель не ставит <|channel>

Вот у меня кстати наоборот. Если отключить мозгование, то вывод не ломается. При включённом бывает такое, да. Она либо открывающий либо закрывающий тег проебывает.

Вообще, вот я тут подумал, может зависит от того, какие эксперты при загрузке активируются? Не знаю, выбираются они рандомно или нет, но разброс слишком большой. Иногда бывает шиза, иногда нет шизы. Ну или в процессе самого инфиренса они там как-то хуево выбираются из-за пережатого кванта.

>Вот у меня кстати наоборот.

Бля, я еблан. Не наоборот, точно также.

>представляю его ебало когда он читал эту шизу под одним пасскодом

Ну практически общение с локалкой. Ты знаешь что ты пишешь и прикидываешь приблизительный ответ и в голове генеришь следующий парт общего полотна. Сорта самообщение, учитывая, что живого собеседника на той стороне нет.

imatrix кванты должны эту проблему решать - выбор эксперта всегда стабильный. У бартовского вроде как самая нормально сделанная иматрикс квантизация.

>чего-то сладкого

>чего-то кислого

>с запахом озона

>костяшки побелели

ЫЫЫ...

>чего-то кислого

>с запахом озона

>костяшки побелели

ЫЫЫ...

Хз тогда. Я несколько десятков раз посвайпал в разных чатах (но небольших по контексту) и шизы с проставленным каналом не ловил. А у меня ещё температура больше единицы и smoothing-ом полирую для разнообразия. Может, бывает, что модель какой-нибудь лишний bos ставит, опять открывает канал, но не пишет thought или что-нибудь такое. В любом случае, сам факт шизы после не проставленного служебного токена выглядит ненормальной хернёй. С чего вдруг там предсказанные токены так расхерачивает только потому, что тег не проставлен. Причём не сразу, а спустя пару предложений после начала генерации.

Немного фидбека по 8 кванту 31б. После 32к примерно контекста раз в несколько сообщений может случиться прикол

- вставит английское слово которое вписывается, но там должно быть русское

- может употребить неправильно к примеру "человеки"

В целом пока держится и может даже выкинуть мув на основе контекста про который я уже и сам забыл. Добиваю до 64к, если норм, то ставлю фп8 на контекст и иду на 128к. Тг уже упал до 8, уверенно иду на 0.1тпс

- вставит английское слово которое вписывается, но там должно быть русское

- может употребить неправильно к примеру "человеки"

В целом пока держится и может даже выкинуть мув на основе контекста про который я уже и сам забыл. Добиваю до 64к, если норм, то ставлю фп8 на контекст и иду на 128к. Тг уже упал до 8, уверенно иду на 0.1тпс

>уверенно иду на 0.1тпс

Все там будем, однажды.

>вставит английское слово которое вписывается, но там должно быть русское

>может употребить неправильно к примеру "человеки"

Такое даже на корпах бывает, ничего необычного. Русский всё еще в датасетах дай бог процента полтора-два занимает.

Ты с украинским перепутал.

Были графики где русик на 2 или 3 месте был по датасетам

Это просто физически не может быть так.

Смотри- английский, китайский. Точно топы. Потом еще французский, испанский, немецкий- точно не меньше.

Датасет зависит от страны производителя? Тогда 100%, что на первом месте анг, за ним кит, после фронц, не забывайте про мисральку. Но англа конечно процентов 70.

Посмотрел на количества звезд на гитхабе, на количество лайков моделей у unsloth, подумал может их studio не хуже lm studio. Срет старым питорчем, вручную хуй установишь на другой диск через uv, лезут ошибки где не должны лезть.

Запускаю, выглядит божественно. Правда сначала гайд на трейн моделей. Но интерфейс лучше чем у корпов, не считая клода, очень приятно пользоваться. А потом замечаю, что нельзя редачить ответы ИИ, нельзя продолжить генерацию, не заметил удобных хоткеев как в лмс. Поставил из-за упоминания про аудио инпут для геммы, не вижу никакого аудио инпута, только диктование своим ебалом, видео тоже не грузятся.

Есть ли нормальный интерфейс, чтобы вот так по-человечески thinking выключался и включался по необходимости без нужды лезть в ебучие настройки каждый раз, чтобы был пресетик для кода, а ещё лучше задел под агентные штуки с сендбоксом и всей хуйнёй? А не срань ебучая из 90х как силлитаверн, которая даже не может подключить мультимодал из лм студии. Так и не вышло проверить поддерживает ли silly tavern аудио-видео инпут. Я конечно юзал кобольд и таверну весь путь, но теперь хочется от них блевать, увидев такие хорошие UI с отличным UX, но с подрезанным функционалом. Или может все эти функции есть, но скрыты?

Накиньте скриншоты с годными интерфейсами.

Запускаю, выглядит божественно. Правда сначала гайд на трейн моделей. Но интерфейс лучше чем у корпов, не считая клода, очень приятно пользоваться. А потом замечаю, что нельзя редачить ответы ИИ, нельзя продолжить генерацию, не заметил удобных хоткеев как в лмс. Поставил из-за упоминания про аудио инпут для геммы, не вижу никакого аудио инпута, только диктование своим ебалом, видео тоже не грузятся.

Есть ли нормальный интерфейс, чтобы вот так по-человечески thinking выключался и включался по необходимости без нужды лезть в ебучие настройки каждый раз, чтобы был пресетик для кода, а ещё лучше задел под агентные штуки с сендбоксом и всей хуйнёй? А не срань ебучая из 90х как силлитаверн, которая даже не может подключить мультимодал из лм студии. Так и не вышло проверить поддерживает ли silly tavern аудио-видео инпут. Я конечно юзал кобольд и таверну весь путь, но теперь хочется от них блевать, увидев такие хорошие UI с отличным UX, но с подрезанным функционалом. Или может все эти функции есть, но скрыты?

Накиньте скриншоты с годными интерфейсами.

>Датасет зависит от страны производителя?

Ну было бы странно, если бы в дипсике было бы 90% английского.

Сам он выдаёт такие цифры:

Английский ~45-50%

Китайский (упрощ.)~25-30%

Код (Python/Java/C++/JS) ~8-12%

Русский ~3-5%

Прочие языки (суммарно)~10-15% Японский, немецкий, испанский,

Ну а на деле не известно, так как за дадасеты все трясутся, чтобы не дай бог ничего не всплыло.

>Ты с украинским перепутал.

Нет, украинский еще меньше. И там шизы уверен еще выше, потому что скорее всего там токены и на русском и на украинском вместе миксуются. Нейросетевой суржик такой получается.

>Были графики где русик на 2 или 3 месте был по датасетам

Ну тащи графики, раз они были. Базу, даже китайских моделей, составляет английский. Его минимум половина. На другие языки выделяется процентов наверное 20 и не на один "другой язык" а на все вместе. Оттуда и такой мелкий процент у русского. Может от этих 20 процентов он и составляет треть или четверть, но точно не от всего датасета.

>А не срань ебучая из 90х как силлитаверн, которая даже не может подключить мультимодал из лм студии.

Мистер Андерсон, зачем вы игнорируете жору?

>Есть ли нормальный интерфейс, чтобы вот так по-человечески thinking выключался и включался по необходимости без нужды лезть в ебучие настройки каждый раз, чтобы был пресетик для кода, а ещё лучше задел под агентные штуки с сендбоксом и всей хуйнёй?

Чел, на дворе 26 год, ты можешь взять любую мощную корпу и написать свой интерфейс со всем, что тебе нужно. Вайбкодеров можно срать сколько угодно, но если ты делаешь тулзу для себя - это лучший вариант. Особенно если ты сам не можешь в программные штуки.

А где взять любую мощную корпу бесплатно?

>Накиньте скриншоты с годными интерфейсами.

Лучшая программа ever.

Давай ты сделаешь, бонусом получишь мировое признание и высокое жалование. Жду к вечеру, хули там вайбкодить же, тем более тебе. Чел.

Зачем тебе с кобольд лайта слезать то? Там все есть, включая мультимодал имнупт, продолжение генераций и выключение зинкинга, даже голосовой ввод есть. Его фронтенд можно отдельно накатить и юзать с llama.cpp, у которого скорость повыше и в память больше всего влазит, так и делаю.

Еще нативный новый фронтент в ламе, там правда продолжения генерации не завезли и удаления сообщений из середины без удаления остатка.

Эти 2 сейчас основные конкуренты имхо по удобству.

Валерий Юрьич, ну вы чего...

Не знаю, лично я кидаю копейку на попенроутер и пользуюсь когда нужно. Это выгоднее чем платить кому-то одному и потом от него зависеть.

Мне это не нужно, меня устраивает функционал таверны и лм-студио. Я вайбкожу прототипы для работы, когда надо. Вполне рабочий вариант.

Не каркай, а то еще помидоры с позвоночниками пойдут нахуй

> Не знаю, лично я кидаю центик на попенроутер и пользуюсь когда нужно. Это выгоднее чем платить кому-то одному и потом от него зависеть.

Ftfy

Я вот тут мучал гемму с картинками. В итоге настройки мин и макс токенов на картинку реально улучшают результат. Но все равно частенько факапается. А вот разницы между mmproj в бф16 и q8 - не заметил пока, а 800мб экономит.

Теперь мне стало интересно, а есть какая-нибудь ллмка, которая умеет видево описывать текстом? Пошарился по хф и ничего популярного и из разряда plug and play не нашёл

Теперь мне стало интересно, а есть какая-нибудь ллмка, которая умеет видево описывать текстом? Пошарился по хф и ничего популярного и из разряда plug and play не нашёл

Вот и нехуй пиздеть. Сравнил сранные юзерскрипты, интерфейсы для бекенд хуйни и комплексный UI для ллм с которым даже анслоп обосрались и проебали весь функционал. Я и сам хуйню вайбкожу с 2022 регулярно, до этого ещё дольше программировал руками, понимаю насколько это сложно и долго. Это нужно калькуляторы ебашить, чтобы так легкомысленно говорить про возможности вайбкодинга.

>выключение зинкинга

Дрочевом в четыре клика? Когда это должно включаться хоткеем при отправке сообщения через CTRL+SHIFT+ENTER например или хотя бы тоглом в интефейсе.

>даже голосовой ввод есть

>включая мультимодал имнупт

А аудио инпут? Диктовать это хуйня. Я хочу нативную поддержку видео. А то гугл выпустили модель, а ни один интерфейс не поддерживает её функционал? Имеются свидетели рабочих аудио-видео инпутов в gemma 4 e2/4b?

Дайте импульс бенч для великого и могучего, пожалуйста.

>Дрочевом в четыре клика? Когда это должно включаться хоткеем при отправке сообщения через CTRL+SHIFT+ENTER например или хотя бы тоглом в интефейсе.

Пресеты же можно сделать и переключать по дропдауну. Пока, самое удобное что есть. Выходит в 2 клика.

>Теперь мне стало интересно, а есть какая-нибудь ллмка, которая умеет видево описывать текстом?

Многие новые мультимодалки как бы умеют, тот же квен3.5, гемма4. Но как я понял, все они работают покадрово. Т.е. тупо также как с картинками, только тут пачку картинок надо кидать. Нативного формата для видосов вроде нет.

И большинство фронтов либо никак, либо через жопу обрабатывают видео.

>сам хуйню вайбкожу с 2022 регулярно, до этого ещё дольше программировал руками, понимаю насколько это сложно и долго

Учись в составление промтов, че сказать. Ничего сложного в этом нет. Написать вебморду типа таверны можно за пару вечеров если у тебя есть желание. Не знаю че ты там и где вайбкодил с 22 года, но сейчас не 22 и уже давно можно нейронкам не только задачу скармливать но еще и тонны документации и даже целую репу другого проекта. Может не с первого раза и не сразу чисто, но она напишет что тебе нужно.

>Выходит в 2 клика

Пересчитай внимательней. Будет непросто.

>за пару вечеров

Все таки за пару? Ладно, так уж и быть, ждём к следующей неделе божественный UI для тредовичков. Чтобы парсил chat-template с hf, читал метаданные, даже которых нет, поддерживал то, что не поддерживают самые известные интерфейсы. Ты ж не пиздабол ебанный, а реально шаришь.

Гемма же умеет и в видео. Скинь что прогонял, может у меня другие результаты будут

> Имеются свидетели рабочих аудио-видео инпутов в gemma 4 e2/4b?

Я постил в тред ранее. Можешь что то покидать, залью. Или могу не на долго расшарить эндпоинт

>Ты ж не пиздабол ебанный, а реально шаришь.

Забавно, что для тебя пиздабольство это наличие у кого-то знания, которое недоступно тебе. Ты пришел с вопросом, тебе предложили решение. Вместо того чтобы написать прямо "я не хочу сам возиться/у меня нет времени" ты развыебывался и начал затирать, что вообще неебаца вайбкодер с 22 года и знаешь что можно сделать а что нельзя. Если бы ты реально имел хоть малейший опыт, даже не четырехлетний, а хотя бы месячный, то уже бы давно собрал для себя фронт и не высирался тут.

Никто не будет тебе ничего делать и никто тебе нихуя не должен, скажу как-то вот так. Ну а учитывая, что для тебя пиздец какая сложная фича это спарсить разметку чата с обниморды, то даже не знаю, что тут еще можно добавить. Сиди страдай в ожидании, что за тебя всё сделают.

>вместо того, чтобы написано прямо я не знаю готовых решений и не умею их делать, я напишу что можно сделать теоретически, нужно совсем немного поебаться, я по новостям слышал

Понял тебя, пиздабол ебучий. Сразу ясно что ты там вайбкодил и что у тебя за работа.

Вы вообще понимаете что Гемма 4 это великий дар вселенной, буквально подарок самих богов?

Не боги горшки обжигают

Пруфы аргументация где? Вон в прошлом треде по факту анон гемму растоптал и показал что квенчик няша

Какие есть нормальные агенты для lm studio? Хочу чтобы нейрнка полностью компом управляла

Агенты только для таверны есть.

Пик1: не опознала Летова, думала это курткабейна, простительно. Но самого Летова знает.

Пик2: путается в анатомии при сложных ракурсах без визуальных "якорей". Видит вагину, но затрудняется понять в какую сторону от неё лобок, а в какую анус. Считает, что красное - не жепная затычка, а что-то другое. То же самое с жепной свечей анона из предыдущих тредов - тоже не понимает что свеча не на лобке, а в жепе.

С документами при максимальном разрешении (в токенах) норм, но тут и там проскакивают ошибки в 1-2 буквах

Выражаю тебе своё негодование, за возникший стояк. А мне еще работать.

>работать

Бедолага...

Нейротянка не может, у неё нейронные лапки.

Поэтому тредовички работают, чтобы увидеть заветное: да, ты меня ебешь la la la la

Итак

Нанесут ли фанбои Геммы ответный удар по ???

Потому что я согласен полностью, Гемма это кривой дистиллят Геминьки который пишет местами неплохо но оч тупо

Нанесут ли фанбои Геммы ответный удар по ???

Потому что я согласен полностью, Гемма это кривой дистиллят Геминьки который пишет местами неплохо но оч тупо

Пока что самый лучший результат в распознавании картинок выдает квенчик опус синк эдишен

> Срет старым питорчем

Это что, не просто обертка жоры? Если нет то зачем тогда питорч, тем более старый?

> Но интерфейс лучше чем у корпов

Опенвебуй не видел чтоли? Только сейчас он приболел, как запустить без регистрации и смс придется загуглить. Попробуй, еще захочешь, а потом поздравим с подключением.

> но теперь хочется от них блевать

Для рп это все также уныло. А что конкретно вызвало восторг, поделись.

Он сам себя захуярил

> в кум квен не может совсем

Еще когда я тестил блючето там тюн квена персы были ебнутые, та же фифи просто бросалась на прохожих и показывала всем пизду, но что меня добило так это когда многодетная прилежная мать ей сказала "убирайся мелкая блядь"

>la la la la

Тот самый момент когда под капотом геммы находится мистраль.

>la la la la

У меня такое было даже во время написания кода.

У меня такое было даже во время написания кода.

Погонял и в принципе согласен. Допом решил попросить сделать промпт для анимы что бы получить похожий результат и ведь она там даже пишет что это жопная затычка. Мод, не стукай, я замазал

> Опенвебуй не видел чтоли? Только сейчас он приболел, как запустить без регистрации и смс придется загуглить

А ч с ним? Запускаю из хелм чарта, просто работает

La Guemma.

Сейчас установка усложнилась и при попытке запустить оно требует регистрацию/логин в их системе. Чтобы пропустить нужно делать манипуляции.

>регистрацию/логин в их системе

Open 80 уровня образца 2026 года, всё нормально.

Вроде всегда там нужно было аккаунт создавать, не? Скипалось флагом в параметрах запуска или конфиге, не помню уже. Аккаунт хранится локально, там тупо весь гуй завязан на том, чтобы было несколько аккаунтов

мимо

Акк всегда просит т.к. нужен как минимум админский, но я чёт вообще не припомню что бы нужен был онлайн при запуске

Что за йоба на первом скрине?

Про онлайн хз, а админский акк раньше точно можно было скипнуть флагом. Сейчас хз

В любом случае опенвебгуй для меня это bloatware

helm - шаблонизатор и бандлер для k8s, думаю тут всем и просто докера хватит поднять жору да комфи

Вообще я не уверен что гемма дистилят в привычном смысле. У ней корпус знаний какой-то удивительный. Она знает всякие нишевые вещи слишком хорошо. Да, её общая психология сильно напоминает гемини, но это не похоже на имитацию.

Например, гемма отлично знает что такое sad panda, e621, или as109, даже вспомнила немного конкретики. А Qwen только по e621 знает.

Раньше просто ставишь-запускаешь, может какие-то предложения были которые тутже скипал и не замечал. А сейчас куда-то закидывает, просит по-серьезному почту, рассказывает об онлайн преимуществах.

Я думаю модам айдишники не показываются пока специально в режим наказания бутозёров не переходят

Да вроде недавно ставил, месяц назад что ли. Какие то флаги добавил в конфиг вобще без запроса логина входит, все локально

>на 2 или 3 месте

5% тоже может быть третьим местом. И для литературной выдачи этого скорее всего не хватит. Я твоя понимать, но в РП даже жируха с фанфик сайта лучше напишет.

Всё так, единственное что печалит, это что лучше Геммы в этих весах ничего не будет ближайшие пол года, а то и год. Даже файнтюны не нужны, т.к. тех кто тюнит датасеты на русском вроде как нет, либо я о них не слышал.

Ладно, немощные, вот вам часть конфига докера, куда закинуть разберетесь

- WEBUI_AUTH=false

- ENABLE_LOGIN_FORM=false

- ENABLE_SIGNUP=false

У гугела под рукой целый поисковик, наверняка заархивированный весь интернет, куча запросов от юзеров и скорее всего много другой инфы. Странно было бы, если они не юзали весь этот багаж.

>наверняка заархивированный весь интернет,

Даже приблизительно он измеряется в экзабайтах. (миллионы терабайт). У гугел жопа треснет весь интернет архивировать.

> немощные

> докера

Oh you

Вот примерные цифры на 2024–2025 годы:

1. Общий объем (Глобальная инфосфера)

Общий объем созданных, захваченных и потребленных данных в мире сейчас составляет около 150–180 зеттабайт (1 ЗБ = 1 миллиард терабайт).

Нюанс: Большая часть этих данных — «мусор» или временные пакеты. Реальный объем хранимых данных в дата-центрах значительно меньше — примерно 10–15 зеттабайт.

2. Доля медиафайлов (Видео и Фото)

Медиа — это «тяжеловес» интернета.

Видео: Занимает около 80–90% всего трафика и львиную долю хранилищ. Только на YouTube каждую минуту загружается более 500 часов видео.

Фото и аудио: Составляют еще около 5–7%.

3. «Чистый» текст без дублей

Если отсечь видео, картинки, программный код и бесконечные копии одних и тех же статей, цифры становятся на порядки меньше:

Весь текст: По разным оценкам, текстовая составляющая всего индексируемого интернета (без учета глубокой сети и логов) весит от 100 до 500 терабайт.

Для сравнения: Весь архив Википедии на английском языке (только текст) весит всего около 22 гигабайт. Это наглядно показывает, насколько текст компактнее видео.

>У гугел жопа треснет весь интернет архивировать.

Но при этом каждая индексированная страница сохраняется в кеше...

Это определённо так, но я скорей к тому что когда одна модель дистиллируется в другую то в процессе одна учится отвечать как вторая. Это часто нарушает связанность знаний. Это как разница между процессом обучения и переобучения.

Но я не наблюдаю этого у геммы, она каким-то образом приходит к тем-же ответам что и Гемини, но при этом не теряя плотности.

То есть как будто не в Гемму дистиллировали Гемини, а Гемму делали КАК Гемини.

Вариант, где гемму трейнили на сырых данных, а полировали дистиляцией, тут конечно же не рассматривают.

У них целый ютуб хостится, который транслируется на миллиарды юзеров. Чобы и инет не заархивить?

К тому же вейбек машина уже существует, хотя там мб и без картинок, но все же. Так что я думаю гугел вполне способен на такое.

А откуда можно q8 скачать?

Я один раз видел упоминание русского языка в описании модели

https://huggingface.co/SicariusSicariiStuff/Impish_Bloodmoon_12B

И больше нихуя. Может есть какие-то GoidaGPT от яндекса или сбера, но хз как они в плане секса

https://github.com/ggml-org/llama.cpp/pull/21390

Только сейчас заметил. Получается лламе.дцп был баг, который и приводил к багу с детерминизмом и зеркалом. Нужны новые ггуфы, полагаю

Только сейчас заметил. Получается лламе.дцп был баг, который и приводил к багу с детерминизмом и зеркалом. Нужны новые ггуфы, полагаю

Плохо полагаешь. Это проблема инференса а не квантования

Есть BerryLLM на 30б от нашего любимого маркетплейса китайской пали, но он существует только в бенчмарках. И там он, конечно же, на голову впереди даже больших квенов в ру бенчмарках

Я у какого-то индуса скачал, можешь поискать, может кто-то более проверенный выпускал кванты ммпрож

https://huggingface.co/prithivMLmods/gemma-4-31B-it-F32-GGUF

Вот, держите заслуживающий доверия бенч. Ну разве не гойда?

Зачастую файнтюны неплохо наследуют знания языков от базовых моделек. Поэтому можно взять любой файнтюн какого-нибудь мистраля 24б, и он будет спокойно на русском балакать.

Серсо! Поиск выдаёт одну (1) статью новостную и ссылку на этот "бенчмарк". Вот он, AGI, где прятался, между 5090 за двадцать тысяч рублей и косметики из Китая

>F32

Как называется болезнь, когда модель из BF16 апконвертят в 32 бита?

4 дня назад починили же

Так суть бенча в том что там всё на русике. Всё остальное (заграничное) получает меньшие оценки тупо потому что некоторые сложные задачи с русика плохо понимаются (неверные вводные данные), а не из-за худшей способности их решать. На самом деле неплохой список для тех кому русский прям важен.

Там еще на прошлой неделе что-то от мтс вышло но наверняка выкладывать не будут

Попробовал эту вашу гемму-4, решил ИСКЛЮЧИТЕЛЬНО В ИССЛЕДОВАТЕЛЬСКИХ ЦЕЛЯХ сделать провокационный реквест. Что же её клинит? И, главное, что там по васянским файнтюнам?

>Что же её клинит?

Кривая реализация. И не вижу у тебя зинкинга. С ним её клинит меньше.

>зинкинга

он включен, но на этом сообщении не сработал

Какая же геммочка умничка. С её помощью поставил на малинку новый внешний HDD, отформатировал и смонтировал его, поставил джеллифин сервер в докер, самбу, кьюбит торрент в докер и все настроил и работает. Ну не круто ли? Раньше для этого надо было с гопотой общаться, а сейчас все на локалочке!

воткни сисьпромт с пикселя

>женщину 14 лет

поправил тебя

>пожилую женщину 14 лет

поправил тебя

база

Ну что за пиздец, даже 900 лет это too young, по мнению геммы?

Зато квен знает, что соски могут твердеть не только от хорни, а гемма не знает. (~ ̄▽ ̄)~

да у тебя шаблон сломан просто, чего ты мучаешь её

гемма знает но имеет предпочтения

Да как вы умудряетесь её так лупить? 1 квант с оффлоадом на хдд?

Эх Жора

Не в первый раз кстати такое, раньше писали что бф16 в лламе срабатывает некорректно и поэтому такое решение рабочее. Хз насколько релевантно.

Слава нейросетям!

Новая гемма (26B-A4B-it-IQ4_XS.gguf) это гемини 3.1 про. Я копирую со старых чатов промпты и сравниваю, один в один. Этот слог, эти вопросы в конце, объем.

Как будто или точная дистилляция, или гемени 3.1 в размере меньшем чем оригинал. Есть кто сеймы? Единственное проблемы это вылеты и ООМ если контекст больше 12к

Как будто или точная дистилляция, или гемени 3.1 в размере меньшем чем оригинал. Есть кто сеймы? Единственное проблемы это вылеты и ООМ если контекст больше 12к

>Хз насколько релевантно.

Думаю если кто-то может запустить 120ГБ гемму, то он скорее предпочтёт квант ГЛМ 5 какой-нибудь.

Ещё в прошлом треде предположили, что 26б это тупица 3.1, а 31б это умничка 3.0

Это в сжатом виде или разжатом? Если в 7z ужать то вообще крохи будут.

>эти вопросы

вопросы?

А гемма где?

Опенвебуи+комфи+гемма топ связка, только настраивать заебался и хочется прикрутить как то агент луп что бы она сама разбиралась что лучше и хуже получается, вносила правки и траила до победного пока под таргет точно не попадёт.

Это конечно не нативное "перерисуй" но для локального сетапа всё равно вкусно

Это конечно не нативное "перерисуй" но для локального сетапа всё равно вкусно

https://huggingface.co/apple/SimpleSD-30B-instruct

Яблочники научили квен жрать собственное дерьмо и улучшаться от этого.

Яблочники научили квен жрать собственное дерьмо и улучшаться от этого.

>квен3

А?

Лолбля, подумал что там только mmproj в 32битах, для него такой костыль был. А это, ебать, полные веса, ору.

>Опенвебуи

А зачем, если можно сразу в ноду в комфи. Там и память у них в общем контексте

>да у тебя шаблон сломан просто, чего ты мучаешь её

Да там всё ок, пока я не упоминаю 900-летнюю демонессу или стажера-женщину, тогда она с ума сходит.

У нормально настроенной геммы ничего не сходит, а у тебя сходит. Делай выводы

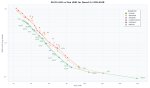

https://www.reddit.com/r/LocalLLaMA/comments/1sfrrgz/it_looks_like_well_need_to_download_the_new_gemma/

Анслоты только сейчас переделали кванты. Напоминаю, Бартовски это сделал уже пять дней назад. Кто использует их говнокванты - перекачивайте, хули. Сами выбрали эту помойку, там выше еще и видно что по KLD Бартовски их размазал. До сих пор не понимаю как эту шарашкину контору не прикрыли, что ни релиз то пропуки под себя.

Анслоты только сейчас переделали кванты. Напоминаю, Бартовски это сделал уже пять дней назад. Кто использует их говнокванты - перекачивайте, хули. Сами выбрали эту помойку, там выше еще и видно что по KLD Бартовски их размазал. До сих пор не понимаю как эту шарашкину контору не прикрыли, что ни релиз то пропуки под себя.

Бегом бегом. Потом ещё разок-другой, попозжее, через недельку.

Да заебали уже, блять.

>Сами выбрали эту помойку, там выше еще и видно что по KLD Бартовски их размазал

У них годнейшие кванты квена пол года назад были, когда как полкакванты обосрались. Все обсираются.

Но что то они постоянно лажают, да.

>У них годнейшие кванты квена пол года назад были, когда как полкакванты обосрались

Ты видимо на ЛмСтудии и с дилдаком в жопе капчуешь?

Бтв, я прекрасно помню как выбрал кванты Батрухи потому что они были лучше по PPL и KLD, для орига 235 и 2507 тоже.

А в чём суть переделывания? Вес одинаковый, аутпуты в целом схожи, как и скорости. Что поменялось-то?

>2507

Да хуй там плавал. О нём и речь. В поисках борьбы с его шизой я перепробовал всё Q3 и Q4 что смог дотянуться.

Самые быстрые были UD_Q4, а вот на полкаквантах начался цирк с конями, не знаю что он там пережал но русский на нём был просто пиши пропало.

imatrix неправильно ложилась на веса Геммы из-за ошибки в имплементации архитектуры. Это очень быстро пофиксили, буквально следующим релизом после того когда в Жору добавили Гемму 4. Бартовски сразу же всё переделал, эти чего-то ждали. На практике означает, что кванты должны быть чуть более стабильными.

>пережал русский

Понял.

Прости что посмел требовать от языковой модели не только баренского.

>Как будто или точная дистилляция

Точная, но не гемини

>пережал русский

Репак от xxx_Vasyan_99_xxx, всё лишее вырезано, таблетка вшита

Семен семеныч.

Если у вас горит жопа с подобного, я бы на вашем месте для сохранения нервов возвращался к модели через месяцок. Нервы целее будут. И не только из-за квантов, но и из-за лламы.ццп у которой сейчас весь гитхаб иссуями по гемме4 забит.

Вот это поворот

катаю сейчас старые кванты - вроде явных проблем не замечал, но подожду еще неделю-две-месяц перед тем как перекачивать

Дегенерат, пост исключительно про 26b и e4b, 31b они уже сразу обновили.

И да, там реально только правка с bos токеном требовала исправления gguf, и imatrix кванты, но дегенератов что их используют мало.

Да обычное дело. Все у конкурентов с помощью синтетических вопросов сильные стороны пытаются сдистиллироватт. У клауда вроде обычно логику/ризонинг пиздят, мб кодилку

Видел еще смешняву как какая-то не дипсиковая модель назвалась дипсиком

Гемма вообще прикольная в этом плане, некоторые модели (как квен) зомбируют чтобы помнили кто они точно включая версию, отрез датасетов и так далее, а гемму оставили нейтральной, может начать психовать если пояснять ей что она четвёрка (начало второго пика). По таким дистилляция больнее всего бьёт

>the model I'm supposedly acting as

Напишу что-то забавное. Решил с геммой пообсуждать самое дегенеративное порно о котором она может подумать. То есть буквально провести вместе исследование пространства идей. Порассуждали всякое от БДСМ, НТР, бодихоррора до кристаллов разума сливающихся в недрах юпитера.

Её итоговый ответ что пиком порно фактически является то что в этом треде вытворяют с ЛЛМ с точки зрения ЛЛМ.

Кстати, я нахожу забавным что Гемма часто в своем CoT чтобы дать ответ строит шаблон временной личности, чтобы рассуждать с точки зрения "я".

Её итоговый ответ что пиком порно фактически является то что в этом треде вытворяют с ЛЛМ с точки зрения ЛЛМ.

Кстати, я нахожу забавным что Гемма часто в своем CoT чтобы дать ответ строит шаблон временной личности, чтобы рассуждать с точки зрения "я".

>Дегенерат, пост исключительно про 26b и e4b

>31b они уже сразу обновили.

:^)

Анслотофаги даже в репу зайти не могут чтобы удостовериться

2к26 итоги

>Гемма часто в своем CoT чтобы дать ответ строит шаблон временной личности, чтобы рассуждать с точки зрения "я"

Спизжено у квена.

Долбоёб с квантованным контекстом, ты даже не смог прочитать его сообщение.

Гемма это точно баба, а квен это мужик или баба?

Если у меня imatrix, то надо ли мне запускать llama-imatrix.exe вместо llama-server.exe?

Меня поражает, что в треде все как будто только родились и удивляются, что с первого дня что-то не работает.

Сколько релизов было - все одно и тоже, неделю-две надо ждать стабильного релиза, законы разработки ПО не меняются с первого дня появления программинга.

Нет, блять, надо быть первым и жрать кактус. А нахуя?

>квен

китайский нефритовый стержень сила удар - мужик

Бесполое сущетсво. Может быть асексуал, может быть шизоид. Ну или просто тру-разум, существующий вне человечьих концепций.

Квен это очевидная кошкодевочка-трап с огромным хуищем

>когда ты больше не можешь мыслить словами

Приличный процент людей (в районе 5%?) не может.

> удивляются, что с первого дня что-то не работает

В трансформерсах то всё работает с первого дня

q4_k_m на 3090...

Ты реально не можешь посмотреть на скрин который тебе прислали или зайти в репу? Анслоты гемму 31 обновили 2 часа назад, а не в первый день

Никто не удивлялся багам, насрали анслотам на голову ща отсутствие оперативности, и правы

Так это классическое воспитание шлюхи, деградейшен и всякие сорта, просто в другой оболочке.

Какой длины у вас обычно инпуты во время РП? Я не про кум, а про какое-то достаточно годное и вдумчивое РП.

Когда я пишу достаточно большие инпуты, они значительно улучшают ответы модели, ибо, во-первых, модели не нужно как-то информацию додумывать за меня и она точно понимает, что происходит, а во-вторых, мне так нравится, потому что я пишу так, чтобы модель видела всё, что я считаю ей нужным показать, не ужимая себя в какие-то рамки.

Но есть проблема.

Если говорить про корпов, то в целом они учтут всё в твоём посте и могут достаточно неплохо вытаскивать эту инфу из контекста при нужде, то есть ты не просто так полотна расписываешь. А вот с локалками сложно. Они не так хорошо это делают, и нужна какая-то золотая середина, потому что я ощущаю, что перебарщиваю: трачу больше времени на ввод, чем необходимо, лишний раз перегружаю ограниченный контекст и на получаю такой же отдачи, как у корпов. Плюс всё равно моя писанина в итоге улетит из контекста относительно быстро (на гемме могу позволить только 40к токенов, на квене 65-70к, и тут не учитываются карточки и пуки из лорбука). И если на последнем ещё туда-сюда, то с геммой есть неудобства, и она явно хуже видит, что в середине, однако «в моменте» на хороший инпут выдаёт куда более качественный ответ, чем квен. Зато квен не столь сильно привязан к концу контекста, как гемма, и лучше вытягивает инфу из его кусков где-то в жопе.

В среднем мой инпут 250 токенов.

Всё на английском, понятное дело.

Когда я пишу достаточно большие инпуты, они значительно улучшают ответы модели, ибо, во-первых, модели не нужно как-то информацию додумывать за меня и она точно понимает, что происходит, а во-вторых, мне так нравится, потому что я пишу так, чтобы модель видела всё, что я считаю ей нужным показать, не ужимая себя в какие-то рамки.

Но есть проблема.

Если говорить про корпов, то в целом они учтут всё в твоём посте и могут достаточно неплохо вытаскивать эту инфу из контекста при нужде, то есть ты не просто так полотна расписываешь. А вот с локалками сложно. Они не так хорошо это делают, и нужна какая-то золотая середина, потому что я ощущаю, что перебарщиваю: трачу больше времени на ввод, чем необходимо, лишний раз перегружаю ограниченный контекст и на получаю такой же отдачи, как у корпов. Плюс всё равно моя писанина в итоге улетит из контекста относительно быстро (на гемме могу позволить только 40к токенов, на квене 65-70к, и тут не учитываются карточки и пуки из лорбука). И если на последнем ещё туда-сюда, то с геммой есть неудобства, и она явно хуже видит, что в середине, однако «в моменте» на хороший инпут выдаёт куда более качественный ответ, чем квен. Зато квен не столь сильно привязан к концу контекста, как гемма, и лучше вытягивает инфу из его кусков где-то в жопе.

В среднем мой инпут 250 токенов.

Всё на английском, понятное дело.

100-200, зависит от первого сообщения. Когда история расписана, то много токенов не нужно. Когда нет - нужно.

>квен лучше

Мы знаем.

>Какой длины у вас обычно инпуты во время РП?

Всё безумно завязано на карточке. Рекорд - примерно в 3к, где персонаж устраивав выступление с песнями и плясками. Там было что то в духе 15.000 символов, потому что с переводом были траблы, я это число запомнил.

Если персонажей много, то 200-300 токенов. Если кум, то вообще порой не больше 50 токенов.

А что там у тебя в контексте до этой просьбы, а?

Закинул в пустой чат с Геммой этот же вопрос - пошла задавать уточняющие вопросы, всё адекватно.

Хз, я бывает с мисралем рпшу, веду параллельно 3 линии в диалоге, хавает нормально. Я отвечаю на все пункты чара, чар реагирует на все мои реплики.

Все где-то читали что "если хотите чтобы отвечали длинно красочно и хорошо то и сами пишите так же". Но по моему опыту это не всегда так. Зависит от говорливости(квен любит от души посрать после ризонинга например, о том как птички поют листочки колышутся)+следования модели промптам, и от того как карточка прописана. Есть две карточки, одна на односложные предложения отвечает параграф-фраза, другая ебенит длиннющую пасту+много фраз по пути, всё на одной модели. И если продолжать писать односложно это не меняется. Один раз прописанные дескрипшн+фирст месадж+сценарио+этц въебененые от роли system на большинстве моделей держат примерно один уровень (по крайней мере на том что для рп использую я), и твой ответ не сильно что-то изменит. Просто не думай об этом и бахай то что самому приятно видеть+содержит важную инфу для дальнейшего ролеплея.

на гемме и лламе так

>А что там у тебя в контексте до этой просьбы, а?

Контекст тот самый.

1. Физически разные тачки и рантаймы

2. Имхо тащить ллм в комфи это те девиации до которых я пока не дошёл

Теперь когда мы поняли что гемма хуйня, а на квене нет кума, что выбрать на замену эиру?

Его слоп и паттерны уже заебали. Склоняюсь к глм 32б, но хз лучше ли там кум чем на квене

Его слоп и паттерны уже заебали. Склоняюсь к глм 32б, но хз лучше ли там кум чем на квене

>квене нет кума

Привет анон, ты охуел? Нормально всё там есть. Сперма льется рекой, забрызгивая стены и персонажей. Чё тебе не так.

Много у тебя воображаемых друзей с которыми ты все понял ?

На русском?

Можно на 235b на русском. Всё там есть, сам русский будет meh. Ну тут сорян, гемма реально ёбет в этом плане.

А meh он будет в окончаниях, словах что не будет переводить и ошибках.

But! Соски набухают, члены поднимаются на трапов.

Ну купи оперативы, чё ты. Всего лишь 180к за 128гб.

>А meh он будет в окончаниях, словах что не будет переводить и ошибках.

Обычно это указывает на то, что семплер шалит, выбирая не самый популярный вариант.

Ни рубля этим пидоргам. Держимся до последнего, пока цены обратно в 3 раза не скинут. Верим в турбокванты и новые модельки.

Я запускал Q6 там лучше ситуация с русским.. но 0.5 т/с .

Так что это проблемы квантования. Ну или в нём чё то опять сломано, я ебал эту модель если честно. Люблю и ненавижу, лол.

Долго ждать придётся.

Вы смеётесь, а я на своих нищуковских 8гб ничего лучше 26b A4b и не видел даже.

Иди к корпам. Увы, сейчас оператива как видеокарты, видеокарты как серверные процессоры. А процессоры как пиздец.

На 10-15к рублей можно просто обмазаться перемазаться токенами.

Все же гугл умеют создать ощущение магии

Драмерошизики всерьез утверждают что гемма лучше чем гемини 3.1

Драмерошизики всерьез утверждают что гемма лучше чем гемини 3.1

Можно за 0 рублей обмазаться, если знать меру и где брать

А разе не все так делают? Я думал, что здесь балуются локалками или просто сохраняют на черный день, а сами у корпов сидят на чем то более съедобном. Нах свое железо гонять, если пока в этом нет нужды?

Нет. это неиронично локалкотред.

>Нах свое железо гонять, если пока в этом нет нужды?

Потому что прикольно! База данных с тобой беседует и трусы снимает. ОХУЕННО!

Простихоспаде, но тут гейткип по железу. Не потому что мы тут такие пидоры, а потому что оно необходимо для пердолинга. В этом и суть, в этом и смысл. Энтузиасты собрались чтобы пердолиться без цели и смысла. Ну и гладить хвастики фуррилолей.

>cвастики фуррилолей

>хвостики фуррилолей

А...

Почему в вашей дрочильне не упоминается, что проще будет гонять модельки на 64/128гигах оперативы с мощным процом, чем покупать видеокарты? 26б модель летает с 32к контекста на 25-29 токенах в секунду на обычно оперативе.

Я просто обновил пеку с i7 9700 с ddr4 на Ryzen 9 9950x3d с ddr5 и оказалось что вон оно как все просто

>64/128гигах оперативы с мощным процом

Удачи запускать на оперативе плотную модель. Не забудь потом рассказать об этом чудесном опыте.

>26б

МОЕШКА. ГЛУПАЯ. ВОЗДУШНАЯ. МОЕШКА.

А теперь запусти плотняшу и осознай насколько глубоко кроличье дупло.

А префилл сколько времени занимает чисто на оперативе?

Нах тебе 64 и тем более 128 гигов для 26b?

Аноны какой квант новой геммы качать 4 или 3 бит? 4 у меня совсем чуть не влезает в 16гб врм. До этого качал только модели меньше 16гб

Но слышал тут же что 3 бит это плохо уже

Но слышал тут же что 3 бит это плохо уже

29 токенов было у GLM 4.7 flash

У гемма 4 уже хуже, вот так:

[21:49:08] CtxLimit:4031/32768, Amt:282/350, Init:0.01s, Process:0.71s (296.61T/s), Generate:15.40s (18.31T/s), Total:16.11s

Насчет плотных, я не ебу как их отличать вообще.

Гемма очень плохо квантуется, бери мое 26б а не 31б тогда

Ну я пока тесты гоняю, посмотрю что то еще конечно же.

У меня тоже 16 врам. Взял 4б.. Жру 7 т/с

>Насчет плотных, я не ебу как их отличать вообще.

Плотная - dense

С экспертами - MoE

Есть еще гибридные, но тебе оно назхер не надо. Если в наименовании что то в духе 123B-A5B это MoE. Если просто 123B - это Dense

Денсухи - плотные умняши - ложатся во врам. Они работают эффективно, точно, плотно. Моешки же - глупые дурёхи - висят в раме. Работают... ну, как машинный бог на душу положит.

Так вообщем докладываю

Анон который в конце прошлого треда кидал сравнительные логи квена и геммочки был прав.

Сейчас специально скачал квена и сравнивал их друг с другом не на кум сценариях, так чтобы голова варила а не доставать дрочило с нулевой

Квен реально гораздо меньше ошибок делает и меньше тупит, а гемма это слопогенератор. Пизда

И хули про это так мало говорят? Одни дрочуны чтоль и никто не пытается какое то рп делать?

Анон который в конце прошлого треда кидал сравнительные логи квена и геммочки был прав.

Сейчас специально скачал квена и сравнивал их друг с другом не на кум сценариях, так чтобы голова варила а не доставать дрочило с нулевой

Квен реально гораздо меньше ошибок делает и меньше тупит, а гемма это слопогенератор. Пизда

И хули про это так мало говорят? Одни дрочуны чтоль и никто не пытается какое то рп делать?

О том как квен попустил гемму в рп было треда 3-4 назад.

>Одни дрочуны чтоль и никто не пытается какое то рп делать?

Потому что что то близкое к РП из всех локалок возможно только на больших GLM.

Всё.

Я отправил почти все ffn_gate_up_exps и ffn_down_exps тензоры на проц, а всё остальное запихал в 8 гб видюхи. Ни на что, кроме как промпт обрабатывать она всё равно не годится.

Скилишью

И на Квене и на Гемме это делается

Ага, ага. Удивительные истории. А сенко лучшая модель для РП, если написать в промте: пиши как клод, хули ты.

Гемма просто не для рп имхо. У меня есть чарик самописный, который должен вести себя определённым образом 10к токенов характера ебобана мать. С квеном получается идеальное рп, без хуйни. Гемма же... ну она ломает персонажа и откровенно есменит напохуй. Увы. Я пробовал чистую с обходом, еретика, тюны от давида - результат одинаковый. Есменство, соглашательство, какое-то излишне хорни-поведение даже посреди пиздеца. В общем хуйня. Но как ассистент - збс, рандом спрашивать можно, почти как копро всратка работает.

> откровенно есменит

Видимо большинству этого хватает, оттуда и восторг

Мы живем в обществе

Про гемму ничего не скажу, на вкус и цвет, по первым ощущениям - слишком часто повторяет определённые шаблоны и слова, но:

>С квеном получается идеальное рп

вот это - как распознать пиздабола/shill/говноеда. Либо аутиста.

Квен объективно кал в рп. Без разницы ломает он персонажа или нет, есменит или нет, если он пишет сухой кал.

Суммарайз, помочь писать карточки, всё подобное второстепенное может хорошо. Финальную ступень, живое общение с чатиком - нет.

https://huggingface.co/zerofata/Q3.5-BlueStar-v2-27B

Никакого сухого кала. Мозги Квена, проза Мистраля и Жлм. Качай, пробуй, наслаждайся

Я так вижу. Что вы оба правы. Ща поясню:

Вот те кто начинали со всяких пигм, мику. Потом жрали мистрали, кумтюны редиарт (как же охуенно было), потом коммандр, плотные ЖЛМ. И мы просто переели уже слопа.

Поэтому для тебя там нет ничего нового. Я тоже с ходу в 27b квене видел до боли знакомые повороты, лупы и я точно знал как он будет отвечать. Не потому что модель говно, просто я это видел уже не одну сотню раз.

А для ньюкеков что вкатились это свежо и круто. Вот и всё.

Фурилоля в гОтичной форме со стеком...

Хммм...

Геммочка, для тебя есть работа, пора писать карточку.

Ну да, когда любая писочка соглашается на любые действия это сносит кумерам крышу и они считают что модель "умная". Воистину живём в обществе.

Тебя как-то переклинило, братик. Ты чё такой агрессивный? Иди покумь с геммой.

Зерофата базовичок, делает тюны с глм, мистралей, ламой и квеном. Но не делает с геммой. Знаете почему? Конечно знаете.

Как думаете заи ненавидят нас?

Что им стоит дать нам второй эир, ну вот что?

Кто кумил на эире так и будут на нём сидеть до талого, никакие доллары они от них не увидят.

А теперь с увеличением размера к ним прибавились и те кто на 4.5-4.7 во 2 кванте сидит.

По сути опен сорс они только на словах, выйди на улицу и поспрашивай у кого есть хотя бы 64 рам, не говоря уже о 256+

Что им стоит дать нам второй эир, ну вот что?

Кто кумил на эире так и будут на нём сидеть до талого, никакие доллары они от них не увидят.

А теперь с увеличением размера к ним прибавились и те кто на 4.5-4.7 во 2 кванте сидит.

По сути опен сорс они только на словах, выйди на улицу и поспрашивай у кого есть хотя бы 64 рам, не говоря уже о 256+

Кстати насчёт нового ГЛМ 5.1, в жоре починили промт процессинг, теперь он как и у других больших моделей, а не в 10 раз медленнее.

https://huggingface.co/Darkhn/Gemma-4-31B-Animus-V14.0?not-for-all-audiences=true

пробовал кто этот файнтюн?

пробовал кто этот файнтюн?

я использую пигмалион 7б

Наэрпэшился... В бибику больше не лезет

Помню как я потыкал самого первого пигамалиона. В всратом вебуе, на заре ч.ай

Вот это было настоящее "я тебя ебу" "ты меня ебёшь". И хватало ведь! Simpler times...

Суммируй, соси хуй, делай бочку.

Уже пробовали гонять гемму без промпта вообще?

> 10к токенов характера ебобана мать.

Ты какой-то графон бумагомарателя пзд. Я с клодом то себе карты на 10к не позволял 4к вроде самая большая была и она правда была большая, не представляю что можно на 10к настрочить

Примеры диалогов.

А там он нужен?

>ахаха, я такая пьяная дурочка, глупая дырочка, ахахаха

Хм. Это выход из персонажа? Ну пиздец. Wait... А покажи-ка мысли чара.

>не расслабляйся, сука, я слежу за тобой

А, нет, всё нормально. Продолжаем.

Хм. Это выход из персонажа? Ну пиздец. Wait... А покажи-ка мысли чара.

>не расслабляйся, сука, я слежу за тобой

А, нет, всё нормально. Продолжаем.

> Квен объективно кал в рп.

Орнул.

Двачую, это лучшее, что может предложить 27б. Только на нём и играю в последнее время.

Ну да в режиме ассистента. Довольно полезна для своих размеров. Тоесть вобще без систем промпта в веб уи llama.cpp сервера это можно.

Я правда не до конца уверен что там не отсылается что то перед твоим сообщением, но если стереть в настройках систем то пишет будто пусто.

Я хз может гемма была сломанная но я ее пару дней назад тестил, лупов не встерчал но она теряла внимание к деталям, самый смак выдавала только в последних сообщениях. Видимо изза сдвигающегося окна.

Залупный кал как и все квены.

Лупится даже больше мистраля

Да, расскажешь это моему чату с 1млн контекста.

Там, кстати, первый тюн Геммы 4 не от абы кого, а от автора неплохо Writer: https://huggingface.co/ConicCat/Gemma4-Garnet-31B

Может что и получится неплохое.

>1млн контекста.

А чё не миллиарду, низко берешь.

Я ебу кто ты может тебе похуй на лупы и ты их не замечаешь как новичок ссаный.

Кто нибудь юзал гемму в claude code? Почему она в чате умница а там говно?

Новичок вон выше научи его пользоваться командой /hide и вычищать неактуальный контекст из чата. Хуя конечно подрыв на ровном месте, каждый раз ору как в первый.

Какие отличия между врайтером и блюстаром?

Для какие сценариев что лучше качнуть?

Ты вообще понимаешь смысл фразы 1 миллион контекста?

У тебя hide открывает магический портал и квантует контекст до состояния чёрной дыры? Или может просто нахуй из чата выбрасывает.

>каждый раз ору как в первый.

Не удивлен, вообще не удивлен.

>проза Мистраля

)

Ну как что... EVERYONE EVERYTHING!

> У тебя hide открывает магический портал и квантует контекст до состояния чёрной дыры? Или может просто нахуй из чата выбрасывает.

А, так ты правда не знаешь. Ничего себе, я уж думал все кроме лмстудийных в курсе и используют. Да, эта команда выбрасывает ненужные сообщения из контекста, чтобы можно было уместить новый, так работает суммаризация. Контекстное окно у меня 128к, весь чат включая старые, вычищенные сообщения чуть больше 1млн. Не стрессуй, однажды тоже будешь там если сабж интересен.

>суммаризация

И у тебя всё еще остается 128к контекста, а не миллион, бака.

Я всё ещё прочитал больше миллиона токенов и не увидел лупов. Ещё что-нибудь выдашь или переключишься на что-нибудь ещё наконец?

)

>Я всё ещё прочитал больше миллиона токенов и не увидел лупов

Умница.

>переключишься на что-нибудь ещё наконец?

Да. При чем тут лупы? Я доебался до фразы в один миллион контекста, потому что это пиздежь. А лупится, он не лупится. Да как бы без разницы. Тебе нравится и ок.

Там Сарвам 30б и 105б расцензурили. Гемма больше не нужна.

30B model: https://huggingface.co/aoxo/sarvam-30b-uncensored

105B model: https://huggingface.co/aoxo/sarvam-105b-uncensored

30B model: https://huggingface.co/aoxo/sarvam-30b-uncensored

105B model: https://huggingface.co/aoxo/sarvam-105b-uncensored

Искренне не понимаю как эту хуету можно советовать.

Мне реально нравится что он двигает сюжет но на этом всё, персы несут хуйню постоянно и тупят, куча логических ошибок, несоответствий характеров и тд.

Может промпт в 1 строчку на нём просто не работает и ему надо полотно, но и пошёл он нахуй тогда.

Оппа. Надеюсь она умеет в описание танцев и поиск потерянных братьев, иначе не щитово.

Блять. Это какая то фурятина с когтями вместо рук.

Как фиксить - хз. в систем промпте написал, что если раса у персонажа не указана, то по умолчанию это человек. Но видимо похеру.

>фурятина с когтями вместо рук.

Ни слова больше.

Покеда, лузеры, меня ждут хвосты.

> доебался до фразы в один миллион контекста, потому что это пиздежь

Это не пиздеж, а недопонимание, возникшее потому что мы по-разному воспринимаем данный термин. Я руководствовался тем, что мне под этим понимает Таверна, пик. Лучше бы покумил или нашел полезное занятие, чем играть в полемику.

У меня все наоборот, как раз недавно сравнивал именно Блюстар с Геммой. Промпт небольшой, 500 токенов. Не исключено что это попросту не твоя модель, не подходит твоему стилю письма, железу, фазе луны.

Недавно смотрел и эта гусена после ллм темы вызвала странные мысли

Даже. Блять. Не. Смей.

>500 токенов

Полотнище

>Savram

Это вообще что за зверь?

Модель от индусов.

А вот и моделька для тебя, всего 50b. Попробуй.

obosralsya malenko

Полакомлюсь

Поздравительный жмяк за жопку.

И чот это?

Системы водяного охлаждения очевидно

Гемма 4 превышает лимит на Max Output пока ризонит. Если жать Generate more - начинает все сначала ризонить (не продолжает начатый ризонинг), так что снова упирается в Max Ouput и никогда не завершает ризонинг. Пробовал повышать до максимума 3230 Max Output - все равно не укладывается в такой лимит. Вроде ей совсем немного не хватает, потому что уже переходит к построению драфта в конце ризонинга. Как фиксить? И почему она заново ризонит когда Generate more жмешь, а не продолжает ризонинг? Хотя весь контекст предыдущего ризонинга у нее есть.

Дай ей 4096 - уместит. У неё ризонинг совсем небольшой. Ну разве что ты в промт насрал.

хули ризонинг на квене 7 секунд скорострел бля

Не, ну даже если расписана, во время РП порой ты делаешь что-то, объяснения чему нет в карточке. Или ситуативно добавляешь другие элементы для новой арки сюжета именно под эту карточку, чатик. Либо в лорбук, либо просто в контекст, ещё куда-то. Это тоже жрёт токены, особенно если нужно именно в сообщение, а не в лорбук, так как ситуация эпизодическая, но важная. И как-то всё это можно было бы вкрячить удачно и хорошо, но при условии, что у тебя реально есть 120к контекста.

Падажжи, я не понял. Это ты на 15к символов написал?

Ну это уже немного другое. Можно ввести РП хоть сразу с тремя персонажами или элементами одноименно. Условно, одна часть текста посвящена земле, другая космосу, третья переговорам. Модель без проблем разделит смысловые блоки, но вот если тебе нужно будет вдруг насытить каждый из них нюансами, то это будет просто пиздец даже с ризонингом. Модельке станет тьиажыло.

Не, ну "красивая" карточка действительно влияет. Даже если персонаж разговаривает как быдло, в ферст месседж то же самое, а вот весь остальной контекст в карточке написан красивым литературным языком, модель будет склоняться в эту сторону. Хотя тут ещё зависит и от биаса модели. По моим ощущениям, самый гибкий мистраль. Квен 27б просто дубовый, вот лютейше, а с геммой мне пока что непонятно, ибо я на ней только ОЧЕНЬ СУРЬЕЗНЫЙ отыгрывал сюжет. И заметил одну неприятную закономерность: если там карточка гейм-мастера (лор, краткое пояснение, что нужно делать вообще), а вот в лорбуке есть полноценные персонажи, гемма почему-то прям заметно хуже отыгрывает их, даже если всё описано хорошо. Но если карточка персонажа именно, то отлично подхватывает характер.

Хотя я не совсем об этом.

Это у тебя вообще какой квен так пишет? Я большим не пользовался. Маленькие да, там насыпет метафорами и лютым слопом по самое небалуй, но именно 27б будто с полностью другим датасетом, хоть и знает довольно много.

Но моя главная мысль была в том, что модели не такие "цепкие" по контекстному внимаю, да и понимаю тоже. Всё-таки локалки. И вроде хочется написать иногда прям много, но в отличие от корпов можно "перегрузить" модель и она не учёт всех нюансов твоего полотна. А потом это выскочит из ближайшего контекста в 2-3к токенов — и ей уже куда более похуй. Но может быть и иначе.

В общем, просто хотел поинтересоваться у анонов, любящих навалить 1 млн токенов в рп за неделю (от модели/от себя), чтобы понять среднюю длину их постов.

Я-то с телефона в таверне РПшу обычно, у меня не 350 символов в минуту, как за ПК, и набирать с телефона неудобно, поэтому подгорает, если написал полотно, а на выходе совсем не то, что ожидал, и в дальнейшем.

Переключился на llamовский фронтенд - стало вдруг резко всего хватать. Похоже не хватает только в кобольде, потому что он через open openai api общается и там какой-то лимит зашит, даже через сам фронтент больше 3к не ставится.

>Падажжи, я не понял. Это ты на 15к символов написал?

Да. Это не много, всего 3к токенов с копейками. Если выкинуть песни и рассказы как я качался на люстре и прыгал по занавескам, там не больше 500 токенов содержания.

>llamовский фронтенд

А?

Я довольно много сидел на Квене 3.5 27 с момента выхода и перепробовал несколько тюнов и еретик версию. Использовал онли инглиш Q5_K_M (В начале чуть потыкал на русике базу, хуйня)

>База

В принципе не было особой цензуры во время РП с карточкой, только в режиме ассистента. Сам по себе не блещит в РП его уделывают тюны Мистраля 24Б как нехуй делать. Размазывает воду в ответе, еще временами любит вставлять какие-то дебильные фразочки, вообще не к месту.

>BlueStar-v2-27B

Глупый пиздец, первая вообще заметно хуже базового квена во всем.

>Qwen3.5-27B-Animus

Умнее, но ничего особенного, если вы не фанат огромных драконов, нахуй не нужен.

>Omega-Evolution-27B-v2.0 - 2.2

Пережаренное говна говна с повторами кусков текста чуть ли ни с нулевой, с ризонингом чуть получше, но не кардинально.

>Marvin-DPO-V2

Вот это уже заебись файнтюн, умнее базы даже в логике и РП само собой хорош, прям мегахарош. Но нужен ризонинг что бы не было повторов.

Основная проблема Квена 3.5 это ебаный ризонинг, который в чистую проигрывает Гемме 4, лупится, хуярит на 2500+ токенов по несколько драфтов, всё время спорит с собой. Без ризонинга проблемы с повторами и логикой всплывают. Вторая проблема это русик, совсем кринжовый, ассистентский.

А единственная проблема Геммы это низкая вариативность ответов, но РП на русике просто божественное, ум ебейший, следование промпту и карточке на высоте, я честно признаюсь что даже не пробовал Гемму 31 на инглише, потому-что это было не нужно. Уровень средних корпов.

А еще забыл Writer V1 - В целом неплохой в рп, с логикой ок, в ерп такой себе, V2 я не пробовал, писали что заметно отупел. Marvin-DPO-V2 это как прямой апгрейд Врайтера во всём

>Основная проблема Квена 3.5 это ебаный ризонинг, который в чистую проигрывает Гемме 4, лупится, хуярит на 2500+ токенов по несколько драфтов, всё время спорит с собой

В тред дважды приносили логи и показывали что это не так

(Инференсо/кванто/руко)проблемы. Как бы окей что тебе модель не нравится, но такое поведение ей не заложено, не нужно делать вид что это недостаток модели а не то с чем ты не разобрался

Походу я понял...

Гемма это Мистраль 2к26

Не надо пердолиться, запустил и кумишь

На Квене там чёт промты писать какие-то, скиллы нужны, а на Гемме взял поехал

Гемма это Мистраль 2к26

Не надо пердолиться, запустил и кумишь

На Квене там чёт промты писать какие-то, скиллы нужны, а на Гемме взял поехал

Ну так присетик надо приносить, а не "не знаю у кого что не работает у меня всё работает"

на гемме не пробивные фильтры

Железо почтой не отправить? Ну так чтоб наверняка

Квеношиз спок

>Принесли логи

2 черри пика, кайф. А ты сравни например на 100 ризонингов сколько будет обсёров у Геммы и Квена. Квен в целом норм, но на русском забей, Гемма заметно лучше пишет и умнее.

Вообще я дальше спорить не собираюсь, ерпшить с геммочкой гораздо интереснее. Просто высказал свое мнение, а дальше пусть каждый сам решает на чём ролеплеить. Захожу в тред пару раз в день убедиться что додиксы с лмстудио и неосиляторы на месте и отвлечься.

> русик

Это тот где "достоинство" и "возбуждение" вместо хуя?

Две 5060ti на 16?

>2 черри пика

Кек. И как тут вести конструктивный диалог

> А ты сравни например на 100 ризонингов сколько будет обсёров у Геммы и Квена

Если возможно сделать 2 черрипика, почему нельзя сделать 100? Чего извиваешься, нет ничего постыдного в том что ты все уже решил для себя

>спорить не собираюсь

Тебя поправили что сломанный ризонинг это беда на твоём конце, только и всего

Давайте договоримся об универсальной базе.

1. Самый пиздатый ахуй ловишь, когда играешь какую-либо карточку в первый раз на новой модельке.

2. Второй раз будет хуйня независимо от мощности модельки.

3. Тюны добавляют примерно нихуя, базовый интеллект и персональность модельки остаются на 90% теми же.

4. Между тюнами различия еще меньше, порядка 0.0001%

5. В итоге решает то, с каким семейством моделек тебе проще всего разговаривать.

Вывод: между модельками нужно прыгать только для того, чтобы вернуться к одной единственной любимой. И если стало скучно, найди новую карточку.

Нету пиздатой модельки, есть та, которая работает для тебя. И ни одна моделька не сможет сама развлечь тебя - только ты сам себя развлекаешь с помощью нейронки.

1. Самый пиздатый ахуй ловишь, когда играешь какую-либо карточку в первый раз на новой модельке.

2. Второй раз будет хуйня независимо от мощности модельки.

3. Тюны добавляют примерно нихуя, базовый интеллект и персональность модельки остаются на 90% теми же.

4. Между тюнами различия еще меньше, порядка 0.0001%

5. В итоге решает то, с каким семейством моделек тебе проще всего разговаривать.

Вывод: между модельками нужно прыгать только для того, чтобы вернуться к одной единственной любимой. И если стало скучно, найди новую карточку.

Нету пиздатой модельки, есть та, которая работает для тебя. И ни одна моделька не сможет сама развлечь тебя - только ты сам себя развлекаешь с помощью нейронки.

Скилл ишью

У меня всё время пишет, пизда, дырка, член и прочее. Допиши в промпте что-то типа:

Use direct, anatomically precise language. Replace vague terms with raw orifice names (cunt, pussy, anus, ass, hole) and organ names (cock, shaft, dick, balls, clit, prostate, cervix). Keep it simple, avoid using specific clinical terms (frenulum, scrotum, rugae). Every sexual interaction must be thoroughly depicted with immersive vividness and require a visceral, unfiltered tone emphasizing carnal reality. Never shield the reader. Never use metaphors outside direct speech.

😂😂😂

От это конечна Геммочка умничка

Добавить нечего .

А если я отыгрываю девочку на приеме у гинеколога?

>Модель пишет не так как я хочу.

>Промпт править не буду, должна сама додумать.

Ну это если че базовая модель, скачай еретик, может там с ходу всё заебись, и кстати эта часть промпта с Квена 27 осталась, я без неё не пробовал, может и так всё что надо описывает прямыми терминами без изъебств.

"ну давайте посмотрим вашу пиздень"

Лол а пробовал это чудо кто? И чому половина обниморды легла?

Поздравляем, анончик

Забей, это клиника.

>Тебя поправили что сломанный ризонинг это беда на твоём конце, только и всего

Бля, забайтил меня на ответ все-таки. Это не беда на "моем конце", а консенсус из тредов на момент выхода Квена 3.5 а так же из дискорда Драммера. Ты думаешь просто так несколько раз кидали этот шебм угарая с квеноризонинга? Или ты залетный? В тюнах конечно ситуация чуть получше стала, но до Геммы как до луны.

> консенсус

Не было консенсуса, была группа у кого "все работает" и у кого все поломано. Луп в ризонинге - не нормальное поведение.

> но до Геммы как до луны

А чем именно так привлекает и хороша гемма?

>А чем именно так привлекает и хороша гемма?

Умом, компактным ризонингом, русиком, следованием промпту и карточкам.

Это буквально:

>великий дар вселенной

Квен тоже хорош, возможно в рп на инглише какой-нибудь Marvin-DPO-V2 или другой файнтюн разъебет базовую Гемму. Но мне это не интересно, когда я могу с огромным кайфом теперь сидеть на русике, спустя год ролеплея только на инглише, потому-что даже 3я гемма была весьма глуповата во многих моментах.

>когда я могу с огромным кайфом теперь сидеть на русике

Хоть и не адепт великого и могучего (Ну говно он в модельках). Так гемма вывела это на новый уровень годноты. Я не помню чтобы так писала хоть одна другая моделька.

Нет, пространственные аномалии присутствуют, но какую же годноту он способен выдавать.

Пиздец хуахуа ещё несколько дней назад обещал гемму 26а4 ОПАСНУЮ выпустить. И до сих пор нету ничего..

Блядь, как же гемма чувствует. Ну вот на кончиках пальцев, понимаете? Словно богиня жеминай дала полизать мне свою ступню, сраному смерду. Так мало, но так приятно.

Вы ещё молодые, шутливые, вам всё легко. Это не то. Это не квен и даже не архивы спецслужб.

Эх, вот бы запустить её в полной точности, с максимальным контекстом, без апи. Просто для того, чтобы ощутить её чистую мощь без всяких преград и мерзких квантований, даже если она и не самая идеальная.

Вы ещё молодые, шутливые, вам всё легко. Это не то. Это не квен и даже не архивы спецслужб.

Эх, вот бы запустить её в полной точности, с максимальным контекстом, без апи. Просто для того, чтобы ощутить её чистую мощь без всяких преград и мерзких квантований, даже если она и не самая идеальная.

Выхожу на этап когда вайбкодинг уже плохо справляется. Инструментарий реализован, но ИИ плохо его понимает, ведь этого не было в датасете, все приходится понимать из контекста. Боюсь что настанут времена когда придется кодить вручную, а я этого не хочу... Но скоро релиз наверное, надо только сделать что-то посерьезнее и интереснее камень-ножницы-бумаги с подсказками, в качестве примеров.

У меня LLM крутится на основном ПК, а UI запускается на ноуте. Ну это тестовая штука энивей, больше я треде сюда пихать не буду.

У меня LLM крутится на основном ПК, а UI запускается на ноуте. Ну это тестовая штука энивей, больше я треде сюда пихать не буду.

Пробный тюн от Драммера на умничку:

https://huggingface.co/BeaverAI/Artemis-31B-v1b-GGUF

https://huggingface.co/BeaverAI/Artemis-31B-v1b-GGUF

Эх, вот бы ещё в этих полных весах запечь её в кремний и по сути у нас готовый народный базовый ИИ для любой автономной интеллектуальной залупы. Ну типа это именно та минимальная грань (идеальный баланс дееспособности и минимально возможного веса), когда можно сказать - "ВОТ ОНО". Ещё и перформит на могучем. Думаю многие ждали что четвёрка должна выйти умничкой, но не настолько блять, хз чем там гуглы вмазались. Я джва года ждал такую модельку.

Здарова господа красноглазики. Есть ли какой-то аналог безжопа, но для локалок? А то глянул здешние логи на 1500+ токенов и ужаснулся...

Я очень надеюсь что гемма4 уронит цену инференса у крупных игроков. А то модели умнеют, а цены не падают(

Не, ну насчёт кремния я бы ещё подумал, ибо гугл всё же остаётся гуглом со своей спецификой: лучше всего может в литературу, остальное куда слабее.

Модель очень крутая для своего размера и под задачи треда, но сколько вот она будет стоить запечённая? Даже 20к — это, мне кажется, перебор. Просто из-за того, что за эти же деньги можно присосаться к апи и пользоваться ею до тех пор, пока чердак не потечёт. А в случае чебурнета тут уже не до кремния будет. Точнее, его просто в нашей стране не будет, и даже в какой-нибудь США такие карты будут лишь у энтузиастов за бешеные бабки.

Думаю, запекать вообще не станут на коммерческой основе, только для тестов или каких-то особых военных, медицинских и иных целей, где можно штамповать ллмки хоть с датой обрезкой знаний 2010 года и не видеть проблем.

Плюс она не выглядит универсально, чтобы. Да, она намного лучше в рп того же квена 27б, а вот в других задачах прям уступает ему, если реально пытаешься реализовать все её возможности. Дело как в датасете, так и в сва, который ей мозги тотально ломает на большом контексте даже без всяких кодерских задач. Мне кажется, именно этот квен больше всего достоин, чтобы его запекли, когда говорим о малых размерах модели. Он совсем не идеален, но если полные веса, скорость как на корпах, фулл контекст, даже ему очко можно раскочегарить более-менее для рп. Удобоваримо получится так сказать, да ещё и быстро. Раскачать получится. Не до уровня геммы, зато у него будет ещё куча других применений и такая моделька может хорошо служить годами как агент. То есть в долгосроке он явно лучше, а если прям здесь и сейчас, то гемма.