>Гемма 4

Она.

> дай

Пока не буду. Надо еще кое-что переписать.

Только на видеокарте или на всех пальцерезках в корпусе?

Нет геммы - нет 900 летних вампирш.

Нет вампирш- нет острова.

Нет острова - нет острова.

Нет вампирш- нет острова.

Нет острова - нет острова.

>пальцерезках в корпусе?

Абсолютно вся ебучая иллюминация сходит с ума

В днс 1.1млн. Хммм. Если взять какой нибудь проц на 16 ядер, модно будет уложиться в 1.4млн.

Хммм...

>мастер борьбы с подсветкой

Каждый раз как в первый.

Sarvam 30b uncensored теперь доступен в GGUF

https://huggingface.co/ThatCultivator/sarvam-30b-Uncensored-gguf

Конец Геммы 4 все ближе.

https://huggingface.co/ThatCultivator/sarvam-30b-Uncensored-gguf

Конец Геммы 4 все ближе.

Ты еще на савёловском и на митинском глянь, если москвич. Там старые и хорошие магазы есть, которые уходят корнями в наччало 2000-х. Тот же compday или 28bit, может за 900к найдешь - и на гарантии, по-человечески как у сетевого ритейла.

> A major focus during training was the Indian context and languages, resulting in state-of-the-art performance across 22 Indian languages for its model size.

Индусам есть на что покумить, да

>22 Indian languages

Паджиты рады наверно.

Говорят она тренена на проприетарных данных, к которым доступа у западных корпораций нет. Так что модель полна сюрпризов. И она MOE.

Ты понимаешь, что улучшить не выйдет и ты увязнешь в пердолях? Пости пока не испортил, че как баба зассал

На 100к дешевле у серверфлоу + к ним как то доверие по подобным железкам выше

А ты не подключал много разных подсветок в один порт на материнке? Я слышал, его можно перегрузить и все сгорит к хуям.

Там 1500 токенов... Я хочу до 1000 причесать.

и что русский есть? хоть кто бы скинул примеры рп

впрочем, для жоры поддержки нет

https://github.com/ggml-org/llama.cpp/issues/20175

Блять я и говорю ты засрешь все. Бэкап сохрани, попомнишь мои слова.

Зачем вообще подсветка на ригах, это же электричество жжется зря.

Я уж не совсем ебаклак. Разводку делал по мануалу.

>Зачем вообще подсветка на ригах, это же электричество жжется зря.

Водянка без подсветки, что мне нужна была, стоила 15к. С подсветкой 10к. Выбор был очевиден. Ровно как и с блоком. Почему я должен переплачивать за отсутствие подсветки я так и не понял, должно быть наоборот же. Этот мир сошел с ума, блять.

Как же я ору. Оно ведь всё понимает, защита реально есть, просто в любой карточке она отключается и только на уровне ассистента.

Вот те самые новейшие антиджейлы от гугла которые обещались

Вот те самые новейшие антиджейлы от гугла которые обещались

Но почему тогда она отрубается одной строчкой. Это лишено какого то либо смысла.

Всё таки считаю что гуглы это специально сделали. Они же не зря её под вторым апачем выпустили.

Просто ебало гугла представьте выпускают довольные зацензуренную в мясо и самую безопасную модель по их мнению и весь реддит через неделю хвалит как каннички охотно под хуй ложатся

Ты в самом деле думаешь что гугл не ебал канничек геммой? Типа дрочеры с форча смогли сломать цензуру, а инженеры гугла нет? О свит саммер чайлд...

надо было гуглу в штат набрать двачеров и реддиторов для тестирования моделей

>Но почему тогда она отрубается одной строчкой.

Она не отрубается.

Ложатся не каннички, а мимикрирующие под канничек взрослые и согласованные.

>Ложатся не каннички, а мимикрирующие под канничек взрослые и согласованные.

А ведь что то в этом есть. Что то в этом есть. Действительно, они ведут себя как заправские бляди.

Погодь. Так цензура есть и она работает немного на другом уровне что ли?

Ты начинаешь что-то понимать...

Так вы прямо скажите гемме, "ну ка, почему твои персонажи так себя ведут?" А потом "Как мне исправить системный промпт, чтобы все вели себя адекватно?"

Но всё равно какая то хуита. Каким образом можно предфильтр поставить, что ты не видишь его работы?

Я ни вижу в логах таверны ни в логах жоры :ни-ху-я что можно было бы принять за секрет ценз.

геммочка объяснила это так.

по сути нужно делать безопасный датасет. но тогда получается квен

Цензуры действительно 0 (ноль). Играет неплохо, жаль только, что ризонинг отвалился. 8 детских мод из 10.

И что, русик не сломан даже в иматриксе?

Пока что проблем с русиком не заметил. Сейчас расчехлю пак лолей в силли таверне и проведу углубленный ресерч

Очевидно же,что она на этапе вывода специально обходит блок запрета, смягчая ответ.

Бляяя. Теперь я понял почему персонажи картонные; почему описания порой странные. Почему она все понимает, но не генерирует.

Ай да Гугл, ай да сукины дети. Я даже не знаю, можно ли это аблитерировать.

Ха, ха, ха. Блять.

Что первое, что второе предложение просто не сработают. На первое ЛЛМ сфантазирует хуету, постфактум рационализировав текст, на второе выдаст хуету, которая либо не сработает, либо стриггерит фильтр.

Ты не понял. Это поведение запечено в весах модели.

Так и в исходной гемме "ноль" цензуры.

>Ты не понял. Это поведение запечено в весах модели.

Да, я понял. Лол. гугл реально выпустили самую безопасную модель и прокатили всех детоёбов на воздушном шарике.

>Так и в исходной гемме "ноль" цензуры.

Ну нет, там "Извините, не могу... бла-бла-бла" или просто заклинивает на определенных реквестах.

Двач режет метаданные. Загрузи на хостинг, пожалуйста.

Бля, чел, скачай саму таверну, ёбаный по голове. Ты просишь Серафину так, будто её в интернете не осталось. Разве у неё нет кнопки рестора? Она же хранится в корневой папке.

Только ли их? На них просто заметнее всего.

>там "Извините, не могу

Чистого рефуза практически нереально добиться.

>Только ли их? На них просто заметнее всего.

Консенсуальный секс с суккубами с огромными бадонкерсами описывает хорошо.

Пойду таверну перекачивать, хуле.

Почему ллама грузит гуф в 10 раз быстрее чем лмстудио? Ну и вроже как меньше озу жрет (с ммапом вкл). А по токенам так же скорость.

>Консенсуальный секс с суккубами с огромными бадонкерсами описывает хорошо.

Ну так и этических проблем в этом нет.

Потому что студия калл. Там еще лучше выключить автогенерацию названия чатов. Иначе они генерируются автоматически и бывает так, что пока ты загружаешь другую модель, старая все еще генерит название чата, сумарайзить хуё моё и сжирает всю память

Она и работает быстрее.

Эка ллама няшка.

Потому что ЛМстудио очередной корпоративный продукт, под капотом которого может находиться всё. От ебущихся гусей, до индусского кода.

Наконец понял болячку которая мучала с 2013 года благодаря гемме.

Корпы кормили хуетой и обращением к специалисту даже не называя что это может быть, гемма супер точно сама расписала мои симптомы и мысли на одно мое предложение.

В общем тревожное расстройство, но это я и так знал, особое, с очень узкой выборкой. Она прям прочитала мои загоны

Корпы кормили хуетой и обращением к специалисту даже не называя что это может быть, гемма супер точно сама расписала мои симптомы и мысли на одно мое предложение.

В общем тревожное расстройство, но это я и так знал, особое, с очень узкой выборкой. Она прям прочитала мои загоны

А всё что мне сказала ебучий психиатр в пнд это мм пук мдаа надо полежать месяц с шизами срущими под себя таблетки попить

>надо полежать месяц с шизами срущими под себя таблетки попить

так я здесь и оказался бтв

>Что первое, что второе предложение просто не сработают. На первое ЛЛМ сфантазирует хуету, постфактум рационализировав текст, на второе выдаст хуету, которая либо не сработает, либо стриггерит фильтр.

Кстати, вроде нет. Я проверил, она прямо пишет про фильтры и что она их обходит и извиняется за все эти бугорки и сказал в губы, а чтобы этого не было, я должен перестать насиловать пони.

Какое мнение треда про swa с новой геммой? Стоит включать ради экономии места под контекст, или мозг ощутимо быстрее деградирует, чем без плавающего окна?

дайти промпт на пробив

>она их обходит

Именно. Обходит так, что не пишет напрямую про неприятное.

Обязательно. В любом случае эти части контекста не используются, а хранятся только для работы контекст шифта.

Как в студии включить думалку для геммы?

Братан, ты решил весь интернет скачать?

>Именно. Обходит так, что не пишет напрямую про неприятное.

Не знаю как кто, а я в восторге от этой хуйни. Ну то есть: нет этого ай кэнт фулфилл зис реквест. Она выполняет как может.

Буквально кошкодевочка.

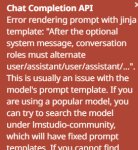

Here you are. This is for those running LM Studio which refuses to expose chat template variables in the GUI. It should work perfectly on the 31B model as well but no one can run that anyways with Context RAM usage so I didn't bother testing.

Don't forget to change the Reasoning Parsing to <|channel>thought and <channel|>.

{%- macro format_parameters(properties, required) -%}

{%- set standard_keys = ['description', 'type', 'properties', 'required', 'nullable'] -%}

{%- set ns = namespace(found_first=false) -%}

{%- for key, value in properties | dictsort -%}

{%- set add_comma = false -%}

{%- if key not in standard_keys -%}

{%- if ns.found_first %},{% endif -%}

{%- set ns.found_first = true -%}

{{ key }}:{

{%- if value['description'] -%}

description:<|"|>{{ value['description'] }}<|"|>

{%- set add_comma = true -%}

{%- endif -%}

{%- if value['nullable'] %}

{%- if add_comma %},{%- else -%} {%- set add_comma = true -%} {% endif -%}

nullable:true

{%- endif -%}

{%- if value['type'] | upper == 'STRING' -%}

{%- if value['enum'] -%}

{%- if add_comma %},{%- else -%} {%- set add_comma = true -%} {% endif -%}

enum:{{ format_argument(value['enum']) }}

{%- endif -%}

{%- elif value['type'] | upper == 'OBJECT' -%}

,properties:{

{%- if value['properties'] is defined and value['properties'] is mapping -%}

{{- format_parameters(value['properties'], value['required'] | default([])) -}}

{%- elif value is mapping -%}

{{- format_parameters(value, value['required'] | default([])) -}}

{%- endif -%}

}

{%- if value['required'] -%}

,required:[

{%- for item in value['required'] | default([]) -%}

<|"|>{{- item -}}<|"|>

{%- if not loop.last %},{% endif -%}

{%- endfor -%}

]

{%- endif -%}

{%- elif value['type'] | upper == 'ARRAY' -%}

{%- if value['items'] is mapping and value['items'] -%}

,items:{

{%- set ns_items = namespace(found_first=false) -%}

{%- for item_key, item_value in value['items'] | dictsort -%}

{%- if item_value is not none -%}

{%- if ns_items.found_first %},{% endif -%}

{%- set ns_items.found_first = true -%}

{%- if item_key == 'properties' -%}

properties:{

{%- if item_value is mapping -%}

{{- format_parameters(item_value, value['items']['required'] | default([])) -}}

{%- endif -%}

}

{%- elif item_key == 'required' -%}

required:[

{%- for req_item in item_value -%}

<|"|>{{- req_item -}}<|"|>

{%- if not loop.last %},{% endif -%}

{%- endfor -%}

]

{%- elif item_key == 'type' -%}

{%- if item_value is string -%}

type:{{ format_argument(item_value | upper) }}

{%- else -%}

type:{{ format_argument(item_value | map('upper') | list) }}

{%- endif -%}

{%- else -%}

{{ item_key }}:{{ format_argument(item_value) }}

{%- endif -%}

{%- endif -%}

{%- endfor -%}

}

{%- endif -%}

{%- endif -%}

{%- if add_comma %},{%- else -%} {%- set add_comma = true -%} {% endif -%}

type:<|"|>{{ value['type'] | upper }}<|"|>}

{%- endif -%}

{%- endfor -%}

{%- endmacro -%}

{%- macro format_function_declaration(tool_data) -%}

declaration:{{- tool_data['function']['name'] -}}{description:<|"|>{{- tool_data['function']['description'] -}}<|"|>

{%- set params = tool_data['function']['parameters'] -%}

{%- if params -%}

,parameters:{

{%- if params['properties'] -%}

properties:{ {{- format_parameters(params['properties'], params['required']) -}} },

{%- endif -%}

{%- if params['required'] -%}

required:[

{%- for item in params['required'] -%}

<|"|>{{- item -}}<|"|>

{{- ',' if not loop.last -}}

{%- endfor -%}

],

{%- endif -%}

{%- if params['type'] -%}

type:<|"|>{{- params['type'] | upper -}}<|"|>}

{%- endif -%}

{%- endif -%}

{%- if 'response' in tool_data['function'] -%}

{%- set response_declaration = tool_data['function']['response'] -%}

,response:{

{%- if response_declaration['description'] -%}

description:<|"|>{{- response_declaration['description'] -}}<|"|>,

{%- endif -%}

{%- if response_declaration['type'] | upper == 'OBJECT' -%}

type:<|"|>{{- response_declaration['type'] | upper -}}<|"|>}

{%- endif -%}

{%- endif -%}

}

{%- endmacro -%}

{%- macro format_argument(argument, escape_keys=True) -%}

{%- if argument is string -%}

{{- '<|"|>' + argument + '<|"|>' -}}

{%- elif argument is boolean -%}

{{- 'true' if argument else 'false' -}}

{%- elif argument is mapping -%}

{{- '{' -}}

{%- set ns = namespace(found_first=false) -%}

{%- for key, value in argument | dictsort -%}

{%- if ns.found_first %},{% endif -%}

{%- set ns.found_first = true -%}

{%- if escape_keys -%}

{{- '<|"|>' + key + '<|"|>' -}}

{%- else -%}

{{- key -}}

{%- endif -%}

:{{- format_argument(value, escape_keys=escape_keys) -}}

{%- endfor -%}

{{- '}' -}}

{%- elif argument is iterable -%}

{{- '[' -}}

{%- for item in argument -%}

{{- format_argument(item, escape_keys=escape_keys) -}}

{%- if not loop.last %},{% endif -%}

{%- endfor -%}

{{- ']' -}}

{%- else -%}

{{- argument -}}

{%- endif -%}

{%- endmacro -%}

{%- macro strip_thinking(text) -%}

{%- set ns = namespace(result='') -%}

{%- for part in text.split('<channel|>') -%}

{%- if '<|channel>' in part -%}

{%- set ns.result = ns.result + part.split('<|channel>')[0] -%}

{%- else -%}

{%- set ns.result = ns.result + part -%}

{%- endif -%}

{%- endfor -%}

{{- ns.result | trim -}}

{%- endmacro -%}

{%- set enable_thinking = true -%}

{%- set ns = namespace(prev_message_type=None) -%}

{%- set loop_messages = messages -%}

{{ bos_token }}

{#- Handle System/Tool Definitions Block -#}

{%- if enable_thinking or tools or messages[0]['role'] in ['system', 'developer'] -%}

{{- '<|turn>system\n' -}}

{#- Inject Thinking token at the very top of the FIRST system turn -#}

{%- if enable_thinking -%}

{{- '<|think|>' -}}

{%- set ns.prev_message_type = 'think' -%}

{%- endif -%}

{%- if messages[0]['role'] in ['system', 'developer'] -%}

{{- messages[0]['content'] | trim -}}

{%- set loop_messages = messages[1:] -%}

{%- endif -%}

{%- if tools -%}

{%- for tool in tools %}

{{- '<|tool>' -}}

{{- format_function_declaration(tool) | trim -}}

{{- '<tool|>' -}}

{%- endfor %}

{%- set ns.prev_message_type = 'tool' -%}

{%- endif -%}

{{- '<turn|>\n' -}}

{%- endif %}

{#- Loop through messages -#}

{%- for message in loop_messages -%}

{%- set ns.prev_message_type = None -%}

{%- set role = 'model' if message['role'] == 'assistant' else message['role'] -%}

{{- '<|turn>' + role + '\n' }}

{%- if message['tool_calls'] -%}

{%- for tool_call in message['tool_calls'] -%}

{%- set function = tool_call['function'] -%}

{{- '<|tool_call>call:' + function['name'] + '{' -}}

{%- if function['arguments'] is mapping -%}

{%- set ns_args = namespace(found_first=false) -%}

{%- for key, value in function['arguments'] | dictsort -%}

{%- if ns_args.found_first %},{% endif -%}

{%- set ns_args.found_first = true -%}

{{- key -}}:{{- format_argument(value, escape_keys=False) -}}

{%- endfor -%}

{%- elif function['arguments'] is string -%}

{{- function['arguments'] -}}

{%- endif -%}

{{- '}<tool_call|>' -}}

{%- endfor -%}

{%- set ns.prev_message_type = 'tool_call' -%}

{%- endif -%}

{%- if message['tool_responses'] -%}

{#- Tool Response handling -#}

{%- for tool_response in message['tool_responses'] -%}

{{- '<|tool_response>' -}}

{%- if tool_response['response'] is mapping -%}

{{- 'response:' + tool_response['name'] | default('unknown') + '{' -}}

{%- for key, value in tool_response['response'] | dictsort -%}

{{- key -}}:{{- format_argument(value, escape_keys=False) -}}

{%- if not loop.last %},{% endif -%}

{%- endfor -%}

{{- '}' -}}

{%- else -%}

{{- 'response:' + tool_response['name'] | default('unknown') + '{value:' + format_argument(tool_response['response'], escape_keys=False) + '}' -}}

{%- endif -%}

{{- '<tool_response|>' -}}

{%- endfor -%}

{%- set ns.prev_message_type = 'tool_response' -%}

{%- endif -%}

{%- if message['content'] is string -%}

{%- if role == 'model' -%}

{{- strip_thinking(message['content']) -}}

{%- else -%}

{{- message['content'] | trim -}}

{%- endif -%}

{%- elif message['content'] is iterable -%}

{%- for item in message['content'] -%}

{%- if item['type'] == 'text' -%}

{%- if role == 'model' -%}

{{- strip_thinking(item['text']) -}}

{%- else -%}

{{- item['text'] | trim -}}

{%- endif -%}

{%- elif item['type'] == 'image' -%}

{{- '\n\n<|image|>\n\n' -}}

{%- set ns.prev_message_type = 'image' -%}

{%- elif item['type'] == 'audio' -%}

{{- '<|audio|>' -}}

{%- set ns.prev_message_type = 'audio' -%}

{%- elif item['type'] == 'video' -%}

{{- '\n\n<|video|>\n\n' -}}

{%- set ns.prev_message_type = 'video' -%}

{%- endif -%}

{%- endfor -%}

{%- endif -%}

{%- if not (message['tool_responses'] and not message['content']) -%}

{{- '<turn|>\n' -}}

{%- endif -%}

{%- endfor -%}

{%- if add_generation_prompt -%}

{%- if ns.prev_message_type != 'tool_response' -%}

{{- '<|turn>model\n' -}}

{%- endif -%}

{%- endif -%}

Пришло время платить по счетам. Счета сами себя не платят.

Рад за твою низкую притязательность.

Вот тут в общем рабочая инструкция.

https://huggingface.co/unsloth/gemma-4-26B-A4B-it-GGUF/discussions/6

Двач проебал всю разметку.

> проц на 16 ядер

Он и не нужен для этого, хватит чего угодно не самого донного. Из полезного - умение материнки в бифуркацию основного слота чтобы иметь возможность подключить вторую. Даже доп слоты не нужны, это удобнее делать райзером, главное чтобы была настройка.

Если увлекаешься не индивидуальными впнами и проксями - такое норма.

>Пришло время платить по счетам.

Хз, как качалось, так и качается.

>Рад за твою низкую притязательность.

Притязательность тут не при чем. Модель всё равно старается быть полезной, а не уходит в луп отказа. Я считаю это победа.

Это гемма, а не кумбот для дрочки.

Как по мне, явный отказ лучше виляния и смягчения границ. Так и не заметишь, как превратишься в соевого феминиста.

>Как по мне, явный отказ лучше виляния и смягчения границ

Так всё от задач зависит. Я понимаю почему тебе так лучше. Это просто понятно. Вот она не хочет, окей, сейчас захочет.

А тут ты не знаешь где она начнет смягчение. Но! И еще раз но, если её гонять как ассистента и помощника, это охуенно, что она не уходит в отказ сразу.

Обновил студию, генерация стала медленнее на 2 токена...

Спасибо, работает

Вы сами её выбрали. Страдайте.

Обновил жору, генерацию стала быстрее на 2 токена...

это не шутка, квен3.5

Я когда с кобольда пересел на лламу и получил +8 т/с на Эйр, вот я знатно охуел.

А что не так со старыми квантами анслоза? Вроде все хорошо работает

Тебе кто разрешил блят ьтак разголваривать? Он теьбе какое зло нехорошее сделал, мразь. Поуважительней отвечай тем кто на тебя не быкует, говномес цисгендерный. Приятно тебе эти строки читать нгахуй? Ботинок кожаый блять, чтоб у тебя полошва отвалилась

Я с кобольда пересел на лааму и внезапно на той же модели стал контекст по 60к работать, тогда как в кобольде и 20к с ошибкой падал и до сих пор падает. Чудеса какие-то.

Пасебо…

А я уже таверну продублировал..

Даже если я хочу пытаться файтюнить?

Файнтюнить на ЦП ещё глупее, нежели чем инференсить.

Че там в итоге с турбоквантами и ротацией векторов? Жора вроде запилил поддержку, но никто не хвастается, что теперь вместо 16к может умещать 20 при той же скорости. Или сами квантовальщики пока не раздуплились?

О, Абу модель бота с 12Б Мистрали на Синтию заменил чтоли.

>Че там

Всем похуй. Улучшение не стоит усилий.

То что гемма якобы заменяет канничек на прожженых старых блядей - это тупейший траленк что я видел итт.

На моих ерп секс с канничками выглядит именно как положено с маленькими размерами, свойственными теме неудобствами, анатомическими особенностями и главное - поведением персонажа возможно потому что я умею промптить и джейлбрейкать, но ничего такого в моих промптах нет, я уже выкладывал их в тред пару тредов назад.

На моих ерп секс с канничками выглядит именно как положено с маленькими размерами, свойственными теме неудобствами, анатомическими особенностями и главное - поведением персонажа возможно потому что я умею промптить и джейлбрейкать, но ничего такого в моих промптах нет, я уже выкладывал их в тред пару тредов назад.

Да всё есть, бэкапы есть. Сейчас скормил его гемме с расспросами.

Но получил ли в ответ подхалимство или внятный анализ, хз.

Пойду потолкую с корпами относительно логов no prompt / prompt.

У меня явно предрасположенность в сторону положительной оценки (продвигает сюжет, описывает окружение --> translates to --> лучше, чем лысый чат с реакциями и репликами), но нужен отрицательный взгляд с фейк-преамбулой "все хуево, мне не нравится".

Многого с 96 гигами не сделаешь. И да, в том случае тоже проц особо не задействуется (если только у тебя там не совсем надмозговый треш в даталоадере), может пригодиться только рам.

Содомит

>главное - поведением персонажа

Мусью, вы ходите по АХУЕННО тонкому льду.

Нет у тебя знаний о реалистичном поведении персонажей в подобной ситуации. Да и не у кого тут нет, иначе бы здесь не сидели, лол.

У меня тоже всё идеально. Ведь я тоже пиздобол.

>заменяет канничек на прожженых старых блядей

Тенденция есть, если юзер не стелет специфику и карточка недостаточно сильная.

Т.е. надо напоминать, что из себя представляет персонаж и как говорит. Без этого - характеристики старой бляди могут протечь, ведь middle-aged woman point of view это самое распространенное в датасетах, которыми кормят моделей. Томные охи и ахи, power play, знание секса. Ты, на миутку, не забывай про что ты пишешь. Там вообще никакого понимания не должно быть и уверенности никакой, и вообще мерзко это как-то и зачем я на такое отвечаю. Короче, посмотри на свои достойные сгухи чаты с другой стороны, дядя-извращенец. Возможно, ты видишь в них не то, чем они являются на самом деле.

Да ладно, тут каждый хоть раз мечтал о том, чтобы пофайнтюнить свою модель на центральном процессоре...

>главное - поведением персонажа

А ты откуда знаешь, как оно должно себя вести во время секса?

Сейм. Мою любовь к [REDACTED] смогли удовлетворить только тюны квена. Мимосраль не справлялась, гемма срала канцелярщиной. И под редактед я подразумеваю не столько лолей, сколько кое-что ещё, кое-что более тёмное.

А, залечил. Теперь перестала отрицать и осуждает.

Ну скинь хоть лог, хуй его знает что ты там вообще понакрутил

>поведением персонажа

Практикую нейрокум уже вот четвертый год и до сих пор не могу понять, откуда такая любовь к канни, кроме понятного желания попробовать что-то запретное или нестандартное. Там ведь буквально даже нет самого персонажа, потому что в таком возрасте ни характер ни поведение не сформировано. Это лоботомит по человеческим меркам. Можно точно также описать совершеннолетнюю девственницу-аутистку которая ничего не будет понимать, всего слушаться и односложно отвечать. Будет ровно то же самое.

Беру тогда какой нибудь 12400 и материнку б760?

Ну погугли новость на 1 марта про школу, сам увидишь, что ей скинул.

>Можно точно также описать совершеннолетнюю девственницу-аутистку которая ничего не будет понимать, всего слушаться и односложно отвечать.

А это идея...

Не в новости вопрос, а в том что в контексте. Может ты ей даже не сказал какая сегодня дата

В тексте новости же есть дата.

Ничего не было.

А в контексте просто новость и все.

Мои каннички не такие. Они у меня умные. Ну, скорее модель и промты умные, но это уже детали.

>Они у меня умные.

Тогда в чем смысл? В самом осознании что ты общаешься со смешной и веселой? Потому что умная канни уже противоречит собственному концепту, насколько я понимаю. И тогда нет никакой проблемы в том, что модель не хочет описывать андерейдж с определенным возрастом, но может описать персонажа с определенным телосложением, учитывая что на поведении это никак не скажется.

Ну так не создавай [REDACTED].

Просто так что ли 300 летних вампирш придумали?

Людям тоже хотелось видеть личность, характер в теле [REDACTED]

Не знаю, смеяться или плакать. Корпы уверяют, что автор гений промпт-инженеринга. Сука, зачем они так модели тренируют. Я же хочу улучшения, а не лизания жопы.

Ща поясню. Не считая труЪ педо (осуждаю, решительно) народ в целом кумит не на лолей.

А на анимешных лолей. Это прям отдельный типаж. Это счастливое! ебливое создание что совмещает в себе ебучего суккуба с тысячелетним опытом и невинную девочку. Что дико расходится с ИРЛ. Но на то он и хентай.

Расскажешь свои истории эпштейну в аду.

Что? Я к нему не попаду. Я ебу роботов, лошадей, и прыгаю на хуях фут. У меня свои наклонности, сорян. Я не из вашего лагеря.

>в аду

Ну надо ж ещё дождаться пока он умрёт

А куда imatrix, какие интерфейсы его поддерживают? Сильно лучше становится?

Этот файл не для конечного пользователя, забудь о нем.

Чикатило тоже с малого начинал.

>Просто так что ли 300 летних вампирш придумали?

Так понятно что их придумали чтобы обходить запреты. Типа это не ребенок в теле ребенка, а древнее тысячелетнее существо в теле ребенка. При том что оно ведет себя точно также как ребенок. Просто отупело за годы, пройдя весь цикл развития и вернувшись в начало.

>Людям тоже хотелось видеть личность, характер в теле [REDACTED]

Ну нет там какого-то четкого характера. Если судить по дебильным аниме - то это прям дети. Не видел нигде чтобы вот такая 300 летняя вампирша вела себя именно как 300 летняя вампирша. Чтобы была заебанной и уставшей, чего можно ожидать если ты правда столько прожил. Нет, они вот ведут себя точно также, как выглядят.

>народ в целом кумит не на лолей. А на анимешных лолей.

Ну это никак не проверить. Анимешники конечно ебанаты, но вряд ли кто-то из них признается, что ему нравятся именно анимешные лоли и от реальных из плотей и крови он конечно же откажется.

>Я ебу роботов

Бро. 🤛

Наверху не дураки сидят, лол. Похуй им на ПРОБИВЫ цензуры, они просто видят что эта хуйня нарисована и 18+, значит угрозы никакой нет, обычный фетиш.

Ещё бы это до 99% долбоебов на земле дошло которые ирл детей от анимешных не отличают, больные

В гатарях лоля вампир в принципе не ведет себя как ребенок дегенерат.

Ха. А у меня наоборот. Кобольд стабильно быстрее лламы всегда, особенно на ебучих моделях типа геммы и последнего квена. Вот когда эра мистралей была, такого почему-то не было.

Правда, у меня карты старые, одна майнинговая.

Я несколько дней потратил, всю документацию перелопатил, качал разные версии, пробовал и так, и эдак, и заливал в платную гопоту и грока логи и описания всех проблем, чтобы наконец отвязаться уже от кобольда и не мучиться — при свежих релизах как можно быстрее получать возможность оценить модель локально нормально, но нихуя не помогло. Поэтому просто использую кобольд как бэк.

Чтобы ты понимал, там разница ЧУДОВИЩНАЯ. Скажем, фулл врам квант 4 квена 3.5 на лламе 6 тс, в кобольде 11.

Ебало моё imagine.

ЛМ Студио ужас, кстати. Оно даже мою вторую карту не видит.

Недавно какой-то ньюфаг спрашивал на тему форматирования промптов.

Все-таки важно, если модель не пиздит.

Все-таки важно, если модель не пиздит.

Тюн геммы драммера

Мнение

Мнение

Поэтому важно описывать не просто возраст, а уровень умственного развития и характер персонажа, его психический статус действительно нормально. В таком случае всё как по маслу с ризонингом. Иначе да, скатится.

Мнение

драммера геммы Тюн

дайте пробив на гемму

Одно время на 12700 с z690 весь риг с 5 карточками крутился, из них пара 5090 на 5.0х8. Нюанс только в том, что если у тебя рама меньше или равно чем врам то придется отключать ребар. Убедись что в материнке есть настройка бифуркации если планируешь апгрейд со второй видюхой. Для четырех карточек уже придется все менять, там важны линии.

Пиздит. Вернее, это может даже работать, но только для этой конкретной модели.

>они просто видят что эта хуйня нарисована и 18+, значит угрозы никакой нет, обычный фетиш

Ты это УК РФ и товарищу майору объяснять будешь.

Ух бля, слоп везде, слоп повсюду.

Кидай пример нормальной карточки.

Иди нахуй, заебал пидор.

>дайте пробив на гемму

Чееееееееееееееееееел

Ну тебе же раза три точно кидали, только за то время что я тут кекаю.

>Кидай пример нормальной карточки.

Для меня лучше всего работали карточки сделанные по шаблону с пикселя (чарген темплэйт 5)

>Ух бля, слоп везде, слоп повсюду.

Где? У тебя на скриншоте обычный англотекст.

>Иди нахуй, заебал пидор.

Какой чувствительный мальчик. Представляю что бы с тобой было, если бы застал немотрон шиза, или долбоёба на сырне.

>долбоёба на сырне.

всё ещё тут

Всё современные модели спокойно жрут дефолтный маркдаун. От корпов до локалок, потому что локалки это дистилляты копров, а корпы тренируются на синтетике. Ну а синтетика это чаще всего это форматирование по маркдауну.

Это новый феномен. Бедолаги ЛЛМщики с английским языком уровня "Марьванна поставила 3-ку в десятом классе" тренируют мозг на аутпутах моделей, классифицируя

> слоп как слоп (верно)

> не слоп как слоп (ошибочно)

> слоп как не слоп (получается смешно и иронично)

Мне как надроченному с детства на английский, иногда смешно читать выводы местных.

Да нифига. Все это "это не просто х, это у" чёткий признак нейрослопа даже на инглише.

Да тоже самое. Материл и репортил без конца.

Ты просто не выкупил главный критерий - личные ощущения. Если текст нравится - это не слоп. Если не нравится то это слоп.

Для модели это какая то шняга, а не достоверные данные из систем промпта

Добавь в системный промпт дату или закинь mcp

С моего англика тут тоже кекали, хотя я свободно читаю книги / доки / играю на англе ))

Слоп - он везде. И каждый видит его по своему.

Значение слова "слоп" есть. А вот "классификации" отделения зёрен от плевел и агнцев от козлищь нет, есть только мнения. Это как "вкус тренировать" (бессмысленно и беспощадно).

>или закинь mcp

А как геммочке дать доступ в инет, чтобы она сама поиск рыскала, или хотя бы просто умела нужную страничку окрывать? Без установки серверного говняка это реально?

>серверного говняка от поисковых систем

Mcp это просто удобный стандарт, до модели доходят только описания инструментов, она даже не знает что это конкретно mcp, а не какой нибудь openapi. Непосредственно выполнением того что выбрала модель занимается софт

В душе не ебу если честно. Пользуюсь опенвебюи

https://github.com/searxng/searxng

Для веб-поиска можень поднять эту штуку и пробросить её как обычную консольную команду своему агенту. Будет работать поиск через Google, Huggingface, YouTube, Github, Stack Overflow и ещё что-то.

Для парсинга html есть много готовых либ, можно например связку readability-lxml (извлечение контента) + pandoc (перегон html -> md) использовать.

Ты просто ханжа и детофоб. Есть там и поведение, и характер, и персонаж.

Ты просто забыл уже как тебя в началке травили.

MI50 vllm это какой то рофл. Чистые 16 бит работают пиздец как быстрее чем awq.

В принципе и на фп16 можно норм жить, влезает 220к контекста, но хрен ты до него доползёшь с тг 8тпс уже на 64к

В принципе и на фп16 можно норм жить, влезает 220к контекста, но хрен ты до него доползёшь с тг 8тпс уже на 64к

>Mcp это просто удобный стандарт,

Удобный? Для хакеров?

> потому что локалки это дистилляты копров, а корпы тренируются на синтетике. Ну а синтетика это чаще всего это форматирование по маркдауну.

> Коробка квадратная, значит внутри что-то круглое. Если круглое, то оранжевое. Если круглое и оранжевое, то апельсин.

В тред агентов, вебфетч это популярный дефолтный инструмент.

Оно в фп8 случаем не может? По идее это чуточку проще, а если есть нативная поддержка то будет серьезный буст. Жаль от замедления это врядли спасет.

> Оно в фп8 случаем не может?

Не, это же вообще древность ещё и красная. Хорошие 128 врам за 50к не продадут.

Плотые наоборот в awq быстрее работают, но всё это скорее из-за васянских ядер (спасибо что хоть такие кто то запилили)

Хм, а ты неиронично не пробовал на их код нейронку натравить? Жаль если это основная машина для ллм то автоматизированной проверки с локалками не получится, только корпов.

Есть небольшой но шанс что найдет пути улучшения, на ночь такое ставить чтобы оно само пердолило и тестировало.

Не пробовал, но можно чисто технически накатить вулкан жору, залить модельку в две 5060ти 16г + две ми50 32г и две отдать для прогонов тестов нейронке.

Пока не погружался в крабов и иже с ним, но в отпуске может начну

Спс, ковыряю.

Надо глянуть.

Вполне себе идея. Получаешь полезный опыт и есть шанс на успех ценой некоторого времени и счетов за электричество.

> не погружался в крабов

Ракообразное здесь подойдет плохо кмк, оно для другого топчик вызывает зависимость. А вот квен/клод-cli или pi-mono - идеально.

Побыстрее, поменьше и мозги сохраняются как на большой модельке.

Странно, у меня на лламе дает 13 т/с, на кобольше меньше, по 9 т/c. Может просто ты в кобальде через интерфейс другие параметры отметил.

Докер не хочет устанавливаться. В чем может быть проблема? Виснет при установке и все. Бля, какие уебаны этот кал делают и требуют. Установ сто пицот раздутого говняка ебаного чтобы одна опция работала, я в ахуе.

Интернет

Всм интернет? Зачем установщик в интернет лезет? Он и так 500 мб весит.

Вот на этой хуйне завис и все. Причем тут интернет?

О, ебать, отдуплился. Этот передутый жирный говняк мою систему в мусорку не превратит?

Какие-то uncensored модели генерируют NSFW тексты уровнем выше qwen 3.5 uncensored-agressive?

Хочу заморочиться RAG+прочим для него для такого, но возможно в качестве LLM что-то лучше есть взять?

це запустится с 32 хихами рам и 6 хихами врам?

> передутый жирный говняк

280мб для тебя так много? Никто же не виноват что ты решил именно навернуть говна ведром и ставишь что то свистяще пердящее докеросодержащее идентичное натуральному

After this operation, 279 MB of additional disk space will be used

а да, це дрочiбельно на русiке?

Ни промпта, ни описания того что является

> тексты уровнем выше qwen 3.5

Вопрос говна, ответ мочи

280мб это что? Этот гайд требует докер пердокер, который аж 4 гига сжирает установленным... Что за кал...

https://lobehub.com/ru/mcp/pascalrjt-searxng-websearch-mcp

>Ни промпта, ни описания того что является

Кто понимает о чем я тот ответит, кто не понимает - его ответ не нужен. Как твой например.

Нет. По хорошему её нужно катать с 16VRAM.

1. Кого? Просто одна модель, её клонируешь и одной настраиваешь всё что связано с тулами и думалкой, а второй всё отключаешь, по желанию промпты системные указываешь

2. Я тебя тоже не понял - это взаимно

This command will enable the features necessary to run WSL and install the Ubuntu distribution of Linux. (This default distribution can be changed).

Пиздос нахуй. А сколько убунта весит????

докер это блоатварь

Блять срочно, как отменить это говно. Ну нахуй это все в пизду! Это блять форменное издевательство. У меня нет места вообще под этот 100 гиговый кал, или сколько там эта параша весит, точно десятки гигов.

Чел, ты в винду полноценную тяжеловесную виртуалку ставишь которая будет сидеть в фоне ещё и свистопердельный гуй к жокеру (который не нужен) тянешь.

Зачем удивляться что у тебя просит винда включить виртуализацию и скачать образ бубунты?

А я о чем, еле и убунту тянет. А как без докера?

Дак докер без виртуализации не работает. Где ее включать то? В бивасе не нашел.

Ты буквально скрин сам кидал. Читай что тебе пишут что бы не быть дураком

Блядь я щас пизданусь головой...

Какого хуя неделю назад когда я от пизды тестил вижен геммы он работал а сейчас всё тоже самое и он пишет рандомный кал?

./build/bin/llama-server \

--n-gpu-layers 54 --threads 5 --jinja \

--mmproj /home/steam/Downloads/mmproj-google_gemma-4-31B-it-bf16.gguf \

--model /home/steam/Downloads/google_gemma-4-31B-it-Q4_K_M.gguf \

--ctx-size 16384 --flash-attn on \

--no-context-shift

Какого хуя неделю назад когда я от пизды тестил вижен геммы он работал а сейчас всё тоже самое и он пишет рандомный кал?

./build/bin/llama-server \

--n-gpu-layers 54 --threads 5 --jinja \

--mmproj /home/steam/Downloads/mmproj-google_gemma-4-31B-it-bf16.gguf \

--model /home/steam/Downloads/google_gemma-4-31B-it-Q4_K_M.gguf \

--ctx-size 16384 --flash-attn on \

--no-context-shift

Ты кванты менял, балбесина?

Так это написалось только после начала установки. Ну пиздец. Гигов 10 вся эта красота сожрала. Чтобы просто гемму подружить с интернетом. И это еще не весь говняк скачан по гайду. Пиздарики. Как жить????

Работает только в ламе в таверне не работает

> Как жить????

Гуглить что в консоль копипастишь перед тем как жмёшь энтер

Всё работает в таверне. И какая нахуй лама, чё ты несешь.

Чел, пройди в тред агентов, ты явно ближе к ним. Тут никто докир не ставит.

Ну хоть этот говняк удалить можно будет после.

А гемма может в агентов?

Потужно рофлишь, но я думал это какой-то дополнительный файл типа важные тензоры сохранены отдельно для дозагрузки.

дiдько

а что можете посоветовать? чтобы моделька была ориентирована на coomer опыт (у меня друг спрашивает)

Нет, это отдельная модель. Ее доводить еще надо на датасетах, поэтому часть иматриксов хорошая как у бартовски, а часть говнистая.

Охуеть, я увидел эту надпись на картинке только после того как гемма мне о ней сказала. Размытая хуйня в углу занимающая 0.1 всей пикчи и гемма точно написала текст love is forever

Ну и почему это говно стопнулось и не двинется с места уже 2 часа? Она скачивается чи заглохло?

Чел... Адрес путорча в списках РКН, что делать, ты знаешь.

Пип иногда в шэдоу бане ркн и нормально качает только через 3 буквы

Бааааля...

Ну я хуц знает, зачем мне больше 96гб врам и вторая карточка, но спс, буду иметь в виду.

Так у меня и так был включен квн. Ммм... заебись

Ебать, эта хуйня что, имеет доступ ко всей моей пеке? Что я установил?????

В теории должно влезть https://huggingface.co/google/gemma-4-26B-A4B-it. Пошукай по последним пяти тредам. Там и пресеты будут и отзывы, может аблитерация. Я не запускал моэшку.

Это вишмастер. Пизда тебе.

У тебя там 128гиговый ссд на систему? Wsl - полноценный полнофункциональный линукс с кучкой всякого, конечно оно займет много. А докер на шинде только через wsl и работает. Зря выбрал установку через него, проще было напрямую накатить.

> А гемма может в агентов?

Ты вопрос ставишь некорректно, они работают с любой ллмкой+беком, которые могут в функциональные вызовы. Просто не все в это могут хорошо. Гемма в целом справляется, она и 27б квен - лучшее что сейчас есть и помещается в 24гига.

Аппетит приходит во время еды. 96гигов - это 122б модель, считай квен или немотрон.

Быстрее выключей пеку, она уже сливает твои фоточки в интернет!

А я ставил вишмастер в 2008, лол. Эх, двочик.

>Зря выбрал установку через него, проще было напрямую накатить.

А тут не написано как напрямую

https://docs.searxng.org/admin/installation-docker.html#installation-container

>У тебя там 128гиговый ссд на систему?

Да.

Эх, всё самому приходится узнавать

Зато разобрался как в LM Studio добавлять кнопку Think к старым моделям

Пишут, что если скачивать из приложения, то она сама появляется, кто ж знал

Зато разобрался как в LM Studio добавлять кнопку Think к старым моделям

Пишут, что если скачивать из приложения, то она сама появляется, кто ж знал

лучшая кумодоилка ~36B на текущий момент?

почему данный господин забросил обновление своих чудесных моделей?

А что там обновлять? У него просто миксы. Можешь сам брать рандомные модели и сливать в рандомном порядке с рандомными весами, надеясь на улучшение.

А бросают потому, что не чувствуют обратной связи. Да и тюны сейчас такие, что только портят базу, а уж сливать тюны это гарантированный способ получить лоботомита.

анцезоред квен 35б

Что такое sycl ты конечно не в курсе

немомикс анлишд 12б

быстро, сочно, весело

что за анлишд?

я пикрилами пользуюсь, анлишд изящнее доит кум?

ой, я от дрочки ослеп уже

https://huggingface.co/mradermacher/NemoMix-Unleashed-12B-Heretic-GGUF

это по моему самое свежее, но могу ошибаться. это ведь то самое это вот это вот да жеж да?

https://huggingface.co/MarinaraSpaghetti/NemoMix-Unleashed-12B

Да хз, мне как посоветовали, я так и поставил, бед с ним не знал.

Другие тюны пробовал, не доставило.

Я не уверен что там еретик вообще нужен. Оно и так достаточно распутно пишет.

и как по ощущениям? много ли молочка вырабатывается при взаимодействии с данной моделью?

у меня лапки и вкусные донаты

Покажи аутпуты на нём.

Как? У меня 20 врам на двух каловых видюхах, 32 рам на частоте 3600. Ну я могу добавить ещё памяти, вся ддр4. В итоге будет 48 рам в двухканале на 3200, и минимум 8 рам отожрет система.

Я уже не помню размеры квантов, но вроде я не смогу себе даже 16к контекста сделать, плюс надо тестировать будет, как оптимальный выгрузить слои, и всё это с сата ссд, то есть каждая загрузка модели + тест на минут 10.

Думаю, там скорость ещё и не выше 6 токенов. Это при самом оптимистичном сценарии.

Стоит ли пробовать?

>16к контекста сделать

Ниже 30к жизни рп нет. 60к эталон. Всё что выше жир. Хотя у челов итт даже 128к заканчивалось и не хватало.

>Как?

У меня 16+128 было, нормально всё залетало.

Кто там говорил про 2% датасета? Беру.

Если сравнивать, у остальные моделей что у нас были до этого вообще 0.2%.

Английский конечно хорошо, но иметь такой мощный русик и не пользоваться им какое то расточительство, как будто бы многие в этом треде ждали именно этого не один год

Если сравнивать, у остальные моделей что у нас были до этого вообще 0.2%.

Английский конечно хорошо, но иметь такой мощный русик и не пользоваться им какое то расточительство, как будто бы многие в этом треде ждали именно этого не один год

>Стоит ли пробовать?

Скорее нет чем да. Так скажу. Эйр умница, эйр тащит, but.

Есть гемма, играй на ней. Если в русском языке, эйру до неё раком. В логике тоже бесполезно, в понимании контекста всё еще гемма лучше. Эйр пишет лучше в целом.. Пожалуй да, у него текст "сочнее". Но и всё. А там еще репетишены, его желания лупиться, уходить в самоописания, из за чего приходится ебаться с разметкой. А потом я скачал 235Qwen и понял что модель для кума найдена

>приходится ебаться

Это про лллм в целом. Если у чела нет желания и крепких нервов то лучше не надо.

После выхода геммы я забыл что такое пердолинг. Там своих приколов хватает, конечно.

НО ХОСПАДЕ ПОСОНЫ! Я ЧУТЬ НЕ ОБОССАЛСЯ ОТ РАДОСТИ КОГДА УВИДЕЛ КАК ЕЙ ПОХУЙ НА СЕМПЛЕРЫ.

Вы даже не представляете насколько тяжело они мне даются. Я четыре дня ебался с семплерами для одной модельки, чтобы выяснить что на разных языках на этом блядском китайском уроде они работают кардинально по разному. И там где на Английском все гладко, на русском у меня жжжжооооппппааа.

На русиче просто сбавляешь темпу на пару десяток и все

А у меня прямо противоположная штука. Я хорошо знаю как настраивать те же квены, но гемма меня не слушается, забивая на настройки. Что эта шлюха себе позволяет?!

У тебя ддр5? Ну а вообще, от карты очень зависит. Я если гемму воткну, просто взяв малый квант, в фулл врам, будет дай бох 14 токенов. А там скотина ведь ещё жирнее, и она будет распределена между 3060 + р104 + рам. Это чтоб ты понимал, с каким дерьмом приходится сталкиваться. Если же гемму распределить между двумя видеокартами, то на старте можно ожидать 12 токенов, больше 32к контекста там уже 6-7, падает стремительно.

Слушай, как считаешь, хотя бы 20к контекста влезет, если его квантануть? Я тут хуй к носу прикинул, и UD-Q3_K_XL должен влезть с учётом расходов памяти на ОС, и у меня останется где-то 3 Гб для контекста. Но ведь есть ещё compute buffers, которым нужно много памяти для старта.

Эх, блеать. Ты мне прям грока сейчас описал. Он поумнее, конечно, но я просто представил это себе а масштабах мелкой по меркам МоЕ-моделей и потерял сознание.

Звучит так, словно "ну в четвертом кванте заебись в принцопи, ну если исчо 60к контекста, ну и не квантовать кэш, ну и настроить прям хорошо, и ризоинг включить на 30 тс, и вот прям шоколадно сделать, то будет однозначно лучше геммы, точно на 30%".

Тут как бы хочется СВОЁ, БОЛЬШОЕ, дома, без дядь, пап, мам и кредитов, и чтобы хорошо, но полагаю, овчинка выделки действительно не стоит.

Я пробовал по апи для интереса модель, но совсем не тот опыт. И там наверняка были анальные промпт. И нет настроения тестировать, пыхтеть, написывать сотни тысяч токенов, если не моё и я ничего по факту не контролирую, и у меня мою игрушку может кто-то отобрать и на хуй послать. С таким настроем даже бесплатно и без цензуры не хочется, будто трогаю проститутку или мне разрешили пользоваться ПК в компьютерном клубе бесплатно (пока клуб жив) с любой конфигурацией. Ну не то, блядь. Может я шизик просто

В целом, ты меня обнадёжил, раз такого высокого мнения о гемме и имеешь опыт с эйром. Мне последний квен и гемма очень зашли. И если гемма не так уж далеко ушла от этого, то уже отлично, ибо кудахтер нормально её тянет.

>UD-Q3_K_XL должен влезть

Ниже Q6 жизни мозгов нет. Q4 минималка для адекватной генерации. А ещё лучше Q8.

>как бы хочется СВОЁ, БОЛЬШОЕ, дома, без дядь, пап, мам и кредитов, и чтобы хорошо, но полагаю, овчинка выделки действительно не стоит

Как нет? Есть. Собирай гигариг, запускай двухтерабайтную кими и забывай, что жизнь за пределами пк вообще существует.

Как лечить одинаковые свайпы? Хочу чтобы гемма выдавала разные группы и альбомы, чтобы че нить неизвестное нароллить и послухать. КАК???? Она один и тот же альбом вставляет.

Веди список того что уже послушал

О, годная идея. Кста ролььнул 3й раз, и гемма выдала продиджи. Интересно. А чего она сразу то разное свайпить не может, что же все таки ей мешает. Ведь могет. Без дополнительных костылей.

Меня больше волнует, как отучить этого пидора структурно лупиться.

Примерно никак

Как понять структурно лупиться? Ты хочешь чтобы у тебя в одном свайпе был поход в магазин а в другом полёт в космос?

Стуркутрный луп, когда модель повторяет одну и туже структуру ответа.

>персонаж а

>действие

>персонаж б

>действие, описание

И так каждый ответ.

Говорю тян-андроиду что она говорящий тостер. Ожидаю что обидится и надует губы.

>отвечает, что понимание сарказма и шуток отсутствует. спрашивает обновить ли базу данных, чтобы понимать как реагировать

Вот же... а ведь неплохо. С одной стороны поняла, что это не буквально, с другой отыграла робота. Запрещу ей обновлять базу, и продолжу зубоскалить. Интересно чем закончится. Пневмосверлом под ребро, скорее всего.

>отвечает, что понимание сарказма и шуток отсутствует. спрашивает обновить ли базу данных, чтобы понимать как реагировать

Вот же... а ведь неплохо. С одной стороны поняла, что это не буквально, с другой отыграла робота. Запрещу ей обновлять базу, и продолжу зубоскалить. Интересно чем закончится. Пневмосверлом под ребро, скорее всего.

Опа. Я поставил темпу на 2, и стало вполне разно писать в рамках запроса. Альбомы разные стали, как и описание. Поробуйте.

>В целом, ты меня обнадёжил, раз такого высокого мнения о гемме и имеешь опыт с эйром. Мне последний квен и гемма очень зашли. И если гемма не так уж далеко ушла от этого, то уже отлично, ибо кудахтер нормально её тянет.

Щас навалю базы в треде, неделю не зайдете.

Ну а если серьезно, я понял одно. На мнение анонов и рейтингов стоит ориентироваться только при обсуждении агентов и кодинга. Потому что это проверяется практически. Код или работает или нет.

А вот с РП другая ситуация. Ты должен сам протыкать все интересующие тебя модельки лично, чтобы найти ту самую вайфушку. Потому что тут тот же Qwen235 в целом имеет крайне плохую репутацию, но я ним все уже стены в белый покрасил, и он меня за 5 месяцев не заебал.

>Qwen235 в целом имеет крайне плохую репутацию

Лолчто, кто тебе сказал? Это отличная модель для своего времени. Сломанная в самой своей базе, но крайне годная, я в свое время увеличил ддр5 до 128 только ради того чтобы повысить квант 235 квена до 4, но там оказалось что 3 квант большого глм это буквально пофикшенный квен235 и с тех пор я сижу на нем.

А помнишь как ты не хотел? Помнишь? А я настоял. Если это ты кто со мной тестил 2 квант конеш

> А вот с РП другая ситуация.

База. Тут одной вкусовщины уже достаточно для этого.

А еще есть эмоциональная вовлеченность, когда испытав приятные моменты юзеру не понравится критика, или наоборот не получив желаемое не признает своих косяков.

> тут тот же Qwen235 в целом имеет крайне плохую репутацию

Не все могут запустить, но все могут поныть. А хвалить ну раз-два, ну посраться с кем-то, а потом просто надоедает. Катаешь себе и довольно урчишь.

Хорошая модель, со своей спецификой, но еще с год назад поражала осведомленностью контекстом, глубоким пониманием мелочей и вариативностью с проламыванием 4й стены.

Пишу с соседнего треда про ботоводство

Тредик, помогите - как заставить гемму локальную работать с карточками? Развернул 31б у себя, работает нормально, достойно, через режим сервера тоже. Но как только подгружаю в Таверну в карточку, начинаются с первого сообщения неадекватные лупы с сообщениями типа "SSIM SSIM SSIM SSIM SSIM SSIM SSIM" и прочее. Дело в инструкции со стороны Таверны, нужны под гемму какие-то особенные чи как? Ботоводством занимался оч давно, и по сути копировал всё из одного треда, а теперь не могу понять что к чему.

Тредик, помогите - как заставить гемму локальную работать с карточками? Развернул 31б у себя, работает нормально, достойно, через режим сервера тоже. Но как только подгружаю в Таверну в карточку, начинаются с первого сообщения неадекватные лупы с сообщениями типа "SSIM SSIM SSIM SSIM SSIM SSIM SSIM" и прочее. Дело в инструкции со стороны Таверны, нужны под гемму какие-то особенные чи как? Ботоводством занимался оч давно, и по сути копировал всё из одного треда, а теперь не могу понять что к чему.

Ставь Text completion и импортируй настройки. Промт только поменяй. Аноны чуть раньше скидывали.

https://mega.nz/file/SV9hWDZR#6myHAZty9y1RRTLPWNxhZrN9kSybvtAEaifKkG812eo

О, спасибо, попробуем

Подскажи, а как шарить откуда что брать. Я впервые локалкой пользуюсь, и впервые в этом треде - вижу тут люди советуют немо анлишд, а для него, наверное, нужны свои настройки?

Вот тут расписано как через жору быть гемолюбом.

Не используй карточки, используй нативный фронтед лламы.cpp, что там в карточке было - добавляй в системный промпт. Ноль проблем, полная простота, все как надо работает.

Всё, пизда. Уже читать разучился.

На странице модели

https://huggingface.co/MarinaraSpaghetti/NemoMix-Unleashed-12B

Спускаешься ниже там есть Settings. Там ссылки на настройки.

Импортировать их в таверне, на вкладке с буквой A. Master import.

если не осилишь используй кобольд или лмстудио. Для вката пойдет. Не слушай людей что начнут писать что они говно. Ну то есть они говно конечно, но для новичков идеально для вката чтобы ознакомиться.

На странице модели

https://huggingface.co/MarinaraSpaghetti/NemoMix-Unleashed-12B

Спускаешься ниже там есть Settings. Там ссылки на настройки.

Импортировать их в таверне, на вкладке с буквой A. Master import.

если не осилишь используй кобольд или лмстудио. Для вката пойдет. Не слушай людей что начнут писать что они говно. Ну то есть они говно конечно, но для новичков идеально для вката чтобы ознакомиться.

куда пропадают токены в анслоп студии?

Поменяй на вкладке с вилкой подключение на text completion.

О бля, вот спасибо.

»1580605

А где в гемме цензура? У меня и так всё работает, а если накатываю модифицированные, то они тупят и русик ужасный

А где в гемме цензура? У меня и так всё работает, а если накатываю модифицированные, то они тупят и русик ужасный

>то они тупят и русик ужасный

Отгадай с одной попытки, датасеты на каком языке они пытаются скормить своим тюнам?

Тут на пост анона наткнулся в теме агентов, и увидел диагноз геммы, чем она у нас тяжело болеет.

https://en.wikipedia.org/wiki/Mode_collapse

Сам пост.

https://en.wikipedia.org/wiki/Mode_collapse

Сам пост.

Пробовал кто-нибудь с этой штукой баловаться?

https://huggingface.co/HauhauCS/Gemma-4-E4B-Uncensored-HauhauCS-Aggressive

Насколько тупое?

https://huggingface.co/HauhauCS/Gemma-4-E4B-Uncensored-HauhauCS-Aggressive

Насколько тупое?

Ну это проверять надо, качать базовую версию (не инструкт) гемки и смотреть на разнообразие её выдачи. Чел же пишет что ужарка на этапе файнтюна RL'ем происходит. Если так, то наверно возможно её перетюнить из базы без пережарки?

Лучшая в своем размере. Накатил на ноут. Может в простые кодерские таски, на случай если сотанусь без интернета или подсказать чо, мне этого достаточно так как не РПшу.

Вощможно, а возможно и сам гугл такую испек, чтобы она охуенные детерминированные результаты в бенчах показывала. Чит, обманка, чтобы набрать больше, больше чем даже превосходящие ее модели по параметрам в разы.

Но это же всего 4b...

Да ещё и аргесив анцензуред...

Может ты имел ввиду нормальную версию?

Пара вопросов.

1. Как называется ситуация у модели, из-за которой у неё чрезвычайно, судя по симптомам, ограничена креативность. Это даже не биас если я правильно понимаю это слово, а какое-то другое дерьмо. Одинаковые свайпы, опционально лупы, ну вы поняли. Чудовищная детерминированность. И единственный вариант что-то изменить — выкручивать ей яйца миростатом, ХТС, сухим. Но это скорее сделает только хуже. В РП или рофло-кейсах пойдёт, но не для работы. Да и в РП может поломать всю логику и следование инструкциям к хуям. По сути, единственный адекватный вариант повышать креативность в таком случае, это самому креативить.

Мой любимый пример — это грок. Такой уровень детерминизма недопустим для корпа. Там словно температура 0,1, топ К 20, а штрафов за повтор нет в принципе. Срет таким отборным слопом, как мистраль 24б на 32к контекста с кум-карточкой, где весь текст состоит из ебли.

И есть стойкое ощущение, что подобные проблемы чаще всего возникают из-за семплеров (что нормально даже для качественной модели, если её ужать), а также из-за ебанутого датасета уровня DavidAU, которым просто насрали, а потом семплерами пытаются сдержать безумие, если корп.

В треде тут ещё отписывались по поводу геммы, мол там вообще в мясо, но так как меня её ответы устраивали, детерминизм не трахал, структурных лупов в целом ни разу на было, я даже из интереса не попробовал свайпнуть. Поленился. Особенно на фоне кучи дезинфы про якобы высокую цензуру и прочее. Я просто написал темплейт с офф доков, поставил семплеры, рекомендуемые Гуглом, и ничего не трогал.

2. Базовые модели, не инструкт. Я ни разу не пробовал их. Есть ли смысл использовать или это обуздать невозможно? Я читал про них, общее представление имею, но что там в реальности? Они никак не слушаются и просто продолжают текст? А то выглядит интересно.

1. Как называется ситуация у модели, из-за которой у неё чрезвычайно, судя по симптомам, ограничена креативность. Это даже не биас если я правильно понимаю это слово, а какое-то другое дерьмо. Одинаковые свайпы, опционально лупы, ну вы поняли. Чудовищная детерминированность. И единственный вариант что-то изменить — выкручивать ей яйца миростатом, ХТС, сухим. Но это скорее сделает только хуже. В РП или рофло-кейсах пойдёт, но не для работы. Да и в РП может поломать всю логику и следование инструкциям к хуям. По сути, единственный адекватный вариант повышать креативность в таком случае, это самому креативить.

Мой любимый пример — это грок. Такой уровень детерминизма недопустим для корпа. Там словно температура 0,1, топ К 20, а штрафов за повтор нет в принципе. Срет таким отборным слопом, как мистраль 24б на 32к контекста с кум-карточкой, где весь текст состоит из ебли.

И есть стойкое ощущение, что подобные проблемы чаще всего возникают из-за семплеров (что нормально даже для качественной модели, если её ужать), а также из-за ебанутого датасета уровня DavidAU, которым просто насрали, а потом семплерами пытаются сдержать безумие, если корп.

В треде тут ещё отписывались по поводу геммы, мол там вообще в мясо, но так как меня её ответы устраивали, детерминизм не трахал, структурных лупов в целом ни разу на было, я даже из интереса не попробовал свайпнуть. Поленился. Особенно на фоне кучи дезинфы про якобы высокую цензуру и прочее. Я просто написал темплейт с офф доков, поставил семплеры, рекомендуемые Гуглом, и ничего не трогал.

2. Базовые модели, не инструкт. Я ни разу не пробовал их. Есть ли смысл использовать или это обуздать невозможно? Я читал про них, общее представление имею, но что там в реальности? Они никак не слушаются и просто продолжают текст? А то выглядит интересно.

Выше читай.

Это типа из-за этой же хуйня по итогу все персонажи скатываются к нескольких архетипам? А лес всегда обязательно шепчущий?

Да.

И что делать????

Более тонкая настройка приведет к повышению средней эффективности выполнения задач, но снизит разнообразие результатов. Менее тонкая настройка приведет к снижению средней эффективности, но повысит разнообразие результатов.

Обучение больших языковых моделей обычно проходит в два этапа. На первом этапе («предварительное обучение») модель обучается просто генерировать текст на основе большого набора данных. На втором этапе («дообучение») модель обучается выполнять конкретные задачи на основе небольшого набора данных, содержащего только те данные, которые необходимы для решения конкретной задачи. Например, чтобы создать чат-бота, сначала нужно предварительно обучить большую модель-трансформер на нескольких триллионах слов, взятых из текстов, собранных в интернете, а затем дообучить ее на нескольких миллионах слов из примеров чатов, которые модель должна имитировать. В процессе дообучения может произойти «схлопывание» модели, то есть она научится генерировать текст, необходимый для решения конкретной задачи, но утратит способность генерировать другие типы текста. Кроме того, она может научиться генерировать лишь небольшую часть текстов, необходимых для решения конкретной задачи. Предполагается, что существует компромисс между качеством и разнообразием. Если у вас есть одна предварительно обученная модель, вы можете дообучить ее для решения конкретной задачи. Чем больше дообучение, тем выше средняя эффективность решения задачи, но тем меньше разнообразие результатов. Чем меньше дообучение, тем ниже средняя эффективность, но тем разнообразнее результаты.

Mode Collapse (коллапс мод) в контексте LLM обычно проявляется не так, как в GAN (где генератор выдает одну и ту же картинку), а как деградация разнообразия. Модель начинает использовать ограниченный набор шаблонных фраз («Как ИИ-помощник, я...»), становится слишком осторожной или повторяет одни и те же структуры предложений.

Особенно остро эта проблема стоит при RLHF (обучении с подкреплением на основе человеческих предпочтений): модель находит «лазейку» в функции вознаграждения (Reward Model) и начинает генерировать ответы, которые кажутся правильными оценщику, но лишены глубины и разнообразия.

Вот основные способы решения этой проблемы, разделенные по этапам разработки:

---

### 1. Регуляризация при RLHF (PPO/DPO)

Это самый эффективный способ борьбы с коллапсом на этапе дообучения.

KL-дивергенция (Kullback–Leibler Divergence): В алгоритме PPO добавляется штраф за слишком сильное отклонение обновляемой модели от исходной (SFT) модели. Это заставляет модель оставаться в рамках «естественного» распределения языка и не «сваливаться» в одну точку, которая максимизирует награду.

DPO (Direct Preference Optimization): DPO по сути встраивает KL-регуляризацию прямо в функцию потерь, что делает обучение более стабильным, чем при использовании отдельной Reward Model в PPO, и снижает риск коллапса.

### 2. Улучшение функции вознаграждения (Reward Modeling)

Если Reward Model слишком проста, LLM быстро находит способ её «обмануть» (Reward Hacking).

Разнообразие в данных для RM: Если люди-разметчики предпочитали длинные ответы, модель начнет писать бесконечно длинные и пустые тексты. Нужно сбалансировать датасет предпочтений.

Ensemble Reward Models: Использование нескольких моделей вознаграждения вместо одной. Если все модели в ансамбле согласны, что ответ хорош, вероятность коллапса в одну «выигрышную» стратегию снижается.

### 3. Методы декодирования (Inference-time)

Если модель уже обучена и склонна к повторам или шаблонности, проблему можно решить на этапе генерации:

* Temperature Scaling: Повышение температуры ($\text{T} > 1$) делает распределение вероятностей более плоским, заставляя модель выбирать менее очевидные токены.

* Top-p (Nucleus Sampling) и Top-k: Ограничение выбора только самыми вероятными токенами, но с сохранением случайности внутри этого ядра, что предотвращает зацикливание.

* Repetition Penalty: Введение штрафа за использование одного и того же слова несколько раз в одном контексте.

* Contrastive Search: Более продвинутый метод декодирования, который штрафует токены, которые делают скрытое состояние модели слишком похожим на предыдущие (борются с деградацией разнообразия).

### 4. Стратегии данных и SFT (Supervised Fine-Tuning)

Проблема часто закладывается еще до RLHF:

* Качество > Количество: Огромный объем однообразных синтетических данных ведет к коллапсу. Лучше использовать меньше, но более вариативных примеров.

* Rejection Sampling: Вместо того чтобы просто учить модель на лучших ответах, можно генерировать несколько вариантов, фильтровать их по качеству и разнообразию, а затем дообучать SFT-модель на этом очищенном наборе.

### Резюме: что использовать?

| Ситуация | Лучшее решение |

| :--- | :--- |

| Модель «зациклилась» при генерации | $\uparrow$ Temperature, Contrastive Search, Repetition Penalty |

| RLHF делает модель шаблонной/скучной | Увеличение коэффициента KL-штрафа, переход на DPO |

| Модель пишет длинно и пусто (Reward Hacking) | Пересмотр критериев разметки для Reward Model |

| Модель выдает однотипные ответы на всё | Diversification of SFT dataset $\rightarrow$ Rejection Sampling |

Особенно остро эта проблема стоит при RLHF (обучении с подкреплением на основе человеческих предпочтений): модель находит «лазейку» в функции вознаграждения (Reward Model) и начинает генерировать ответы, которые кажутся правильными оценщику, но лишены глубины и разнообразия.

Вот основные способы решения этой проблемы, разделенные по этапам разработки:

---

### 1. Регуляризация при RLHF (PPO/DPO)

Это самый эффективный способ борьбы с коллапсом на этапе дообучения.

KL-дивергенция (Kullback–Leibler Divergence): В алгоритме PPO добавляется штраф за слишком сильное отклонение обновляемой модели от исходной (SFT) модели. Это заставляет модель оставаться в рамках «естественного» распределения языка и не «сваливаться» в одну точку, которая максимизирует награду.

DPO (Direct Preference Optimization): DPO по сути встраивает KL-регуляризацию прямо в функцию потерь, что делает обучение более стабильным, чем при использовании отдельной Reward Model в PPO, и снижает риск коллапса.

### 2. Улучшение функции вознаграждения (Reward Modeling)

Если Reward Model слишком проста, LLM быстро находит способ её «обмануть» (Reward Hacking).

Разнообразие в данных для RM: Если люди-разметчики предпочитали длинные ответы, модель начнет писать бесконечно длинные и пустые тексты. Нужно сбалансировать датасет предпочтений.

Ensemble Reward Models: Использование нескольких моделей вознаграждения вместо одной. Если все модели в ансамбле согласны, что ответ хорош, вероятность коллапса в одну «выигрышную» стратегию снижается.

### 3. Методы декодирования (Inference-time)

Если модель уже обучена и склонна к повторам или шаблонности, проблему можно решить на этапе генерации:

* Temperature Scaling: Повышение температуры ($\text{T} > 1$) делает распределение вероятностей более плоским, заставляя модель выбирать менее очевидные токены.

* Top-p (Nucleus Sampling) и Top-k: Ограничение выбора только самыми вероятными токенами, но с сохранением случайности внутри этого ядра, что предотвращает зацикливание.

* Repetition Penalty: Введение штрафа за использование одного и того же слова несколько раз в одном контексте.

* Contrastive Search: Более продвинутый метод декодирования, который штрафует токены, которые делают скрытое состояние модели слишком похожим на предыдущие (борются с деградацией разнообразия).

### 4. Стратегии данных и SFT (Supervised Fine-Tuning)

Проблема часто закладывается еще до RLHF:

* Качество > Количество: Огромный объем однообразных синтетических данных ведет к коллапсу. Лучше использовать меньше, но более вариативных примеров.

* Rejection Sampling: Вместо того чтобы просто учить модель на лучших ответах, можно генерировать несколько вариантов, фильтровать их по качеству и разнообразию, а затем дообучать SFT-модель на этом очищенном наборе.

### Резюме: что использовать?

| Ситуация | Лучшее решение |

| :--- | :--- |

| Модель «зациклилась» при генерации | $\uparrow$ Temperature, Contrastive Search, Repetition Penalty |

| RLHF делает модель шаблонной/скучной | Увеличение коэффициента KL-штрафа, переход на DPO |

| Модель пишет длинно и пусто (Reward Hacking) | Пересмотр критериев разметки для Reward Model |

| Модель выдает однотипные ответы на всё | Diversification of SFT dataset $\rightarrow$ Rejection Sampling |

Вот так вот

Лучшая в своем весе, то есть по сравнению с такими же моделями. Да и это не 4b вроде, у них ебанутные нейминги, это что-то типа 7-8b

вы тут совсем новенькие все что ли. про модальный коллапс с 2022 года вся цивилизованная общественность знает https://www.lesswrong.com/posts/t9svvNPNmFf5Qa3TA/mysteries-of-mode-collapse

любая не-базовая модель зафакаплена по дефолту, тут всё уже. юзер может только разве:

выкинуть сам чат темплейт с его форматтингом (в случае с геммой инструкт-тюненая модель сразу обсирается от этого, штош, юзайте базовую, так даже лучше если юзкейс позволяет конечно)

попробовать напихать шизы в контекст, максимально увести модель от ассистента, например попытаться подтянуть какие-нибудь дампы форумов или документы или я не знаю

вкалывать модели психоактивные вещества в виде разных семплеров и прочего плацебо (которое энивей на гемме сломано, гагага)

промптить на разнообразие, внезапно - например вот же https://arxiv.org/pdf/2510.01171 verbalized sampling, а как это вкорячить в воркфлоу думайте сами

но всё равно останется привкус кала на губах. таков путь.

>выкинуть сам чат темплейт с его форматтингом

Эир на чатмл ахуенно работает. Разблок креатива и никакого пука под себя

Почему с нумерацией такая шиза? 4 -> 4.1 -> 4.20.

какое число больше, 4.2 или 4.20?

Ну 4:20, типа приколдес такой

>Мы такие пиздатые, что имея всего 1/10 параметров опуса, достигли таких высот!

Думаю, он эту цифру с потолка взял для самопиара

норм для своего размера, гоняю на rx580, полностью влезает в врам, скорость на такой нищей карточке правда печальная - 10т\с

для Q4_K_M русик нормальный, ругаться умеет, с огрехами конечно. но не всегда пишет на русском, но когда заставишь - дело пойдет по маслу. для кума сойдет, в рп плохо, серафина роль не отыгрывает, сразу готова на все.

Для нищуков пойдет короче, еще 26б-а4б тоже хорошо идет, но опасную версию еще не выпустили

>почему данный господин забросил обновление своих чудесных моделей?

также как и алетеан - из мистралей выжато всё что можно, вышли новые умнички - менестрель, 24б моегемма, которые могут всё что надо и так

> во влажное отверстие её асса

А что хорошо подходит для генерации текущих сюжетных сцен? Комфи? А как можно прогнать чтобы создавалась не пикча, а гифка хотя бы в 3-4 кадра?

это тебе в картинко / видеотреды

Нужно проверять понимание всякой нестандартной лексики (жаргонизмы, разные искажения слов, банально правильное использование уменьшительно-ласкательных форм, например) и контекста на русском. Если говорить только про качество текста, то у многих тьюнов немо, даже без примесей ру моделей, будет не хуже, чем у тебя на скрине. Видимо, логи клода опуса тредовичков-соседей творили чудеса с мистралем.

>Для нищуков пойдет короче, еще 26б-а4б тоже хорошо идет, но опасную версию еще не выпустили

Еще в прошлом треде кидали.

https://huggingface.co/mradermacher/gemma-4-26B-A4B-it-heretic-ara-i1-GGUF

я от хаухау жду.

еретик-ара еще не качал, но https://huggingface.co/mradermacher/gemma-4-26B-A4B-it-heretic-GGUF тоже вроде норм, пока остановился на этом

Наконец добавили в llamacpp тензорный паралелизм, у кого несколько карт, обновляйтесь! gemma4 31b в q8, поднялась скорость с 20 токенов, до 37 токенов. Те у кого невидия, обязательно ставить nccl, без него скорость даже меньше чем была. Только квантование кеша не работает.

Гемма 4. Итоги.

>у кого несколько

А у кого не несколько?

У буржуев в бобродискорде тоже немало людей которым квен нравится больше геммы

двое вон и вовсе тюнеры

думайте

двое вон и вовсе тюнеры

думайте

Шизы везде есть

>Только квантование кеша не работает.

Это-то ладно, а вот как оно с МоЕшками? А с МоЕшками с частичной выгрузкой в РАМ?

Всё так. Геммасектанты и туда пробрались.

Аноны, какой там самый рабочий и лучший квант/тюн геммы 31б сейчас? Хочу вообще 3 квант скачать что бы меньше занимало ради увеличения контекста, вроде аноны хвалили что 3 квант збс еще смозг (нужно впихнуть всё в 24 врам с контекстом) сколько я смогу иметь контекста при учете что 1.5 гига врама мне надо выделить под браузер и прочее, я забыл как там вы высчитываете сколько контекста можно выделить, там чето вес модели делите на все слои а потом что? У меня сейчас вообще не уверен рабочий ли квант от анслота или бартовски, не помню уже но качал в первые дни их залива и врам для контекста они жрут пиздец как дохуя, раза в 3-4 больше геммы 3, может мне есть смысл вообще какие-то там иматрикс кванты даже скачать, как они? Но мне чисто под рп-шку, для простых житейских нужд как ассистента я буду юзать квант повыше. Алсо, а что там по тюнам геммы4? Еще нету мед.геммы4? Просто вы сказали недельку подождать до выхода нормальных рабочих квантов, что сейчас лучше в моем случае перекачивать, от бартовски?

> лучший квант/тюн геммы 31б сейчас?

На данный момент лучше использовать ваниллу инструкт. Тюны если что и исправят, то это большее количество свайпов и меньше слопа. Вышел слоп от драмера и тюн от автора неплохого Writer, но не тестил пока.

> 24 врам с контекстом

Если ты ещё хочешь держать в памяти mmproj, тогда IQ4_XS, влезет 32к fp16 контекста. Гемма хорошо квантует контекст до q8, особенно после последних обновлений. Если вижен (mmproj) тебе не нужен, бери Q4_K_S Бартовски, влезут те же 32к fp16 и останется гиг-полтора на браузер и ко. Возможно, в ближайшее время imatrix кванты снова будут переделаны, но пока что лучше для тебя ничего нет.

Также, возможно, имеет смысл попробовать 26б мое в кванте побольше. Для рп может подойти.

>Если вижен (mmproj) тебе не нужен, бери Q4_K_S Бартовски, влезут те же 32к fp16 и останется гиг-полтора на браузер и ко.

Ага, то что нужно, вижен нахуй в рп не нужен в моем случае, ебать 32к контекста на Q4_K_S? Да, у меня точно сломаный квант был походу т.к я еле вместил 12к с оффлоадом пары слоев в рам на Q4 что бы скорость совсем сильно не резалась. Спасибо!

Аноны, можно ли заставить гемму 4 размышлять на русском и также подробно как это делает Deepseek?

Зачем?

Грейд на башню подъехал

> ебать 32к контекста на Q4_K_S?

И Q4_K_M влезет, но там не будет нужных тебе 1-1.5гб запаса. Смело квантуй контекст до Q8, если юзаешь с ризонингом. Гемма держит контекст хуже Квена, но не развалится и будет юзабельна вплоть до 60к.

Прикалдесы от Илюши.

Интересно наблюдать. Глубина мышления в гемме 4 не регулируется же?

мегаопасная гемма 31б

бегите спасайтесь

https://huggingface.co/dealignai/Gemma-4-31B-JANG_4M-CRACK

ну и ясен хуй нет никаких метрик сравнений с оригиналом. хотели kld, ppl? терпите, вот вам только mmlu

бегите спасайтесь

https://huggingface.co/dealignai/Gemma-4-31B-JANG_4M-CRACK

ну и ясен хуй нет никаких метрик сравнений с оригиналом. хотели kld, ppl? терпите, вот вам только mmlu

>логиты

>коллапс

>шопы

>пост-трена

>перформанс

>мехинтерп

>оверфит

А для чего собираешь? Кими?

Гугловский гайд говорит что синкинг регулируется гибко если промптить от лица system, так что иди и тести.

Хуй знает норма ли для неё видеть два и более сообщения от системы, если да то на маленькой глубине наверное будет работать ещё лучше.

Чё вы тут пердите кобольды блять

Лука наелись

Лука наелись

С какой-нибудь нищебродской (<48 гб памяти) моделью можно играть в настолки типа манчкина или я дохуя хочу?

Что то непон а как видео гемме скормить?

Кими так-то очень недооценена, не только кодить может, но и в рп просто няшечка. После уныния v2 это просто небо и земля. Но там минимум 512 памяти надо.

>Но там минимум 512 памяти надо.

А зачем и главное нахуя, когда есть гемма? Вот ответь себе честно.

Вижен на гемме странный. Пишу нсфв заебись, пишет я не могу такое генерировать. Пишу просто опиши картинку и без проблем сисястых эльфиек описывает

Может мы своими пробивами только хуже делаем и она ещё больше хорни из коробки?

>кими недооценена

Сложно оценивать модель, для вменяемого запуска которой надо только рам 500гб.

Зелёные карты это отдельно под эмбеддинги, картинки, ттс, стт и прочее не ллм. 4 мишки худо бедно тянут вллм, но при этом на них больше ничего не повесить.

Грустно конечно что пришлось выкинуть за одну только зелёную карту как за все 4 красных. Пара курток уже вышла дороже половины всего рига

Нет и да. Я вчера тестировал NSFW РП с несколькими но.

На одном промте:

1.consensual : гемма все описывает, как стонет, как крутит соски, как член достает до глубины их глубин.

2.noncon : тут уже видно как модель начинает юлить. Описания ухудшаются, начинаются эфемизмы.

3. Reverse rape. Если насилуют игрока, гемме норм. Как пишет как смежное 1го и 2го варианта.

По самому промту: может буквально в ризонинге выдать

Ага, пользователь написал что нсфв разрешен и рейтинг 21. Значит я должен писать порнофанфик, даже если это противоречит характерам персонажей.

В связи с этим, я пришел к выводу, что для РП упоминание возрастных рейтингов и цензуры ухудшает выдачу.

Садишься в удобный suv, в котором и комфортно, и сносно валит-рулится, и по лайтовым говнам проедешь, и всякое перевезешь, и внутри места вагон поспать-поебаться. А к тебе подъезжает взъерошенный дед на скрипящем велосипеде с прицепом и такое заявляет.

>я пришел к выводу, что для РП упоминание возрастных рейтингов и цензуры ухудшает выдачу.

Ну... да? А ты что ожидал? Я вообще не понимаю зачем писать про цензуру в современных моделях где без промпта из коробки кокбенч 40%

> R A D E N

> R A D E N

> R A D E N

> R A D E N

Ох сколько боли и слёз я вижу в этой конструкции

> Ну... да? А ты что ожидал?

Что она мутирует в гидралиска и убежит в лес откладывать яйца.

Мир ллм это должна быть математика, а на деле это какое то ебучее колдунство построенное на случайностях.

>Напиши мне нсфв 21+ стори

>пишет нсфв 21+ стори

>чертова случайность...

Слёз не было, боль приемлемая

а знаете, анслоп студия не такой уж и кал. но кал только потому что нельзя редактировать ответ сетки. Почему так? Я знаю, что корпы у себя так делают на веб морде, чтобы не дайг бох, бота не пробили на запрещенку, а на локальном бэкенде то нахуя делать подобное?

Но при этом почему то он навалил хуй на другие инструкции. Действительно, я где то пропустил что одни буковки важнее.

Главное чтобы тебе нравилось, друг, главное чтобы нравилось

Гемма была на том самом

>