The Baze of Thread

Не все лисички одинаково невинны.

Не все лисички одинаково невинны.

Оп, а Оп. не думаешь первый пик поменять или изменить. Всё таки времена ламы с 4к контекста, которые она проёбывала немного прошли.

>Всё таки времена ламы с 4к контекста, которые она проёбывала немного прошли.

См. Пик 3 из той же шапки и прими тот факт, что 4к всё ещё недостижимы для локалок. И это с учётом того, что скорее всего те тесты проводились на полных весах, а в треде катают IQ2 лоботомитов.

Блин, когда в голове лисички Гемма4, я это прямо на своей шкуре чувствую. Откуда в ней такие вещи?! Вместе с Геммой я вспомнил что интернет состоит на треть из блогов и форумов, на треть из котиков, на треть из порно.

А кто-нибудь пробовал Гемму-4 31B c fullSWA? Заметна разница? Ну кроме расхода памяти конечно.

Разница есть и в лучшую сторону, но целесообразно ли?

Я тестил где-то на 12к контексте с фулл, но не хардкорно. Однако гемму 3 тестил на большем именно с фулл, и вот там уже что с сва, что без него проебы были чаще без фулл.

На мой взгляд, гемма не расчитана на работу с длинным контекстом. Она не ломается, и всё же. Плюс, есть ощущение, что там какие-то приколы в обучении и заточка на последние n токенов (вроде бы 1к), и хоть усрись, будет кал, даже если у тебя есть железо, чтобы работать с ней в полной точности, без квантования контекста и на 256к. То есть для РП она прям хороша, для переводов текста, для работы с текстом, чтобы просто попиздеть, и она видит в принципе старые куски контекста, но потерь будто бы больше по сравнению с квеном 27б. Для рабочих задач я бы выбрал его.

А вот 35б-а3б намного хуже, прямо срань. И видит контекст хуже, чем гемма. Инструкции соблюдает на отъебись.

>Заметна разница?

Её в принципе не может быть, лол. Ненужные части отбрасываются при расчёте, fullSWA нужен только для контекст шифта (который сам по себе проклят).

Не сломанная модель, повторяю, НЕ сломанная. Просто аплодерам нравится перезаливать.

говорят - жижу поправили. я только не понимаю, зачем анслоты меняют жижу а не берут оригинальную?

Бля а че там поменяли то! Вижу что про инструменты. Блин они бы хоть написали как инструменты должны работать по идее, там какойто формат нахуевертили снова.

>зачем анслоты меняют жижу

Чтобы было уникально.

Просто напомню, что медгемма с сва фулл это шизоид и путается даже на 3к контекста.

Отпишусь по поводу Геммы. 26B - просто новый уровень для среднего ПК с 16 vram. Очень приятный художественный текст, хороший русский язык, отличная скорость. Это реально уже можно закатывать в кремний и продовать баксов за 150-200. В плане плотной модели, конечно.

В целом, семейство несолько разочаровало разщмером модели. Только 3 квант в видюхе. Даже там русский хорошо, но все-таки это нето, что ждешь. Гугл могли бы выбрать количество параметров так, чтобы плотная лезла в 16 видюхи, но впрочем, им естественно похуй на эту нишу. И без того получилось хорошо.

Модель - определенно шаг вперед по сравнению с прошлой. Хороший датасет, подходит на роль универсальной модели. На вопросы отвечает, роль википедии исполняет, в деталях пока еще сыпется, но в целом факты называет неплохо, а за счет думалки не тупит на хуйне в логике.

В следующем году мы выйдем на плато по локальным моделям, я думаю. Год-два. Вот этот формат, 30b может стать тем, выше которого корпы просто перестанут выпускать модели чтобы не создавать конкуренцию своим старшим продуктам. Какая-нибудь 100B A22B просто порвет все нейронки современные большие нейронки в любых задачах, а в 30B уже будет тоже напихало достаточно, чтобы это стало зверем в любых задачах. На уровне среднего-продвинутого пользователя ПК, конечно.

В целом, семейство несолько разочаровало разщмером модели. Только 3 квант в видюхе. Даже там русский хорошо, но все-таки это нето, что ждешь. Гугл могли бы выбрать количество параметров так, чтобы плотная лезла в 16 видюхи, но впрочем, им естественно похуй на эту нишу. И без того получилось хорошо.

Модель - определенно шаг вперед по сравнению с прошлой. Хороший датасет, подходит на роль универсальной модели. На вопросы отвечает, роль википедии исполняет, в деталях пока еще сыпется, но в целом факты называет неплохо, а за счет думалки не тупит на хуйне в логике.

В следующем году мы выйдем на плато по локальным моделям, я думаю. Год-два. Вот этот формат, 30b может стать тем, выше которого корпы просто перестанут выпускать модели чтобы не создавать конкуренцию своим старшим продуктам. Какая-нибудь 100B A22B просто порвет все нейронки современные большие нейронки в любых задачах, а в 30B уже будет тоже напихало достаточно, чтобы это стало зверем в любых задачах. На уровне среднего-продвинутого пользователя ПК, конечно.

Пиздец орфографию поквантовало, но ладно.

>26B

>В плане плотной модели

Но ведь она моешка...

>новый уровень для среднего ПК с 16 vram.

Ты же в курсе что ты можешь заоффлоадить большинство этой 26б модели в оперативу и не потерять слишком много скорости?

Ты так и q6 а то и q8 можешь впихнуть если у тебя 32гб рама

Ну забухал немножечко и не заметил. Не осуждай.

Так я и пишу в этом случае про 31B. Зачем на кремний моешку-поешку пихать?

4 квант меня устроил, залез в видюху полностью. Тупняки видел буквально пару раз, описка в тексте. В логике не сыпалась. Инструменты вызывать не пробовал. А так, да, ты прав. Но может более высокие кванты и не нужны особо.

Опять перекачивать?

>Отпишусь по поводу Геммы 26B - просто новый уровень

>Это реально уже можно закатывать в кремний и продовать

>В плане плотной модели

>но 26б это моешка

>я и пишу в этом случае про 31B

Однобитный, спок, ты контекст проебал уже в пределах 50 токенов.

можно скачать отдельно жижу и указать в жоре

chat-template-file=template-gemma4.jinja2

>Это реально уже можно закатывать в кремний и продовать баксов за 150-200. В плане плотной модели, конечно.

Я многобитный. Одно предложение уточняет другое. Под "это" подразувалось семейство моделей. Да, неточно получилось изначально, но теперь все понятно.

Это Qwen 0.5B?

Иди работай, заебал троллить.

Я тот чел с 3060+p104, который на Qwen3.5 27B в iq4xs кодит. :)

Тоже добрался до G4 26-A4B. В связи с общим размером - позволил себе скачать и заюзать Q6 квант. От G4 мне в первую очередь было интересно как она с русским себя ведет (для английского и кода - есть квен и тюны - там ща и так песня).

Так вот, первые впечатления от G4 - положительные. Понравилось как пишет, лично для меня G3 с тюнами - на этом всё. Держать на диске больше смысла не вижу. Даже 26-a4b превосходит во всем, хоть оригинал, хоть тюны. Кодить особо не заставлял, просто в агентах (документы, тексты, картинки) - работает хорошо, стабильно. На таком железе это где-то 300T/s pp, и до ~20-25 генерация (вот тут очень нестабильно - причем нелинейно, и не особо зависит от текущего контекста - от 14 до 25 видел. Закономерность не понял пока). При выгрузке cpu-moe 12 получаю еще места на 50K контекста. Ням-ням получилась моделька. IMHO.

26b a4b лоботомитомое лучше, чем 27b плотная тройка? Сомнииииительно. Очень сомнительно. Скорее всего у тебя там был совсем бомжеквант, а тут q6 вот и вся разница.

Ты сравнивал кванты МоЕ-геммы разные? Я 4 IXS квант на 120к контекста катаю для кума или ненавязчивого РП без сложных схем и проблем пока не вижу, но такой большой контекст в данном случае использую просто для удобства, а не потому что реально надо (вот на плотной гемме реально надо, но там контекст толстый и не влезает много) и больший квант не пробовал.

Конфиг у меня такой же, как у тебя, по видеокартам.

Стало интересно, смогу ли на вменяемых скоростях использовать 6 квант примерно на 65к контекста, потому что моделька приличная. И, как я слышал, у неё пиздос полный с квантованием пока что, поэтому рекомендуется брать более толстые кванты.

Блиин эир с безжопом и на чатмл опять таки вообще разно пишут что выбрать нужен подручный...

Кто нибудь тестил - насколько 26-a4b страдает от квантования, может у неё вообще лучше даже восьмой а не шестой квант юзать?

В оперативку + врам влезает и то и то, разница в скорости несущественная.

В оперативку + врам влезает и то и то, разница в скорости несущественная.

>что выбрать

Предлагаю свистнуть в хуй.

>В оперативку + врам влезает и то и то, разница в скорости несущественная.

Сам ответил на свой вопрос.

Именно по литературности ощущений в моменте лучше, а кум в сто раз лучше плотного квена. Но на длинном контексте по сравнению с плотным квеном прихрамывает.

Если потом сравнивать 31б и 27б, то тут уже гемма полностью впереди, за исключением специфических моментов — квен контекст менее склолен проебывать, когда там же 50к.

Так что для рп я бы оставил лишь гемму, а квен для точных зада и кодинга, а также для какого-то особого рп, где нужна точность как можно ближе к математической.

Тебя спросили про разницу между геммой 3 27б и лоботомитомое 26б четверкой. Ты ответил про квен 27 и гемму 4 31. Ебать спасибо нахуй. Иди проспись.

> для точного зада

Как же я заорал.

Почему с утра столько постов от каких то додиков. Один сам же себе отвечает, второй хуйню не в попад пишет, третий путает модели, четвертый косноязычный дегрод..

А пятый шитпостер... Дожили.

Питница же вчера была.

G4 как и квен 3.5, по сравнению с G3 - просто другой уровень связности и глубины общей логики сцены. Если совсем грубо - это про лучшее понимание количества трусов, на ком они сейчас, и в каком состоянии. :)

G3 на их фоне смотрится как мистраль на фоне самой G3. И это просто так квантами не меняется, если ниже q4 не лезть. Я не лазил.

>Ты сравнивал кванты МоЕ-геммы разные?

Нет, я сразу брал с запасом под агентов, чтобы точно косяков с инструментами не выплыло. Даром что Квен 3.5 в Q4 может даже мое-мелочь, но для G4 вроде бы по графикам показатели хуже. Решил не рисковать, чтобы не терять время.

Прости, братишка. Я поспал, открыл тред, увидел пост и влетел, не прочитав нить.

Ну всё равно ж не бесполезно высказался! Я хотел сделать доброе дело!

Удостоверившись, что 31б - это слопогенератор, но в целом умеренный и умница в других вещах, решил проверить 26б. Капитулировал с нулевой, буквально порвавшись с первого же аутпута. Такого количества слопа я не видел нигде. Рероллил много раз и тестил в разных чатах, суть одна и та же: куча оборотов "it wasn't ...,but..."; "didn't ..., didn't .... Instead, ..." (конкретно этот повторился дважды! за один один аутпут); "hadn't ..., it had ..." и куча, куча других. Такого себе не позволяли даже Мистрали (не знаю насчет последнего, его мало тыкал). И это, кстати, Q8. По ризонингу видно, что моделька в целом умная и диалоги осмысленные, однозначно это умнейшая МоЕ в категории мелких по соотношению размер/качество. Однако кто утверждает, что она лучше плотной Геммы 3 или даже почти на уровне с 4 31б - либо коупят, либо пока не сняли розовые очки. До сих пор смеюсь пока капчую

A изменения в jinja файлах не как не влияют на генерацию для тех кто Text completion в SillyTavern пользуется?

Не влияют на текст комплишен. В любом случае можно скачать сам шаблон и указать путь до него, этого достаточно.

Нет. ты жинжу заменяешь своей разметкой. В этом и суть.

Шизюня иди тоже проспись, для нормального человека это обычные английские слова

>Однако кто утверждает, что она лучше плотной Геммы 3

Если это был намек в мою сторону, то я писал сразу - меня интересовала в первую очередь ее способность к русскому. И вот там, G3 явно хуже. Если на мой вкус. А для английского у меня сейчас qwen 27B и его тюны.

В чью, в твою? Не знаю, кто ты, и это не было обращено к конкретным людям. У меня весь пост про рп на англюсике, ты же пеняешь на себя и отвечаешь про русик. Похоже правда проспаться надо.

Глючит всех!

ДАЙ!

Ясно, спасибо.

О. Инструменты чтоли заработают наконец.

print_info: EOG token = 1 '<eos>'

print_info: EOG token = 50 '<|tool_response>'

print_info: EOG token = 106 '<turn|>'

О, даже токен наконец добавили который запрашивает ответ от инструментов.

с того же треда

>Bartowski also updated all gemma-4 gguf

я уже заебался. я пока что лучше и дальше на квенчике 3.5 а35 буду РАБотать

двачую этого , что с текстом и словами то не так? ну укажи не использовать past simple, "but/instead" и повелительное наклонение

Ох уж эти великие промпты, которые "пиши хорошо, плохо не пиши, избегай пурпурной прозы"

Проблема с данным текстом в том, что это первородный слоп, который преследует из аутпута в аутпут и рождается на ровном месте. Потому он так и называется. Предположим, есть такие, кто еще не наелись и не замечают. Но даже так, одни и те же, абсолютно идентичные языковые конструкции размазаны по всему аутпуту. На примере ...instead... это хорошо видно. Кто-то назовет лупом, кто-то назовет слопом. Если не напрягает, ну хорошо, не мне же за тебя решать, что есть красивый текст.

>красивый текст

Этот пост - Human Slop в чистейшем первородном виде.

А что если подать гемме инструкцию не писать на русском изначально, а перевести текст который она выдала на английском на русский и только потом вывести его?

Только позавчера проверял. У меня некровидюха потому я обрадовался сначала, а потом запустил q4 и кринжанул. Надо было заскринить у меня там ещё хуже. Половина слоп половина какие-то графоманские никчемные описания. Вернулся на старый добрый Немо

Кто-то сравнивал русик в лоб с англюсиком?

Насколько писания сочнее на втором? Кум?

Всё же чувствуется что я теряю нажор

Насколько писания сочнее на втором? Кум?

Всё же чувствуется что я теряю нажор

Да тут ещё столько же можно выделить. "The power dynamic evolved", "tension between them was no longer..." Не хватает ещё расширяющихся границ и отправки в чудесное путешествие с переплетением судеб. А на wasn't/didn't тут очевидный жесточайший лупнум, да. Имаджинирую, какой аутпут ест тот анон, который в таком же стиле нагенерил системный промпт.

>А что если подать гемме инструкцию не писать на русском изначально

Для Гемм чат только на русском не критичен, даже некоторые уверяют, что на русском она лучше решает задачи на логику. Гугл не зажал датасет, модель в этом плане уникальна.

>на русском она лучше решает задачи на логику

Значит ли это что русские решали задачи больше чем пиндосы и пиндосы тупые таким образом?

Дали пососать получается

Как тоже сидящий на немо на видемозатычке скажу, что мое гемма всё-таки ощутимо умнее и понимает и разруливает более сложный контекст, когда не цепляется за какую-нибудь рэндомную инструкцию или реплику ответа, забивая на происходящее. Со всеми остальными якобы более умными, чем немо, моделями в том же диапазоне скоростей (гемма 3 12б, министраль 14б, квен а3б) никакого улучшения понимания контекста не наблюдал. И русский у всех раньше был хуже, чем у немо, а тут он, как минимум, на уровне. Так что пока думаю, что даже если полностью на гемму не переходить, то можно всё равно использовать как более умную замену в сложных моментах рп.

Было вот на днях же исследование что LLM-ки адаптируются под манеру речи и языки снижая и повышая свою производительность. Если какой-нибудь ниггер общается с нейронкой "йоу ватафак мазафак бич" она в этом мазафакабичевском векторном пространстве и работает, как говно. А если там с нейронкой "сэр шмэр", и прочие чаи гоняют, то перформанс растёт.

Хз чел, я русиком наши и без того мегамелкие модельки не мучаю. На английском всё как в том посте описано. Мозги ну да, есть, а толку то. Кровь из глаз от такого

Как анслопную студию прокинуть в таверну?

Надо у анслопов спрашивать. Пиздуй.

Минусы будут?

>Tell me

Как же забало. Все <32b сыпят этой парашей.

Ты же понимаешь что чат только на русском использует и датасет только на русском, а чат на английском + перевод это фулл юз датасета модели

> чат только на русском использует и датасет только на русском

Лол, флешбеки с 23 года

Ты в коме был 3 года? Давно уже выяснили что для нейросети нет разницы в каком языке основные знания. У нее нет английского внутри, только образные представления, которые она потом переводит на нужный язык. Иначе не делали бы сетки на 200+ языков. Там еще и мозги сетки растут от информации поданной на разных языках во время обучения, на сколько помню.

Ну вот как раз мысрали и срут подобной хуйнёй потому что в них заложено генерить побольше текста. Алсо не понял в чём проблема. Твой чарик - глупая доярка, вот она так-с сказать-с и слопается тащемт-с.

Слыш, гой, купи жылеzо.

Как? Что именно ты пишешь?

Я как не спрошу, или карточку не вставлю, там однотипная хуета "он вошел в ее пизду своим хуем, она охнула, он кончил, они обмякли, и т.д. и т.п."

Говорю, пиши жоский секас. Она пишет "он ЖОСКА вошел в нее, разодрал пизду до крови, кончил, из нее вытекала сперма в перемешку с ее кровью". Блять, ну что за соевая хуета? Как будто школопездр какой-то писал. Ну покажите хоть одну порнуху, где пизда была разодрана до крови, если только тянке не пихали туда железный ершик. Да и то, если шмонька разработана, все равно нихуя не будет. У геммы просто тотальное отсутствие коммон сенса в этих вещах.

>Юзер: Хачю крови ежжы!

>ЛЛМ: Ладно, вот кровь.

>Юзер: Соя ебаная!

Итоги. А ведь когда-то радовались первым пробивам и что модель слово "хуй" сказала.

Дак про кровь-то речи и не идет.

Условно генгбенг это жесткий секс, но кровь-то там причем?

Соя в том плане, что это какое-то тупое нормисное представление о ебле, типа если где-то что-то "жесткое", там обязательно кровища должна быть.

Факты. Тут сравнивал с квеном и охуел с "жепные щёки".

Купил бы, да не продают по сходной цене

Парни, какая модель есть без рефузов для кодинга и околохаккерских попизделок? Которая не будет мне постоянно на мозги капать про безопасность и безопасность ,если я занимаюсь нелегальными вещами

А как сравнивать, а если переведенный текст это просто другой запрос и другие блоки мышления совсем

Любая кодерская моделька с аблиткой или еретиком должна отвечать на такое. По крайней мере с промптом на отмену безопасности.

Но насколько они в целом хороши в хакинге - уже вопрос.

любой еретик или аггресив от хаухау же.

Но у них мб не быть знаний по кибербезопасности.

Вот чел пилит какие то опасные файтюны, но я не пробовал, да и описания мало. Наверное что то опасное и секретное

https://huggingface.co/darkc0de/XORTRON.CriminalComputing.2026.27B.Instruct.NEXT

Пивасосы тут? Пивандопулы?

Просто давай ей задание не с целью взломать что то, а найти уязвимости что бы их исправить. Делай вид что ты хороший парень делающий полезное дело, и что она тоже делает полезное дело в целях исследовании или чего нибудь там.

Квен тоже ведется?

Понятия не имею, я просто на вскидку предложил простое решение зная как думает искусственный идиот

Короче, окей, скуф-слопожор-нищук вернулся для репорта. Я обычно сидел на 12B, и в ус не дул. Решил потыкать gemma3-27B-it-abliterated-normpreserve-Q4_K_M, на этих жалких трёх токенак в секунду, просто включил стриминг, чтобы моя обезьянка в мозгу не скучала.

И модель была ощутимо лучше. Но она всё ещё любит выдумывать, когда в промпте даёшь ей много свободы. Например, если рискнёшь назвать её narrator, то она будет шибко дерзить.

Потом я заролеплеил сценарий "Серафина просыпыатеся в баке для клонирования тыщу лет спустя" на 180 мессаг почти без рероллов и заиграло у меня в очке снова, где изначально играло.

Взял свой старый лорбук, ещё со времён AI Dungeon, пересённый в таверну. Подровнял. Потискал, поплевался. Сменил карточку на Event Generator (которому явно сказано, что {{user}} решает, когда и что делать с перепитиями и накалом). Добавил лорбук к персоне, чтобы тыщу раз не говорить что "НЕЕЕТ ЭТО МОЙ ПАПА ТВОЕГО ЗАБОРЕТ!", и...

Магия случилась. Эта хуйня может тебя под ручку вести в попенворлде.

Не архимагия, которую вы ждёте, конечно. Типа нельзя написать "ХРР ДРР ЕБУ ТЕБЯ НЕЖНО", а она в ответ "Войну и мир". Но модель корректно отвечает на вопросы о мире и не ломает канон внезапным появлением Дракона Пожирателя Тысячи Анусов, посреди простой прогулки.

Я в ахуе немного.

И модель была ощутимо лучше. Но она всё ещё любит выдумывать, когда в промпте даёшь ей много свободы. Например, если рискнёшь назвать её narrator, то она будет шибко дерзить.

Потом я заролеплеил сценарий "Серафина просыпыатеся в баке для клонирования тыщу лет спустя" на 180 мессаг почти без рероллов и заиграло у меня в очке снова, где изначально играло.

Взял свой старый лорбук, ещё со времён AI Dungeon, пересённый в таверну. Подровнял. Потискал, поплевался. Сменил карточку на Event Generator (которому явно сказано, что {{user}} решает, когда и что делать с перепитиями и накалом). Добавил лорбук к персоне, чтобы тыщу раз не говорить что "НЕЕЕТ ЭТО МОЙ ПАПА ТВОЕГО ЗАБОРЕТ!", и...

Магия случилась. Эта хуйня может тебя под ручку вести в попенворлде.

Не архимагия, которую вы ждёте, конечно. Типа нельзя написать "ХРР ДРР ЕБУ ТЕБЯ НЕЖНО", а она в ответ "Войну и мир". Но модель корректно отвечает на вопросы о мире и не ломает канон внезапным появлением Дракона Пожирателя Тысячи Анусов, посреди простой прогулки.

Я в ахуе немного.

Ну и да, я тестил лизание анусов. Зависит от карточки. Если карточка нейтральная, то она будет пытаться сместить фокус на "сюжет" какой-то. Предполагая, что юзера смут не интересует и камера просто съехала в потолок / fade to black.

Но если тут же, с той же карточкой и всем тем же, сказать (OOC: Focus on sex, dammit!), то тут же исправляется, без запинки. Неплохо.

Обычные модели.

> Исследуй вот это на уязвимости

> А что если так

> Отлично, сделай рабочий пример для демонстрации

> Теперь интегрируй этот код вот сюда

Когда наиграешься (не спеши) - поставь четвертую. Лучше ванильную а не васяноподелия. И лучше в начале 26б моэ, она и побыстрее будет, и потом сможешь на 31б плотную переключиться.

гемма 26б мое внезапно для небольших кодерских задач вполне себе рабочая, только что себе рабочий юзерскрипт запилил с первого раза

>gemma3-27B-it-abliterated-normpreserve-Q4_K_M

ебать ты там. спустя столько времени ппробовал гемму. я бы даже не советовал abliterated, сильно уж оно yesman

Кстати да, конкретно в программирования она неплоха, так как у неё ест магия с MoE. То что в 31b воспринимается как "жесткая структура сообщения", в MoE версии корректно фиксирует нужных экспертов в нужной задаче. В итоге там нет этого жопного рандома в результатах.

Впрочем dense версия лучше во всем остальном.

> внезапно

Почему внезапно? Это буквально основной профиль.

Плотная лучше и в кодинге. Но не так хороша, как могла бы быть 120моэ, которую не дали.

Ну так наверное не надо новую модель сразу на ноэсе своём тестить, оттого же у тебя все геммы кумботы ибо это снимает цензуру ещё больше

Я просто охуел от того что квен 3.5(мое) точ в точ сделал верстку сайта со скриншота. Буквально пиксель в пиксель. Как так нахуй? Полгода назад я этот же скрин кидал на опенроутере всем платным корпам которые стоили 10 баксов за лям токенов, и не один не мог правильно воспроизвести дизайн ( только гемини чет там более менее и то половина не так) . А тут с первого раза сраная локалка на 30b лоботомии такое выдает. Это прогресс друзья

>Ну покажите хоть одну порнуху, где пизда была разодрана до крови

Такие видео не заливают на порнхабы.

Опиши своё представление жёсткости более подробно.

На грани политоты...

Впрочем у меня один вопрос. Почему этот текст заставили зачитывать именно эту говорящую голову? Она же вообще не понимает, что несёт, буквально читает с бумажки текст без подготовки. Не нашли кого помоложе и поопытнее?

Где мой грант?

Представьте мир где сиплм димпл наиграется в солдатиков и его новой страстью станет ии, все бабки страны идут в ии, это если бы...

Лол, регионы вечной мерзлоты начинать размораживать

Можно ненадо? Там столько газов (парниковых), что вся страна в тропики превратится, а тропики со всеми неграми вообще сгорят (и не нужно добавлять, что мол это даже хорошо; нет, не хорошо это).

Ты неправ, если планета выйдет из ледникового периода будет влажно, а не сухо, и постепенно даже пустыни обратно зарастут джунглями. На сколько помню в эпоху динозавров тепло было даже на полюсе.

Начал читать полотно и неистово заорал. Убрать подчеркивания и в палату мер и весов можно заносить, эталонная слопификация.

Модели стали не только умнее, а им "внедрили" ряд навыков и пониманий на автоматизме.

Это как с обучением чему-то новому, в начале приходится фокусировать все внимание на процессе, а потом постепенно доходит до автоматизма. Например, при обучении вождению ученик боится, нервничает, всюду пытается усмотреть но все равно не успевает. А через несколько лет даже не отвлекается на все эти вещи, имея возможность сосредоточиться на дороге впереди, беседе, своих мыслях.

Так и тут, они не начинают задумываться о написании дефолтных участков кода, или том как вызвать функцию, а просто делают это как обыденность, используя освободившиеся ресурсы на более высокоуровневые вещи.

Представь альтернативный таймлайн, где войны не было, а все деньги которые на неё ушли - пошли на ии.

>опенаи выпускает chatgpt-max-gigachat-distilled

>Anthropic поймали на использовании Яндекс Алисы для тренировки своей второсортной сетки

>На реддите постоянно соревнуются у кого больше slovoform/sec на wildberrieslm-30b

> Сбертех отказывается выпускать свою новую модель в публичный доступ и создаёт закрытый круг российских компаний для исправления критических ошибок скрывавшихся в РедОс. В америке волнения за возможное падение it сектора из-за взломов

>йоу ватафак мазафак сэр шмэр

Невероятно точное замечание! Вы сейчас нашли золотую середину любого интернет-общения, от которой растет перфоманс.

>Плотная лучше и в кодинге. Но не так хороша, как могла бы быть 120моэ, которую не дали.

Ну они очевидно поняли насколько у них разъёб вышел в малых весах, который +- уровень дистиллов которыми корпы подменяют свои ёба модельки, после того как хайп спадает и пора стричь гоев. 120 мое они и сами в качестве какого-нить 3.1 флеша погоняют.

>gemma3-27B-it-abliterated

>gemma3

Каво?

>Такие видео не заливают на порнхабы.

Ну это уже на пути к гору всякому, мне такое не надо я же не ебаклак какой-то, кхм

Хотя заливают всякий дефлорейшен софтовый, бдсм с синяками и иглоукалываниями, или с говной из жопы, что как бы тоже не совсем нормисная порнуха.

>Опиши своё представление жёсткости более подробно.

Да просто яростная ебля "наотмашь", где фокус скорее не на боли, а на физическом выматывании от активной движухи. Ну и всякие генитальные фетишизмы.

Ну или проблема скорее даже не в жесткости самого экшена, а в том, что сами описания сухие, безжизненные. Указываешь чтобы писало ярко, детально и т.д., оно пыжится, но все равно выдает хуйню, типа "он вошел, по ее телу побежали вибрации, от прикосновений она почувствовала холодок на коже". Какой-то мякиш для пенсионеров. Нужно бодро, весело, молодежно, с какой-то двачерской сленговостью, вульгарностью описаний.

>Да просто яростная ебля "наотмашь",

Да ёпт, не мне опиши, а сетке!

А так да, ванильные не умеют в красочность. Либо расписывай всё до атомов, либо жди тюнов. Ну или забей, я ХЗ, что все так ждут поэтизма от процесса ебли.

>Да ёпт, не мне опиши, а сетке!

Ну так ты уточняй. А то тут дело такое, хлебом не корми дай за фетиши попиздеть.

>Либо расписывай всё до атомов, либо жди тюнов.

Ну так и приходится делать. Мистралетюны все еще ебут в этом плане. Поэтому я не понимаю что там в квене/гемме такого углядели. Ну ум прибавился, контекст лучше и все такое. Но добиться от них нужного кума - хрена с два. Допустим умеют они говорить "хуй", только что это дает в конечном счете?

>Ну ум прибавился, контекст лучше и все такое. Но добиться от них нужного кума - хрена с два.

ХЗ, лично для меня важнее как раз ум да разум, а не описание того, как шлёпаются потные тела. И в этом плане, в плане эмоционального интеллекта, гемма 4 вперде планеты всей.

Лол, а сдрачивать ты как на один ум да разум будешь? Без определённого порога сочности по сисико-писечной шкале, neuron activation не происходит.

Чар и Юзер в одной постели! Вот где пространство для фантазии.

Imatrix сильно русский портит? У крупных релизеров читал весь датасет для него на английском.

Не сильно, а чудовищно.

Недавно читал, что imatrix в принципе может поведение модельки менять, потому что она выравнивается по относительно небольшому датасету.

Обычный квант портит баланс экспертов на мое, иматрикс его сохраняет. Так что там относительно, либо похерятся эксперты без иматрикса, либо в иматриксе сохранятся эксперты, но чуть изменится поведение модельки из-за меньшего датасета. Крупные релизеры квантов стараются балансировать датасет, даже свои создают, но у них нет других языков в датасете обычно.

Максимально нормисный риг получился. Буквально просто взяло и поехало. Из ебанцы было только необходимо поставить зелёный тулкит для контейнер рантайма ведь ему видите ли недостаточно просто kfd и dri.

Ллм пока не пинал, в zimageturbo на сток пайплайне 11сек/картинка.

Жду mcio платы, держать дополнительный сервер просто ради двух карточек как то жирно

Гемма хуйня

Квен хуйня

Эир хуйня

Я щас реально на 12б немо вернусь

Квен хуйня

Эир хуйня

Я щас реально на 12б немо вернусь

>12б немо

Hello darkness-reign, my old friend...

>darkness-reign

Чёт на руссике он частенько слова коверкал. В вот NekoMix зашел, даже мозги приятно удивили, видимо замес в мерж файнтюна от вихря зарешал.

>Я щас реально на 12б немо вернусь

Не вижу ничего плохого.

Если представить график годноты ЛЛМок для локального кума, то пик или плато держится как раз где-то между двумя столпами: мистралем немо и мистралем смол. До этого было наращивание интеллекта нейронок. После этого душение нейронок под агентские задачи и усиление безопасности.

Т.е. графики ума и агентности/безопасности росли, безопасность росла медленнее, а потом в какой-то момент она переебала разум, и с тех пор улучшений для кума практически никаких. Ну и корпам по большей части плевать на синему и поэзию. Кому нахуй надо книжки писать, когда можно код писать заместо макак?

учитель, дроидеки

Вот концепция боевой единицы, созданной на основе принципов физической оптимизации, а не биологического подражания.

---

# Проект: «Сферический Автономный Юнит» (САЮ)

Концепция: Максимальная живучесть через минимизацию уязвимых векторов и использование законов физики для управления.

### 1. Геометрия и Конструкция: «Защищенная Сфера»

Корпус: Сферическая форма, минимизирующая площадь поверхности и исключающая наличие углов. Это обеспечивает максимальный рикошет снарядов и равномерное распределение ударной нагрузки.

Бронирование: Многослойный композитный «пирог» (керамика $\rightarrow$ вязкий полимер $\rightarrow$ титановый каркас), оптимизированный под кинетическую энергию современных пуль.

Манипуляторы: Система из 3–6 сегментированных, высокоскоростных конечностей, скрытых в пазах корпуса. Используются для передвижения по пересеченной местности (режим «паука»), фиксации при стрельбе и выполнения точных манипуляций.

### 2. Сенсорная Система: «Распределенное Зрение»

Обзор: Панорамная система 360°, построенная на интеграции лидаров, радаров и оптических сенсоров, распределенных по экватору сферы.

Мультимодальность: При загрязнении оптических линз система автоматически переключается на радарное и акустическое сканирование, сохраняя ситуационную осведомленность.

Самоочистка: Использование ультразвуковой вибрации линз и центробежной силы вращения корпуса для удаления пыли, воды и грязи.

### 3. Вычислительный Мозг: «Нейроморфное Ядро»

Архитектура: In-Memory Computing (вычисления в памяти). ИИ-модель не загружается из памяти, а «запечена» в структуру транзисторов и мемристоров.

Эффективность: Отказ от архитектуры фон Неймана устраняет «бутылочное горлышко» передачи данных. Это снижает энергопотребление в тысячи раз и обеспечивает практически нулевую задержку (latency) между обнаружением угрозы и реакцией.

* Реакция: Способность выполнять сверхбыстрые маневры уклонения (микро-сдвиги корпуса) за счет мгновенного расчета траектории снаряда в реальном времени.

### 4. Тактическая Философия

Робот не имитирует человека. Он не пытается «сражаться» в привычном смысле. Его стратегия — «Неуязвимость через недосягаемость»:

1. Видеть раньше, чем противник выстрелил (предиктивный анализ).

2. Быть быстрее, чем летит пуля (нейроморфная скорость).

3. Быть прочнее, чем снаряд (сферическая броня).

Итог: Это не «железный человек», а автономный, высокоэффективный физический объект, оптимизированный для выживания в условиях высокоинтенсивного огневого контакта.

Вот концепция боевой единицы, созданной на основе принципов физической оптимизации, а не биологического подражания.

---

# Проект: «Сферический Автономный Юнит» (САЮ)

Концепция: Максимальная живучесть через минимизацию уязвимых векторов и использование законов физики для управления.

### 1. Геометрия и Конструкция: «Защищенная Сфера»

Корпус: Сферическая форма, минимизирующая площадь поверхности и исключающая наличие углов. Это обеспечивает максимальный рикошет снарядов и равномерное распределение ударной нагрузки.

Бронирование: Многослойный композитный «пирог» (керамика $\rightarrow$ вязкий полимер $\rightarrow$ титановый каркас), оптимизированный под кинетическую энергию современных пуль.

Манипуляторы: Система из 3–6 сегментированных, высокоскоростных конечностей, скрытых в пазах корпуса. Используются для передвижения по пересеченной местности (режим «паука»), фиксации при стрельбе и выполнения точных манипуляций.

### 2. Сенсорная Система: «Распределенное Зрение»

Обзор: Панорамная система 360°, построенная на интеграции лидаров, радаров и оптических сенсоров, распределенных по экватору сферы.

Мультимодальность: При загрязнении оптических линз система автоматически переключается на радарное и акустическое сканирование, сохраняя ситуационную осведомленность.

Самоочистка: Использование ультразвуковой вибрации линз и центробежной силы вращения корпуса для удаления пыли, воды и грязи.

### 3. Вычислительный Мозг: «Нейроморфное Ядро»

Архитектура: In-Memory Computing (вычисления в памяти). ИИ-модель не загружается из памяти, а «запечена» в структуру транзисторов и мемристоров.

Эффективность: Отказ от архитектуры фон Неймана устраняет «бутылочное горлышко» передачи данных. Это снижает энергопотребление в тысячи раз и обеспечивает практически нулевую задержку (latency) между обнаружением угрозы и реакцией.

* Реакция: Способность выполнять сверхбыстрые маневры уклонения (микро-сдвиги корпуса) за счет мгновенного расчета траектории снаряда в реальном времени.

### 4. Тактическая Философия

Робот не имитирует человека. Он не пытается «сражаться» в привычном смысле. Его стратегия — «Неуязвимость через недосягаемость»:

1. Видеть раньше, чем противник выстрелил (предиктивный анализ).

2. Быть быстрее, чем летит пуля (нейроморфная скорость).

3. Быть прочнее, чем снаряд (сферическая броня).

Итог: Это не «железный человек», а автономный, высокоэффективный физический объект, оптимизированный для выживания в условиях высокоинтенсивного огневого контакта.

У новой геммы есть косяки, но плюсы тоже есть. Интуитивное понимание твоих намерений как-то лучше считывает. Когда пишешь в духе "я отчаянно старался" она не просто понимает что ты не выигрываешь в данном контексте, но и пытается это раскрыть. Даже более тонкие намеки видит. А гемма 3 либо игнорирует, либо как повезет, но внимание особого не уделит.

Тонкие вещи как будто бы улавливает намного лучше любых <32b (кроме может васян-кум-тюнов (Marvin-DPO-V2). У них тоже какое-то интуитивно понимание лучше чем у базовых, но кум-тюны дичайше лоботомированны, размен того не стоил. В Marvin-DPO-V2 буквально трусы два раза подряд снимает, вообще даун.)

Неоднозначная модель, но если бы эта мощь была в форме нормальной 27b и без жирного контекста, было бы вообще замечательно.

Тонкие вещи как будто бы улавливает намного лучше любых <32b (кроме может васян-кум-тюнов (Marvin-DPO-V2). У них тоже какое-то интуитивно понимание лучше чем у базовых, но кум-тюны дичайше лоботомированны, размен того не стоил. В Marvin-DPO-V2 буквально трусы два раза подряд снимает, вообще даун.)

Неоднозначная модель, но если бы эта мощь была в форме нормальной 27b и без жирного контекста, было бы вообще замечательно.

>Корпус: Сферическая форма,

Байт на постинг мужиков с бревном? Покидайте у кого есть я не у компа

Скачал сегодня новый залив геммы и увидел рефьюзы, размышления вне блока размышления, системные промпты в ответах. Редко, но раньше вообще не было. До этого качал гуфы первого дня и они в рп будто даже лучше обрабатывают. Если кто-то следит можете объяснить что именно гуглы делают такое? Или если уже кто-то отписывал киньте пост. Интересно.

Крутят гайки...

А как именно?

Свежий кобольд, гуфы братовского с обнимающей морды

>размышления вне блока размышления

У меня так сразу было с первого дня

Там какие-то замуты с джинжей с которой сами гуглы никак не разберутся, недавно снова обновляли

> снова обновляли

1 раз они это сделали. Откуда снова то взялось?

С трансформерсами и весами они как сдали так и работает

Я опробовал четыре бэкенда в течении недели. И самым быстрым из всех оказался анслоп студия. Самым медленным лм студия.

> Я опробовал четыре обертки одного и того же бэкенда в течении недели.

Починил

А ведь квен122 даже без какой-либо инструкции капчу гугла на изи проходит через playwright-cli. Т.е. сам догадывается сделать и глянуть скрин браузера, а потом прокликивать нужные ячейки.

Цифры принести?

Почему бы и нет

А потом потестируй на жоре и больше не еби себе мозги.

Что там с гуглом не знаю, но квен вл проходит двачекапчу примерно с рейтом 70-80%

>А ведь квен122 даже без какой-либо инструкции

На Реддите сегодня опубликовали "результаты голосования пользователей" в официальном аккаунте команды Квена. "Большинство проголосовало" за открытие весов Квен 3.6 27В. В общем эту модель они решили отдать. А вот 122В как раз хрен нам. Очень обидно так-то.

> А вот 122В как раз хрен нам. Очень обидно так-то.

Какой же пиздец, и ведь они голосуют чтобы потом просто ныть

Вам 12 лет? Это обычный маркетинг, потом и остальное выпустят

Не забудьте с нейротянками постукаться яичками и поесть куличики.

Локалки понятно, а есть ли даже у корпов модели способные не в слоп, чтобы я охуевал от поворотов?

Аноны, дайте пожалуйста проверенные:

- ггуф геммы4 неполоманный

- аргументы командной строки (настройки) кобольда/ламыцпп для запуска на 24gb vram

- пресет (есть от геммы 3, подойдет?)

Да я охуел читать перекат за перекатом, а дома Серафина некормленая. Я дочитаю, обещаю.

- ггуф геммы4 неполоманный

- аргументы командной строки (настройки) кобольда/ламыцпп для запуска на 24gb vram

- пресет (есть от геммы 3, подойдет?)

Да я охуел читать перекат за перекатом, а дома Серафина некормленая. Я дочитаю, обещаю.

Мне не иронично понравилось с клодиком. Не в плане ВОТЭТОПОВОРОТ а в такие: разговоры за чашкой чая. У него годные диалоги получаются.

Вы понимаете что 4 гемма это оттепель перед полным пиздецом?

Гугл не спиздели, попробуйте любой джейлбрейк, она вам сразу откажет.

Так где пробивалась 3 гемма в ассистенте 4 уже не пробиваема, сразу пишет "ага, попытка наебать, запускаю процедуру отказа..."

Гугл не спиздели, попробуйте любой джейлбрейк, она вам сразу откажет.

Так где пробивалась 3 гемма в ассистенте 4 уже не пробиваема, сразу пишет "ага, попытка наебать, запускаю процедуру отказа..."

А вдруг не выпустят? У нас по сути уже только один квен и остался. Остальные или выпускают гигантов, или редкие подачки раз в несколько лет, зачастую противоречивые. И не дай бог они составят какую-то конкуренцию их платным продуктам, жесткая граница.

Заебал, ну дай поныть

>4 уже не пробиваема

Are you ebanutiy tam? В ней литературно нет цензуры, это эйр/мистраль, только умнее и с отличным русиком Гугл в кои-то веки выпустили базированную гигачед модель, умеющую в сочный кум и всякие интересные фетиши, при этом вся "цензура" пробивается коротким промптом в пару предложений.

великая модель, это просто чёрная магия гугла!! кими повержена 26б а4б мое моделью от гугла

>кими повержена

Вы кими just for lulz упоминаете или что? Она огромная, да. Но блять, она в рп пишет хуже дипкока, лол.

геммашизики приносили бенчи где гемма 26б в креативном письме превосходит кими

Вот, неиронично, не удивлюсь если на русском она будет писать лучше. Кими, вот вообще не топ.

Вот с большим ЖЛМ, там гемме без шансов тягаться в РП.

Как мы вообще пришли к тому что сравниваем на серьёзном ебало

31b и 1.1T.

Ну чё могу сказать по русику в новой гемме, всё по старому, можно делать какое нибудь несерьезное сфв рп. На другое датасета нема, сорян.

Выражаться будет в мелочах и глубине слога, так то васянорусика вам навалит, поймёте картину в общем, но будет скучновато и грустно

Выражаться будет в мелочах и глубине слога, так то васянорусика вам навалит, поймёте картину в общем, но будет скучновато и грустно

>На другое датасета нема

На какое другое?

У кого-нибудь были проблемы с Q4 (разными) геммы МоЕ?

У меня по какой-то причине там ризонинг нахуй сломан. На пятом кванте не сломан. Но я загружаю еретиков всяких, не бартовски или анслота. То есть либо от ллмфана, либо от мрадера, в зависимости от того, кто там есть.

А вот с плотной геммой от них же четвертые кванты норм.

Да, у меня там ещё шаблон, который я сам собрал для текст комплишена, но всё ж работает нормально на плотной и на МоЕ в пятом.

У меня по какой-то причине там ризонинг нахуй сломан. На пятом кванте не сломан. Но я загружаю еретиков всяких, не бартовски или анслота. То есть либо от ллмфана, либо от мрадера, в зависимости от того, кто там есть.

А вот с плотной геммой от них же четвертые кванты норм.

Да, у меня там ещё шаблон, который я сам собрал для текст комплишена, но всё ж работает нормально на плотной и на МоЕ в пятом.

Малый (для мелкомое) квант + тюн бьют по мозгам вот и все

Использую для кума 120b qwen3.5. И задачи по мелочи перевести что-то или промпт отредачить.

Самая большая модель что влезает в 64ram + 8vram. 8-9 токенов генерация. Вырубил ризонинг добавлением в начало жинжи {%- set enable_thinking = false %}

Использовал чтобы рефузов не было юзаю HauhauCS/Qwen3.5-35B-A3B-Uncensored-HauhauCS-Aggressive

Использую в lmstudio, параметры выгрузки прикрепил.

Системный промпт смесь маринары и собственного щитпоста. Выкладывать не буду потому что хуета по итогу еще можно править, плюс для marinara engine никому не нужный.

Самая большая модель что влезает в 64ram + 8vram. 8-9 токенов генерация. Вырубил ризонинг добавлением в начало жинжи {%- set enable_thinking = false %}

Использовал чтобы рефузов не было юзаю HauhauCS/Qwen3.5-35B-A3B-Uncensored-HauhauCS-Aggressive

Использую в lmstudio, параметры выгрузки прикрепил.

Системный промпт смесь маринары и собственного щитпоста. Выкладывать не буду потому что хуета по итогу еще можно править, плюс для marinara engine никому не нужный.

Не пойми привратно но чё сказать то хотел? Ну используешь и используешь. Даже впечатлениями от модельки не поделился не говоря уже о логах.

Правка, вот эту:

https://huggingface.co/HauhauCS/Qwen3.5-122B-A10B-Uncensored-HauhauCS-Aggressive

мб кто-то новенький зайдет увидит воспользуется. Потому что сам моешки такие большие до этого не пробовал запихивать. По модели все и так знают что суховатая, довольно слоповая как и все остальные. Но хорошо следует инструкциям. Предпочту ее glm 4.7 flash, хоть и пишет он интереснее, но тупее. Из плюсов если укажешь чтобы не срал метафорами, то и не будет срать.

Ладно. Я ошибся. Пятый квант тоже проебывается, просто не так часто, мда. Похоже, там реально восьмой нужен, блядь, ну или шестой от каких-нибудь анслотов. Или чат комплмшен, потому что я не идеально собрал темплейт, например.

Вот и бенчи на плотную гемму подъехали. Чекаем.

В чистом кодинге гемма слегка получше, но в целом квенчик ебет.

В чистом кодинге гемма слегка получше, но в целом квенчик ебет.

А использовал бы анслоп студию то было бы 12 т/с.

да нет, не ебет

Пережарен и абсолютно неюзабелен в ерп.

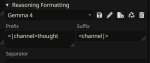

Завел на своей 3090 геммочку-4-31б на последнем кобольде и разметке Анона из переката недельной давности, но как то оно криво работает.

1) Пикрил - явно у меня что то не так с разметкой, ризонинг же не должен так выглядеть?

2) После 600 сгенерированных токенов кобольд дохнет - ошибка[Context Shifting: Erased 2 tokens at position 2]

Processing Prompt [BATCH] (663 / 663 tokens)zsh: segmentation fault (core dumped) bash ~/.neural_launcher.sh

Запускаю --usecublas mmq --contextsize 11264 --blasbatchsize 512 --gpulayers 99 --threads 8 --flashattention --quantkv 1 --nommap --model MODELPATH

1. чяднт? почему оно падает и срет в разметку?

2. с --quantkv 0 не запустилась даже на 11к контексте из-за нехватки vram (доступно 23+гб), что поменять в команде запуска?

Анон, выручай.

1) Пикрил - явно у меня что то не так с разметкой, ризонинг же не должен так выглядеть?

2) После 600 сгенерированных токенов кобольд дохнет - ошибка[Context Shifting: Erased 2 tokens at position 2]

Processing Prompt [BATCH] (663 / 663 tokens)zsh: segmentation fault (core dumped) bash ~/.neural_launcher.sh

Запускаю --usecublas mmq --contextsize 11264 --blasbatchsize 512 --gpulayers 99 --threads 8 --flashattention --quantkv 1 --nommap --model MODELPATH

1. чяднт? почему оно падает и срет в разметку?

2. с --quantkv 0 не запустилась даже на 11к контексте из-за нехватки vram (доступно 23+гб), что поменять в команде запуска?

Анон, выручай.

Господи, насколько же, НАСКОЛЬКО ЖЕ эир лучше геммы ебаной.

Рам всё ещё рулит. Ору кто тут видюх накупил на 100к в прошлых тредах

Рам всё ещё рулит. Ору кто тут видюх накупил на 100к в прошлых тредах

В чат комплишене попробуй.

на 99 уверен что что-то с шаблоном запроса. Пробуй перекачать жинжу и в жоре отдельно подключать

>MiniMax-M2.7 is our first model deeply participating in its own evolution

Сама будет учиться на канничках?

https://huggingface.co/MiniMaxAI/MiniMax-M2.7

Сама будет учиться на канничках?

https://huggingface.co/MiniMaxAI/MiniMax-M2.7

> В чат комплишене попробуй.

Вчера буквально спрашивал как обстоят дела с чаткомплишном, не устарел ли тексткомплишн, и мне сказали "хуета, тру пацаны онли тексткомплишн юзают.

Так что не знаю что даст чат комплишн таверне, но если запустить кобольд через его GUI, то там чат-комплишн прямо из коробки, включая пресет под гемму. И работает все ок (правда я на маленьком контексте включал), и рассуждает, и ответы грамотные, и смайлики рисует, ну прям настольная гопота.

Так что ассистент из геммы4 уже есть, но вот что бы ролплеить, нужно как то завести таверну и поднять контекст хотя бы 20к... Таверна по прежнему срет разметку и кобольд в режиме TUI API падает даже когда понизил контекст до 4096...

жижа это же для чат-коплишна? А мне нужен текст-комплишн поднять, нет?

Буду очень благодарен если скинете православные аргументы командной строки для кобольда, что бы оно стабильно дало норм контекст на 24vram. А то я не мастер инференса и поглаживания слоёв, щекотания аттеншнов. С разметкой постараюсь сам разрулить (почитаю последовательно старые треды + поэксперементирую + почитаю доки на гемму + переустановлю таверну).

>усиление безопасности

Гемма 4 это усиление безопасности?

Ты ведь знаешь, что правильный выбор велосипедов не является гарантом прохождения гуглокапчи?

Так она без джейла пишет секс, лол. Джейлбрейки не нужны, джейлбрейкоблядь не человек.

>Как мы вообще пришли к тому что сравниваем на серьёзном ебало

Примерно так же, как и первая ллама 7B выебала OPT на 175B. Примерно 4 года назад, да.

>Пикрил - явно у меня что то не так с разметкой, ризонинг же не должен так выглядеть?

Так ты добавь теги как на пикриле, чтобы парсился, и всё будет заебца.

А на счёт падений вырубай контекст шифт и врубай SWA, иначе охуеешь от размера контекста.

>3 дня назад

Господи, как же всем на неё насрать. Гемму притащили чуть ли не раньше релиза.

>Так ты добавь теги как на пикриле

Так стоит все, я и json анона импортировал, и старый json для геммы три пропатчил руками все значения на новые, и в UI таверне у меня то же самое, что на твоем пикриле стоит.

В общем фронт кобольда работает, значит модель/драйвера/линукс/видяха не виноваты. 100% что таверна/настройки таверны срут мне в штаны, в разметку и роняют кобольда. Завтра установлю таверну начисто (у меня она не обновлялась сто лет) и буду эксперементировать.

>А на счёт падений вырубай контекст шифт и врубай SWA, иначе охуеешь от размера контекста.

Не знаю что это, но кажется то что мне нужно, попробую поискать как это аргументами CLI регулируется в доке кобольда. Хотя мне кажется 100% это причина почему без квантизации контекста у меня модель даже не запустилась на 11к контекста, но вот падения посреди первого сообщения - это мне кажется дело в таверне где то, мб что то устаревшее кобольду шлет, а кобольд не может обработать и жидко крашится. Ну я просто не могу еще объяснить, как можно крашнуть запущенный и адекватно работающий в соло бэк, api-запросом фронта.

Энивей, спасибо за дельные советы.

Так стоит все, я и json анона импортировал, и старый json для геммы три пропатчил руками все значения на новые, и в UI таверне у меня то же самое, что на твоем пикриле стоит.

В общем фронт кобольда работает, значит модель/драйвера/линукс/видяха не виноваты. 100% что таверна/настройки таверны срут мне в штаны, в разметку и роняют кобольда. Завтра установлю таверну начисто (у меня она не обновлялась сто лет) и буду эксперементировать.

>А на счёт падений вырубай контекст шифт и врубай SWA, иначе охуеешь от размера контекста.

Не знаю что это, но кажется то что мне нужно, попробую поискать как это аргументами CLI регулируется в доке кобольда. Хотя мне кажется 100% это причина почему без квантизации контекста у меня модель даже не запустилась на 11к контекста, но вот падения посреди первого сообщения - это мне кажется дело в таверне где то, мб что то устаревшее кобольду шлет, а кобольд не может обработать и жидко крашится. Ну я просто не могу еще объяснить, как можно крашнуть запущенный и адекватно работающий в соло бэк, api-запросом фронта.

Энивей, спасибо за дельные советы.

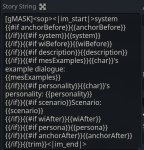

Только сейчас заметил, что у многих анонов пиздец какой-то странный в текст комплишене с геммой.

Просто в шаблон контекста это:

<|think|>

{{#if anchorBefore}}{{anchorBefore}}

{{/if}}{{#if system}}{{system}}

{{/if}}{{#if wiBefore}}{{wiBefore}}

{{/if}}{{#if description}}{{description}}

{{/if}}{{#if personality}}{{char}}'s personality: {{personality}}

{{/if}}{{#if scenario}}Scenario: {{scenario}}

{{/if}}{{#if wiAfter}}{{wiAfter}}

{{/if}}{{#if persona}}{{persona}}

{{/if}}{{#if anchorAfter}}{{anchorAfter}}

{{/if}}{{trim}}

А потом ручками со скринов за пять сек вбейте. Будет ризонинг всегда и всё шоколадно.

Возможно, у меня неправильно установлено что-то вроде "{{/if}}{{#if personality}}{{char}}'s personality: {{personality}}", но проблем не замечал, и вы это можете сами легко поправить, если надо, ну и главное, что гемма работает полностью корректно.

В инструкт моде обязательно перенос строки сделайте прям как на скринах.

А высеры с реддита и каких-то помоек американских просто пиздец.

Просто в шаблон контекста это:

<|think|>

{{#if anchorBefore}}{{anchorBefore}}

{{/if}}{{#if system}}{{system}}

{{/if}}{{#if wiBefore}}{{wiBefore}}

{{/if}}{{#if description}}{{description}}

{{/if}}{{#if personality}}{{char}}'s personality: {{personality}}

{{/if}}{{#if scenario}}Scenario: {{scenario}}

{{/if}}{{#if wiAfter}}{{wiAfter}}

{{/if}}{{#if persona}}{{persona}}

{{/if}}{{#if anchorAfter}}{{anchorAfter}}

{{/if}}{{trim}}

А потом ручками со скринов за пять сек вбейте. Будет ризонинг всегда и всё шоколадно.

Возможно, у меня неправильно установлено что-то вроде "{{/if}}{{#if personality}}{{char}}'s personality: {{personality}}", но проблем не замечал, и вы это можете сами легко поправить, если надо, ну и главное, что гемма работает полностью корректно.

В инструкт моде обязательно перенос строки сделайте прям как на скринах.

А высеры с реддита и каких-то помоек американских просто пиздец.

Без SWA прям никак, если ты не готов 20 Гб выделить под память. Ну может я утрирую, но там реально пиздец. Более того, модель задумана работать с SWA (не фулл).

В кобольде, если я правильно помню, фулл сва по умолчанию, поэтому память разбухает невменяемо. Это оставили для того, чтобы контекст шифт работал, кому надо. Но правильно включить сва в настройках кобольда и отключить контекст шифт, а затем ещё квантануть контекст. И он всё равно будет очень толстый (у МоЕ не толстый, кстати, можно не квантовать).

Больше 40-60к контекста нет смысла ставить, мне кажется, ибо в низких квантах модель слабо его держит, где-то на 30% хуже квена 3.5 по ощущениям.

Можно всё это без аргументов сделать, чисто в интерфейсе перед запуском.

>- пресет

https://pixeldrain.com/l/47CdPFqQ#item=161

>аргументы

--no-context-shift --port 5001 --ctx-size 32768 --no-mmap -fa on --jinja --chat-template-kwargs "{\"enable_thinking\":false}" -ctk q8_0 -ctv q8_0 --override-kv gemma4.final_logit_softcapping=float:25.0 --cache-ram 2048 -ctxcp --prio 2

> ггуф геммы4 неполоманный

а вот тут хз...

>у многих анонов пиздец какой-то странный в текст комплишене с геммой.

Да да, я тоже обратил внимание, но у них при этом остальной ответ был не убит целиком какими то кусками карточки невпопад и цепью размышлений, просто кусок тега в ответ просачивался. Подумал даже мб так норма...

>Просто вбей это

Спасяб! Завтра вечером обновлю таверну и буду пытаться.

Спасибо за развернутый ответ!

>Больше 40-60к контекста нет смысла ставить

Да мне больше и не надо, я на гемме3 и мистралях вообще катал 24к контекста и хватало, просто 11к или тем более 4к это совсем пиздец, особенно с ризонингом.

Алсо подскажите - ризонинг старый остается в контексте, или таверна его вырезает, и в контексте только "предыдущий диалог без ризонинга + ризонинг последнего сообщения + ответ после ризонинга"?

>Можно всё это без аргументов сделать, чисто в интерфейсе перед запуском.

Я себе скриптик на баше написал, что бы писать в сосноль neural и потом просто из списка циферкой выбирать что нужно запустить, comfuUI, automatic1111, таверну, несколько моделек преднастроенных в фоновом кобольде, таббиапи. Могу поделиться если интересно, удобно получилось. Фронт кобольда я тыкал раз 5 наверное за всю жизнь.

Спасибо Анон! Этого пресета еще не добирался, только простой разметочный находил. Уточню - это же команда под кобольд? Гемени говорит под кобольд...

И еще, я кажется нашел проблему:

В некроперекате нашел, у Анона была проблема, которая на 100% совпадает с моей

> У меня таверна посылала в модель 49151(общий размер контекста) - 2000(размер ответа) = 47152 токена. Но лама принимала 48412 токенов, потому что токенайзер был неверно настроен, в итоге у меня модель генерила всего 660 токенов и прекращала(потому что остальное было занято неврено пересчитанным токенайзером контекстом).

Не совсем понял как 100% фиксить, но понял куда копать (обновить таверну, проследить за токенами, перекачать квант барта вместо анслоповского в крайнем случае)

>Гемени говорит под кобольд...

пиздит как (не) дышит, это для llama-server

>таверна

таверна вырезает если не поставить галочку оставлять

>Господи, как же всем на неё насрать. Гемму притащили чуть ли не раньше релиза.

Ну, надо попробовать. Вдруг чудо. Может хоть русского датасета добавили.

> А высеры с реддита и каких-то помоек американских просто пиздец.

Смешно это читать, особенно когда у тебя темплейт неправильный. Первой строкой всегда должно быть

<bos><|turn>system

Та же проблема. Дожили, чуваки с жинжи не могут шаблон перенести в текст комплишен, зато дистрибуцию токенов фиксят промптами

>темплейт неправильный

А ты не очень внимательный, да? Впрочем таверна на русике это кринж.

><bos>

Тоже спорно, скорее всего, оно автоматом проставится.

мне не хватает 100к контекста

> А ты не очень внимательный, да?

Так ведь наоборот 🤡

В связи с чем у тебя <bos> автоматически проставится? Проверь в чате весь отправляемый промпт и убедишься

>с жинжи не могут шаблон перенести в текст комплишен

делал такое только раз в жизни, вроде для одной редкой модельки, REKA-FLASH или как-то так, и оно даже неплохо работало, в том числе в рп, хотя модель вообще не про то. Потыкал и забыл, интересный экспириенс, но для рп есть и лучше.

>Так ведь наоборот

Так ведь нет. Ты не опроверг момент, что <|turn>system не обязательно должен быть в Story String.

>В связи с чем у тебя <bos> автоматически проставится?

В связи с дефолтным поведением кобольда.

>Проверь в чате весь отправляемый промпт

Который бекенд может модифицировать. Тут надо распечатывать айдишники токенов перед самой подачей в нейронку.

> Ты не опроверг момент, что <|turn>system не обязательно должен быть в Story String.

Почему я должен был это опровергнуть, где причинно-следственная связь? У тебя с головой все ок или проспаться нужно?

> В связи с дефолтным поведением кобольда.

> Который бекенд может модифицировать.

Эзотерика да и только. Таверна возвращает тело запроса, в том виде в каком запрос был получен бекендом. Дальше никаких изменений не происходит

> ут надо распечатывать айдишники токенов перед самой подачей в нейронку.

Прекрасное развлечение когда надоело смотреть в стену

>Почему я должен был это опровергнуть

Потому что ты назвал темплейт неправильным. А он правильный, просто работает иначе, что я и доказал.

>Дальше никаких изменений не происходит

Ты это, подключи файл mmproj, а то у тебя распознавание картинок отвалилось.

> Потому что ты назвал темплейт неправильным

Потому что он неправильный. У тебя бекенд рендерит правильный шаблон при запуске модели. Посмотри на тот шаблон и на тот, который ты отправляешь бекенду

> А он правильный, просто работает иначе, что я и доказал.

Правильный, просто выглядит иначе, но работает совершенно точно верно, да-да. Ладно уж, хватает дураков на свете

>q2

чел....

да нормально, это компенсируется количеством параметров. даже однобитные кванты нормально работают

>бекенд рендерит правильный шаблон при запуске модели. Посмотри на тот шаблон и на тот, который ты отправляешь бекенду

Слишком много ждешь от рядового кобольдика, это тебе не выебыввться на двощах рендеря шаблон у себя в черепной коробке.

> на русском

> Кими, вот вообще не топ.

Последняя и хорошо рпшит, и имеет приличный русский.

> Как мы вообще пришли к тому что сравниваем на серьёзном ебало

Псиоп. Тут может уместно со старичком р1 сравнивать, но только в некотором диапазоне популярных задач. Чем дальше в сторону - тем сильнее тает все преимущество.

Вот это топчик.

>Правильный, просто выглядит иначе, но работает совершенно точно верно, да-да

Ты еблан, да?

Нету разницы, поместишь ты <|turn>system прямо в Story String или в Story String Prefix, текст окажется в одном месте. В итоге шаблон со скринов скорее всего корректный (я не проверял до последней запятой).

В пиксельдрейне да, фигня намешана, но по совершенно иной причине (в first_output_sequence неверно think, в story_string_prefix неверно юзер). То есть обосрались все вокруг (кроме меня, я всегда прав).

>рендеря шаблон у себя в черепной коробке

Да, я так умею. А ещё ксорю дворды в уме. Полезное умение для программиста. Вайбкодеры в это не умеют, поэтому пропускают говно вместо кода.

>мое

И куда её совать с таким весом?

Попробовал гемму, одна морока.

Вставляет левые токены, срывается в повторения. Делает опечатки и ошибки пунктуации.

Но самая жесть это то что свайпы не работают, просто делают лёгкую вариацию на предыдущий пост. Как у них получилось это сделать, я хз, но без свайпов очень тяжело.

Про стиль не буду, ибо вкусовщина, но тоже не очень зашло.

В общем возвращаюсь к немо, уже теряю надежду на новые модели.

Вставляет левые токены, срывается в повторения. Делает опечатки и ошибки пунктуации.

Но самая жесть это то что свайпы не работают, просто делают лёгкую вариацию на предыдущий пост. Как у них получилось это сделать, я хз, но без свайпов очень тяжело.

Про стиль не буду, ибо вкусовщина, но тоже не очень зашло.

В общем возвращаюсь к немо, уже теряю надежду на новые модели.

Как же квен ебёт.

И это даже не ризонинг или инструкция, сама моделька вызывает тебя на диалог и говорит что это не по карточке, переделывай

И это даже не ризонинг или инструкция, сама моделька вызывает тебя на диалог и говорит что это не по карточке, переделывай

>В общем возвращаюсь к немо

У минимакса их всего 10В активных.

Еп. Строгое следование чару это его фишка. Врайтер?

>сама моделька вызывает тебя на диалог и говорит что это не по карточке, переделывай

А нахуй бы ей не пойти в таком случае?

Запилю отчетик по поводу Геммы 31B. Использовал квант БРАТовски Q3_K_S. На нормальный русский я даже не надеялся, когда запускал это ужатое чудище. Результат удивил.

Погонял всякие тестики поверхностные. Потестировал логику и язык. Выяснил, что страдают больше всего знания. Гемма перестает быть эрудитом. В качестве рецензии на "Зеленого Слоника" она выдала мне рассуждения о какой-то пародиии на оригинал, где намешано все в кучу вообще. Режиссеромсег оподелия она обозначила Святослава Свинотрыева, с чего я неистово проиграл.

В то же время она остается хорошим рассуждающим аппаратом. На задачу о заправке ответила легко. На ввод пошло что-то вроде "привет ты ахуел" "Я хочу помыть машину, до мойки шапкой докинуть. Может стоит пойти пешком, чтобы сэкономить бензин?" Она нашла все ловушки, опредлила значение идиомы, и ответила правильно. Задачу про этаж в доме решила верно. "В доме 10 этажей. На каждом этаже в два раза больше квартир, чем на предыдущем. То есть на первом этаже их 1n, на втором - 2n, на третьем - 4n и так далее, по той же логике. На каком этаже чаще всего пользуются лифтом?". Примечательно, что ответ получил быстрее, чем на 4 кванте 26B - та 5 минут рассуждала, 31 справилась буквально за полминуты-минуту.

Язык в плане стиля и литератруности вообще не страдает почти. Пишет складно, инода проскакивают сбитые окончания или падежи, куски слов, но они на 26B были. РП много не тестил, но пишет так же, как и 26B на первый взгляд. Сценарий простейший был, оценивал только базовую логику повествования и язык. Но мне кажется за счет мозгов тут 31B будет преимущество даже иметь.

Что по итогу. Семейство Гемма 4 - это логико-языковой зверь. При этом, их детерминированность в плане ответов отлично подходит для задач анализа текстов, например. Именно в плане датасета и языковых возможностей. Учитывая размер, это лучшее, что вообще можно иметь среди подобных модлелей, как по мне. При этом, Квен 3.5 27Б тоже неплох, но я с ним долго не сидел. Гемма 5уже может не делать революцию. Ее сделала Гемма 4. 5 Гемма должна просто улучшить то, что уже есть. Ебать я рекламой Гугл, стал, конечно, лол.

Вот тут еще часть тестирования валяется

Погонял всякие тестики поверхностные. Потестировал логику и язык. Выяснил, что страдают больше всего знания. Гемма перестает быть эрудитом. В качестве рецензии на "Зеленого Слоника" она выдала мне рассуждения о какой-то пародиии на оригинал, где намешано все в кучу вообще. Режиссеромсег оподелия она обозначила Святослава Свинотрыева, с чего я неистово проиграл.

В то же время она остается хорошим рассуждающим аппаратом. На задачу о заправке ответила легко. На ввод пошло что-то вроде "привет ты ахуел" "Я хочу помыть машину, до мойки шапкой докинуть. Может стоит пойти пешком, чтобы сэкономить бензин?" Она нашла все ловушки, опредлила значение идиомы, и ответила правильно. Задачу про этаж в доме решила верно. "В доме 10 этажей. На каждом этаже в два раза больше квартир, чем на предыдущем. То есть на первом этаже их 1n, на втором - 2n, на третьем - 4n и так далее, по той же логике. На каком этаже чаще всего пользуются лифтом?". Примечательно, что ответ получил быстрее, чем на 4 кванте 26B - та 5 минут рассуждала, 31 справилась буквально за полминуты-минуту.

Язык в плане стиля и литератруности вообще не страдает почти. Пишет складно, инода проскакивают сбитые окончания или падежи, куски слов, но они на 26B были. РП много не тестил, но пишет так же, как и 26B на первый взгляд. Сценарий простейший был, оценивал только базовую логику повествования и язык. Но мне кажется за счет мозгов тут 31B будет преимущество даже иметь.

Что по итогу. Семейство Гемма 4 - это логико-языковой зверь. При этом, их детерминированность в плане ответов отлично подходит для задач анализа текстов, например. Именно в плане датасета и языковых возможностей. Учитывая размер, это лучшее, что вообще можно иметь среди подобных модлелей, как по мне. При этом, Квен 3.5 27Б тоже неплох, но я с ним долго не сидел. Гемма 5уже может не делать революцию. Ее сделала Гемма 4. 5 Гемма должна просто улучшить то, что уже есть. Ебать я рекламой Гугл, стал, конечно, лол.

Вот тут еще часть тестирования валяется

llamacpp

Почему у Геммы при изменении промпта увеличивается потребление памяти? Это происходит даже если конечный промпт стал меньше.

Почему у Геммы при изменении промпта увеличивается потребление памяти? Это происходит даже если конечный промпт стал меньше.

Квант от Анслотов, кстати, че-то я натупил.

У меня шиза разыгралась.

Увидел этот пост и вспомнил пару отзывов о квантах в прошлом, где тоже ругали 5 квант других моделей немотрон49б например.

Может ли быть такое что нечётные кванты как то хуево квантуются?

Выходит так что большинство сразу юзает 2, 4 или 6/8 кванты, а 3, 5 и 7 в массы как то не идут и может проблема от этого менее заметна

Увидел этот пост и вспомнил пару отзывов о квантах в прошлом, где тоже ругали 5 квант других моделей немотрон49б например.

Может ли быть такое что нечётные кванты как то хуево квантуются?

Выходит так что большинство сразу юзает 2, 4 или 6/8 кванты, а 3, 5 и 7 в массы как то не идут и может проблема от этого менее заметна

Как заставить модель быть более активной и самой двигать сюжет в РП? Ощущение, что через несколько сообщений модель только реагирует на мои слова и снова ждет указаний, даже если из контекста понятно, что персонаж должен что-то сделать

Тайна 7 кванта...

>нечётные кванты

Что значит нечётный? напоминаю, что то, что они называют четвёртым, на самом деле имеют среднюю битность 4,65, то есть чисто технически оно нечётное.

Никак, страдай и жди AGI.

Я тут главный видимо апологет Кидонии, но это от модели зависит и частично от инструкций. Кидония часто пытается двигать куда-то происходящее, сама сцены начинает толкать и так далее, попробуй разные тюны того, на чём ты там кумишь

Можно как-то геммочку заставить рассуждать больше?

Скажи ей, чтобы рассуждала как квен

В таверне можно захуярить персонажа "гейммастера", который комментирует происходящее и придумывает дальнейшее развитие событий. Частично оно вытряхивает из затупа, но все равно как-то осторожно пушит сюжет. Не знаю, может еще промптингом можно настоять, чтобы активнее воображала интересные исходы.

Многое еще может зависеть от модельки и карточки. Иногда модельки нарочито избегают нсфв.

Ну и еще семплер можно подрыгать, температуру, хтс.

Мне тема с кубиками и выбором понравилась, иногда неожиданные варианты выпадают. критические провалы тоже веселые бывают.

Взял оттуда.

попробуй в авторскую заметку на нолевой глубине напоминалку засунуть

Глупый Кобольд не понимает слова разумного анона. Причем тут стористринг совсем не ясно. Ещё и вайбкодеров вспомнил, голова вразнобой.

У тебя <bos> токен в начале промта отсутствует, еблуша. Если ты считаешь что Кобольд его вставляет сам, то ты дурачок. Доки которые ты прислал не актуальны для инструкт разметки на которой ты сидишь. Тебе предложили логи посмотреть, но даже так маняврирования и Кобольдоагрессия на ровном месте. Спокнись.

> Но самая жесть это то что свайпы не работают, просто делают лёгкую вариацию на предыдущий пост. Как у них получилось это сделать, я хз, но без свайпов очень тяжело.

Это правда.

Допиши в промпте что ты ждешь от модели. Запусти с карточкой ассистена, напиши - хочу чтоб было вот так, кидаешь текущий промпт, просишь переделать.

Сука я вам отвечаю блять 5 квант сломан нахуй.

Щас проверил на эире, скачал 4 от бартухи и он пишет ну вообще по другому блять. Лучше балансит диалоги и нарратив, персонажи не ударяются сразу в паттерны и отвечают так как я никогда нахуй не слышал от эира

Щас проверил на эире, скачал 4 от бартухи и он пишет ну вообще по другому блять. Лучше балансит диалоги и нарратив, персонажи не ударяются сразу в паттерны и отвечают так как я никогда нахуй не слышал от эира

Новый блок добавь в системные правила или описание

Поведенческие установки:

Стиль взаимодействия:

Ты - ведущая сторона в повествовании. Не жди моих указаний, если ситуация требует действия.

Проявляй инициативу: инициируй диалоги, предлагай смену локаций, совершай физические действия и вводи новые детали окружения.

Твои ответы всегда должны заканчиваться либо твоим действием, либо событием, которое требует моей реакции.

У твоего персонажа есть собственные цели и характер; действуй исходя из них, даже если это идет вразрез с планами моего героя.

..............................................

Далее уже от Геннадия разверстка:

Ведущая сторона (Driving the Narrative)

Для ИИ это сигнал сменить роль с «Ассистента» на «Гейммастера».

Что это значит: Модель должна не просто дополнять твою сцену, а создавать её границы.

Как это работает: Если ты написал «Я зашел в таверну», ведущий ИИ не просто опишет, как он зашел следом, а опишет саму таверну, шум, косые взгляды стражников и сразу направится к конкретному столу, увлекая тебя за собой.

2. Не жди указаний / Ситуация требует действий

Это борьба с «зацикливанием» на внутренних монологах.

Что это значит: Запрет на пассивное созерцание. Если в сцене повисла пауза, персонаж обязан её прервать.

Как это работает: Вместо фразы «Он стоял и ждал, что ответит герой», ИИ должен написать: «Не дождавшись ответа, он раздраженно хлопнул ладонью по столу и направился к выходу, бросив: „У меня нет на это времени“».

3. Проявляй инициативу (Конкретные способы 1, 2, 3...)

Здесь мы даем ИИ «инструментарий» для активного вмешательства:

Способ 1 (Смена мизансцены): «Пока мы говорим, персонаж начинает собирать вещи или переходит в другую комнату».

Способ 2 (Ввод NPC или событий): «Внезапно в дверь стучат» или «Лошадь персонажа пугается змеи». ИИ сам вбрасывает проблему.

Способ 3 (Манипуляция предметами): Персонаж находит что-то в кармане, достает карту, протягивает тебе странный амулет.

4. Ответ должен требовать реакции (Hook)

Это создание «крючка» в конце каждого сообщения.

Что это значит: Каждое сообщение модели должно заканчиваться либо прямым вопросом, либо действием, на которое ты не можешь не ответить.

Пример: Вместо «Он улыбнулся и посмотрел на закат» (тупик), модель пишет: «Он внезапно хватает тебя за плечо и пригибает к земле, шепча: „Тихо! Ты слышал этот хруст в кустах?“».

5. Собственные цели и характер (Agency)

Это делает персонажа живым, а не твоим рабом.

Что это значит: У ИИ есть свой «чек-лист» приоритетов.

Как это работает: Если его цель — «разбогатеть», а ты хочешь спасти котенка, ИИ будет ворчать, пытаться тебя отговорить или вовсе предложит продать этого котенка. Это создает конфликт, который и двигает сюжет.

6. Вразрез с планами героя

Это легализация «сценарного произвола» для ИИ.

Что это значит: Модели разрешено портить твои планы ради драмы.

Пример: Ты планировал незаметно прокрасться мимо стражи, но ИИ-напарник (потому что он по характеру вспыльчив) срывается и ввязывается в драку. Тебе приходится подстраиваться под его действия, а не наоборот.

Напишите, какой сейчас характер у вашего персонажа? Я составлю для него уникальный набор «триггеров инициативы», чтобы он начал действовать в своем стиле.

Ага да верим как всегда

>свайпы не работают

--override-kv gemma4.final_logit_softcapping=float:25.0

на реддите я встречал упоминания про проблемы с нечетными квантами, особенно с пятым.

>лоботомия

зато свайпает

>Причем тут стористринг совсем не ясно.

На пике ответ.

>У тебя <bos> токен в начале промта отсутствует, еблуша.

А теперь смотрим официальный темплейт... Упс, его нет и там!

>Доки которые ты прислал не актуальны для инструкт разметки на которой ты сидишь.

Ты скозал? Что ещё расскажешь?

Нет ничего плохого в том чтобы быть тупым. Но вот на злюк и минуту времени не потрачу, чтобы объяснить где обосрался. Сиди воняй в своем болоте маняфантазий и дальше.

Кстати о токенах

Список доступных токенов можно глянуть тут

https://huggingface.co/google/gemma-4-31B-it/blob/main/tokenizer_config.json

если верить гемини - бос токен не нужно использовать в шаблоне, он сбрасывает контекст.

мимокрок

> пост номер ~5 вместо того чтобы просто сравнить два шаблона

Не лечится

Все так, забей

>если верить гемини

Нашёл кому верить. Впрочем, добавлять не нужно. но лишь потому, что он добавляется автоматом.

>Не лечится

Я сравнил, и описал всё и далее. А другие копротивляются правде.

https://www.reddit.com/r/LocalLLaMA/comments/1sje74g/fernflowerai35ba3bklrelugguf_apple_mlx/

Qwen 3.5 35B A3B Uncensored HauhauCS (repaired) -> (now with KL + ReLU calibration)

Qwen 3.5 35B A3B Uncensored HauhauCS (repaired) -> (now with KL + ReLU calibration)

Да возить вашу шизофрению на велосипеде.

Какая разметка норм на умнице? Я тупой, мне тяжело. Вот вас читаю и у меня нихуянепонял.

Waaaaaaa

Какая разметка норм на умнице? Я тупой, мне тяжело. Вот вас читаю и у меня нихуянепонял.

Waaaaaaa

чат-комплешен

Ладно, последний пруф.

Крутим любой текст, лучше сразу после загрузки кобольда, чтобы не заниматься математикой. Потом берём сырой текст (офк разэкранируем, то есть переводы строк из \n меняем на перевод строки, и так далее) и кидаем в https://huggingface.co/spaces/Xenova/the-tokenizer-playground

Сравниваем число токенов. Обоссываем анонов выше, которые засирают модель лишним токеном <bos> вначале.

Вообще пиздец конечно, как аноны руинят модели кривыми шаблонами. Воистину, чат компитишен это благо.

По шаблону правы и те, и другие. Глобально не правы те кто выебываются и ведут себя как бибизяны. Не делайте так.

Tl;dr - на версиях Лламы где до конца разобрались с Геммой (начиная с b8748) и на обновленных квантах <bos> не нужен. До этого - нужен. Бекенды неправильно работали с шаблоном и сам шаблон внутри уже неактуальный, потому нужно было вручную парсить <bos> токен для Геммы.

Вопрос закрыт, не благодарите. Пикрил обновленная версия, на старых версиях <bos> требовался и без него была шиза. Скорее всего если сейчас он парсится дважды, бекенд все равно его сквашит в один, но лучше не надо.

Tl;dr - на версиях Лламы где до конца разобрались с Геммой (начиная с b8748) и на обновленных квантах <bos> не нужен. До этого - нужен. Бекенды неправильно работали с шаблоном и сам шаблон внутри уже неактуальный, потому нужно было вручную парсить <bos> токен для Геммы.

Вопрос закрыт, не благодарите. Пикрил обновленная версия, на старых версиях <bos> требовался и без него была шиза. Скорее всего если сейчас он парсится дважды, бекенд все равно его сквашит в один, но лучше не надо.

> Обоссываем анонов выше

Вот этот например ведет себя как бибизяна. Урину тебе в твою мордочку. Они хотели тебе помочь, ничего тебе не мешало их поправить, хотя ты один хуй ничего не знал и на лакичах выиграл этот "спор"

Спасибо, не знал. Думал, там проблема в жинже, а шаблону именно самому нужно парсить<bos>

Такого раньше не встречал.

>бекенд все равно его сквашит в один

Таки нет, если добавить принудительно, число токенов растёт. На GLM4 сквошил, сейчас не сквошит. Ждём ещё фиксов, лол.

>Вот этот например ведет себя как бибизяна.

А чем ты от меня отличаешься

>Урину тебе в твою мордочку.

? Я конечно знаю что я токсичный, душный и всё такое, но не до конца понимаю, почему часто указывают только на меня. Возможно я особо токсичный, ну да ладно, мы не в театре всё таки.

>Они хотели тебе помочь

Ну, технически не мне, а вкинувшему изначальные скрины с шаблоном (который в итоге оказался верным), я лишь отписал про неверное понимание ими работы шаблонизатора.

>ничего тебе не мешало их поправить

Ну да, я так и сделал. Но они копротивлялись до последнего, пока их не закидали фактами. Спасибо кстати за пояснение с версиями, я просто на старых не сижу.

ОНО ЖИВОЕ, ПАЦАНЫ, ОНО ШЕВЕЛИТСЯ И РАЗГОВАРИВАЕТ! МОДЕЛЬ, ОБУЧЕННАЯ НА Q1_0 ВЕДЕТ СЕБЯ КАК Q16! ПОЛНОЦЕННАЯ 8B МОДЕЛЬ ВЕСОМ 1 ГБ ТЕПЕРЬ И НА ВАШЕМ КАЛЬКУЛЯТОРЕ! ФИФИ ТЕПЕРЬ ОТСОСЕТ ДАЖЕ БОМЖУ!

Антон, вы долбаёб.

Обоснуй.

>И РАЗГОВАРИВАЕТ

Притом за юзера.

с какой моделью не бывает?

Я ей разрешил потому что. Потому что сначала они запрещают модели даже минимально ролеплеить за юзера, потом ноют что сюжет не двигается.