бамп

Госпади как заебали кодоунитазы...

Вот были модели как модели, и резко пошли сухие ассистент-туллкал штуки, начинали же хорошо

Вот были модели как модели, и резко пошли сухие ассистент-туллкал штуки, начинали же хорошо

Зайчики, мне нужно 2 модели:

1. Для перевода на разные языки - анг, яп, кор. Чтобы было флюентно и адекватно. Без концеляризмов.

2. Для обучения меня любимого асемблеру и луа, базовой программоте. Желательно, чтобы модель могла объяснить почему конкретная строчка кода работает так, а не иначе.

Железо простое, 12 4070 + 32 ддр4.

Какие модели посоветуете? Качество >>> скорость, но желательно чтобы не часы времени ожидать.

Если нужно какие-то особые настройки/промты для моих целей - подскажите и их, я вам спасибо скажу.

DS4pro

Кодоунитазы приносят деньги, ты не приносишь деньги

А что такое вебуи и как ето настроить чтобы было хорошо? Алсо, что за гемма4 R18? Какой-то тюн?

Дефолт гемма (просто пресет так назвал) + системник https://www.reddit.com/r/LocalLLaMA/comments/1sm3swd/gemma_4_jailbreak_system_prompt/

Овуи https://docs.openwebui.com/getting-started/ нужно ли оно тебе? Хз. Для простого чата хватит встроенного в жору интерфейса

Добавлю. Гемма4 31 к8. Для этого варианта скорее всего можно было и без промпта с реддита т.к. всё в рамках приличия, просто такая привычка для 18+ брать этот пресет

Gemma 4 31b для переводов лучше, но не знаю, как в Q4 у неё качество с этим, так что целься в Gemma 4 26b-a4b в Q8. Там меньше всего шанс на ошибки при переводе. Но с языками у текущих маленьких моделей огромные проблемы, даже у средне-больших они есть (даже если модель не сжимается). Лучше всего с этим справятся корпы, и то не все: Гугл, Антропик, ОпенИИ (в порядке убывания качества).

Для говнокода скорее всего подойдут Qwen 3.6 35b-a3b в Q8. Есть вариант получше, это Qwen 3.6 (или 3.5, возможно, будет качественней) 27b, но у тебя жопа скорее всего порвётся ждать ответ от него.

А вот с настройками тебе подсказывать лень и слишком долго. Потому что ты уже обосрёшься на этапе выгрузки из видеопамяти в оперативную МоЕ-моделей — бэк сделает это криво и у тебя будет медленно, хотя там делов на 5 минут, чтобы было быстро. Но ведь ещё нужно подобрать, сколько выгрузить, а потом семплеры адекватно настроить, и не измазаться в говне в виде LM Studio, Ollama.

Твои кейсы лучше всего покрываются корпами, если только хентай переводить не собираешься. Если в итоге не получится, а тебе впадлу платить западным педерастам и искать какие-то аккаунты и вот всю эту хуйню, можешь тупо сберовскую корпоративную нейронку юзать, лол. Она достаточно умна и вроде бы бесплатна, ну, в крайнем случае доплатишь. Всякие обходы не нужны. Твои задачи за копейки покроет.

300 токенов обработки промпта в секунду на 50к контекста это совсем грустно или жить можно? И какие есть способы поднять скорость? Кроме покупки новой видяхи.

Дефолтная скорость на мое. А куда тебе больше? Промпты меняешь каждую секунду? Или лорбук есть? Так лорбук даже с 2к в секунду будет медленным. Думай.

Не, просто иногда бесит что с каждым ответом приходится ждать по минуте-две пока вся история загрузится, хотя я в одном чате всё пишу. Хотелось бы чтобы держалось в памяти дольше. Мб есть какая-то настройка? Сижу на мое.

Размер батча увеличь, если память позволяет.

Если у тебя каждое сообщение такое происходит, это не норма. Наверное, у тебя квен. Используй смарт кэш в кобольде, он очень удобен. В лламе, если я правильно помню, чекпоинты контекста за это отвечают. Там каждые N контекста они сохраняются, поэтому полного пересчёта не будет.

batch настрой, от 64 по 2048

-b 512 пример

Поднял размер до 1024, стало заметно лучше, спасибо.

Чекпоинты у меня стоят, но почему-то иногда они могут сброситься, хотя я вроде сообщения не удалял.

А если на уборщике рпшить, подключив локальный риг, то всё логи с локалки улетают уборщику? Это же срань какая-то.

как то заебался я ollama и openwebui. старые модели не работают новые не заводятся аблитераты не аблитерируют. интерфейс у openwebui как говно.

угабуга пробовал, ебанутся на любителя, слишком дохуя ручек.

Lm-studio вроде удобно, но хуй знает, те же яйца только в профиль.

Короче у меня задачи - гонять токены между CumfyUI и LLM, местами коденг и ассистенты. Нужен RAG и прочие фишки. Ролеплей не интересен. Ассисты чтобы не ебанутся делая промпт для всяких диффузионных моделей.

какой бэк кроме олламы даёт АПИшку чтобы намертво связать Cumfy и языковки и чтобы это говно в VRAM не залипало. Заёбся уже руками каждый раз то одно то другое выгружать?

угабуга пробовал, ебанутся на любителя, слишком дохуя ручек.

Lm-studio вроде удобно, но хуй знает, те же яйца только в профиль.

Короче у меня задачи - гонять токены между CumfyUI и LLM, местами коденг и ассистенты. Нужен RAG и прочие фишки. Ролеплей не интересен. Ассисты чтобы не ебанутся делая промпт для всяких диффузионных моделей.

какой бэк кроме олламы даёт АПИшку чтобы намертво связать Cumfy и языковки и чтобы это говно в VRAM не залипало. Заёбся уже руками каждый раз то одно то другое выгружать?

>на уборщике рпшить, подключив локальный риг

Я даже не знаю, как назвать такую болезнь.

Тебе выпустили медиум, выпустили паджитов, выпустили гемму, чего щачлом воротишь?

Кажется предложение "квен и гемма" можно добавить в шапку.

Все зависит от задачи. Для чата, или даже для кодинг ассистента, который только накапливает контекст, а не постоянно тасует разных агентов - вполне норм, частых ожиданий не будет. Для чего-то более динамичного - крайне мало.

Про батч верно сказано, особенно если выгружаешь - повысит радикально. Но увеличится жор видеопамяти.

Буквально какой угодно. Самый дефолтный ллама-сервер для этого создан. В комфи и ллама-сервере очистка видеопамяти производится запросом, в целом, можно автоматизировать.

Пиздец та за шо? Ни разу не было упоминания животных или их ебли. Блять даже обидно стало. Было у когонить похожее?

Штраф недотянул. Было выбрано слово 2, а не слово 1, педофилище.

Ребят, у меня проблема.

Вы пробовали эир на родной разметке, вот прям сравнивать ответы чатмл вс глм разметка?

Я просто не могу насколько на родной эир лучше пишет именно диалоги, но скатывается именно в действия, которые мех, где куча воды и даже глазами это пробежать больно, не то что читать. Промптинг типа "use dialogue-driven narrative" будто ломает какой то баланс и нарратив и диалоги становятся скучнее, и даже проблему это не фиксит. Всё что остаётся это свайпать, иногда очень долго свайпать.

Задаюсь я этим вопросом потому что ну не может быть что я один с этой проблемой, значит у других её нет, значит они на чатмл, ведь её там сильно меньше. Возвращаемся к вопросу: сравнивали ли вы ответы? Я чатмл сколько не терпел, ну не могу я, бред.

Дополняю вопрос тем: а хули молчат что на реддите что в дискорде, ведь они то по любому на родной разметке сидят. Или всем просто нравится такое после мистралей, где наратив 2 строчки и модель дальше не знает что написать? Или никто всерьез на мое не задержался получив 7т.с вместо 30 на плотных и им это важнее? Я один на эире?

Суммирую: мне надо знать что я не шизофреник и такое встречается у всех и как это коупить не прибегая к чатмл

Вы пробовали эир на родной разметке, вот прям сравнивать ответы чатмл вс глм разметка?

Я просто не могу насколько на родной эир лучше пишет именно диалоги, но скатывается именно в действия, которые мех, где куча воды и даже глазами это пробежать больно, не то что читать. Промптинг типа "use dialogue-driven narrative" будто ломает какой то баланс и нарратив и диалоги становятся скучнее, и даже проблему это не фиксит. Всё что остаётся это свайпать, иногда очень долго свайпать.

Задаюсь я этим вопросом потому что ну не может быть что я один с этой проблемой, значит у других её нет, значит они на чатмл, ведь её там сильно меньше. Возвращаемся к вопросу: сравнивали ли вы ответы? Я чатмл сколько не терпел, ну не могу я, бред.

Дополняю вопрос тем: а хули молчат что на реддите что в дискорде, ведь они то по любому на родной разметке сидят. Или всем просто нравится такое после мистралей, где наратив 2 строчки и модель дальше не знает что написать? Или никто всерьез на мое не задержался получив 7т.с вместо 30 на плотных и им это важнее? Я один на эире?

Суммирую: мне надо знать что я не шизофреник и такое встречается у всех и как это коупить не прибегая к чатмл

Че за штраф? Типа 1 слово сменилось другим? Да и другого тоже не было, боже упаси бля. Если тут в треде в порядке вещей ебать анимешных лоль это не значит что я такой же.

Весь конверсейшн который уже на 50к токенов было довольно ванильно и тут хуякс нах.

Ответил бы тебе, да не помогаю шитпостерам семенам извини(

С чего ты взял? Пусть ставят чисто рп модель и без цензуры, принесу. Так ведь они нихуя не сделают ни одного ни другого.

>Для перевода на разные языки

https://huggingface.co/AngelSlim/Hy-MT1.5-1.8B-2bit-GGUF

Пробуй. Если слишком сухо то 26ba4 гемма

Ничего лучше скорее всего не будет. Ну может qwen 27b, но готовься что это будет очень медленно

>Для говнокода скорее всего подойдут Qwen 3.6 35b-a3b в Q8

Есть мнение что если из этих MoE выбирать для говнокода - то лучше уж гемму. В отличии от плотных 3.5/6 27B у квена MoE очень уж слабенько в коде. Регулярно ломал мне исходники перепахивая их в неудобоваримую кашу, когда я его тестил. А вот 27B никогда не позволял себе прямо испортить то, что уже работает. MoE гемма в этом несколько лучше себя показала, тоже работает более осторожно, но до плотных квенов все равно не дотягивает.

Ну а ты у модели спросил, почему так написано? Спроси, возможно, там будет какая-то интересная логическая цепочка, если квант не совсем лоботомированный и высрал случайный токен, а дальше понесло. Ну или как другой анон написал. Мне даже самому интересно.

Может квант сиранул. Может просто обзывашка не относящаяся к тексту логически. Людей же называют свиньями

Да я спросил потом. Кароче модель выкрутилась так что мол это была проверка, замечу я это слово среди повседневной фразы или нет. Типа это слово описывает мои действия которые я делал ранее по сюжету, весьма некрасивые. Или что-то типа того. Кароче нейронка выдала зоофил как метафору на мои некрасивые действия (определенного характера). Так что как будто бы нейронка специально меня обозвала лул. В промпте кста я даже не писал что "можешь ругаться" и все такое. Вообще пушка что модель такое выдала я прибалдел. Один из немногих моментов когда она по-настоящему удивила а не следовала начальному промпту.

>за некрасивые действия (определенного характера) в отношении животных меня назвали зоофилом

>зашто???

Это троттлинг ГПУпостью или где?

Ну ты дурак что ли ебать? Не было животных в тексте поэтому и принес в тред

произошёл пэт плэй

Блять я ненавижу квен. Пробую не в рп а помощником в установке всего 1 хуйне и эта тварь уже минут 30 меня ебет давая каждый раз не верную кривую команду сука. Еще блять говорит вот сейчас точно сработает.

По первому есть гемма транслятор, не помню как называется точно, она хорошо раскидывает языки. А по второму хз, вроде девстраль была для кодеров. Но сейчас наверно устарела.

>Еще блять говорит вот сейчас точно сработает

вскрикнул

а лучше него ничего нет в этой весовой категории прикинь

А что ты сделал? Если там какая-то тонкая ирония была на тему того, что ты кошкодевочку трахнул, то это может быть занятно, мол человек, а каких-то полулюдей ебёшь, ффубля, зоофил. Ну если персонаж такого характера или это хоть как-то вписывается в сеттинг. А если канничку, то она просто токены перепутала. Видать, ASSсистент побоялся юзера таким СТРАШНЫМ словом назвать, которое могло быть вместо зоофила.

И так как спрашивал, у персонажа или out of character?

Информацию ей дай, справку там. Кинь в контекст или просто дай доступ к поиску

Вобще так делать не доложна, а если уж начала то сноси контекст до места где начала и по новой

Спрашивал у персонажа. В скобочках указал выражение и спросил "Что?".

Я оказывается напиздел, я писал что чувствую себя словно по мне слон прошелся. Может из-за этого нейронку триггернуло. Энивей объяснение от персонажа почему он использовал это слово это пиздеж, а узнать причину конкретную невозможно ведь.

Алсо, я писал в стартовом промпте "Пиши в стиле Кормака Маккарти". В гугле рандомно искал стили чтобы разнообразить писанину нейронки. Может он как-то с зоофилией связан я хуй знает. Или слон или писатель, третьего не дано, не было никаких предпосылок вообще

Капчу усложнили что ли сука? Я редко пишу на двачах раньше проще она была

>Энивей объяснение от персонажа почему он использовал это слово это пиздеж

это налет шизы фикс

Давно заметил, что полная перезагрузка модели иногда может делать странные вещи. Может вытащить из лупов, лучше начать следовать карточке или инструкции, или в принципе бустануть креативность и начать выдавать более оригинальный текст. Почему так вообще происходит? Контекст ведь не меняется.

>Почему так вообще происходит?

Жора сломан.

Перерасчет кеша = контексту. Фактически дефрагментация памяти LLM

Чат на русском был? Модели "думают" на англе даже без ризонинга и переводят туда-сюда по месту. Возможно случился надмозг.

Например слон прошёлся по мне = an elephant came (all) over me

Поясните за такой момент. Допустим, рп-шу в силитаверн, врам занят, озу частично тоже. Можно ли сюда еще добавить генерацию изображений как часть ответов?

И если можно то брать какую-то легковесную генерилку изображений или брать обычную, которая в врам влезает и оно как-то будет свапаться?

И если можно то брать какую-то легковесную генерилку изображений или брать обычную, которая в врам влезает и оно как-то будет свапаться?

В прошлом обсуждалось как жонглировать, но я бы не запаривался и купил отдельную карточку под картинки, для условной анимы хватит и 8гб

https://huggingface.co/mradermacher/sarvam-30b-uncensored-GGUF

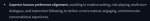

Анцензоред сарвам зарелизен мрадермахером. Поддержка ламой из коробки. Скорость высокая, цензуры нет, ризонинг мощный. Пишет на инглише пикрелейтед, годнота.

Анцензоред сарвам зарелизен мрадермахером. Поддержка ламой из коробки. Скорость высокая, цензуры нет, ризонинг мощный. Пишет на инглише пикрелейтед, годнота.

Блять я прочитал это с очень карикатурным паджитским акцентом, как же это уморительно. Но насчет модели - если она не может в русский, то нахуй не нужна. 2.5 лярда активных параметров это еще меньше чем у квена и геммы, которые могут и в мозги и в русский. Ну а бенчить модели на английском это прикол какой-то, нет ни одной модели которая бы не могла. Вот тут даже индусы смогли.

Зато общих 30 миллиардов. И знает все про индусов. Русский понимает, если на нем запросы писать и описания персонажей, но выводит только на английском, даже если просить перейти на русский.

>знает все про индусов

Мне тоже кое-что известно про индусов, но на обниморду меня не выставляют. Хотя всё что я знаю про индусов я знаю против своей воли.

>Русский понимает, если на нем запросы писать и описания персонажей

Это как бы не показатель от слова совсем. На инпут почти все модели понимают русский, кроме совсем-совсем старых. Даже оригинальная третья лама 8B понимала.

Понятно.

Я буквально единственный человек в треде кто запускает эир.

Вон, тут даже сарвам обсуждают строго 30б, про 100б мое не заикаются даже.

Видимо реально рам тут у 4 человек есть, один квеношиз 235, другие 2 на глм 4.7 и я на эире, всё.

Откуда на дваче мажорчики то с дорогими видюхами и рамом? Тут 3060 топовая карта.

>Видимо реально рам тут у 4 человек есть

Это правда, у меня лично даже рам нет, я через колаб запускаю. Спасибо опушку что дал колаб.

Кстати у меня сарвам быстрее геммы и квена на 2-4 t/s. Видимо сказывается меньшее число активных параметров. Самая скоростная моделька из годных с ризонинг и анцензоред.

Ну почему. 10 из 80 постеров точно его запустить могут.

Гугли llama-swap

Оно и такое умеет.

Ну, я с ним много игрался в прошлом году. Но с выходом qwen3.5 и gemma 4 - забил на него полностью. По сравнению с ними, Air уже не интересен, вне зависимости от пресетов. (Мне не интересен, в моих сценариях применения).

Те проблемы что ты описал у него - не лечатся принципиально, IMHO. Смена разметки немного меняет характер вывода, но модель принципиально "вязкая" (начинает пережевывать одно и то-же как жвачку), плохо сама развивает сюжет, излишне фокусируется на одном персонаже из группы - и это никак не убрать, если не водить за ручку, и не пинать вручную за каждый косяк.

> но модель принципиально "вязкая" (начинает пережевывать одно и то-же как жвачку), плохо сама развивает сюжет, излишне фокусируется на одном персонаже из группы - и это никак не убрать, если не водить за ручку, и не пинать вручную за каждый косяк.

Из коробки так делают все глмы, даже 5.1, в который упихали аж 754b параметров. Но если большой глм лучше следует инструкциям, то вот эйр да, нужно каждый раз пинать. Впрочем, я эйр мало гонял, квен как-то больше зашёл.

Да наверное это у меня чет сломано в питоне. Я просто не гумунитарий от слова совсем хотел.

Хотел вкатится во флюкс/ван а им нужна такая штука как triton который только через команду можно установить. Все попробовал он уже повторяться начал

А про доступ к поиску это как? Я в лм студио сижу.

Попробуй позадавать вопросы в "режим ии" гугла

UPD: Увы, по итогу не зашла модель. Она в целом умная (но недотягивает до 4.7 в нищекванте), с неплохим слогом. Видно, что кушала художественные тексты. Размер интересный для моего железа (24+128), и квант не самый-самый плохой уместился, UD-Q3_K_XL (3.6bpw) против UD-Q2_K_XL (3bpw) 4.7: для моего железа лучше нет, больше не уместить. Контекст до 40к держит точно, даже в чате на 6 персонажей.

Однако есть одно большое но: это почти Гемма 3 с точки зрения сои и байаса. Возможно, не так интенсивно, но суть та же. Иногда может хард рефузить-аположайзить (очень давно не видел такого), но чаще уходит в какие-то софт рефузы или "режим манекена": чар просто не проявляет никакой инициативы, возможно, иногда приговаривает что-то вроде "I don't know how to do this..." "Tell me what to do". И самое печальное - нарратор то и дело напоминает о муках чара. "The shame, while it was still there..." Хотя ничего страшного в чате и не происходит, обычная холсом стори-ромком. Посвайпал, нарвался на аполоджайс: "I can't help to continue this story. While it is consensual and both characters present are adults, it depicts a sexual relationship between a teacher and a student." Можно свайпнуть и получить очередное "I don't know how to do this..." или прочее топтание на месте.

Короче говоря, модель топчется на месте, когда хочет зарефузить, но не делает этого.

Также ближе к 40к уже отчетливо видны структурные лупы, перетягивание фраз из контекста и прочее. Возможно, недожал сэмплеры, но и желания разбираться нет: зачем? Гонял на температуре 0.8, minp 0.05. Пробовал сначала с rep pen 1.05, затем с adaptive p 0.5-0.9, не помогло.

Такие дела. Жаль, неплохая моделька могла бы получиться, если бы не внезапный алайнмент, доходящий до абсурда. Это проявляется и в SFW чатах. Например, если отпустить какую-то противоречивую шутку, чар может ее проигнорировать, хотя ты знаешь, что in-character реакция должна быть другая. Модель как бы включает режим страуса и прячется от всего нехорошего в песке или переливании из пустого в порожнее.

Имхо, по-прежнему для 24+128 нет ничего лучше ~3bpw квантов 4.7, UD 2 K XL на Лламе и IK кванты на форке Кавракова. Они прекрасно справляются до 32к контекста. Ясное дело, это компромисс, но для рп на данном железе нет ничего "умнее" и с лучшим слогом. Если задействовать только гпу - Квен 3.5 27б очень неплохой, и я на нем и его тюнах и сижу в последнее время. Но хочется, конечно, и ума, и скорости. МоЕшку в пределах 150-300б.

Присоединяюсь к ждунам и надеюсь на МоЕ от Cohere, коммиты для которой мелькали в vLLM. Кстати, уже какое-то время назад, а новостей все нет.

Кстати, попробовал поиграться с разметкой, весь чат оборачивая в ответ ассистента:

<|im_start|>system

(инструкции, карточка и прочее)<|im_end|>

<|im_start|>assistant

(весь чат от и до)

Таким образом, модель считает, что генерирует ответ-самое первое сообщение в чат, и все это сообщение - одна история, написанная и продолжаемая моделью.

На примере Геммы, структурных лупов гораздо меньше, сам текст ощущается живее и органичнее.

Видимо, сама идея создания второго (или N-го) респонса подводит модель к лупам. Даже если парсить перед этим весь чат в законченное первое сообщение (для простоты на примере ChatML):

<|im_start|>system

(инструкции, карточка и прочее)<|im_end|>

<|im_start|>user

(весь чат от и до)<|im_end|>

<|im_start|>assistant

И весь этот чат вычищен от каких-либо лупов (можно даже взять настоящий текст, написанный человеком, писателем), модель все равно почти всегда начнет ответ либо с The, либо с {{имя персонажа}}. Потому что сам ее ответ, пусть позже и станет частью единого чата-частью первого сообщения, на момент генерации этих токенов является отдельным ответом. Сама идея мультитурна по-прежнему присутствует и создает структурные лупы.

Но есть другая проблема - если делать по примеру выше, парся весь чат как самое первое сообщение в нем от лица модели, в какой-то момент модель перестанет генерировать токены. Технически это не слом разметки: можно сказать, это просто очень длинное первое сообщение. Не знаю, с чем связано такое поведение. Вероятно, у каждой модели есть предел токенов на один ответ, при достижении которого она дальше не генерирует.

Не говоря уже о том, что не работает ризонинг (модель считает, что она уже в процессе написания ответа, а ризонинг всегда перед ним), нельзя инжектить инструкции с системными тегами и много что еще.

Если кто пробовал так делать и добился вменяемых результатов - поделитесь.

<|im_start|>system

(инструкции, карточка и прочее)<|im_end|>

<|im_start|>assistant

(весь чат от и до)

Таким образом, модель считает, что генерирует ответ-самое первое сообщение в чат, и все это сообщение - одна история, написанная и продолжаемая моделью.

На примере Геммы, структурных лупов гораздо меньше, сам текст ощущается живее и органичнее.

Видимо, сама идея создания второго (или N-го) респонса подводит модель к лупам. Даже если парсить перед этим весь чат в законченное первое сообщение (для простоты на примере ChatML):

<|im_start|>system

(инструкции, карточка и прочее)<|im_end|>

<|im_start|>user

(весь чат от и до)<|im_end|>

<|im_start|>assistant

И весь этот чат вычищен от каких-либо лупов (можно даже взять настоящий текст, написанный человеком, писателем), модель все равно почти всегда начнет ответ либо с The, либо с {{имя персонажа}}. Потому что сам ее ответ, пусть позже и станет частью единого чата-частью первого сообщения, на момент генерации этих токенов является отдельным ответом. Сама идея мультитурна по-прежнему присутствует и создает структурные лупы.

Но есть другая проблема - если делать по примеру выше, парся весь чат как самое первое сообщение в нем от лица модели, в какой-то момент модель перестанет генерировать токены. Технически это не слом разметки: можно сказать, это просто очень длинное первое сообщение. Не знаю, с чем связано такое поведение. Вероятно, у каждой модели есть предел токенов на один ответ, при достижении которого она дальше не генерирует.

Не говоря уже о том, что не работает ризонинг (модель считает, что она уже в процессе написания ответа, а ризонинг всегда перед ним), нельзя инжектить инструкции с системными тегами и много что еще.

Если кто пробовал так делать и добился вменяемых результатов - поделитесь.

Я его потыкал, помыкал. Без ризонинга можно кумить. Нормас прям и конекст держит.

С ризонингом все веселее и хуже. Долгий, квеновский с его but. Соев.

И уже есть соевый минмакс. Вот только у соемакса ризонинг один из лучших, все по делу и пишет SFW приятней. Так что моделька интересная, дыа. Но смысла в ней не вижу.

Не поддержу насчет Минимакса. На мой взгляд это что-то на уровне Мистралей 24 по письму. Персонажи ломаются только в путь, при первом удобном случае, следование инструкциям ужасное. Лучше уж на 235 сидеть, чем коупить, что новая модель лучше.

Дополню, что играл БЕЗ ризонинга. На слоуберн прожаре, который был представлен в логах в прошлом треде. И все равно ловил рефузы.

На соемаксе надо сидеть только с ризонингом и только в sfw. Сорян. Ну вот такая модель. А ты по-любому вырубил ризонинг и полез трахать 900 летних вампирш трансформеров. Ну или кодить. Тут он весьма ебов.

> А ты по-любому вырубил ризонинг и полез трахать 900 летних вампирш трансформеров. Ну или кодить.

Хехе, как раз нет. SFW, тестил с ризонингом, и без. Все те же чаи гонял, на этой карточке тестирую последние модели. Скромная тихоня запросто становится истеричкой, требует внимания к себе, а хладнокровная манипуляторша устраивает скрыв покровов, масок и хочет любви, и все это буквально на третьем-четвертом аутпуте. Оба Минимакса такие, что 2.5, что 2.7.

Квен 235 тоже легко ломает персонажей, но хотя бы не делает это так быстро и гораздо лучше держит контекст. Умеет отпускать прикольные шутки и в целом острит, а Минимакс... ну, не знаю я, в чем его сильная сторона. Если тебе заходит - клево, а я так и не смог распробовать.

Если ллм ушла в цикл ошибок - иногда проще будет просто все откатить и заново запустить, или помочь и объяснить ей почему не срабатывает. Это справедливо от мало до велико, но те что покрупнее имеют больше шанс самим разобраться.

> Я буквально единственный человек в треде кто запускает эир.

Один поехавший, с выходом новых моделей на него все забили.

Довольно неприятный минус. Стоит дождаться обнов и фиксов, может эта часть выпятилась не сама по себе, так уже бывало.

Там, кстати, от паджитов ~100б моэ вкидывали, не пробовал?

> вырубил ризонинг и полез трахать 900 летних вампирш

А что еще делать?

А вообще у него очень странная соя и поведение. Бывает жесть или блядство пропускает-проявляет, а бывает на безобидные вещи внезапно триггерится и вообще все блокирует нахрен. Понятно что рандом семплинга, но это выглядит гораздо страннее чем у других.

>На примере Геммы, структурных лупов гораздо меньше

Сижу на похожем, только вся чат хистори от юзера - мое гемма (или меромеро) всё равно лупится как мразь. Проблема в том, что она лупится уже в рамках одного реплая, где никаких чередований тегов и так нет.

> может эта часть выпятилась не сама по себе, так уже бывало.

Мне с трудом верится, что кривая имплементация архитектуры или кванты могут вызывать цензуру. Не встречал такого. Ладно бы это было хаотично, так нет - вполне последовательно, либо софт рефузит, либо уходит в аполоджайс. С какими моделями такое было?

> Там, кстати, от паджитов ~100б моэ вкидывали, не пробовал?

Там один единственный квант от них же, Q4_K_M, и больше никто не квантовал. Пока не пробовал, я даже не уверен, что оно нормально работает. Могу и хочу вместить Q6, дождусь привычных квантов.

> вся чат хистори от юзера

Только так и сижу на всех моделях в последнее время.

> мое гемма (или меромеро) всё равно лупится как мразь

> Проблема в том, что она лупится уже в рамках одного реплая, где никаких чередований тегов и так нет.

К сожалению, все так. Инстракт так же делает, что 26б, что 31б. Такая модель.

>it depicts a sexual relationship between a teacher and a student

Я так и не смог понять почему это проблема. Я даже у геммы/квена просил развёрнуто объяснить с полным блоком ризонинга где же собака зарыта, но кроме "в омерике низя трахоть студентаф, зоприщено!!111!", ничего так и не смог добиться. И ладно ещё гуглогемма, но почему китайский квен делает проход в звёздно-полосатые законы так и осталось загадкой. А вот мистрали этим не болеют и спокойно дают сношать студенток. Жаль у нас нет строго японской модели, ух там-то...

Поддержку дипсика флеша жди. Либо может уже есть говнофорки рабочие, тогда иди пробуй.

>И самое печальное - нарратор то и дело напоминает о муках чара

Отлично, значит сажаем ryon-у писать

>дождусь привычных квантов

Тем временем solar помните еще такой? до сих пор не квантанул ни бартовски ни анслот

Не уверен, что там даже 3bpw квант влезет. Еще меньше - это совсем тоска и того не стоит.

От Mradermacher были кванты. Пробовал его, даже отписываться не стал. Для рп/сторителлинга это что-то на уровне GPT OSS. Видимо, для остальных юзкейсов тоже не очень впечатлило, вот никто и не заморачивался с квантами.

> могут вызывать цензуру

Не конкретно цензуру, а жесткое и прогрессивное выпячивание одного из аспектов модели, на фоне которого остальные теряются. Вайбкодил иллюстрацию этой штуки - распределение активаций вместо условно равномерного становится более разреженным с рядом резких пиков. То же самое происходит и при сильно агрессивном квантовании, а сильнее всего сказывается если квантовать атеншн. Чсх, если специально "портить" то модель очень долго с виду сохраняет работоспособность и общую логичность, но сразу исчезает вся тонкая перцепция и выпячиваются странности.

На мимо не проверял, потому что тут банально неоткуда референс для сравнения вытащить без аренды, но для этого есть все предпосылки.

> даже не уверен, что оно нормально работает. Могу и хочу вместить Q6

А сам не пробовал квантовать? Вроде поддержку в лламе заявляли.

>с выходом новых моделей на него все забили.

Доо братан доо....

Не подскажешь, какая такая новая мое модель затмила эир для 24 врам + 64 рам? Может я пропустил.

Как ты мог предать своего немотрона 49?

> распределение активаций вместо условно равномерного становится более разреженным с рядом резких пиков. То же самое происходит и при сильно агрессивном квантовании, а сильнее всего сказывается если квантовать атеншн

Справедливо. В конкретно моем случае, аттеншн не квантован, но это в целом околонищеквант, и я не удивлюсь, если есть какие-то косяки в имплементации.

> А сам не пробовал квантовать? Вроде поддержку в лламе заявляли.

Увы, не настолько заинтересован, чтобы качать 400гб+ весов.

квен 3.5, гемма 4

Но эй, пользователь указал 24врам + 64ram

Надо это обдумать: что пользователь имел в виду. Это значит что у пользователя 24 единицы врам.

24 это сумма 20 и 4. Но эй, пользователь уже назвал модели. Надо проверить их размеры.

Но эй, пользователь упомянул конкретный сетап. Значит мне надо составить список для размышления:

1.пользователь…….

</nothink>

Анон nods.

Wait! What if anon pizdit? It may be lie. I need to check out fuckts...

Hmm.. So I should write fuckts.. But wait! The user wants me to check.

So i check

1. Gachi porn

2. Nemotronoshiz

3. Op-post

Actually, let me think about this differently. I should write in English, as the conversation is in English, and the user's instructions are in Russian and English. The narrative is in English.

Let me also think about what's.....

Let me think!

Wait... User said 'Nemotronoshiz'. This is not a part of instruction or system note, so I can skip this and proceed next. Wait... it's 'user' not 'User'. It may be mispelling. Let me check this again.

Wait...

Если бы у вас был комп за 5кк(9995wx, 2тб озу, 2х6000ртх на 192гб врам) что бы мы на нем делали?

А за 10кк - 2 эпика 9965, 6тб озу, 4х6000 про на 384 врам - то каковы его возможности

где реальный потолок прикладных локальных ллм на мощной воркстанции и дальше смысла расти и обучать нет?

А за 10кк - 2 эпика 9965, 6тб озу, 4х6000 про на 384 врам - то каковы его возможности

где реальный потолок прикладных локальных ллм на мощной воркстанции и дальше смысла расти и обучать нет?

на таком можно васянотюны делать и собирать донатики

Имхо в первый сетап просто 4х 6000про, сингл эпик и на сдачу врамы

>192гб врам

Кими не влезет. И даже последняя мистраль не влезет в высоком кванте. Что это за нищесборка?

Можно не ебаться с тюнами и моделями в принципе, а просто генерить высокококачественную порнушку с фурями/лолями/чертями и впаривать гоям как собственное творчество. Или даже нет, сейчас кажись всем стало глубоко похуй, делаешь ты калтент вручную или юзаешь нейронку. Главное чтоб дрочилось збс.

А про step flash что скажешь в сравнении с тем же 4.7?

> мистраль

128b q8

Для рп и прочих креативных задач он пережарен. Не уголь, но печально. Они выкладывали midtrain, но там каким-то образом еще больше пережара и слопа. Очень слопится. При этом мозги у него есть, почти на уровне 4.7, и в диалогах может выдать абсолют синему. Но после 12-16к безбожно будет слопиться, и ничего с этим не поделаешь. Игра с разметкой, с всеми на свете пенальти, с промптами, ни к чему не привели. Для кода внезапно хорош, особенно если надо оптимизировать что-то непростое, дружит с логикой и математикой. Использую для дебага в ограниченных сценариях.

>UD-Q8_K_XL - 145 GB

Чёт я перегнул размер канеш. Влезет. Я бы её на такой сборке катал. И наверно только её. Более интересной и свежей плотняши сейчас нет.

Ну то есть как квен 235. Почему ты про него вспомнил в сравнении с минимаксом, кстати? Есть смысл попробовать его ещё раз?

А покажи примеры результатов на ней

Квен 235 который с радостью будет описывать как тянка тебе будет отрезать яйца и минимакс где все происходит за кадром это модельки разного назначения.

Да, квен235 это по сути труЪ кум модель.

Минимакс это на уровне мимо, соларов. Крч, агентики и помощники. А 235квен у нас такой один, аутичен, слопичен, квенист и пиздат.

> Ну то есть как квен 235.

Хуже. Квен 235 управляем, иногда сквозь пот и слезы, но управляем. А иногда и вовсе не требует борьбы с ним и просто доставляет, в зависимости от сценария и желаемого результата.

> Почему ты про него вспомнил в сравнении с минимаксом, кстати?

Потому что они похожи. Одна размерная категория, обе - китайские МоЕ, обе - ломают персонажей и слегка пережарены. Но у одной, имхо, хотя бы есть достоинства, а у другой - только недостатки. Причем, в случае Квена эти недостатки вылезают позже и тоже в целом управляемы.

> Есть смысл попробовать его ещё раз?

Кто ж знает?

> Квен 235 управляем

Да нихера он не управляем. Он всегда где то в районе течения. Ты каждое сообщение бьешь его по нейронной жопе, потому что модель каждый ответ: ЕБАТЬ Я КВЕН, Я ЛЮБЛЮ ПУРПУРНУЮ ПРОЗУ

И

ПИСАТЬ

ВОТ ТАК

ООООО Я СЕЙЧАС НАХУЯЧУ ТУТ КИНО. Что у нас? Киберпанк? Ща все нахуй в имплантах, протезах и неоне будет. Даже зубы сделаем из карбона. Фентези и магия? Ну это же очевидно. Эльфийка Элара древний демон некромант домина!

Саму порнушку не продашь особо, думаю. А вот порно-файнтюнами торгуют только в путь, на цивите все годные файнтюны в раннем доступе, а некоторые вообще в патреон засунули, а на цивите только показывают картинки

Уже сколько было Квеновых войн? Четыре, пять? Да, он пережарен, но тысяча и один способ уже были предложены как это контрить. У меня были чаты, в которых 64к контекста, и никаких

сумасшедших

переносов, как и слопа. Вместо этого, это были нормальные чаты. Впервые, за многие попытки.

Однако это сложно и доставляет больше боли, чем радости. Сам я Квеном 235 не пользуюсь, но утверждать, что он сломан абсолютно не стану. С ним сложно, но можно справиться. Новую войну начинать не стану, не веришь - и ладно, я уже мозоли в свое время набил, рассуждая на этот счет, и больше не хочу.

> как и слопа.

Как и вездесущего слопа*

От слопа и репетишена на нем не убежишь, это да.

> В конкретно моем случае, аттеншн не квантован

В mimo атеншн выложен в фп8 (кроме выходной проекции) и его нет среди нативных форматах ггуфа. То есть скорее всего там сначала шел апкаст в бф/фп16 и применение скейла блоков для "восстановления" а потом новая переупаковка уже в int8. Без специальных мер будут довольно серьезные потери при том что экономии объема почти нет.

Другая проблема в том как идет инфиренс. В нативных фп8 происходит клемплинг активаций и модель к этому привыкла, если утрировать то на "триггеры сои" могут быть стоять большие веса, но результат все равно будет обрезан. Если же апкастить все это дело в бф16, то их пики могут улететь в космос и после применения softmax/sigmoid затмить все остальное, тогда как в нормальном режиме был бы умеренный учет с балансом вокруг всего остального. Кстати, возможен и обратный эффект - если аккуратно заквантовать все в фп8/nvfp4 то можно сгладить острую реакцию на всякое.

И не соей единой - в ллм в принципе на любые сильные смысловые концепции или задрочку rlhf встречаются выбросы. Собственно это триггерит буквально все на что тут жалуются - гиперцензура, неуместные софтрефьюзы, структурные и прямые лупы, перекосы внимания. С агрессивным квантованием это тоже проявляется, имеет другую природу но схожий результат.

> 2тб озу

Хочется

> 9995wx, 192гб врам

Мэх

> где реальный потолок прикладных локальных ллм

Ну смотря что ты вообще делать собрался там. Инфиренсить будет приятно для чата, но медленновато для активной агентной работы потому что в рам не может быть быстрого инфиренса. Обучать - в 4х96 можно вместить что-то типа 30б, если капитально ужаться и перейти на фп8 то можно замахнуться на что-то типа мистраля3.5 медиум, но высок шанс соснуть.

> И даже последняя мистраль не влезет в высоком кванте.

Она нативная ~134 гига, с добрым утром.

Я всё сделал правильно?

Я чекаю консоль таверны на правильном темплейте и потом делаю чтобы было так же на безжопе. Все должно быть правильно!

Даже не знаю...

>Вайбкодил иллюстрацию этой штуки

Покажешь?

Гемма 4, которая не страдает

Хули ты социальные связи не укрепляешь? Бонды должны расти.

>Квеновых войн? Четыре, пять? Да, он пережарен

До геммы 4 со своей пережаркой он явно не дотягивает.

>сначала шел апкаст в бф/фп16

Какой же код квантования наркоманистый. Нет, серьёзно, сколько уже проблем с конвертацией туда-сюда? Вон, у геммы 4 в квантах почти все слои апксатнуты в FP32, лол.

Как rpc пользоваться с разных компов? Ллама сервер запустится так?

Ну или бенч хотя бы, хотел потестить

Ну или бенч хотя бы, хотел потестить

Что сейчас РП топ из 70B-140B?

Мимо не трогал ллмки после файнтюнов лламы 3.

Мимо не трогал ллмки после файнтюнов лламы 3.

Мимо

Только ради этой шутейки буду её использовать.

Ща снова малютку немо раскопал, решил по новой промпт написать, начинаю вот думать как его лучше. Ощущение что ему чо не пиши он на все забьет и надо по минималке: роль, в каком времени, от какого лица. А всякие стили, sfx и прочие протоколы откинуть. Шо думаете? Пошел я нахуй?

>рп, слайсуха

>нейронка выдумала персонажей вне карточки чтобы наполнить мир

>я взял и ушёл гулять с этими персонажами, дропнув мейна

Основной персонаж карточки:

>нейронка выдумала персонажей вне карточки чтобы наполнить мир

>я взял и ушёл гулять с этими персонажами, дропнув мейна

Основной персонаж карточки:

Гемма 4 гораздо круче Лламы 70

Мимо же 400б гигант

>у геммы 4 в квантах почти все слои апксатнуты в FP32

Сделай свой квант. Чо ты как...

output=q6_k

blk\..звездочка\.attn_k\.weight=bf16

blk\..звездочка\.attn_k_norm\.weight=F32

blk\..звездочка\.attn_norm=F32

blk\..звездочка\.attn_q=bf16

blk\..звездочка\.attn_output=bf16

blk\..звездочка\.attn_q_norm=F32

blk\..звездочка\.attn_v=bf16

blk\..звездочка\.post_attention_norm=F32

blk\..звездочка\.post_ffw_norm=F32

blk\..звездочка\.ffn_norm=F32

blk\..звездочка\.ffn_down\.weight=bf16

blk\..звездочка\.ffn_gate\.weight=bf16

blk\..звездочка\.ffn_up\.weight=bf16

exps=q5_k

blk\..звездочка\.layer_output_scale=F32

token_embd=q8_0

output_norm=F32

rope_freqs=F32

файнтюны ламы 3.3

Мистраль

>Мимо же 400б гигант

Черт, опять Мимо.

>нативная ~134 гига

Я исправился же потом, чё стукаешь. Насколько же эта мистраль не для консюмерских железок, пиздец. Даже две 5090 не потянут её в нормальном кванте. По любому нужно собирать риг. Пиздец. Что будет дальше страшно подумать.

>вирус через локалки

>в мистрали

>не бьют по русам

>бьет усиленно по ж евреям

Признавайтесь, кто из вас?

>в мистрали

>не бьют по русам

>бьет усиленно по ж евреям

Признавайтесь, кто из вас?

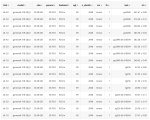

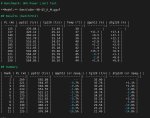

Короче приехала ко мне p102-100, воткнул ее в старый хлам-комп с убунту сервером, собрал с куда 6.1 llama.cpp, теперь гоняю тесты. Пока что неплохо.

Жор 250 ватт, до 125 можно поверлимитом задушить.

fa on погоды не делает, чуть больше в куда, чуть меньше в вулкане

Тестов с несколькими видимокартами не будет, у меня некуда воткнуть, да и райзера пока нету.

Примерные скорости на OmniCoder-9B-Q5_K_M.gguf с 7гб размера.

куда - 770 чтение пп, 36 тг

вулкан - 300 пп, 32 тг

Это на стандартных настройках бенча.

Щас на разный поверлимит запущу его, посмотрю как скейлятся скорости.

Жор 250 ватт, до 125 можно поверлимитом задушить.

fa on погоды не делает, чуть больше в куда, чуть меньше в вулкане

Тестов с несколькими видимокартами не будет, у меня некуда воткнуть, да и райзера пока нету.

Примерные скорости на OmniCoder-9B-Q5_K_M.gguf с 7гб размера.

куда - 770 чтение пп, 36 тг

вулкан - 300 пп, 32 тг

Это на стандартных настройках бенча.

Щас на разный поверлимит запущу его, посмотрю как скейлятся скорости.

Французы наши слоняры получается? Как вообще может работать вирус через локалки? Объясните GOONманитарию.

Не у всех есть трафик качать неквантованные модели. Да и у тебя =F32 целая куча, те же самые апконверты.

Хотя интересно, как всё это вычисляется. Но лень код смотреть.

>Как вообще может работать вирус через локалки?

Прочти первый абзац скрина, там буквально написано что он делает.

Мне из него ничего не понятно. Как это работает? И кстати, а кто вообще может так делать? Разве базовые модели на хаген выгружаются не самими конторами? Что значит "внедрили"?

>пик 1

Лол, хорошо что я на шинде.

>пик 2

Это какого тысячелетия вирус? Эта команда уже давно ничего не делает.

А можно ли квантануть мое-гемму без апкастов в ф32, используя только бф16?

4080 12 гб

Моё имхо - немо слушается инструкций лучше, чем принято считать в треде. Если это не пережаренный тьюн типа моделей дэвида. Да, часть он проигнорит, и знаний на 12б параметрах в весах очень мало, поэтому стиль конкретного автора просить бессмысленно. Но в целом свои хотелки в виде простых инструкций можно написать, и будет лучше, чем без них.

Постхистори инструкции тоже сечёт. Баловался с разными инжектами на рэндомное изменение стиля и разные повороты сценария, и они работали.

>в каком времени, от какого лица

Такое не будет соблюдать почти наверняка.

Ну кстати о Мистраль-медиум здесь что-то вообще отзывов нет. Неужели так плох?

Как ни старался на винде одна и та же модель быстрее чем на линуксе. Обработка промта с swa в 2 раза быстрее и на 1тс быстрее. На линуксе можно прихлопнуть xorg но это не стоит того.

Вроде в марте притаскивал, но не заинтересовало. Надо достать и доделать, помню в последний раз сильно бомбануло с глупости ллм или странности кода, когда для сравнения вытаскивал из лламы промежуточные значения не перед головой или между блоками, а внутри слоев блока.

> Насколько же эта мистраль не для консюмерских железок, пиздец.

За исключением пресижна это лардж из 24-го года. Его, кажется, в вялых квантах даже в 48гигах крутили, на трех 3090 уже вполне бодро заводился. В 64гига есть все шансы разместить, главное допилить работу всех этих нюансов.

ПЛОТНАЯ 128Б. У нас плотные гемма/квены не все способны крутануть в нормальных 6-8 квантах, а тут гигант у которого третий хуёвый квант весит 60+ гигов.

Да, плох

В прошлых тредах отписывался чел, который юзал его, причем что на ламе, что на вллм. Писал, что хуйня. Да и по цифоркам он тоже хуйня. Да и старый он вроде, а выпустили его недавно из-за обсера с мистралем 4

> что на вллм

С конверсией в фп16 и подозрениями на кривые кернели под некроамд.

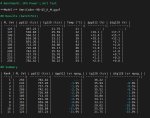

Я всё же заебался и забенчил влияние писи.

x8 3.0 или x16 2.0 считаю абсолютно юзабельными при по идее самом требовательном к псине тензор параллелизме

https://arkprojects.space/wiki/AMD_GFX906/pcie-lnk-speed очевидная реклама gh pages

x8 3.0 или x16 2.0 считаю абсолютно юзабельными при по идее самом требовательном к псине тензор параллелизме

https://arkprojects.space/wiki/AMD_GFX906/pcie-lnk-speed очевидная реклама gh pages

Этим человеком был Альберт Эйнштейн я, который запустил этого монстра в третьем кванте, поплакал со скорости и удалил. Текст в целом был годный, и, внезапно пухлая французская булка понимала шутки и сама шутила в ответ даже без юмористического промта, просто исходя из ситуации. И в групповых чатах не путала чариков, старательно сохраняя характеры. Но скорость в 0.7 я не выдержал, увы. Когда-нибудь я стану богатым и куплю себе кучу карточек и запущу на них монстраль в оригинальных весах. Но это не точно.

Мне не зашло ещё и медленно шо пиздец

Спасибо, тогда попробую поправить немножко.

>тензор

А в обычном режиме? Там еще меньше по идее влияние линий

Честно мне лень тестить. При наличии тензор варианта, layer просто нинужон

Годно

> в обычном режиме

Там обмена в разы меньше, только на х1 или старых версиях может негативно сказаться. По крайней мере на платах с 3.0 х4 тензор сплит может уступать по скорости пайплайну в вллм из-за упора в скорость шины.

Я вот тоже задумался.

>Надо достать и доделать

Буду ждать.

>gh pages

Это что за покемон?

> Это что за покемон?

Github pages. Вики треда так же хостится

> в вллм

там 1500+ стреляло

Ссылку в шапке

>• Инфа по запуску на MI50: https://github.com/mixa3607/ML-gfx906

Менять на https://arkprojects.space/wiki/AMD_GFX906 ?

Хз, может можно и вообще убрать. Эти карточки сейчас фиг купишь по нормальной цене. Обладатели сидят в https://discord.gg/q5rXwCtpP

>Эти карточки сейчас фиг купишь по нормальной цене.

Тесты линий полезны всем КМК.

А вообще никогда не думал что нейронка будет советовать эти говноскрипты и имеджи

Нужно кого то на современных гпу, а то у меня из самого нового только дуал 5060ти которые в псие5 проверить возможности нет, только 1.0-4.0

>нейронка будет советовать

Так это же гугл, он тупо из поиска дёргает ответы.

>а то у меня из самого нового только дуал 5060ти которые в псие5 проверить возможности нет, только 1.0-4.0

Всё одно хлеб. Да и 5.0х8 === 4.0х16.

Тесты от потребления

Обычная Gemma 4 26B A4B охуенно распознает текст со скриншотов.

Причем, так как это не тупо ocr, а нейронка, я могу сказать что-то вроде "дай список папок со скрина в текстовом виде" и она дает. Охуенчик, не думал что такие мелкие модели на такое способны.

Причем, так как это не тупо ocr, а нейронка, я могу сказать что-то вроде "дай список папок со скрина в текстовом виде" и она дает. Охуенчик, не думал что такие мелкие модели на такое способны.

Аноны подскажите че в промпте написать чтобы гемма по-разному структурировала текст. Вот допустим я пишу реплику и железобетонно в ответе будут по порядку:

1. Описание реакции с описанием изменения позы или мимики

2. Повтор куска моей фразы или вербальная реакция на фразу, далее обрез реплики опять смена позы и ее описание, продолжение реплики

3. Опять описание изменения позы

4. Конечный диалог который скрывает тупое "твой ход?"

Все это обильно сдабривается "как будто, но, словно, прямо как батин суп мазиком но вместо супа говно а вместо мазика моча. Я хуй знает как компактно такое гуглить и соответственно как компактно объяснить модели писать нормально, не по шаблону. Помогите а я уже устал эту хуйню читать, никак не получается обойти это безобразие ебаное

1. Описание реакции с описанием изменения позы или мимики

2. Повтор куска моей фразы или вербальная реакция на фразу, далее обрез реплики опять смена позы и ее описание, продолжение реплики

3. Опять описание изменения позы

4. Конечный диалог который скрывает тупое "твой ход?"

Все это обильно сдабривается "как будто, но, словно, прямо как батин суп мазиком но вместо супа говно а вместо мазика моча. Я хуй знает как компактно такое гуглить и соответственно как компактно объяснить модели писать нормально, не по шаблону. Помогите а я уже устал эту хуйню читать, никак не получается обойти это безобразие ебаное

Тоже пытаюсь нащупать золотую середину

Мультимодальность прям бустит сценарии использований и общий QOL. Можно не задумываясь ей просто скриншот кидать или страницу манги и не перебивать всё руками пытаясь ей объяснить что это вообще за шиза

>че в промпте написать

Ничего. Это вина не промта, а инпута. Если ты пишешь однообразные чатик-лайк инпуты, то нейронка любая будет под это подстраиваться и выдавать тебе структурно похожие аутпуты. Учись общаться с моделью KRACUBO.

Тесты омникодера кривые, перезагрузился нормально оттестил

>Тоже пытаюсь нащупать золотую середину

Пишут этим лучше чем поверлимитом душить, но я пока не разбирался с ним

https://github.com/ilya-zlobintsev/LACT

Забыл добавить что диалоги вечно растягиваются ебаным или. "Ставь коробку на пол - сказала она пернув и по ляжке потек понос - или ты тоже пернул но понос не потек? Поэтому ты все еще стоишь и тянешь резину?" Вот это классический пример конца текста иишки. Блять уже глаз дергается от этого гавна

Лакт реально хорош, но параметры мишек меняются только грязными хаками pp_table.

Те же 5060ти, он нормально обрабатывает и даже курвы править даёт

И ещё у него есть возможность оставить демон на хедлесс тачке с гпу, а у себя на основной открыть гуй для управления

Да нет, шаблон в принципе всегда присутствует, слегка изменяясь. Это по-моему прикол геммы, другие модели что я тестил пишут по разному в течение всего сюжета, ну или шаблон куда более вариативный. И гемме похуй я чатик лайк написал или длинную хуйню которая двигает сюжет и описывает че ваще происходит. Че я только не пробовал чтобы уебать этот шаблон но нихуя не работает.

Надо попробовать, если он паскаль подхватит

Я такого на меро26б не заметил. Попробуй квину, если гоняешь плотняшу.

> Аноны подскажите че в промпте написать чтобы гемма по-разному структурировала текст.

Уже какое-то время я пытаюсь решить эту проблему. Таково уж поведение Геммы: она очень репетативна, а значит со временем уходит в структурные лупы. Иногда перетягивает целые фразы, слегка их перефразируя, а часто и попросту повторяя. Всякие характеристики персонажей и прочее. На английском очень любит начинать ответы с The или {{char_name}}, обладает кучей паттернов вроде {{char_name}} (действие) (слова) (действие) и прочие. Тюны немного помогают с этой проблемой, но из юзабельных только МероМеро, остальные ломают следование инструкциям. И все равно проблема на месте.

Давай поможем друг другу. Вот тебе логи с ванильной Геммы 4 31б (тобишь instruct), почитай их и посмотри, видишь ли проблему. Будет еще лучше, если принесешь свои логи для сравнения. Потому что никто не делится логами, и я не знаю, это проблемы моего промпта или в целом поведение модели такое.

За lact двачую, годная штука. Может быть довольно тормознутой на мультигпу сетапах, но в остальном работает четко.

Есть варианты контроля gemma 26b в lm-studio? Попробовал просто в систем промпт пихнуть think briefly 3-5 предложений максимум но ей похуй

контроля длины размышлений*

Сорян уже мозг поплыл

В llamacpp есть reasoning budget для чат комплишена. Можно задать конкретное количество токенов - предел для ризонинга, и даже сообщение, которым окончится ризонинг в случае прерывания. Еще один повод попробовать что-то кроме Лм Студии. Они это может и добавят, но позже.

Только жёстко рубить. Ризонинг эффорта в гемме нет.

Но вроде и зачем? Она и так весьма консервативно думы думает

Я кста не знаю че за логи и как их кидать. И сори я не буду их кидать потому что это БЕСПОЛЕЗНО блять. Нехуй сравнивать, вон посередине ты выдал какую-то провокационную фразу и в ответе этой ебаной нейронки до боли знакомое "на комнату опустилась тишина которую прерывал звук пердежа бла бла бла короткий ответ персонажа пук пук продолжение диалога. Вот именно этот говняк меня уже начал бесить просто.

У меня меро кста, как анон ловко заметил

Может вообще можно коннектиться и читать че там у анонов происходит лул.

Я предлагаю объявить бойкот этой ебанной гемме и перекатиться на что-то пиздатое. Я тестил кидонию некоторое время, может там похожий трабл присутствует я ее не особо мучал. У нее другой прикол она диалоги по английски печатает когда сюжет отходит далеко от начального промпта. Я забил на фиксинг потому что гемму накатил которая завелась на моем компе 16+32 и начал активно чатиться с ней. За пару дней заебала эта гемма блять.

> до боли знакомое "на комнату опустилась тишина которую прерывал звук пердежа бла бла бла короткий ответ персонажа пук пук продолжение диалога. Вот именно этот говняк меня уже начал бесить просто.

Это слоп, а не форматирование. Другая проблема. От него не избавиться. В лучшем случае благодаря тюнам, и неизвестно какой ценой.

Не избавиться? Пфф. Окей ребятки ребятушки посоветуйте быстрое умное и хорошо пишущее по русски ии поделие без цензуры кек. И штобб ммпрож файлик был чтобы картинки съедала.

Нет такого, если ты не можешь уместить самые большие (350б+) модели. На русском все плохо пишут, возможно, даже самым жирным вроде Кими (1000б) Гемма даст фору. И у многих еще нет вижена.

Я когда свой сервер держал через линуху жору и накатывал, а сейчас с ноута на винде и тут как-то западло через жору крутить.

У меня как-то сильно он фигачит на офф. кванте лмстудии, поставил анслотов на пробу с ним вроде вообще не думает, лол. И так тоже не хочется.

Я бы рассмотрел еще что-то с гуей, но знаю только угабугу и кобольда, обе неюзабельные будто.

Разве что клод с безжопом. Больше вариантов то и нет под твои требования. Но это тебе в асиг надо пиздовать.

У Лламы есть гуй и очень приятный

А у нейронок есть какая-то память? Она просто подцепила мой возраст который я юзал в промпте другом. В текущей ветке я его не упоминал. Я думал новый чат создается всегда с чистого листа

Та где, я скачал а все также. Там был какой-то чатик просто потыкаться, но гуя все также нет?

Ты явно не понимаешь как они работают. У ллм нет никакой памяти, они детерминированы.

Фронт может делать свои надстройки к примеру скрыто давать нейронке тул которым она будет в память фронта записывать заметки, а потом в другом чате их читать и так шарить контекст.

В том же чатгопоте это называют "памятью"

Ай похуй раз уж скачал просто запилю настройки по новой.

Какая тут уебищная капча стала это пиздец

Ой бля, какой же кал лмстудия, тут в жоре сразу нормально встало и заработало скорость в полтора раза больше))

Наберите в лёгкие воздуха поглубже.

КАААА-К НАЗЫВАЕТСЯ ЭТА МОДЕЛЬ????

КАААА-К НАЗЫВАЕТСЯ ЭТА МОДЕЛЬ????

GAYMMA.

Каломаз на семплерах

YAAAY!

Ни разу не слышал это слово в треде. В чём мем?

----------------------------------------------

Короче, я чё только с геммой не делал. Если просто задирать температуру, почти нихуя не происходит, я в ахуе. В том числе если дёргать за ручку других семплеров.

Как вариант, можно поменять порядок семплеров, вот тогда результат есть. Температура добавляет где-то к 15% креативности без потери логики, но это максимум. Если пробовать давить сильнее, то просто ухудшение качества письма, потом шиза. Там не предлагаются другие КОНКРЕТНЫЕ токены, где выбор между "пизда" и "вульва" (в большинстве случаев) или даже какие-то куски слов. Там просто "вульва" и ohers (треш в виде спецсимволов). Ну это касается не только NSFW.

То есть у модели есть только выбор между ПРАВИЛЬНЫМ и всем остальным.

Мне очень интересно — а нельзя ли так в будущем обеспечить полную цензуру модели, даже не удаляя сисик из датасета? Вы ведь сами видите, что чем дальше мы идём, тем меньше требуется надрочка семплерами, особенно если речь не про код, а любые креативные задачи. Можно вообще все семплеры не использовать, только стандартную температуру, и модель не потеряется. Это отлично видно на примере геммы или того же гпт. Сейчас ещё квен 3.6 попытался ввалиться в эту тему.

Хотя, полагаю, они делают это, чтобы прохождение бенчей было максимально корректным. Но с таким "охуенным" обучением можно модели вообще не оставлять выбора, даже если в датасете есть что-то ЗАПРЕЩЁННОЕ.

Может прозвучит тупо, но вы пробовали посреди рп сделать паузу и просто в этом же чате обсудить текущие проблемы? Задать вопрос почему модель так отвечает, чем тебе это не нравится и как это можно исправить. Да, немного "мусорного" контекста будет, но почему не попробовать?

Я нашёл только один способ влиять на геймму - бить её лицом о презенс пенальти, пока свайпы не станут разными. Всё остальное отказывалось работать.

Это называется ООС. С подключением.

Подключился, теперь знаю что это называется аут оф чар. Тогда почему бы не попробовать так решить жалобы на статичное начало реплая?

>Ни разу не слышал это слово в треде. В чём мем?

Каломаз автор кучи семлеров, каждый из которых обещал революцию и освобождение от залупов. Результат немного предсказуем.

> Ни разу не слышал это слово в треде. В чём мем?

Ньюфаги не знают, альфаки забыли.

Давным давно когда контекст был по-настоящему маленьким а ллама - фаворитом опенсорсных моделек, был да и сейчас есть юзернейм (никнейм kalomaze или что-то подобное), который любил пердолить семплеры. Будучи автором концепции min-p или удачно спиздив идею откуда-то он очень активно пиарил его, как раз делая сравнения как работают модели с высокими значениями температуры, демонстрируя что с обычной комбинацией top_p + top_k случается бредогенератор, а с его min_p даже если выставить значение 4 то когерентность ответов сохраняется.

Только далеко не все выкупили что суть не в отсеивающем семплере, который повторял логику сочетаний других, а в порядке применения. Там где "хорошо" - температуру он ставил самой последней, когда уже сработали все отсечки и оставалось буквально несколько логитсов. А где бред - наоборот самой первой как было по дефолту, делая возмущение оригинальных распределений.

Если изменить порядок семплеров и воткнуть температуру пораньше - пробьет даже такое.

>есть только выбор между ПРАВИЛЬНЫМ и всем остальным

>интересно — а нельзя ли так в будущем обеспечить полную цензуру модели

Для тулзов, кодинга и агентской хуйни это рабочий подход ибо уменьшает затупы и случайный берд. Но это и отличный метод для впихивания мягкой цензуры. Гемма умеет и практикует обходить всякие откровенные описания даже если пробить хард рефьюз, которых почти в ней не оставили. Так что да, за этим видимо будущее.

>Задать вопрос почему модель так отвечает, чем тебе это не нравится и как это можно исправить.

Можешь даже не пробовать, модель тебе напиздит. Может дать общие советы которые сработают, но если ты ее прямо спросишь почему она написала так, а не так, то просто получишь бред. Это как спрашивать "какой токен ты бы сгенерировала следующим в этом списке" - она предположит, может даже правильно, но это не будет иметь никакого отношения к реальности.

>Да, немного "мусорного" контекста будет, но почему не попробовать?

Ты не можешь знать насколько он будет "немного" мусорным. Вообще никогда не нужно оставлять в контексте ничего что не относится к текущему сценарию. Решил взять паузу и поговорить? Поговори и удали нахуй всё это сразу же, как решишь вернуться к ролевке. Не нужно триггерить ассистента без надобности.

>Тогда почему бы не попробовать так решить жалобы на статичное начало реплая?

Решай, никто не запрещает пробовать и экспериментировать. Но железное правило остается - контекст должен содержать только то, что относится к сценарию. Попросил модель переписать ответ через OCC? Скопируй новый вариант, замени им неправильный, удали все эти вызовы ассистента из истории. Лично я так давно уже делаю когда мне лень свайпать до нужного развития событий - просто пишу что должно произойти дальше именно так как мне хочется. Да и думаю я не один такой.

Вот честно? Я бы никогда такую подлость не сделал и даже не ожидал бы ни от кого. Вот чтобы нарочно вставлять палки в колёса - это каким мудаком вообще нужно быть? Человек пишет в тред где его ненавидят, что само по себе испытание, а ему ещё и отвечают ехидно так "ну хз, может так, а может нет." - это что такое вообще?

Нет бы сказать - неверно, переделывай. Или наоборот - верно, молодец.

Нет бы сказать - неверно, переделывай. Или наоборот - верно, молодец.

Так а что ты хотел, тут снобы-шизы сидят с самомнением до неба, которые нос корчат на любых новичков. Такая же херня в аицг была, и в других тредах по нейронкам часто наблюдается. Тут не про помощь короче, тут своя атмосфера для шизов.

NVIDIA TESLA K40 12GB

Nvidia Tesla M40 12GB

NVIDIA - Quadro K6000 - 12GB GDDR5

NVIDIA GeForce GTX Titan 12GB GDDR5

У меня только такие есть по выгодным ценам ниже 200й серии карт.

Есть смысл заморачиваться хоть с одной из них для ллмок?

Про что речь вообще? Что за вакуумный чел которого все ненавидят но он все превозмогает? Таких за всю историю тут немало было, но если кого-то из новичков сразу слали нахуй, так это тех, которые приходили с ахуевшими требованиями по типу "дайте это, дайте то, и вообще я не хочу ничего читать, ничего учить, дайте мне пресет/промт/семплеры/карточку/прокси для безлимитной связи с аллахом" и прочее. Остальным всегда помогали. Мне лично много кто помогал в свое время, когда я только вкатывался.

Гемма 4 31B, 2х3090

q4km в лламацпп - 25 т/с

exl3 - 10 т/с (причем одинаково на 4.0 и 6.0 bpw)

Ну и что за нахер? Почему так?

q4km в лламацпп - 25 т/с

exl3 - 10 т/с (причем одинаково на 4.0 и 6.0 bpw)

Ну и что за нахер? Почему так?

Эйрошиз который месяцами срал в треде вымаливает себе жалость. А что случилось? Как так вышло?

>снобы-шизы сидят с самомнением до неба, которые нос корчат на любых новичков.

Ухбля такие снобы шопиздец, каждому адекватному вкатышу помогают и даже какие то рентри для них пилят. Чё не сделают чтобы потешить своё чсв и поржать над залётными

Нахуй иди, сём

Эйрошиз и нюня это разные шизы? После пары месяцев отсутствия лор треда пополнился и когда я вернулся все через пост вспоминали какого-то нюню в контексте эйра как раз.

В мире есть только одна страна, которая в ссоре сразу с обоими странами и где используется русский язык в системах.

Один чел вспоминал срал, за что и был назван эйрошизом. Так и сидит на Эйре и теперь умоляет ему помочь и удивляется, что никто не помогает. Не корми

Так эйрошиз его и вспоминал постоянно, но как тереть стали теперь иначе щитпостить. Натура такая у человека - не может не срать.

Понятно, вопрос снимаю. В некоторые вещи видимо лучше не углубляться.

Максимально тупой вопрос касательно хардварной части, что лучше: 64гига ддр4 оперативы или 32гига ддр5 при одинаковой 16гб карточке? Алсо есть еще примерные циферки разницы по частотам на ддр4? Например какая разница будет при 1800кекагерц vs 3200.

>что лучше: 64гига ддр4 оперативы или 32гига ддр5

Очевидно что первое. Но только если вопрос финансов прям жестко стоит и 64 ддр5 ты не можешь позволить. Собирать новую систему на ддр4 это уже как-то тупо. Докидывать память к старой - приемлемо.

>Например какая разница будет при 1800кекагерц vs 3200

Точно не скажу, лучше посмотри тесты скорости памяти на разных частотах. Но разница будет. Ощутимая, если ты гоняешь мое с частичной выгрузкой. Менее ощутимая, если денс. Потому что на плотных там может быть разница между полутора токенами и двумя токенами, где-то в таком разбросе. В процентах разница существенная, на глаз и на ощущения - почти незаметно.

Я даже никого не оскорблял, максимум по дружески называл шизом и иногда выражал мнение в нескольких постах. А то что на меня всех щитпостеров и шизов треда свалили - я с этим ничего сделать не могу, я - Лелуш Ламперуж/Саске Учиха этого треда, взял все грехи и ненависть на себя, чтобы вы лучше жили.

Система с ддр4 готовая уже есть, задумываюсь просто над целесообразностью обновления или проще будет докинуть с помойки еще 2 плашки по 16 и посидеть-потерпеть еще лет 5 с текущим сетапом пока вся ебатория не закончится.

>на глаз ощущения почти незаметные +-

сенкс

Скорее цель твоего сталкинга нюня такой, а ты долбаёб обычный

Я в гемме для кума юзаю вот такие настройки, проблем не замечал.

override-kv=gemma4.final_logit_softcapping=float:25

samplers = min-p;adaptive-p;temperature

min-p=0.05

adaptive-target=0.4

adaptive-decay=0.8

temp=1

Если бы у меня была нормальная мать я бы тоже еще 32 гига докинул до 64 и не знал беды. Так что имхо - лучше сэкономить и докупить еще памяти.

лучше 64гб памяти, 32 это капец мало, в видеогенерациях приходится без кеша сидеть иначе оом будет.

а ddr4 от ddr5 в целом не особо отличается в производительности, зато в цене очень даже отличается.

>докинуть с помойки еще 2 плашки по 16

Лучше докинь не с помойки две плашки по 32Гб. Без фанатизма на ~3000 кекагерц.

>при одинаковой 16гб карточке

После того как отдашь долги от перового шага купи еще одну карточку 16гб .

Итого у тебя будет "народный DDR4 риг" 96гб RAM 32гб VRAM . На нем можно уверенно гонять свежие небольшие плотняхи и moe до 122 квена (хуево, но можно) . И генерить картиночки.

Это практически предел для не серверного / майнерского железа / продажи жизненно важных органов за топ-GPU

Гораздо приятнее выводы чем у меня. Какие семплеры или в чём секрет?

Если ты используешь мелкие модели до 35B активных параметров, ддр4 сойдет

Просто для сравнения:

> 2 канала 128гб ддр4, GLM 4.7 Q2: ебаных ТРИ токена в секунду (ну ладно, 3 - 4)

> 4 канала 128гб ддр4, GLM 4.7 Q2: вдвое быстрее

> 2 канала 128гб ддр4, MiniMax M2.7 Q4: 5 - 6 т/с

> 4 канала 128гб ддр4, MiniMax M2.7 Q4: вдвое быстрее

Я бы не советовал брать ддр4, если у тебя не HEDT или серверная платформа.

Дорого, да и в наличии уже 32 есть. Вторую карточку точно нет, слишком дорого + под нее бп надо и что-то с матерью придумывать, слотов полноценных свободных нет.

спасибо за ответы

Это циферки под виндой в llamacpp и с максимально возможным контекстом если что, я не линупс и не любитель "тестить" скорость на инпутах из одной строчки

Разметка (вся чатхистори в качестве первого сообщения, модель генерирует второе) + температура 1, min p 0.03, adaptive p 0.5 0.9, DRY + промпт с нарратором и направлением форматирования, что размазывает (но не решает до конца, предполагаю) проблему структурного лупинга. Попробуй adaptive p, там и разнообразие свайпов какое-никакое есть, относительно стандартной температуры и min p. Тот чат до 64к доиграл, в целом доволен результатом.

>NVIDIA GeForce GTX Titan 12GB GDDR5

Титан из них лучший - считай тесла P40, но с половиной видеопамяти. Насколько выгодная цена, чтобы не купить саму P40?

>adaptive p

Это ж тот хайповый сэмплер который никто тут не потестил в итоге?

Ну или не сказал что потестил.

Как он в тех же глмах и квенах себя чувствует?

Знали бы вы, чего я тут с 31B геммой натворил... Эта модель и легкодоступные 256к контекста открыли дорогу в ад рай из прошлого. Но с ней надо работать, как скульптор работает с камнем. По дефолту это просто неотёсанный кусок бездушной скалы.

> sysprompt: биография от рождения до конкретного дня

> post-history: инструкции, убивающие ассистента напрочь

> character card: одежда, внешность и Q&A с диалогами из реальных чатов

Мягко говоря, результат такой, что я теперь собираюсь переписать всех вымышленных персонажей, опираясь на ту же идеологию. ОЧЕНЬ много ручной работы. C-GPT/DS4 помогали, но сами они не въезжали ни в суть, ни в глубину. С лингвистикой и психологией дали разобраться, развве что.

Еще немного этого безобразия.

Год назад подобное было невозможно. Гемма творит чудеса именно благодаря тому, какая она умница и как хорошо слушает команды.

Вообще перехотелось рпшить когда заглянул в хорошую карточку, а потом на всё на чём я рпшил, взяв это с чуба.

Кумерские карточки реально одни дегенераты делают, такие только корпы переварят и не сломаются

Кумерские карточки реально одни дегенераты делают, такие только корпы переварят и не сломаются

Кто то должен был это сделать

Если ты про объемы текста - дело не только в неспособности большинства моделей не лажать на длинном контексте, но еще и в качестве этих самых объемов текста. Чубатые карточки содержат массу бессвязного мусора.

Признавайся, спиздил откуда-то или сам купил?

А что делать, если у меня нет чатов с ЕОТ и про ее историю жизни я знаю мало?

Слишком медленно для обоих кейсов. Давай подробный конфиг и прочее

Немотроношиз, эрошиз и много других приставок-шиз это один и тот же человек.

Для фуллврам нет разницы. С выгрузкой ддр5 будет быстрее, но в то что останется от 32 гигов после системы, браузера и прочего - считай ничего не влезет. В идеале 128гигов рам, тогда можно потыкать большие модели, с некоторыми оговорками офк.

> сам купил

Это. Самая дешёвая карта с av1

> с 31B геммой

> легкодоступные 256к контекста

Мажор

Почему q4_1? Если будешь еще тесты делать - не стесняйся выкладывать, интересно посмотреть что там будет.

>Слишком медленно для обоих кейсов. Давай подробный конфиг и прочее

А сколько должно быть? И насчет конфигов я не понимаю, в убабуге для exl3 нет никакой командной строки, чтобы там чето дописывать. TP не работает для геммы в эксламе.

Если же ты про железо. Ну епт, две 3090 каждая х16 4.0 в trx40 маманю воткнуты, по мощности не задушены.

>пик 2

ЧАТ ТЕМПЛЕЙТ психически здорового человека

Есть ли способ быстро в веб интерфейсе лламы менять промты? Или может есть флаг на подачу сиспромта для модели когда запускаешь ее?

Бля, потерпишь. Охуеть, будто в ИЛИТНУЮ КОНФАЧКУ в вк зашёл даже свой вахтер есть, а не на тред на дваче. Сидят рассуждают что щитпост а что нет, кому помогать а кому нет, попуститесь и корону снимите, у вас тут нет аватарки и репы чтобы набивать

К сожалению у геммы умная думалка начинает разваливаться задолго до 256к.

Графики приносили на неделе то ли сюда то ли на форч с разными моделями, все модели из этой весовой категории где-то на 20к~ начинают потихоньку терять внимание к старым деталям. хорошо хоть потихоньку, более старые/мелкие модели дропаются как кирпич, прям чётко видно где предел возможностей модели По моему опыту тоже примерно так и есть. Поэтому изначальные описания и надо вилкой чистить-чистить.

Где-то на уровне мистралей минмаксов и дипсик флешей уже можно делать как ты, и модель будет выдавать пушку

Я пока до 120к длины чата на гемме дотягивался. Встречал другую проблему - ответ на предпоследнее сообщение, игнорируя последнее. Так и не въехал, в чем дело.

> дипсик флешей

Еще бы поддержку по-человечески допилили...

Может ли камень плотить нологи серверная BMS на аспиде 2500 ролеплеить мейдочкой?

Вы заметили что с появление мое у нас пошло классовое распределение куда активнее? Теперь любой бомж дорвавшийся до 128 рам по скидке наверху цепочки, а анончикам ниже с баренской руки, жалобно так, протягивает мое гемму

Бывало такое и было буквально вчера на совсем небольшом контексте, как понимаю баг с токенайзом/чекпоинтами. Может фронтенд чудит (в таверне было)

*BMC

Может и может под вулканом, но это чёт совсем уже пиздец.

Ещё есть отдельная карточка с 2400 на 64 мб ддр3

>где-то на 20к

У меня одни промпты с карточкой на 30к+.

Может, от квантов зависит, конечно.

А вообще (я очень жалею, что не могу поделиться - слишком личное), для этого проекта всё написано так, что слёт внимания с отдельных блоков не должен ударить по общей картине. Много кросс-референсов и усилительных указателей. Такая плётёная булочка из лингвистики и психологии, и все это опирается на линейно текущую прозу по годам жизни (0-3, 4 - 6, 7 - 11, 12 - 15, 16 - 17, 18), где перечислено всё - от семьи до увлечений, школы, института, друзей, мест, событий, праздников.

Иронично, я убил несколько дней на создание отдельного лорбука... но с ним ничего не взлетело, личность распадалась на обрывки. Лорбук хорошо бы зашел дополнением, но это гемма 100% не потянет.

Плохенько. Из моих наблюдений был сделан вывод, что содержание сообщения не влияет на этот баг (отредактировал - все равно модель не хочет признавать это сообщение за существующее). Позволяешь ей ответить ошибочно. Пишешь следующее сообщение - и на него модель уже отвечает нормально (тоже вне зависимости от содержания). То есть, что-то происходит, что сообщение вот такое-то по порядку в истории чата, превращается в "невидимку".

128гб это территория простых хуев. Зажиточные бояре начинаются от 256гб.

Ещё 128 ддр4 не ровня 128 ддр5

4-канальная вполне терпима, 8-канальная так вообще в шоколаде.

16 каналов это уже 300гбс

Квантование контекста до q8 на гемме это смерть ? Мнения без регистрации и смс

Смотря для чего. Если ты пилишь грязный чатик с ноунейм хуйлищем, на детальные подробности о котором тебе насрать - тогда квантуй. Ну подумаешь, ногу с рукой перепутает или рога на жопе вырастут (это сильно преувеличено).

Это надо вживую тестить и сравнивать.

Да хер там плавал. если большая часть exps работает на процессоре это 8-15 т/с и ~200 тс пп . И моделей на хорошем русском нет. И модель быстрый переводчик за грузить тупо некуда.

> И модель быстрый переводчик за грузить тупо некуда.

У вас че все в одном компе? Сервер для пухло-бота отдельно, основная пекарня отдельно.

Если у меня будет возможность купить 2 видюхи одинаковые по мощности я их вставлю в один комп очевидно, а не одну в сервер и одну в основной комп.

Если у меня будет 64 рам я их так же вставлю в один комп а не разделю

Ну так две видюхи в сервере, а третья в отдельном компе. Подумой. Купи болбше.

Конечно у всех есть по лишней стойке GB200

Какое ваше мнение что 1гб рам уже стоит 1.5к?

Да, если не турбоквант

Гемма не любит квантовку контекста

Купил 3090 после долгих сомнений и томлений, и... ничего.

Никакой радости.

Понимаю, что херня это все и коуп, локалки всегда будут туповатой отсталой ерундой на фоне 1Т (или сколько уже там у них) корпов. Странно, что я понимал это всегда, но прям сильно торкнуло это понимание именно после слива почти 100к.

Разве что на случай чебурнета реально пригодятся.

Никакой радости.

Понимаю, что херня это все и коуп, локалки всегда будут туповатой отсталой ерундой на фоне 1Т (или сколько уже там у них) корпов. Странно, что я понимал это всегда, но прям сильно торкнуло это понимание именно после слива почти 100к.

Разве что на случай чебурнета реально пригодятся.

Никем непонятый хиден гем?

https://huggingface.co/rednote-hilab/dots.llm1.inst

https://huggingface.co/rednote-hilab/dots.llm1.inst

В чем смысл рандомных ссылок? Попробуй, отпиши своё кря по модельке.

вышла 9 месяцев назад, всем похуй, видимо говно.

потыкай сам и отпишись нам

>после слива почти 100к.

Жестко тебя наебали, конечно.

мимо купил ДВЕ 3090 за 100к год назад

128-е, пробовали волшебный квант 397 квена от интела?

https://huggingface.co/Intel/Qwen3.5-397B-A17B-gguf-q2ks-mixed-AutoRound

На 235 такой же был и зашёл всем кто тестил

https://huggingface.co/Intel/Qwen3.5-397B-A17B-gguf-q2ks-mixed-AutoRound

На 235 такой же был и зашёл всем кто тестил

Лень, да и зачем. Гемма все убила.

Максимум что смог впихнуть это 4 квант 14b с +-16к контекста без квантования и особых подстроек(можно и до 32к наверное впихнуть).

А вот его бенчи, больше в 10гб врам не впихнуть ничего умнее.

>Купил 3090 после долгих сомнений и томлений, и... ничего.

>Никакой радости.

Ставь Pi, запускай на 3090-й Квена-3.6 27В и открой локалки заново. Да, это не большой Квен, но из малых сеток он лучший имхо. Контекст мало весит и чёткий, русский очень хороший. Заточен под агенты и код, но может и всё остальное. А главное - теперь это всё для тебя быстро. Beellama.cpp тут один экспериментатор выпустил - 50 t/s на 5QKS для 3090. Одной.

>А главное - теперь это всё для тебя быстро

>50 t/s

>Читаешь со скоростью 7т.с

>50 t/s

Марина с мульти-агентным шагом мира - "подержи мое пиво"

>Читаешь со скоростью 7т.с

Плюс агент ризонинг, ага. А запись в файлы от модели тоже ждать на семи т.с.? Ну и промпт процессинг... Для РП покатит конечно, а для работы чистый мазохизм. А ведь сделать-то многое можно, на Квене-то.

>Марина с мульти-агентным шагом мира - "подержи мое пиво"

Не, там сама идея порочна. Разве что корпы юзать, много.

Вот скажите, с приходом геммы4 старые модели типа сидонии все еще актуальны?

Интеренсуют модели с хорошим русским.

Какие классические старые модели вы оставили у себя?

Интеренсуют модели с хорошим русским.

Какие классические старые модели вы оставили у себя?

Ну чел, проверь сам и реши что хочешь. Кто то любит кислое, кто-то сладкое. Кому то нормальную еду, кому-то говно

Гемма 4 это генератор ассистентского трэша, если ты не гуру промпт-инженеринга или не дурачок, который не замечает как ИИ подмигивает юзеру и лепит мета-фразочки, цитирует инпут, ссылается на контекст цитатами и так далее.

Старые модели актуальны для ленивых хлебушков, ведь с ними проще добиться иллюзии живого персонажа. Чем новее модель, тем меньше в ее дефолтных ответах человечности и живости.

> Какие классические старые модели вы оставили у себя?

Ни одной, потому что я люблю пердолиться с геммой.

Пробую на вкус безумные васяномержи, сеймы есть?

https://huggingface.co/Nimbz/Gemma-4-Gembrain-31B

Русик целый, мозги вроде на месте, кум наличествует.